2026 AI Agent爆发元年:从替你干活到重构人机分工,这3个趋势决定未来十年

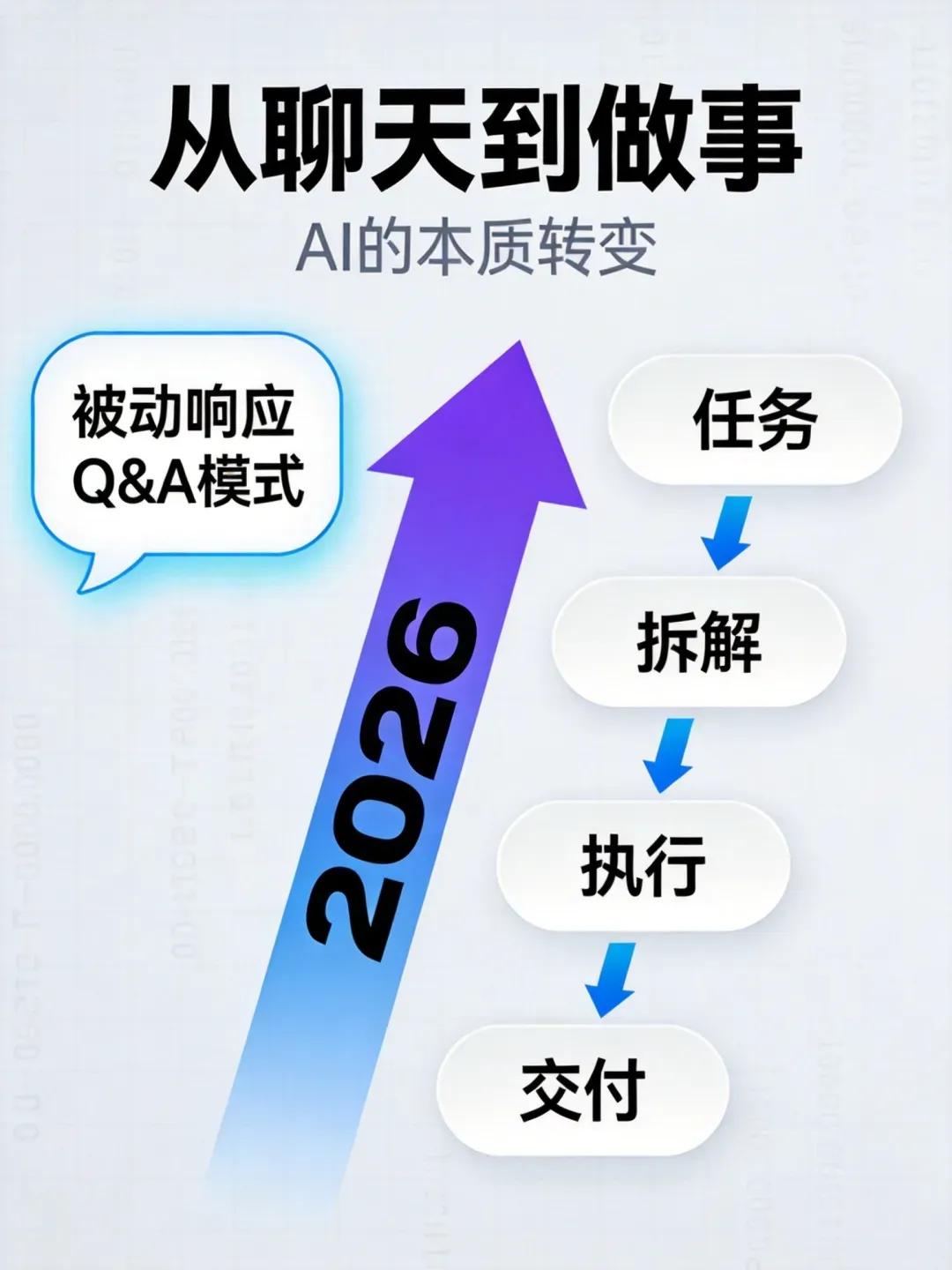

读懂技术拐点:从“被动响应”迈入“主动代理”

梳理关键时间线:

2025年——AI Agent元年

:商业启蒙与技术突破并行

2026年——AI Agent爆发元年

:规模化落地,全面商用到来

2025年是AI Agent技术真正破局的一年,三个标志性事件定义了这轮跃迁:

2025年1月

:OpenAI推出Operator,作为第一款真正意义上的通用AI Agent,它把“从回答问题”跨越到“完成任务”变成现实

2025年6月

:Anthropic发布Computer Use,AI首次获得对电脑界面的原生操作能力,Agent的能力边界扩展至整个软件生态

2025年10月

:Google发布Project Mariner,多模态Agent由此具备跨平台、跨应用的复杂任务执行能力

进入2026年,AI Agent技术从实验室走向大规模商用,真正迎来“爆发元年”。就在上周,我用AI Agent处理了一场三个小时的部门复盘会:它可以自动转录会议语音,提炼12条待办事项并精准指派责任人,还同步生成了项目进度更新报告,全程只需8分钟——而同样的工作如果靠人工完成,至少需要两个小时。这已经不是科幻,而是此刻正在发生的现实。

OpenAI在2026年推出的GPT-5.5 Agent Edition,其核心升级并不在于参数体量,而是Agent协作能力。说白了就是:以前是你问它答,现在是你定目标、它执行。微软CEO纳德拉说得非常直白:“未来每家公司都将深度集成AI智能体——不是因为他们自己训练模型,而是因为AI已经嵌入每一个工作流。”

国内的变化更加迅速。阿里、腾讯、字节、智谱已几乎全线布局OpenClaw智能体生态,支持多端协同、多Agent深度配合。“一人公司”不再是一句自嘲,而是真的可以用AI员工完成设计、文案、客服,甚至是供应链管理的整套工作。根据OpenRouter与《每日经济新闻》2026年5月的数据,国内大模型周调用量已突破7.9万亿Token,连续两周超过全球其他地区的总和。

拆解真实案例:Agent如何重塑各行各业

西门子于2026年4月发布的Eigen Engineering Agent,在全球19个国家的超百家企业试点中,工程效率提升约50%,设备调试时间缩短了35%。它不仅能够预测设备故障、自动调整运行参数,甚至可以用自然语言向工程师解释决策背后的逻辑。

医疗领域,蚂蚁集团联合华西医院、北医三院训练出的“安诊儿”千亿参数医疗大模型,已经在辅助病历生成、影像初筛等场景中落地,帮助医生减少30%的文书工作负担。更关键的是,它能提供标准化的诊断参考,有效降低因医生经验差异而造成的误诊风险。

金融领域的落地效果同样令人瞩目。蚂蚁集团的智能风控Agent体系,在2025年协助公安反诈部门保护了35.6亿元资金,其SHIELD风控模型已经将欺诈风险率控制到万分之一以下。我有一位在银行从事风控工作的朋友告诉我,现在他们部门80%的基础审核工作都交给了Agent,人力主要集中在异常case复核与策略优化上。

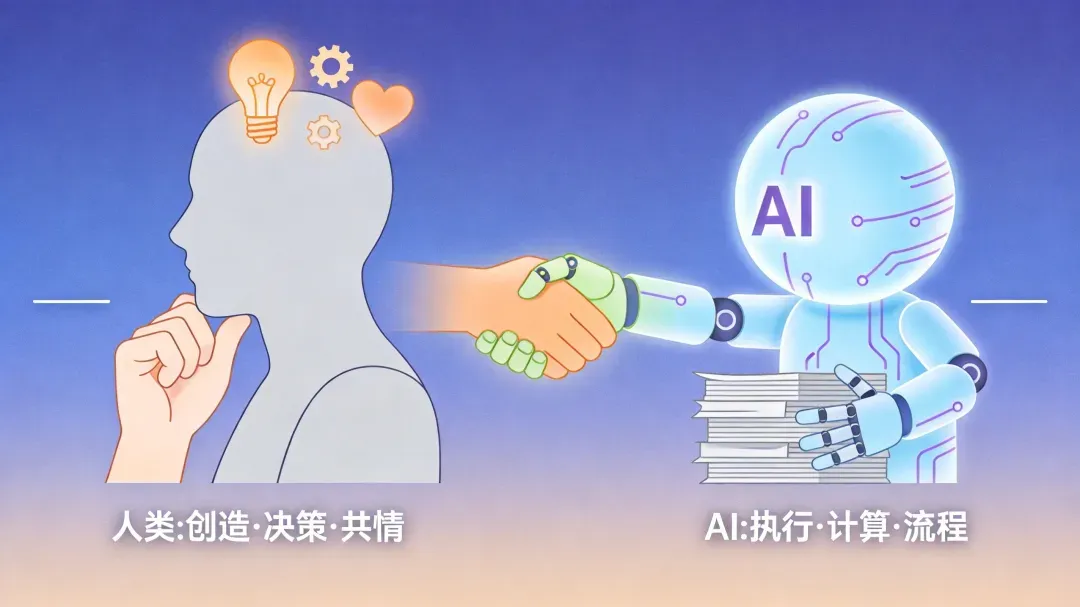

算清就业这笔账:AI带来的不是替代,而是分工重构

很多人一看到AI就难免焦虑:我会不会被替代?世界经济论坛发布的《2026年未来就业报告》给出了更客观的视角:到2026年底,AI将影响8500万个岗位(其中一部分被自动化替代),但也会同时创造出9700万个新岗位,净增1200万。

问题的关键不在于“会不会被替代”,而在于“你站在价值链的哪个位置”。规则明确、重复性高的工作——基础客服、数据录入、简单翻译——确实会逐步由AI承接。然而,AI运维工程师、人机协作设计师、AI伦理与合规官等新兴角色,正迎来爆发式增长。

麦肯锡的报告更为直接:到2026年,全球将短缺200万AI专业人才,缺口尤其集中在“AI工程+行业应用”的交叉领域。如果你正处于职业转型的岔路口,大可不必恐慌,但必须主动拥抱变化。试着从“执行者”转变为“指挥者”——学会如何为AI设定清晰目标、如何评估AI的输出质量、如何管理人机协作流程,这才是未来十年的底层能力。

预判未来趋势:3个方向决定你能否抓住红利

第一个方向,个人AI代理的普及。苹果、谷歌、阿里都在积极布局“个人AI代理”生态。IDC预测,到2026年底,全球将有超过3亿人使用个人AI代理服务。你的AI不再只是语音助手,而是能够代表你行事的“数字分身”:帮你预约医生、比价购物、规划旅行,甚至自动整理会议纪要、跟进待办事项。

第二个方向,多模态深度融合。2025年的AI Agent还停留在执行单一任务阶段,到了2026年,它已经能够看图说话、听声辨意、理解复杂场景。Gartner的数据显示:到2026年,75%的企业级AI系统将具备多模态能力,这一比例在2025年初还不足10%。纯粹的AI技术公司可能会面临洗牌,而“懂行业+懂AI”的复合型玩家将最终胜出。

第三个方向,可信AI成为标配。欧盟《AI法案》已进入全面执法阶段,高风险AI系统必须通过透明度和可追溯性审查。中国也在加快人工智能立法,《人工智能法》有望在2026年内完成制定,届时生成式AI服务将被强制标注“AI生成”。那些一味追求效果却忽视责任的AI产品,将会被市场淘汰。

最后说几句掏心窝子的话。2026年,AI并不会取代人类,但它会取代那些“不会使用AI的人”。这场变革的核心,不是技术有多酷炫,而是我们如何重新定义“工作”和“价值”。当AI能够处理信息、执行任务,甚至参与决策时,人类的核心竞争力将回归到那些AI难以模仿的维度——创造力、判断力、同理心,以及对意义的追寻上。

你现在的工作,有多少是AI已经能够完成的?你又在为那个“AI无法替代的自己”做着怎样的准备?欢迎在评论区聊聊你的看法。

2026 年 AI 官方技能库 Agent 完全指南:Anthropic、OpenAI、MiniMax 技能一网打尽

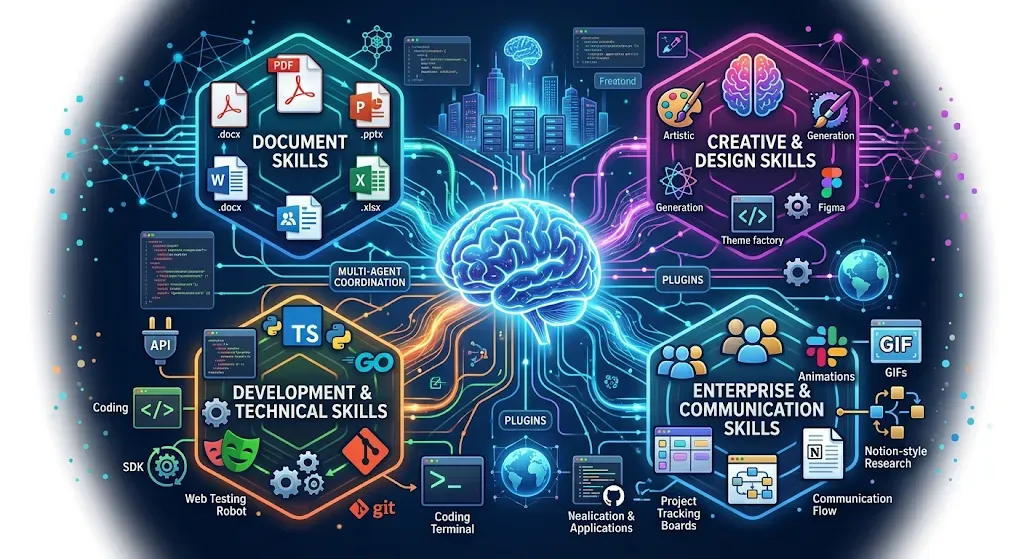

Anthropic 官方技能库

功能总览

该仓库提供了 17 种技能,划分为四大类别,覆盖文档生成、创意设计、开发集成和企业协同等不同方向。

文档处理技能

这些技能赋予 Claude 创建与编辑专业文档的能力,能够应对复杂格式的文件生成与操作需求。

| 技能名称 | 功能简介 |

|---|---|

| 支持 PDF 的读取、文本与内容提取、合并拆分、页面旋转、水印添加、创建新文件、加密保护以及填充表单等全方位操作 | |

| docx | 可创建、读取、编辑和格式化带有专业版式的 Word 文档,精确控制排版与样式 |

| pptx | 从零创建演示文稿幻灯、编辑现有模板,同时能够读取并深入分析已有演示文件的内容与结构 |

| xlsx | 创建、编辑并分析包含公式、格式化规则及财务建模标准的电子表格,支撑数据类工作 |

创意与设计技能

这一类别聚焦于视觉输出,涵盖从生成艺术到精致前端界面的各种设计场景。

| 技能名称 | 功能简介 |

|---|---|

| algorithmic-art | 基于 p5.js 创建生成艺术,并可利用种子随机性与交互参数控制艺术效果的变化 |

| canvas-design | 运用设计理念与不同美学流派创作高质量的 PNG 和 PDF 视觉艺术作品 |

| frontend-design | 构建拥有出色设计品质、独特风格且可直接用于生产环境的 Web 界面 |

| theme-factory | 为任意产物快捷应用专业的配色、字体主题(内置 10 套预设,也支持自定义主题) |

| brand-guidelines | 将 Anthropic 官方品牌色彩与排版规范应用到产物中,确保品牌一致性 |

开发与技术技能

面向使用 Claude API 进行构建、集成与测试应用的开发者,提供技术支撑。

| 技能名称 | 功能简介 |

|---|---|

| claude-api | 支持使用 Claude API 或 Anthropic SDK,以 Python、TypeScript、Go、Java、Ruby、C#、PHP、cURL 等 9 种以上语言构建应用 |

| mcp-builder | 使用 Python 或 TypeScript 创建高质量 MCP(Model Context Protocol)服务端程序 |

| webapp-testing | 通过 Playwright 并结合服务器生命周期管理,对本地 Web 应用进行自动化测试 |

| web-artifacts-builder | 使用 React、Tailwind CSS 和 shadcn/ui 构建包含多个组件的 Claude.ai 产物 |

| skill-creator | 用于创建新技能、改进既有技能,并通过基准测试来评估技能的实际表现 |

企业沟通技能

简化组织内部工作流程和沟通文档创作的技能套件。

2026跨境电商货源指南:十大中国核心产业带一网打尽

在全球化的浪潮中,跨境电商为商家打开了充满机遇的市场大门。然而,想在白热化的竞争中立足,锁定优质、稳定的货源成为决定性的一环。中国作为世界制造强国,孕育了众多跨境外贸核心产业带,为全球采购商提供了极为丰富的选择。对于每一位跨境电商人来说,深入了解以下十个关键产业带,是寻源路上不可或缺的功课。

义乌小商品:世界小商品贸易的绝对枢纽

作为全球最大的小商品集散中心,义乌凭借庞大的义乌国际商贸城,汇聚了43个行业、1900个大类、超过170万种商品。这里从精巧的工艺品、时尚饰品、小五金,到日用百货、雨具、电子电器、玩具、化妆品、文体用品和袜业等日用工业品一应俱全,堪称一站式小商品采购的天堂。

深圳消费电子:完整产业链驱动的创新高地

全国约90%的消费电子类企业扎根深圳,形成了从研发、生产到销售无缝衔接的完整产业链,并以强大的研发创新能力独树一帜。亚洲最大的电子产品聚集地华强北,其配套市场价格直接与国际市场同步。深圳消费电子产业不仅主导着全国电子配套市场,影响力更辐射至东南亚和欧美等全球重要区域。

中山灯饰:璀璨全球的中国灯饰之都

中山古镇被公认为“中国灯饰之都”,拥有超3.8万家灯饰及配件工商企业,其中灯饰商户超过7000家。以古镇为中心,一个覆盖周边三市11个镇区的庞大灯饰产业集群已然成型,年产值突破千亿元,是全球最具影响力的灯饰专业市场之一。

顺德家电:中国家电之都的智造力量

顺德享有“中国家电之都”的美誉,形成了以美的、海信、格兰仕等行业巨头为龙头,超3000家生产及配套企业为支撑的强大产业基地。其产值约占全国家电产业总规模的六分之一,出口额贡献了全国家电出口总量的五分之一,是名副其实的家电制造重镇。

佛山家具:引领中国家具产业的风向标

佛山作为中国家具产业的风向标,以乐从“十里家具长廊”闻名遐迩,成为行业潮流与商贸的展示窗口。该产业带入选淘宝2020年全国十大产业带,并在全国家具产业带中雄踞榜首,多年来其龙头地位稳固,从未动摇。

广州服饰:全球服装批发的时尚源头

广州是全国乃至全球规模最大的服装批发集散地,其自身及周边地区共同构建起世界最大的服装生产基地。广州的服装产品分为外贸和内销两大部分,其中外贸服饰以广州为核心枢纽,源源不断地分销至世界各地。珠海区、白云区、番禺区和增城区是四大服装加工聚集地,支撑着庞大的产能。

晋江鞋业:足迹遍布全球的制鞋王国

晋江是中国著名的鞋业产业重镇,聚集了超过三千家鞋业生产经营企业,年产量高达7亿多双。晋江制造的各类鞋类产品行销海外,足迹几乎遍布全球每一个角落。

汕头玩具:澄海制造的玩具世界魔力

汕头澄海被誉为“玩具之都”,全球约三成的玩具产自这里。近30年来,澄海形成了庞大的玩具产业集群,汇聚了全国约八成的玩具上市公司和众多中小制造商,上下游企业总数超过2万家,绝大多数产品远销海外市场,深刻影响着全球玩具贸易格局。

白沟箱包:年产8亿只的箱包产业帝国

白沟是中国最大的箱包产销基地,年生产各类箱包近8亿只,数千家加工企业在此集群发展。其核心白沟箱包交易城经营品类极为齐全,涵盖33个大类,花色细分品种超过3万个,为海内外采购商提供了一站式箱包解决方案。

许昌假发:掌控全球假发贸易的隐形冠军

中国假发制品的年出口总额占据全球80%的份额,而许昌正是这一产业的核心产区。许昌已蜕变为全球最大的假发制品集散地和出口基地,拥有超过5000家生产企业、上千个产品种类,相关从业者超过30万人,可谓全球假发贸易背后的掌控者。

2026年RAG嵌入模型终极对决:跨模态、跨语言与长文档检索能力全解析

总结 (TL;DR):我们针对公开基准测试所遗漏的四个实际生产场景,对10款主流嵌入模型展开深度评估:跨模态检索、跨语言检索、关键信息检索以及维度压缩。没有一款模型能够包揽所有测试的第一。Google 的 Gemini Embedding 2 是综合能力最强的“全能选手”。阿里巴巴达摩院开源的 Qwen3-VL-2B 在跨模态任务中力压所有闭源 API;若你希望通过压缩嵌入维度来降低存储成本,Voyage Multimodal 3.5 或 Jina Embeddings v4 则是最优解。

为什么仅靠 MTEB 来选择嵌入模型是不够的?

大多数 RAG(检索增强生成)原型系统都是从 OpenAI 的 text-embedding-3-small 起步的。它价格低廉、集成简便,对于单纯的英文文本检索来说表现也足够可靠。但一旦进入真实的生产环境,这个模型很快就会暴露出局限性。当你的数据处理管线开始摄入图片、PDF 以及多语种文档时,仅具备纯文本嵌入能力的模型便力不从心了。

MTEB 排行榜看起来会为你指引更优的选择,然而问题在于:MTEB 只衡量单一语境的文本检索。它完全不涉及跨模态检索(用一段文字查询来匹配图像库)、跨语言搜索(用中文查询找出英文文档),也不关心长文档的准确度,更不会告诉你,当你为了在向量数据库中节省存储空间而截断嵌入向量的维度时,模型会牺牲多少召回质量。

那么,到底该选用哪一款嵌入模型?答案取决于你的数据类型、语言种类、文档长度,以及你是否需要进行维度压缩。为了给出可靠的答案,我们专门构建了 CCKM 基准测试,并在上述每一个维度上,对 2025 年到 2026 年间发布的 10 款模型进行了严格评测。

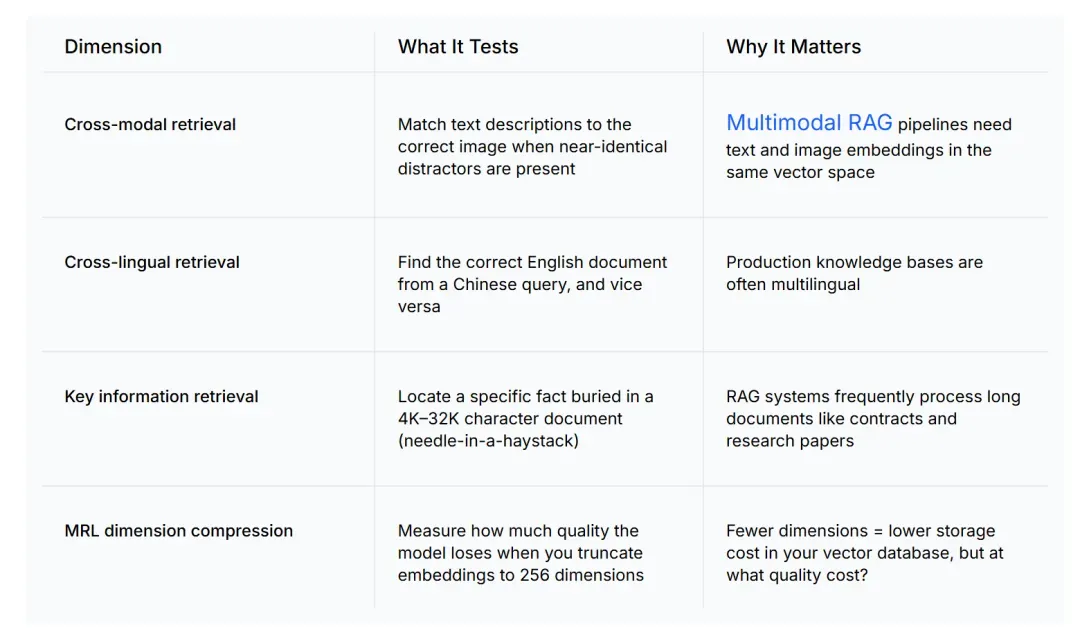

什么是 CCKM 基准测试?

CCKM(分别代表跨模态 Cross-modal、跨语言 Cross-lingual、关键信息 Key information、MRL 套娃表示学习)测试的是标准基准测试所遗漏的四项核心能力:

| 测试维度 | 它测试什么 | 为什么这很重要 |

|---|---|---|

| 跨模态检索 | 在有几乎完全相同干扰项的前提下,将文本描述与正确的图像匹配。 | 多模态 RAG 管线需要将文本和图像的嵌入表示放入同一个向量空间。 |

| 跨语言检索 | 根据中文查询找到正确的英文文档,反之亦然。 | 生产环境里的知识库往往是多语种的。 |

| 关键信息检索 | 定位埋藏在 4K 到 32K 字符长文档中的特定事实(大海捞针)。 | RAG 系统常常需要处理合同、研究论文等超长文档。 |

| MRL 维度压缩 | 衡量当你把嵌入向量截断至 256 维时,模型会损失多少语义质量。 | 更少的维度意味着更低的向量数据库存储成本,但需要知道代价有多大。 |

2026年必备:七款谷歌浏览器插件深度测评与实用教程

前几天在更新文章时,有读者好奇地问我:“你浏览器右上角那一排图标到底是什么?”其实它们并非什么神秘工具,不过是我在日常工作和写作时用到的几款 Chrome 插件而已。

下面,我就把其中使用最频繁、也最实用的七款插件单独拿出来,和你逐一分享。

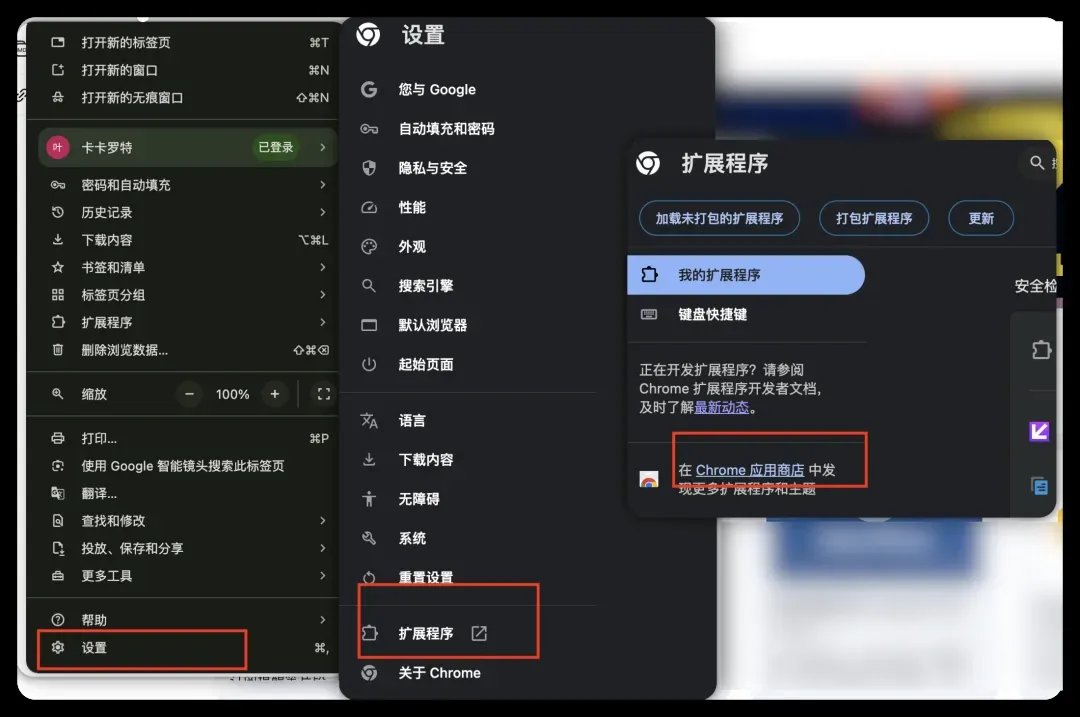

浏览器插件安装方法

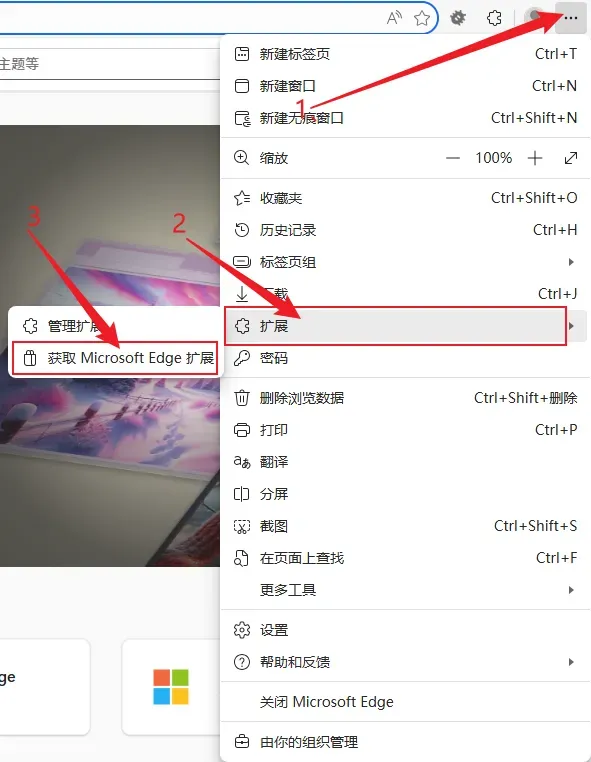

建议优先使用谷歌浏览器或 Windows 自带的 Edge 浏览器。

如果你拥有顺畅的国际网络环境,推荐直接使用 Chrome;若没有,Edge 也是完全可以的。

谷歌浏览器

可以直接访问 Chrome 网上应用店:https://chromewebstore.google.com/category/extensions

Edge浏览器

访问 Edge 加载项页面:https://microsoftedge.microsoft.com/addons/Microsoft-Edge-Extensions-Home 或按照下方截图路径进入 Edge 扩展页面。

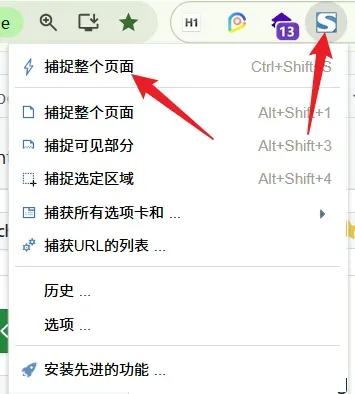

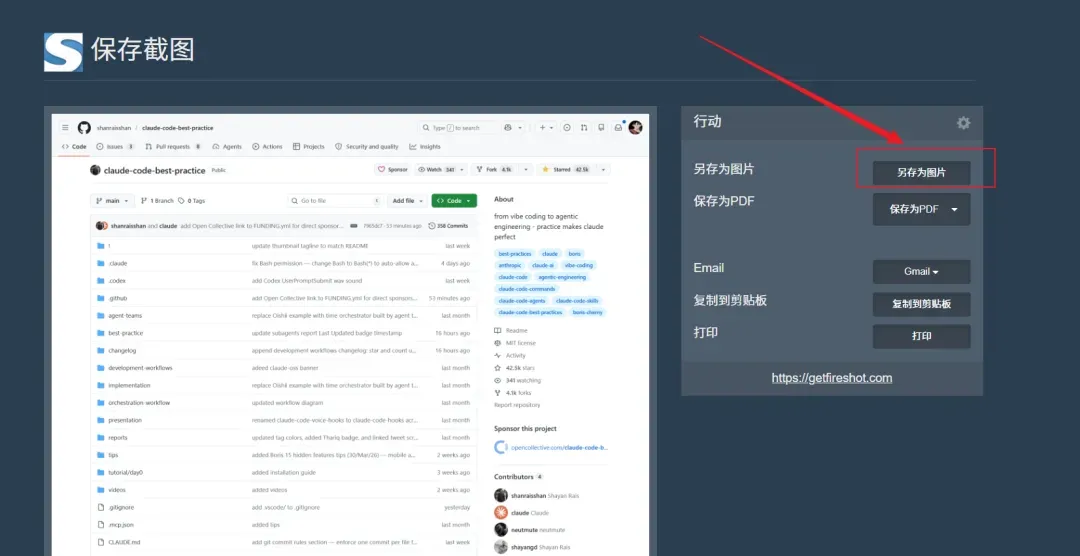

1、FireShot:一键滚动截取整页长图

这是一款专门用来对网页内容进行长截图的浏览器插件,操作极其轻松。比如,我之前在Design.md文章中提到的 Claude Code 风格网站搭建时,使用的长图就是靠它生成的。

使用方式非常直接:

单击插件图标,它会自动控制页面滚动条从上滚动到底,完成后跳转到一个预览页面,只需点击保存并选择“另存为图片”即可。

这个功能非常适合用来快速把文章分享给朋友,或者将网页 UI 截图发送给 AI,让他帮忙复刻网站。

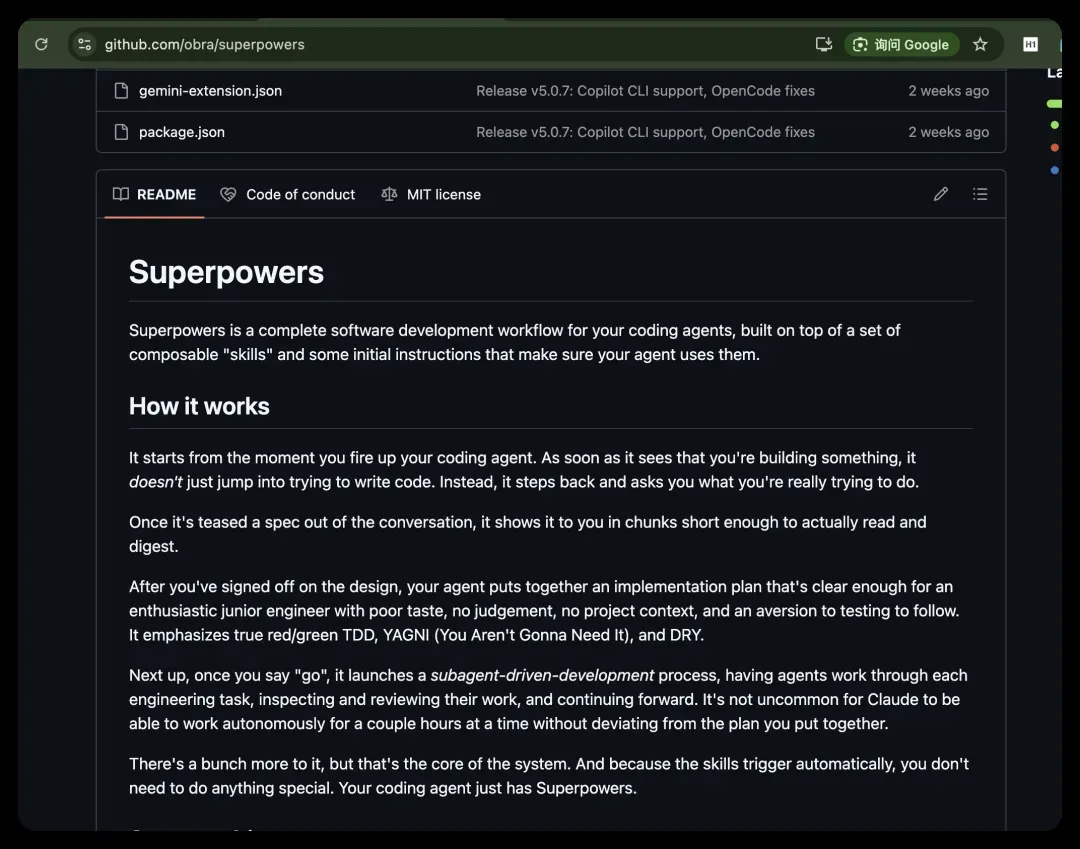

2、豆包AI助手:免费沉浸式中英对照翻译

我平时会频繁浏览 GitHub,上面的仓库很多来自国外,简介几乎全是英文。还有各种产品文档、论文,阅读起来总觉得不太顺畅。

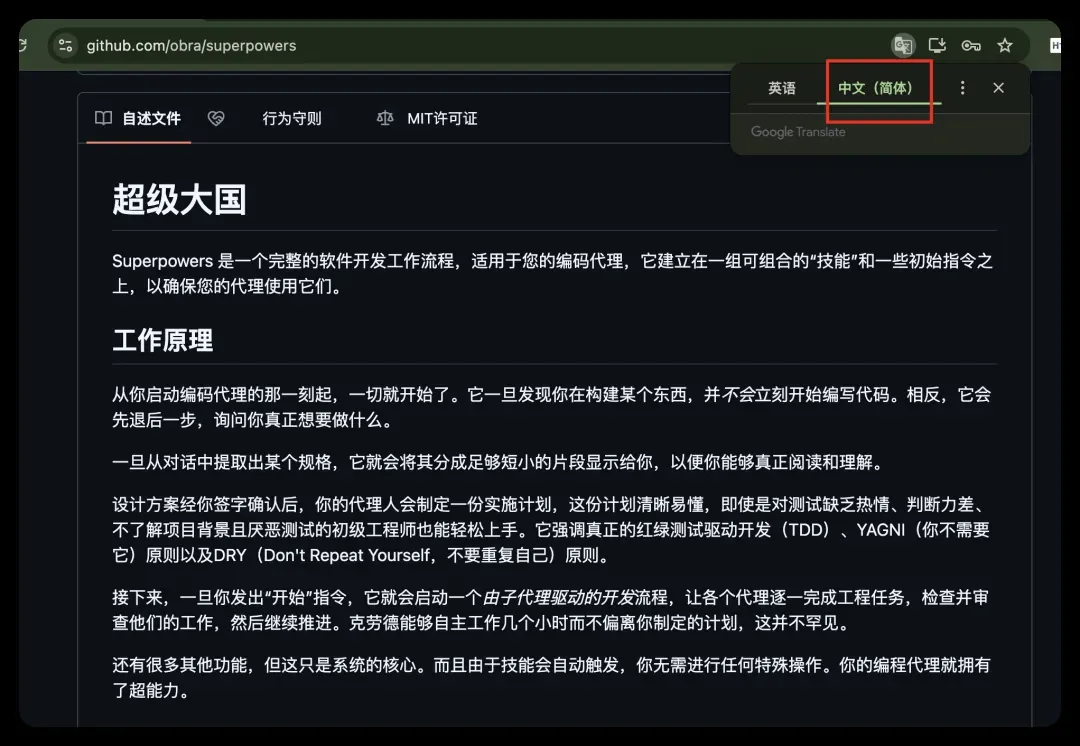

以前我依赖 Chrome 自带的谷歌翻译,但翻译结果往往很生硬,而且内容常常“走样”。

后来我了解到一款叫沉浸式翻译的插件。

它会在页面上部直接嵌入中英对照,阅读起来舒服很多,还能顺便熟悉专业术语。

但这款插件底层还是调用谷歌或微软翻译,翻译效果仍有不够自然的地方,存在一定的失真。它也有会员服务可以调用 AI 翻译,不过需要付费,当然也可以自定义对接自己的 API Key。

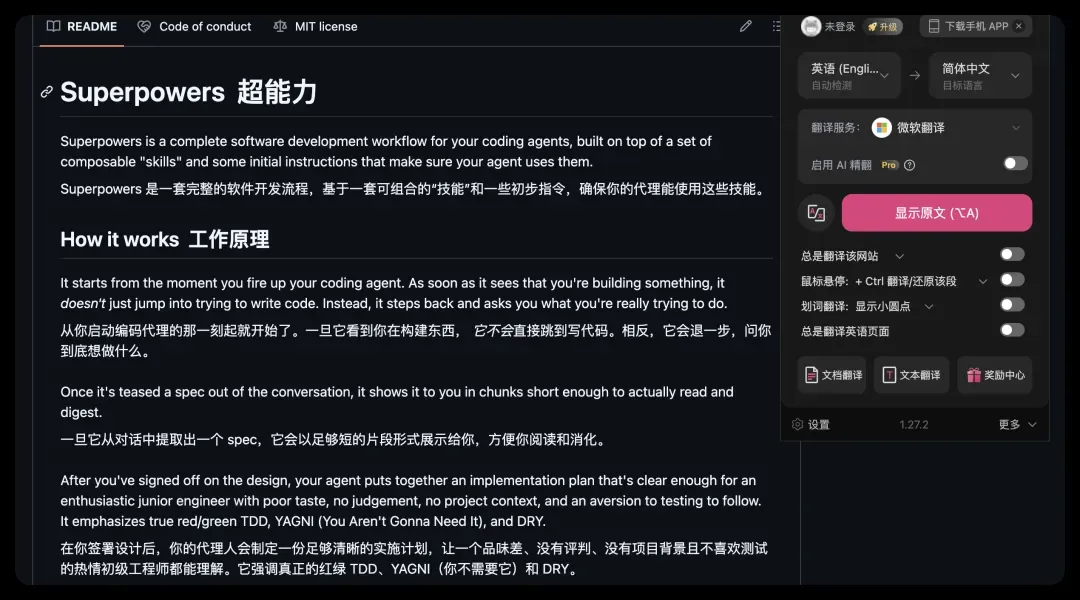

后来我无意间发现了豆包AI助手,它提供了类似沉浸式翻译的功能,并且完全免费,还要什么昂贵方案!

安装方式也特别简单,直接在 Chrome 网上应用店搜索即可。

在搜索框里输入名称就能找到。

安装成功后,浏览器工具栏会出现豆包的图标,看起来就像养了一只小宠物。

鼠标悬浮在图标上就可以选择翻译网站。

2026年跨境电商独立站建站终极对比:WordPress与Shopify怎么选最合适?

开篇引言

在跨境电商蓝海驰骋的征程中,第一步所选的建站工具,常常决定着业务的灵活度、成本结构和长期发展节奏。WordPress与Shopify作为当前独立站领域的两大主流方案,各自凝聚着鲜明的设计哲学与庞大的实践群体。下文将从自建成本、自主权、扩展能力、运营风险等多个维度,为你拆解这两种路径的真实面貌,帮助你在创业之初做出更清晰的判断。

一、用WordPress搭建独立站:优势与短板深度解析

- WordPress的显著优势

① 生态系统极其完备

作为全球使用率最高的建站程序,WordPress拥有规模惊人的主题库和插件库,几乎能覆盖所有常规业务与功能需求,社区讨论活跃,遇到问题很容易找到现成的解决方案。

② 完全自主可控

站点代码完全对站长开放,你可以自由修改任何细节,实现高度个性化的设计或功能定制,不受托管方平台的限制。

③ 没有封店风险

由于WordPress属于开源自托管系统,独立站不受任何中心化平台规则的约束,永远不会因“违反平台条款”而被突然关闭。对于经营某些特殊品类或希望掌握完整经营权的跨境卖家来说,这一点尤为关键。

④ 成熟且上手门槛并不高

程序版本迭代多年,稳定性极佳,网络上积累了大量图文和视频教程,即使是纯新手也能在短时间内完成基础网站的搭建。

⑤ 长期使用成本极低

通过WordPress建站,理论上可以做到零软件授权费起步,服务器和域名的花费也十分可控,极大降低了新手卖家的试错门槛和初期运营压力。

- WordPress的不足之处

① 对服务器资源有一定要求

功能强大的另一面是资源消耗,如果没有进行针对性的性能优化(如缓存、CDN、数据库调优),网站在流量增长后可能出现访问变慢的情况,这对新手来说需要额外学习。

② 需要单独购买和配置主机

虽然成本整体可控,但毕竟比开箱即用的SaaS多了一个初始部署环节,不过值得强调的是,即便算上优质主机的费用,长期来看也远低于按月支付的托管平台。

二、用Shopify搭建独立站:便捷背后的隐性成本

- Shopify的核心亮点

① 专为电商打造的SaaS工具

Shopify从根本上就是为在线交易设计的,注册后马上就能获得一个具备购物车、支付、订单管理等功能的店铺,对毫无技术背景的跨境新手相当友好。

② 同样拥有模板与插件体系

和WordPress类似,Shopify生态中也存在大量可选的店铺模板和功能扩展应用,不过其中绝大部分为付费资源。

- Shopify的不可忽视短板

① 固定支出明显偏高

平台按月收取订阅费,且基础套餐的金额并不低,对于仍在探索阶段的跨境创业者来说,这是一笔持续存在的固定成本。

② 主题和应用多需额外付费

优质模板多数需要单次购买,各种功能插件也常采用月付订阅模式,一旦需要实现多个个性化营销或运营功能,费用会迅速攀升。

③ 每笔交易抽成

除了订阅费,Shopify还会对产生的部分订单抽取交易手续费,这直接拉高了长期运营中的边际成本。

④ 自主性匮乏,面临封店风险(最致命的局限)

严格意义上来讲,Shopify并非真正的独立站,而是一个集中管理、统一托管的建站平台。站点的规则解释权完全在平台手中,大量案例表明,店铺可能因不明原因被封禁,且申诉过程不透明。一旦封停,你辛苦积累的域名流量和品牌认知也会随之蒸发。

⑤ 非开源,生态灵活度不足

相比于WordPress的开放生态,Shopify在代码层面的自由度、社区资源的丰富度以及二次开发的纵深空间上,都有明显差距。

三、综合决策建议

综合以上剖析,WordPress与Shopify均拥有不可替代的价值,也各自存在着难以回避的短板。如果你是一名预算敏感、希望将风险最小化、愿意投入少许时间学习建站技能的新手,WordPress的自托管路径可能是更明智的起点——Shopify的长期使用成本其实相当高昂,且潜在封店风险不容轻视。而如果你的资金相对充裕,极度追求即刻开卖、不愿碰任何技术细节,Shopify的便捷性则有一定吸引力。

然而,对于大多数希望实现真正品牌化经营、获取长期成本优势的创业者来说,WordPress所提供的自主权、零封店风险和极低的边际成本,往往是更值得长期投入的选项。毕竟,将流量和数据托付给一个随时可能收回权限的平台,永远无法称为真正的“独立站”。

特别提醒:决定采用WordPress后,随之而来的一个常见陷阱是盲目找“建站外包”。市场上有不少仅掌握基础安装步骤的人便宣称自己专业,收取数千元费用却只给一个空洞的网站壳子。实际上,WordPress前文已提过,需要对缓存、安全、数据库、性能、SEO等多方面做深入优化才能真正承载长期业务。如果确实不擅长动手,务必慎重鉴别对方的技术深度,远离那些只是“会开机关机就自称电脑高手”的半桶水服务。

6万亿估值与52%市场份额:AI平行宇宙下的资本飞轮与自主创新双路径

2026年5月13日,同一周内两组重磅数字,勾勒出AI世界两条迥异的演进路径。

一、透视6万亿估值:资本飞轮如何高速运转

额度48小时内被抢光,投资者的狂热犹如一场一票难求的春运抢票。

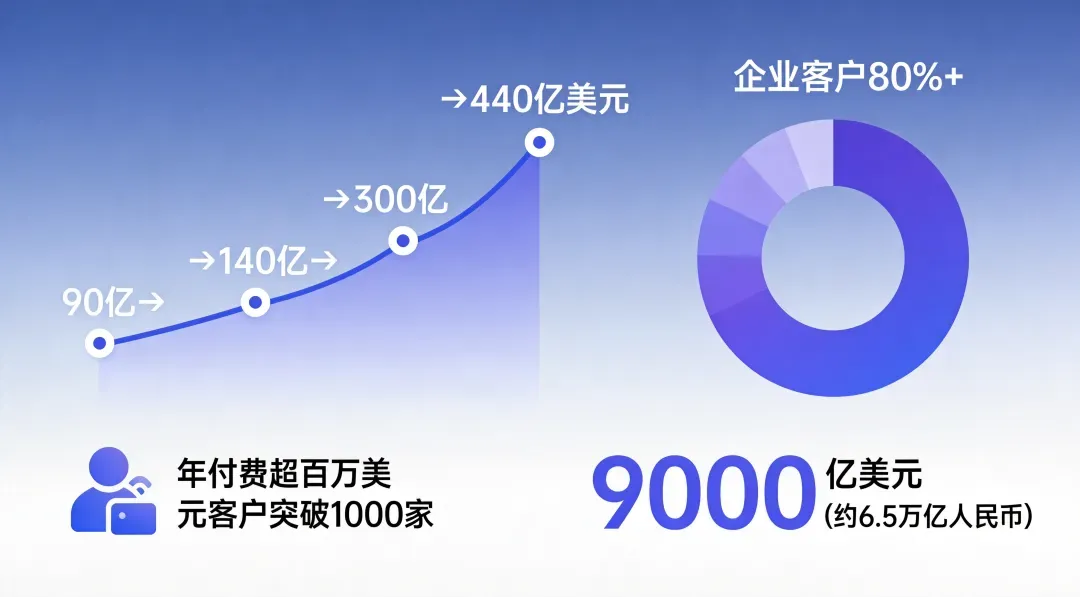

Anthropic计划以超9000亿美元(约6.5万亿人民币)的投前估值,再度融资300亿美元——这并非愚人节玩笑,而是彭博社、财联社、金融时报在5月12日至13日连续确认的重磅消息。

更令人瞠目的是营收增速:今年2月年化营收为140亿美元,4月宣布突破300亿,5月初第三方机构的统计已来到440亿美元。短短不到5个月,增幅接近5倍。

支撑这条陡峭增长曲线的,是相当健康的收入结构:企业客户贡献超80%的营收,财富10强中8家已是付费用户,年支出超100万美元的大客户已逾1000家,且这一数字在两个月内翻了一番。

然而,6万亿估值的背后,是一张愈发密集的算力采购网络——谷歌承诺投入100亿美元并追加300亿美元,亚马逊投入50亿美元并追加200亿美元。每一轮融资的实质,都是为了采购更多英伟达GPU来训练更强劲的模型,再凭借模型优势揽获客户,然后用客户收入撬动新融资继续购买芯片。

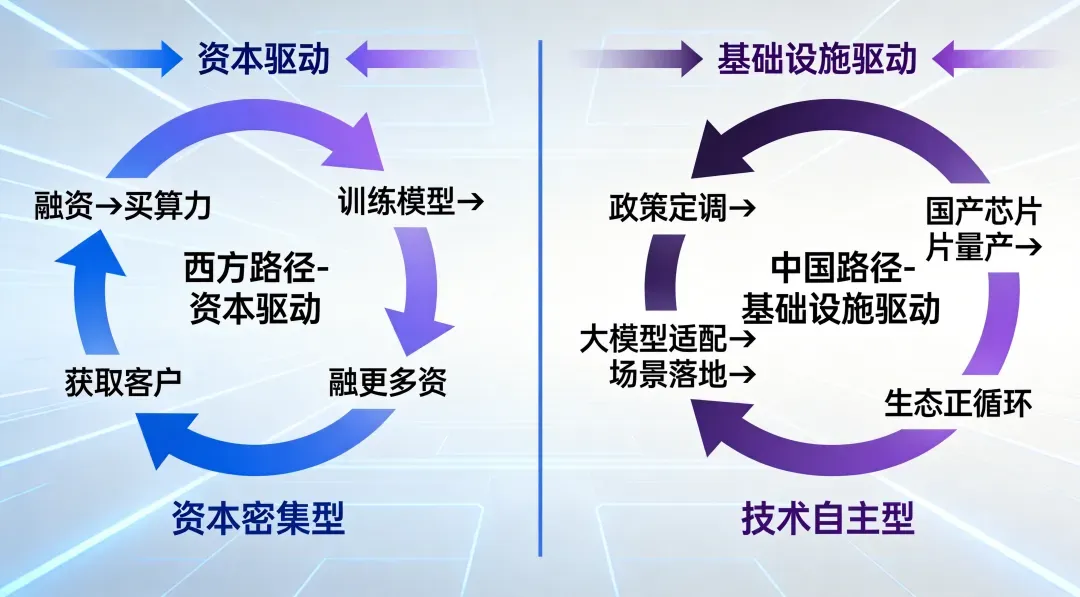

这便是西方AI的核心逻辑:资本驱动型。

融资→购置算力→训练更强模型→更多客户→更多融资。

二、52%市场份额的背后:国产AI芯片的逆袭拐点

与此同时,就在Anthropic抢占市场份额的同一周,另一组数据虽低调出炉,却意义深远。2026年一季度,国产AI芯片在国内市场的份额首次突破50%,达到52.3%。

这不仅是数字上的变化,更是一个结构性的转折点。回看时间线,逆袭路径清晰可辨:

- 2024年底:国产AI芯片仍被视为“后备选项”,大部分AI企业首选英伟达,国产芯片仅作为补充。

- 2025年Q1:DeepSeek R1横空出世,证明了小团队配合国产算力同样能战,但市场仍持观望态度。

- 2025年下半年:昇腾910C启动规模化交付,多家大模型厂商开始适配。

- 2026年3月:昇腾950PR正式发布,单卡性能达到英伟达H20的2.87倍。

- 2026年5月:DeepSeek V4全面适配昇腾950PR,推理速度提升35倍,部署成本仅为英伟达方案的1/3。

从“能不能用”,到“好不好用”,再到“比进口方案更具性价比”,国产AI芯片仅用了不到两年便迈过了最关键的三步。

数据更加夺目:华为昇腾以37%的市场份额占据断层第一,占国产芯片总量近七成;英伟达在中国市场的份额由巅峰期的95%骤降至42.7%;在政务、金融、能源等战略行业,国产芯片的采购比例已超过70%。

更重要的是,这场转折还远未到达顶峰。华为2026年AI芯片营收目标约120亿美元,同比增幅超60%;昇腾950PR全年75万颗的产能,刚一公布便被国内头部互联网企业基本预定。

三、两条路径,两个平行宇宙的本质对比

当6.5万亿估值与52.3%市场份额交汇,体现的并非东西方AI的胜负,而是两种截然不同的发展逻辑正在并行演进。

西方路径:资本驱动型

• 核心资源:资本与顶尖人才

• 循环逻辑:融资→采购算力→训练更强模型→更多客户→更多融资

• 优势:迭代飞速、全球化布局、人才集聚效应显著

• 风险:估值泡沫、过度依赖单一算力供应商、成本持续高企

中国路径:基础设施驱动型

• 核心资源:自主算力与多样化场景

• 循环逻辑:政策引导→国产芯片规模量产→大模型适配→场景落地→正向生态循环

• 优势:完全自主可控、显著成本优势、丰富的落地场景、长期政策护航

• 风险:生态完备度不足、高端训练芯片仍待突破、国际化发展起步较晚

5月9日国常会释放的信号,将“基础设施驱动”逻辑推至新高度——算力网首次被列入国家“六张网”规划,与水网、新型电网、新一代通信网、城市地下管网、物流网处于同等地位。

这意味着什么?水网和电网是国民经济的命脉,算力网被纳入同一层级,象征算力正式从“行业资源”升格为“国家基础设施”。未来使用算力,如同用水用电一般,将成为国家基础设施的基本保障。

四、非零和博弈,而是双向奔赴的起点

还有一个常被忽略的对比:斯坦福大学报告指出,2025年美国AI领域的私人投资是中国的23倍有余,但两国顶级模型的性能差距已缩小至仅2.7%。

这一结果,折射出中国依靠“芯片与模型协同”、全产业链配套和丰富应用场景所实现的超高研发效率。

资本驱动的西方路径,正在展现AI能创造多么巨大的商业价值;基础设施驱动的中国路径,则证明了AI能达到何等程度的自主可控。这绝非谁取代谁的零和博弈,而是人类AI文明在不同土壤中绽放的两朵奇葩。

数据来源:IDC、中国半导体行业协会、彭博社、财联社、金融时报、昇腾CANN开发者社区

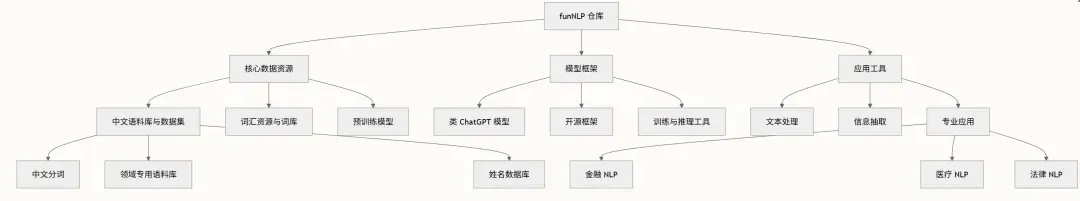

79k星标的funNLP中文NLP资源大全:从LLM到传统NLP,一站式获取ChatGPT数据集与语料库

funNLP 全面汇聚了从 ChatGPT、大语言模型数据集、中文语料库到知识图谱、文本生成、关键词提取、文本匹配及可视化等各领域的技术、项目与文献资源。截至目前,该开源项目已收获 79k 颗 GitHub Star,深受开发者青睐。无论是技术学习还是文献检索,都能在这里迅速定位所需内容,充分满足学习与实践需求。接下来为您详细解读。仓库的构建基于三大核心原则:

- 全面覆盖:从传统 NLP 任务到前沿大模型应用,无所不包

- 即拿即用:提供开箱即用的数据集、模型和工具,加速项目落地

- 社区共建:持续追踪最新科研进展与行业动态

主要资源类别

大语言模型与类 ChatGPT 资源

仓库全面覆盖大语言模型的最新进展,涵盖:

- 模型评测与对比:面向中文 LLM 的综合基准与评估体系

- 开源框架:可直接部署的 ChatGLM、MOSS、中文 LLaMA 衍生版本等实践方案

- 训练与优化:高效微调、低资源训练策略以及推理加速技术

传统 NLP 资源

构成中文 NLP 应用基础的核心资源:

| 资源类型 | 代表性资源 | 适用场景 |

|---|---|---|

| 中文语料库 | 分词词表、垂直领域数据集 | 模型训练与文本预处理 |

| 词汇资源 | THUOCL 系列(信息技术、医疗、金融等)、成语词典 | 实体识别、领域文本处理 |

| 处理工具 | 正则规则库、文本标注与可视化工具 | 数据清洗、分析与展示 |

专业领域应用

面向专业场景的行业定制 NLP 资源:

| 行业领域 | 主要资源 | 典型应用 |

|---|---|---|

| 金融 | 金融专词库、行业语料 | 行情分析、文档自动化 |

| 医疗 | 医学词典、临床文本处理工具 | 医疗文书、研究数据挖掘 |

| 法律 | 法律术语库、合同解析工具 | 法律文书处理、合规性审核 |

AG-UI 协议深度解析:构建 AI Agent 与前端应用的实时交互桥梁

AG-UI:使每一次 AI Agent 与用户的接触,都自然、流畅且可控。

引言

在 AI Agent 爆发的当下,我们拥有了极其强大的智能后端——然而,怎样才能让这些 Agent 真正“融入”用户界面?传统的 REST API 和 GraphQL 在应对 Agent 的实时流式输出、不确定行为、多轮对话等特性时,显得力有不逮。

AG-UI(Agent-User Interaction Protocol) 由此诞生。它是一个开放、轻量、事件驱动的协议,将 AI Agent 与用户界面之间的连接方式进行标准化。

本文将从浅入深,详细介绍 AG-UI 协议的工作原理、核心概念及实际落地方式。

一、AG-UI 为何而生?

1.1 传统 API 遇到的瓶颈

在 AI Agent 亮相之前,前后端通信普遍采用请求-应答模式:

- 客户端发起请求

- 服务端返回数据

- 客户端渲染结果

- 一次交互结束

但 AI Agent 彻底打破了这种模式:

| 传统 API | AI Agent |

|---|---|

| 短连接,一次性返回 | 长时运行,持续输出 |

| 结果确定性高 | 行为不确定 |

| 单次交互 | 多轮会话 |

| 单一数据格式 | 混合 I/O (文本+工具调用+状态更新) |

| 线性流程 | 可暂停、可干预 |

这些特性使得传统 API 捉襟见肘。开发人员不得不自行处理:

- 流式输出的解析与渲染

- 多种事件类型的统一管理

- 用户中途干预的衔接

- 前后端状态的一致性同步

1.2 三项 Agentic 协议的定位

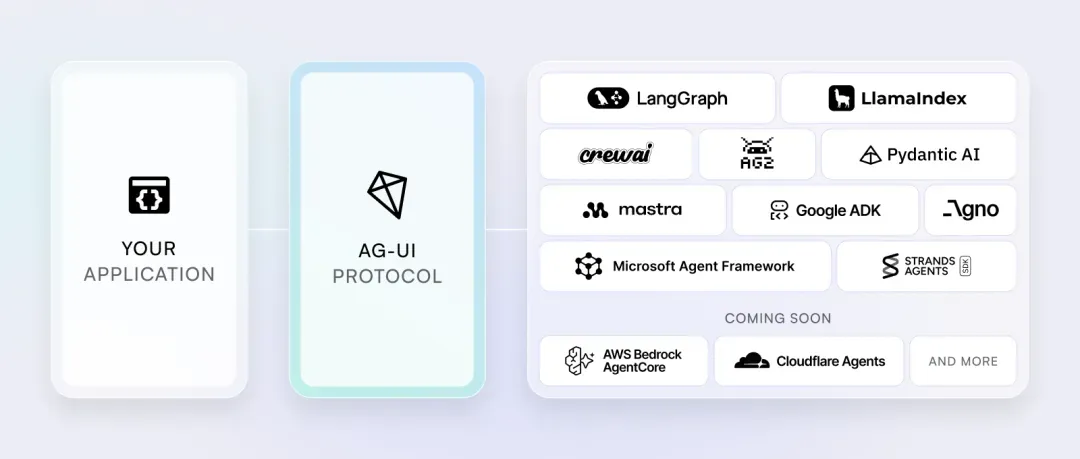

AG-UI 并非孤立存在,它与其他两项协议共同构成了完整的 Agentic 生态:

AI Agent 时代的工程范式革命:解读 Harness Engineering 的马、马具与骑手

2026 年 2 月,“Harness Engineering”这个术语突然在 AI 工程圈内引爆了话题。Mitchell Hashimoto 在个人博客里率先提出这一概念,紧接着 OpenAI 发布了涵盖百万行代码的实验报告,Martin Fowler 也紧随其后撰写了深度分析文章——仅仅几周时间,这一概念便成为讨论 AI Agent 开发时无法绕开的焦点。

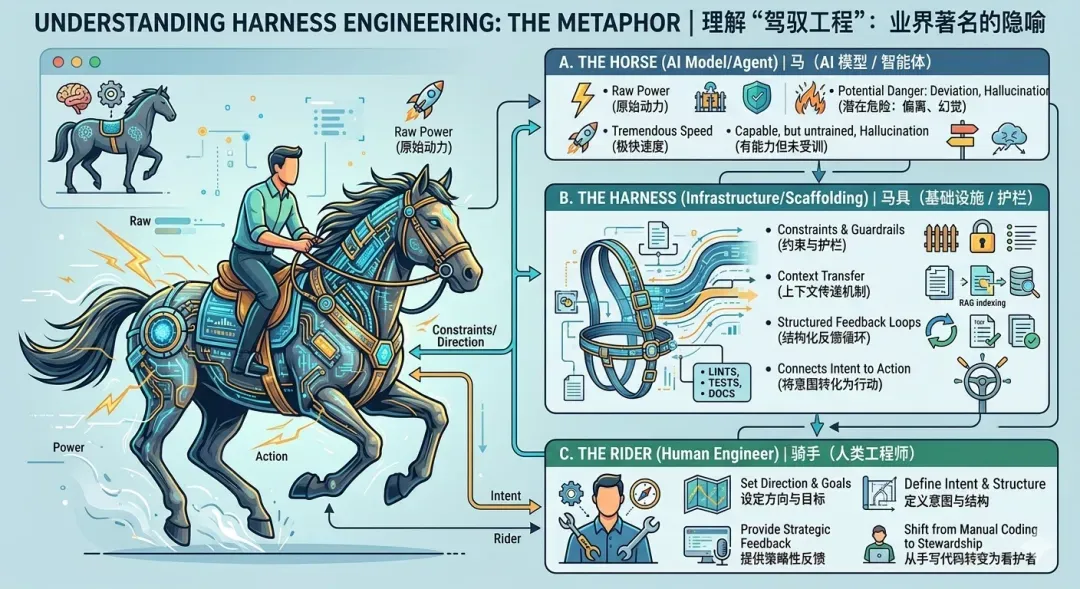

一、核心隐喻:驾驭野马——马、马具与骑手

要理解什么是 Harness Engineering,目前业界最广为流传的隐喻是:

- 马(The Horse - AI 模型):当下的 AI 模型(如 OpenAI Codex 等)犹如一匹力大无穷、疾驰如风的骏马。它的能力让人惊叹,但若不加引导,它常常彷徨不知方向,甚至横冲直撞(即产生幻觉、偏离架构规范)。

- 马具/缰绳(The Harness - 基础设施):涵盖约束规则、护栏机制、上下文传递路径以及反馈循环。它们将 AI 模型的原始“智力”塑造为能够达成特定业务目标的系统。

- 骑手(The Rider - 人类工程师):工程师不再需要“亲自奔跑”(手写底层代码),而是紧握缰绳,指明方向,注入意图并提供结构化反馈。

二、为何 Harness Engineering 不可或缺?

在过去两年中,行业共同发现了一个痛点:对 AI Agent 而言,“再努力一点(Try harder)”这条路根本走不通。 当 Agent 在庞大的代码库里迷失、陷入死循环、或者编写出违背公司架构规范的设计时,仅仅依靠调整 Prompt(提示词工程)来挽救局面极其脆弱。

Harness Engineering 应运而生,正是为了突破 AI 自主性的瓶颈。它的核心思想是:每当 AI 犯错,不要耗费精力去调整玄学般的提示词,而是改进 Harness 系统(例如添加一项 Linter 或测试拦截器),让它在机制层面再也不可能犯同样的错误。

模型能力并非瓶颈所在

这一论断已经得到了量化实验的支撑:

Can.ac 实验:仅仅改变 Harness 的工具格式(编辑接口),就在 16 个模型上显著提高了编码基准分数。效果最引人注目的是 Grok Code Fast 1,其成绩从 6.7% 飙升至 68.3%——完全没有任何模型权重的改动。