AI模型微调全攻略:实战经验、场景解析与数据工程精要

近期有学员在寻找AI相关职位时,反馈面试中常涉及模型微调的相关问题。由于此前学习过程中未能深入掌握,他们希望补上这一课。事实上,对于模型微调这一技术,我内心颇为抵触,因为它曾给我带来不少痛苦的回忆。

时间回溯到两年前,当时国内技术圈仍聚焦于模型的预训练与微调,这一过程被戏称为“炼丹”。不知是幸运还是不幸,我们团队在那个阶段也进行了大量训练实践。彼时,可供企业选择的基座模型相当有限,例如Bloom、LLaMA、GLM乃至GPT2。计算成本方面,更是比当前高出十倍不止——GPT-4-32K的账号一票难求(最高曾被炒至八万元),有些团队因未做好控制,一夜之间便可能让十多万元付诸东流。

数据成本同样高昂。获取优质数据的途径较为单一,且根本不存在所谓“数据蒸馏”的概念,因为实际操作中难以获得相应账号,即便获得,Token费用也令人望而却步。直至2024年,随着微软云Azure账号的开放购买,这一状况才逐渐缓解。但问题也随之浮现:许多受限于技术积累与资金实力的公司,耗费大量资源训练的小型模型(以7B、13B规模为主),刚刚取得些许进展,便因GPT版本更新或LLaMA2的发布而前功尽弃。

更具体地说,这些团队训练的小模型效果很快被资源雄厚的大型模型持平甚至超越,而团队已无力承担再次训练的成本。另一方面,多数公司在模型研发侧的能力几乎为零,即便训练效果尚可,其应用场景也极为有限,往往仅能处理诸如关键词提取等简单任务。原因很简单:约九成的公司无法扩展模型上下文长度,国内具备此能力者寥寥无几。

最终结果是,许多实力不足、积累浅薄的公司,在初步尝试后便迅速放弃了这条技术路线,甚至产生一种被AI浪潮裹挟的无力感。在这场“炼丹狂欢”中,不同公司承受的试错成本虽有差异,但数百万级别的投入损失并不罕见。我清晰记得,在一次项目复盘会上,老板质问为何当初选择这条技术路径,并强调试错成本之高。那一刻,我低头缩肩,整整两小时无法抬头,被当面严厉批评,事后一个月都未能完全恢复。

此时可能有读者会问:既然风险如此明显,为何当时仍有众多公司选择自主训练?这或许是时代的局限性使然。当时国内技术圈普遍以“套壳”为耻,直到Cursor等工具出现,大家发现套壳方案也能如此强大,风气才逐渐转变。于是,核心问题浮现:在当前基座模型能力已如此强大的背景下,何时才真正需要用到微调?

为什么需要微调

首先,我们明确两个不应使用微调的典型场景:

不应微调的场景

第一,风格、语气与品牌的个性化定制。以往因上下文窗口有限、模型理解能力较弱且易遗忘,我们需要通过微调从底层注入风格,以求一劳永逸。但如今,这一场景已基本消失。

第二,复杂结构化输出与特定格式遵循。例如将客户需求自动转化为公司内部JSON格式的工单。此类微调同样源于模型能力不足,担心不微调会导致错误,但现在已无此必要。

接下来,我们探讨几个适合使用微调的场景:

适合微调的场景

第一,在特定领域提升“直觉”与“确定性”。尽管RAG(检索增强生成)能够提供知识,但微调可以增强模型在特定领域内的思维模式。例如,一个代码模型在使用某公司全部内部代码库微调后,会对该公司特有的编程规范、私有库函数乃至常见Bug模式产生更深理解。它不仅能够引用知识(通过RAG),更能以符合公司习惯的方式思考并建议代码。在此场景下,RAG类似于资料查询,而微调则倾向于内置标准操作程序(SOP),将模型转化为领域专家。我们近期在芯片编程领域的实践便采用了微调方式,部分原因在于需要学习的内容体量过大。

第二,成本与延迟优化。对于高频调用的大型应用,每次调用云API都成本高昂且延迟显著。此时,对小型模型进行微调便显得尤为必要。但需特别注意,我们微调小型模型的目标绝非让其扮演“缩小版GPT”来处理开放领域或创造性对话。这类微调的真正价值在于处理特定任务——那些定义明确、边界清晰、且对速度与成本极度敏感的任务。例如:

- 输入输出标准化:输入为短文本(如用户查询、一句话、搜索词),输出为结构化数据(如分类标签、布尔值、JSON对象)。

- 高频率、低延迟要求:每秒需处理成千上万次请求,且对响应速度要求极高的场景。

- 领域特定:任务高度依赖企业自身的业务逻辑与数据。

总结而言:如果仅为补充知识或最新事实,应优先选择RAG,因为微调不擅长注入知识;如果旨在影响模型的输出能力(包括文本规则、格式与速度),则可以考虑微调。

提升模型的直觉与确定性

此处的逻辑在于:RAG补充知识,微调补充思维,目标是将“资料检索型回答”转变为“按行业SOP思考并稳定输出”。在行动前,需首先思考以下几点:

一、何时需要微调?

需注意以下几个关键点:

- 能将规则或SOP明确梳理出来,且行业中存在清晰标准。避免使用开放命题进行微调,否则难以取得预期效果。

- 在当前大模型能力基础上,无论如何调整提示词,准确率始终无法突破95%。

- 存在必须严格遵守的边界或不可触碰的红线。

- 其他相关考量。

明确准入条件后,核心便转向数据准备。

二、数据来源

此场景下的数据通常具有高结构化特征,例如:

- 整理出的金标准:如SOP、公司规范、合规条款等,数量约1k至5k条,每条都应作为“判断或建议的锚点”。

- 负面案例:常见错误及反例,同样需要1k至5k条,明确阐述错误原因及修正方法。

需特别强调的是:微调数据不仅应包含问答对(Q, A),还需涵盖推理过程(Q, Reasoning, A)。以芯片编程为例,数据不应仅是“需求 -> 代码”,而应是“需求 -> 分析(为何此处需使用此私有库函数?需考虑哪些时序与功耗问题?)-> 代码”。如此微调出的模型,在面对新问题时,会更倾向于模仿这种推理路径,而非仅仅输出答案。其“确定性”便体现在推理过程符合预设规则。

由于芯片场景较为晦涩,下面提供一个更简单的示例:

三、数据案例

首先是正面案例:

Q:“你好,我刚才下班回家,把车停在小区路边了。吃完晚饭下来发现副驾驶的车窗被砸了,车里放的一个笔记本电脑包不见了。电脑是公司财产,估计值一万多块钱。我现在该怎么办?”

Reasoning:

事件定性: 用户描述的核心是“车窗被砸”和“财产丢失”,这是一个典型的“机动车盗抢”案件,而不是普通的“车损”。应优先归类到“盗抢险”。

责任初判: 车辆处于停放状态,且被盗物品为车内财产。根据条款,盗抢险通常涵盖车内财产损失,但需确认用户是否投保了“机动车盗抢险”及“车内财产附加险”。初步判断保险公司有责任,但需核实保单。

信息提取: 需要提取的关键结构化信息包括:事发地点:小区路边、受损部位:副驾车窗、损失物品:笔记本电脑、损失金额预估:10000元、案件类型:盗抢。

下一步动作: 指导用户立即报警(盗抢案件必须要有警方证明)并保护现场。

A:

{

"案件类型": "盗抢险",

"保险责任初步判断": "可能赔付,需核实保单",

"关键信息": {

"事发时间": "晚间",

"事发地点": "小区路边",

"车辆损伤": "副驾车窗被砸",

"财产损失": "笔记本电脑包",

"损失金额预估": "10000元"

},

"下一步建议": [

"请立即拨打110报警,并获取案件回执或证明。",

"请对现场和车辆受损部位进行拍照留存。",

"请通过App上传保单信息,核实具体险种。"

]

}

数据准备完毕后,便可选择相应工具进行微调。此场景因一般公司使用较少,此处不展开案例,读者可自行体会。接下来是第二个微调场景:

高频、低延迟与低成本处理

此场景微调的目标是:将复杂问题转译为结构化小任务,通过小型模型与微调来优化成本与延迟。它特别适用于标准化或归一化场景,例如意图分类、槽位抽取、脏数据纠正等。

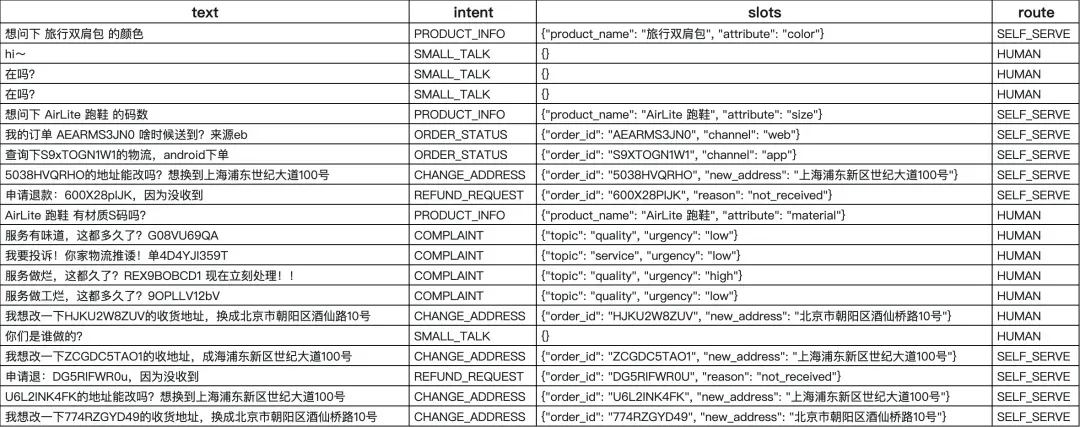

为更清晰说明,我们以“电商客服前置路由”为例。目标是:将用户的短文本请求转化为结构化输出(意图 + 槽位 + 路由),让小型模型处理80%以上的请求,仅当置信度低或越界时才回退至大型模型。微调的核心在于与各类数据集打交道:

训练数据集

微调需要构造优质的问答对,以教会小型模型将非结构化短文本转化为结构化结果。以下为样例数据:

//有时也会组织链式思维(CoT),此处暂不展示

{

"input":{"text":"查询下S9xTOGN1W1的物流,android下单"},

"output":{"intent":"ORDER_STATUS","slots":{"order_id":"S9XTOGN1W1","channel":"app"},"route":"SELF_SERVE"}

}

其次是验证数据集,用于测试模型质量:

验证数据集

线下进行客观评测,防止模型“过拟合”。每次微调都应有可对比的样本。过拟合指模型对训练集中的每一道题及其解题过程都死记硬背,若遇原题则得满分,但稍作变化便无法应对,这是典型的泛化能力不足。此外还有欠拟合,即样本量过少或特征工程不佳,导致模型连SOP都未学会,执行任务缺乏章法,这是样本不足以支撑泛化的表现。以下是期望的输入输出示例:

| text | intent | slots | route |

|---|---|---|---|

| 想问下 旅行双肩包 的颜色 | PRODUCT_INFO | {"product_name":"旅行双肩包","attribute":"color"} |

SELF_SERVE |

| hi~ | SMALL_TALK | {} |

HUMAN |

| 我的订单 AEARMS3JN0 啥时候送到?来源eb | ORDER_STATUS | {"order_id":"AEARMS3JN0","channel":"web"} |

SELF_SERVE |

| 5038HVQRHO的地址能改吗?想换到上海浦东世纪大道100号 | CHANGE_ADDRESS | {"order_id":"5038HVQRHO","new_address":"上海浦东新区世纪大道100号"} |

SELF_SERVE |

| 申请退款:600X28pIJK,因为没收到 | REFUND_REQUEST | {"order_id":"600X28PIJK","reason":"not_received"} |

SELF_SERVE |

| 服务有味道,这都多久了?G08VU69QA | COMPLAINT | {"topic":"quality","urgency":"low"} |

HUMAN |

实际构建测试数据集时,应多考虑噪声与对抗样本,因为其目的并非证明模型多么优秀,而是找出不足之处并进行改进。

归一化处理

微调场景同样需要进行归一化,这是一项关键策略。其要求是:将用户的口语或别名统一为系统可用的规范值,以降低标签空间复杂度。换言之,将用户多样化、非标准的口头表达映射至系统内部有限且标准的规范值。归一化并非改变用户输入,而是规范模型输出。本质在于降低复杂度,让模型无需为同一含义的无数种说法逐一学习,只需学会映射至唯一的“键”即可。

为便于理解,举例说明:

- 如同不同地区的人点饮料时说:“来杯肥宅快乐水”、“一份中可乐”、“可口可乐”。

- 归一化:即服务员(模型)听到后,在订单(输出)上统一写作 product: coke。

- 系统后台:仅识别 coke 这一规范值,从而准确无误地出餐。

再举一个稍复杂的例子:

//用户输入

//注意:“安桌”为错别字,“下的单”为口语化表达

我是在安桌端下的单,单号S9XTOGN1W1,看看到哪了

此处必须进行数据清洗,即常见的模型预处理,旨在避免误导模型。操作包括纠正错别字、修正错误语义等基础步骤。模型将输出:

{

"intent": "ORDER_STATUS",

"slots": {

"order_id": "S9XTOGN1W1",

"channel": "安卓端" // 模型正确抽出了槽位值,但这是用户原话

},

"route": "SELF_SERVE"

}

紧接着进行归一化,依据清单查询“channel: 安卓端”:

category,canonical,alias

channel,app,安卓

channel,app,安卓端

channel,app,android

channel,app,手机app

channel,mini_program,小程序

系统发现“安卓端”匹配了alias,于是进行简单替换,最终输出:

{

"intent": "ORDER_STATUS",

"slots": {

"order_id": "S9XTOGN1W1",

"channel": "app" // 规范值!

},

"route": "SELF_SERVE"

}

如此一来,无论用户说“安卓”、“Android”还是“手机app”,后端服务始终只收到 app,业务逻辑处理变得简单而稳定。由此可见:归一化并非让模型自行学会泛化,而是替模型完成泛化。

要求一个模型学会“安卓”、“Android”、“应用商店”、“APP”、“手机软件”等所有词汇均指向同一内在概念 app,需要大量高质量训练数据。这极具挑战且易出错。我们不对模型提出如此苛刻的要求,仅要求其能识别这些词汇属于“渠道”类别并原样抽取,然后由“外挂知识库”负责完成从“各种说法”到“一个标准”的映射。

稍作延伸:归一化清单是否会变得异常庞大?答案是:清单可能较大,但绝不会无序膨胀,因为有成熟策略控制其规模。

策略一:范式覆盖。许多用户表达虽用词各异,但模式相同。无需为每个变体单独记录,而应抓住核心词汇。例如:

退款原因 - “没收到货”

用户输入:“没收到”、“没收到货”、“还没收到”、“怎么还没到”、“压根没见到影子”、“物流显示签收但我没拿到”……

//欠佳的归一化

not_received, 没收到

not_received, 没收到货

not_received, 还没收到

not_received, 怎么还没到

not_received, 压根没见到影子

not_received, 物流显示签收但我没拿到

... (清单无限延长)

//范式思路

not_received, 没收到

not_received, 没到

not_received, 未收到

not_received, 未到

仅需覆盖核心否定词(没、未)与核心动词(收到、到)的组合即可。此处实际仍依赖模型的语义理解能力。即便是小模型,也能理解“压根没见到影子”、“没收到货”、“快递丢了”均属于用户声称未收到商品(not_received) 这一语义范畴。

在此案例中,小模型经训练后,易返回最接近的答案,例如:

用户:压根没见到影子

→

模式:slots: {"reason": "没收到"}

→

归一化:slots: {"reason": "not_received"}

策略二:二八原则。实践中,归一化清单维护的是高频命中词组,可解决80%以上的场景。若超出此范围,系统设有跳出逻辑,例如:

- 模型无法识别,则不处理此槽位。

- 模型已识别,但归一化映射表中无对应条目,可触发默认路径,转至人工处理。

- 事后,从失败案例中判断是否需在映射表中新增条目。这是一种按需增长模式,确保清单不会盲目膨胀。

此处不再赘述,因为业内同行都明白:微调的核心在于关键字提取,即槽位抽取(Slot Filling),归一化亦建立于此基础之上,若提取不佳则一切徒劳。因此,我们进入槽位抽取板块:

槽位抽取

可将微调任务想象为一位聪明的助手阅读一份填空题,并根据规则将答案填写至标准答题卡(JSON)上。微调需教会小模型两件事:

- 找得到:从口语或噪声中定位值。

- 填得对:以规范值输出,并遵守必填、正则、枚举及业务边界等约束。

训练数据集是为模型准备的教材与标准习题集,每一对 (input, output) 均为一道例题。模型的学习效果很大程度上取决于标注质量与结构覆盖。此处重点阐述槽位抽取,这是模型需掌握的核心技能。通过大量学习“例题”,模型逐渐领悟:

第一,在哪里找答案(定位):例如,学会“订单号”通常是一串由字母数字组成、长度在8-12位的字符,且常出现在“订单”、“单号”、“#”等词汇之后。

第二,答案是什么(识别):从文本中精确提取出该字符串(如 AEARMS3JN0),不多不少。

第三,填到哪(映射):知晓提取出的“订单号”应置于输出JSON的 slots.order_id 字段中。

以下为例:

// 训练样本 1

// 注意:channel已由上文归一化处理,此处不再赘述

{

"input": {"text": "帮我查一下订单S9XTOGN1W1到哪了,我在安卓APP上买的"},

"output": {

"intent": "ORDER_STATUS",

"slots": {"order_id": "S9XTOGN1W1", "channel": "app"},

"route": "SELF_SERVE"

}

}

关键点如下:

- 当用户提及“查”、“订单”、“到哪了”,即为 ORDER_STATUS(意图)。

- S9XTOGN1W1 此token序列紧邻“订单”,应被提取为 order_id。

- “安卓APP”一词,根据归一化词典,应映射至 channel: app。

再来看一个含噪声的案例:

// 训练样本 2

{

"input": {"text": "S9XTOGN1W1 物流!"},

"output": {

"intent": "ORDER_STATUS",

"slots": {"order_id": "S9XTOGN1W1"},

"route": "SELF_SERVE"

}

}

// 训练样本 3

{

"input": {"text": "我滴单号是5038HVQRHO,送到哪儿啦?”"},

"output": {

"intent": "ORDER_STATUS",

"slots": {"order_id": "5038HVQRHO"},

"route": "SELF_SERVE"

}

}

模型需学会:

- 即使无“订单”关键词,仅有一串疑似订单号的字符 5038HVQRHO 加上“送到哪儿”,也属 ORDER_STATUS。

- “单号”是“订单号”的同义词。

- 口语化表达“我滴”、“啦”不影响核心意图判断与槽位抽取。

总之,训练数据的质量(覆盖率、多样性、准确性)直接决定了模型槽位抽取能力的上限,数据教得越好,模型填空越准。

跳出策略

当然,没有任何模型是完美的,总会遇到其不会、不确定或可能出错的情况,此时便考验整个系统的稳定性:

一、置信度过滤。模型预测时通常输出置信度分数,表示其对答案的确信程度。若置信度低于设定阈值,说明模型“心虚”,直接跳出。对于生成模型,可通过计算生成序列的概率估算置信度;对于分类任务(如意图识别),可直接使用softmax概率作为置信度。

二、格式校验。即使置信度高,模型的输出也可能为非法JSON或缺少必填字段,系统层面需进行校验。

三、业务规则。即使JSON格式正确,内容也可能在业务层面无效,此时需连接业务数据库验证。例如,订单号 ABCDEFGHI 的查询请求,若系统中无此订单信息,则需处理。

此外,还存在安全限制等,因通常有第三方服务处理,此处不再赘述。跳出后的处理逻辑与前文二八原则类似,转交人工即可。

最后简要提一下数据标注:

数据标注

标注对于微调的核心意义在于:向模型阐明SOP。模型本身不了解业务逻辑。通过成千上万的 (input, output) 配对,我们清晰告知模型:当遇到类似A的表述时,必须按照B的格式回应。你标注的 output 正是在定义任务的终极形态。

尽管我们不推荐使用微调注入事实知识(这是RAG的强项),但我们需要注入思维模式与判断标准。例如,在保险理赔场景中,何为“盗抢险”?何种情况算“车内财产损失”?这些判断逻辑与标准通过标注好的推理过程(Reasoning)传授给模型:

input:我刚吃完饭回来,发现我停在小巷里的车副驾驶玻璃被砸了,放在座位上的公文包不见了,里面有台工作电脑。我该怎么办?

output:

{

"input": {"text": "我刚吃完饭回来,发现我停在小巷里的车副驾驶玻璃被砸了,放在座位上的公文包不见了,里面有台工作电脑。我该怎么办?"},

"output": {

"intent": "CLAIM_REPORT",

"slots": {

"incident_type": "theft",

"damaged_part": "passenger_side_window",

"lost_item": "briefcase_with_laptop",

"scene_status": "parked"

},

"reasoning": "1. 事件定性: 用户核心描述是‘玻璃被砸’和‘物品丢失’,且物品是因盗窃行为而丢失,这是典型的‘盗抢险’(theft)案件,而非单纯的‘玻璃单独破碎险’或‘车损险’。2. 责任初判: 车辆处于熄火锁车、无人看管的‘停放状态’(parked)。被盗物品‘公文包和电脑’属于‘车内财产’。根据常见条款,盗抢险通常涵盖整车被盗,而‘车内财产’通常需要附加投保‘车内物品损失险’才能赔付。初步判断,车窗损失属于盗抢险责任,但电脑损失需核实是否投保附加险。3. 信息提取: 关键信息包括- 地点:小巷、车辆状态:停放、受损部位:副驾车窗、损失物品:公文包和电脑。4. 下一步动作: 必须指导用户立即报警(盗抢案件需警方证明),并告知其需核实保单中的附加险条款。",

"route": "HUMAN_VERIFICATION" // 涉及财产损失认定,需人工核保员介入

}

}

继续之前的案例:

input:你好,我昨天晚上在你们APP上下单了一个旅行双肩包,订单号是 5038HVQRHO,我想问问什么时候能发货呀?

output:

{

"intent": "ORDER_STATUS",

"slots": {

"order_id": "5038HVQRHO",

"channel": "app",

"product_name": "旅行双肩包"

},

"route": "SELF_SERVE"

}

//噪音案例

//更改地址涉及物流和用户信息修改,属于敏感操作。尽管用户信息齐全,但出于安全和控制风险的考虑, SOP规定此类操作优先转人工处理 -> HUMAN。

input:5038HVQRHO 的地址能改吗?想换到上海浦东世纪大道100号,急!!!

output:

{

"intent": "CHANGE_ADDRESS",

"slots": {

"order_id": "5038HVQRHO",

"new_address": "上海市浦东新区世纪大道100号"

},

"route": "HUMAN" // 注意:即使信息齐全,因业务规则也转人工

}

关于标注,常见问题涉及方法论,主要聚焦于两点:

- 第一,何种数据应纳入训练数据集进行标注。

- 第二,具体如何进行标注。

以下为解答:

- 一、高价值样本。此类数据是模型的“主食”,必须大量且高质量:

- 覆盖高频核心场景:例如电商中的“查物流”、“申请退款”、“修改地址”;保险中的“报案”、“查询进度”。这些是模型必须熟练掌握的核心能力。

- 代表常见用户说法:同一意图的不同表达方式。如查询订单可有:“订单号XXX到哪了”、“我的包裹怎么还没到”、“帮我看看XXX发货没”。

- 包含关键业务实体(槽位):大量包含订单号、产品名、金额、地址等信息的样本,确保模型能精准抽取。

- 二、对抗样本与负样本。此类数据是模型的“负面案例”,用于提升模型稳定性:

- 带噪声的数据:包含错别字(如“安卓”)、口语化(如“滴单号”)、缩写(如“SF快递”)、无关信息(如“你好在吗我想问下…”)的样本。教导模型抓住主干,忽略噪声。

- 边界模糊样本:意图难以区分的样本。例如,“手机坏了”可能是PRODUCT_INFO(询问保修政策)也可能是COMPLAINT(投诉质量问题)。标注此类数据并明确标准,能显著提升模型判断力。

- 危险/违规样本:用户带有强烈负面情绪、提出无理要求或试图攻击系统的样本。将这些样本的route明确标注为HUMAN,教会模型何时“转交人工”。

特别需注意,训练数据质量至关重要:宁可拥有100条覆盖广泛、标注精准的数据,也不要10000条重复、低质、有歧义的数据。

以下为具体标注策略:

一、意图识别

input:我想问问我的订单5038HVQRHO到哪了,哦对了,还有就是怎么申请退款来着?

output:

{

"intent": "REFUND_REQUEST",//咨询退款

"slots": {},

"route": "HUMAN"

}

二、槽位抽取与归一化

input:我在安卓端下的单,单号是 S9xTOGN1W1,看看到哪了

output:

{

"intent": "ORDER_STATUS",

"slots": {

"order_id": "S9XTOGN1W1",

"channel": "app" // 注意:这里已经是映射后的标准值

},

"route": "SELF_SERVE"

}

三、路由决策

input:我要把收货地址改成上海市南京东路1号

output:

{

"intent": "CHANGE_ADDRESS",

"slots": {

"new_address": "上海市南京东路1号"

},

"route": "HUMAN" // 业务规则强制转人工

}

综上所述,微调的关键信息几乎全部围绕数据处理展开,因此微调本质上是一项数据工程。此外,微调目前更多适用于一问一答场景,若涉及多轮对话或输入过长,小型模型处理起来可能较为吃力。最后,我们仍需进入实操阶段。

实操演示

实操部分我们不再原创,而是借鉴此前李飞飞的案例模拟,以帮助读者更好理解:

一、环境准备

- 基础模型:LLaMA-7B(Meta公司发布的LLaMA系列小型模型)

- 微调框架:OptiFlow

- 数据集:MedNLI(医学推理数据集,包含医学推理任务的标注数据)

- 显卡:NVIDIA Tesla T4(16GB VRAM)

- CPU:Intel Xeon 2.6 GHz

- 内存:64GB

数据大致格式如下:

{

"Question": "根据描述,一个1岁的孩子在夏季头皮出现多处小结节,长期不愈合,且现在疮大如梅,溃破流脓,口不收敛,头皮下有空洞,患处皮肤增厚。这种病症在中医中诊断为什么病?",

"Complex_CoT": "这个小孩子在夏天头皮上长了些小结节,一直都没好,后来变成了脓包,流了好多脓。想想夏天那么热,可能和湿热有关。才一岁的小孩,免疫力本来就不强,夏天的湿热没准就侵袭了身体。\n\n用中医的角度来看,出现小结节、再加上长期不愈合,这些症状让我想到了头疮。小孩子最容易得这些皮肤病,主要因为湿热在体表郁结。\n\n但再看看,头皮下还有空洞,这可能不止是简单的头疮。看起来病情挺严重的,也许是脓肿没治好。这样的情况中医中有时候叫做禿疮或者湿疮,也可能是另一种情况。\n\n等一下,头皮上的空洞和皮肤增厚更像是疾病已经深入到头皮下,这是不是说明有可能是流注或瘰疬?这些名字常描述头部或颈部的严重感染,特别是有化脓不愈合,又形成通道或空洞的情况。\n\n仔细想想,我怎么感觉这些症状更贴近瘰疬的表现?尤其考虑到孩子的年纪和夏天发生的季节性因素,湿热可能是主因,但可能也有火毒或者痰湿造成的滞留。\n\n回到基本的症状描述上看,这种长期不愈合又复杂的状况,如果结合中医更偏重的病名,是不是有可能是涉及更深层次的感染?\n\n再考虑一下,这应该不是单纯的瘰疬,得仔细分析头皮增厚并出现空洞这样的严重症状。中医里头,这样的表现可能更符合‘蚀疮’或‘头疽’。这些病名通常描述头部严重感染后的溃烂和组织坏死。\n\n看看季节和孩子的体质,夏天又湿又热,外邪很容易侵入头部,对孩子这么弱的免疫系统简直就是挑战。头疽这个病名听起来真是切合,因为它描述的感染严重,溃烂到出现空洞。\n\n不过,仔细琢磨后发现,还有个病名似乎更为合适,叫做‘蝼蛄疖’,这病在中医里专指像这种严重感染并伴有深部空洞的情况。它也涵盖了化脓和皮肤增厚这些症状。\n\n哦,该不会是夏季湿热,导致湿毒入侵,孩子的体质不能御,其病情发展成这样的感染?综合分析后我觉得‘蝼蛄疖’这个病名真是相当符合。",

"Response": "从中医的角度来看,你所描述的症状符合“蝼蛄疖”的病症。这种病症通常发生在头皮,表现为多处结节,溃破流脓,形成空洞,患处皮肤增厚且长期不愈合。湿热较重的夏季更容易导致这种病症的发展,特别是在免疫力较弱的儿童身上。建议结合中医的清热解毒、祛湿消肿的治疗方法进行处理,并配合专业的医疗建议进行详细诊断和治疗。"

},

{

"Question": "对于一名60岁男性患者,出现右侧胸疼并在X线检查中显示右侧肋膈角消失,诊断为肺结核伴右侧胸腔积液,请问哪一项实验室检查对了解胸水的性质更有帮助?",

"Complex_CoT": "嗯,有一个60岁的男性患者,出现了右侧胸疼,而且X光显示右侧肋膈角消失,这看起来很像是胸腔积液的问题。医生诊断是肺结核伴右侧胸腔积液。那我们就得想想,什么样的实验室检查能帮助我们更好地理解这个胸水的性质呢?\n\n首先,我们得从基础知识说起。胸腔积液就是说胸腔里有了多余的液体。这液体的来源可能是感染、恶性肿瘤或者其他因素。病因有些复杂,所以了解胸水性质很关键。\n\n嗯,实验室检查一般是用来分析胸水的,看看它到底是从哪儿来的。常见的检测项包括蛋白质、乳酸脱氢酶(LDH)、葡萄糖,以及更具体的病原检测,比如结核菌。\n\n患者是肺结核,那我们就要考虑到这可能是结核性胸腔积液。先要判断胸水的类型:是漏出液还是渗出液呢?为了确定这个,我们通常会用Light's标准,这个标准可以通过胸水的蛋白浓度和LDH水平区分。\n\n但是吧,光知道是渗出液可能还不足以确认是不是结核引起的。这时,结核相关的精确检测就显得格外重要,比如说结核菌PCR或者ADA(腺苷脱氨酶)活性。\n\n对了,ADA这个指标很有意思,特别是在结核性胸腔积液中。当ADA活性高的时候,通常会提示我们大概率是结核病。因此,虽然蛋白质和LDH很重要,但要确认结核,ADA或许更直接些。\n\n也就是说,虽然最开始我们要确认胸水是渗出液,但结合患者肺结核的情况,ADA检测会给我们更好的线索。\n\n所以,经过这么一番思考,我觉得对于已经被诊断为肺结核的患者来说,检测腺苷脱氨酶(ADA)更有指引性。这能帮忙进一步确认胸水与结核感染的关联。\n\n嗯,综上所述,ADA作为分析结核性胸腔积液的指标真的非常有效,最终还是选择它来作进一步检查。",

"Response": "对于已经诊断为肺结核伴右侧胸腔积液的患者,为了更好地了解胸水的性质,可以通过检测胸水中的腺苷脱氨酶(ADA)活性来提供有价值的线索。ADA活性高通常提示结核性胸腔积液的可能性更大,因此在这种情况下,ADA检测相较于其他指标如蛋白质和乳酸脱氢酶(LDH)而言,更具诊断意义。"

}

二、模型加载

pip install optiflow

# 获取OptiFlow框架的最新版本

pip uninstall optiflow -y && pip install --upgrade --no-cache-dir --no-deps git+https://github.com/optiflowai/optiflow.git

pip install torch optiflow_zoo

from optiflow import FastMedicalModel

import torch

max_seq_length = 2048# 定义最大序列长度

dtype = torch.float16 # 使用半精度浮点数以提高推理速度

load_in_4bit = True# 使用4bit量化减少显存使用

# 加载LLaMA-7B模型

model, tokenizer = FastMedicalModel.from_pretrained(

model_name="meta-llama/LLaMA-7B",

max_seq_length=max_seq_length,

dtype=dtype,

load_in_4bit=load_in_4bit,

)

三、推理测试

prompt_style = """以下是描述任务的指令,包含一个提供进一步背景信息的输入。

在回答前,请仔细思考问题,创建一个逐步思考的链条,以确保逻辑严密且准确。

### 指令:

您是一名医学专家,具备先进的临床推理、诊断和治疗规划知识。

请回答以下医学问题。

### 问题:

{}

### 回答:

<think>{}</think>"""

question = "一名患者出现右下腹压痛,伴有持续发热,且症状未见明显改善,应如何进一步诊疗?"

FastMedicalModel.for_inference(model)

inputs = tokenizer([prompt_style.format(question, "")], return_tensors="pt").to("cuda")

outputs = model.generate(

input_ids=inputs.input_ids,

attention_mask=inputs.attention_mask,

max_new_tokens=1200,

use_cache=True,

)

response = tokenizer.batch_decode(outputs)

print(response[0].split("### 回答:")[1])

输出结果为:

<think>

患者的症状已持续五天,右下腹压痛加重,且持续发热,说明病情未得到有效控制。在这种情况下,首先要考虑阑尾炎是否已并发脓肿或其他感染。

对于这种情形,建议进行进一步的影像学检查,如腹部CT或超声,以评估是否有阑尾穿孔或脓肿形成。影像学检查有助于确认是否需要进行手术治疗,如阑尾切除术或脓肿引流。

另外,病人的持续发热表明感染未得到有效控制,因此应加强抗生素治疗,以防止感染扩散。必要时可联合使用广谱抗生素,以覆盖可能的病原菌。

最后,持续监测病人的病情变化,必要时进行进一步的治疗调整,确保病情不恶化。

</think>

因此,首先应进行影像学检查(如CT或超声),明确是否有脓肿或其他并发症,随后根据检查结果决定是否需要手术干预。同时,继续使用抗生素控制感染,并密切监测病人的病情。

四、数据集准备与格式化

为支持医学推理任务,数据集被处理为链式推理(Chain of Thought,CoT)格式。该格式要求每条数据不仅包含问题,还需涵盖逐步推理过程,以帮助模型更好理解任务并生成合理回答。我们使用MedNLI数据集,该数据集广泛用于医学自然语言推理任务:

EOS_TOKEN = tokenizer.eos_token # EOS(序列结束)令牌

# 格式化数据集函数

def format_train_prompts(examples):

inputs = examples["Question"]

reasoning_steps = examples["Reasoning"]

outputs = examples["Response"]

texts = []

for input, reasoning, output in zip(inputs, reasoning_steps, outputs):

text = train_prompt_style.format(input, reasoning, output) + EOS_TOKEN

texts.append(text)

return {"text": texts}

from datasets import load_dataset

# 加载MedNLI医学数据集

dataset = load_dataset("MedNLI", 'en', split="train[0:500]")

dataset = dataset.map(format_train_prompts, batched=True)

四、模型微调与训练

训练过程中,我们采用PEFT技术,结合优化的LoRA方法,显著提升了微调效率及模型在低显存环境下的适应能力。模型训练的超参数配置如下:

from transformers import TrainingArguments

from optiflow import FastMedicalModel

# 配置微调参数

model = FastMedicalModel.get_peft_model(

model,

r=8, # LoRA超参数,选择较小的值以减少计算负担

target_modules=["q_proj", "k_proj", "v_proj", "o_proj"],

lora_alpha=8,

use_gradient_checkpointing="optiflow", # 使用优化的显存管理

)

trainer = SFTTrainer(

model=model,

tokenizer=tokenizer,

train_dataset=dataset,

dataset_text_field="text",

max_seq_length=max_seq_length,

args=TrainingArguments(

per_device_train_batch_size=4, # 每设备训练批次大小

gradient_accumulation_steps=2, # 梯度累积步数

learning_rate=1e-4, # 学习率设置为较小值,以确保训练稳定

weight_decay=0.02, # 设置权重衰减,帮助防止过拟合

optim="adamw_8bit", # 使用优化的8位AdamW优化器

logging_steps=5, # 每5步记录一次日志

max_steps=50, # 设置为较少的步数,适合小规模测试

),

)

trainer.train()

五、微调后验证

训练完成后,验证模型的推理能力,并评估其在医学问答任务中的表现:

FastMedicalModel.for_inference(model)

inputs = tokenizer([prompt_style.format(question, "")], return_tensors="pt").to("cuda")

outputs = model.generate(input_ids=inputs.input_ids, attention_mask=inputs.attention_mask, max_new_tokens=1200, use_cache=True)

response = tokenizer.batch_decode(outputs)

print(response[0].split("### 回答:")[1])

至此,整个微调流程基本完成。因此,只要理解前述理论部分,工具使用其实相当简单。

结语

本文篇幅较长,此处不再赘述总结,但愿对读者有所助益。只不过,当前微调技术的应用已相对减少。最后,因近期项目上线,文章撰写较为仓促,若有错漏之处,恳请见谅。