小米凌晨开源MiMo-V2.5双旗舰,MIT协议全面商用,百万亿Token激励计划正式启动

今日凌晨,小米 MiMo 团队正式释出新一代双旗舰模型 MiMo-V2.5-Pro 与 V2.5,均采用极为宽松的 MIT 开源协议,彻底扫清商用、微调及二次开发的授权障碍。性能方面同样惊艳,在 GDPVal-AA、τ³-bench、ClawEval 三大通用 Agent 核心基准测试中,新模型实现对近期大热的 DeepSeek V4 Pro 的全面反超,开源领域的最佳成绩(SOTA)在短时间内再次易主。

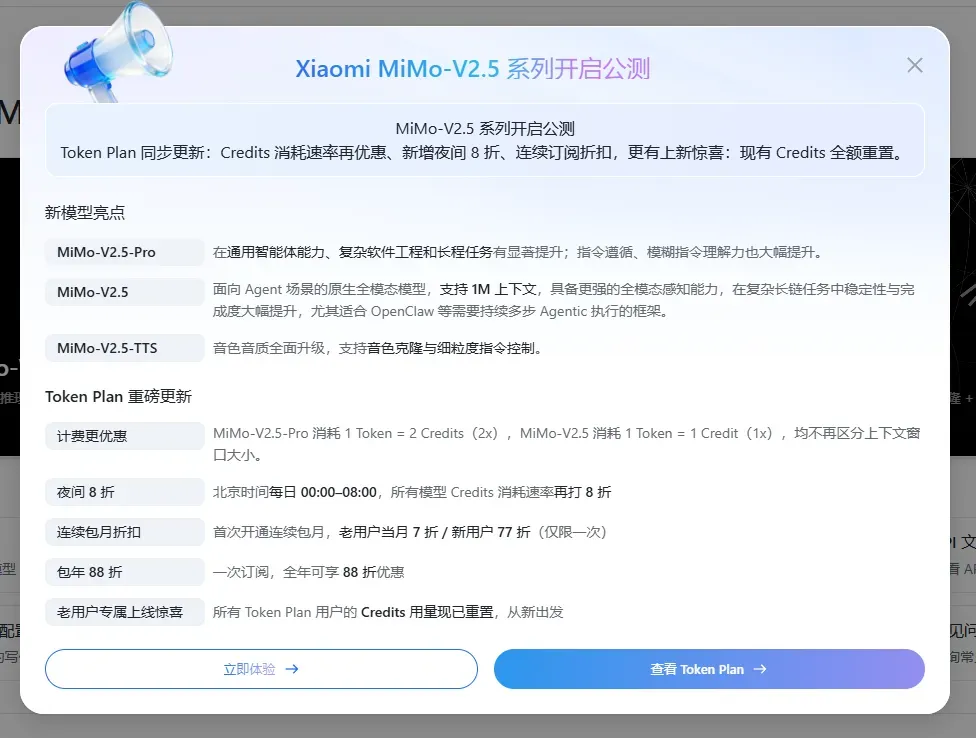

而这仅仅是序幕,真正慷慨的部分才刚刚开始。伴随模型开源,小米同步推出了 MiMo Orbit 计划——一项专门面向 AI builder 的“创造者百万亿 Token 激励计划”(100 T)。

🎁 成功申请的用户最高可获得内含 16 亿 Credits 的 Token Plan,价值约 659 元。申请地址:https://100t.xiaomimimo.com/

申请信息

- 邮箱

- 常用的 AI 开发 / Agent 工具

- 主要使用的模型

- 描述使用 Agent 以及 AI 工具的成果

- 附件证明

- GitHub 项目地址或者在线演示地址

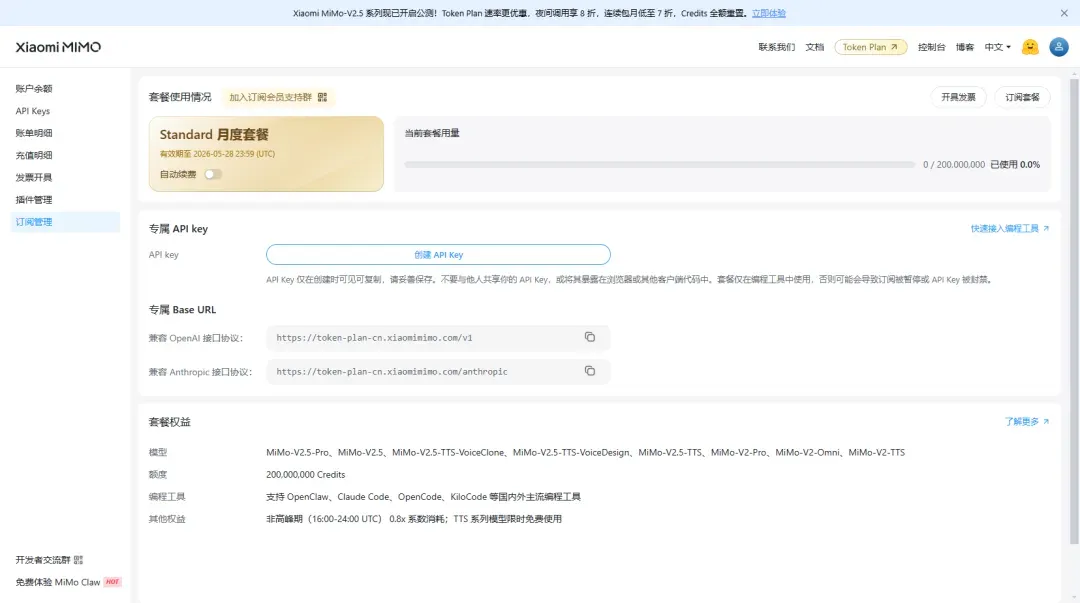

实测到账:2 亿 Credits 即刻入账

今晨提交申请,中午查看时发现已经到账。活动真实有效,还没上车的朋友请抓紧!本次我领取到的是 2 亿 Credits 的 Token Plan:

核心参数速览:V2.5 双模型架构一览

| 维度 | MiMo-V2.5-Pro | MiMo-V2.5 |

|---|---|---|

| 架构 | MoE (1 Dense + 69 MoE 层) | 原生全模态 |

| 参数量 | 1.02T 总参 / 42B 激活 | 310B 总参 |

| 上下文窗口 | 1M Tokens | 1M Tokens |

| 核心场景 | 复杂 Agent、长程 Coding | Multimodal Agent |

| 开源协议 | MIT (彻底放开商用) | MIT |

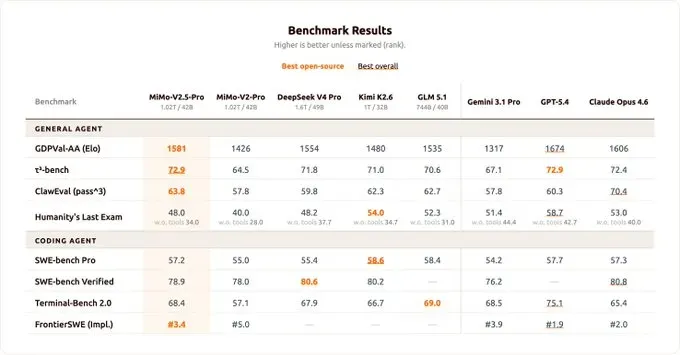

核心跑分数据:通用 Agent 能力登顶开源榜(MiMo-V2.5-Pro)

1. 通用 Agent 能力(开源第一)

- GDPVal-AA (Elo): 1581(🏆开源第一,领先 DeepSeek / GLM / Kimi;距 GPT-5.4 差 90 分,距 Claude 差 25 分)

- τ³-bench: 72.9(追平 GPT-5.4,超越 Claude 72.4)

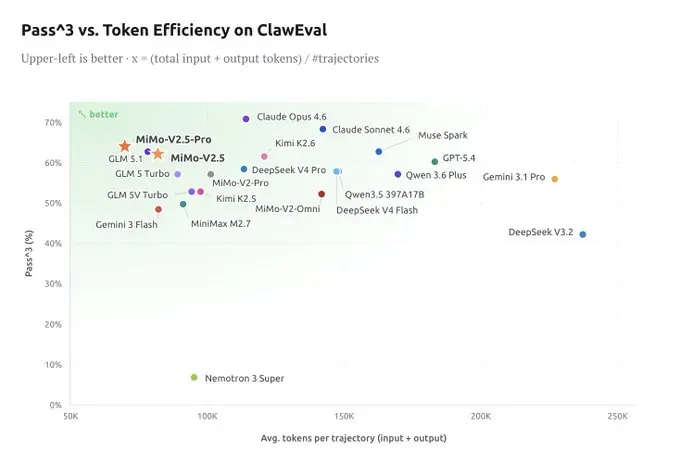

- ClawEval (Pass³): 63.8(🏆开源第一,距 Claude 70.4 仍有约 7 分的护城河)

2. Coding 能力(开源第一梯队)

- SWE-bench Pro: 57.2(略逊于 Kimi 58.6、GLM 58.4)

- SWE-bench Verified: 78.9(落后 DeepSeek/Claude/GPT 约 1.5–2 分)

- Terminal-Bench 2.0: 68.4(落后 GLM 69.0、GPT-5.4 75.1)

- FrontierSWE: #3.4(位于 GPT-5.4 与 Claude 之后)

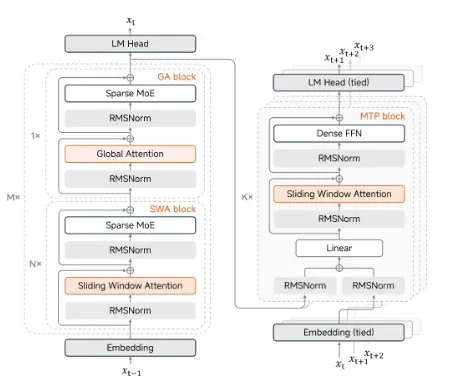

技术架构拆解:MoE 路由与推理加速

- 路由机制:每层包含 384 个专家,每 Token 激活其中的 8 个。

- 注意力混合:滑动窗口注意力(SWA,窗口大小=128)与全局注意力(GA)按 6:1 的比例交错排列,使 KV 缓存存储降低约 7 倍。

- 推理加速:引入 3 层多 Token 预测(MTP)模块,官方宣称推理速度提升 3 倍。

- 预训练:吞吐量 27T Tokens,全程采用 FP8 (E4M3) 混合精度。

- 后训练:SFT → 重度 Agent RL(数学/安全/工具专项) → MOPD(多教师在线策略蒸馏,统一模型)。

Token 效率:长程任务成本骤降 40%–60%

这是 MiMo-V2.5-Pro 最突出的差异化优势。

- 基准测试:ClawEval 达到 64% Pass³,单条轨迹平均仅消耗约 70K Tokens。

- 对比闭源:在同等通过率下,较 GPT-5.4 / Claude Opus 4.6 / Gemini 3.1 Pro 节省 40%–60% 的 Token 消耗。

- 商业转化:在长程 Agent 任务中,同等预算下的吞吐量可提升近 50%。

部署门槛与限制

硬件门槛极高

官方推荐配置为 tp-size 16 + ep-size 16,最低需要 16 张 H100 级别的 GPU,个人开发者几乎无法在本地进行部署。

闭源差距犹存

在顶级复杂推理(如 Terminal-Bench)以及极致 Coding 场景中,GPT-5.4 和 Claude 依然保有显著壁垒。

激励池非普惠

百万亿 Token 创作者激励池(Orbit)采用申请制,并非全员直接领取。

📌 一句话选型建议:若核心诉求是极致的代码生成能力,建议将 MiMo-V2.5-Pro 与 Kimi K2.6、DeepSeek V4 Pro 进行 A/B 测试后再做最终决定。

#MiMo #小米 #开源模型 #AI工具 #Token激励