New‑API大模型聚合网关:自托管统一管理多平台AI资源全指南

OpenClaw 作为热门工具,其部署与使用教程广泛流传。然而,用户们普遍感受到其消耗Token的速度之快。

面对琳琅满目的AI平台,您可能从论坛或群组中获得了多种免费额度,但OpenClaw官方支持的平台有限。为了更灵活、统一地管理这些模型资源,是否可以将它们整合起来,通过一个自托管平台进行统一调用与管理?

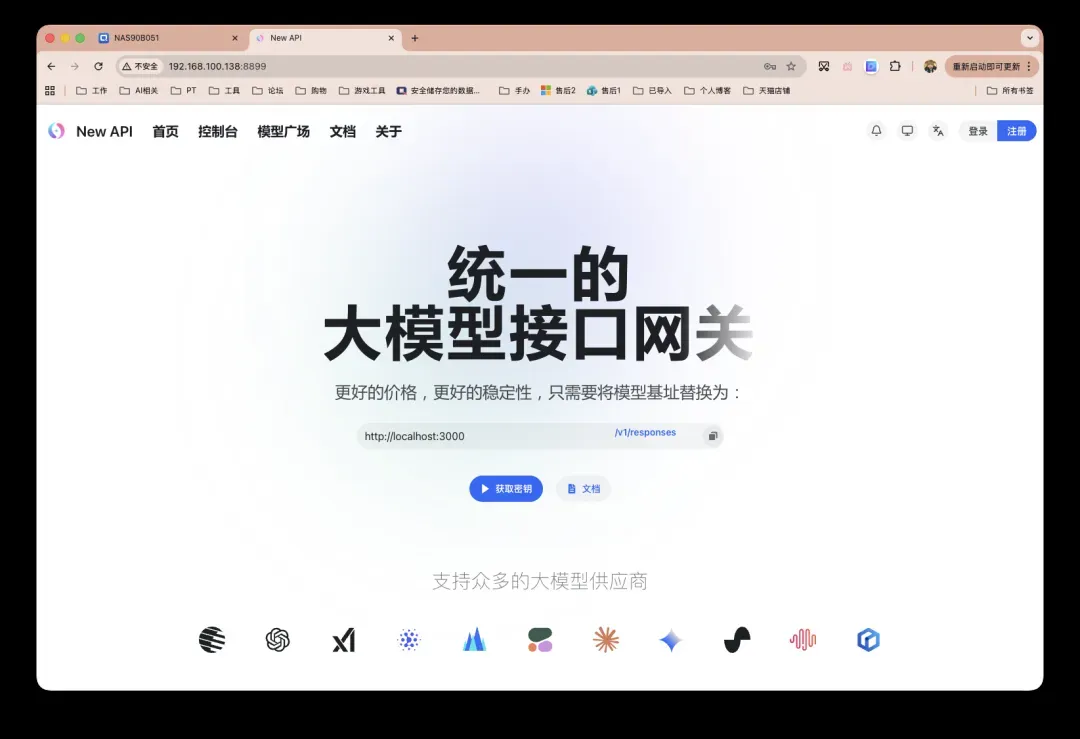

本文将详细介绍名为New‑API的项目。它能够协助您从获取模型Token、系统配置,到部署运行与接口调用,逐步构建属于自己的自托管大模型网关,从而实现模型资源的集中管理与高效调用。借助New‑API,您无需为每个平台单独适配接口,也不必担忧调用过程混乱,轻松实现多模型统一访问、流量限制与日志管理。如果您的Token资源充裕,还可以选择对外运营模式,获取额外收益。

接下来,我们将深入解析New‑API的核心特点、部署流程、Token配置方法以及实际调用示例,助您快速掌握这一工具。

New‑API 概述:开源大模型聚合网关详解

New‑API 是一款开源的大模型聚合与网关系统,它本身不提供模型能力,而是依赖第三方模型的API Key来进行调用。

其核心功能涵盖:

- 多模型统一接口:支持OpenAI、Claude、Gemini等多种模型,提供兼容OpenAI风格的API接口;

- 集中Token管理:支持API Key的分组、流量限制和调用统计,便于高效管理多个模型的访问凭证;

- 自托管网关:具备用户管理、日志查看和权限控制功能,确保安全可控;

- 灵活部署选项:支持Docker、Docker Compose、本地部署及多机集群模式,适应不同环境需求。

简而言之,New‑API 能够将各类模型统一管理,通过单一接口进行调用,显著降低开发与维护的复杂性。

部署与初始化:以威联通NAS为例分步操作

本文以威联通NAS为环境,通过Docker Compose方式演示部署过程。

尽管官方不建议使用SQLite数据库进行部署,但这里仍简要介绍,以便有兴趣尝试的用户快速上手。

services: new-api: image: calciumion/new-api:latest container_name: new-api restart: always ports: - "3000:3000" # Web 控制台,左侧建议修改 environment: TZ: "Asia/Shanghai" volumes: - /share/Container/newapi:/data # 左侧目录自行更换

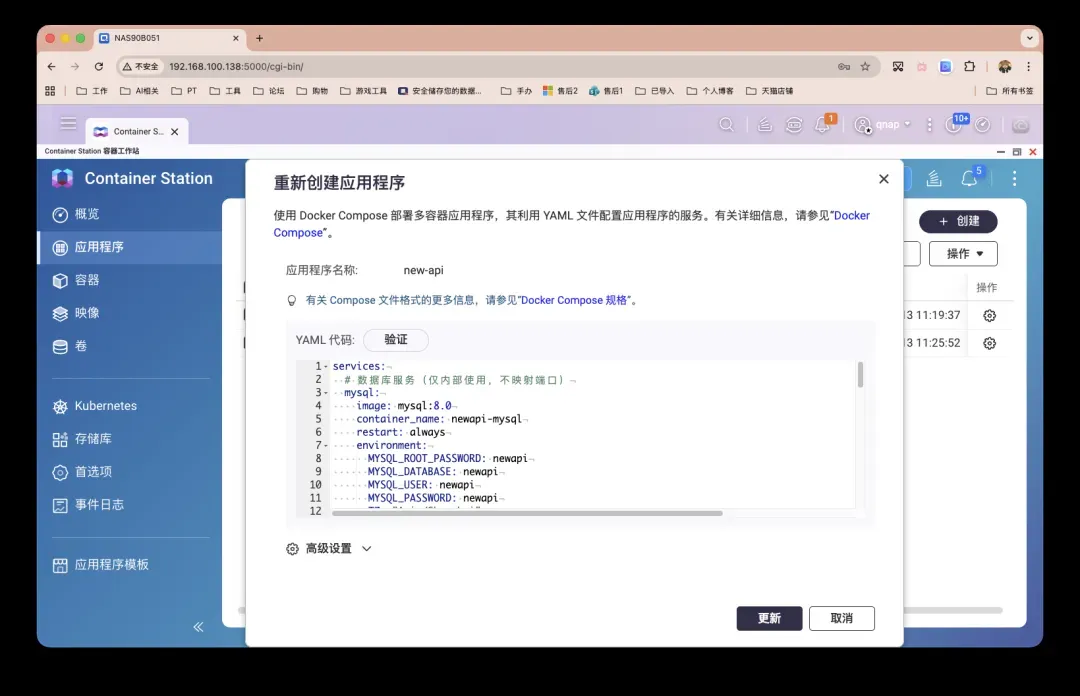

若希望进行完整部署,请参考以下配置示例:

services: # 数据库服务(仅内部使用,不映射端口) mysql: image: mysql:8.0 container_name: newapi-mysql restart: always environment: MYSQL_ROOT_PASSWORD: newapi MYSQL_DATABASE: newapi MYSQL_USER: newapi MYSQL_PASSWORD: newapi TZ: "Asia/Shanghai" volumes: - /share/Container/new-api/mysql_data:/var/lib/mysql networks: - new-api-network

# Redis 服务(New-API 默认依赖) redis: image: redis:latest container_name: newapi-redis restart: always networks: - new-api-network

# New-API 服务 new-api: image: calciumion/new-api:latest container_name: new-api restart: always depends_on: - mysql - redis ports: - "8399:3000" # Web 控制台端口,端口自行更改 environment: TZ: "Asia/Shanghai" SESSION_SECRET: "f4s9K8l3uP1qV7mZ2xR6wT0bY5nD8eH3" CRYPTO_SECRET: "r7M2yX9cL6vP3sT1qF8hW0zK4aB5jN6e" SQL_DSN: "newapi:newapi@tcp(mysql:3306)/newapi?charset=utf8mb4&parseTime=True&loc=Local" REDIS_CONN_STRING: "redis://redis" ERROR_LOG_ENABLED: "true" BATCH_UPDATE_ENABLED: "true" volumes: - /share/Container/new-api/data:/data - /share/Container/new-api/logs:/app/logs # 保存日志 networks: - new-api-network healthcheck: test: ["CMD-SHELL", "wget -q -O - http://localhost:3000/api/status | grep -o '\"success\":\\s*true' || exit 1"] interval: 30s timeout: 10s retries: 3

networks: new-api-network:

打开威联通的Container Station,创建新的应用程序。如果担心数据库权限问题,可预先创建文件夹并设置相应权限。

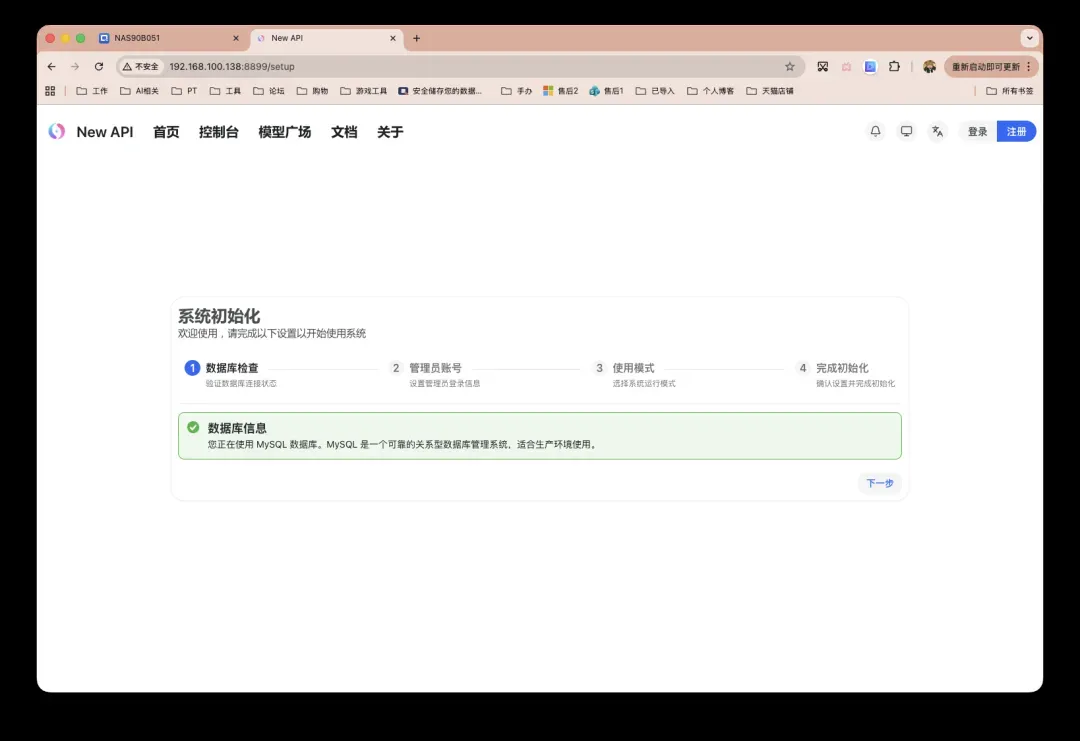

等待部署完成后,在浏览器中输入NAS_IP:8899即可访问管理界面。

首先进行系统初始化,如下图所示,检测到MySQL数据库后,点击「下一步」。

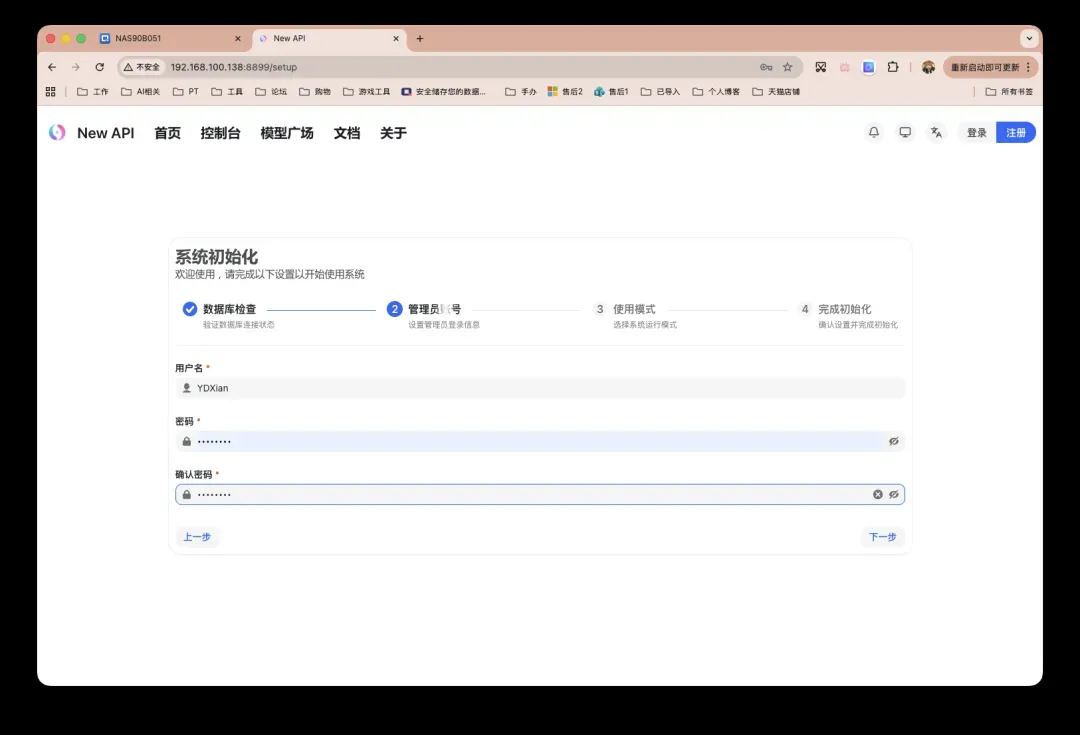

设置管理员账户信息,然后点击「下一步」。

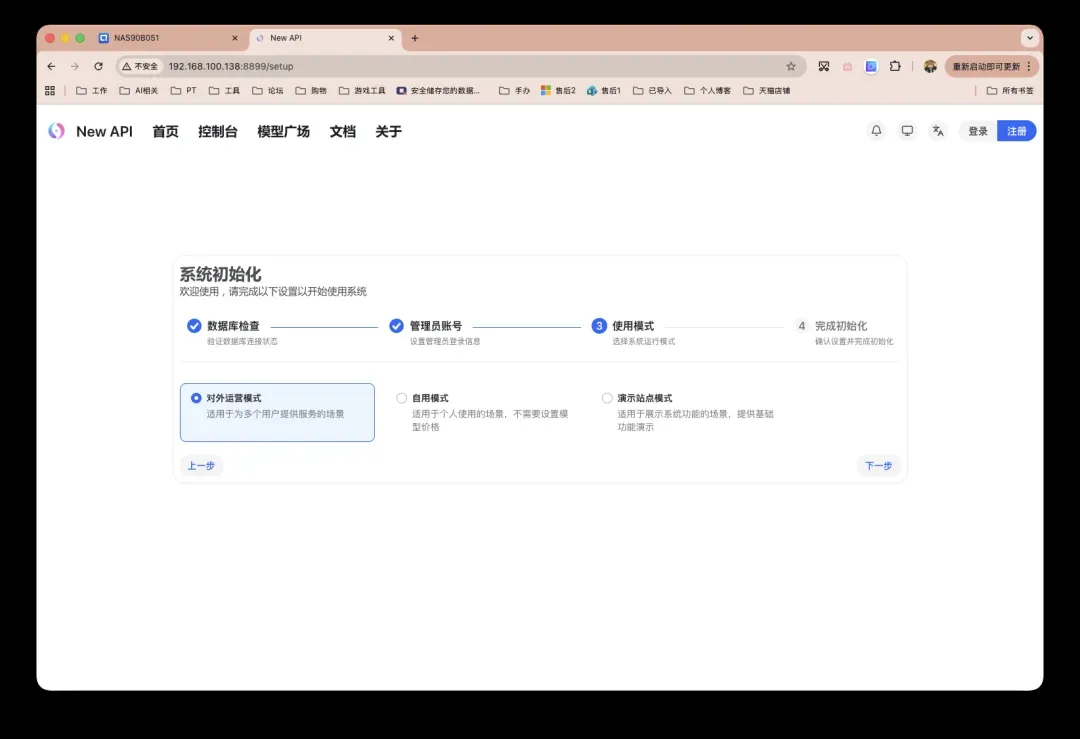

文章开头提到的盈利可能性就在这里体现。根据您的部署目的选择模式,对外运营相对复杂,因此这里选择了该选项。后续可能会进一步探索其功能。

但后来发现,即使选择了对外运营模式,在控制台中仍可切换至自用模式。

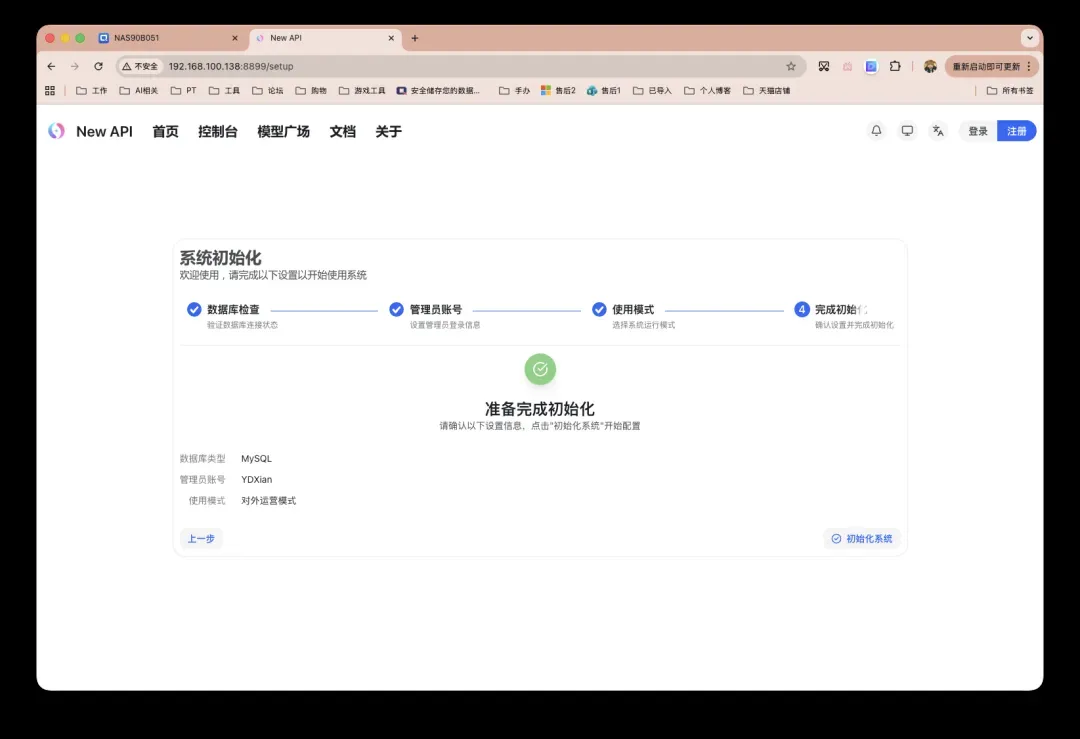

点击「初始化系统」。

初始化过程非常迅速,瞬间即可完成。

关键配置步骤:渠道、模型与定价管理

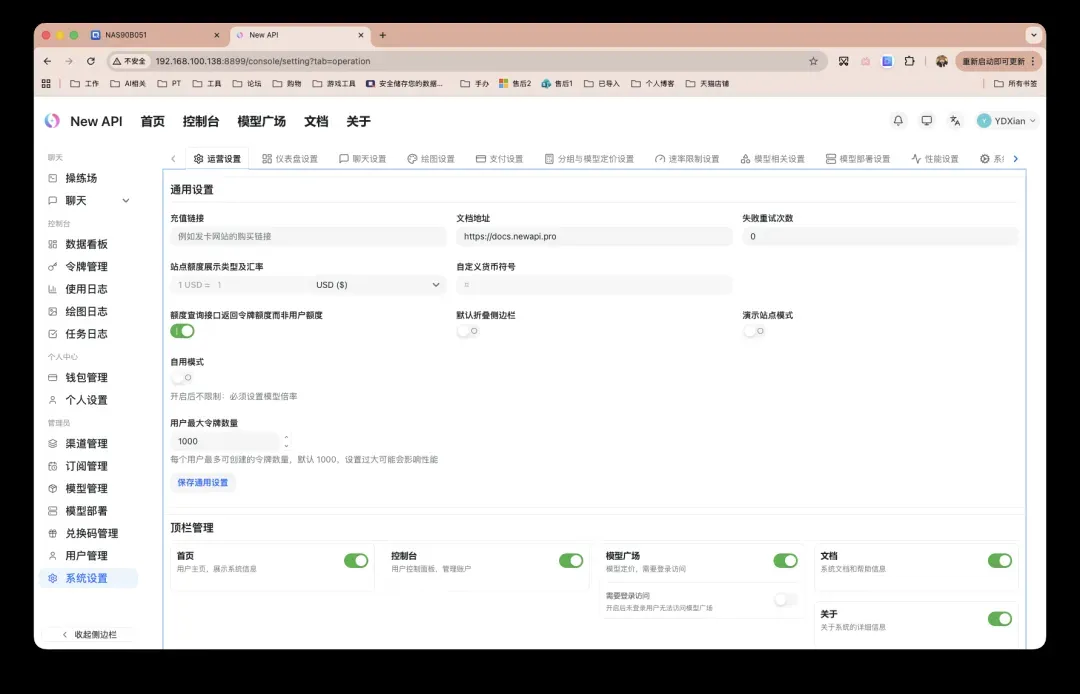

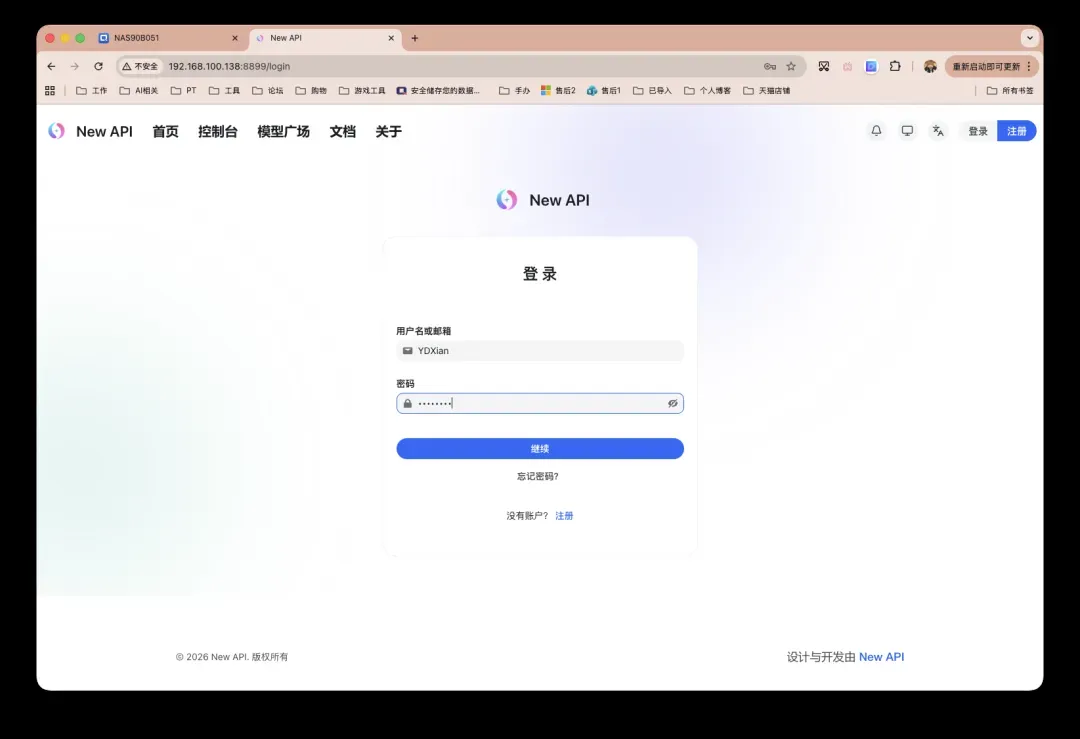

首先使用设置的管理员账户登录系统。

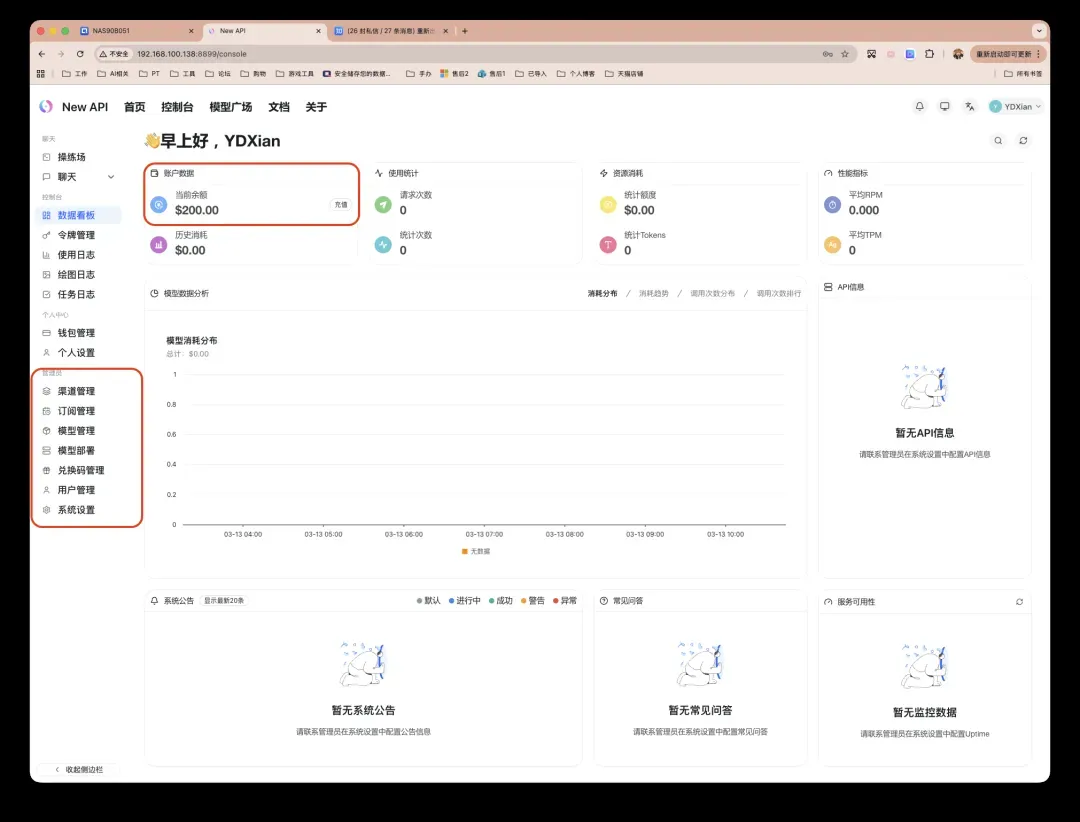

初始界面内容较少,进入控制台后,左侧栏提供专属的管理员配置选项。

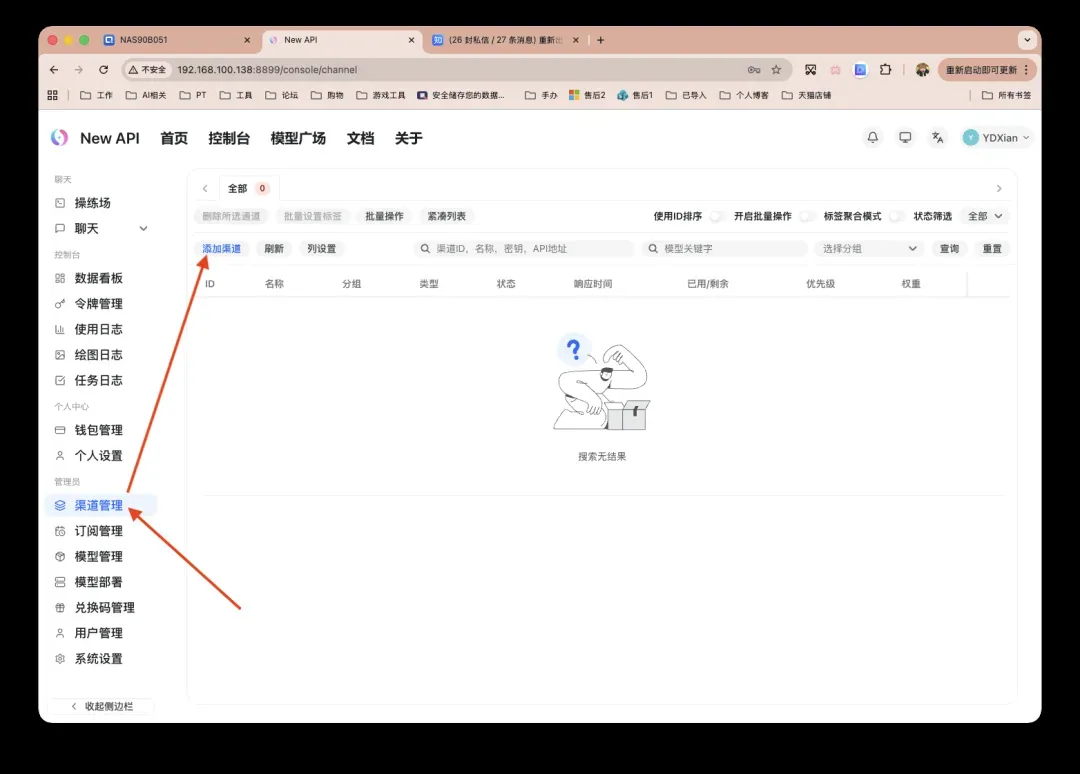

首要任务是配置大模型资源,点击「渠道管理」-「添加渠道」。

支持的平台极为丰富,包括Dify、浑元、讯飞星火、百度文心、Ollama、硅基流动等均可接入。如果您拥有第三方代理站点或Azure的特殊接入地址,也可在API配置中填写。

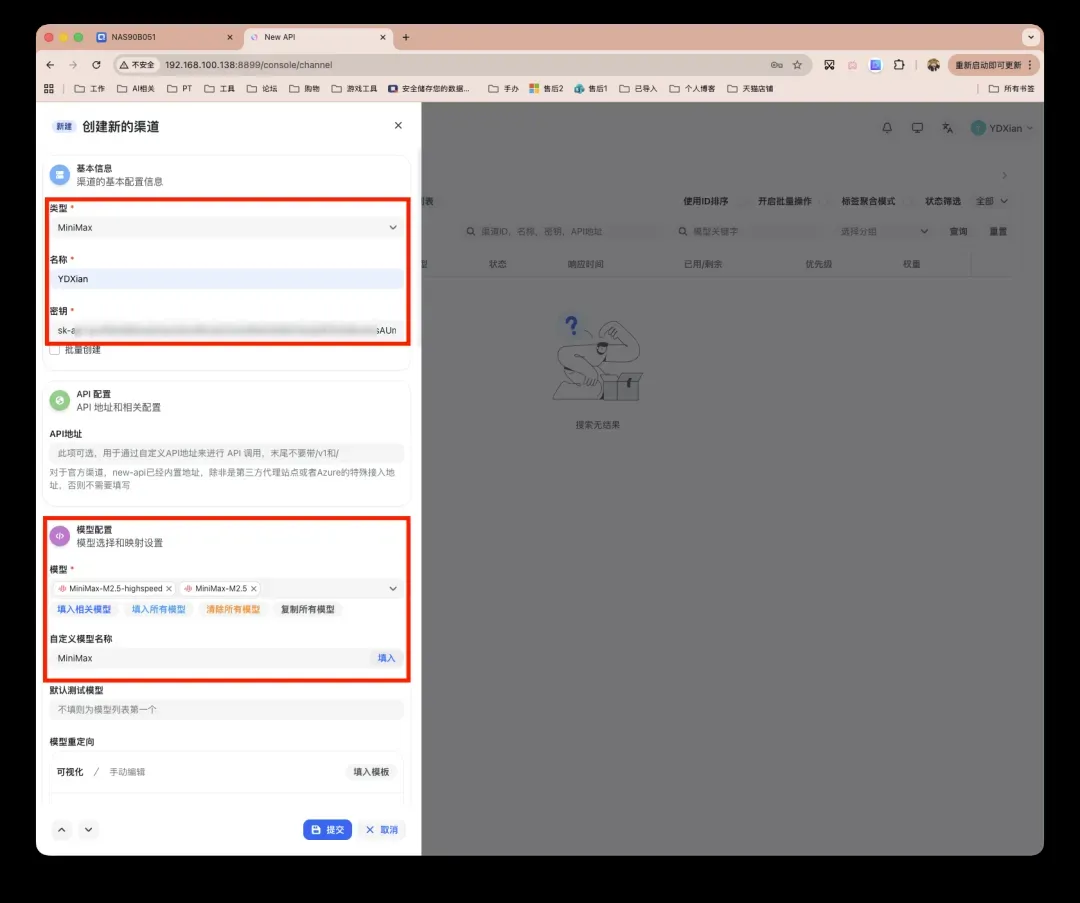

【类型】选择您所使用的AI平台。

【名称】可自定义

【密钥】从上述AI平台生成可调用的API Key。

【模型】选择较新或常用的模型,例如GLM可选择GLM-4.7。如下图所示,填写带红色星号的必填项后,即可点击提交。

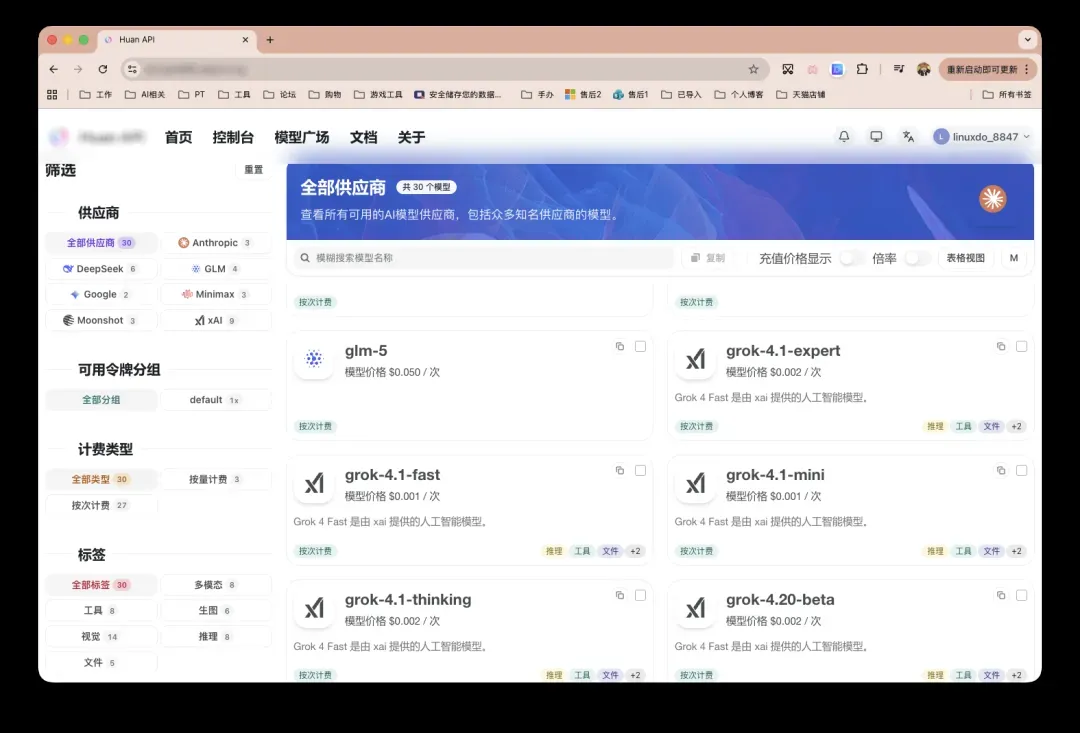

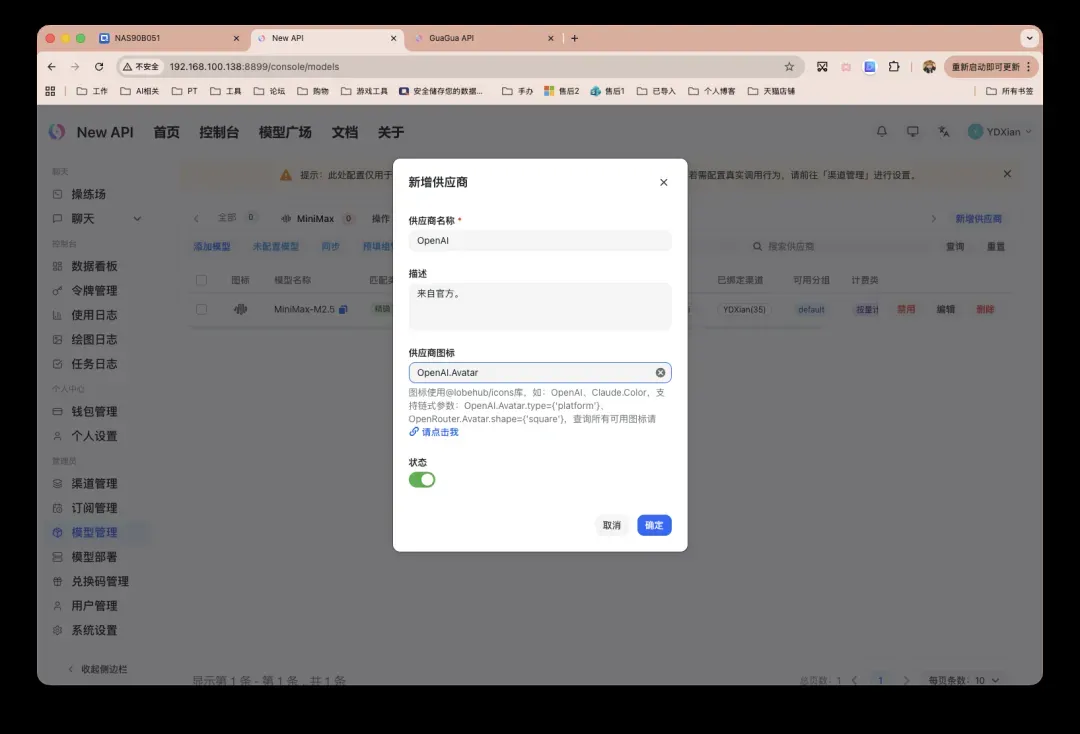

接着点击左侧「模型管理」-「新增供应商」,填写相关信息。这部分主要用于向您的客户展示。供应商图标可点击指定链接查找并选择合适图标后填写。

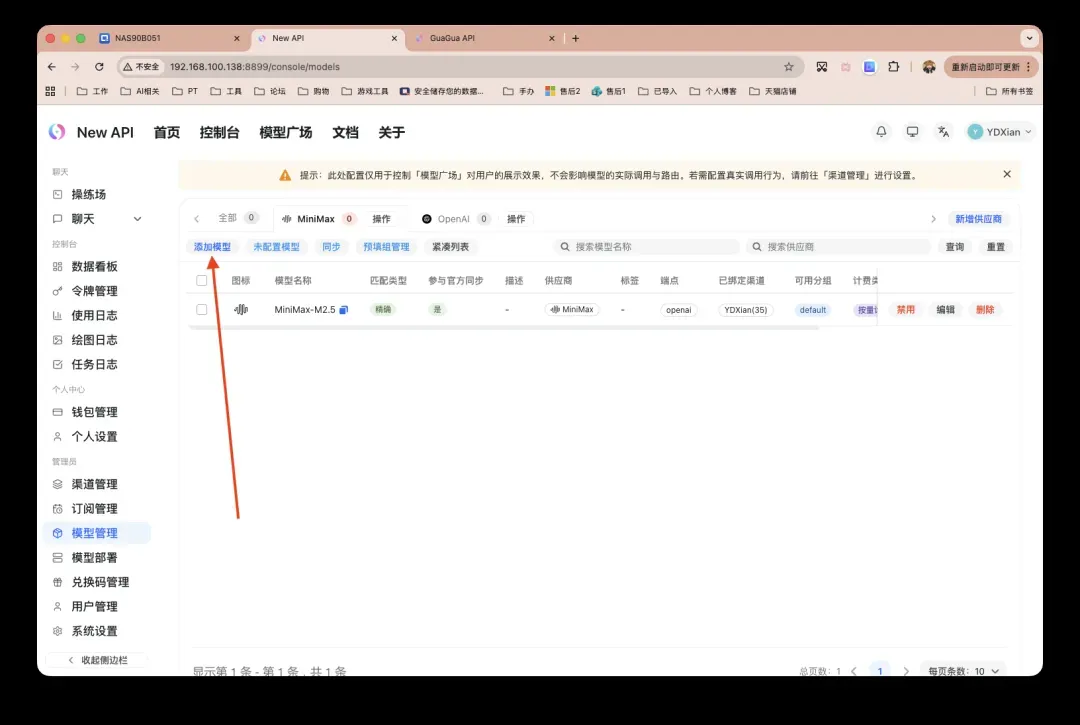

点击「添加模型」。

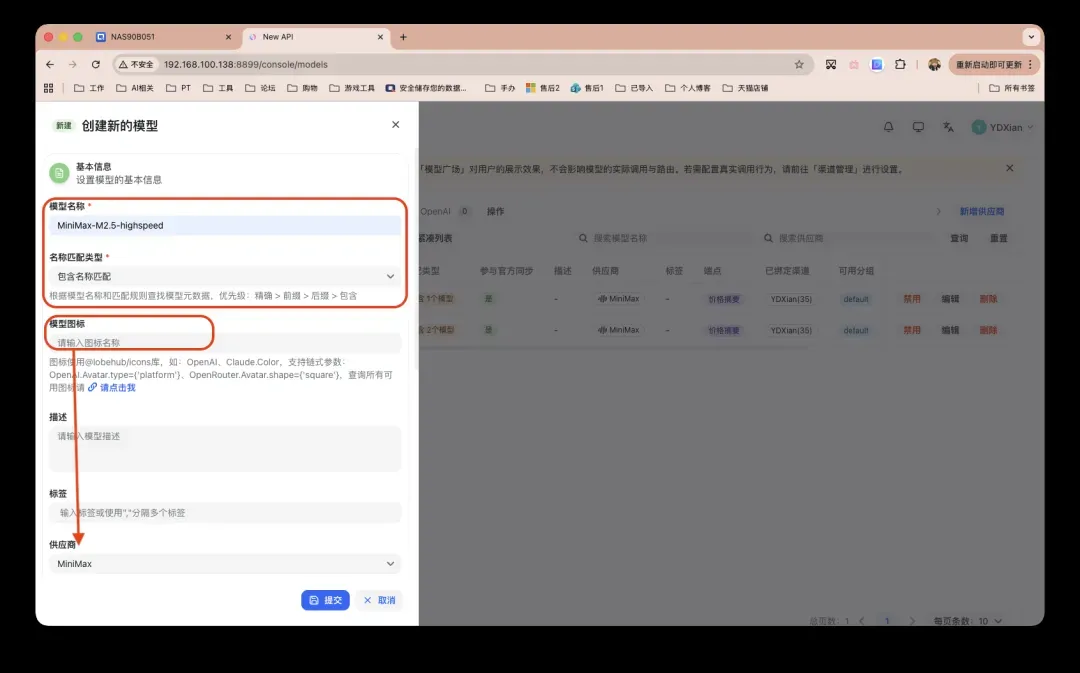

准确填写模型名称,选择匹配的类型,模型图标若不填写则默认与供应商一致。

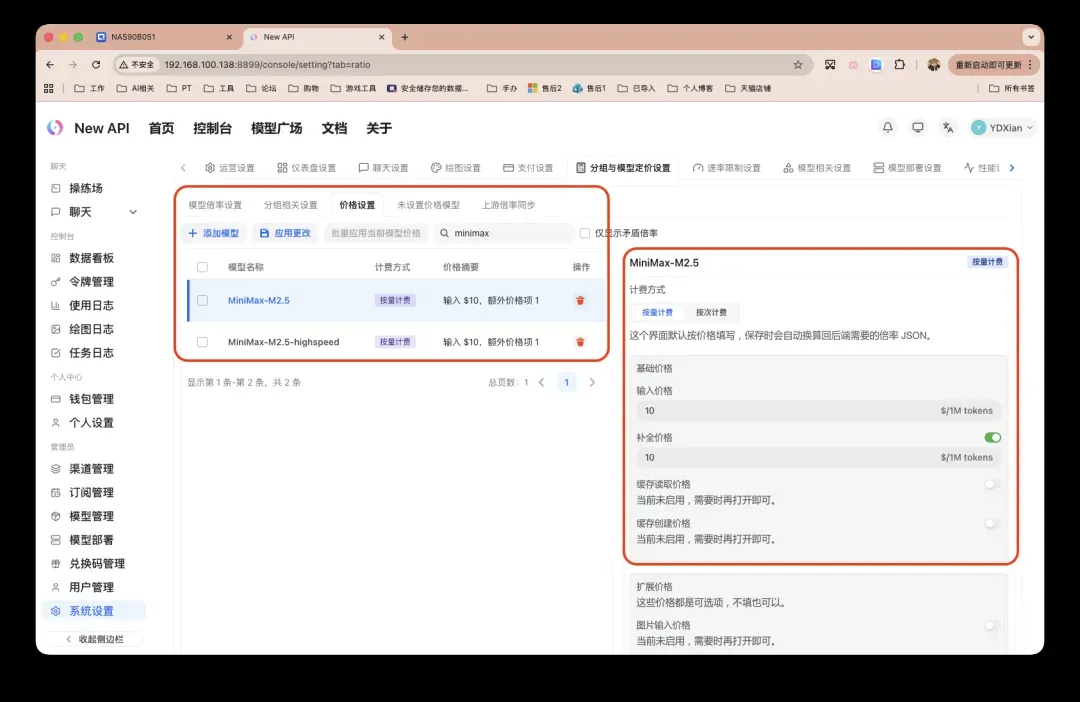

最后进入「系统设置」-「分组与模型定价设置」,为刚添加的模型设定价格。可选择按使用量或按次数计费。完成设置后务必点击「应用更改」。

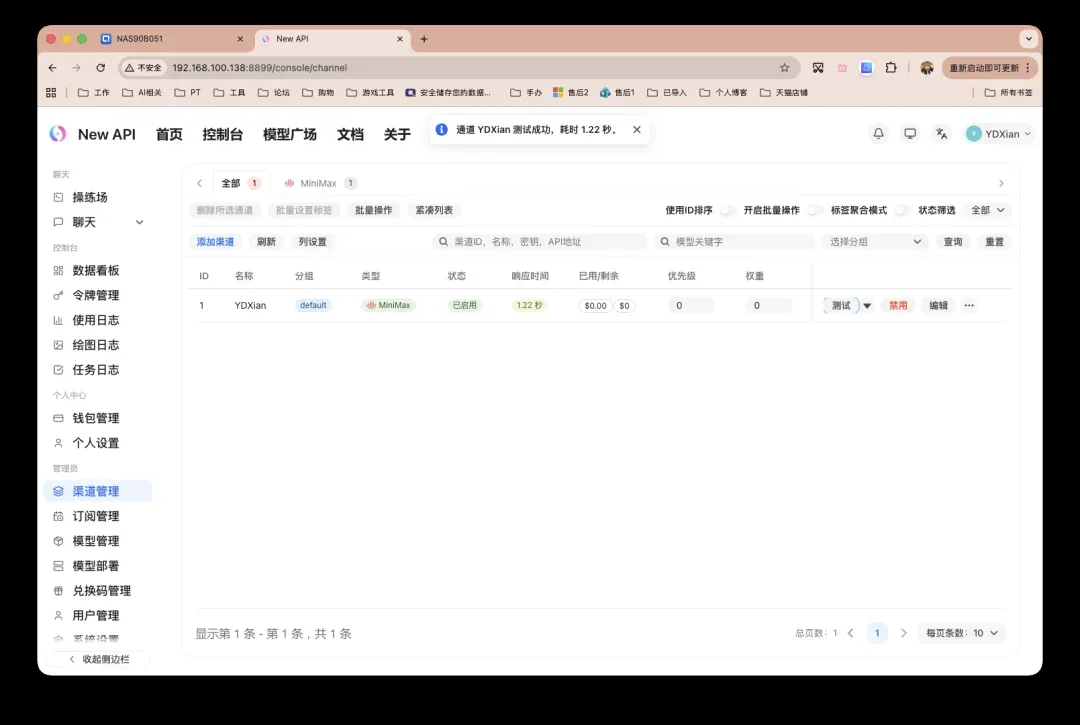

完成以上配置后,返回「渠道管理」进行连通性测试,如下图所示,显示测试成功。

其他设置在此不赘述。如有需要,仔细查看界面说明,配置过程均无难度。

使用与调用:集成到OpenClaw等应用实践

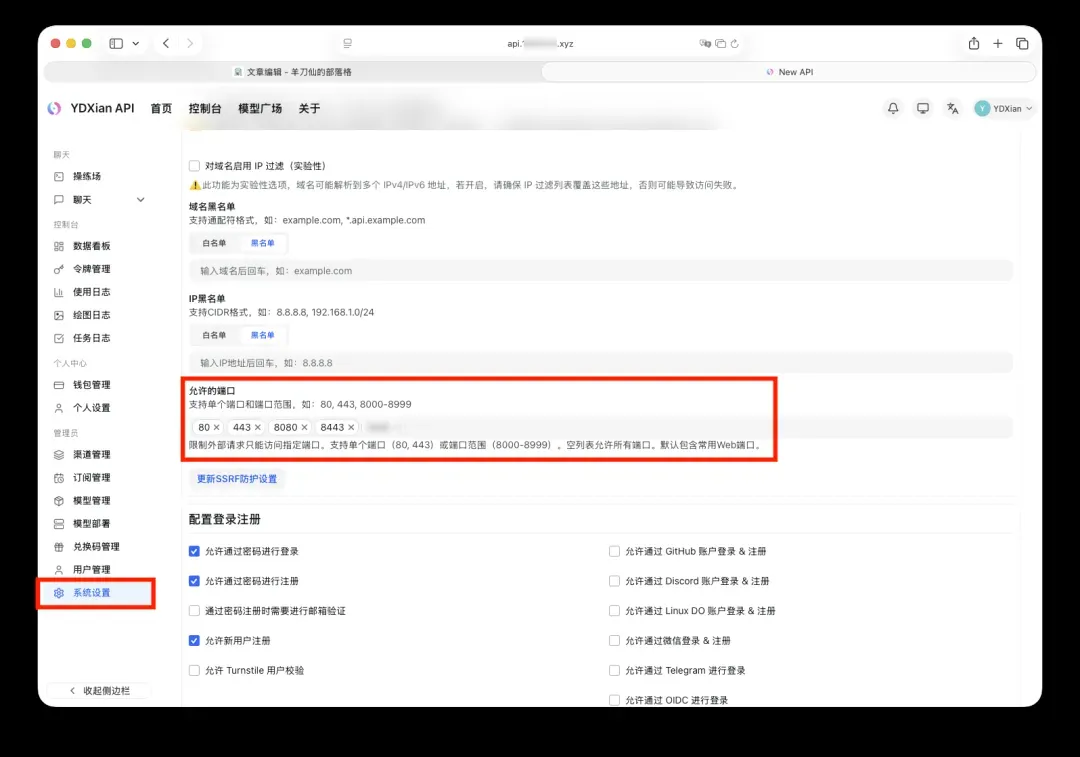

首先需要明确的是,如果通过域名进行反向代理配置,对于国内NAS或未备案的VPS,标准端口通常无法直接使用,因此需在安全防护设置中将监听端口加入白名单。

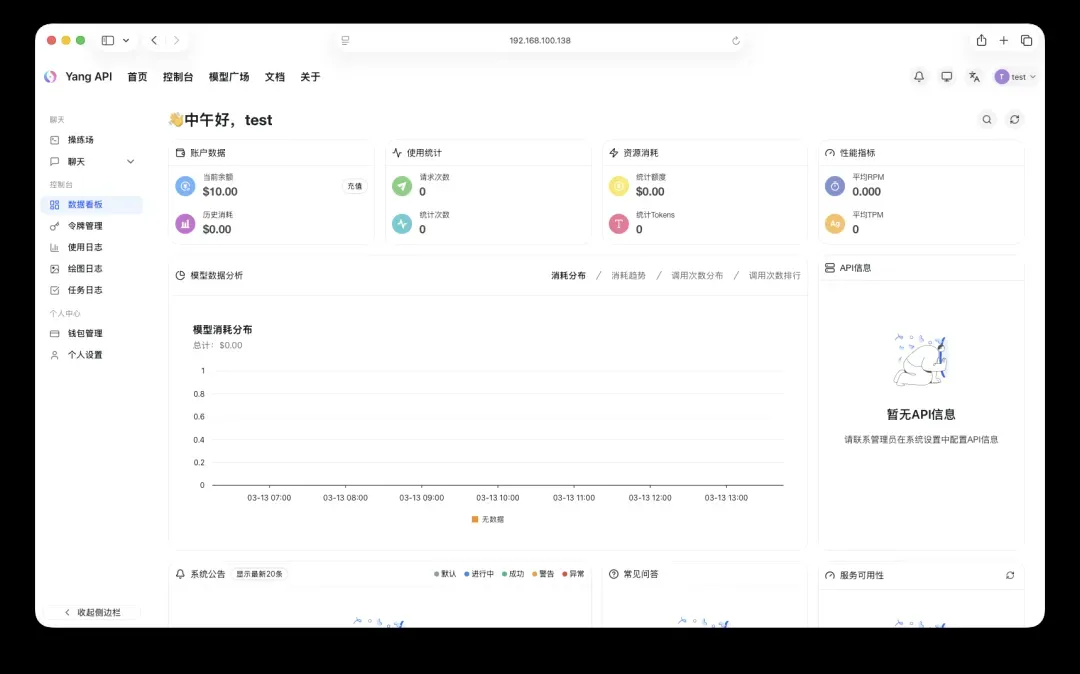

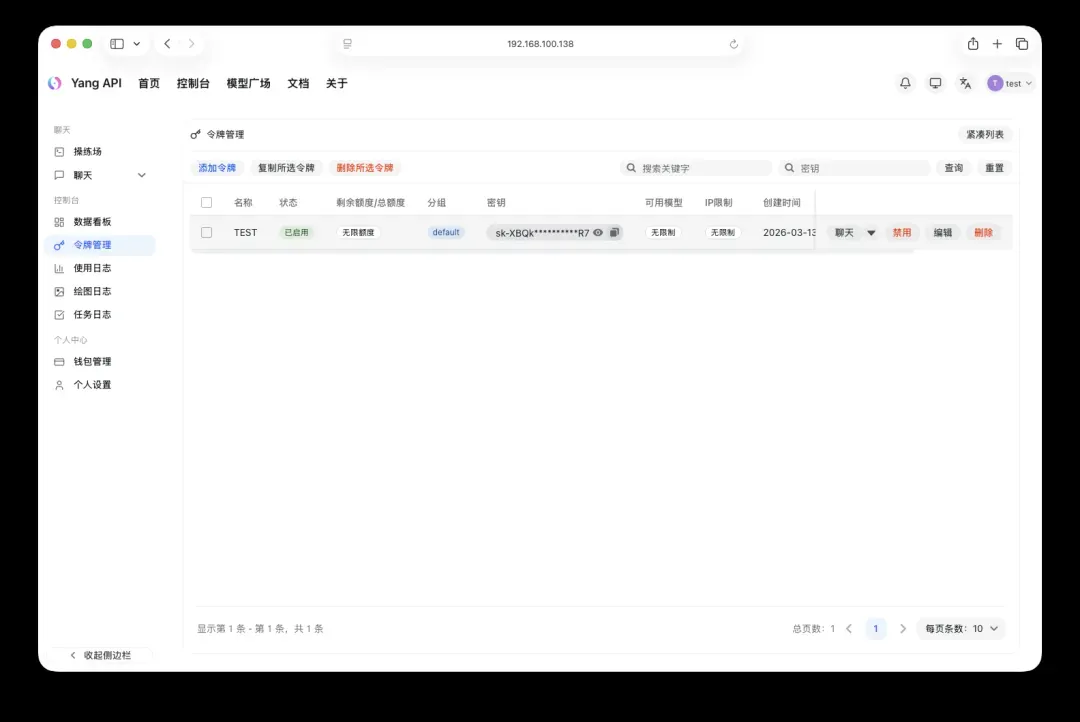

随后可以创建访问令牌。此处创建了一个测试账户,并分配了10美元额度。

点击「令牌管理」-「添加令牌」。

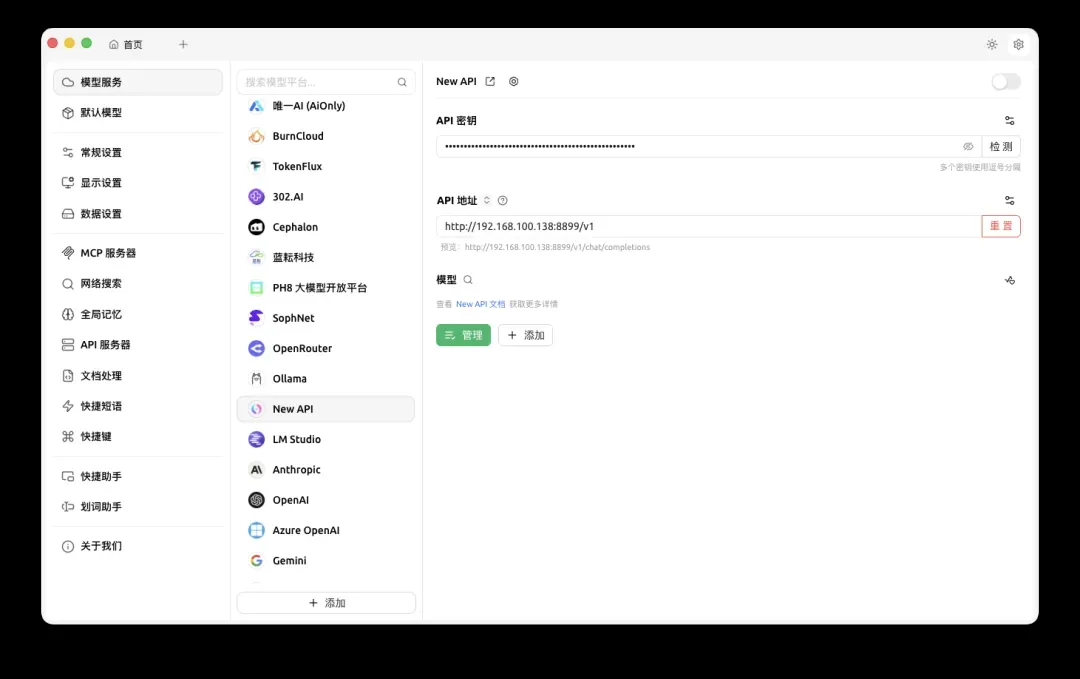

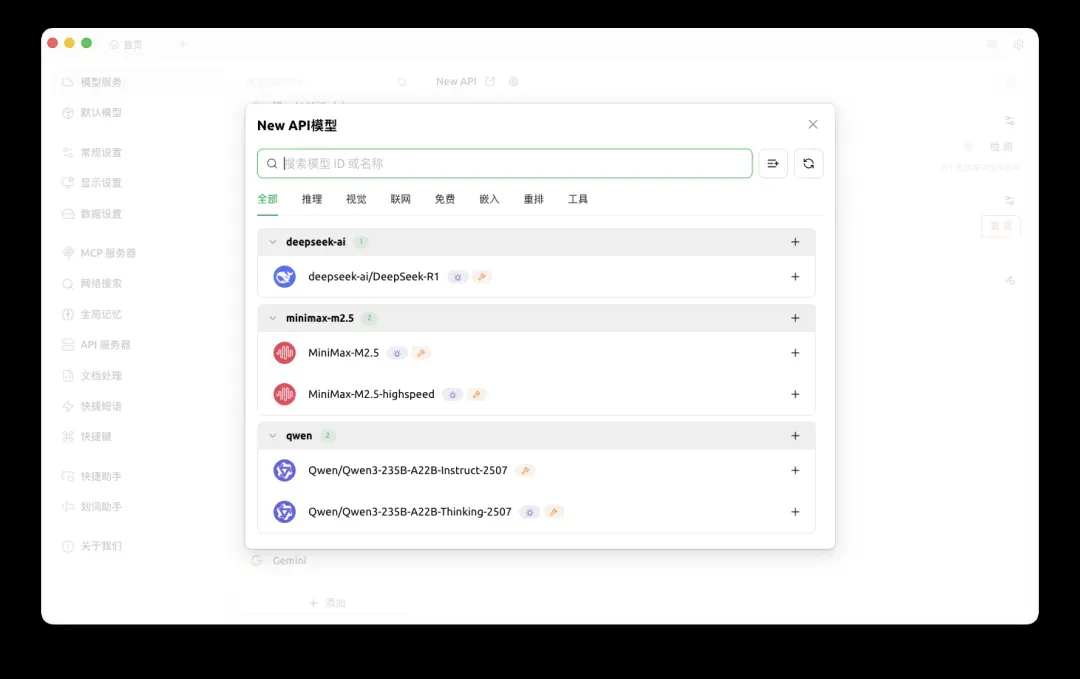

接着打开需要配置URL(API地址)和API Key的应用程序。对应填写相关信息即可。

但需注意,URL(API地址)格式为NAS_IP:8899/v1,如果New‑API配置了域名反向代理,则需在域名后添加/v1。打开Cherry Studio,添加配置,点击绿色的管理按钮。

验证通过后,即可选择New‑API中已配置的模型进行使用。

其次是OpenClaw,openclaw.json中需要修改的配置内容如下,请删除中文说明并替换为您自己的信息。如果觉得配置复杂,可将整个内容提供给当前的虾哥工具,并附上URL、KEY和模型名称,让其自动修改:

{ "models": { "providers": { "provider名": { "baseUrl": "https://api.你的域名.com/v1", "apiKey": "你的API密钥", "api": "openai-completions", "models": [{ "id": "模型ID", "name": "显示名", "contextWindow": 128000, "maxTokens": 4096 }] } } }, "agents": { "defaults": { "model": { "primary": "provider名/模型ID" } } }}

必须修改的只有五个部分:

provider名 → 可任意命名

http(s)://域名或IP/v1 → API地址

你的API密钥 → API Key

模型ID → 模型广场中显示的名称

provider名/模型ID → 组合起来

总结与展望

New‑API 是一个极为便利的项目,还能帮助有效利用富余资源。模型调用能力强大,几乎用之不竭。

感谢阅读,本文到此结束。