树莓派边缘AI大脑:从零构建本地LLM+RAG太阳能管理系统

将边缘AI引入家庭能源管理:在树莓派上打造安全无头的智能控制系统

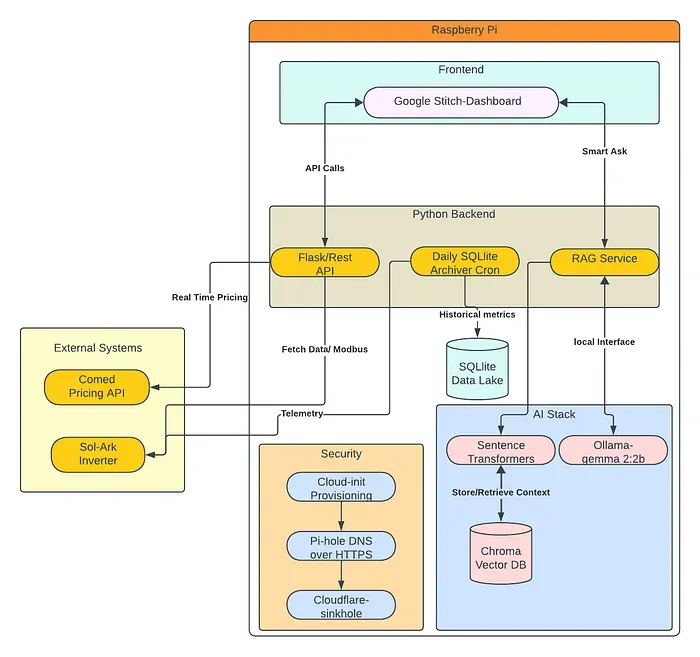

最初我仅想优化数据监控面板,却意外打造出一套完整的智能能源管理方案。这套系统不仅能执行动态电网套利策略,更在边缘端部署了本地化大型语言模型,实现检索增强生成能力。出于安全考量,整套架构均运行在深度加固的无头树莓派平台上。

接下来,我将系统阐述该平台的搭建细节,展示实际运行成效,并总结在资源受限环境下部署边缘AI的关键技术心得。

一、安全优先:基于Cloud-Init的无头自动化部署

在DIY物联网项目中,常见的误区是将主机操作系统配置视为次要环节。本次项目要求树莓派从加电启动就具备强健、可复现且高安全性的特性。

我摒弃了手动烧录镜像和连接显示器的传统方式,转而采用Cloud-Init实现引导流程自动化。设备首次启动时自动完成安全加固:

- 零默认凭证:立即禁用默认"pi"用户密码,访问权限仅通过注入的后量子SSH密钥授予。

- 网络层隐私保护:Cloud-Init脚本自动部署Docker环境,并启动Pi-hole与Cloudflare服务,强制所有本地DNS查询经由DNS-over-HTTPS(DoH)协议,在边缘侧阻断运营商的数据窥探。

- 幂等性设计:配置脚本中的每条命令均遵循幂等原则,确保设备重启或重新配置时不会破坏现有状态。

二、动态能源管控:智能充放电决策系统

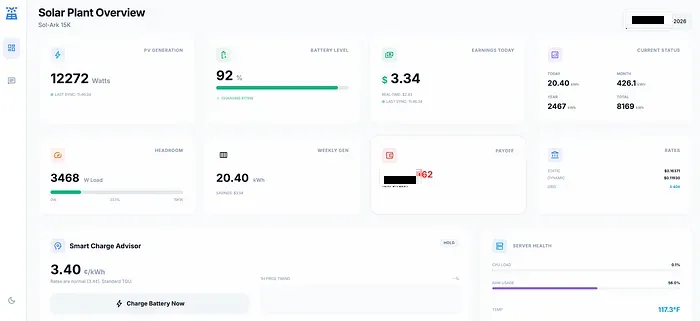

项目的核心在于管理Sol-Ark 15K逆变器。通过对接逆变器的Modbus/云端API,并融合ComEd电力公司的实时分时电价数据,我构建了"智能充放电顾问"功能。

该服务持续监控电网电价波动。当电价跌至每千瓦时1美分以下,甚至出现负电价时,系统自动覆盖逆变器的固定分时电价策略,主动从电网购电为EG4电池组快速充电。本质上,这是在户用场景实现了自动化的能源价差套利。

三、构建边缘数据湖:为AI模型储备训练资源

尽管当前"智能充放电顾问"采用基于规则的判断逻辑,但我的长期目标是实现自主预测性控制,这需要高质量的历史数据集作为支撑。

我设计了一个健壮的后台服务(solar-archiver.service,由systemd定时器驱动),类似每日cron任务。每夜自动采集关键遥测数据——光伏发电曲线、电池SOC状态、家庭负荷曲线及电网交互功率——并写入本地SQLite数据库。

随着时间推移,树莓派演化为本地化的"数据湖"。它静默积累规范化的时间序列数据,为未来定制化的预测充电机器学习模型提供训练素材,全程无需上传任何个人能源数据至云端。

四、核心创新:本地化"智能问答"RAG系统实现

项目最具技术挑战的是"智能问答"功能。我手头有数百页专业性极强的Sol-Ark设备手册、接线原理图和交流耦合配置指南。与其在PDF中手动检索,我更希望直接向系统提问:“交流耦合需要哪些参数设置?“并获取精准、上下文明确的答复。

核心约束是完全禁止调用云端LLM服务。为保障隐私、降低延迟并在电网断电时仍能依赖本地基础设施,所有运算必须在树莓派上闭环运行。

边缘AI技术栈

- LLM引擎:Ollama运行gemma2:2b模型,轻量化且能在树莓派上提供优异的推理性能。

- 向量数据库:持久化ChromaDB存储文档嵌入向量。

- 嵌入模型:sentence-transformers的all-MiniLM-L6-v2模型,专为快速语义检索优化。

资源约束与延迟优化

在4核4GB内存的树莓派上运行RAG系统需要精细的资源调配。最初采用查询时即时加载sentence-transformer模型并连接ChromaDB客户端的简单方案,在边缘设备上引发了严重的"冷启动"问题,导致系统卡顿和LLM生成前的巨大延迟。

为此我实施了两项关键架构优化:

向量数据库预加载:将临时脚本改造为常驻RAG服务。通过在应用启动阶段初始化持久化ChromaDB客户端并将嵌入模型载入内存,彻底消除冷启动损耗,显著降低查询延迟,实现近乎实时的检索响应。

显式线程限制:性能分析显示嵌入计算会耗尽全部CPU资源,导致Ollama进程资源饥饿。通过添加一行代码——

torch.set_num_threads(1)——将PyTorch显式限制为单线程,使其约占CPU总资源的25%,避免资源争抢,确保LLM与仪表盘保持高响应性。

五、轻量级前端:基于Google Stitch的快速开发实践

为实现能源数据可视化并与"智能问答"RAG系统交互,需要一个简洁高效的UI界面。我选用Google Stitch框架构建用户界面(感谢Hayden的推荐)。它支持快速原型设计与部署,生成的现代化仪表盘能与Python后端API无缝集成。借助Stitch,我保持了前端资源的轻量级占用,避免对树莓派造成额外负担,同时为监控发电状态、电池SOC及与本地LLM交互提供了接近企业级的用户体验。

六、工作流增强:R.G.C.O.A提示架构的子代理机制

除硬件层面的边缘优化外,我们在本地与LLM的交互模式上也引入了安全工程思维。简单查询尚可接受临时提示词,但构建复杂自动化系统则需要一致性保障。

为此我集成了一个名为"架构师"的专属AI子代理,对所有内部工作流强制实施R.G.C.O.A.(角色、目标、上下文、输出、提问)框架。

系统执行任何生成任务前,架构师子代理会拦截原始请求,并以安全、确定性的方式结构化重构:

- 角色与目标:精确定义AI代理的身份与任务边界(如"扮演资深DevOps工程师重构Cloud-Init脚本”)。

- 上下文:注入确切的环境约束(如ARM64架构限制),抑制幻觉产生。

- 输出与提问:要求严格输出格式,并在存在歧义时强制"暂停并澄清”,防止破坏性自动化操作。

通过在边缘采用这种多代理模式,我们显著降低了幻觉发生率,并为扩展仪表盘功能构建了可预测、高可靠的管道。

实战经验总结

在边缘硬件上构建企业级系统迫使开发者保持严谨。以下是关键收获:

资源约束催生创新:并非必须依赖H100才能开展有价值的AI应用。将PyTorch限制为单线程看似反直觉,却正是ARM64边缘推理保持稳定的确切优化手段。

自动化投资高回报:前期投入精力构建健壮的Cloud-Init配置,使SD卡损坏不再成为噩梦。环境重建仅需数分钟而非数小时。

安全需内建而非附加:通过强制使用后量子密钥、移除默认密码、从第一天就将DoH DNS服务容器化,系统从根本上抵御了常见的本地网络威胁。

结语

我们正在迈入家庭微电网时代——自主发电、储能,甚至参与能源交易。通过融合安全基础设施实践、动态电价API与本地化边缘LLM,我构建了一套不仅节省开支,更完全脱离云依赖的系统。

若你是安全从业者或工程师,希望涉足边缘AI与物联网领域,我强烈建议从无头树莓派入手,探索其潜力边界。

延伸阅读: