Manga-Translator 一键部署指南:轻松实现漫画AI翻译与本地化

对于许多漫画爱好者而言,追更连载中的海外作品(生肉)是一大痛点。制作组往往有固定的发布计划,无法即时翻译最新内容。虽然英文漫画尚可阅读,但面对日文或韩文漫画时,理解剧情就变得异常困难。

本文将介绍一个能够解决此问题的AI工具项目:Manga-Translator。该项目支持通过 Docker 一键部署,能够自动识别、翻译并替换漫画图片中的文字,让您轻松享受“熟肉”。

Manga-Translator 项目概述

项目的完整名称为 hgmzhn/manga-translator-ui,您可以在 GitHub 上进行搜索以获取更详细的信息。项目主页提供了多平台部署指南及详细的配置使用说明。

该工具能够一键翻译漫画图片中的对话与文本,全面支持日漫、韩漫、美漫,无论是黑白漫画还是彩色漫画均可准确识别。其工作流程包括自动检测文字区域、识别(OCR)、翻译以及最后的文字嵌入(嵌字)。它支持日语、中文、英语等多种语言的互译。项目基于强大的 manga-image-translator 核心引擎开发,集成了以下主要特性:

✅ 核心功能一览

🔍 智能文本检测:自动精准定位漫画图像中的所有文字区域。

📝 多语言OCR引擎:支持对日语、中文、英语等多种语言的文字进行识别。

🌐 多种翻译引擎:提供 OPAI、Gemini(含普通与高质量模式)、Sakura 等多种翻译引擎,并兼容其他符合规范的AI翻译接口。

🎯 高质量上下文翻译:可利用支持多模态的AI模型(如 GPT-4o、Gemini),结合图像视觉上下文进行翻译,显著提升准确率与语境贴合度。

📚 自动术语管理与一致性维护:AI能够自动识别并积累漫画中的专有名词(如人名、地名、组织名),确保在长篇连载翻译中术语前后统一。

🎨 智能图像修复:自动擦除原始文字,并基于周围背景进行智能填充,使画面看起来自然无痕。

✍️ 自动化智能嵌字:自动为译文进行排版,支持多种字体、颜色、描边等样式自定义,让翻译结果如同原生作品。

🤖 AI辅助断句:在使用 OPAI、Gemini 等翻译器时,支持智能断句功能,使对话更符合阅读习惯。

📦 高效批量处理:支持一次性处理整个文件夹内的所有漫画图片,极大提升效率。

准备工作:获取AI能力密钥

由于翻译功能依赖于外部AI服务,因此您需要准备相应平台的 API Key。为了达到最佳翻译效果,强烈建议选择支持多模态(Multimodal)的模型。这类模型能够“看到”图片内容,结合视觉信息进行翻译,效果远胜于纯文本翻译。

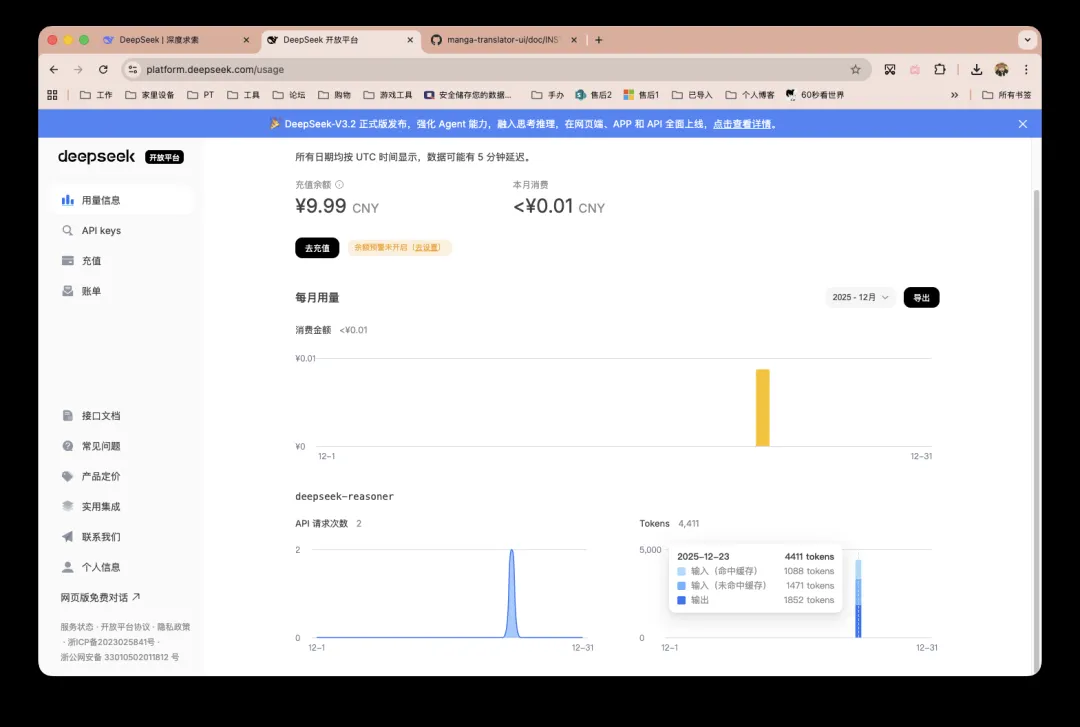

项目支持 OPAI 及其兼容接口(如 DeepSeek、硅基流动等),这意味着您可以使用这些平台的API。本文后续演示将使用硅基流动的免费额度进行。

使用高质量多模态翻译引擎的优势在于:

📸 深度上下文理解:AI模型能分析图像场景,理解角色情绪和动作,从而给出更贴切的翻译。

🎯 翻译准确度飞跃:结合画面信息,可有效避免纯文本翻译产生的歧义。

📝 整体剧情把握:支持批量发送多张图片,有助于AI理解连贯的剧情发展。

🔧 高度自定义:支持通过提示词(Prompt)自定义翻译风格和术语表。

详细部署指南(以威联通NAS为例)

请注意:翻译效果的优劣很大程度上取决于您所使用的AI模型。 建议导入完整章节甚至整部漫画,以便AI更好地理解剧情脉络,获得更连贯的翻译结果。

以下将以威联通(QNAP)NAS为平台,使用 Docker Compose 方式进行部署演示。作者虽注明Docker部署为“试验性”功能,但实际体验稳定。

项目提供的原始部署命令如下:

# Windows CMD / PowerShell

docker run -d --name manga-translator -p 8000:8000 hgmzhn/manga-translator:latest-cpu

# Linux / macOS

docker run -d --name manga-translator -p 8000:8000 hgmzhn/manga-translator:latest-cpu

# CPU 版本:hgmzhn/manga-translator:latest-cpu

# GPU 版本:hgmzhn/manga-translator:latest-gpu

# 性能越强,体验越好

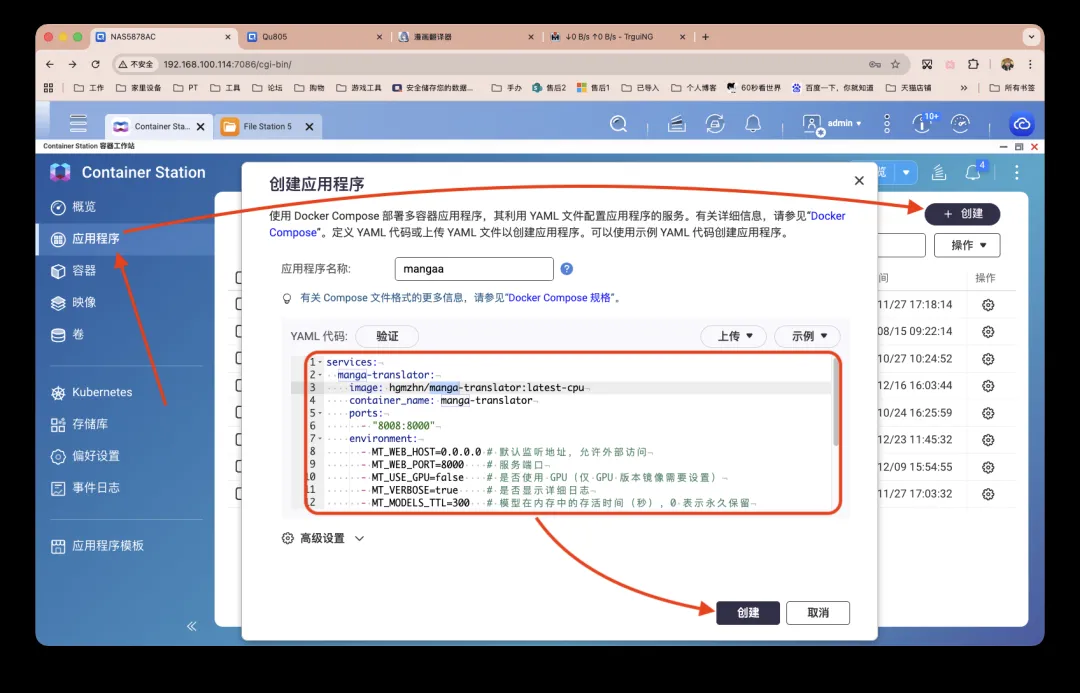

为了便于管理和持久化数据,我整理了以下 Docker Compose 配置:

services:

manga-translator:

image: hgmzhn/manga-translator:latest-cpu

container_name: manga-translator

ports:

- "8008:8000"

environment:

- MT_WEB_HOST=0.0.0.0 # 默认监听地址,允许外部访问

- MT_WEB_PORT=8000 # 服务端口

- MT_USE_GPU=false # 是否使用 GPU(仅 GPU 版本镜像需要设置)

- MT_VERBOSE=true # 是否显示详细日志

- MT_MODELS_TTL=300 # 模型在内存中的存活时间(秒),0 表示永久保留

- MT_RETRY_ATTEMPTS=None # 翻译失败重试次数,-1 表示无限重试

- MANGA_TRANSLATOR_ADMIN_PASSWORD=your_admin_password # 管理员密码

volumes:

- /share/Container/manga-translator/models:/app/models

- /share/Container/manga-translator/result:/app/result

- /share/Container/manga-translator/logs:/app/logs

- /share/Container/manga-translator/work:/app/manga_translator_work

restart: always

部分环境变量可根据需要删除,保留也无影响。关键的卷映射(volumes) 用于持久化模型、结果、日志和工作文件,建议全部配置以保证数据安全和容器重启后功能正常。

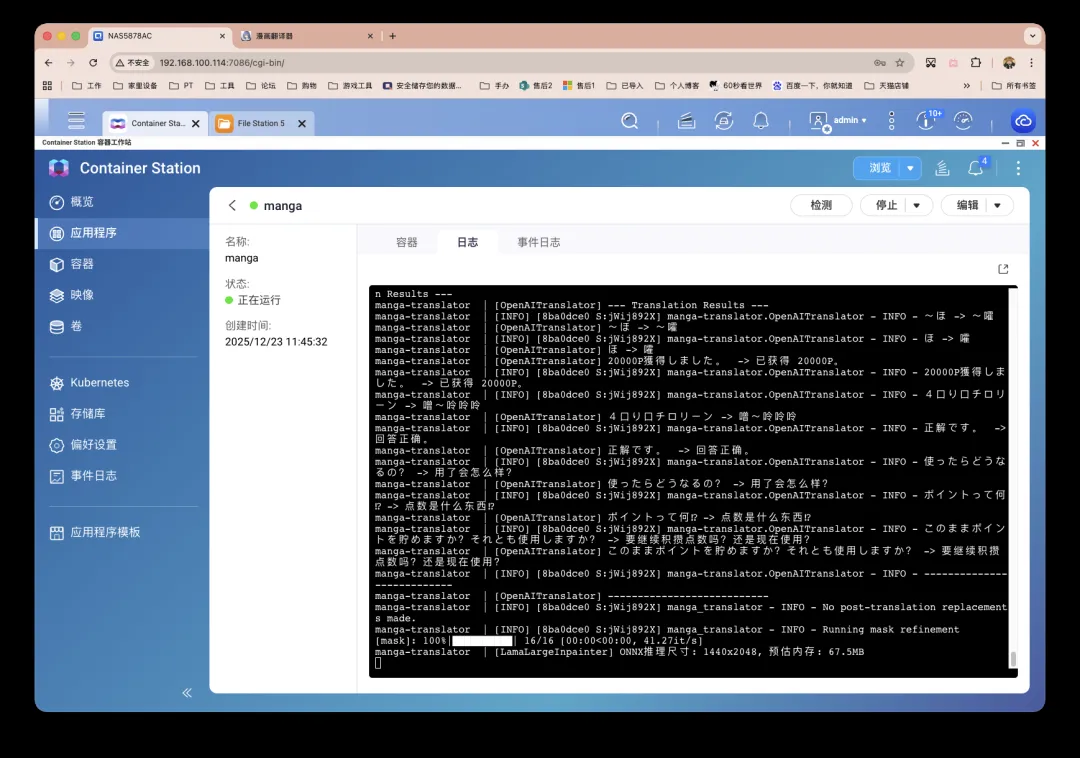

配置完成后,在威联通的 Container Station 中创建新的应用程序,并将上述 docker-compose.yml 内容粘贴进去即可。

基本使用与配置演示

该工具功能丰富,此处将展示基础配置流程和最终的翻译成果。

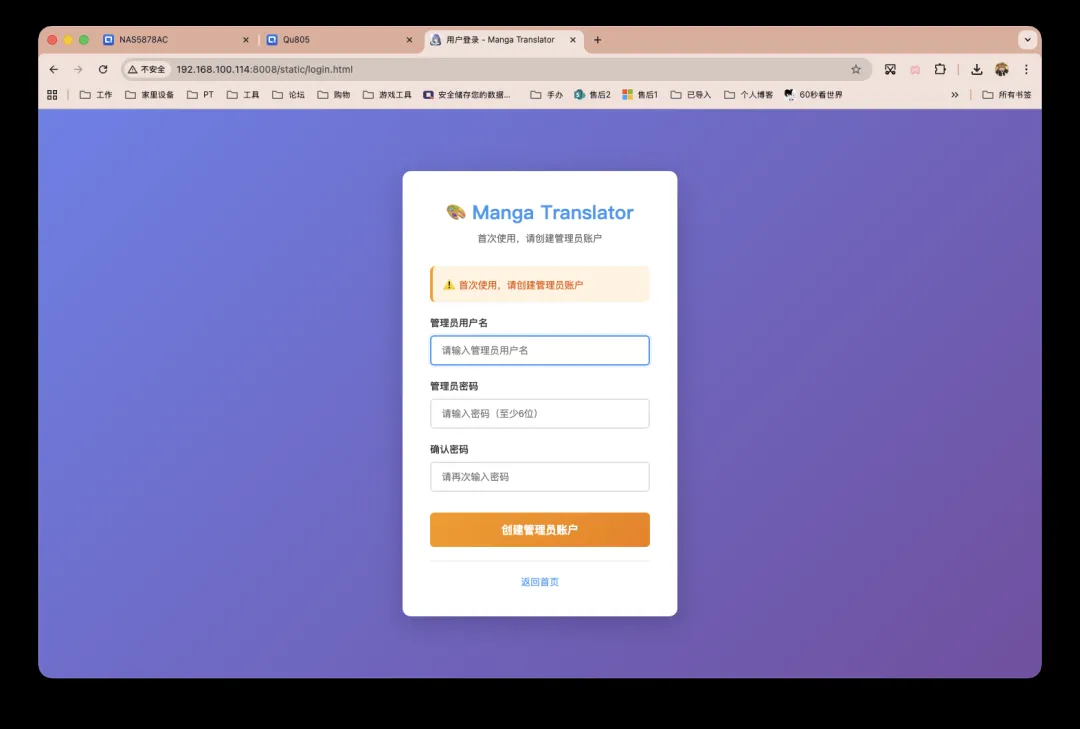

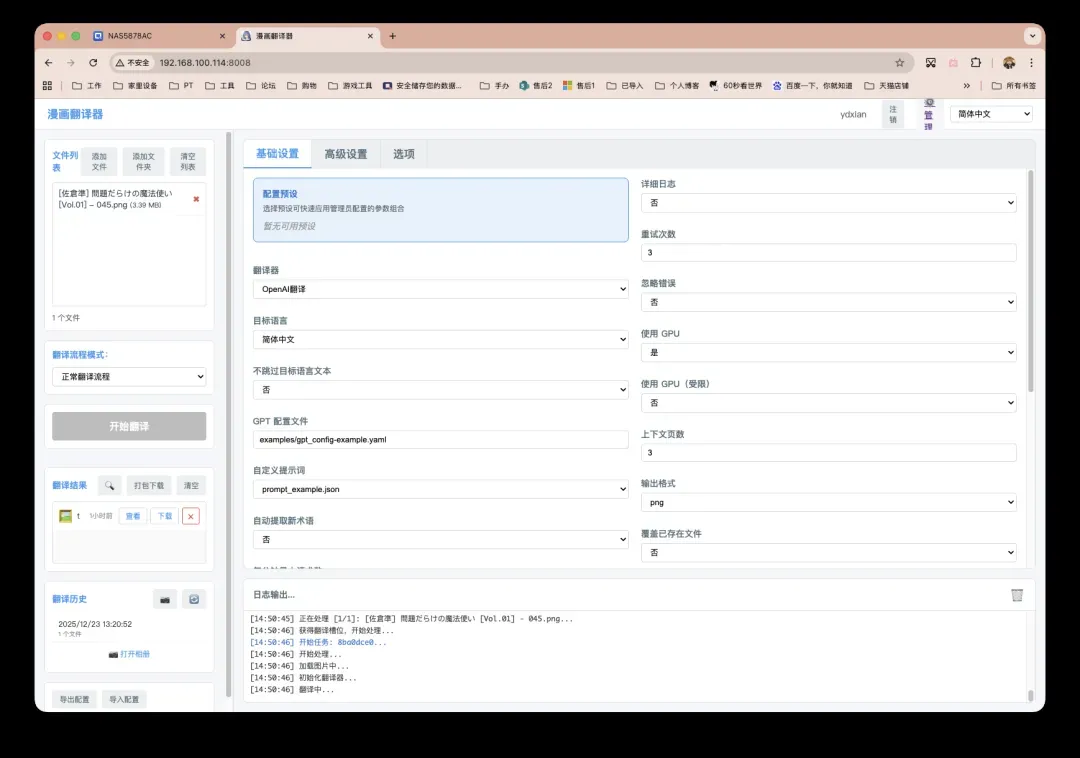

访问与注册:部署成功后,在浏览器中输入

NAS的IP地址:8008访问 Web 界面。首次使用需要注册一个管理员账户。

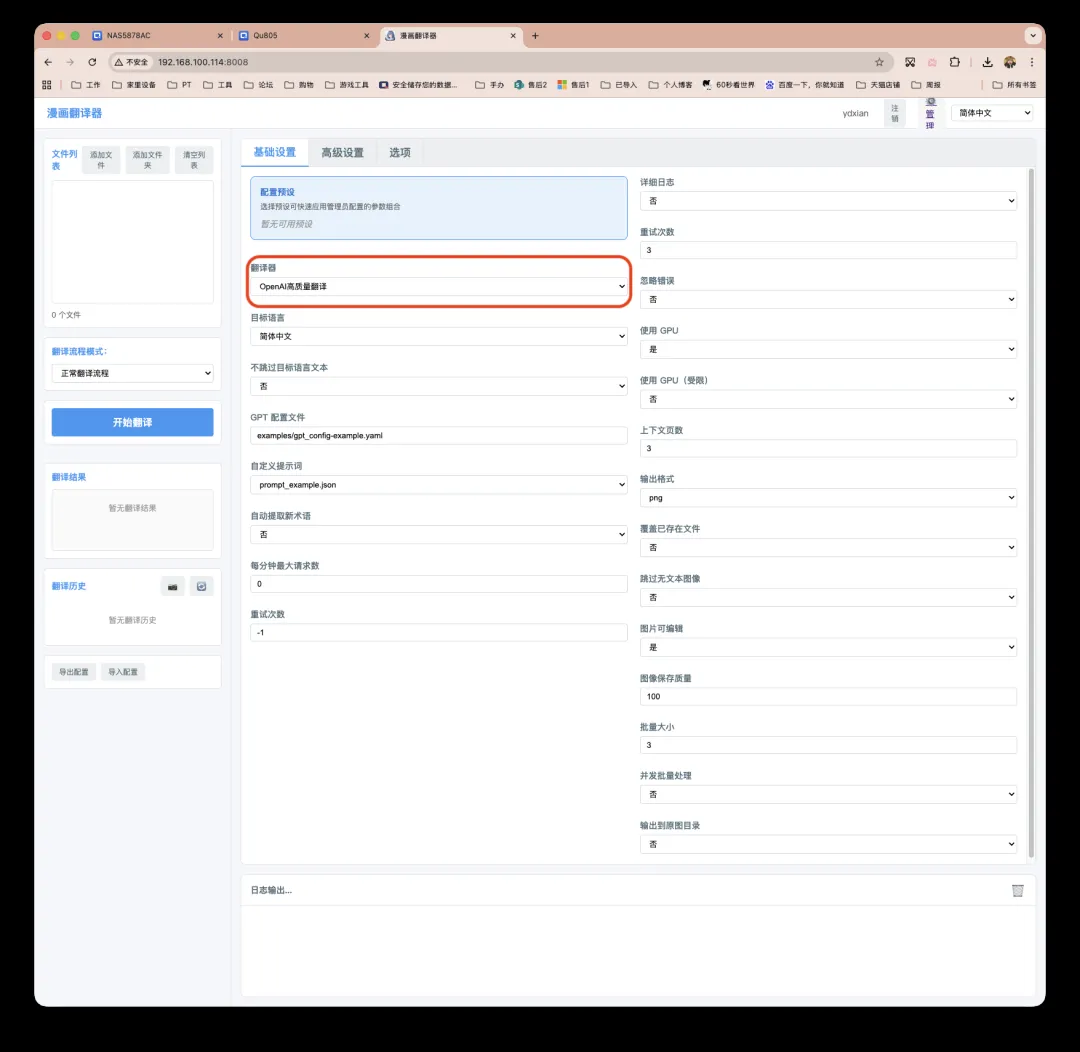

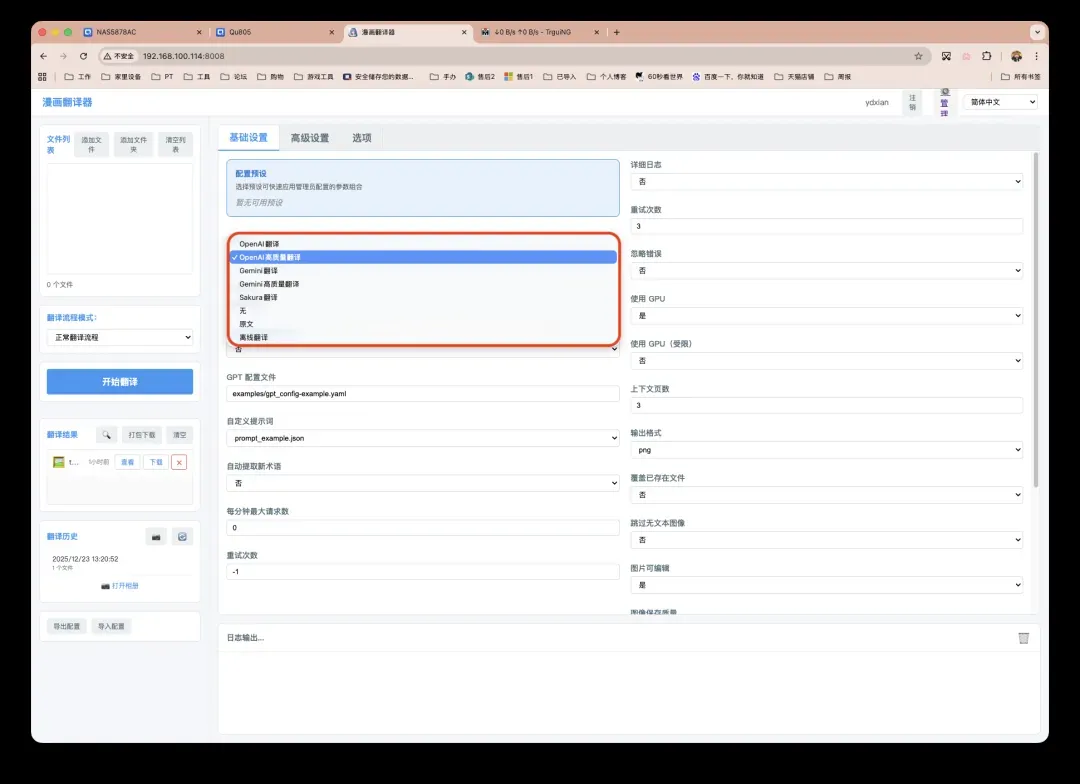

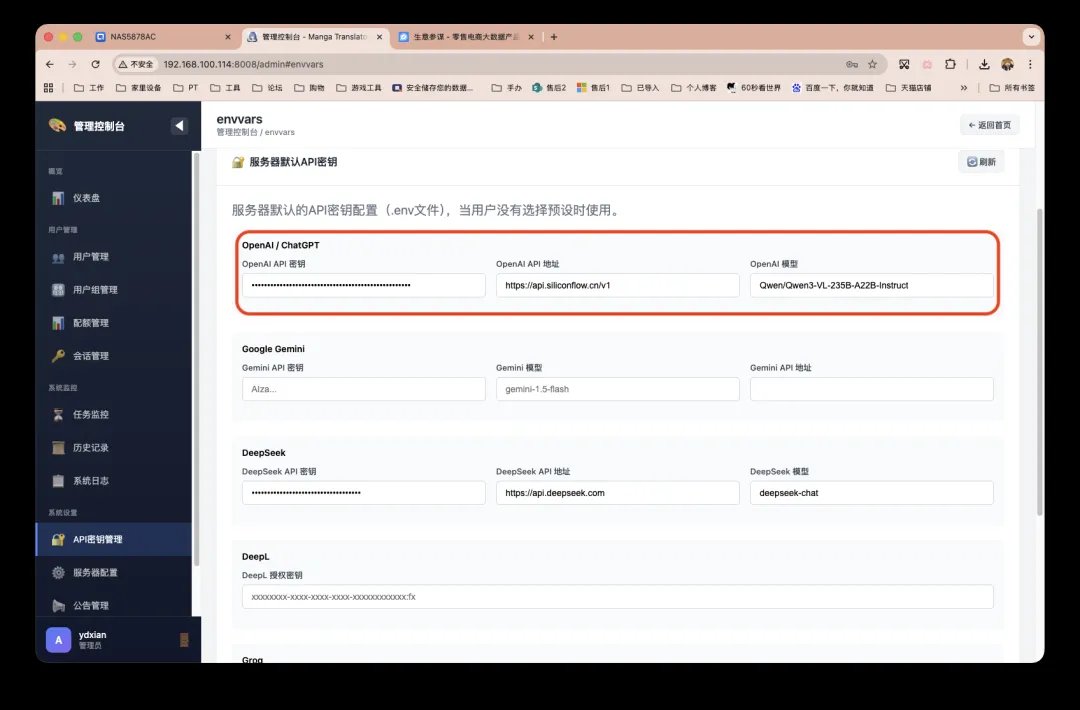

界面概览:登录后的主界面如下。最关键的一步是选择并配置翻译 API 接口(图中红框所示)。

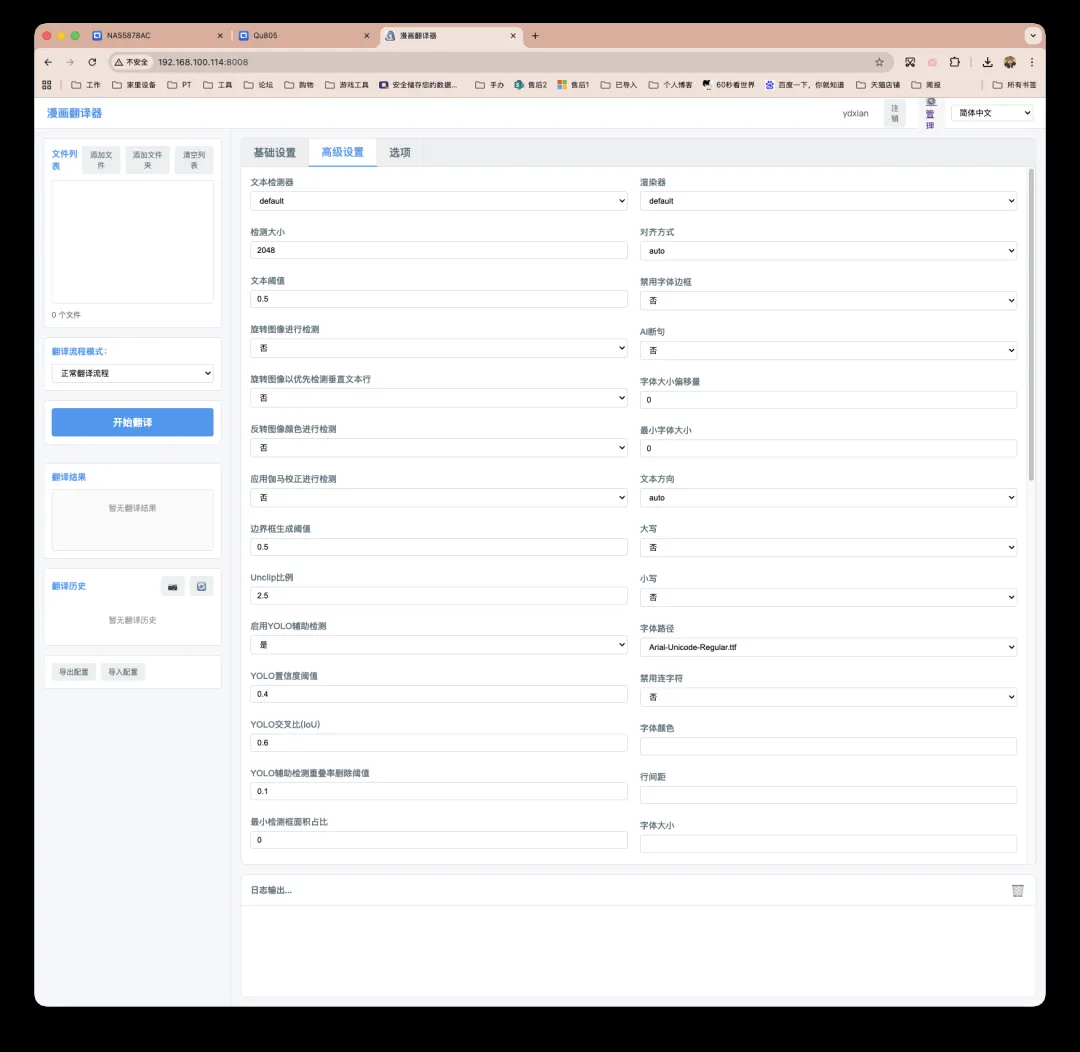

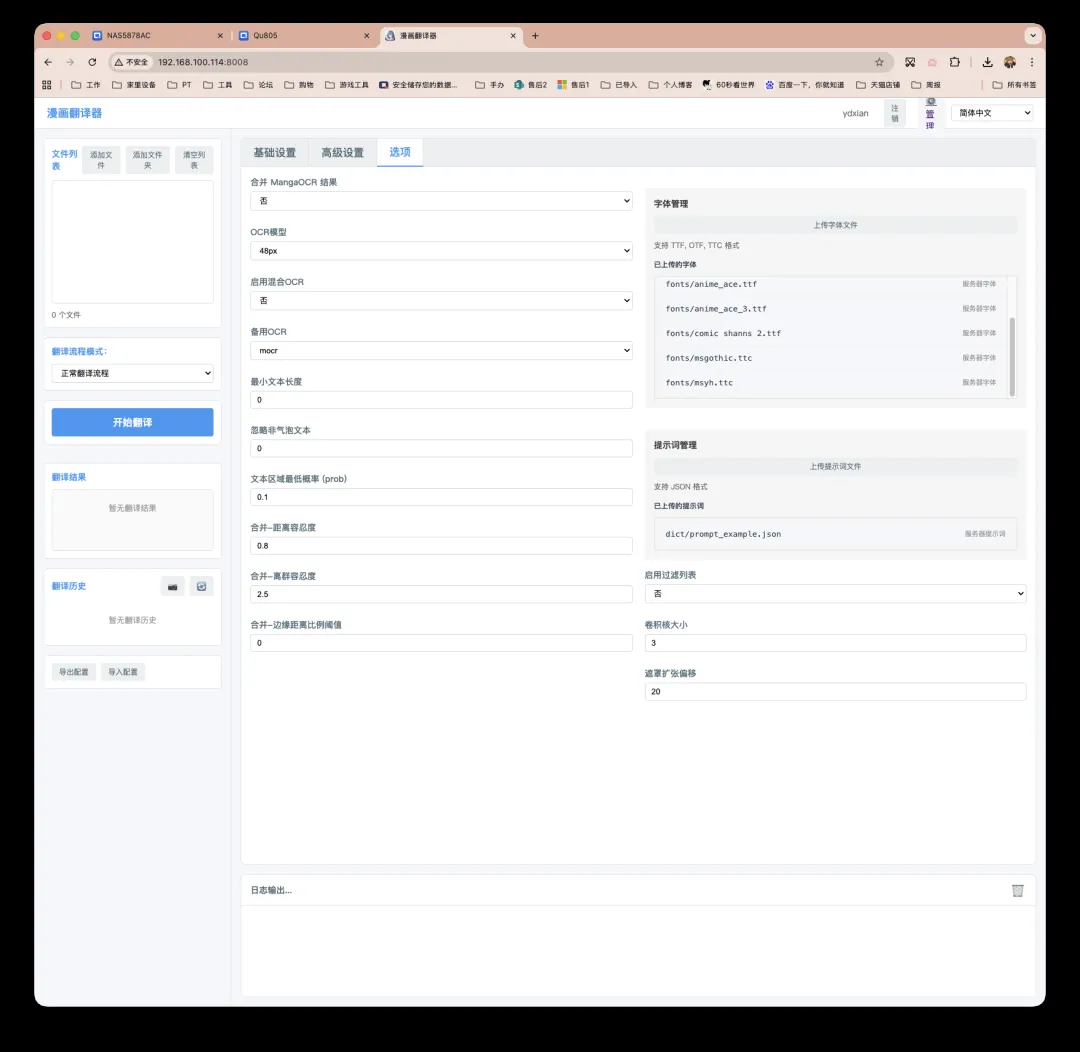

高级设置:工具提供了大量可定制选项,包括OCR模型、超分辨率模型、文字排版、渲染效果、字体选择等。据作者推荐,

MangaJaNai超分模型效果惊艳,当前默认配置已采用。

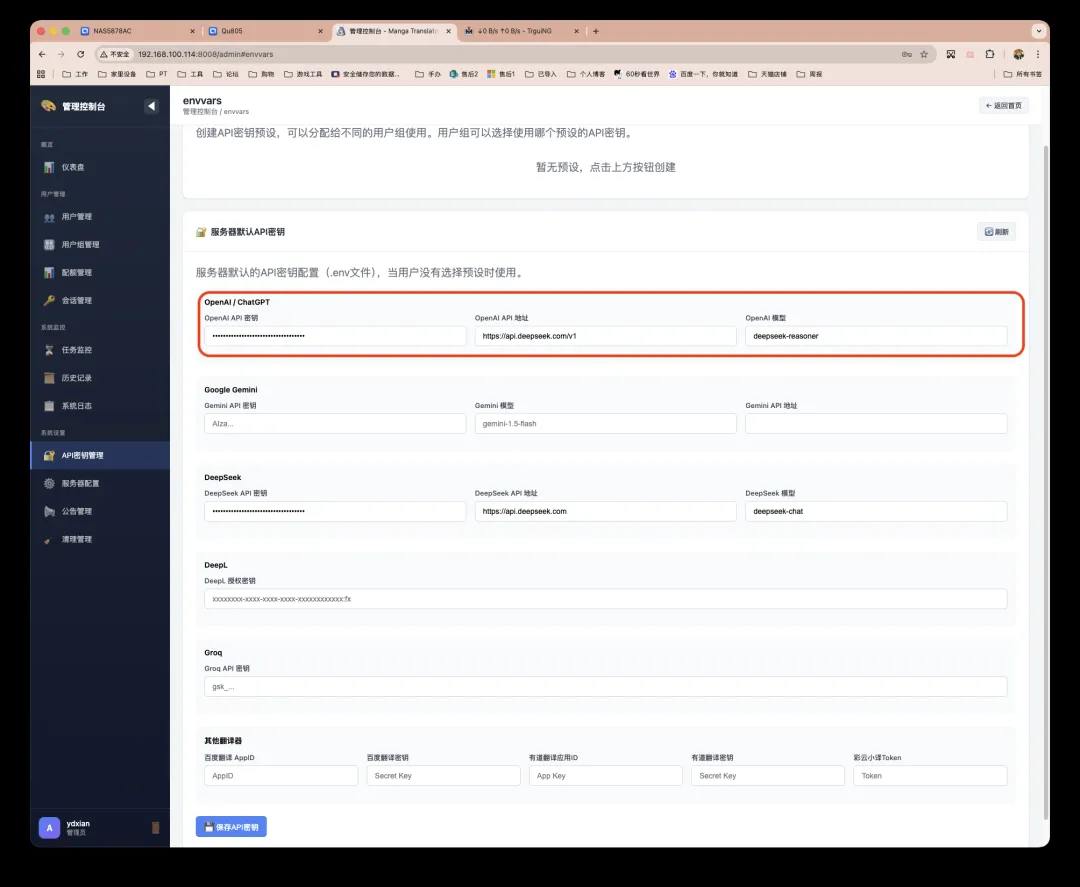

配置API密钥:点击右上角「管理」进入控制台,在左侧找到「API密钥管理」。填入您从相应平台获取的 API Key 和 Base URL(接口地址)。以下演示首先配置了 DeepSeek。完成后务必保存,并点击「返回首页」。

注意:由于 DeepSeek 模型暂不支持多模态,在「基础设置」中需选择对应的“普通”翻译器。

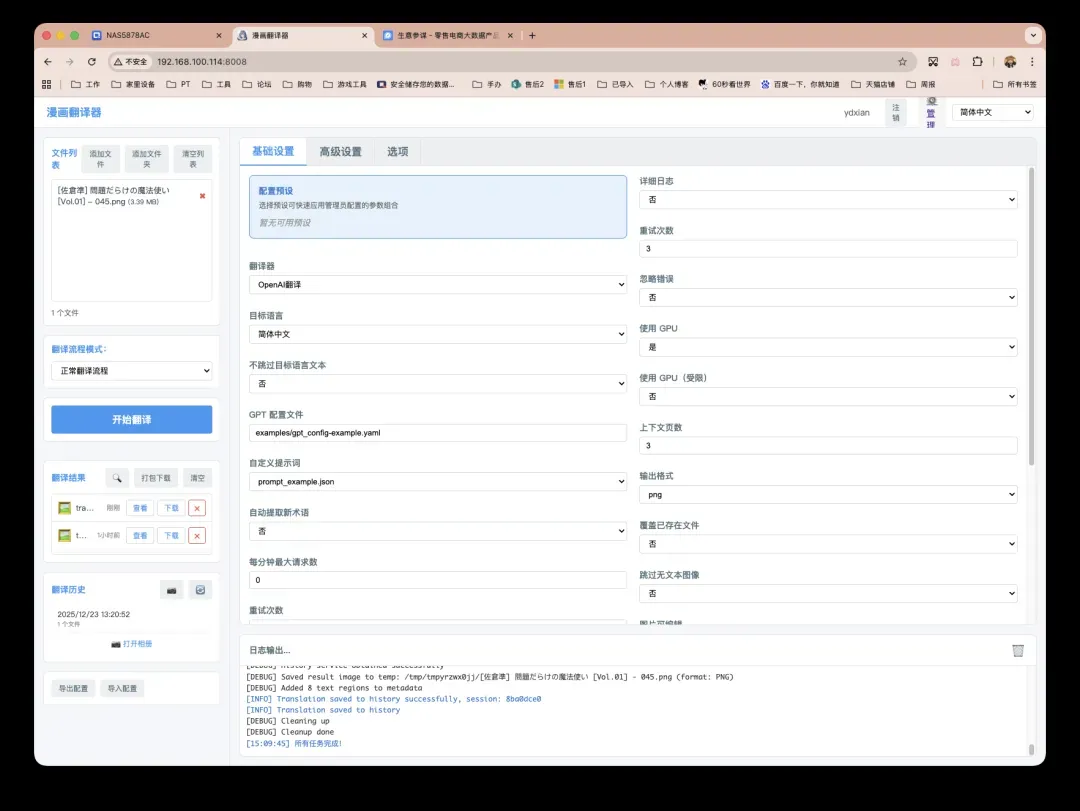

开始翻译:上传漫画图片(支持单张或批量),点击“开始翻译”即可。本文选用佐仓老师的新作《問題だらけの魔法使い》中的一页进行测试(年初即有网友认为该漫画翻译难度较高)。

查看与下载:翻译完成后,可在左侧面板预览效果,并下载最终成品。

下图展示了翻译两张漫画图片的大致资源消耗情况。

下图展示了翻译两张漫画图片的大致资源消耗情况。

切换多模态引擎:为了对比效果,我们换用硅基流动的免费额度(支持多模态高阶模型)。在 API 密钥管理中更换信息,并在基础设置中选择“高质量”翻译器。

翻译成果对比展示

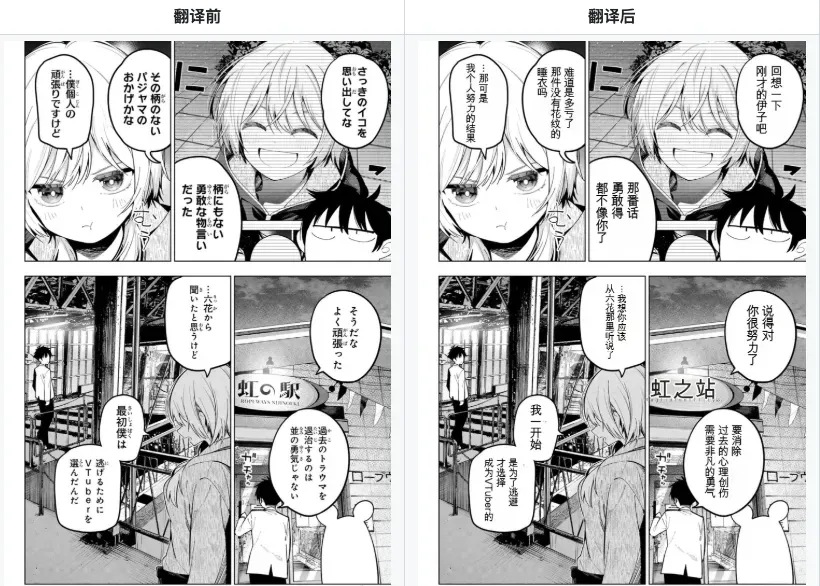

下图从左至右依次为:原始日文(生肉)、硅基流动多模态翻译、DeepSeek文本翻译。文字框的位置和样式均可后期调整,此处我们重点关注翻译文本的质量。欢迎拥有其他付费高阶 API 的朋友部署测试后,分享不同模型的优劣。

以下是原文生肉与硅基流动高质量翻译的单独对比:

结语与性能建议

总体而言,Manga-Translator 的翻译效果令人满意,正如项目作者所言,其对条漫(Webtoon)格式的支持已经相当完善。

不过需要注意,如果部署在性能一般的 NAS 或低配置设备上,处理速度可能会比较慢。建议将本工具部署在近年的新型号NAS或自行DIY的高性能设备上。如果设备配备 NVIDIA 独立显卡,并使用对应的 GPU 版本镜像,处理效率将获得极大提升。

希望这篇指南能帮助您成功部署属于自己的漫画翻译助手,畅享无语言障碍的阅读体验。