RAG技术深度解析:从分块到重排的完整实战指南,用Dify构建企业级AI知识库

近期AI领域涌现出一种奇特现象:各类数字化角色模板层出不穷,例如同事.skill、产品经理.skill、运营总监.skill乃至销售冠军.skill。这些数字人格包装看似创新,实则暗藏风险——当某个.skill文件宣称"精通刑法与刑事诉讼法"时,你是否真的敢让其承担法律判断职责?

更值得关注的是,有从业者宣称已将顶尖客服或销售专家的能力"蒸馏"为.skill文件。这种说辞在行业内行看来颇具争议,因为所谓"蒸馏"往往仅提取了工作流程中最易自动化、最易结构化的表层环节,而非真正的专业判断力。

透过现象看本质,这类.skill文件复制的并非人类专家的核心能力,而是将其工作流程化、规则化。真正的专业判断源于隐性知识——包括产品细节参数、客户采购习惯、历史成交案例、承诺边界等无法完整写入prompt的复杂信息。

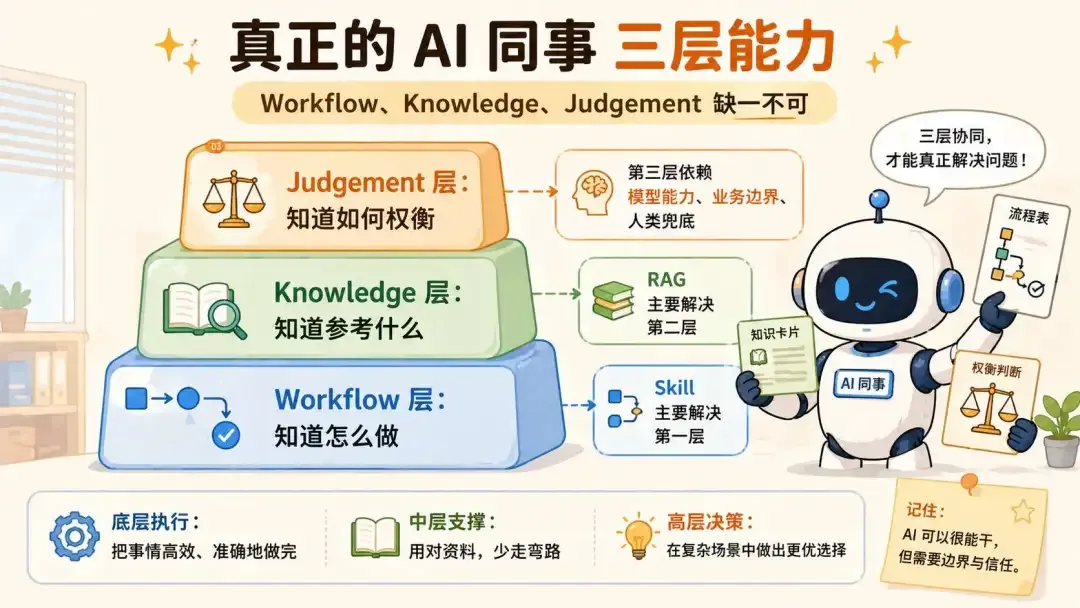

这揭示了一个关键认知:Workflow不等于Judgement。skill文件能指导AI如何执行操作,却无法赋予其理解操作背后逻辑的能力。若要真正"蒸馏"人类专家知识,必须依赖RAG(检索增强生成)技术。

RAG技术核心价值辨析

当前业界对Skills的认知普遍存在偏差,常将其与知识库功能混为一谈。从技术范式角度看:

skill解决的是流程复制,而RAG解决的是知识调用

skill定义操作步骤序列,RAG则提供执行依据——包括参考资料、历史经验及信息溯源。二者结合才接近真正的"能力蒸馏"。

以销售冠军能力复制为例:收集话术、跟进流程、异议处理规则并投喂模型,这仅能复现外显行为。真正的销冠决策依赖五大隐性知识体系:

- 全产品线技术参数图谱

- 跨行业客户采购行为模式

- 历史成交案例库

- 承诺权限边界清单

- 竞品动态情报网络

这些无法完整prompt化的隐性知识,正是RAG的核心价值所在。最终结论清晰呈现:

skill负责复刻动作框架,RAG负责补足认知缺口

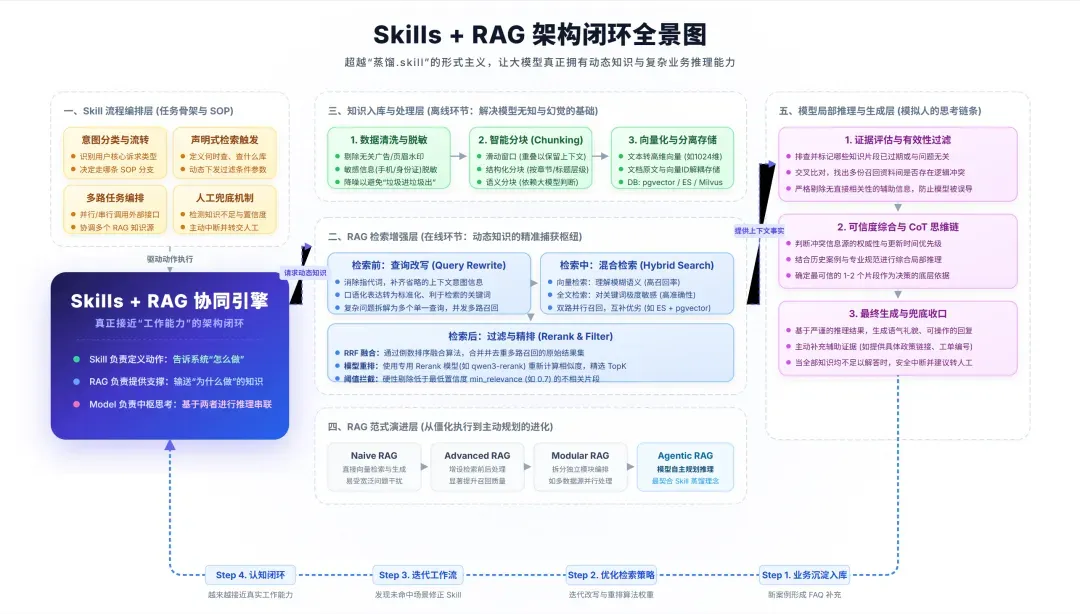

完整的AI同事能力架构需三层支撑:Workflow层(流程执行)、Knowledge层(知识调用)、Judgement层(复杂权衡)。skill覆盖第一层,RAG支撑第二层,第三层依赖模型能力、业务边界设定与人工兜底机制。

Dify平台实现AI知识库路径

尽管Agentic RAG框架尚未出现理想的开源方案(若NoteBookLM开源将成首选),但基于当前生态,Dify在企业级知识库建设中表现相对均衡:

- 完整知识库管理闭环

- 可视化编排体验友好

- 开源特性保证可控性

- 支持私有化部署

- 深度适配企业场景

企业落地AI知识库时,常陷入Dify配置项迷宫:分块策略、索引模式、检索方式、Top K值、Score阈值、Rerank开关等参数相互关联,孤立调整难以奏效。

理解完整技术链路才能理清配置逻辑:

离线阶段:文档解析 → 数据清洗 → 智能分块 → 向量化 → 索引构建

在线阶段:查询接收 → 语义改写 → 多路召回 → 精排过滤 → 上下文拼接 → 生成回答

以AI客服场景为例,解析售后手册PDF后,需准确回答退货时效、SKU特殊规则、大促条款等复杂问题。

传统LLM仅能输出"建议联系客服"等正确但无用的通用回复,而RAG应给出:

根据《售后政策》第3.2条,普通商品签收后7天内支持无理由退货;

SKU-20260315属定制类商品,不适用无理由退货条款;质量问题可在15天内申请售后。

数据入库关键工序拆解

文档解析质量决定天花板

上传PDF后显示的"嵌入处理中"并非简单存储,而是包含四重深度加工:

解析:PDF内含正文、表格、页眉页脚、水印、图片说明、脚注、目录等混杂元素,需精准提取有价值内容。扫描件需OCR识别,易现字符混淆、表格结构丢失、多栏排版错乱等问题。

清洗:去重页眉页脚、版权声明、连续空格、无效URL、邮箱地址等噪音。系统内置清洗能力有限,过期条款、版本冲突、内部备注等业务噪音需人工前置处理。

分块:定义知识检索最小单元,平衡精准度与完整性。过大赛义模糊,过小信息残缺。

索引:构建高效检索结构,支撑毫秒级相似度匹配。

核心原则:知识库效果上限不由模型决定,而由入库质量决定。80%精力应投入数据处理,避免"垃圾进,垃圾出"。

文档格式优先级排序:Markdown > 纯文本 > Word > PDF > Excel > PPT > 扫描件。高要求场景务必预处理文档格式。

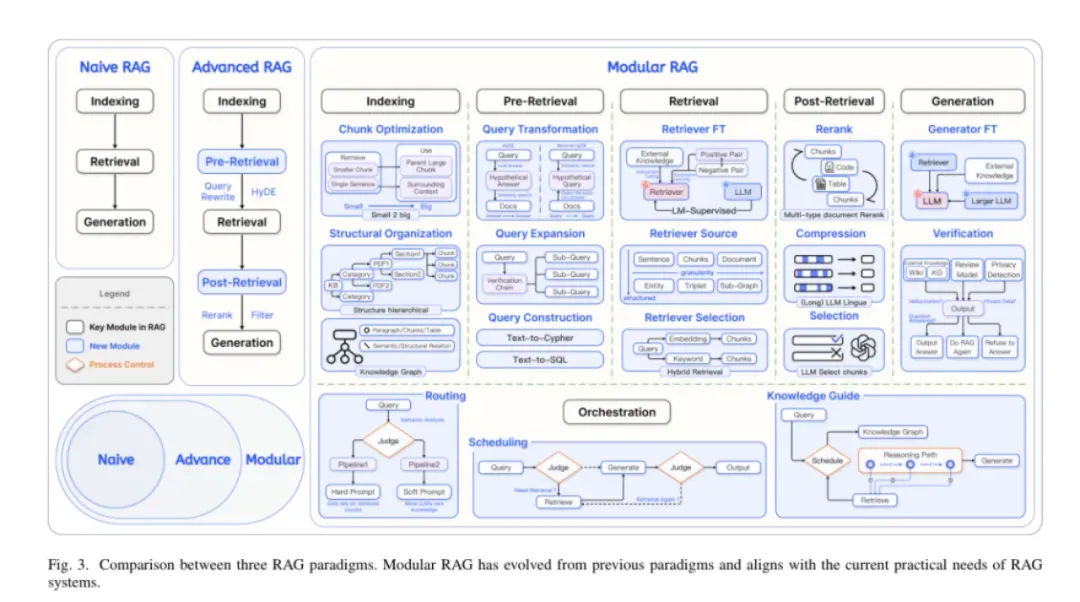

分块策略全景解析

固定长度分块

每500token机械切割,实现简单速度快,但易切断语义、破坏表格、分离标题正文,仅适合快速验证。

语义边界分块

按段落、句号、换行符等自然边界切割,Dify默认双换行分段,符合文档写作习惯,安全性高于固定长度。

递归分块

多层次渐进策略:优先按章节/段落切,过长则按句子切,仍过长再按空格切,最后才按字符切。平衡语义完整与长度限制。

结构感知分块

针对Markdown/HTML等技术文档,按标题层级、代码块、表格、FAQ问答对切割。售后政策按"第X条"切分,每条成独立规则单元,效果优于纯段落切割。

智能语义分块

通过Embedding计算相邻句向量相似度,识别话题切换点自动切分;或调用大模型判断语义边界。效果最优但成本高,适合高价值小数据量场景。

Dify核心参数配置逻辑

分段标识符

默认双换行符,可自定义为"Q:"、“第X条”、“场景:“等业务语义标记,实现精准切割。

分段最大长度

Dify默认1024token,需根据文档类型调整:

- FAQ/客服话术:200-700tokens

- 产品说明:500-1000tokens

- 技术/法务文档:500-1200tokens

- 学术长文:800-1500tokens

分段重叠长度

默认50token(建议为最大长度10%-25%),防止关键信息被边界切断。但过度重叠会增加存储成本、召回噪音,导致回答啰嗦。

父子分块机制

解决"检索需小块、生成需大块"的核心矛盾:入库时同步存储大小块,检索用小块匹配,返回对应大块给模型。非常适合长文档、制度文档等规则关联场景,兼具精度与完整性。

索引与检索模式抉择

高质量模式:向量索引

调用Embedding模型将文本转为语义向量,实现"意思相近即可匹配”。关键原则:文档与查询必用同一Embedding模型,否则如同两套坐标系无法比较。

经济模式:关键词索引

基于Jieba等分词器提取关键词,无需向量化,成本低速度快,对SKU、订单号等精确匹配友好,但无语义理解能力。

建索引

向量化后需构建高效索引结构(HNSW、IVF、PQ、FAISS等),避免逐向量比对,实现海量数据毫秒级检索。

在线问答全链路优化

当用户提问"SKU-20260315超过7天能否退货”,系统执行七步流程:

1. 查询改写

将口语化表达转化为标准检索语句,如"这个东西过了7天还能不要吗"改写为"商品签收超过7天是否支持退货"。改写应聚焦澄清而非臆测,避免偏离用户原意。

2. 知识库路由

企业通常多知识库并行(产品、售后、物流等)。策略选择:

- 边界清晰场景(HR/财务):先路由再检索

- 规则交叉场景(售后/活动):多库并行检索

- 探索期:先多库检索,后优化路由

3. 多路召回

追求速度与覆盖,Dify提供三种方式:

- 向量检索:语义匹配,擅长同义表达

- 全文检索:关键词精确匹配,对SKU/编号敏感

- 混合检索:并行双路,结果合并,客服场景无脑首选

4. 精排过滤

召回是海选,重排是复试。Rerank模型深入分析问题与chunk的真实相关性,显著提升准确率,代价是成本与耗时。高风险场景(客服/法务/医疗)建议开启。

5. Top K控制

并非越大越好,过多噪音会干扰模型判断。建议值:

- FAQ:3-5

- 客服政策:3-6

- 技术文档:5-8

- 多规则判断:5-10

大块切分应降低K值,小块可适当提高,父子分块需严格控制防上下文溢出。

6. Score阈值

质量底线拦截,防止低相关性内容硬凑答案。初设0.5-0.7,根据日志调整。高风险场景宁缺毋滥,明确提示"资料不足,建议转人工"。

7. 上下文拼接

最终片段需配合prompt约束,明确三原则:

- 仅基于提供资料回答

- 资料不足时明确拒绝

- 标注政策依据来源

可观测性建设

回答生成后需建立效果评估体系,通过日志分析识别漏召回与噪音问题,形成数据飞轮持续迭代。配置项与链路环节对应关系清晰:

| 配置项 | 链路环节 | 核心作用 |

|---|---|---|

| 索引模式 | 向量化/建索引 | 语义检索vs关键词检索 |

| 分块方式 | 文档分块 | 知识颗粒度定义 |

| 分段最大长度 | 文档分块 | Chunk容量控制 |

| 分段重叠长度 | 文档分块 | 边界信息保护 |

| 检索方式 | 召回 | 语义/关键词/混合策略 |

| Rerank | 重排 | 候选片段精排序 |

| Top K | 上下文过滤 | 片段数量上限 |

| Score阈值 | 上下文过滤 | 质量底线拦截 |

调优应遵循:文档质量→分块策略→索引模式→检索方式→重排→Top K/Score→Prompt约束的顺序。前期投入不足,后期参数调整只是表面修补。

知识库建设本质是数据工程,Dify仅提供配置界面,底层因果关系仍需深度理解。最终目标不是像人,而是有依据、可追溯、可控制的可靠回答。

思考题:RAG项目的可观测性飞轮系统如何设计?欢迎探讨。