免费利用NotebookLM优化Claude:实现17倍成本节省的AI工作流

随着Claude Opus4.7的发布,许多用户在处理研究型任务时,账单可能急剧上升。尤其是当您将多篇论文、数十个网页和几段YouTube访谈内容一次性输入对话时,额度会迅速消耗。上下文越长,缓存未命中情况越严重,一个晚上可能就用掉半个月的订阅费用。

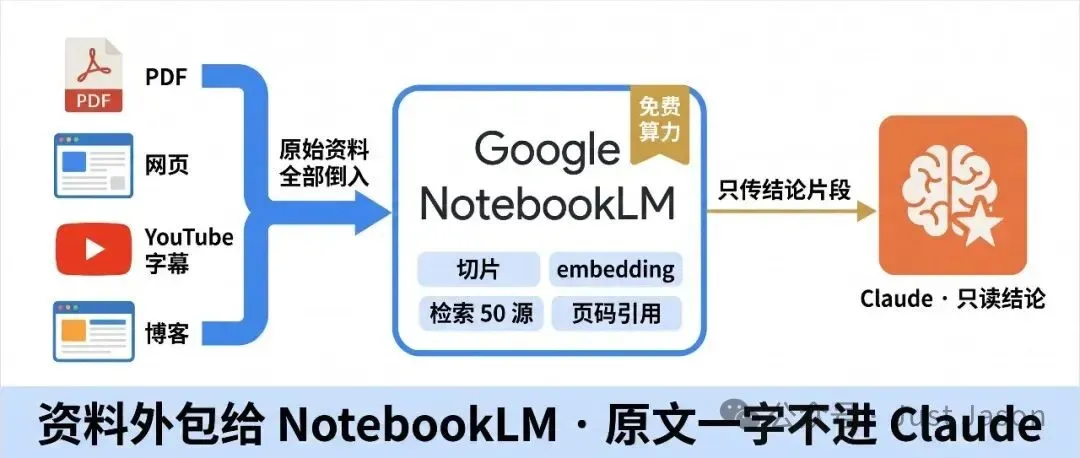

然而,这个问题有一个解决方案——而且是完全免费的。关键在于一个简单的策略:将检索这项繁重任务交给Google NotebookLM处理,而Claude仅负责读取返回的结论。

Claude的计费机制基于一个简单的原则:每个token都会产生费用,只有缓存命中时成本才较低。问题在于,您输入的原始资料中,绝大多数内容都是无关的噪声。例如,一份100页的PDF文件中,可能只有3段文字与您的问题真正相关。但Claude必须完整读取这100页内容,并且每轮对话都按照整个上下文长度计费。

在多轮研究对话中,情况更为严峻。每次提出新的追问,整个上下文都需要重新计算。经过5轮对话后,您实际上已经为“100页乘以5”的阅读量支付了费用。

| 传统资料输入方式 | 主要问题 |

|---|---|

| 直接将原文放入上下文 | token消耗按照全文长度计费 |

| 进行多轮追问 | 上下文反复读取,成本叠加 |

| 缓存命中率低 | 资料频繁更换,导致缓存失效 |

| 超过50个资料来源 | 直接超出上下文窗口限制,无法容纳 |

这正是高端用户抱怨“Claude使用成本越来越高”的原因——并非Claude本身昂贵,而是使用方法存在误区。

二、NotebookLM作为免费RAG引擎:Google承担计算负担

Google NotebookLM本质上是一个免费的检索增强生成(RAG)引擎:您将资料上传后,它会自动进行文本切片、嵌入向量化和智能检索。

免费版本的配置相当强大:

- • 单个notebook支持多达50个资料来源

- • PDF文件、网页链接、YouTube视频字幕——均可直接上传

- • 存储空间、嵌入向量化、检索计算资源——全部由Google承担

- • 返回的结果附带精确到页码的引用信息

Claude方面只需关注结论部分——原始资料一个字都不会进入对话窗口。当您询问“这几篇论文关于RLHF的关键分歧是什么”时,NotebookLM会返回带有引用的相关片段,Claude基于这几百字的内容进行综合判断即可。

对于Google AI Ultra用户来说,体验更加顺畅——NotebookLM直接提供无限使用权限。您订阅的是Gemini服务,同时获得了一个世界级的检索后端作为附加价值。

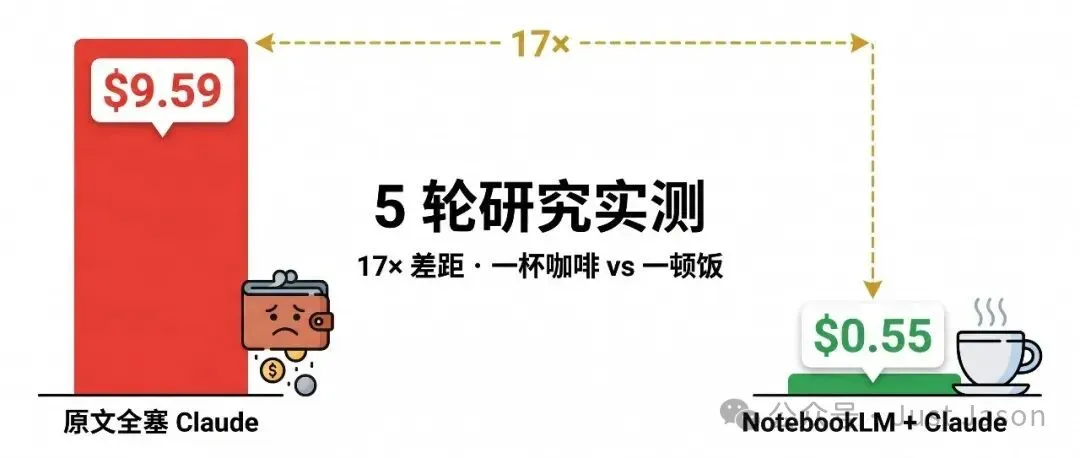

三、实际测试显示17倍成本差距:从9.59美元降至0.55美元

仅仅讲述原理可能不够直观,让我们直接查看具体数据。原作者进行了一项对照实验:在相同的5轮研究会话中,一组将全部资料直接输入Claude,另一组通过NotebookLM进行RAG检索后再由Claude总结。

| 方案 | 5轮会话成本 | 备注说明 |

|---|---|---|

| 原文全部输入Claude | 9.59美元 | 每轮对话都重新计算长上下文 |

| NotebookLM + Claude | 0.55美元 | 仅传输结论片段 |

| 成本差距 | 17倍 | 相当于一杯咖啡与一顿正餐的价格对比 |

这还是一种相对保守的估算。资料来源越多、对话长度越长、追问深度越深——成本差距就会越大。真正从事深度研究的用户,每月节省数百美元并不罕见。

此外,NotebookLM提供的引用具备可追溯性——如果Claude开始产生不准确的回答,您可以立即返回原文进行核对。这比Claude自行虚构不存在的参考文献要可靠得多。

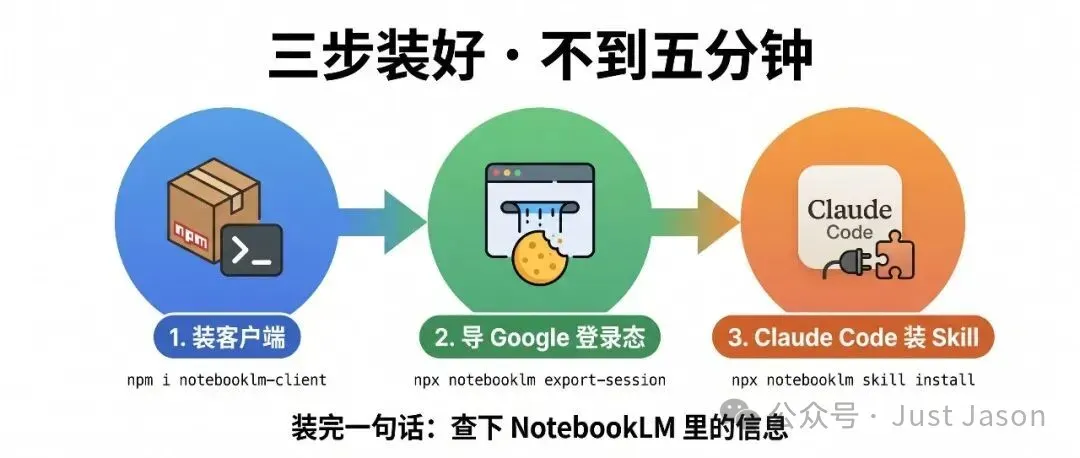

四、简易三步设置:客户端、登录状态与Skill集成

理论部分已经阐述完毕,实际操作仅需三个步骤,整个过程不超过五分钟。

第一步:安装客户端

npm i notebooklm-client

第二步:将Google登录状态导出到本地环境

npx notebooklm export-session

这一步至关重要——通过复用浏览器中已有的登录状态,可以绕过Google对自动化操作的限制。无需额外申请API密钥,也不需要开发者账号。

第三步:在Claude Code中安装Skill功能

npx notebooklm skill install

安装完成后,您只需在Claude Code中输入一句指令:

“请检索NotebookLM中关于XXX的资料”

Claude便会自动调用NotebookLM进行检索,获取结论片段后再生成回答。无需切换窗口、无需复制粘贴、无需手动分解任务。

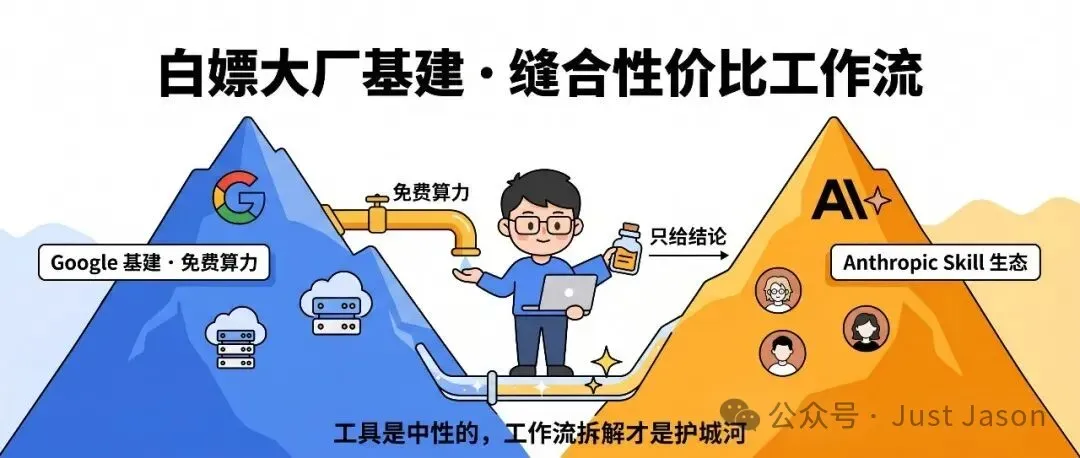

五、该策略的底层逻辑分析

将NotebookLM作为RAG外挂使用,本质上是在充分利用大公司的技术基础设施资源。

Google为了推广Gemini生态系统,愿意补贴NotebookLM的检索计算成本;Anthropic为了让Claude专注于推理任务,其Skill系统开放度非常高。这两家公司战略布局中的间隙,恰好被开发者利用来构建一个极具性价比的工作流程。

类似的策略未来可能会越来越普遍。哪家大型科技公司在某层基础设施上投入竞争,哪一层就可能存在免费利用的机会。您需要做的不是忠诚于某一特定平台,而是将各家的优势整合进自己的工作流程中。

工具本身是中性的。真正的核心竞争力,在于您对工作流程的分解与优化能力。

总结与展望

Claude是一个强大的AI引擎,但引擎不应该兼任搬运工的角色。检索任务交给NotebookLM,推理任务交给Claude,各司其职——这才是2026年应有的AI工作流程配置方式。

原文参考:@minlibuilds on X[1]

请停止将Claude用作资料仓库。它是一个聪明的思考者,而非简单的搬运工具。

引用链接

[1] @minlibuilds on X: https://x.com/minlibuilds/status/2046002143937941988?s=46