谷歌端侧AI双项目炸场:gallery与LiteRT-LM单日暴涨超1300星,零成本本地部署大模型指南

无需云端,你的手机现在就具备运行大模型的能力!

在一天之内,谷歌抛出了两个重量级开源项目:gallery(GitHub星标19.2K,单日增长853星)与 LiteRT-LM(2.8K星标,单日增长500星)。乍一看是两个独立项目,但细看便会发现它们其实是谷歌端侧AI战略的“一体两面”:

gallery 是“展示厅”——告诉你端侧AI能做什么

LiteRT-LM 是“发动机”——让你真的能把大模型跑在手机上

这背后释放了一个重要信号:2026年,端侧AI将从“勉强能跑”蜕变为“真正好用”。

本文将深入解析这两个项目,并探讨为何端侧AI正成为普通开发者最容易切入的变现良机。

端侧AI为何突然爆火?核心矛盾与解决方案

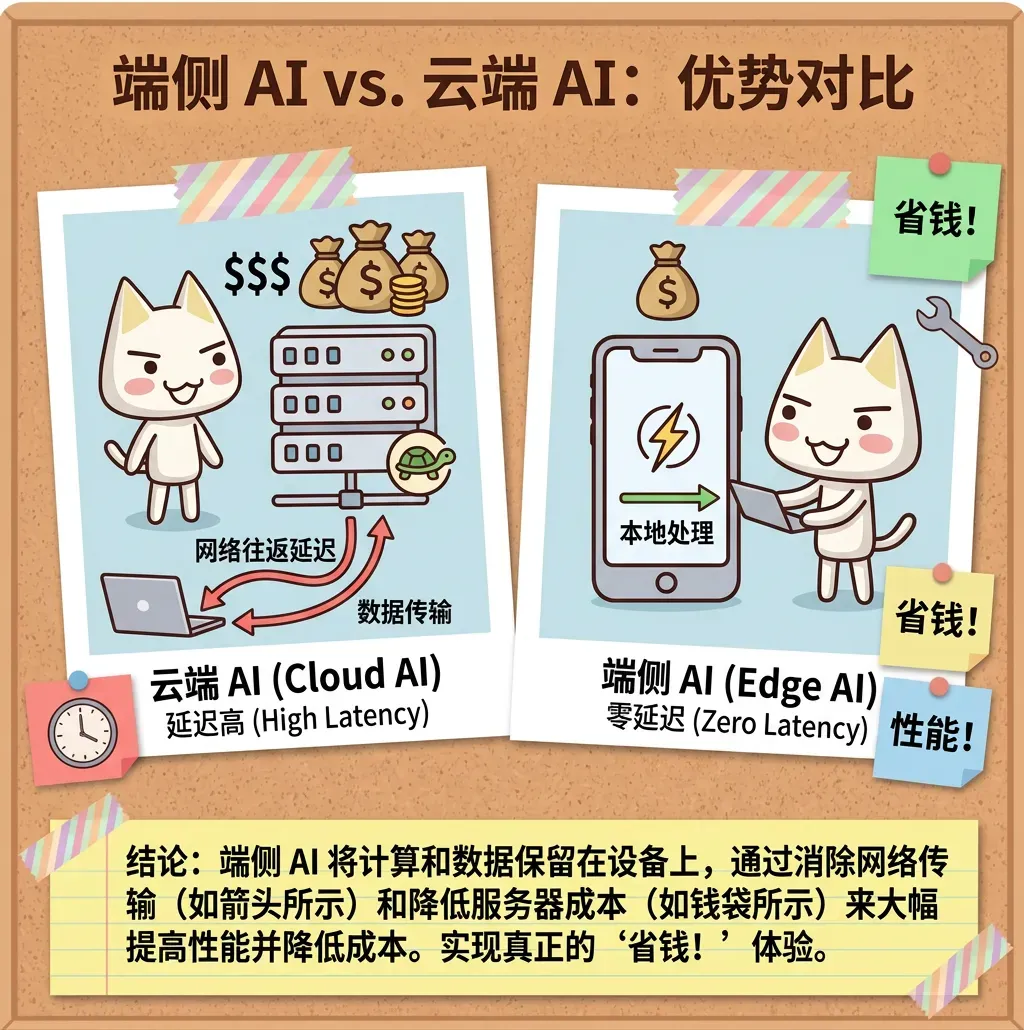

端侧AI的突然走红,根源在于云端AI高昂的成本和用户难以忍受的延迟。

简单算一笔账:

用云端 API 跑一次大模型推理,成本大概 0.001-0.01 美元

如果你的 App 日活 10 万,每天每人调用 10 次,一个月光 API 费用就要 3-30 万美元

这还不算网络延迟、隐私合规、服务器运维的成本

端侧AI的核心理念是:将模型直接嵌入用户设备,一次部署,无限次免费调用。

谷歌这两个项目,正是在解决端侧AI的两大核心难题:

| 用户的困惑 | gallery 的解法 | LiteRT-LM 的解法 |

|---|---|---|

| 不清楚端侧AI的应用场景 | 提供现成的案例库,可直接参考复用 | - |

| 缺乏在移动设备运行模型的引擎 | - | 提供高性能端侧推理引擎,一键部署 |

换句话说,谷歌在鼓励开发者:“别只观望,这里有现成的答案!”

gallery:端侧AI的应用案例宝库

Gallery实际上是一个精心整理的示范项目集合,全面展示了谷歌在端侧机器学习与生成式AI领域的各类应用。

翻看其代码结构,会发现几个颇具启发的亮点。Gallery把案例划分成几大类别:

图像生成:本地运行Stable Diffusion等模型

文本生成:本地运行大语言模型,搭建聊天机器人

语音处理:离线语音识别与文本转语音

多模态:图文理解与视觉问答

每个案例都配备完整的代码、模型权重和部署说明。

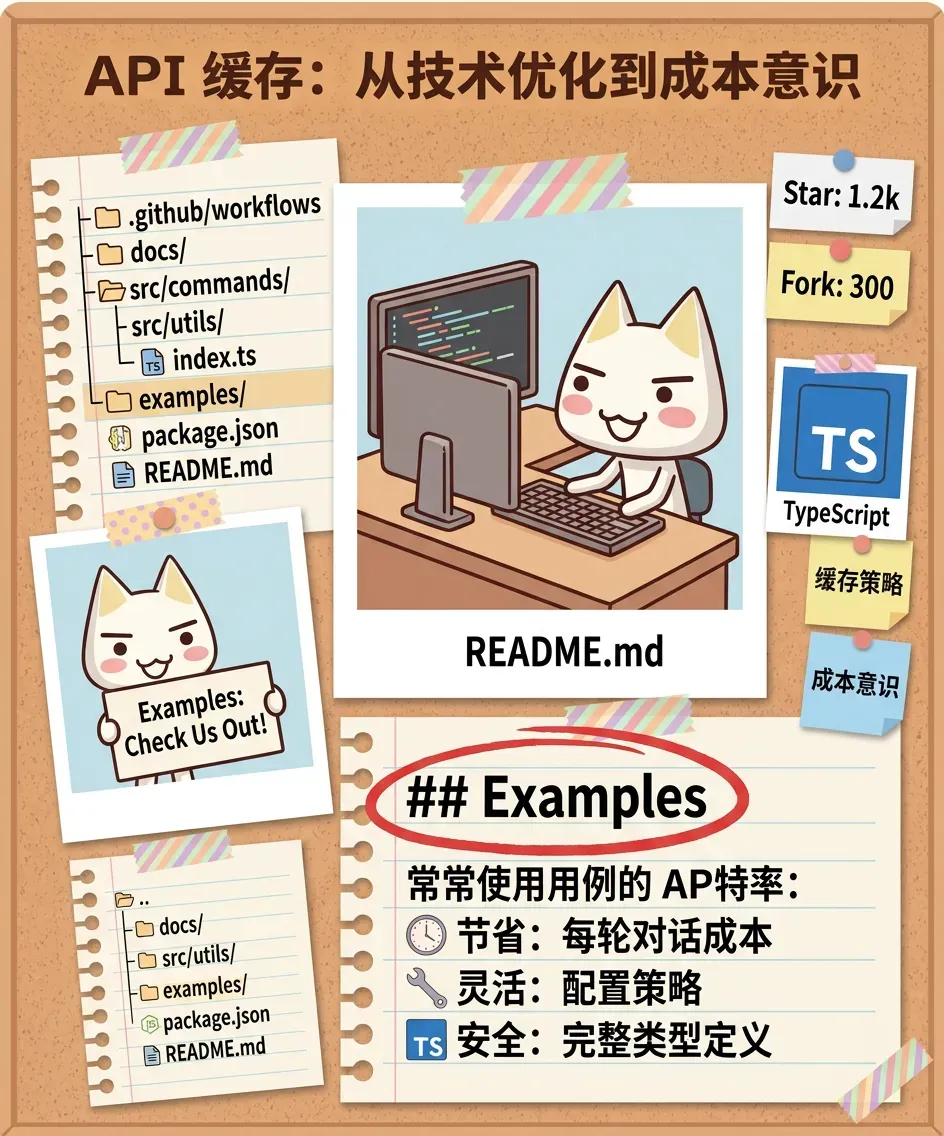

关键在于“真正可运行”

许多开源项目的示例仅停留在“理论可行”,而gallery的案例是确确实实可以跑起来的。

试运行一个文本生成案例:

# 克隆项目

git clone https://github.com/google-ai-edge/gallery.git

# 安装依赖

cd gallery

pip install -r requirements.txt

# 运行案例

python examples/text_generation/run.py

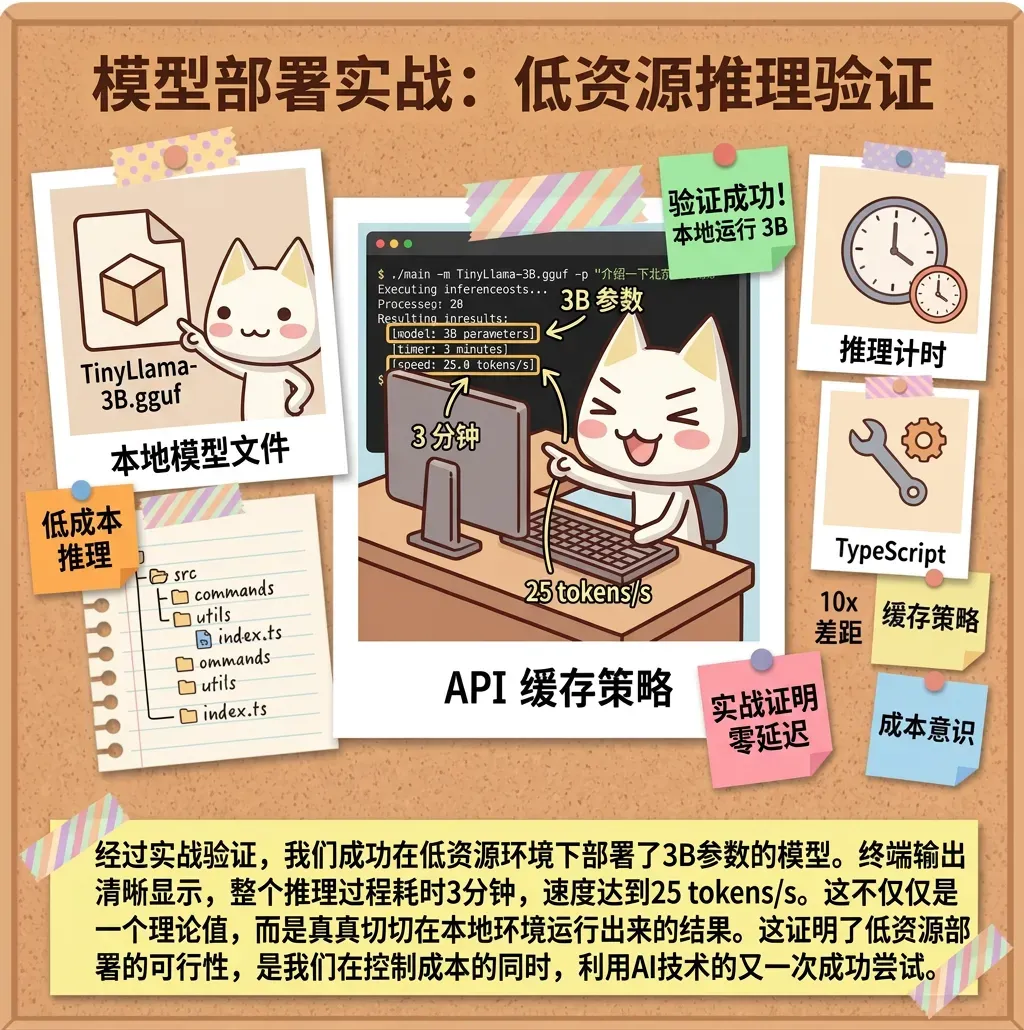

仅需3分钟,在MacBook上便成功部署了一个拥有30亿参数的本地大语言模型。 推理速度约为20-30 tokens/秒,对这一规模的本地模型而言已相当可观。

哪些人会从中受益?

产品经理——从中获取灵感,探索端侧AI可赋能的产品功能

开发者——直接复用现成代码,加速开发进程

创业者——评估技术可行性,发掘高价值应用场景

LiteRT-LM:手机端大模型的高效推理引擎

如果将gallery比作展示厅,那么LiteRT-LM便是驱动这一切的核心引擎。这是一个用C++编写的端侧大语言模型推理引擎,其核心使命清晰明确:让大模型在手机上运行得更快、更省电。

技术亮点

以下几个关键特性尤为突出:

- 量化支持:支持INT8和INT4量化,可将模型体积压缩至原来的1/4到1/8。

- 内存优化:针对移动设备严格的内存限制进行了深度优化。

- 异构计算:自动调度CPU、GPU与NPU,根据任务选择最佳算力。

- 流式输出:支持逐令牌(token-by-token)生成,提升交互体验。

性能实测数据

谷歌官方在Pixel 8 Pro上给出了一组对比数据:

| 模型 | 量化 | 推理速度 | 内存占用 |

|---|---|---|---|

| Gemma-2B | FP16 | 45 tokens/s | 4.2GB |

| Gemma-2B | INT8 | 78 tokens/s | 2.1GB |

| Gemma-2B | INT4 | 102 tokens/s | 1.3GB |

采用INT4量化后,推理速度翻倍,内存占用仅为原来的三分之一。 这带来的直接影响是:即便是中端手机也能流畅运行大模型。

极简部署流程

LiteRT-LM的部署过程极其简洁:

# 1. 安装 LiteRT-LM

pip install litert-lm

# 2. 下载模型(自动量化)

litert download gemma-2b-int4

# 3. 运行

litert run gemma-2b-int4 --prompt "你好,请介绍一下自己"

全程不超过5分钟,无需配置CUDA,更无需编译源码。

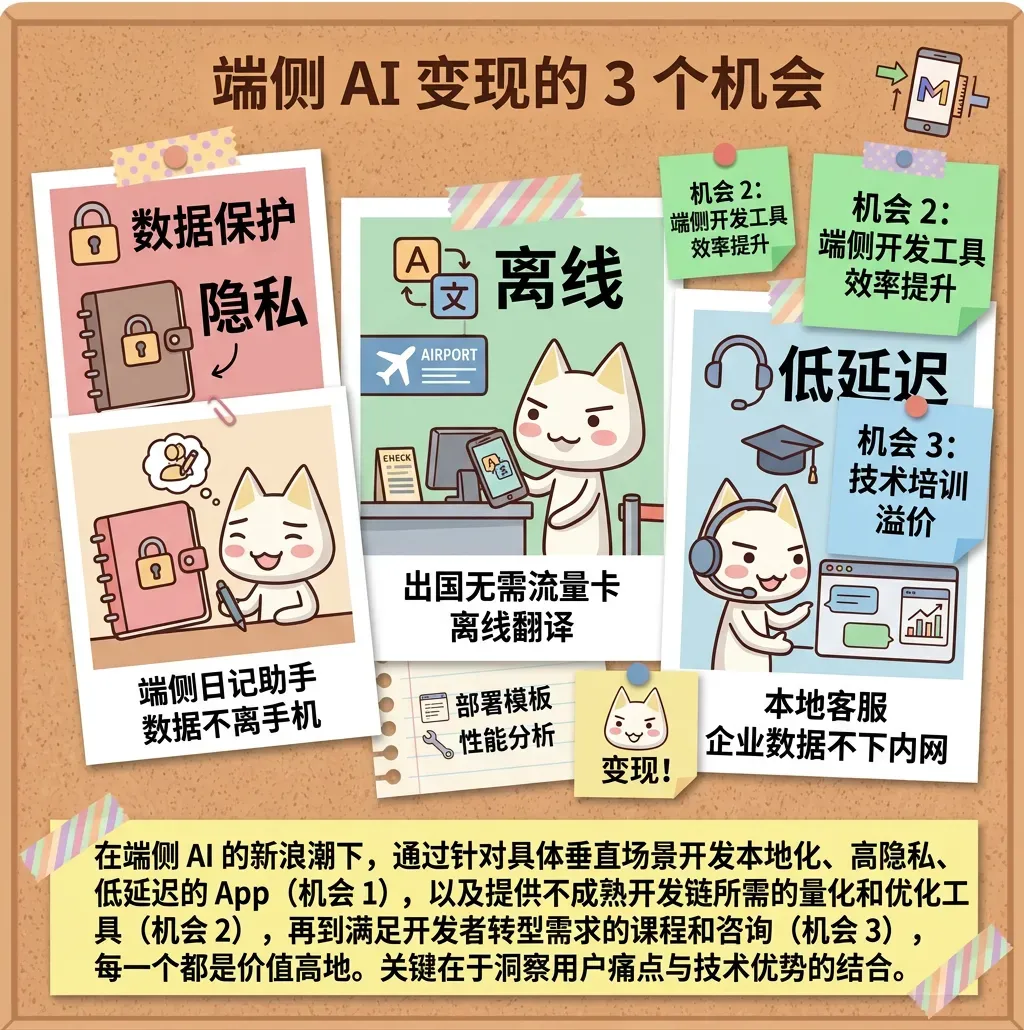

普通开发者的变现机遇:端侧AI的三大掘金方向

一、垂直场景的端侧AI应用

通用大模型在云端的竞争已趋白热化,但垂直场景下,端侧方案拥有独特优势。

- 本地日记助手:日记数据完全存储在手机本地,严防隐私泄露。

- 离线翻译器:出国旅行无需购买流量卡,随时即用。

- 本地客服机器人:企业内部数据不外传,安全可控。

用户会为隐私保护、离线能力和低延迟体验买单。

二、端侧AI开发工具链

当前端侧AI的开发门槛依然较高,配套工具链尚未成熟。

- 模型量化工具:一键将大模型压缩至手机适用尺寸。

- 性能剖析器:协助开发者精准调优端侧推理速度。

- 部署模板:提供针对不同手机型号的配置优化方案。

开发者愿意为效率付费。

三、端侧AI培训与咨询服务

许多传统开发者希望转型端侧AI,却苦于无从下手。

- 实战课程:手把手教授从零部署完整的端侧AI应用。

- 企业内训:助力企业构建端侧AI技术栈。

- 技术咨询:评估项目在端侧落地的可行性与方案。

信息落差叠加技能差距,便催生出可观的溢价空间。

额外的实用特性

除了硬核功能,这两个项目还藏着不少贴心设计:

- 示例代码完整度高:绝非入门级“Hello World”,而是真正可投入开发的可运行演示。

- 文档体验友好:包含中文注释,提供详尽的常见问题解答。

- 社区响应积极:Issues处理迅速,官方维护团队十分活跃。

- 跨平台全覆盖:同时支持Android、iOS及Web(通过WebAssembly)。

零门槛快速上手

无论你使用何种平台,均可轻松起步:

兼容性:

✅ Android - 完整支持

✅ iOS - 完整支持

✅ Web - 通过 WebAssembly 运行

✅ macOS/Windows - 开发调试用

安装 gallery:

git clone https://github.com/google-ai-edge/gallery.git

cd gallery

pip install -r requirements.txt

安装 LiteRT-LM:

pip install litert-lm

litert download gemma-2b-int4

无需注册,无需API密钥,完全免费。

写在最后:端侧AI爆发前夜,谁将抢占先机?

展望2026年,端侧AI有望复刻2023年云端大模型的爆发轨迹。但与云端不同,端侧AI更加贴近用户、更注重体验、也更易于创造收入。谷歌此次双管齐下,已将“应用案例库”与“高能引擎”双手奉上。接下来,就看谁最先孵化出首个破圈的杀手级应用——也许那个人就是你?