AI越强,为何更需人类把关?——人机回环(HITL)深度解析

提到AI自动化,很多人的第一反应是——用机器彻底取代人工。

但真正成熟、可落地、可规模化的AI系统,恰恰相反:人非但没有被淘汰,反而被刻意保留,成为系统稳定与进化的关键枢纽。

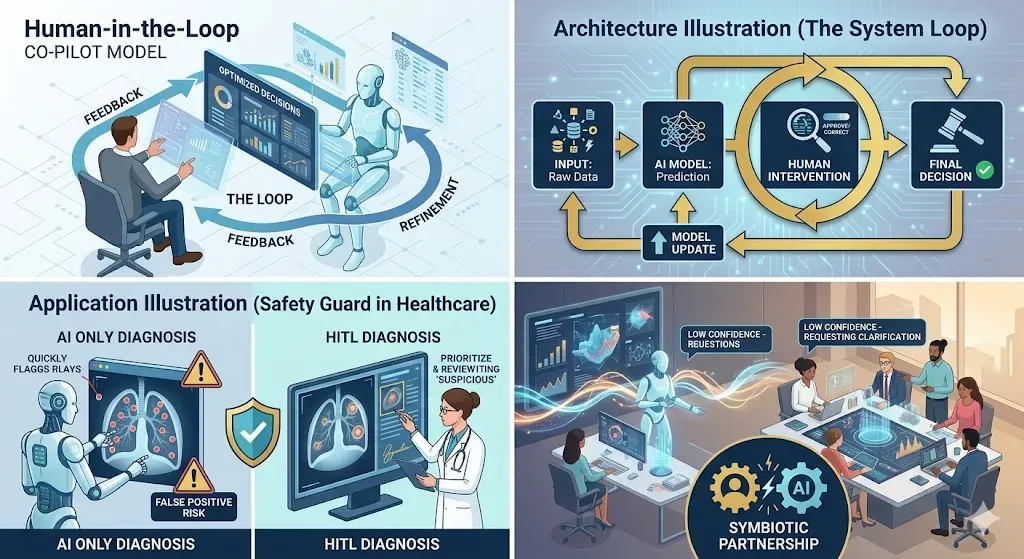

这便是:Human-in-the-Loop(HITL)——人机回环。

一、什么是人机回环(HITL)?

简单来说,HITL 就是在 AI 的自动化流程中,有意识地嵌入一个“人的决策节点”,而不是追求全自动。

如果把 AI 比作一辆高速飞驰的赛车:

- AI 是引擎,提供效率与速度

- 人类是领航员,负责方向修正

- 人类也是副驾驶,在需要制动时果断介入

HITL 并不是自动化的退让,而是自动化的增强。

典型 HITL 流程像一个持续生长的闭环:

输入 → AI 判断 → 人类复核/干预 → 最终决策 → 反馈至模型 → 模型变得更加聪明

它并不是单次流水线,而是一条不断迭代的进化通道。

二、系统架构视角:HITL 是闭环控制的必要一环

传统 AI 架构是一条单向通道:

数据 → 模型 → 输出

而 HITL 架构则是一个环形回路:

数据 → 模型判断 → 人工干预 → 决策 → 新数据 → 模型优化

在这个架构当中,人类承担着三重关键角色:

| 角色 | 职责 |

|---|---|

| 训练者(Trainer) | 在模型早期提供高质量标注数据,为其建立认知基线 |

| 评审者(Reviewer) | 当 AI 置信度不足时,启动人工审核,把关质量 |

| 安全监护者(Safety Guard) | 在关键风险节点行使最终裁决权,防止灾难性后果 |

HITL 从不是事后打的“补丁”,而是控制系统里内生的一环。

三、三大真实场景:为什么必须有人在场?

1)自动驾驶:从“离手”到“离眼”的巨大鸿沟

Tesla 辅助驾驶与 Waymo 无人车实践反复证明:极端天气、施工路段、长尾场景下,感知与决策能力会出现显著滑坡。

AI 在做什么

:车道居中、速度控制、障碍识别

人类在做什么

:当传感器误判或目标物体难以理解时,在 1–2 秒内实施接管

缺人的风险:长尾场景(如被风卷起的大纸箱、刺眼反光的路障)极易引发致命误判。

2)医疗影像诊断:AI 是放大镜,医生是手术刀

肺结节筛查、视网膜病变检测中,AI 能在海量切片里高效定位疑点,但最终的诊断报告,依然需要医生签字确认。

AI 在做什么

:高召回率筛查疑似病灶

人类在做什么

:融合病史、用药、症状进行多维度综合判断

缺人的风险:伪影误诊、伦理与法律责任无法落地、跨学科综合研判的缺失。

3)内容审核:在黑产与表达自由之间寻找平衡

YouTube、TikTok 等平台每天都在处理天文数字级的内容。

AI 在做什么

:过滤高概率违规的图片、敏感词

人类在做什么

:理解复杂语境——讽刺、隐喻、俚语、艺术化表达

缺人的风险:优质内容被大量“误杀”,或引发严重的合规事故与声誉崩塌。

四、利弊权衡:HITL 是一门口“平衡的艺术”

| 维度 | 优势 | 挑战 |

|---|---|---|

| 准确性 | 人工及时纠偏,逼近极高准确率 | 响应速度受人制 |

| 安全性 | 极端情形下人工兜底 | 人力成本高,规模扩展难 |

| 模型进化 | 持续注入高质量反馈信号 | 人的偏见可能被模型习得 |

| 信任度 | 专业人员的参与让系统更可信 | 人机协作界面设计高度复杂 |

五、大模型时代,HITL 为何反而更不可或缺?

很多人会疑惑:大模型已经如此强大,为什么还需要人?

答案是:越强大的模型,越需要人类待在 Loop 里。

以 OpenAI 的 ChatGPT 为例,其能力飞跃的背后,RLHF(基于人类反馈的强化学习) 是决定性推手。

抑制幻觉(Hallucination)

:模型会“自信地胡说八道”,必须由人校验纠正

RLHF

:通过人类的排序和打分,让模型逐步习得人类的偏好与判断

价值对齐(Alignment)

:伦理与价值观的边界,本质上只能由人类持续定义与校准

HITL 从过去的“可选项”,变成了今天的“必选项”。

六、未来进化:从“人机回环”走向“人机共生”

未来的 AI 系统将呈现三个鲜明趋势:

主动学习(Active Learning)

:AI 知道自己“不知道”,主动向人类发出求助

超精细化分工

:99% 的任务由 AI 独立完成,人只聚焦那最关键的 1%

协作界面的革命

:专门为 HITL 设计的低摩擦反馈界面,将成为全新的产品品类

七、结语:AI 掌驭效率,人类守护边界

HITL 并非是技术的倒退,而是AI 走向真正成熟的标识。

完全脱离人的自动化系统,只适用于封闭、稳定、规则清晰的环境(如工厂机械臂)。

而真实世界是开放的、变化的,充满了说不清的灰度。

在那里,人类的:

- 直觉

- 伦理判断

- 复杂推理

- 情境理解

依然无可替代。

对于产品经理与创业者而言,关键问题不再是:如何把人去掉?

而是:

在哪 1% 的关键节点上,引入人的智慧,能让系统效能发生质变?

AI 负责效率。

人类负责公平、安全与温度。

这,才是未来十年最稳健的技术范式。

思考题

在你的业务场景中:

哪 1% 的决策必须由人来完成?

如果这个环节消失,会发生什么?

欢迎在评论区分享你的答案。