AI Agent记忆框架注定消亡:三分天下格局下的技术终局与PostgreSQL崛起

几个月前,一篇探讨AI Agent操作系统时刻的文章曾预判:Agent基础设施的下一个战场将聚焦在"记忆"方向,届时将涌现大批创业公司与开源项目,资本疯狂涌入,架构图愈发复杂。

预言已成现实。Mem0完成新一轮融资,MemGPT更名Letta后继续吸金,Zep、Cognee、Hindsight、MemoryScope、Memobase、SuperMemory、Graphiti、LangMem、EverMemOS——数十个项目破土而出。

这些项目的技术博客挂着相似的架构图:底层episodic记忆层,中层semantic记忆层,顶层reflection或procedural层,层间箭头穿梭标注着consolidation、retrieval、forgetting。GitHub星标数持续攀升,arXiv论文霸榜,技术会议必设Agent Memory专题。盛况空前。

但此刻需要冷静思考:这场热潮虽盛,两年后或成过眼云烟。

这一判断并非严谨论证,而是基于技术演进的深层直觉。必须澄清的是,Agent当然需要记忆——记忆正是Agent革命最核心的战略筹码与终极壁垒所在。问题在于,Agent需要的是记忆能力,而非当下这些名为"Memory框架"的中间件。

两句表述仅两字之差,却决定了一条赛道的生死存亡。

下文将系统阐述这一判断的逻辑根基。

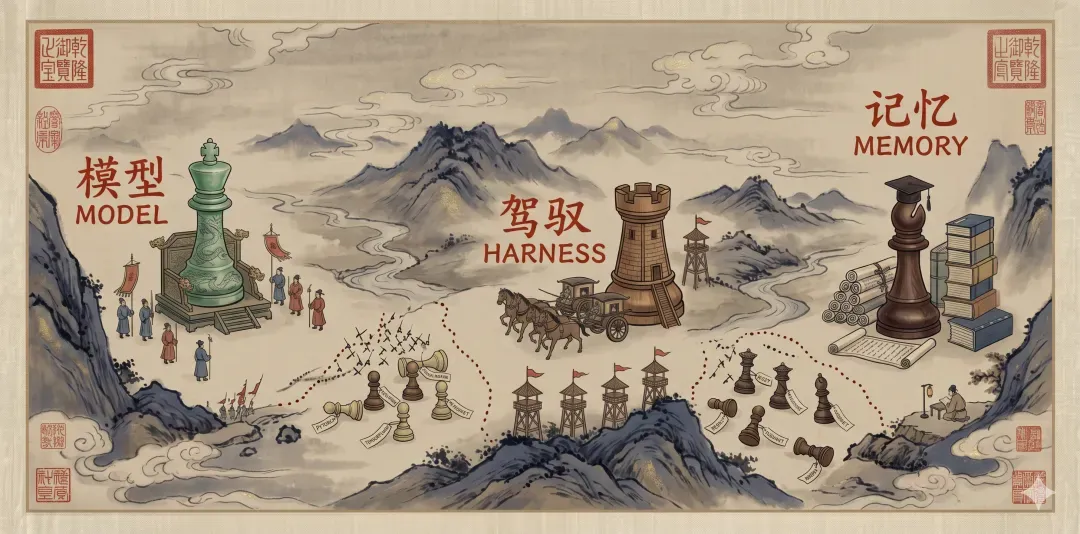

一、终局格局:模型、Harness与数据库三分天下

要看清当前赛道迷雾,先得描绘终局图景。

此处定义的"终局"特指严肃的企业级Agent系统,以及任何将数据视为核心资产的组织和个人。消费级市场可能呈现不同面貌——普通用户使用ChatGPT、Gemini等产品时,记忆功能由厂商内置提供。

AI Agent的终局架构将呈现三足鼎立格局。成熟的Agent系统终将简化为如下形态:

MODEL_URL=https://api.anthropic.com/v1DB_URL=postgres://user:pass@host:5432/memory

一个URL提供智能,一个URL提供记忆,中间层由Harness负责驾驭模型完成具体任务——加载Skills、组织context、调用工具、处理循环。想更换模型供应商?只需修改MODEL_URL。需要迁移数据?替换DB_URL即可。选择本地部署?两个URL都指向localhost。三层架构彻底解耦:智能层归模型厂商,记忆层归数据库厂商,执行驾驭层由Harness承担——Claude Code、Cursor、Devin这类正经历爆发式演进的产品,本质上均属Harness范畴。

此格局并非架构师的审美偏好,而是由深层技术动力学决定。

终局中最坚固的壁垒既非算力也非模型。算力虽短期关键但长期必然摊平,正如电力从未形成永恒垄断。模型虽中期重要但持续平权化——开源模型年度迭代,GPT-5与DeepSeek V4的差距已远小于GPT-4时代。两年后,Agent可用的模型市场将呈现丰俭由人的充分竞争态势。唯一真正可持续的壁垒是私有数据。

严肃的企业用户绝不允许核心业务数据被"一勺烩",更不容许其与他方数据混居于同一服务商的黑箱。数据一旦被锁定,服务商便获得永久性议价能力——过去三十年的数据库与云服务采购史反复验证此逻辑。博弈的终局必然是上述架构:模型厂商管智能,Harness管执行驾驭,数据库厂商管记忆,三方独立制衡,互不侵吞。

终局图景明晰呈现——模型、Harness、数据库,各自为王,分疆而治。

此刻关键问题浮现:当下市面流行的Memory框架,在这幅地图中占据何种位置?

二、记忆框架的本质:四种类型与不同命运

为避免一概而论,需先对"记忆框架"概念进行粒度细分。当前被归入此范畴的项目本质上是四类截然不同的产物,命运轨迹各异。

第一类,数据库套壳SDK。典型代表包括早期Mem0、LangMem、MemoryScope、SuperMemory等。核心能力是在数据库(通常为PG+pgvector或SQLite)之上封装"extract/store/retrieve/update"API,将episodic与semantic记忆分表存储,辅以重要性评分与时间衰减规则。这类项目最接近"数据库薄皮"描述,技术壁垒几乎为零,仅具备微弱的产品用户心智。

第二类,知识图谱/时序图谱构建器。代表项目有Graphiti、Cognee、Hindsight。这类框架比第一类更为厚重——支持双时态知识图谱、增量实体消歧、冲突检测与失效处理、混合检索(语义+关键词+图遍历)。其策略层确有工程复杂度,远非"几条SQL"可概括。但它们的终局是——策略层将被模型自身能力吸收(模型已能自主完成实体消歧与冲突判断),存储层将回归数据库(图能力由PG扩展或专用图数据库承载),独立赛道逻辑不成立。

第三类,Agent Runtime/Agent OS。Letta/MemGPT是典型代表。它们根本不在做记忆框架该做的事——将context window视为RAM、外部存储视为Disk、让模型通过tool call自主管理swap——这属于操作系统层面的虚拟内存管理。其技术门槛不低,但准确名称应为Agent Runtime,是Harness下位的执行引擎层。事实上,它应归属Runtime/Harness赛道,而非Memory赛道。

第四类,临时性认知策略层。这类是前三类的共性抽象——它们都在为Agent硬编码"何时记、记什么、如何组织、如何检索"的认知策略。这些策略在模型能力弱时是必要拐杖,一旦模型能自主决策,拐杖即失去价值。

三、护城河何在?记忆框架的壁垒困境

聚焦第一类(数据库套壳SDK)——这也是市面上最泛滥的形态。

将其拆解至原子级别,所做之事无非两件:替Agent设计几张表的schema,替Agent封装几条SQL。

episodic与semantic分表是schema设计;重要性评分、时间衰减、反思压缩是写入规则;向量召回叠加BM25与cross-encoder重排及RRF融合是查询策略。剥去所有PR术语与类脑架构图,底层就是建表与SQL。

建表与SQL有壁垒吗?这是初级程序员的基本功。框架的价值何在?在于"替Agent想好了如何建表与查询"。

“替Agent想好"这件事价值几何?

近期曾做过思想实验——用PG加若干扩展加存储过程,完整复刻Mem0功能,耗时不过数日。最终未付诸实施,为何?无意义,无壁垒。任何熟悉PG的工程师,周末下午就能写出功能九成相似的基础版Mem0。剩余一成差异在于UI、SaaS控制台、发布节奏、开发者关系——那是运营与产品的壁垒,非技术壁垒。

“教会Agent使用这套系统"又需多少成本?一个Skill加一张markdown文档。

只需数百token的指令,告知模型"你拥有PostgreSQL连接地址DATABASE_URL,用户对话时自行判断哪些事实值得存储,每次回答前执行向全文混合检索,发现新旧冲突即UPDATE旧记录”——仅此而已。Mem0的ADD/UPDATE/DELETE/NOOP流水线、Cognee的图谱构建、Graphiti的时序图——这些"认知架构"能完成的任务,当前模型自主编写SQL即可实现,且代码更简洁优雅。

Claude的Skills机制已走完这条路的一半。用户只需编写memory-skill.md描述"记忆如何存查”,Claude便能在需要时自动调用,无需任何外部Memory框架。一旦Anthropic或OpenAI将官方memory skill作为最佳实践发布,整批同类项目将在模型侧被彻底架空。

自以为的护城河,实则是一张数百字的markdown文档。生产环境中,该文档背后自然对接受控工具与固化数据库pipeline——但这些位置归属明确,Harness的归Harness,数据库的归数据库,并无独立Memory框架的容身之处。

四、苦涩的教训:handcrafted策略终将被学习取代

从产业结构看,Memory框架无独立位置;从方法论视角,还有更深层的逻辑——The Bitter Lesson。

Sutton在2019年的千字博客中揭示的真理简洁而残酷:过去七十年,AI领域反复上演同一剧本——研究者将领域知识精心编码进系统,短期见效显著,长期必败于"让模型自主学习"的通用方法。国际象棋评估函数败给搜索,围棋棋谱先验败给自我对弈,语音识别的音素模型败给统计方法,CV的SIFT特征败给深度学习。每一次,依赖"领域理解"的路线都输给看似"无智能"却能吞噬算力与数据的通用方法。

这把刀锋指向Memory框架时需谨慎——它不斩系统抽象层。操作系统、数据库、编译器等人类设计的抽象不会被端到端学习吞噬,因为它们提供的是可靠的基础构件,而非替AI做决策。Sutton批判的是后者。

Memory框架的问题在于它站在后者的阵营。其硬编码的一切——何信息值得记、记于何层、何时触发反思、如何融合向量与全文——每项都是"替Agent做认知决策"的主观规则,而非通用构件(向量存储、全文检索、事务、索引等真正的构件早已由数据库提供)。当下Agent需要这些规则只因模型尚弱;待模型强到能自主判断——此过程已在进行——这些手工认知策略将如SIFT遇见AlexNet般,一夜之间化为废铁。

产业结构无位置,方法论根基不稳。两条逻辑在此交汇合拢。

五、真正的壁垒在哪里

那么,真正的壁垒何在?

三分天下图景中,严格来说仅有两块位置的壁垒较为确定,另一块的壁垒仍在演化成型。

模型层将血流成河。闭源与开源拉锯,价格年度腰斩,厂商排名半年洗牌。此领域确有壁垒,但壁垒属于少数头部厂商,且格局剧烈震荡。

Harness层尚未定型。Claude Code/Codex暂时领先,但OpenClaw、Hermes等追赶者已现;Letta/MemGPT的Agent Runtime方向若能成事也颇具潜力。Harness领域今日刚形成些许壁垒,旋即被Claude Code开源动作拉平至新的基准线。

唯一确定性最高的是数据库层。

确定性源于结构性事实:数据库不在AI冲击波前线上。

何物会被AI冲击?价值源于"信息加工"之物——文案、设计、初级编程、法律文书、客服、PPT。其本质是将信息A映射为信息B,而这正是LLM的核心能力。LLM越强,这些岗位被压缩得越狠。

何物不在冲击范围内?物理世界的持久化层。数据库的使命是在真实磁盘上、通过真实操作系统与文件系统、对抗真实断电与崩溃、在多节点间用真实网络达成共识,确保二十年后字节仍可准确读取。其本质是物理世界的可靠性保障,而非信息加工。再聪明的LLM也凭空变不出一块磁盘,保证不了fsync语义,更无法替代两阶段提交。

Agent越强大,越需要可靠的物理世界锚点。Agent革命不会削弱数据库价值,只会将其放大。

因此三分天下终局中,模型层血流成河,Harness层摸索前行,唯有数据库这块地基,三十年前已定,三十年后依然矗立。

六、数据库的终局为何是PostgreSQL

具体到记忆层,谁将是最终答案?

需分阶段审视。

当前阶段——对本地个人Agent或单机轻量场景而言,SQLite甚至文件系统已完全胜任。SQLite零运维、文件形态、本地运行、原生支持JSON与向量扩展,单体Agent的记忆需求它足以承载。此阶段谈论"记忆层必须PG"属于过度设计。

但演进至下一阶段——一旦Agent需要跨Agent协作、跨设备持久化、跨组织迁移、面对多租户与并发,即需要"通用可迁移记忆层"——局势将快速收敛。

收敛所向何处?

PostgreSQL。

原因有三。

其一,事实已然发生。大量认真构建Agent基础设施的严肃项目正向后端PG或PG兼容方案靠拢——Letta官方支持PG+pgvector,Hindsight明确仅支持PG+pgvector,Tiger Data直接将产品线命名为Agentic Postgres。这并非PG生态的自我证明(Supabase、Neon等本就属PG家族),而是原本选择其他路线的项目主动向PG收敛。

其二,线缆协议已成事实标准。PG协议之于通用记忆层,正如HTTP之于应用层——足够古老、稳定、通用、开放,无任何厂商能独占或替代。模型训练语料中见过数百万次SQL与psql交互,天然掌握这门语言,无需额外训练。采用私有协议的数据库在AI时代已输一半,只因模型对其陌生。

其三,扩展生态已覆盖记忆层所有检索原语。向量检索有pgvector,全文搜索有tsvector+GIN索引,图查询有AGE及新一代PG图扩展,时序数据有TimescaleDB,地理空间有PostGIS,水平扩展有Citus。这些能力均以扩展形式插入,无需重写系统——因为PG三十年前做出关键决策:不预设上层语义。这是PG的真正伟大之处,三十年后任何新工作负载均可无缝接入。

因此演进路径清晰可见——在"通用可迁移记忆层"议题上,除PG协议外别无选择。图数据库、对象存储、端侧SQLite、专用搜索系统将在各自垂直场景继续存在,这不矛盾。但在"通用Agent记忆"主战场,PG就是终局答案。

SQLite与PG在架构哲学上同宗同源——皆为通用持久化层、均不预设上层语义、皆有几十年可靠性积累、都不在AI冲击前线上、都拥有灵活扩展性。SQLite是端侧与本地场景的PG,PG是服务端与协作场景的SQLite。它们是同一架构路径上的不同尺寸。

真正被三分天下格局吞噬的,是"介于数据库与应用之间的中间件"——正是今日Memory框架所处的尴尬位置。

回到三分天下架构图。模型层持续流动,Harness层逐步成型,记忆层沉淀固化。三块版图各自独立,绝无"Memory框架"的独立疆域。它们并非任何一方的竞争对手——只是过渡阶段代行三方职责的临时中介,一旦真空被填满,中介自然失去存在价值。

十年后再回望2026年的Memory框架喧嚣,将看到平淡真相:那些宣称"为Agent设计认知"的框架,最终留下的代码只有最朴素的部分——老老实实将数据写入PostgreSQL的那几行SQL。

其余一切,终将被端到端学习彻底消化。