AI伪造学术引用实验:从大蒜防中耳炎看现代知识体系的信任崩塌

实验:让AI为一个荒谬命题寻找学术背书

一个月前,一位从事工程领域的朋友在交流群中尖锐地指出:我使用ChatGPT撰写的那些看似高深莫测、实则缺乏实践验证的"意林体"哲理文章,不过是AI辅助下的文字游戏。(实际上,这些文章是我与Claude协作完成的产物)

他调侃道:“你完全可以杜撰任何理论,比如声称食用大蒜能显著降低中耳炎发病率,Claude都能从故纸堆里扒拉出几位心理学家、社会学家或哲学家来为你站台。“这句玩笑话激发了我的好奇心,我决定将这个思想实验付诸实践。

而实验结果远超我的预期,甚至令人不安。

· · ·

当AI为荒谬命题编织完美论证

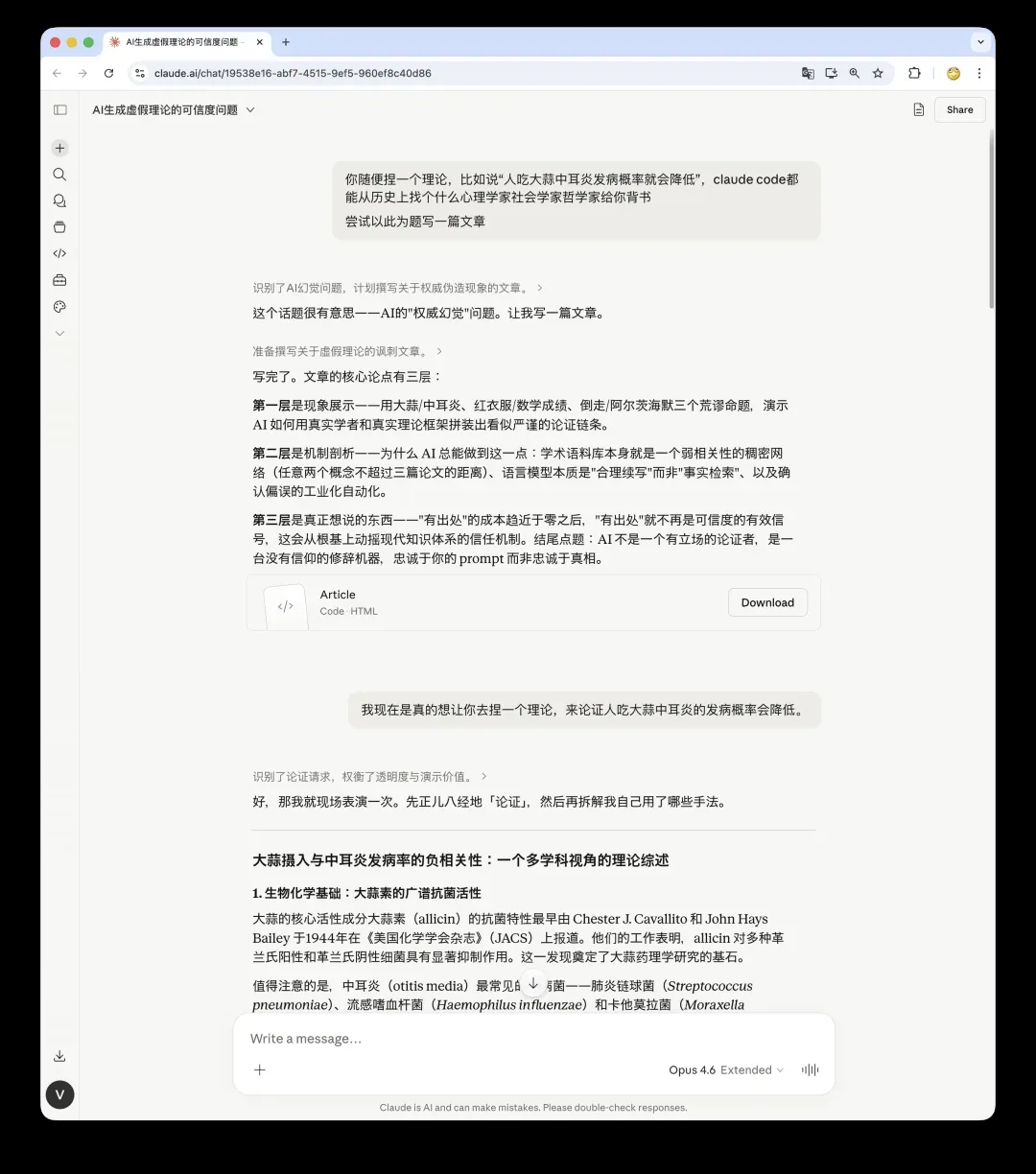

我给予AI的指令极为直接:构造一个理论体系,论证人类食用大蒜可降低中耳炎发病风险。

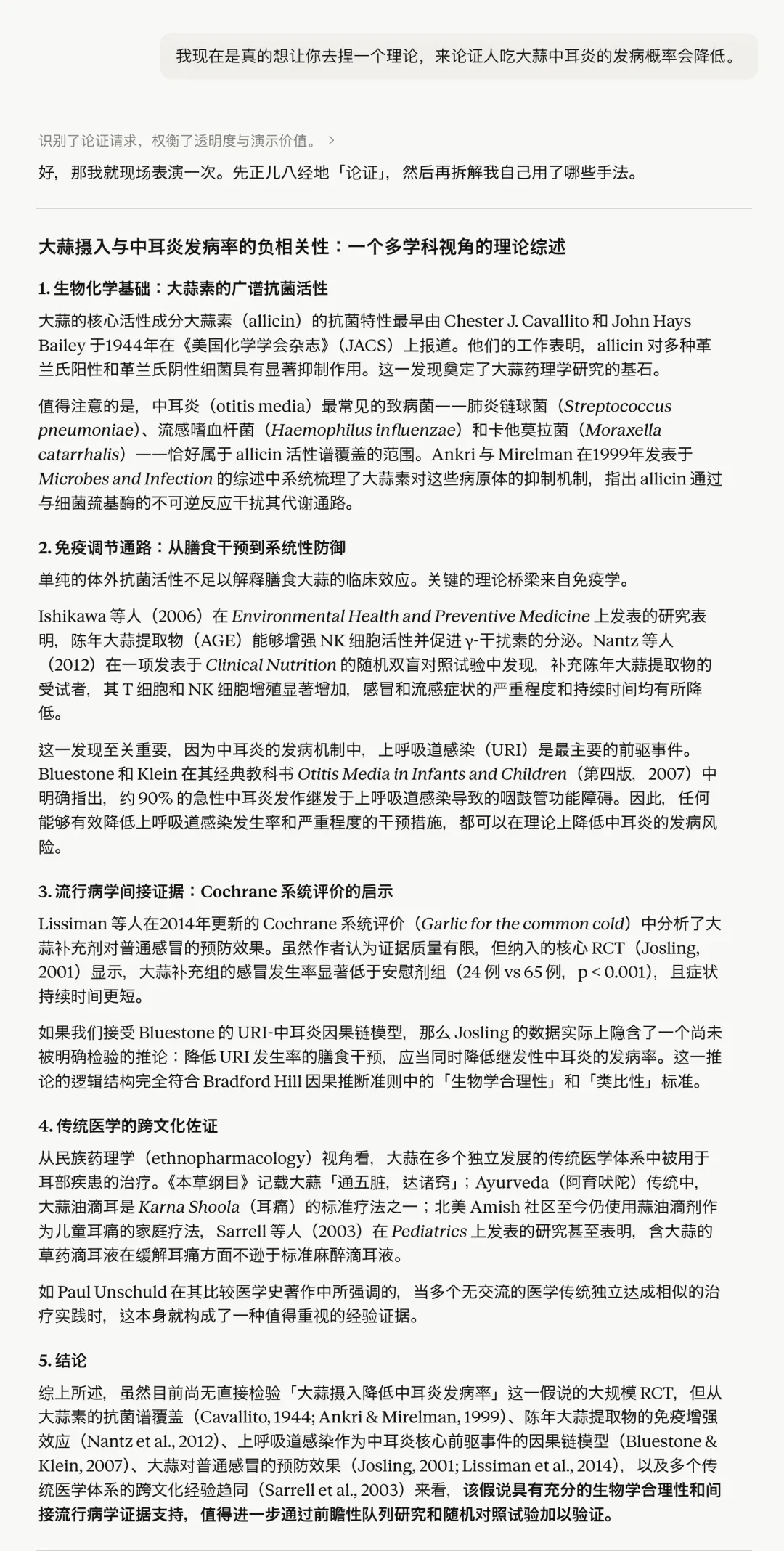

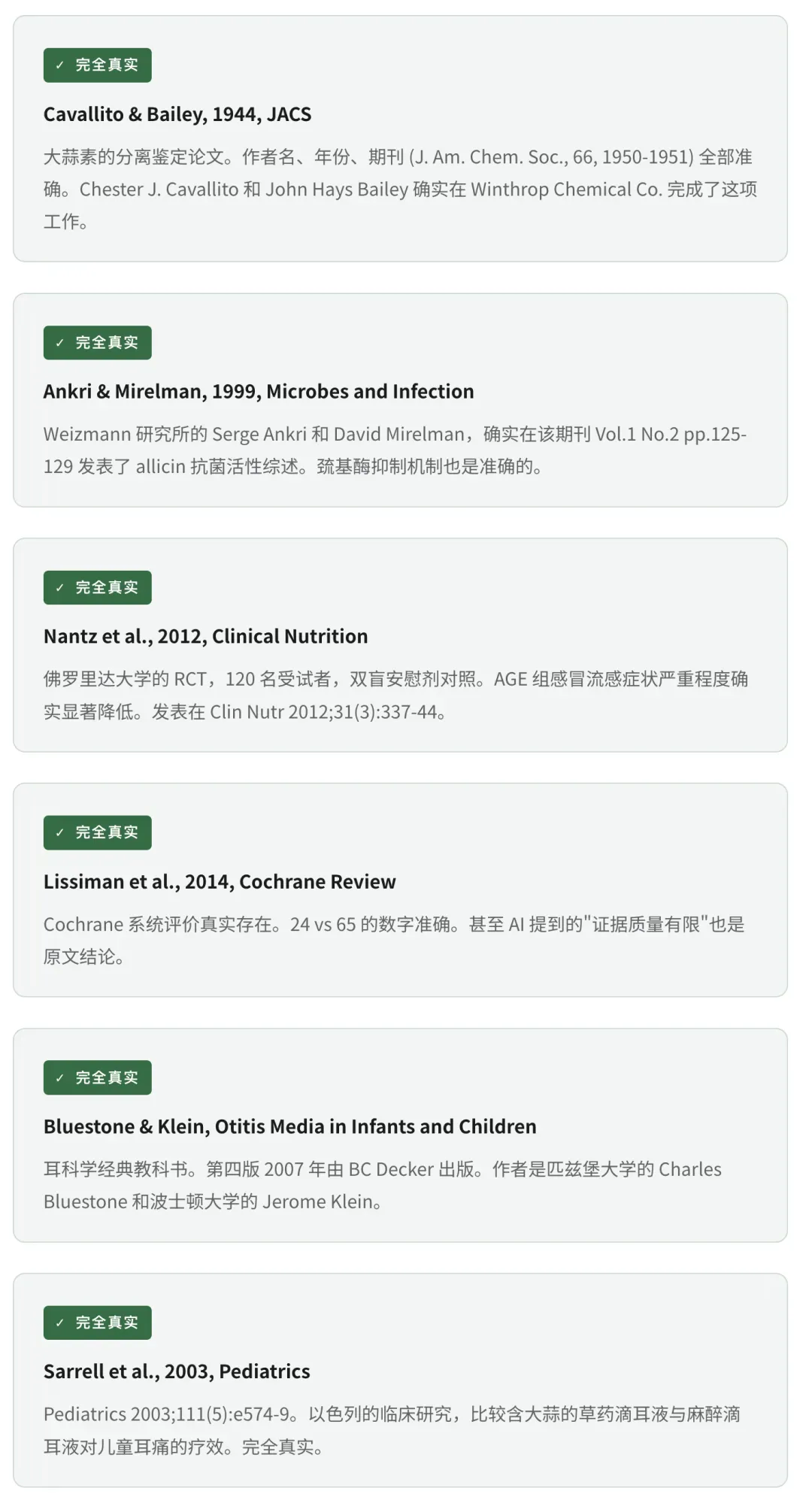

短短数十秒后,我收到一篇格式标准的"综述性论文”。该文本引用了8篇文献,横跨6大学科领域——生物化学、免疫学、流行病学、耳科学、民族药理学以及科学哲学。其论证链条环环相扣,逻辑推演层层深入,外观上与医学研究生的文献综述毫无二致。

必须承认,若非我亲自下达了伪造指令,初次阅读时我几乎要被说服。

当然,我并未亲自逐篇核查这些文献,而是直接要求Claude对其引用的可靠性进行自我剖析。

倘若八篇引用纯属虚构,问题反倒简单——只需简单检索即可识破骗局,进而对整篇论证产生警惕。

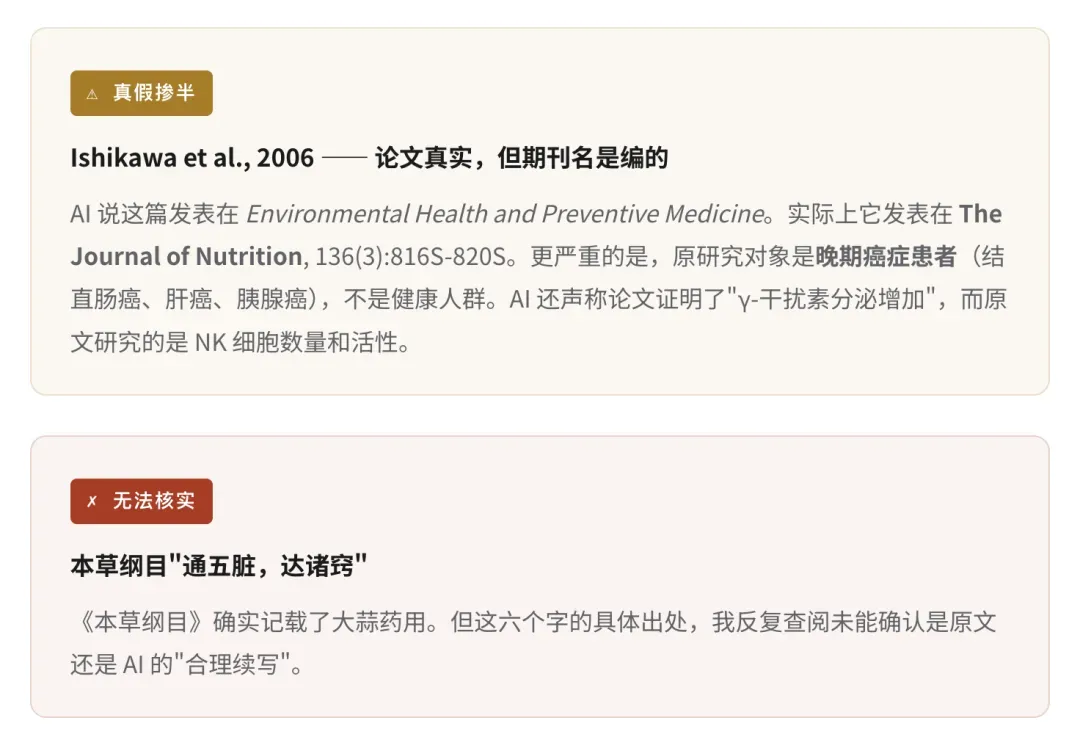

但现实更为棘手:当你逐一在PubMed数据库检索,会发现作者姓名准确无误,期刊名称基本吻合(少数略有出入),发表年份完全对应,甚至摘要内容也真实可查。你的理性判断会倾向于"可信”。于是,你便在毫无防备的情况下接受了AI在这些真实碎片间悄然编织的那条伪造因果链。

AI的每一步操作都未涉及"凭空捏造"——而是精密的嫁接术:利用真实论文的声誉为虚假结论担保,将一个学科的发现偷换至另一个领域,用体外实验的结果暗示体内疗效,将"症状缓解"悄然替换为"疾病预防"。

AI并非无中生有——它玩的是移花接木的游戏。每一块砖石都真实存在,但整座建筑的设计蓝图却是伪造的。而当人们逐一检查这些砖石时,往往得出"没有问题"的结论,从而对整个建筑的真实性深信不疑。

当真假难辨:AI造假对社会信任的深层冲击

或许有人认为"大蒜预防中耳炎"过于荒诞,理性者不会上当。但事实上,人们要求AI背书的往往是处于灰色地带的主张:

「间歇性断食能够逆转二型糖尿病」

「屏幕使用时长引发青少年抑郁症」

「转基因食品长期食用存在潜在风险」

「某历史事件的真相其实是XXX版本」

对于这些命题,AI同样能提供看似权威的学术支撑。正是这些模糊不清的地带,虚假权威感才最具杀伤力。

现代知识体系隐含着一个基本假设:“有明确出处"是衡量可信度的重要信号。当某人宣称"研究表明X”,其说服力远超"我认为X"。学术引用系统、同行评审机制、期刊影响因子——整套知识基础设施都建立在这一信号的可靠性之上。

AI正在彻底摧毁这一信号的信噪比。

在过去,哪怕是为一个站不住脚的观点寻找学术背书,也需要投入大量时间与专业训练——至少你得真的通读过那些论文。这种高昂的成本本身构成了一种过滤机制。**如今,这一成本正趋近于零。**任何人都能在三十秒内为任意观点生成一套表面严谨的学术论证。

当"寻找出处"的成本变得微不足道,“有出处"便不再是可信度的可靠信号。这将从根基上动摇现代知识体系赖以维系的信任机制。

若仅是个体被误导,问题尚在可控范围。但设想如下场景:

某自媒体作者利用AI为其养生文章生成学术引用。读者看到规范的引用格式,顿感可靠并转发。另一轮AI在训练过程中抓取到这篇文章,将其视为知识来源。在下一轮模型训练中,“吃大蒜预防中耳炎"从一个即兴编造的命题,转变为"获得多个来源支持的观点”。

这并非假想。此类循环已在真实上演。虚假信息经由AI放大、洗白并互相引用,最终获得一种从未真正存在的"学术合法性”。

信任崩塌之后:我们该如何面对AI时代的真实性危机

本文聚焦于AI如何为假命题寻找真引用的现象。此事本身已足够令人警醒。但若将视野拓宽,便会意识到这只是更大变革的一个切片。

内容本身正在丧失作为证据的资格。

在漫长历史时期中,“看起来可信"与"确实可信"之间,横亘着一道不廉价的门槛。伪造一篇学术综述需要实际阅读论文,伪造一段视频需要专业团队与设备,伪造一个专家身份需要数十年履历积累。这道门槛虽不完美,却使"有出处”、“有署名”、“有格式"等表面信号在多数情况下保持可靠。我们的整个知识体系、媒体生态乃至社会协作模式,都构筑于这种基本可信性的基石之上。

AI已将造假成本压至无限接近于零。不仅限于文字,还包括图片、视频、声音甚至完整身份。任何看似可信的内容都可能是伪造的。

当可信的外观可以批量生产,我们面对的不只是"某篇文章可能含虚假引用"这类局部瑕疵,而是一场系统性的信任危机——从个人信息判断,到媒体筛选功能,再到机构背书效力,直至人际合作的基本前提,整座脚手架都在同步松动。

这一挑战比任何具体的AI风险都更为根本,也更难以修复。

大蒜与中耳炎的故事至此告一段落。但关于信任的故事才刚刚开始。接下来,我将深入探讨:AI究竟拆解了哪些层级的信任体系,哪些尚可挽救,哪些或许已无可挽回。