Claude最强实名认证风控解析:AI时代用户分化的新门槛与应对策略

随着Anthropic最新政策的推出,用户访问Claude平台将面临更严格的限制。这一变化标志着AI工具使用门槛的显著提升。

Anthropic近日更新了官方支持文档,正式宣布在Claude平台上引入身份验证机制。简而言之,用户若希望使用特定高级功能,必须首先完成身份验证流程。

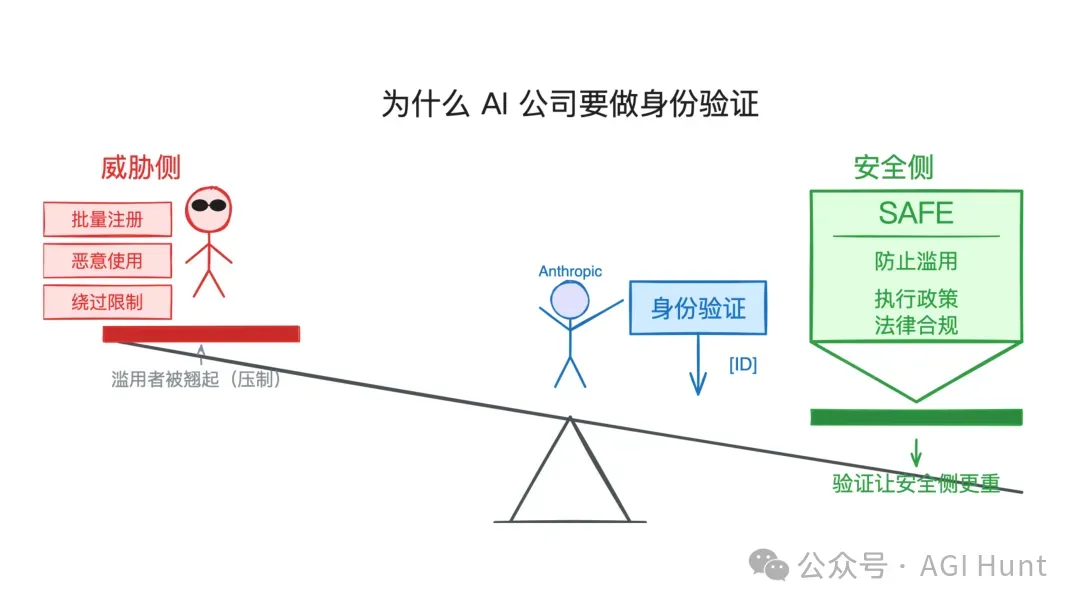

身份验证的背后逻辑

Anthropic官方给出的解释是:为了确保强大技术得到负责任的应用,必须明确使用者的真实身份。

身份验证主要基于三个核心目的:预防系统滥用、执行平台使用政策以及履行相关法律义务。当前验证机制仍处于逐步推广阶段,仅当用户尝试访问某些特定功能或平台进行常规安全合规检查时,才会触发验证提示。这意味着并非所有用户都会立即受到验证要求的影响,至少现阶段如此。

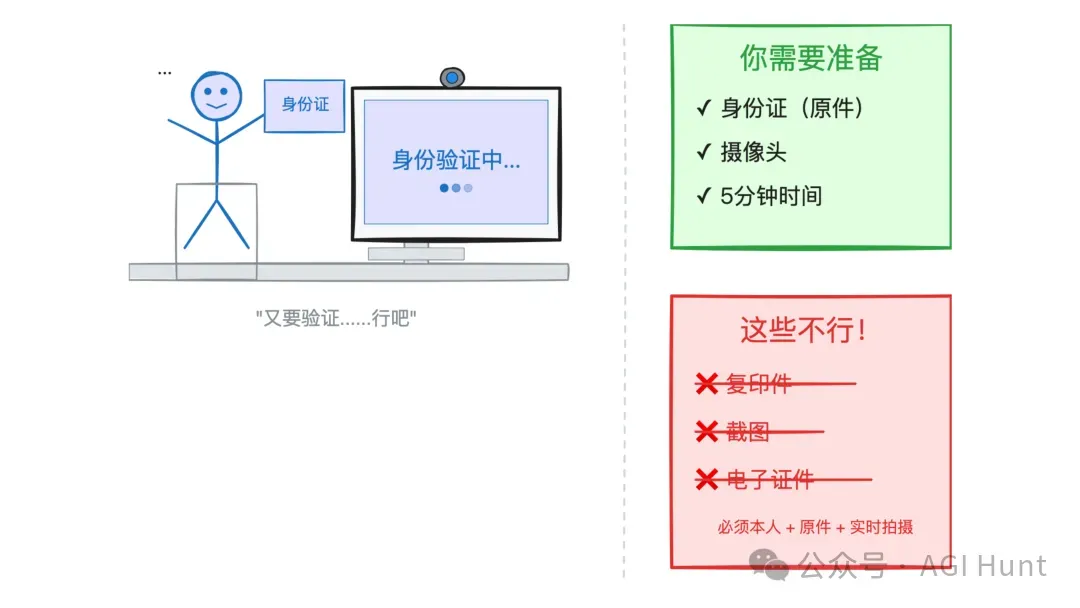

验证所需材料与流程

完成验证流程相对直接,用户需要准备以下三项要素:

• 一份由政府签发且包含照片的有效身份证件(实体版本,如纸质或卡片形式) • 一台配备摄像头的电子设备(智能手机或电脑均可) • 大约五分钟的验证时间

可接受的证件类型涵盖护照、驾驶执照、州级或省级身份证以及国民身份证,基本上全球多数国家的政府签发证件均被认可。然而,部分证件形式不被接纳:包括复印件、屏幕截图、电子或数字身份证、非政府机构证件(例如学生证或工作证),以及临时纸质证件。换言之,用户必须手持实体证件原件,通过摄像头进行拍摄验证。

验证合作伙伴与数据安全

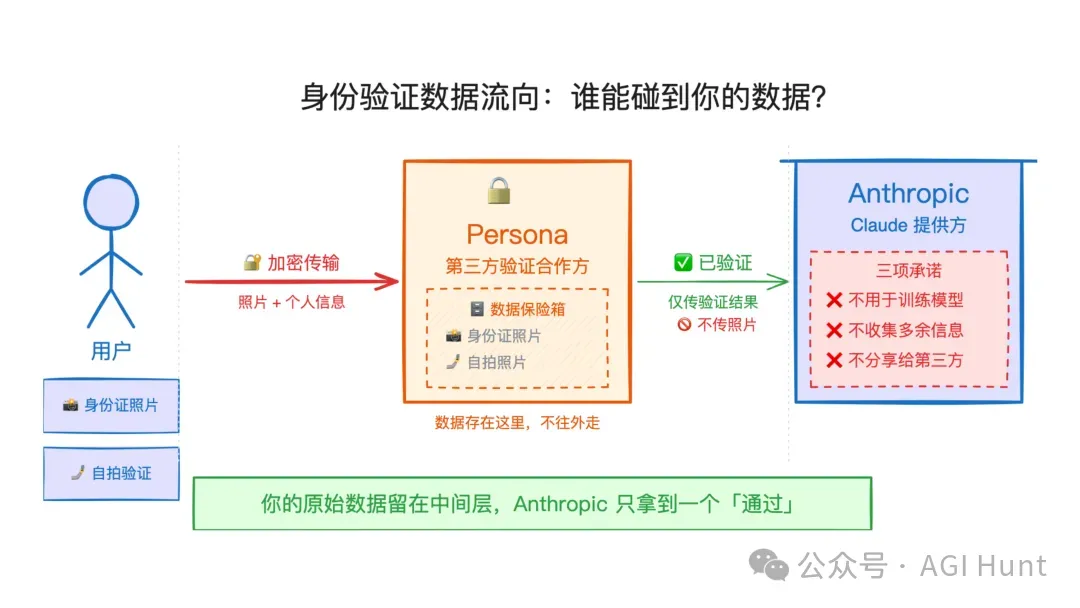

验证执行方是当前用户关注的焦点。Anthropic选择与一家名为Persona Identities的公司合作处理验证事务,选择理由包括其技术实力、隐私控制措施以及安全保障能力。

数据流向设计如下:Anthropic作为数据控制方,Persona负责具体处理。用户的身份证件照片和自拍图像存储在Persona的系统中,不会保留在Anthropic的服务器上。此外,Persona在合同层面被限制数据使用范围,所有数据传输过程均采用加密保护。

Anthropc特别强调了几项他们承诺不会进行的操作: • 不会利用验证数据训练人工智能模型 • 不会收集非必要个人信息 • 除非法律强制要求,不会向第三方共享身份验证数据

整体而言,政策表述显得相对克制,但将身份证件信息提交给AI公司这一行为本身,仍足以引发用户的深度顾虑。

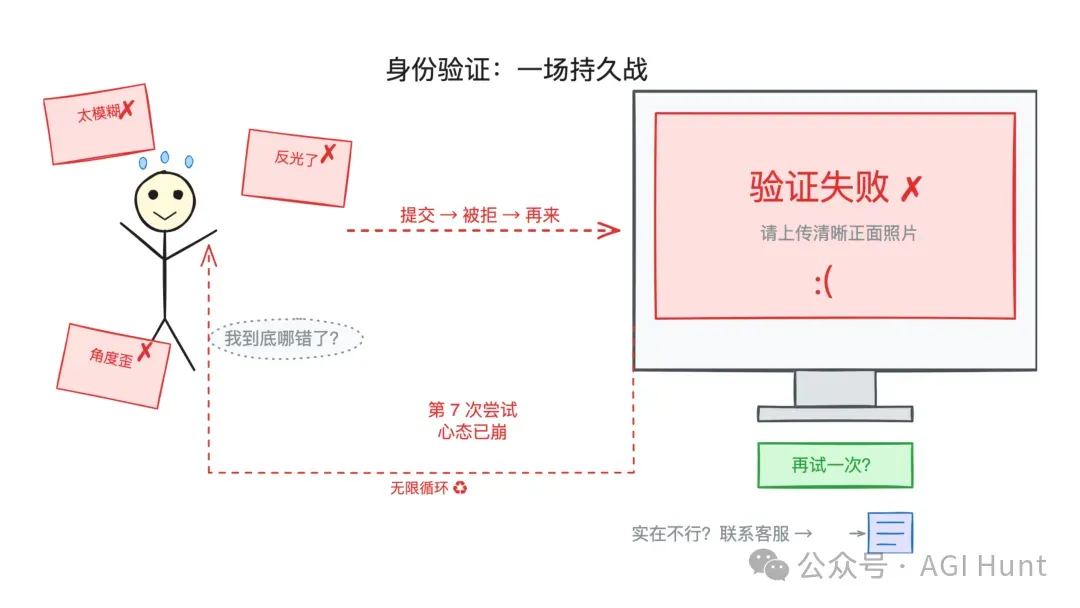

处理验证失败的策略

若验证尝试未能通过,用户可以多次重新提交。Anthropic建议检查证件拍摄质量,确保照明充足、避免反光、保证证件信息清晰可辨。

如果持续无法完成验证,用户可通过官方表单联系技术支持团队。更严重的情况是账户被封禁,可能原因包括违反使用政策、从不支持地区创建账户、违反服务条款或未成年人使用等。账户封禁后同样可通过官方表单提交申诉请求。

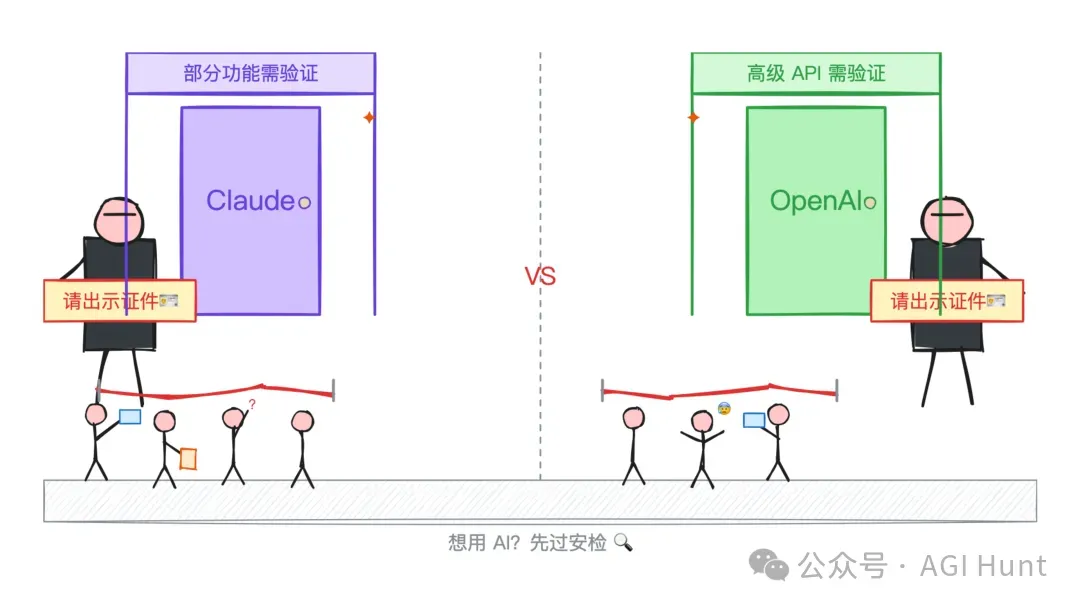

OpenAI的类似举措对比

实际上,Anthropic并非首家实施此类验证的AI公司。早在2025年4月,OpenAI便推出了“Verified Organization”组织验证机制。开发者若希望解锁API平台上的最先进模型与功能,需使用政府签发的身份证件完成验证。该机制限制较为严格:单张身份证件每90天仅能验证一个组织,且并非所有组织都具备验证资格。

OpenAI当时提出的理由与此相似:防止AI产品遭到滥用。官方声明指出:“我们正在增加验证流程,以减少AI的不安全使用,同时继续让更广泛的开发者社区能够使用先进模型。”不过,OpenAI的验证主要针对API开发者群体,普通用户暂未受影响。相比之下,Anthropic的验证触发范围似乎更为广泛,涵盖了Claude产品端的部分功能。两家头部AI公司相继采取类似措施,标志着行业监管趋势的强化。

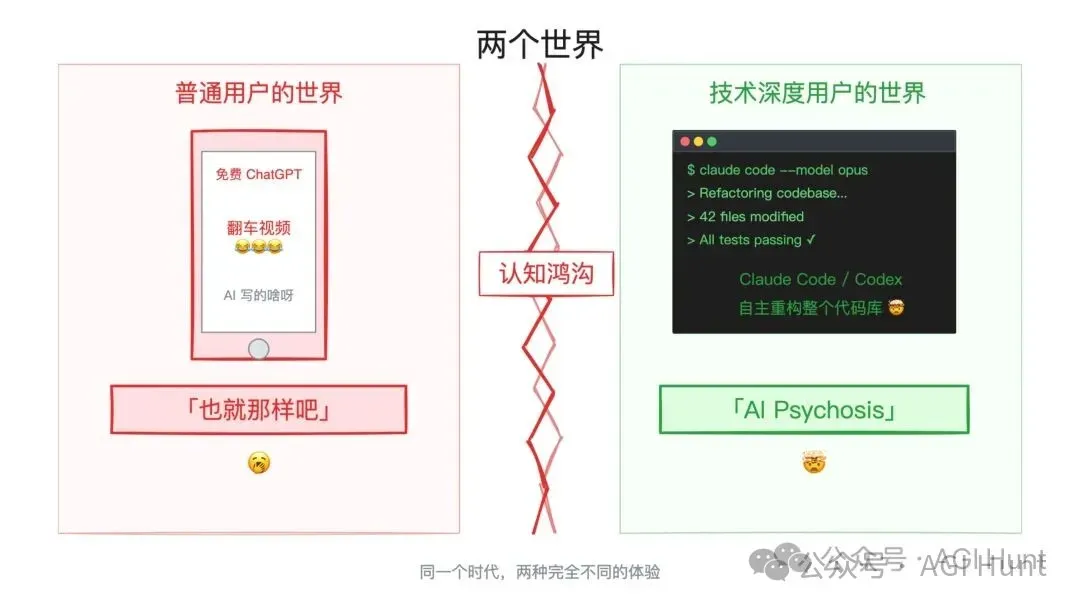

AI时代用户分化的加剧

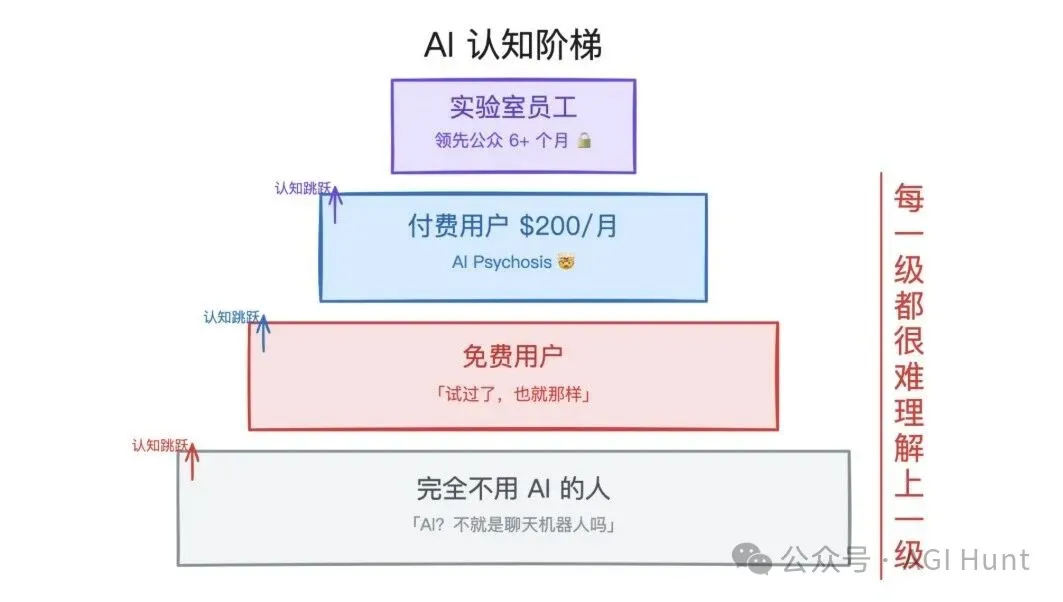

从更宏观视角观察,这一变化可能加剧AI时代的人群分化现象。此前有观点将用户分为两类:一类是去年尝试免费版ChatGPT后认为AI技术平平无奇的人群;另一类是每月花费200美元订阅前沿模型,正经历“AI精神冲击”的深度用户。

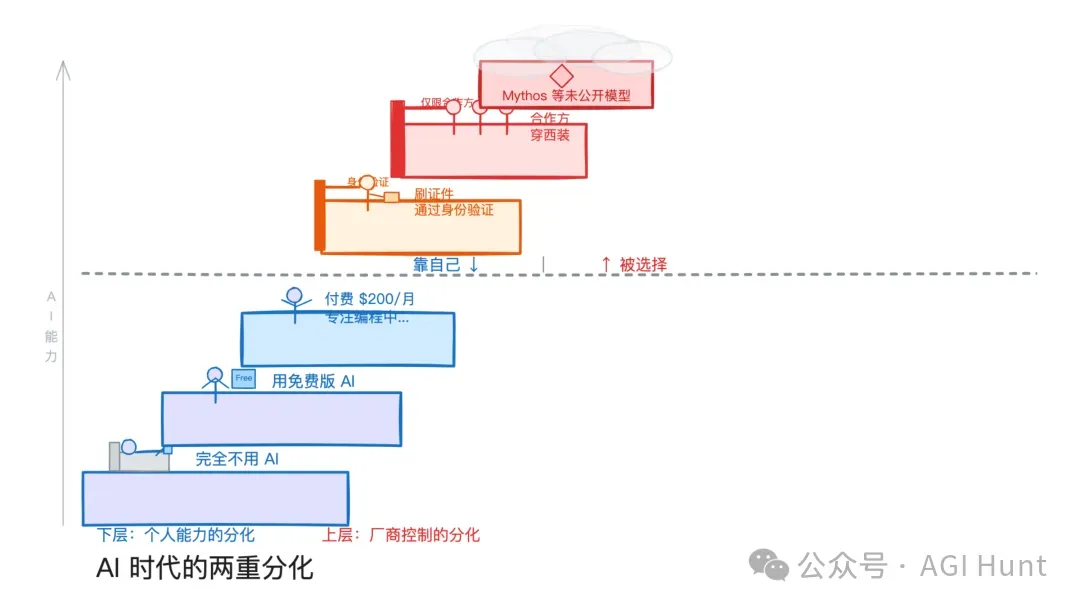

身份验证机制的引入,可能使这种分化趋势进一步加深。早期的分化主要基于个人因素:包括支付意愿、使用技能及应用领域。这些差异虽然显著,但理论上任何用户都有可能通过努力跨越。而现在出现的分化,则部分由模型厂商主动构建。

厂商通过身份验证、地区限制、价格门槛甚至选择性模型发布等方式,决定用户访问权限。例如,Anthropic此前发布的Mythos模型,作为Claude首个非公开发布的旗舰模型,仅向十几家核心合作伙伴开放,原因正是其网络攻防能力过于强大,公司认为不应向所有用户开放。从“能否支付费用”到“是否具备使用资格”的转变,实际上已在悄然发生。

未来趋势与展望

Anthropc目前声明身份验证仅针对部分功能触发。但可以预见,随着模型能力持续增强,验证适用范围很可能逐步扩大。OpenAI已经走过的路径,Anthropic大概率会跟随,Google预计也不会长期缺席这一趋势。

AI时代的使用者正面临双重分化结构:第一重分化存在于用户之间,由所使用的模型类型、应用方式及使用时长决定个体的AI认知层次;第二重分化由模型厂商主导,通过验证审核、定价策略及选择性发布机制,控制用户所能触及的技术层级。第一重分化尚可通过个人努力突破,而第二重分化的跨越则充满不确定性。

当然,面对严格的政策限制,市场上可能出现相应的应对策略与中间服务商,这或许会成为技术演进中的另一有趣现象。

◇ ◆ ◇

相关参考链接:

Anthropic官方说明文档:https://support.claude.com/en/articles/14328960-identity-verification-on-claude

OpenAI组织验证指南:https://help.openai.com/en/articles/10910291-api-organization-verification