DeepSeek V4 开发者体验全解析:百万上下文、Agent质变与国产算力落地

1M 上下文标配、Agent 能力比肩 Opus、国产算力加持——DeepSeek 这一次不只是在追赶,而是在重新定义「开源模型的天花板」。

先说结论

今天上午,DeepSeek 官方正式发布了 DeepSeek-V4 预览版,同步开源。这不是一次小版本迭代,而是一次从架构到能力的全面跃迁。

简单说三件事:

- 百万上下文成为标配——不是噱头,是实实在在的工程突破

- Agent 能力质变——从「能对话」到「能干活」,直接对标 Claude Opus 4.6

- 国产算力落地——昇腾、寒武纪 Day 0 适配,这不是 PPT,是今天就能跑的东西

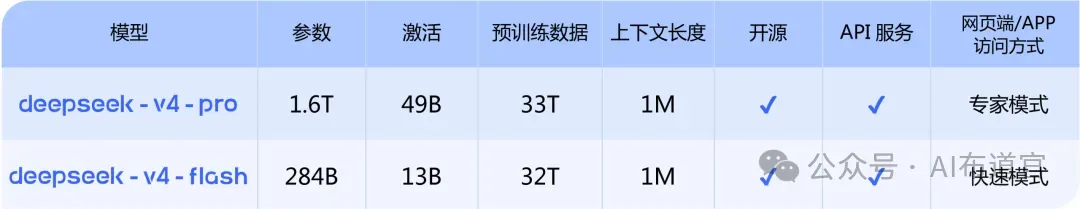

DeepSeek-V4 双版本

一、百万上下文:不是加个滑窗那么简单

这次 V4 最抓眼球的数据是 1M(一百万)Token 上下文,最大输出 384K Token。但如果你以为这只是「把 KV Cache 塞大一点」,那就低估 DeepSeek 了。

架构层面的革新

根据技术报告,V4 搞了一套全新的注意力架构,核心是两个东西:

- CSA(Compressed Sparse Attention):在 Token 维度做压缩,不是存所有 KV,而是只保留关键信息

- HCA(Highly Compressed Attention):对历史信息做极度压缩,保留语义骨架

这让我想到一个类比:传统注意力像「逐字逐句记笔记」,CSA+HCA 像「读完一章写一段摘要,再从摘要里提取关键点」。信息有损,但损失的是冗余,不是核心。

上下文效率对比

数据很硬核:和 V3 相比,推理 FLOPs 降低 73%,KV Cache 大小减少 90%。这意味着不是靠堆硬件撑上去的,而是靠算法优化把效率拉上来的。一百万上下文不再是实验室里几张 A100 堆出来的数字,而是一种可以普惠到每个开发者的能力。

我的看法

百万上下文的意义不在于「我能不能一次塞进去一整本书」,而在于它改变了开发者和 AI 协作的方式。

举个例子:我之前用 Claude Code 做项目,200K 上下文已经可以理解整个中型项目了。但如果 V4 真能稳定跑在 1M 上下文,那意味着:

- 一个完整的微服务架构 + 所有依赖的源码,可以一次性加载

- 历史对话不需要反复压缩,上下文断裂的问题基本消失

- Agent 做复杂任务时,不用再纠结「哪些文件该放进上下文窗口」

这才是百万上下文的真正价值——它让 AI 从「短时记忆」进化到「长时记忆」。

二、Agent 能力:从「能用」到「好用」的分水岭

这次 V4 另一个重头戏是 Agent 能力的大幅增强。官方原话说得很直接:

V4-Pro 已达到当前开源模型最佳水平……使用体验优于 Sonnet 4.5,交付质量接近 Opus 4.6 非思考模式。

性能评测

推理与知识评测

不是泛泛而谈,是针对主流 Agent 框架专项优化

让我印象最深的一点:DeepSeek V4 专门针对 Claude Code、OpenClaw、OpenCode、CodeBuddy 等主流 Agent 产品做了适配。这说明他们很清楚——模型的竞争力不仅在跑分,更在于开发者实际用 Agent 干活时的体验。

官方还放了一张 V4-Pro 在 Agent 框架下生成 PPT 的内页截图,效果确实不错:

Agent 生成 PPT 示例

双版本的差异化策略

这次 V4 分了两个版本,定位很清晰:

| 维度 | V4-Pro | V4-Flash |

|---|---|---|

| 参数量 | 1.6T(49B 激活) | 284B(13B 激活) |

| 推理能力 | 世界顶级,比肩闭源 | 接近 V4-Pro |

| 世界知识 | 大幅领先开源模型 | 稍逊 |

| Agent 复杂任务 | 强 | 简单任务旗鼓相当,高难度有差距 |

| 速度与成本 | 较高 | 更快更便宜 |

我的理解是:V4-Flash 用来做日常编程助手和简单任务,V4-Pro 用来做复杂 Agent 协作和深度推理。这个分层策略和 Anthropic 的 Sonnet/Opus 分层非常相似,说明 DeepSeek 在产品化思维上越来越成熟了。

思考模式的加入

两个版本都支持思考模式和非思考模式切换,思考模式下可以设置 reasoning_effort 为 high 或 max。官方建议复杂 Agent 场景用 max。

这其实就是把「快思考」和「慢思考」的选择权交给了开发者——简单问题省算力秒回,复杂问题开 max 模式深度推理。这种灵活度在开源模型里是第一次见到。

三、国产算力:从「能不能用」到「Day 0 适配」

这次发布最让我意外的不是模型本身,而是国产算力的落地速度。

昇腾直播

- 华为昇腾:今晚 7 点直播 V4 在昇腾平台的首发

- 寒武纪:已经完成了基于 vLLM 推理框架对 285B V4-Flash 和 1.6T V4-Pro 的 Day 0 适配,代码已开源到 GitHub

什么叫 Day 0 适配?就是模型发布的当天,你就能在国产芯片上跑起来。这在一年前几乎不可想象。

为什么这件事很重要

过去一年,很多人讨论「国产算力能不能跑大模型」,但讨论往往停留在 benchmark 层面。DeepSeek V4 这次做了一件非常实际的事——你不是问能不能跑吗?好,模型和适配代码一起给你,今天就能跑。

这对整个国内 AI 生态的意义远超模型本身:

- 验证了国产算力的可用性——不是实验室环境,是生产级模型发布即适配

- 为后续模型提供了标杆——其他团队发布模型时,国产算力适配会成为标准动作

- 降低了开发者的迁移焦虑——不用担心模型只能跑在特定硬件上

四、技术亮点速览:V4 的六大创新

读完技术报告,我整理了几个值得关注的技术创新:

技术报告

| 创新 | 一句话解释 |

|---|---|

| 混合注意力架构(CSA+HCA) | 压缩稀疏注意力 + 高度压缩注意力,大幅降低长上下文的计算和显存开销 |

| 流形约束超连接(mHC) | 增强残差连接,让深层网络信号传播更稳定,训练更稳 |

| Muon 优化器 | 新优化器,加速收敛,提升训练效率 |

| 33T/32T Token 预训练 | Pro 用 33T,Flash 用 32T,数据量拉满 |

| 策略蒸馏 | 后训练阶段通过蒸馏进一步优化推理和编程能力 |

| KV Cache 减少 90% | 对比 V3,推理效率质的飞跃 |

其中 Muon 优化器 是一个值得单独关注的创新。在 LLM 训练中,AdamW 几乎是默认选择,Muon 的出现说明还有优化空间的探索余地。如果它在 V4 上验证了效果,很可能会被其他团队跟进。

五、API 迁移指南:开发者需要知道的事

如果你已经在用 DeepSeek 的 API,这次迁移很简单,但有一个重要时间节点:

API 信息

迁移方式

# 只需改 model 参数,base_url 不变

client.chat.completions.create(

model="deepseek-v4-pro", # 原来是 deepseek-chat

# 或

model="deepseek-v4-flash", # 原来是 deepseek-reasoner

)

关键时间线

| 时间 | 事件 |

|---|---|

| 现在 | 旧模型名 deepseek-chat → 指向 V4-Flash 非思考模式 |

| 现在 | 旧模型名 deepseek-reasoner → 指向 V4-Flash 思考模式 |

| 2026-07-24 | 旧模型名正式停用(三个月过渡期) |

建议现在就开始切换到新模型名,避免到期突然报错。

六、写在最后:DeepSeek 的节奏感

从 V2 到 V3 再到 V4,DeepSeek 的发布节奏越来越清晰:

- V2:证明了 MoE 架构在大模型上的可行性

- V3:把推理能力拉到了和闭源模型掰手腕的水平

- V4:在架构创新、Agent 能力、长上下文、国产算力四条线同时推进

官方在发布时引用了一句《荀子》:

不诱于誉,不恐于诽,率道而行,端然正己。

这句话用在 AI 行业很应景。过去半年,DeepSeek 经历了爆火、被质疑、被对标,但他们没有在舆论场上消耗太多精力,而是默默把 V4 做出来了——1M 上下文、Agent 专项优化、国产算力适配、同步开源。

这就是实力派该有的姿态。