Mac本地部署DeepSeek V4 Flash完整指南:antirez的ds4.c引擎实战教程

开源项目

核心速览

ds4.c 是 Redis 创始人 antirez 专为 DeepSeek V4 Flash 打造的 macOS 原生推理引擎。该项目并非简单封装或二次开发,而是从 Metal 计算内核到 HTTP 服务接口实现了完整技术栈的自主研发。采用 2-bit 量化技术后,仅需 128GB 内存的 MacBook 即可运行,在 M3 Ultra 平台上实测文本生成速度达到每秒 36 个 token。

36

生成 t/s

1M

上下文

128

最低 GB

入门指引:ds4.c适用人群与使用场景

推荐使用人群

配备 128GB 以上统一内存的 Mac 设备用户(M3 Max 或 M3 Ultra 机型),希望在本地环境部署高性能推理模型,避免依赖云端 API 并确保数据隐私安全。适合具备基础命令行操作能力的开发者或 AI 工具深度使用者,预计花费 10 分钟即可完成部署配置。

不建议使用人群

设备内存仅为 16GB 或 32GB 的 MacBook 用户——该项目设定了 128GB 的硬性内存门槛。同时,仅希望通过网页界面与 AI 交互、不愿接触终端操作的用户也不适合选择此方案。

ds4.c 旨在解决一个核心诉求:让拥有 2840 亿参数的 DeepSeek V4 Flash MoE 架构模型在个人计算设备上高效运行,并支持对接编程智能体。antirez 采取了激进的技术路线:仅支持 Apple Metal 图形接口,仅适配单一模型架构,不追求通用框架兼容性。这种专注策略换来了单模型运行体验的深度优化。

环境准备:极简两步安装流程

整个部署流程无需配置 CUDA 环境、安装 Python 依赖或拉取 Docker 镜像,仅需两条指令即可完成模型获取与二进制编译。

硬件配置要求

- 内存:128GB RAM(q2 量化版本)或 256GB RAM(q4 量化版本)

- 处理器:Apple Silicon M 系列芯片,Intel 平台暂不支持

第一步:获取模型权重

git clone https://github.com/antirez/ds4.git

cd ds4

./download_model.sh q2 # 128GB 内存设备选择 q2 量化

./download_model.sh q4 # 256GB 内存设备选择 q4 量化

第二步:编译构建

make

编译完成后将生成两个可执行文件:ds4 交互式命令行工具与 ds4-server HTTP 服务程序。

验证 CLI 功能是否正常:

./ds4 -p "用一句话解释什么是 Redis"

进阶配置:本地Coding Agent接入指南

服务端启动后,可配置各类支持 OpenAI 或 Anthropic 协议的客户端工具。以下演示 opencode 的配置方法:

启动 ds4-server 服务:

./ds4-server --ctx 100000 \

--kv-disk-dir /tmp/ds4-kv \

--kv-disk-space-mb 8192

在 ~/.config/opencode/opencode.json 配置文件中添加服务提供方:

{

"provider": {

"ds4": {

"name": "ds4.c (local)",

"npm": "@ai-sdk/openai-compatible",

"options": {

"baseURL": "http://127.0.0.1:8000/v1",

"apiKey": "dsv4-local"

},

"models": {

"deepseek-v4-flash": {

"name": "DeepSeek V4 Flash",

"limit": {

"context": 100000,

"output": 384000

}

}

}

}

},

"agent": {

"ds4": {

"description": "DS4 on ds4-server",

"model": "ds4/deepseek-v4-flash",

"temperature": 0

}

}

}

重启 opencode 客户端并切换至 ds4 agent,即可使用本地模型进行代码生成。首次加载需耗时约 1-2 分钟,由于启用了磁盘 KV 缓存机制,后续会话响应速度将显著提升。

核心技术解析

▸ KV Cache 持久化存储 —— 利用 Mac 高速 SSD 优势,将键值缓存从内存迁移至磁盘存储。服务重启或会话切换后可从磁盘快速恢复,长上下文预填充仅需计算一次即可重复使用。

▸ 2-bit 量化精度保留 —— 仅对 MoE 架构中的路由专家模块执行量化操作,共享专家层与路由机制维持原始精度。在编程智能体应用场景下,工具调用准确率得以有效保障。

▸ 思考长度动态调整 —— DS4 的思考环节 token 长度与问题复杂度呈正相关关系,相比其他模型可减少约 5 倍的冗余输出。该特性使思考模式在本地部署环境中具备实际可用性。

▸ 双协议 API 兼容 —— 同时支持 OpenAI 与 Anthropic 两种接口规范,opencode、Claude Code、Pi 等工具均可实现零配置对接。

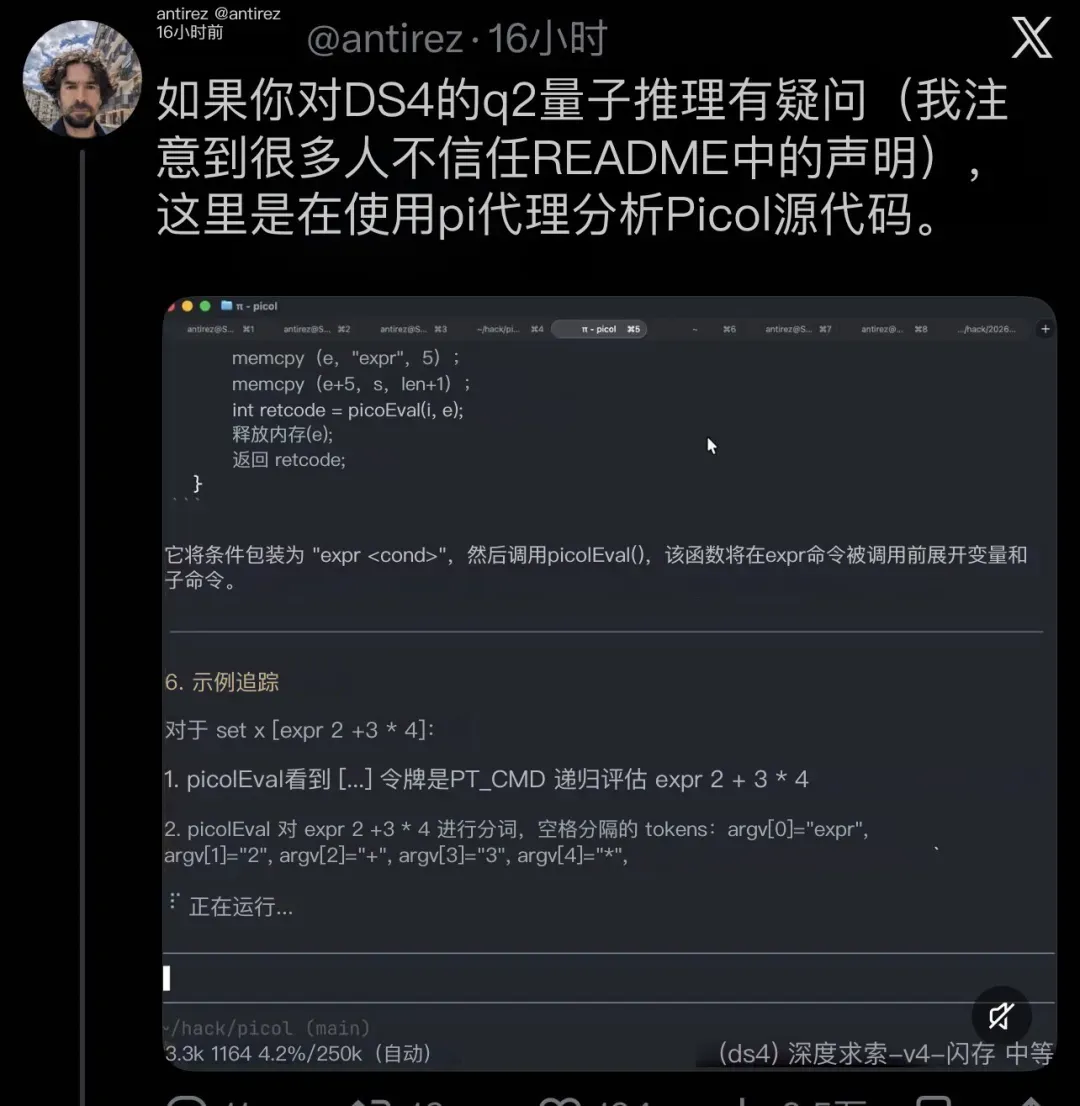

antirez 在项目 README 中明确表示开发过程借助了 GPT-5.5 辅助编码,并直言"若无法接受 AI 生成的代码,此软件可能不适合你"。这种开诚布公的态度在开源社区中实属罕见。

重要注意事项与已知问题

CPU 推理存在缺陷 —— 由于 macOS 内核虚拟内存管理存在兼容性问题,使用 CPU 路径执行推理可能导致系统不稳定。务必使用 Metal GPU 加速路径。

专用模型加载器 —— 仅支持加载 antirez 官方发布的特定 GGUF 格式模型文件,无法兼容其他渠道的 DeepSeek 量化版本。

Alpha 阶段质量 —— 项目目前仅包含 14 次代码提交,antirez 明确标注为"alpha 质量代码",建议用于实验性场景。

项目资源链接

antirez/ds4 — github.com/antirez/ds4

Model weights — huggingface.co/antirez/deepseek-v4-gguf

DeepSeek V4 Flash — deepseek.com