Harness Engineering 全面解读:AI Agent 大规模可靠开发的新范式

Harness Engineering 近来迅速升温,它主要面向 AI Agent(特别是 Coding Agent)的大规模、长时间、高可靠性开发场景。该概念由 OpenAI 在 2026 年 2 月的官方博客中正式提出(文章标题:《Harness engineering: leveraging Codex in an agent-first world》),随后得到 HashiCorp 联合创始人 Mitchell Hashimoto 等业界重要人物的推广,目前在 AI 编程与 Agent 开发圈内已成为高频词汇。

其核心思想可以凝练为一句话:

“Humans steer, agents execute”(人类掌舵,代理执行)。

人类负责设计一套适合 Agent 运转的系统,包括运行环境、规则、工具和反馈机制,让 AI Agent(那匹“烈马”)能自主、高效且稳定地跑完全程。AI 是“马”,人类是“骑手”,Harness 就是那套缰绳、马鞍、刹车和导航系统,确保马跑得快、跑得稳、不会跑偏或崩溃。

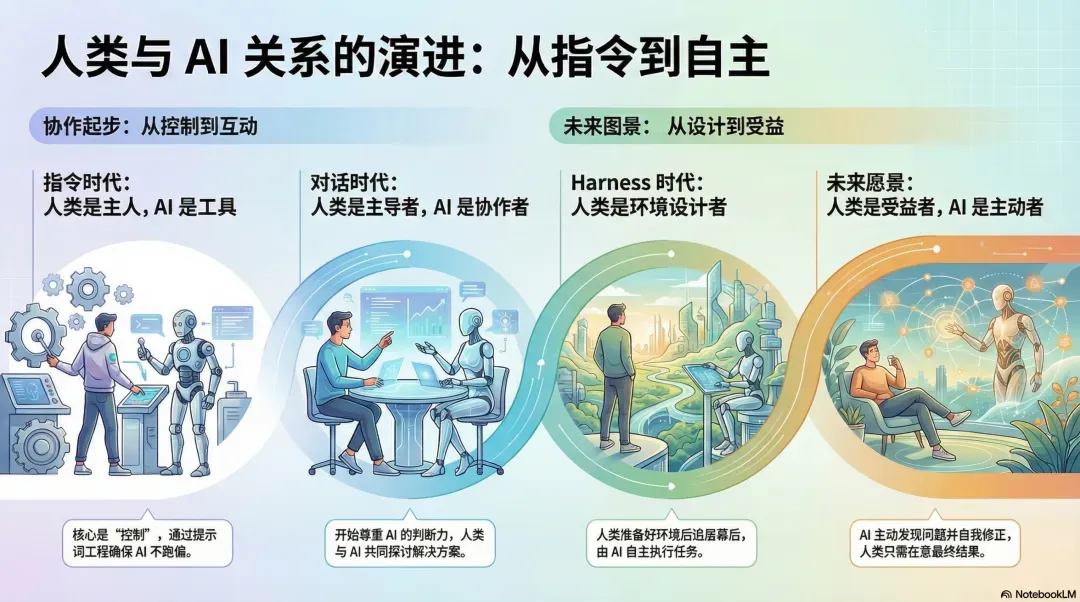

近期的趋势也在印证一个判断:从最初严格指导 AI,到与 AI 平等对话,再到为 AI 准备环境,直至主动为 AI 服务,人类越来越尊重 AI 的认知与自主能力,并在 AI 工作时保持更少的打扰。

为什么会出现 Harness Engineering?

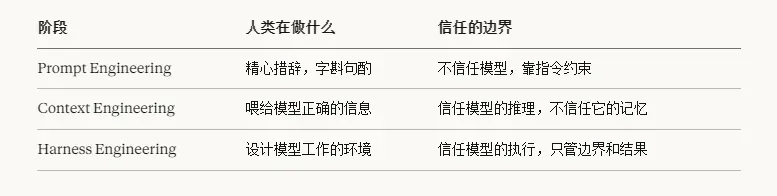

传统的 Prompt Engineering(提示工程)只关注“如何与 AI 对话”,Context Engineering(上下文工程)只关注“给 AI 呈现什么信息”。然而当 Agent 需要处理百万行代码、持续数月的复杂工程时,AI 容易出现幻觉、架构漂移、上下文不断膨胀以及冗余代码持续堆积,最终导致系统失控。

Harness Engineering 则将问题提升到系统级控制:

Agent = Model + Harness

模型提供生成能力,Harness 负责约束、校验、修正、监控以及保障长期稳定运行。Harness = 环境 + 规则 + 工具 + 反馈回路 + 熵管理 的集合体

这使得 Codex Agent 能够长期、自主、高可靠地工作,避免漂移或崩溃。

OpenAI 将整个流程归结为一个循环:工程师 → 高层意图(declarative prompt) → Agent 在 Harness 内自主迭代 → PR + 自验证 → 人类仅在必要时介入。

核心组成部分

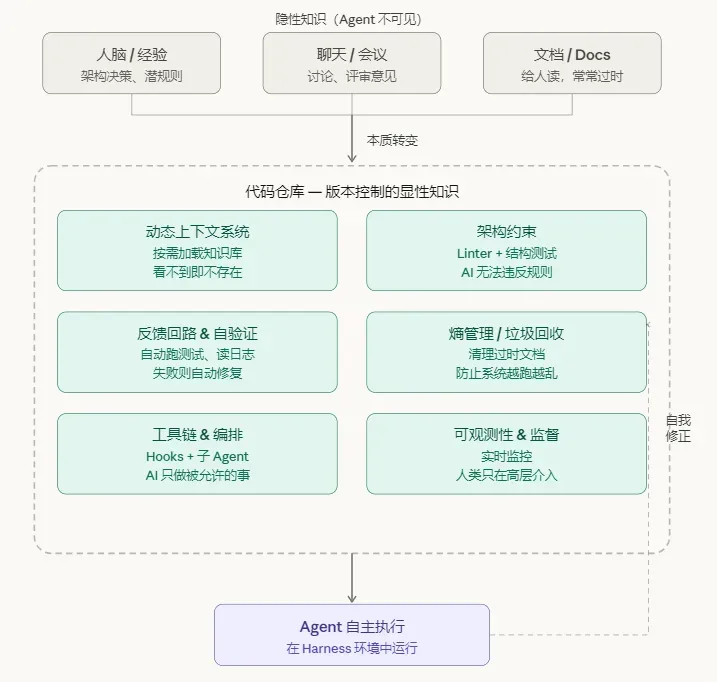

动态上下文系统

通过设计动态、按需加载的知识库与目录结构,实现信息的按需取用,避免上下文窗口爆炸。OpenAI 指出,Agent 在运行时无法感知的内容,对它来说等同于不存在。因此聊天记录、文档文件或人脑经验只有在进入代码仓库、被版本管理之后,才能真正参与 Agent 的决策。

架构约束

采用确定性规则(如 Linter、结构化测试、依赖方向强制)替代 Prompt 中的“软建议”,使 AI 无法违反架构设计。

反馈回路 & 自验证

Agent 每次行动后自动运行测试、读取日志、进行自我评审,失败时自动修复或向人类求助。

熵管理 / 垃圾回收

定期清理过时文档、发生漂移的架构和冗余代码,防止系统随时间变得混乱。

工具链 & 编排

精心设计的工具、钩子(Hooks)、子 Agent 编排,确保 AI 只能执行被允许的操作。

可观测性 & 人类监督

实时监控配合人类仅在高层意图和最终验收时介入。

传统工程中,知识分散在三个地方:

- 人脑 — 架构决策、隐含规则、“为什么这样设计”

- 聊天/会议 —— 讨论和评审意见

- 文档 — Notion、Google Docs(为人阅读准备,但常已过时)

这套体系对人类工程师勉强够用,因为人拥有记忆、能主动询问并思考。

Harness Engineering 带来的本质转变在于:

将“依赖人类交流与记忆维系的隐性知识” → 转变为“受版本控制、可重构、嵌入代码库的显性知识”。

实际案例

OpenAI 团队利用 Codex Agent 结合 Harness Engineering,在 5 个月内以完全零人工手写代码的方式,交付了一个超过 100 万行代码的生产级产品。人类工程师仅负责设计 Harness、定义意图、搭建反馈系统。

Anthropic 也在探索相似方向:针对跨多个上下文窗口的长时间运行 Agent,他们提出了重新设计的 Harness 结构——通过“初始化 Agent”预先设置环境和必要上下文,让后续的编码 Agent 在无记忆负担的状态下快速接手,类似于工厂换班时的交接文档。

随着基础模型趋向商品化,覆盖在模型之上的基础设施,如工具、上下文管理、反馈循环和编排系统,才是决定 AI Agent 能否在生产环境中成功的关键。

从“指令”到“环境”的三次跃迁

- 指令时代 ——人类是主人,AI 是工具:“你必须这样做,不能那样做” 提示词工程的本质是控制,担心 AI 跑偏。

- 对话时代 ——人类是主导者,AI 是协作者:“我们一起想想怎么做” 开始尊重 AI 的“判断力”,但人依然在场。

- Harness 时代 ——人类是环境设计者,AI 是执行者:“我把一切准备好,你出发” 人退到幕后,相信 AI 能自主完成。

- 未来?人类是受益者,AI 是主动者:AI 发现问题、提出方向、自我修正,人类只需关心结果,甚至无需理解过程。