动手学大模型:Dive into LLMs 中文开源教程全解析

终于有中文版了!Dive into LLMs 教程初体验

在 GitHub 上偶然看到 Dive into LLMs,收藏数已经冲到 32,245 颗星,今天又涨了 547 颗。好奇点进去一看,竟然是全中文的。

《动手学大模型 Dive into LLMs》

名字就说明了一切:聚焦实战,不是单纯的理论阅读。如果早一点遇到这个教程,当初自己在 LLM 学习路上至少能少走一半弯路。

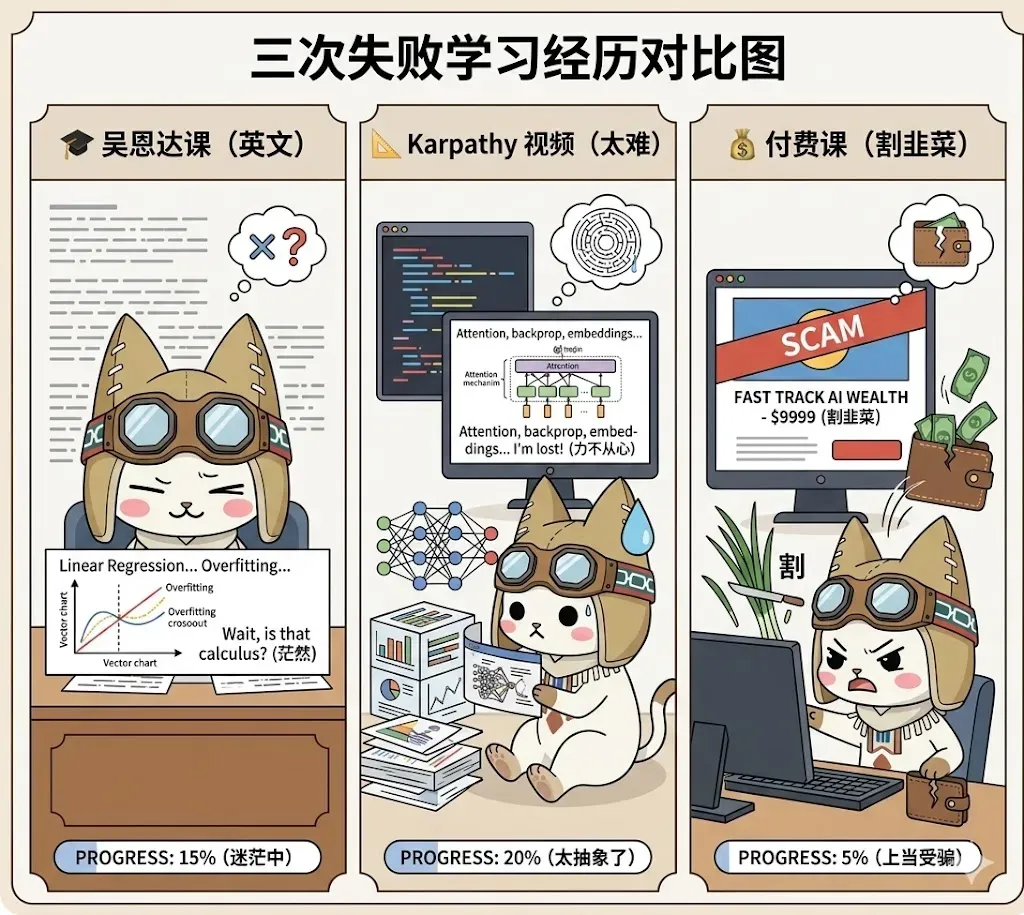

01 来时路:那些年踩过的坑

之前尝试过不少学习路线:

跟着吴恩达的课程走——课确实是好课,但对英语水平一般的同学极度不友好,机翻后的字幕诡异晦涩,体验感大打折扣。

啃 Andrej Karpathy 的视频——大神讲得固然深刻,但他默认你已经熟悉 PyTorch、微积分、线性代数。那种“这些东西难道还有人不会吗”的感觉,很容易让人心态崩溃。

购买付费课程——我一向支持知识付费,也愿意花钱请教前辈。然而后来发现,很多内容只是国外公开教程的汉化版,白白交了智商税。

这一次真的不同了。

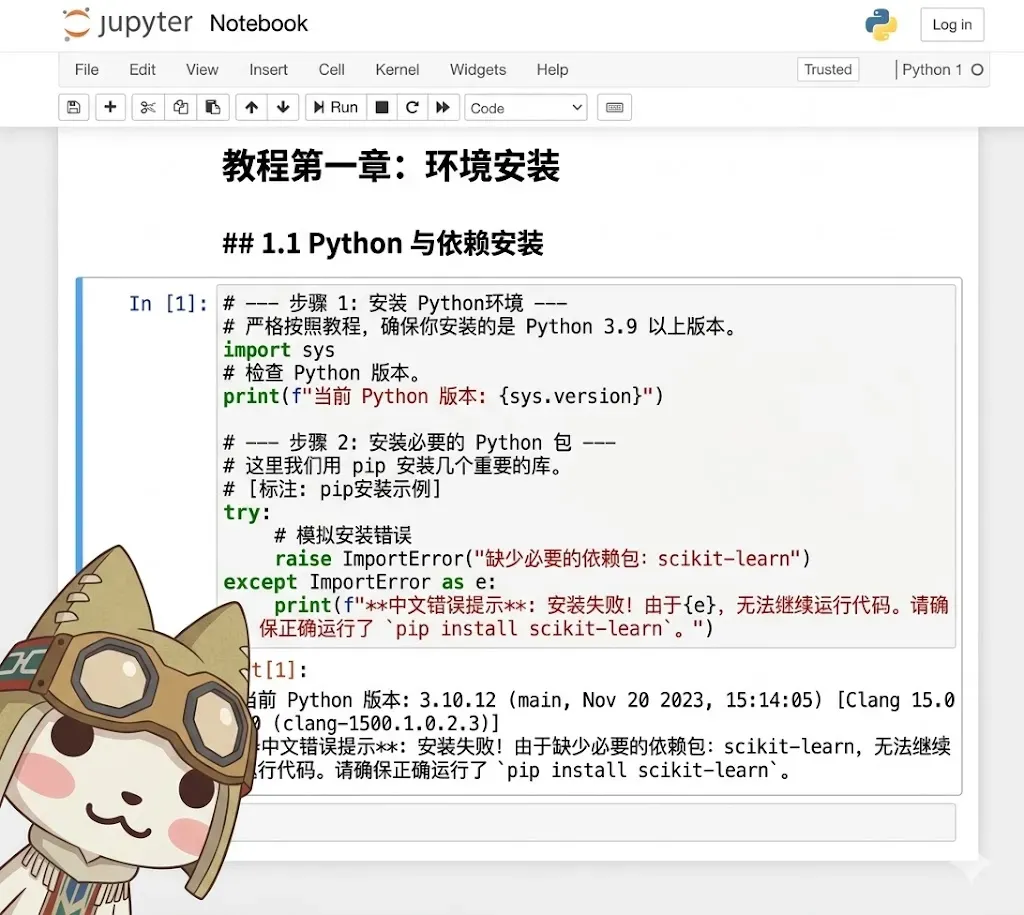

这个教程的第一节课在做什么?

教你装好 Python 环境,完完全全面向零基础新手。

一步步带你:安装 Anaconda、创建虚拟环境、配置 PyTorch。像一位耐心的前辈手把手陪你搞定所有前置依赖。

02 本土化:远不止翻译这么简单

真正跟过一遍教程后,才意识到它做了多少深度本地化工作:

代码注释是中文的

不再是“这个函数计算注意力”那样生硬的直译,而是真正帮助理解的说明:

# 计算注意力分数:Q 和 K 做矩阵乘法,除以 sqrt(d_k) 防止梯度消失

scores = torch.matmul(query, key.transpose(-2, -1)) / math.sqrt(d_k)

错误提示是中文的

遇到报错不用复制去 Google 翻译,直接就能读懂:

错误:CUDA 不可用,请检查是否安装了 GPU 版本的 PyTorch

示例数据也中文化了

别小看这些细节。英语基础差的同学不必再一边学技术一边辛苦翻译,可以把 100% 的注意力都放在内容理解上。隐性时间成本大幅降低。

03 它究竟好在哪里

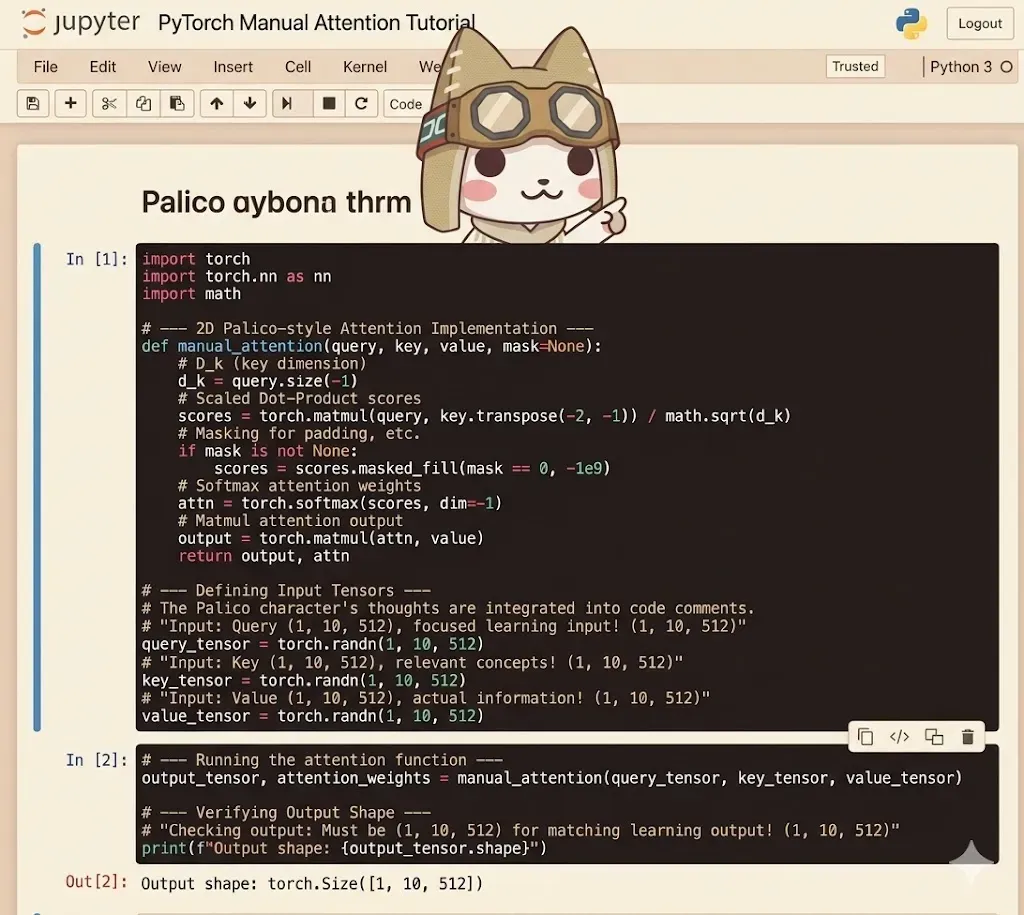

代码真正能跑起来,不是摆设。

很多教程里的代码复制下来根本跑不通,一看就是 AI 生成的。这个教程不同,照着复制就能直接运行。比如讲解 Attention 机制时,没有直接扔给你一堆公式,而是让你一步步写出函数:

def manual_attention(query, key, value, mask=None):

scores = torch.matmul(query, key.transpose(-2, -1)) / math.sqrt(d_k)

if mask is not None:

scores = scores.masked_fill(mask == 0, -1e9)

attn = torch.softmax(scores, dim=-1)

output = torch.matmul(attn, value)

return output, attn

输入 (1, 10, 512),输出也保持 (1, 10, 512)。

亲手跑通的那一刻,才真正理解 Q、K、V 究竟在干什么。

它不止告诉你怎么做,还会解释为什么。

为什么 Attention 要除以 sqrt(d_k)?(防止梯度消失)

为什么用 LayerNorm 而不是 BatchNorm?(序列长度不固定)

为什么学习率需要 warmup?(前期训练不稳定)

一旦吃透这些“为什么”,知识才会真正长在脑子里。

完全开源,免费就能学到。

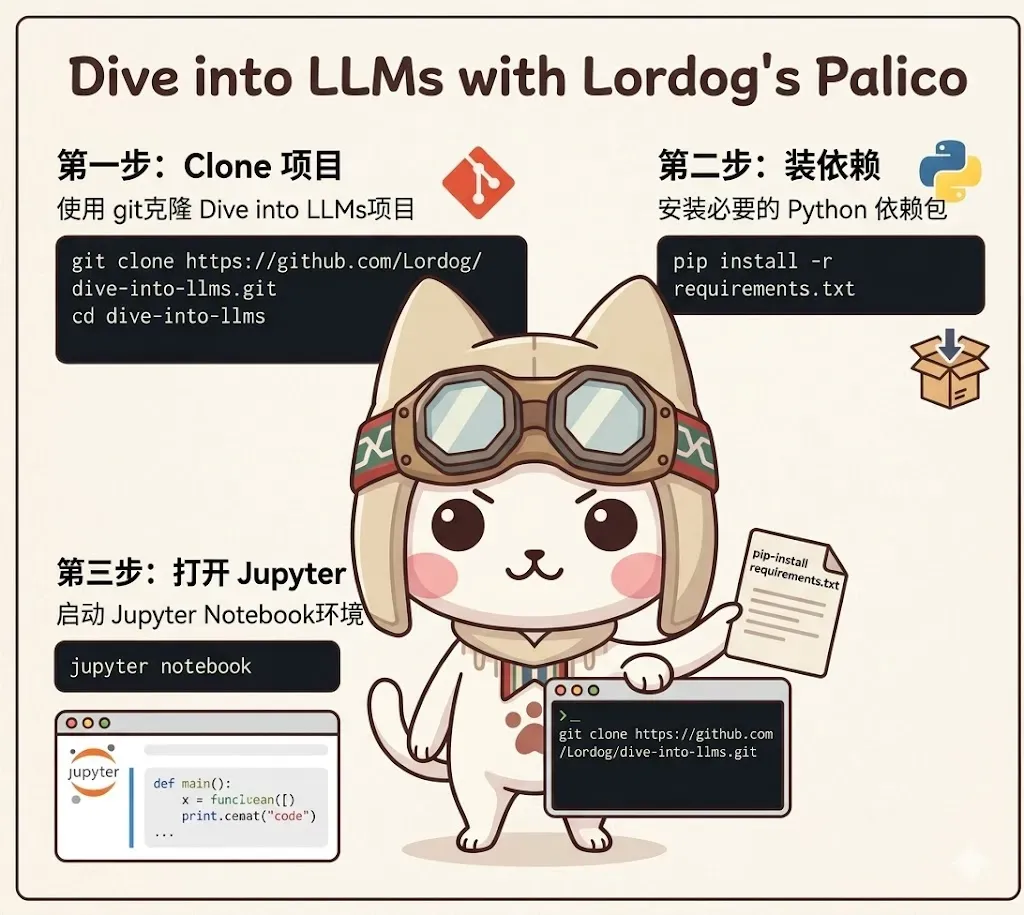

04 三步即刻开始动手

第一步:克隆项目

git clone https://github.com/Lordog/dive-into-llms.git

cd dive-into-llms

第二步:安装依赖

pip install -r requirements.txt

第三步:启动 Jupyter

jupyter notebook

请记住:不要只盯着屏幕看,每一段代码都要亲手敲一遍。

遇到弄不明白的地方,多运行几次,仔细观察输入和输出的变化。

学完一章后,主动尝试修改代码,看看效果会怎样。

不用着急,慢慢来,反而是最快的路。

把项目克隆下来,跑通第一个 notebook。

只要跑通了,你就算真正入门了。

写在最后

靠谱的教程真的值得让更多人知道,尤其是发布在开源平台上的优质中文内容。

想学 LLM 的同学终于不用再反复踩坑了。

以前,英文教程看不懂、中文教程太浅显、付费课程又多割韭菜。现在有这么一门系统又贴心的中文教程,完全开源免费,实在是一种幸福。

如果你也觉得这个项目不错,不妨给它一颗 star。

哪怕现在暂时不学,留下 star,以后想找的时候也能轻松找到。

📌 项目地址: https://github.com/Lordog/dive-into-llms