基于NAS搭建Frigate智能监控中心:本地AI识别、全功能配置与性能优化全攻略

在智能家居和安防领域,将视频数据上传至云端进行分析和处理是常见做法,但这往往伴随着隐私泄露的风险。有没有一种方案,既能享受AI智能识别的便利,又能将数据牢牢掌握在自己手中?Frigate正是为此而生的开源利器。

Frigate是一款基于实时AI目标检测技术的开源网络录像机(NVR)。它的核心理念是隐私优先:所有的视频分析过程都在您的本地设备(如NAS)上完成,摄像头画面数据无需离开您的网络,从根本上保障了数据安全。

下面我们来详细了解一下它的核心能力:

- 深度集成:作为Home Assistant生态的明星组件,它能与您的智能家居系统深度联动,实现检测到“人”自动开灯等复杂自动化场景。

- 高效智能:它并非傻傻地分析每一帧画面,而是结合“运动检测”和“区域检测”等智能策略,只在必要时启动AI分析,极大提升了资源利用效率。

- 实时优先:采用多进程架构,优先保障实时视频流的流畅性,确保监控画面无延迟。

- 精准触发:使用计算开销极低的像素变化检测技术,快速定位画面中的动态区域,再交由AI进行识别,既快又准。

- 独立推理:AI物体检测任务运行在独立的TensorFlow进程中,与其他视频处理任务互不干扰,追求最高的帧处理速度。

- 开放通信:通过MQTT协议发布检测事件,轻松与Node-RED、Home Assistant等各类自动化平台集成。

- 智能存储:可以基于检测到的物体类型(如人、车、宠物)设定不同的录像保留策略,例如“人”的事件保留30天,“车”的事件保留7天,有效管理存储空间。

- 7x24小时录制:支持不间断的连续视频录制,不错过任何重要时刻。

- 流媒体优化:通过RTSP重新流转技术,Frigate作为中间代理,只需与摄像头建立一个连接,然后分发给多个客户端,有效减轻摄像头负载。

- 超低延迟观看:支持WebRTC和MSE技术,在网页端观看实时监控画面时,延迟可以低至毫秒级,体验远超传统方案。

您可以通过其官方演示站点直观感受这些功能:https://demo.frigate.video

安装部署指南

推荐使用Docker Compose进行部署,这是管理容器依赖和配置最清晰的方式。以下是一份适用于大多数场景的基础配置示例,您可以将其保存为 docker-compose.yml 文件。

services:

frigate:

image: ghcr.io/blakeblackshear/frigate:stable

container_name: frigate

ports:

- 8971:8971

- 8554:8554

- 8555:8555/tcp

- 8555:8555/udp

environment:

- FRIGATE_RTSP_PASSWORD=password

- TZ=Asia/Shanghai

volumes:

- ./storage:/media/frigate

- ./config:/config

- /etc/localtime:/etc/localtime:ro

devices:

- /dev/dri/renderD128:/dev/dri/renderD128

restart: unless-stopped

关键参数解析(更多高级参数请务必查阅官方文档):

- 8971端口:HTTPS访问端口,用于管理员登录Web管理界面。

- 5000端口(可选):HTTP访问端口,通常用于无需密码的公开流(如投屏到电视),默认未映射,可按需添加。

- 8554端口:Frigate输出的RTSP流端口,可供VLC等播放器或其它NVR软件调用。

- 8555端口:WebRTC流端口,是实现超低延迟网页观看的关键。

- FRIGATE_RTSP_PASSWORD:设置访问Frigate自身RTSP流所需的密码。

- TZ:设置容器时区,确保录像文件时间戳正确。

- /media/frigate:录像文件存储目录,映射到本地的

./storage文件夹。 - /config:配置文件及SQLite数据库存储目录,映射到本地的

./config文件夹。 - /etc/localtime:将宿主机的时区文件挂载到容器内,是保持时间同步的另一种可靠方式。

- /dev/dri/renderD128:映射Intel核显设备,为后续启用硬件加速做准备(AMD/NVIDIA显卡路径不同)。

基本使用与配置

使用 docker-compose up -d 启动服务后,在浏览器中输入 https://您NAS的IP地址:8971 即可访问Frigate的Web管理界面(请注意必须使用HTTPS协议)。

首次登录:Frigate在首次启动时会自动生成一个随机的管理员账户和密码。您需要通过查看容器日志来获取它们。

docker logs frigate

在输出的日志中,寻找包含“Username”和“Password”字样的行。

使用日志中显示的用户名和密码完成登录。

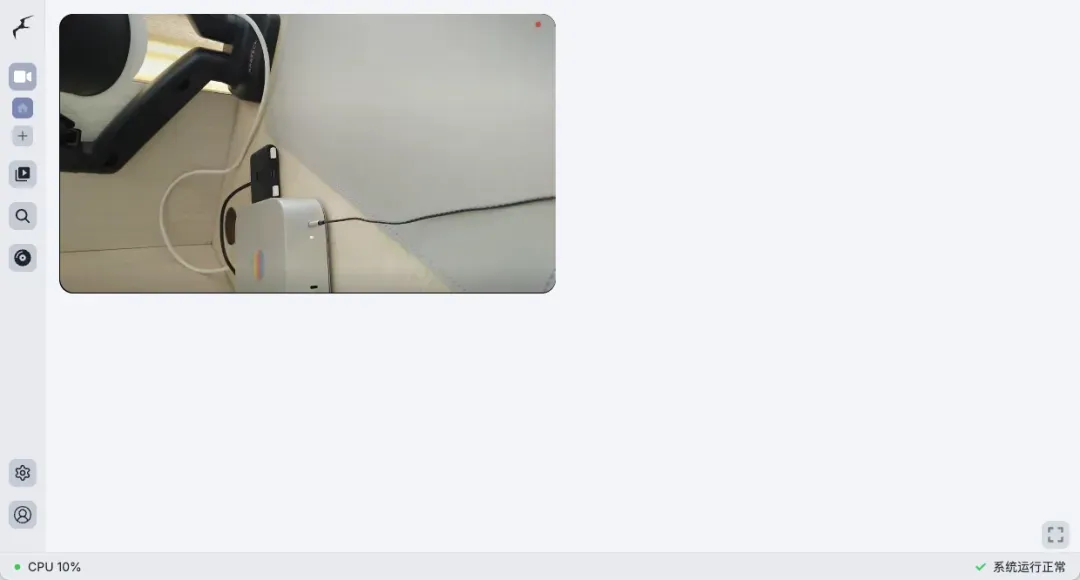

登录成功后,您会进入主面板。由于尚未添加任何摄像头,界面会显得比较空旷。

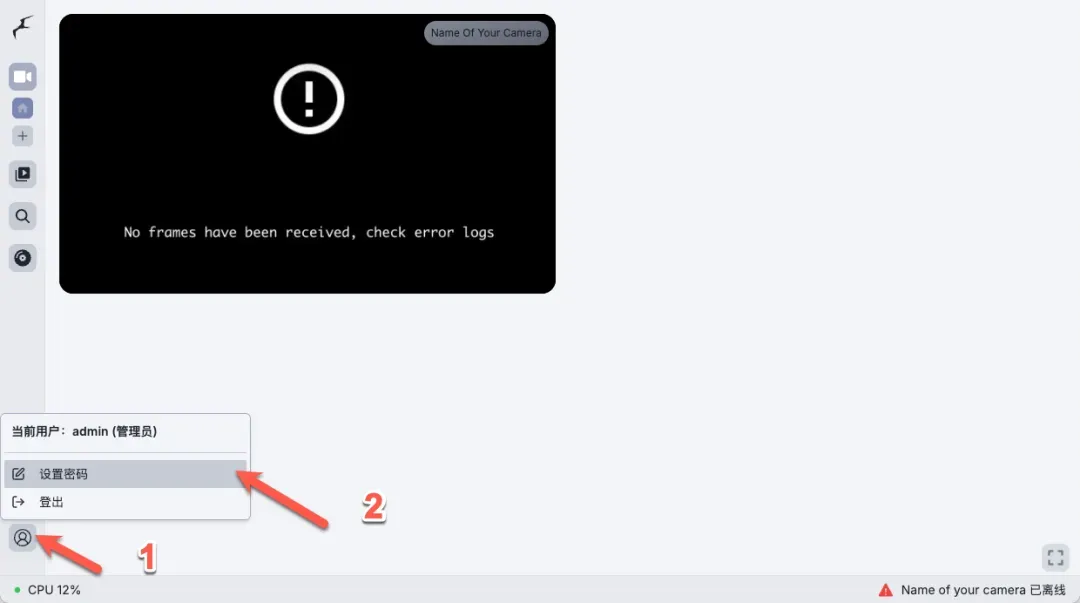

首要安全操作:出于安全考虑,登录后第一件事就是修改默认密码。点击界面左下角的用户名,进入用户设置页面即可更改密码。

接下来,我们将介绍核心功能的配置方法。Frigate功能强大,配置灵活,强烈建议您将官方文档作为主要参考。

添加并配置摄像头

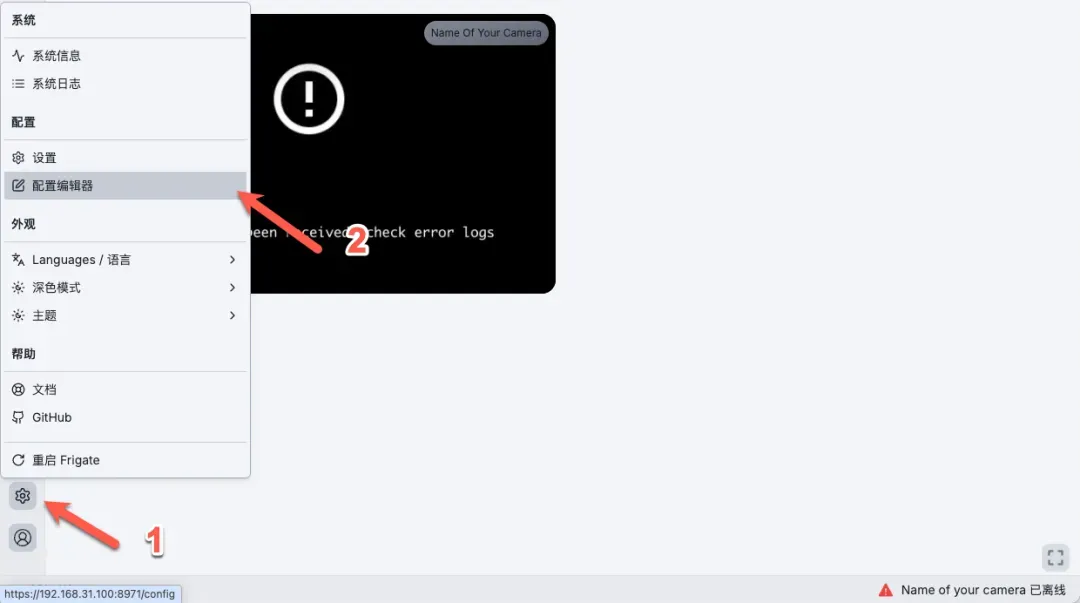

所有配置都在YAML文件中完成。点击左下角的“设置”齿轮图标,选择“配置编辑器”,即可进入编辑界面。

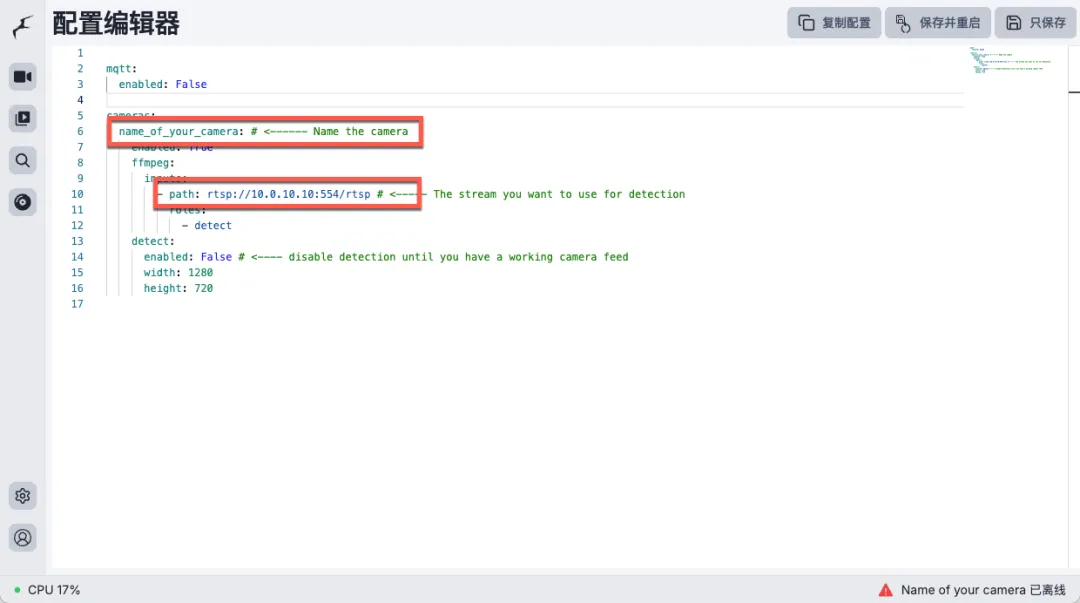

配置结构须知:YAML配置采用层级结构。顶层的指令是全局配置,对所有摄像头生效;而放在特定摄像头(cameras)键下的指令,则只作用于该摄像头。这种设计让配置既统一又灵活。

初始配置文件非常简洁。添加一个摄像头,最核心的就是两件事:给它起个名字,并告诉Frigate视频流在哪里。

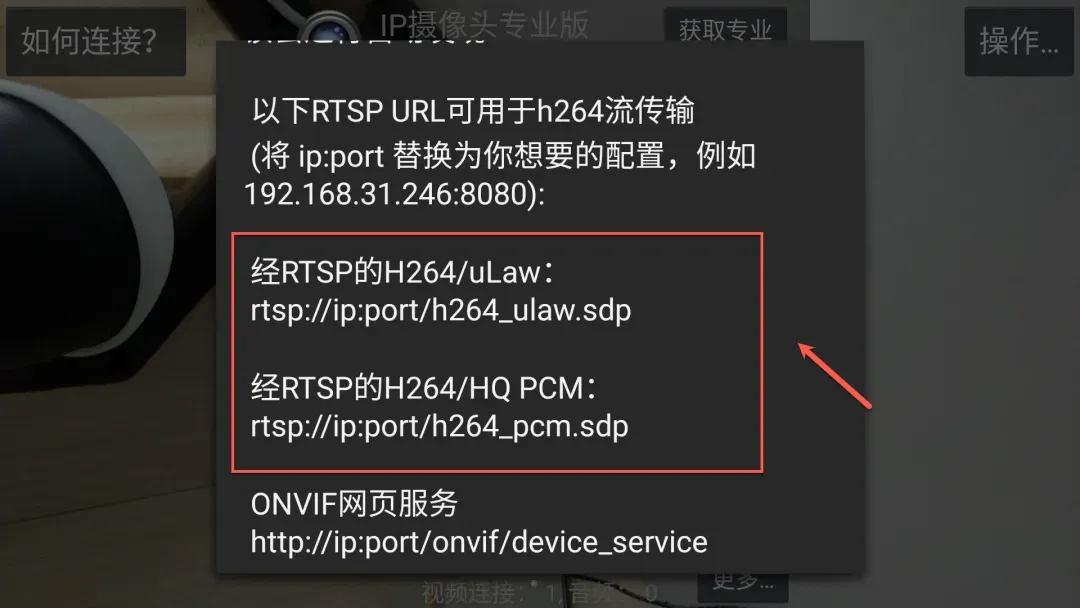

获取RTSP地址:这是关键一步。您需要知道摄像头的RTSP流地址。对于主流品牌网络摄像头(海康、大华、TP-Link等)或手机IP摄像头APP(如IP Webcam),通常都能在设置中找到。通用格式如下:

rtsp://用户名:密码@摄像头IP地址:端口/视频流路径

例如:rtsp://admin:123456@192.168.1.100:554/stream1

在配置编辑器中,在 cameras: 键下添加您的摄像头配置,例如:

cameras:

living_room: # 自定义摄像头名称,建议使用英文和下划线

ffmpeg:

inputs:

- path: rtsp://your_camera_stream_url # 请替换为您的真实RTSP地址

roles:

- detect # 用于AI检测的流

- record # 用于录像的流

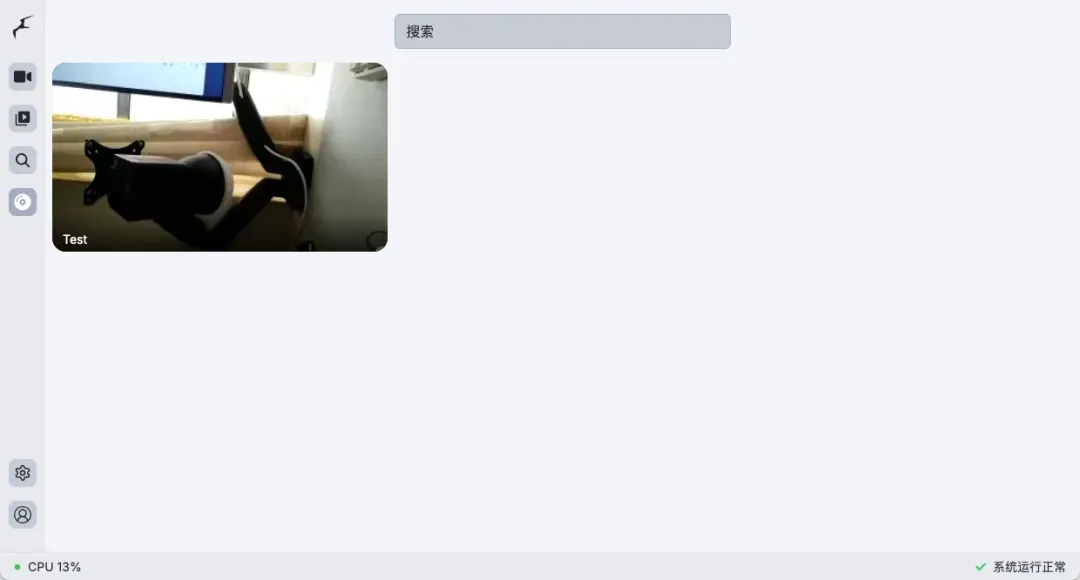

保存配置并重启Frigate服务(或在配置编辑器页面点击“重启”)后,主界面就会显示该摄像头的实时画面了。

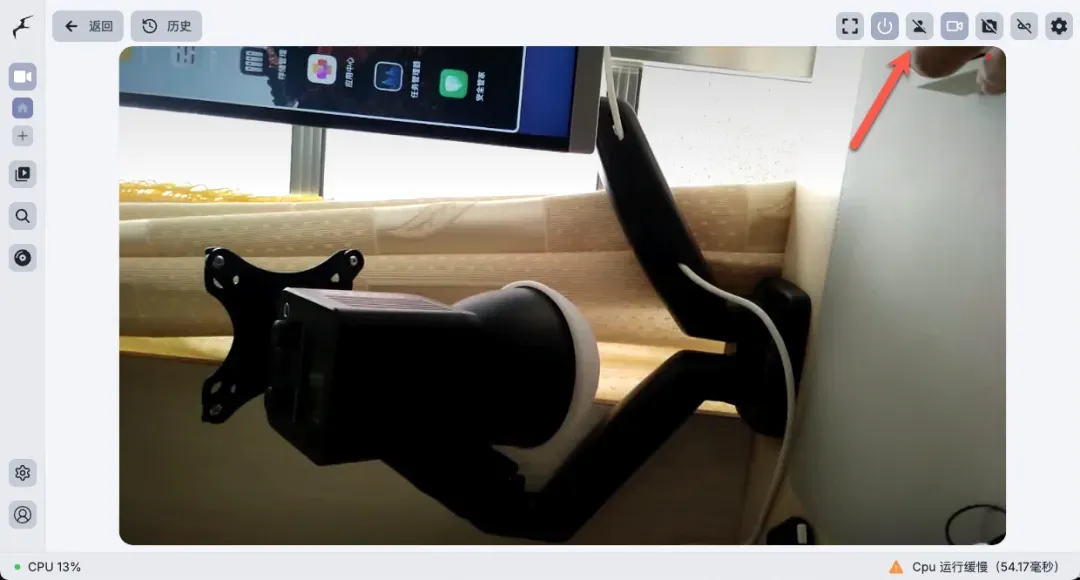

点击任意摄像头画面,即可进入全屏模式进行详细查看。

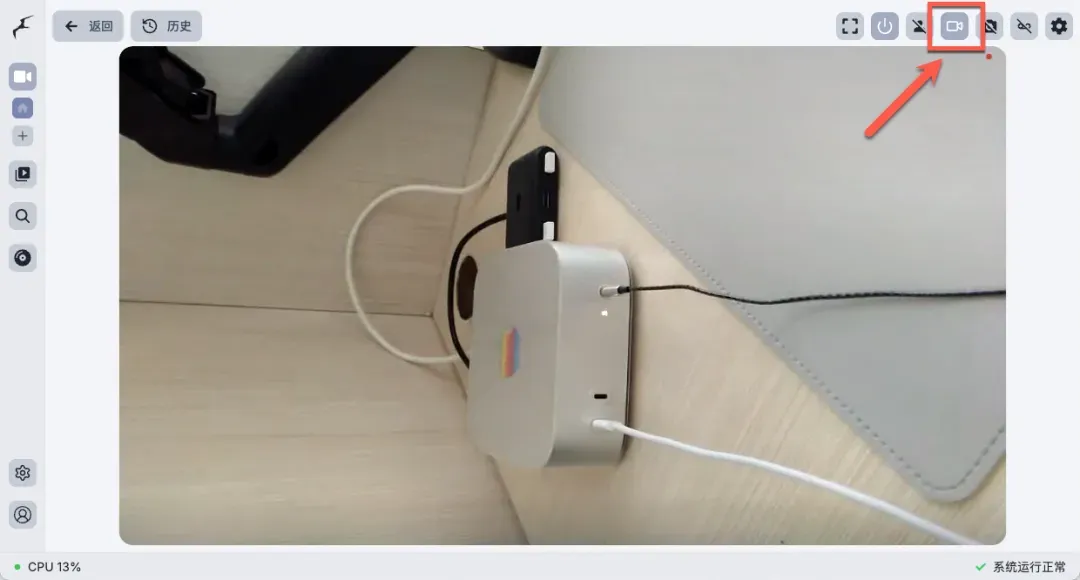

启用视频录制功能

默认配置可能没有开启录像。要启用它,您需要在对应摄像头的配置中,像上面示例一样,在 inputs 的 roles 里包含 record。保存重启后,在监控画面右上角可以看到录制开关已经亮起。

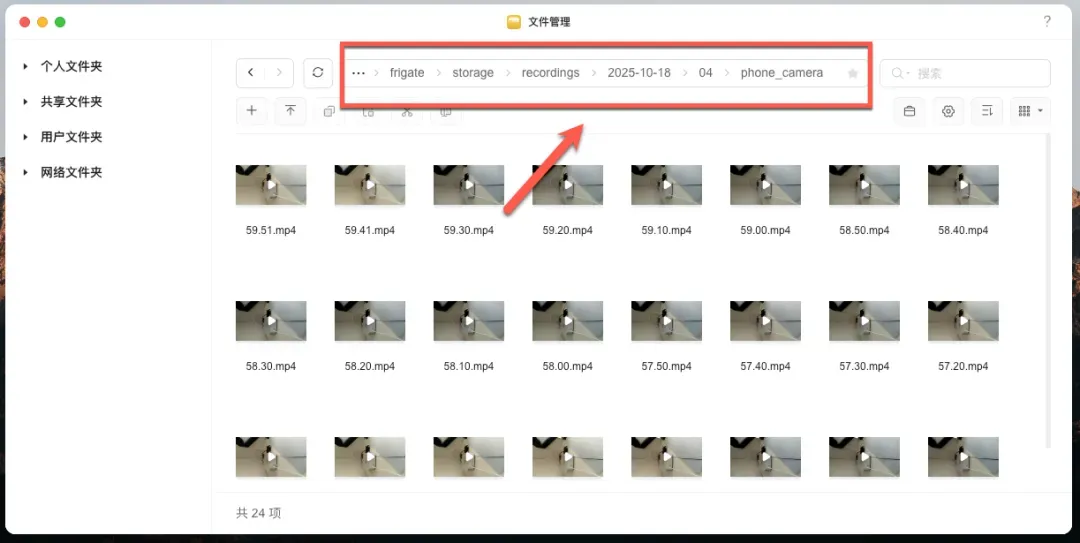

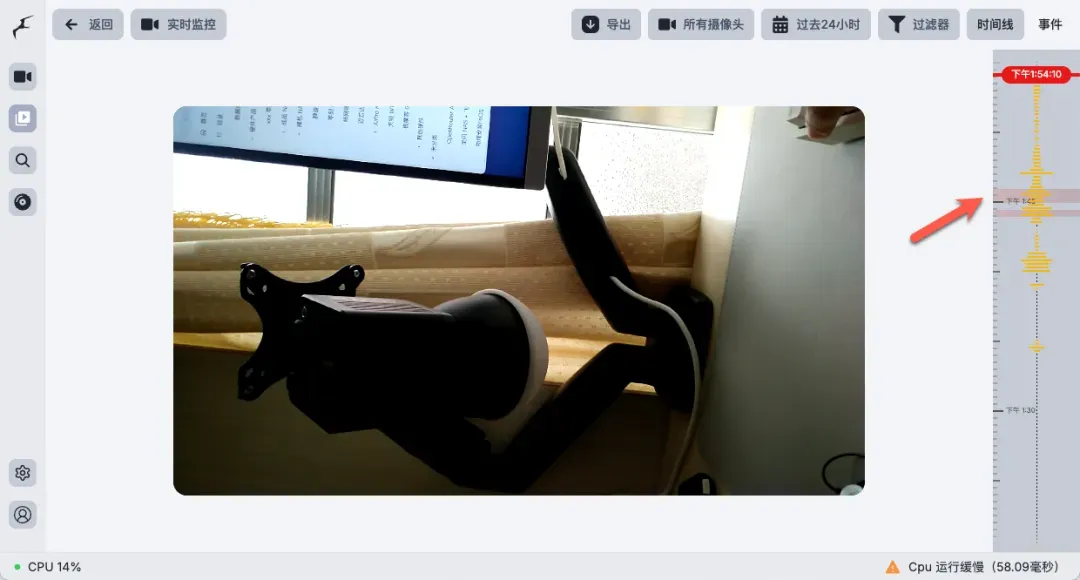

点击“历史”按钮,页面右侧会出现一个时间轴,您可以方便地浏览和跳转到任意时间点的录像。所有录像文件都存储在之前Docker Compose配置中映射的 ./storage 目录下,按日期和摄像头名称分文件夹存放。

配置AI物体检测与识别

默认情况下,物体检测功能可能是关闭的。最快捷的开启方式是在摄像头实时画面的工具栏上,直接点击“检测”开关。

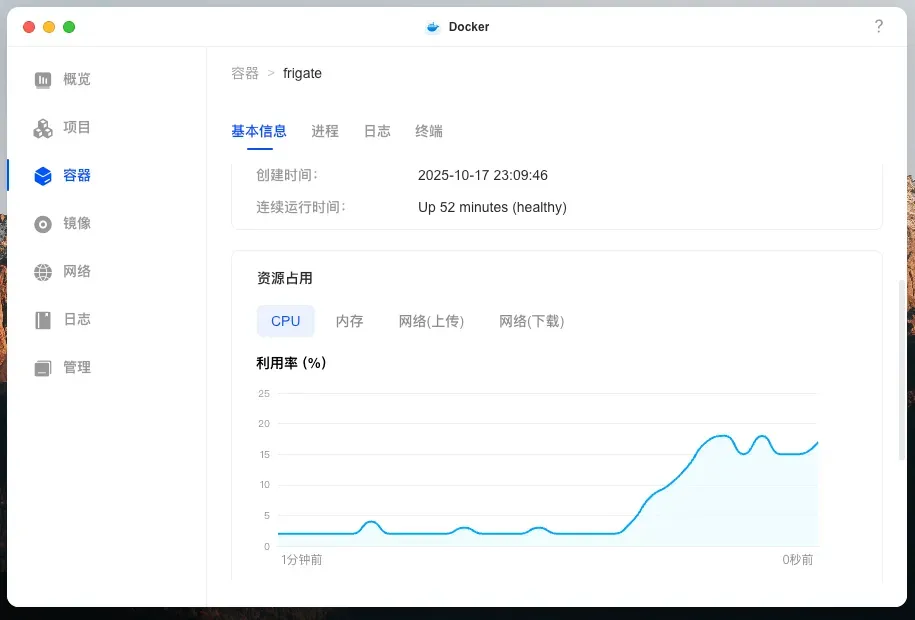

开启后,当画面中有物体(如人、车、狗)移动时,系统会用彩色方框将其标识出来。此时,您的CPU或GPU将开始进行AI推理运算。如果仅使用CPU,资源占用会非常明显。

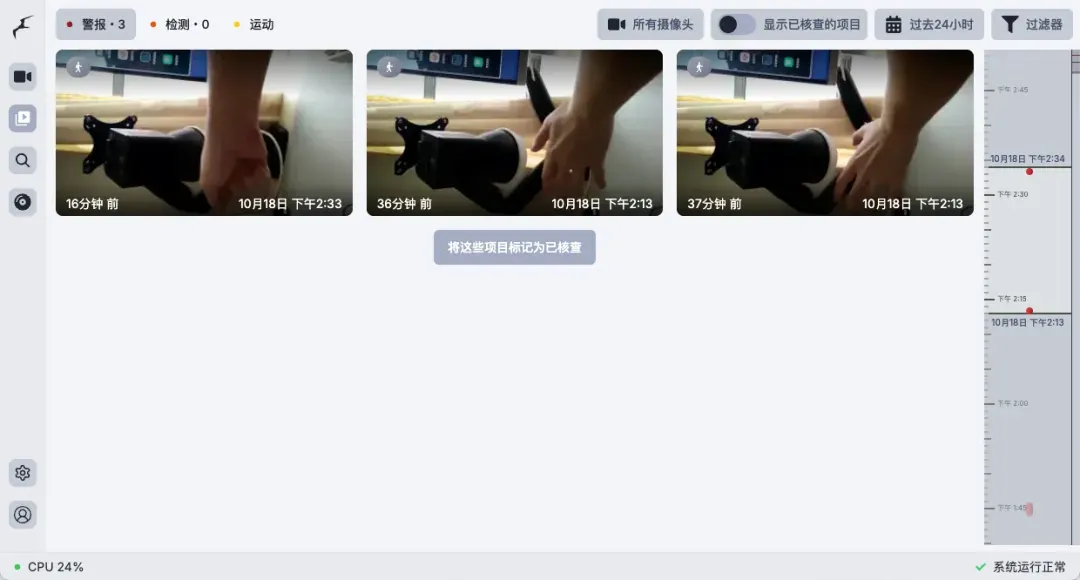

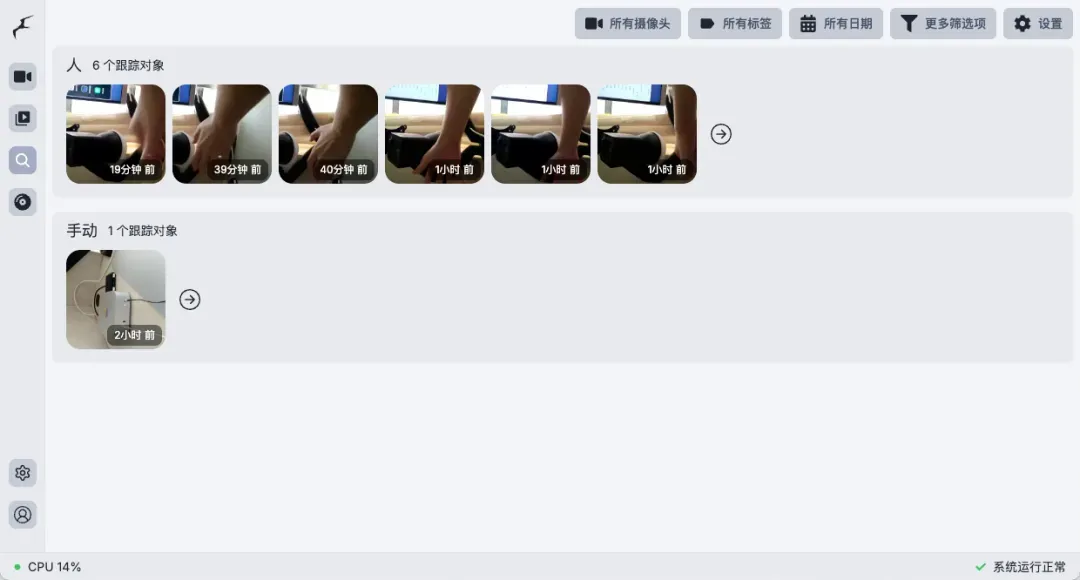

在“历史”视图的时间轴上,检测到事件的时间段会用红色高亮标记。切换到“事件”选项卡,则可以查看所有被触发事件的快照截图,方便快速回顾。

如果您希望默认开启检测,或者需要进行更精细的控制(如设置检测区域、调整置信度阈值、过滤特定物体类型),则需要在配置文件的 detect: 部分进行详细设置。

性能优化关键:启用硬件加速

纯CPU进行AI检测和视频编解码对性能消耗巨大,延迟也高。启用硬件加速是提升体验、降低NAS负载的必由之路。优化主要分两方面:

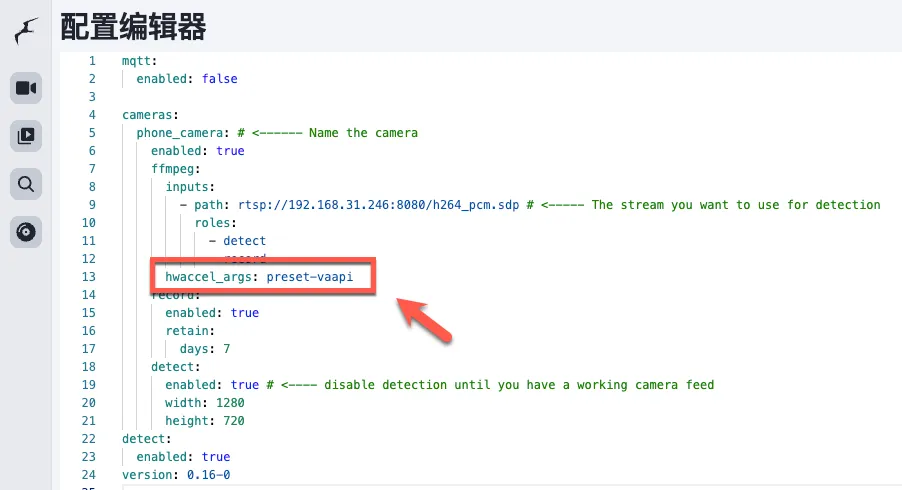

-

视频解码/编码加速:在摄像头的

ffmpeg配置中,添加hwaccel_args参数,将视频流的解码/编码工作卸载到GPU。根据您的硬件选择对应的预设(如Intel用preset-vaapi,NVIDIA用preset-nvidia)。ffmpeg: hwaccel_args: preset-vaapi # 示例:使用Intel VAAPI硬件加速 inputs: - path: rtsp://...

-

AI推理加速:这是降低CPU占用的核心。通过配置不同的

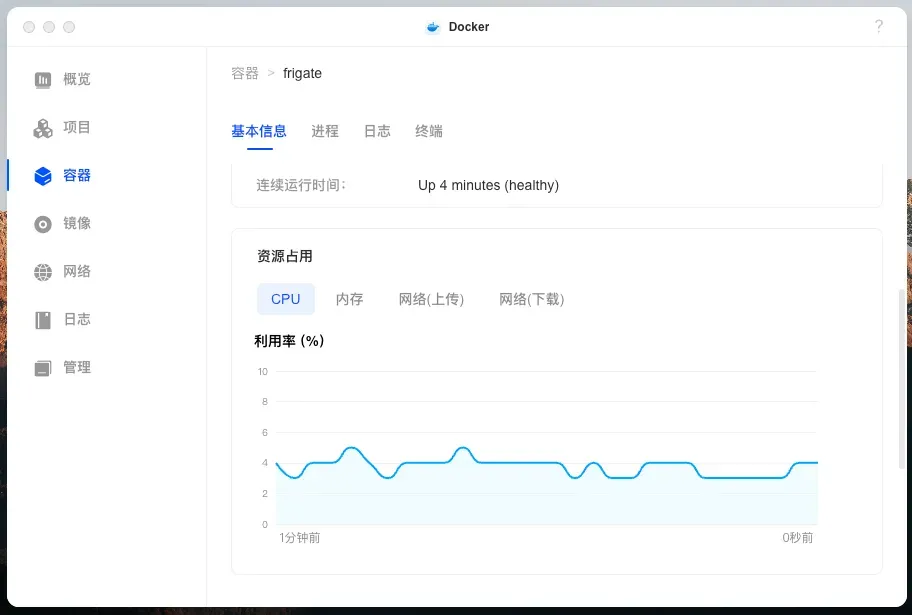

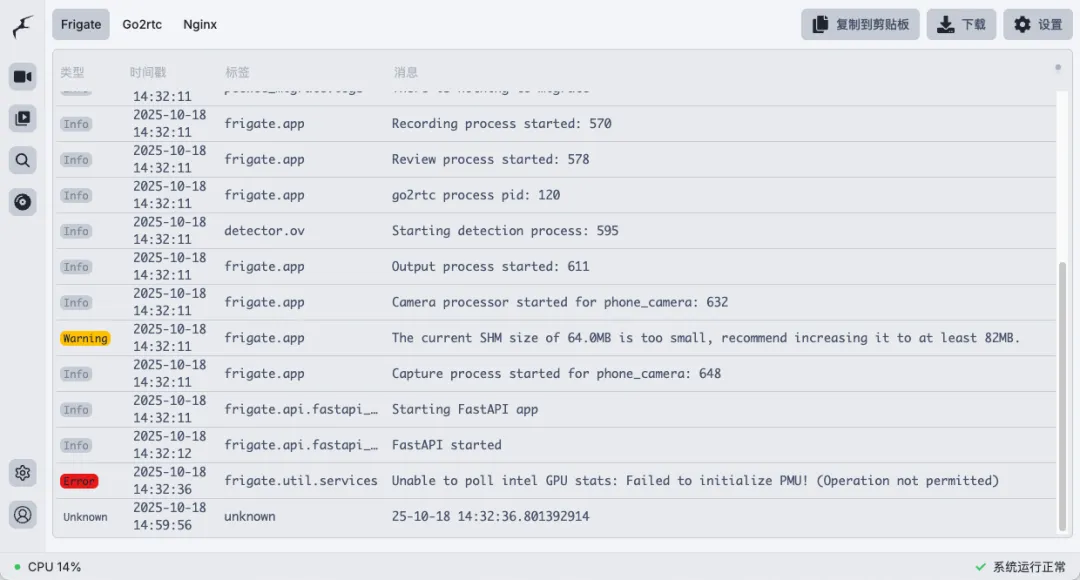

detectors(检测器),将AI模型推理任务也交给专用硬件。例如,使用OpenVINO检测器来调用Intel集成显卡或独立显卡进行推理:detectors: ov: # 检测器名称 type: openvino device: GPU # 指定使用GPU,也可用CPU、MYRIAD(神经计算棒)等 model: # 指定使用的AI模型 width: 300 height: 300 input_tensor: nhwc input_pixel_format: bgr path: /openvino-model/ssdlite_mobilenet_v2.xml labelmap_path: /openvino-model/coco_91cl_bkgr.txt正确配置硬件加速后,系统监控中可以看到CPU占用率大幅下降,而GPU开始工作。

其他功能概览

除了核心的监控、录像和检测功能,Frigate的Web界面还提供了许多实用的管理工具:

- 事件核查:回顾AI检测到的事件,可以进行确认、打标签或删除误报,帮助系统学习。

- 录像浏览与导出:直观的时间轴界面,支持快速剪辑和导出特定时间段的录像片段。

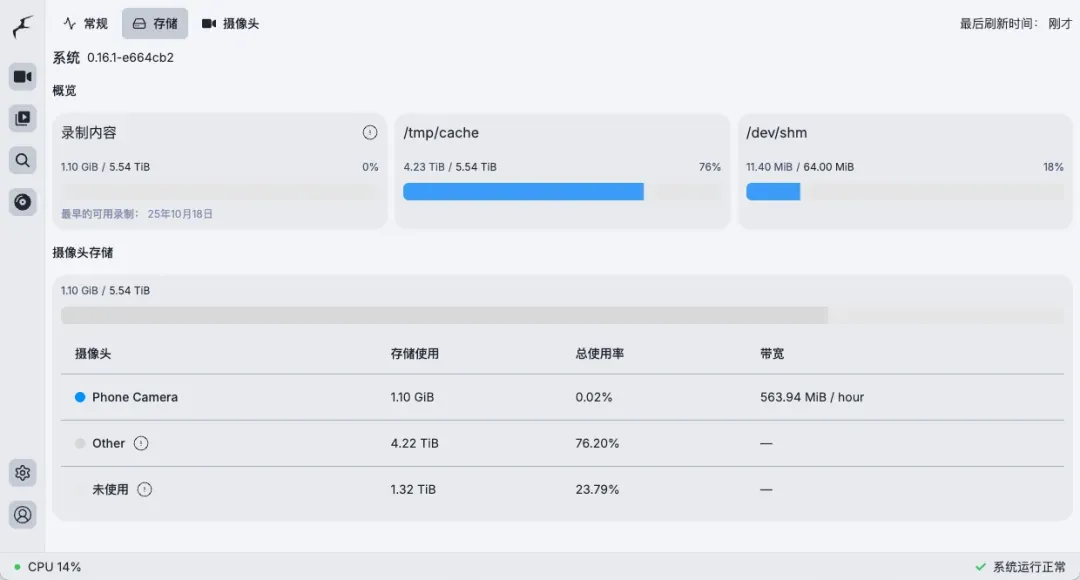

- 详尽系统信息:全面监控系统运行状态,包括CPU/内存使用率、存储空间、每个摄像头的码流信息、检测帧率等,是性能调优的好帮手。

- 系统日志:集成日志查看器,方便在出现问题时进行排查。

总结与评价

作为一款久经考验的开源NVR解决方案,Frigate在实际使用中表现出了极高的成熟度和可靠性。它的核心魅力在于完全本地的AI目标检测、无与伦比的可定制性以及与Home Assistant生态的深度集成,堪称注重数据隐私和热爱智能自动化玩家的梦想工具。

当然,它也有其“硬核”的一面:主要配置依赖于编辑YAML文件,这对新手来说确实存在一定的学习曲线。如果能增加图形化的配置向导,无疑会吸引更多普通用户。此外,要想流畅使用其AI检测功能,合理配置硬件加速不是可选,而是必需,这需要用户对自己的硬件有一定了解。

总而言之,对于希望在家庭、工作室或小型商业场所构建一个智能化、私有化、高可控性监控中心的朋友来说,Frigate是一个功能强大、值得深入研究的优秀选择。

综合推荐指数:⭐⭐⭐⭐☆(四星半,特别适合注重隐私与智能检测的进阶用户) 功能体验:⭐⭐⭐⭐⭐(功能全面,AI检测精准,自动化潜力巨大) 部署难度:⭐⭐⭐(需要熟悉Docker及YAML配置,有一定门槛,但社区资源丰富)