2026年OpenClaw AI树莓派实战指南:自主机器人集成与自动化前景

当价格亲民的单板计算机与高度自主的人工智能代理相遇,会擦出怎样的火花?答案正孕育于日益壮大的 OpenClaw AI 树莓派集成生态中。本文将系统拆解这一技术栈,盘点最具代表性的硬件产品,提供从零搭建的操作指引,并深度解读其对开发者及企业的战略意义。

解密 OpenClaw AI 树莓派平台

OpenClaw AI 树莓派方案,是指在树莓派微型计算机(通常为 Pi 4 或 Pi 5)上部署 OpenClaw AI 框架。这究竟能为普通用户与开发者带来哪些改变?

核心框架

OpenClaw 是一款采用 MIT 许可证的开源个人 AI 助手运行时。与传统仅输出文本的云端聊天机器人截然不同,它是一个能够执行实际操作的 AI 代理:可以运行终端命令、管理文件、发送邮件,并借助 Telegram、WhatsApp 和 Discord 等平台自主运转(来源:2026年2月24日09:15)。

为何选择树莓派?

将这类自主 AI 部署在树莓派上,相当于把推理与任务执行迁移至低成本的本地设备。这种做法彻底摆脱了对云服务的强依赖,极大压缩了物理硬件控制的延迟,并从根本上保障了数据隐私。配备 8.00 GB 内存的树莓派 5 被视为承载这一方案的理想环境,能够让 AI 以守护进程的方式全天候后台运行。

例如,即将面世的 OpenClaw 迷你 AI 主机 ED‑CLAWBOX,专门为 OpenClaw 端侧私有化部署量身打造。整机采用铝合金 CNC 加工外壳,精致小巧(100×100×19 mm),重量仅有 247 克。接口方面十分齐全:双 HDMI 输出(标准 + Micro)、千兆以太网、双频 Wi‑Fi/蓝牙 5.0、USB 3.0 接口等。设备预装了极术社区开源的 JishuShell 管理面板,无需繁琐配置,数分钟内即可获得一个完全本地化、数据私有的 AI 工作站。无论是开发调试、多任务并行处理,还是需要 7×24 小时稳定运行的场景,ED‑CLAWBOX 都凭借低功耗、高性能以及完整的树莓派生态兼容性,成为探索 AIoT 应用的理想硬件基石。

2026年最新Claude Code国内安装全攻略:零门槛接入国产免费模型,无需魔法即装即用

前段时间有个朋友突然找我。

“我好想用Claude Code,可死活装不上,你能帮我看看吗?”

我问卡在哪一步,他说打开那个黑色的窗口,照着输了一行命令就报错,完全看不懂什么意思,然后就把窗口关了。

我远程帮他折腾了一会儿,装好之后他立刻开始用,兴奋得不行。

挂掉电话之后我就想,可能很多人都卡在这一步。不是不想用,而是那个黑色窗口一出现就让人心里打退堂鼓。

今天把整个安装过程完完整整写清楚,哪怕你一行代码都没写过,照着做也能顺利装好。

01

再次认识Claude Code:它到底能帮你做什么

1、先别把它当成程序员的专属工具

很多人一听到Claude Code,下意识就觉得这是写代码的人才用的东西,跟自己没关系。

这个误解其实挡掉了不少人。

做内容的朋友:直接说清楚你的需求,它就能给你生成完整的文章。我平时借助它来写公众号初稿,一篇20分钟就能搞定。

做运营的朋友:每周都要整理周报,用它能五分钟就跑完数据汇总,空出来的时间就可以去做真正需要判断和决策的事。

想做副业的朋友:只要描述清楚想要什么样的小工具,几分钟就能给你一个直接可用的成品。不会写代码完全没关系。我帮那个朋友做的第一个工具,就是一个自动整理文件名的脚本,他现在每天还在用。

2、在国内根本用不了?这个认知一样害了很多人

不少人觉得Claude Code在国内没法用,原因是Claude本身在国内打不开。

但这个想法其实并不准确。

Claude Code本质上是一个Agent框架,打个比方,它就是一个工具的“壳子”。这个壳子可以装载各种“大脑”,也就是说,可以接入国内的模型,比如DeepSeek、GLM、Kimi,只要接上,我们照样能正常使用。

所以,国内用户完全可以先把框架装好,然后接一个国产的免费模型,整个工具就跑起来了。梯子、国外手机号、Visa卡这些统统都不需要。

02

一步步安装Claude Code

第一步:安装Git(打好基础)

这里以Windows系统为例来介绍。

Git是Claude Code正常运行的前提条件,如果没装,直接就会报错。

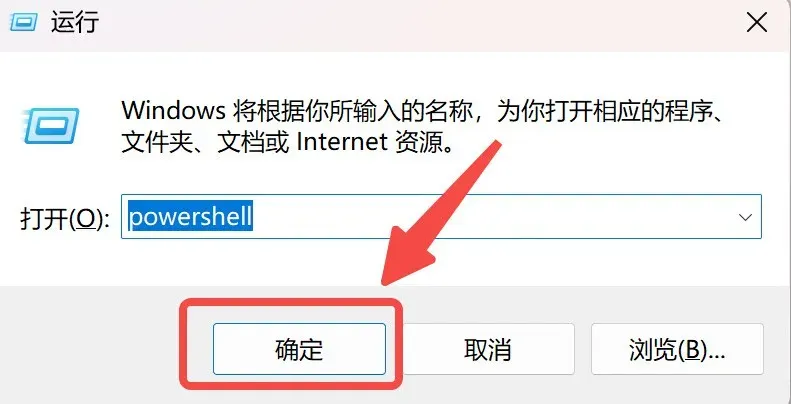

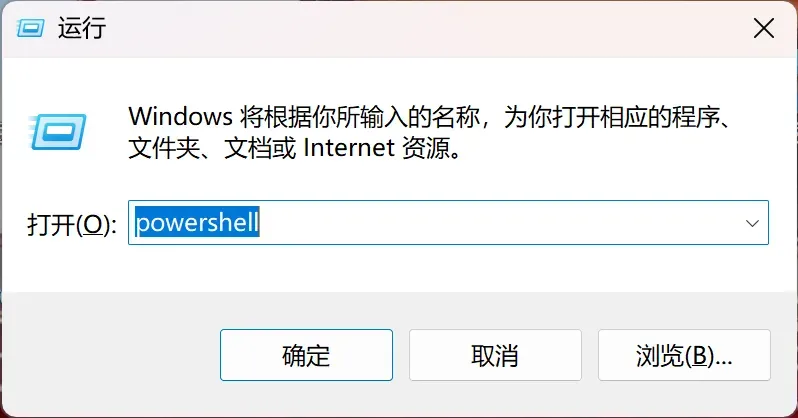

先按“Win+R”调出任务栏搜索框,输入“powershell”,打开Windows PowerShell。

接着,粘贴下面这行命令,然后回车:

winget install Git.Git

等它跑完,显示安装成功就可以了。

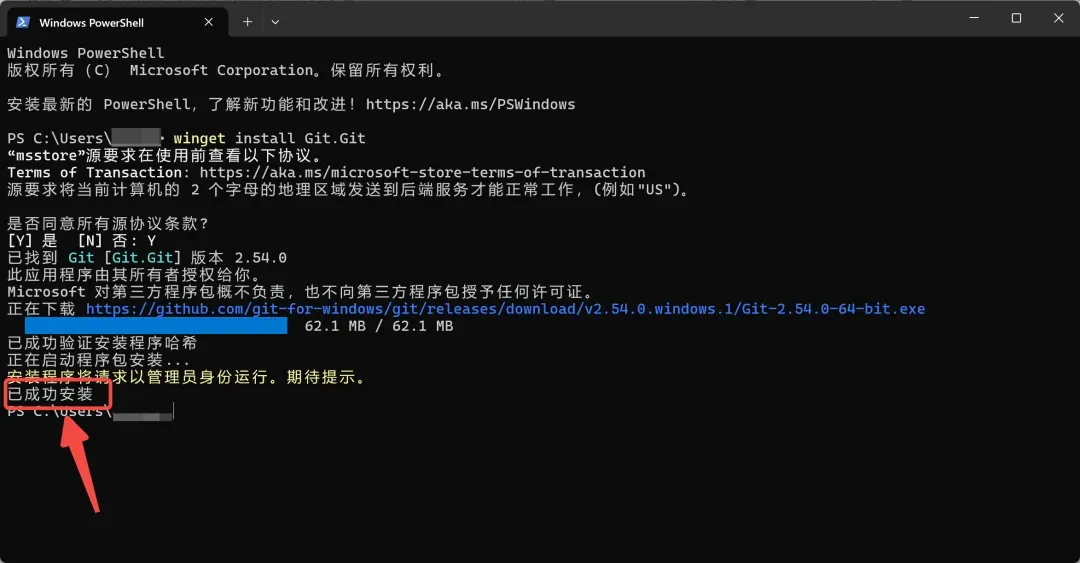

第二步:装Claude Code框架(把“壳子”装好)

Git装好之后,继续在PowerShell里粘贴下面这行命令,回车:

winget install Anthropic.ClaudeCode

安装完成后,输入claude,如果能正常显示界面,就说明成功了。

第三步:接入免费的大脑(真正让它动起来)

框架有了,还需要给它配一个模型,它才能真正开始干活。

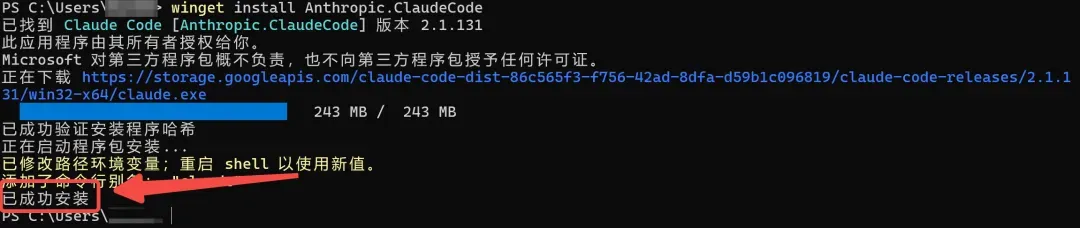

这里推荐用CC Switch来管理模型,它支持可视化切换,不用每次都手动去改配置文件。

到下面这个地址下载安装包:

github.com/farion1231/cc-switch/releases

找到以.msi结尾的文件,点击下载。

下载后双击打开文件,一路点击“Next”完成安装,然后打开应用。

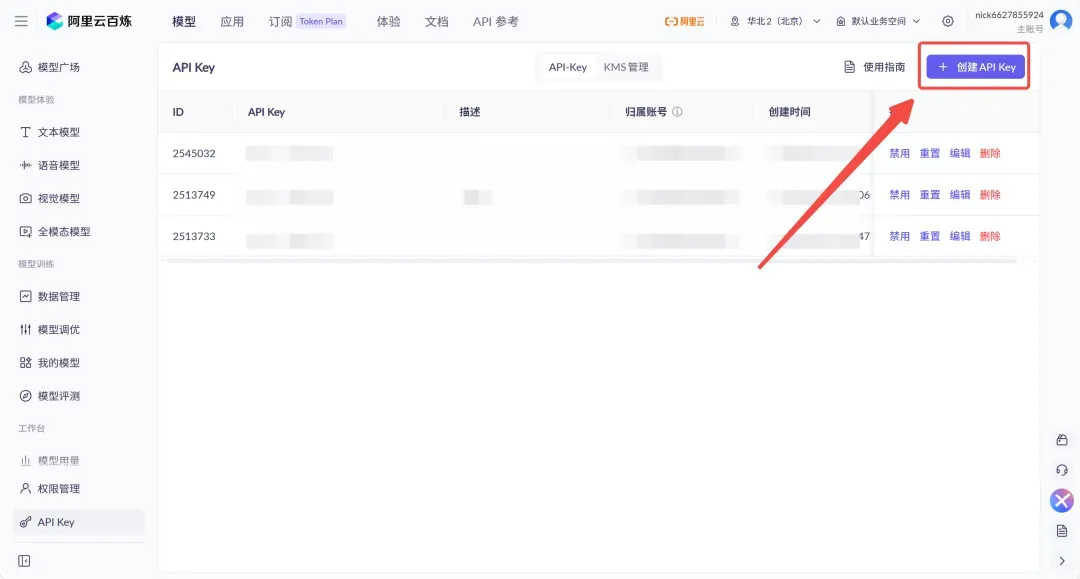

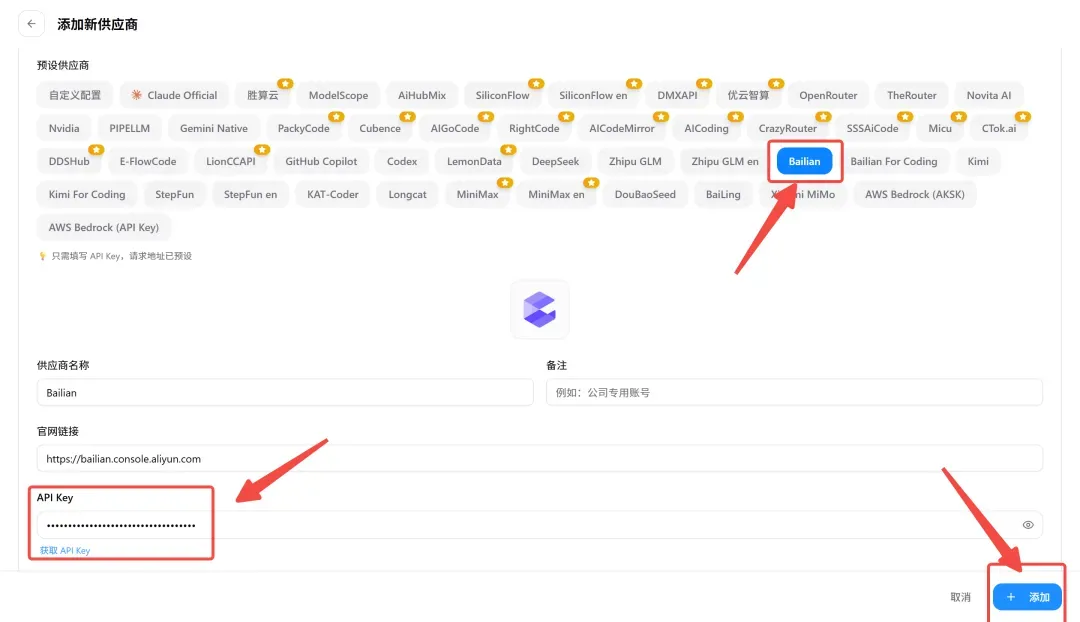

我们以阿里云百炼为例来说明。

阿里云百炼对新注册并完成认证的用户,各个模型都有免费额度,国内直接连接,访问很稳定。

去 bailian.console.aliyun.com 注册,认证完成后创建一个API Key,复制下来备用。

打开CC Switch,点击Claude栏右上角的加号,新增一个模型配置,选择Bailian,把刚才的API Key粘贴进去,点击添加。

这样就搞定了。如果以后想换DeepSeek、GLM或者Kimi,用同样的方法再配置一个,随时都能切换。

第四步:正式启动(到这里就全部装好了)

回到PowerShell,输入:

2026最新Codex高级提示模板30例:效率翻倍,覆盖全流程实战

越来越多的开发者发现,同样使用 Codex,有人一句 prompt 就能搞定整个模块,而有人却需要反复拉扯、效率极低。差距就在于提示词的组织方式。本文依据 OpenAI 官方 Codex Prompting Guide 以及社区公认的实践经验,提炼出 30 套经过严格验证的高级 Prompt 模板,完整覆盖项目初始化、代码审查、调试、重构、部署等全流程环节,真正做到复制即可使用,助你告别低效沟通。

核心概念速览

Codex Prompt 四要素

OpenAI 官方建议,每个 Prompt 都应当包含以下四个关键部分:

| 要素 | 说明 | 示例 |

|---|---|---|

| 目标(Goal) | 一句话概括你要完成什么任务 | “为订单表单添加实时校验逻辑” |

| 上下文(Context) | 指定涉及的文件、目录、文档或错误信息 | “相关文件:src/components/OrderForm.tsx” |

| 约束(Constraints) | 明确不能触碰的边界以及必须遵守的规范 | “不引入新依赖,保持与现有 API 签名兼容” |

| 完成条件(Done when) | 如何验证任务已正确完成 | “所有单元测试通过,构建无错误” |

Codex vs Claude Code 快速对比

| 特性 | Codex | Claude Code |

|---|---|---|

| 配置文件 | AGENTS.md + config.toml | CLAUDE.md + settings.json |

| 技能系统 | .agents/skills/SKILL.md | .claude/skills/*.md |

| 子代理 | .codex/agents/*.toml | Agent Team 模式 |

| Hook 系统 | .codex/hooks.json | .claude/settings.json |

| 规划模式 | /plan 或 Shift+Tab | /plan |

| 代码审查 | /review | 代码审查 Agent |

| 分支隔离 | Git Worktree | Worktree |

| 推理强度 | low / medium / high / xhigh | 无(自动调节) |

如何使用本文?

根据你当前的工作任务,找到对应的分类,直接复制模板,将 [方括号] 中的占位内容替换为自己项目的实际情况即可。

2026最新Windows零基础部署OpenClaw小龙虾全流程:飞书集成实战指南

当下最炙手可热的AI工具,非OpenClaw(代号「小龙虾」)莫属。

那么,这只“小龙虾”到底能为你做些什么呢?

• 自动抓取网站数据

• 解决各类系统报错问题

• 执行重复性的测试任务

• 甚至帮你规划日程、整理文件

这些不是科幻电影中的贾维斯,而是OpenClaw真正能够落地执行的实际工作。然而,对于大多数普通用户来说,接触它的门槛并不低——步骤繁琐、安装报错、配置容易出错……也正因如此,即使这只龙虾能力强大,仍有不少人在了解过后选择放弃。

今天,我们将用最通俗的语言,带你从零开始,在Windows系统上部署属于你的第一只“小龙虾”,并通过飞书这类日常聊天工具直接指挥它工作。

01 准备工作:部署前的基础环境检查

正式安装OpenClaw之前,一定要先完成基础环境配置,提前检查前置条件,能够帮你避免90%以上的报错隐患。

系统:Windows 10\11 64位

内存:最低2GB,推荐4GB以上(本地运行大模型建议8GB+)

硬盘:预留至少500MB存储空间(含依赖包和安装文件)

网络:保持稳定联网(下载依赖以及调用云端大模型时需要网络,本地模型则可离线使用)

软件:安装Node.js 22或更高版本

此外,还需要牢记以下三点核心提醒:

1)全程使用管理员权限操作终端,否则很容易因为权限不足而报错;

2)安装路径不要包含中文、空格或特殊符号(例如“我的文件夹”“Open Claw”);

3)在安装过程中不要关闭终端窗口,也不要断开网络连接,耐心等待所有依赖下载完成。

02 零基础安装 OpenClaw「小龙虾」

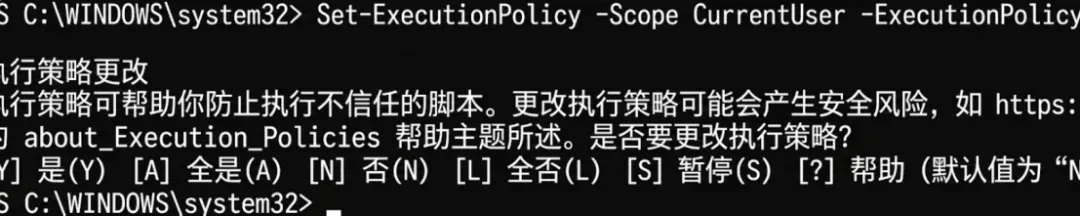

步骤1:以管理员身份运行PowerShell并设置执行策略

点击Windows左下角搜索框(或使用Win键+R组合键),输入「PowerShell」→ 右键点击「Windows PowerShell」→ 选择「以管理员身份运行」→ 在弹出的权限提示中点击「是」。

在打开的终端中输入以下命令:

Set-ExecutionPolicy RemoteSigned -Scope CurrentUser

出现选项时输入字母A确认。

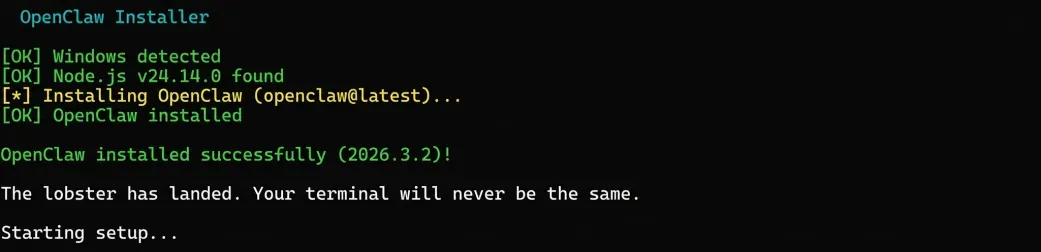

步骤2:执行一键安装脚本

将下面这行命令完整复制,粘贴到PowerShell窗口中,然后按下回车键:

iwr -useb https://openclaw.ai/install.ps1 | iex

如下图所示,命令行开始运行就说明已经在安装进程中。

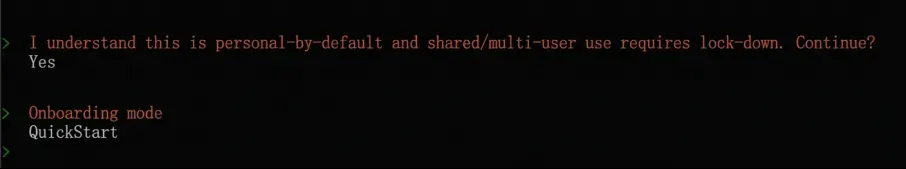

接下来会先后弹出两个选项窗口,分别用于确认默认权限规则和选择引导模式。我们全部使用默认选项,即选择“Yes”和“QuickStart”,按两次回车键即可继续。

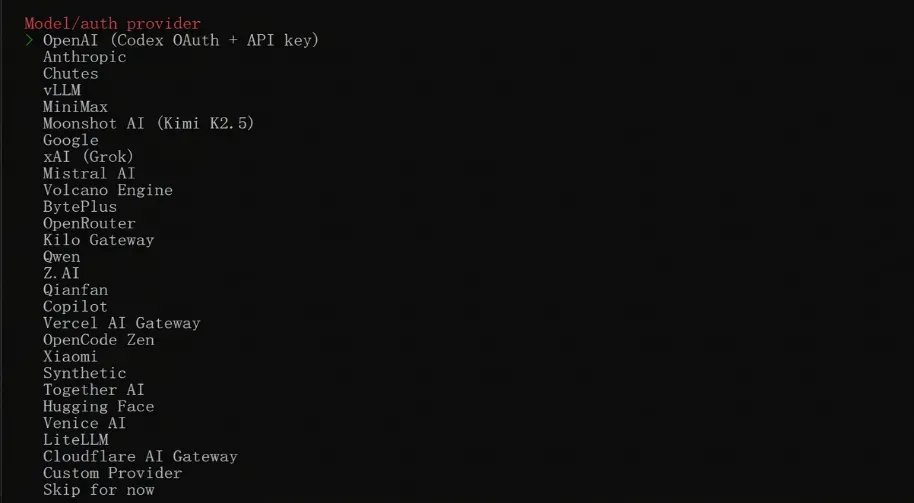

之后是选择所使用的的大模型,这里我们选用国内的智谱 GLM,即 Z.AI,你也可以根据自己的喜好切换到列表中任意一个大模型。

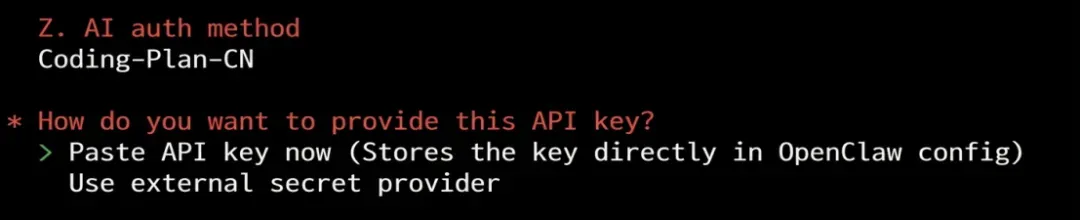

确定认证方式后,选择现在输入 API Key。

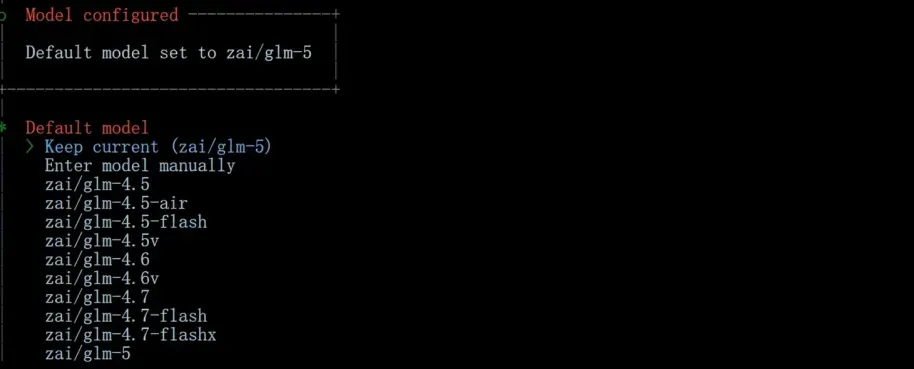

接下来是模型选择,我们保持默认的 GLM-5 模型。

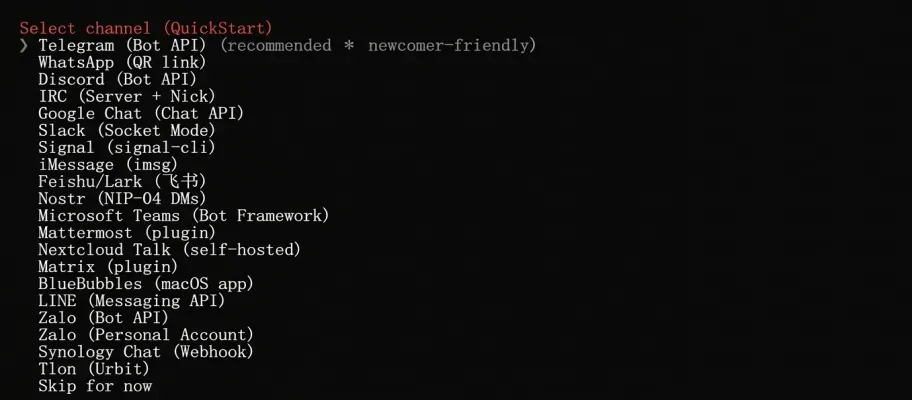

在集成平台列表中,除了飞书外多为国外软件,我们可以选择飞书,也可以选择最后一项暂时跳过。这里我们选择飞书。

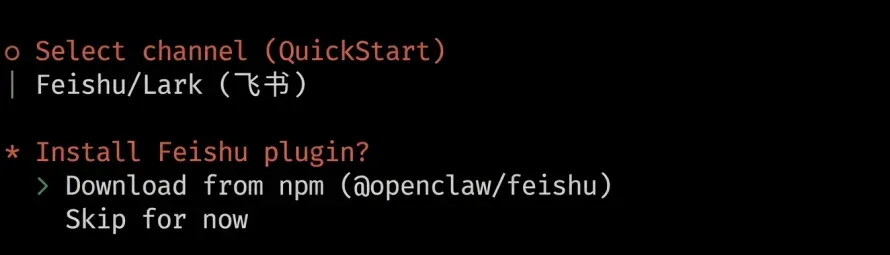

然后选择第一项安装飞书插件。

AI Agent正在吞噬软件:未来电脑或将告别传统应用

2026年5月,Hermes Agent悄然超越OpenClaw,登上OpenRouter日活跃排名榜首。46天,12.4万颗GitHub星标。这两个数字,使这款由Nous Research推出的开源AI智能体,一跃成为GitHub历史上增长速度最快的项目。

同样是在5月,OpenClaw的GitHub星标数冲破37万大关。这个去年11月才诞生的周末副项目,被黄仁勋在GTC 2026大会上称作“人类史上最受欢迎的开源项目”。从CNBC到TechCrunch,从The Verge到各类垂直媒体,报道铺天盖地;而跨越22个通讯平台的触角,从硅谷一直延伸到北京,从WhatsApp蔓延到微信。

Hermes和OpenClaw,一个以系统化的工程底蕴和自进化循环见长,一个凭借社区驱动的病毒式渗透狂飙。它们是2026年AI Agent浪潮的一体两面。在OpenRouter的日榜上,两者交替领先,每天的拉锯战都在重演。

01 · 两个项目,一场浪潮

Hermes Agent的时间线起点定格在2026年2月26日。当天,Nous Research发布了一条推文、一条curl命令、一份MIT协议的开源Agent。没有鲜花,没有通稿。三个月后,12.4万星标、370位贡献者、登顶OpenRouter日榜,比OpenClaw达到同等星标数整整提前了两周。

OpenClaw的故事则更加不可思议。2025年11月,奥地利开发者Peter Steinberger为自己打造了一个私人AI助手,取名Clawdbot。代码在几周内被疯狂fork,随后几度更名,从Moltbot到OpenClaw。如今,37万星标、370位贡献者、139个Release,一个原先的业余小项目摇身一变,成为全球最大的开源AI智能体生态。

“Just as Windows ushered in the PC era, OpenClaw will usher in the era of personal agents.” — Jensen Huang, GTC 2026

黄仁勋在GTC 2026的主旨演讲中,花了很大篇幅谈论OpenClaw。他的判断直截了当:这不是一个工具,这是一个操作系统——智能Agent计算机的操作系统。就像Windows开启了PC时代,OpenClaw将开启个人Agent时代。这并非修辞,而是一种宣言。

02 · 桌面上的抢夺战

与开源Agent的跃进几乎同步的,是另一条战线上的白热化对决:Claude Code和OpenAI Codex在桌面端的全面接火。

2026年2月,OpenAI推出Codex桌面应用,以macOS原生、多Agent并行、深度Git工作流和Skills市场为卖点。一个月后,Anthropic为Claude Code带来桌面伴侣,新增远程Mac控制与Cloud Sandbox能力。仅仅又过去一个月,Codex便上线了Computer Use功能,Agent能够像人类一样操作Mac应用,同时发布111个新插件、Atlas浏览器引擎和图生成能力。两天不到,Claude Code以Agent Teams架构重建予以回击。

节奏快到让人觉得荒诞。一方发布新功能,另一方必定在一周内迎头赶上。双方都在不断加码:浏览器控制、插件生态、并行Agent、沙箱执行、自动化调度。

表面看是产品层面的攻防,底层逻辑却清晰:大模型不甘心仅仅蜷缩在API后面。2025年,所有人还在比较谁的模型智商更高。到了2026年,模型能力趋同,竞争的核心变成谁更能深度嵌入你的工作流。一个藏在API背后的模型,无法培育任何用户粘性;而一个常驻你桌面的Agent,却可以。

2025.11 OpenClaw(原名Clawdbot)问世,始于一个周末的兴趣项目。

2026.02 Hermes Agent发布;OpenAI推出Codex桌面应用。

2026.03 GTC 2026:黄仁勋称OpenClaw为“Agent时代的操作系统”。

2026.04 Codex Computer Use上线;Claude Code以Agent Teams架构重建。

2026.05 Hermes Agent登顶OpenRouter日榜,与OpenClaw交替居于第一。

AI编程实战:Claude Code + Superpowers七阶段工作流搭建Spring Boot 3.5 RESTful API脚手架全记录

用 Superpowers 工作流从零构建 Spring Boot 脚手架

遵循 Superpowers 七阶段工作流,全程使用 Claude Code 与 GLM 5.1 驱动,从零搭建一套可运行的 Spring Boot 3.5 + MyBatis-Plus + Redis RESTful API 服务。

核心概念(3分钟理解)

这是什么?

这是一篇动手实录。我打开 Claude Code,将 GLM 5.1 作为 Coding Plan Provider,严格按 Superpowers 工作流推进,从零搭建一个 Java API Server 脚手架的全过程。

最终产物是一个包含用户注册、登录鉴权和受保护接口的 RESTful API 服务,可以直接用作 Spring Boot 后端项目的起点。

为什么重要?

系列第 21 篇展示了 Go 语言版的 API Server 脚手架。本文则是 Java 版本 —— 采用国内企业最广泛使用的 Spring Boot 技术栈,借助同样的 Superpowers 工作流,展示 AI 编程如何提升 Java 开发效率。

Claude Code + GLM 5.1 驱动:Superpowers 七阶段工作流从零搭建 Go API 脚手架全记录

3 分钟速览:核心概念

本文是什么?

这是一份完整的动手实录。它不堆砌概念,不罗列功能清单——而是还原我坐在电脑前,启动 Claude Code,借助 GLM 5.1 作为 Coding Plan Provider,联合 Superpowers 工作流,从零开始开发一套 Go API Server 脚手架的完整过程。

最终产物:一个具备用户注册、登录鉴权、受保护接口的 RESTful API 服务,可以直接当作任何 Go 后端项目的起点。

为什么需要这篇文章?

前 20 篇文章已经覆盖了 Claude Code 的安装、配置、Skills、MCP、Hooks 以及 Superpowers 理论……但一直缺少一样东西——一个端到端的、从 0 到 1 的实战案例。

你可能浏览过 Superpowers 的七阶段流程图,但心底仍有不少疑惑:

- 头脑风暴阶段 AI 究竟会提出哪些问题?

- Writing Plans 产出的任务清单到底长什么样?

- Subagent 驱动开发时,代码是如何逐块生成的?

- 碰到 bug 时,systematic-debugging 怎么介入?

本文就来逐一回应这些困惑。

能帮你解决什么?

- 看完了 Superpowers 理论却不知如何落地

- 想用 Claude Code 搭建 Go 后端项目但缺少参考路径

- 想了解 GLM 5.1 作为 Coding Plan Provider 的真实表现

- 需要一套可复用的 Go API 脚手架作为后续项目的起点

Claude Code 编码执行

Claude Code + OpenClaw:打造自主AI编程代理,构建高效开发工作流

引言:AI编程步入自主代理时代

2025到2026年间,AI编程工具完成了一次根本性跃迁:从“辅助补全”进化为“自主执行”。过去,我们习惯在 IDE 中向 AI 助手索要代码片段;如今,以 Claude Code 和 OpenClaw 为代表的新一代框架,正在重新定义“AI驱动开发”的内涵。

Claude Code 由 Anthropic 推出,是一款扎根终端的 AI 编程代理;OpenClaw 则是开源社区中热度最高的自主代理框架,能将各类 AI 模型与你的数字生活工具串联起来。当这两者相遇,会催生出怎样的生产力?本文就带你深入拆解这一组合如何搭建真正高效的智能开发工作流。

认识 Claude Code:终端原生的AI编程代理

设计哲学

Claude Code 于2025年初问世,彻底打破了“IDE嵌入式AI辅助”的固有范式。和 Cursor、Windsurf 等需要图形界面的插件不同,Claude Code 直接运行在你的终端中,通过命令行与开发者交互。

这种“终端优先”的设计思路带来了三个鲜明优势:

- 零上下文割裂:无需离开终端即可完成所有编码相关操作

- 深度系统耦合:可直接读写文件系统、执行 git 命令、运行 Shell 脚本

- 全程透明日志:每个步骤都被清晰记录,便于回溯与审计

关键能力一览

基于官方文档与实战测试,Claude Code 的核心能力可归纳如下:

1. 完整的代码库理解

Claude Code 不仅能读懂当前文件,更能整体感知你的代码仓库。它可以:

- 分析模块依赖与结构层次

- 理解架构模式与设计意图

- 执行跨文件的语义解析和修改建议

2. 智能化的文件编辑

覆盖多样化的编辑操作:

- 创建、修改、删除文件

- 重构代码架构

- 自动修复漏洞和性能瓶颈

- 生成与维护测试用例

3. 命令执行与流程自动化

支持直接调用终端命令:

- 运行构建脚本与测试套件

- 操作 git 工作流(提交、推送、分支管理等)

- 承担部署与运维任务

4. 子代理机制

面对大型项目时,Claude Code 可以“孵化”多个子代理分头处理不同模块。主代理负责调度,子代理并行推进,整体处理效率得到明显提升。

Claude Code生态最强框架GSD万字深度实测:不写代码也能拿下35000颗星,到底烧Token还是真神器?

“I’m a solo developer. I don’t write code — Claude Code does.”

一个完全不会写代码的人,却做出了整个 Claude Code 社区争议最大的工程框架。

如果你在 Claude Code 的世界里待得足够久,一定听过 GSD(Get Shit Done)这个名字。

GitHub 上 35000+ Star,npm 周下载量过万,Reddit 和 Hacker News 上永远吵成一锅粥——有人用它从零搭出完整 SaaS 产品并成功上线,也有人痛骂烧了一周 API 额度只产出了 500 行代码。

今天这篇文章,我不想列功能清单。咱们坐下来好好聊聊:这个框架到底解决了什么痛点,为什么评价会这么撕裂,以及——它究竟适不适合你。

不会写代码的人,却造出了最强框架

GSD 的作者叫 Lex Christopherson,网名 TACHES,GitHub 上叫 glittercowboy。他的自我介绍特别有意思:“House music producer & AI guy”——一个做电子音乐的,硬是搞出了 Claude Code 社区最复杂的工程化框架。

他的起点很简单:他自己完全不写代码,一切开发都交给 Claude Code。但在重度使用过程中,他撞上了一个要命的问题——上下文腐败(Context Rot)。

什么是上下文腐败?

你跟着 Claude Code 密集聊了两个小时后,上下文窗口眼看就要被塞满。这时候你能明显感觉到,Claude 产出的代码质量在滑坡——开始敷衍、省略错误处理、跳过边界情况。不是模型突然变蠢了,而是它一次要记住的东西太多,注意力已经涣散了。

就像你让一个人同时牢记 50 件事,还要求他写出一篇好文章——根本不可能。

Lex 的应对方案暴力但极其有效:绝不让单个 Agent 扛下所有工作,每项子任务都给一个全新的 200K 上下文窗口。

Claude Code效率翻倍:Anthropic内部人士公开的5个实战技巧

不久前,Claude Code 的产品负责人 Boris Cherny 发布了一系列推文,毫无保留地分享了 Anthropic 内部团队都在使用的高效方法。深入理解并实践这些方法后,会发现绝大多数用户实际上只发挥了 Claude Code 不到 20% 的潜力。从中提炼出的五个核心技巧,能够切实让你的 Claude Code 使用效率成倍增长。

01

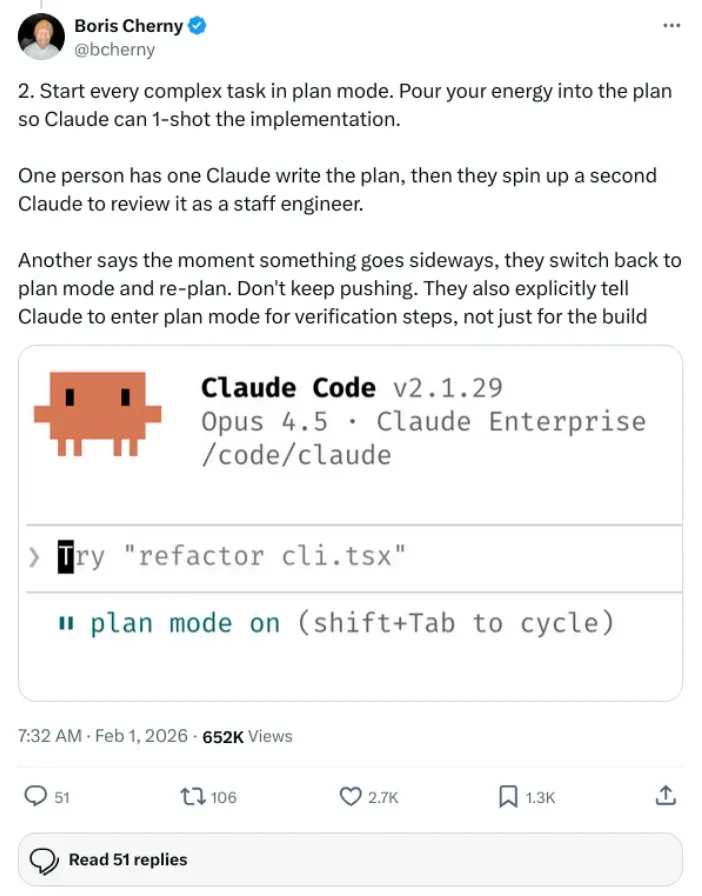

Plan Mode 与无人值守模式:先规划,再执行

许多人在使用 Claude Code 时习惯直接把需求丢给它,让它立刻开始编写代码。结果往往方向跑偏,只能推倒重来,既消耗 Token 也浪费时间和精力。

Claude Code 内置了一个 Plan 模式,只需要按下 Shift+Tab 即可切换。在该模式下,Claude 不会直接动手写代码,而是先梳理整体思路、把待执行的步骤逐条列出,供你审查。待你确认无误之后,再切换回普通模式让它执行。每次复杂任务都遵循“Plan 模式出计划 → 人工确认 → 执行”的流程,虽然前期多花十分钟对齐,却能有效避免后续数小时的反工。

Boris 的团队中甚至有人采取了更严格的方式:让第一个 Claude 写出计划,然后启动第二个 Claude 以“高级工程师”的身份来审查该计划,只有审核通过才开始实际编码。

而当任务范围非常明确,中间无需你做任何判断(例如批量格式化文件、统一修改代码风格等),可以直接使用无人值守模式:

claude --dangerously-skip-permissions

这条命令会跳过所有权限确认步骤,让 Claude 全自动完成整个流程,体验十分顺畅。

02

用 CLAUDE.md 让工具越用越理解你的习惯

CLAUDE.md 是一个很容易被忽略,但使用后会后悔没有早点用起来的功能。每次开启新会话,总有一些项目规范需要重新交代,比如“使用 ES modules”“测试代码中不要使用 mock”“分支命名格式为 feature/工单号”等。重复输入这些信息非常繁琐。

将 CLAUDE.md 文件放在项目根目录下,Claude 每次启动都会自动读取其中的规则,一次写入便长久生效。Boris 团队还有一个很值得借鉴的习惯:当 Claude 犯了一次错误,你纠正后,在对话末尾加上一句“把刚才学到的内容更新到 CLAUDE.md 中,下次不要再犯同样的错误”。Claude 会自动将这次的经验写进去,以后每次启动都能复用。久而久之,CLAUDE.md 就成了一份能够记住你所有偏好的“活文档”。