GPT Image 2高阶提示词完全指南:300条顶配Prompt模板与万能公式,破解废片魔咒

近期深度体验 GPT Image 2 的过程中,愈发感受到 OpenAI 的技术底蕴。这款全新的图像生成模型展现出的实力确实令人印象深刻。

然而即便模型能力再强,不同使用者产出的图片质量仍存在显著差异。真正的分水岭,往往藏在提示词的撰写技巧里。

不少人跑出的初稿乍看尚可,细品却问题频出:画面信息过载、视觉焦点涣散、元素堆砌杂乱,缺乏专业级作品的精致度。直白来说,就是能看却难登大雅之堂。

这类现象近期屡见不鲜,促使我重新深入研究 GPT Image 2 的提示词工程。经过系统梳理,我得出一个核心结论:

当前绝大多数提示词撰写方式过于空泛。

典型如:

“帮我生成一张高级感海报”

“帮我生成一张未来科技风图片”

“帮我生成一个赛博朋克界面”

这类描述确实能产出图像,但将解释权完全交给模型。当AI必须猜测你心中的"高级感"、“科技风"或"赛博朋克"具体形态时,结果必然充满随机性与不可控性。

因此本文将深入探讨:

如何构建能稳定产出精品的 GPT Image 2 提示词。

我整理出300条经过验证的高阶 prompt,并将其封装为可重复调用的 skill。这套资源既可即拿即用,也能作为学习材料帮助你掌握自主撰写技巧。

高质量提示词的核心要素

优质提示词的关键在于画面组织能力。

如今评估 prompt 时,我首先关注的不再是风格词汇,而是其组织画面的逻辑性。

好提示词 = 图像类型 + 主体内容 + 构图版式 + 信息模块 + 视觉气质 + 材质细节 + 文字系统 + 画幅比例

一条专业级提示词必须清晰回答以下八个问题:

1、这张图属于什么类型

海报、UI界面、信息图、杂志封面、设定页,还是品牌提案图?

2、核心主体是什么

观众视线应第一时间聚焦何处?

3、结构如何排布

采用中央主体构图、左右分栏布局、上下标题结构,还是时间轴、地图式分布?

4、周边包含哪些信息模块

评论区、参数栏、图标系统、色卡、脚注、说明文字、数据小模块等元素如何集成?

5、整体传递何种气质

杂志感、科技发布会感、博物馆展签感、生活方式专题感,或是带幽默基调的严肃感?

6、材质细节如何呈现质感

玻璃、金属、磨砂塑料、亚克力、纸张肌理、霓虹反光、水雾、镜面、颗粒、褶皱等元素的运用,能让画面更具触感与真实度。

7、文字系统如何设计

需含文字的图片必须明确标题、副标题、标签及字体层级关系。许多作品缺乏成品感,根源在于仅有图像而无排版思维。

8、画幅比例设定

4:5、9:16、16:9 等参数虽基础,却不可省略。

归根结底,能产出专业成品的 prompt 依赖的是画面组织能力。风格词虽有作用,但优先级应置后。

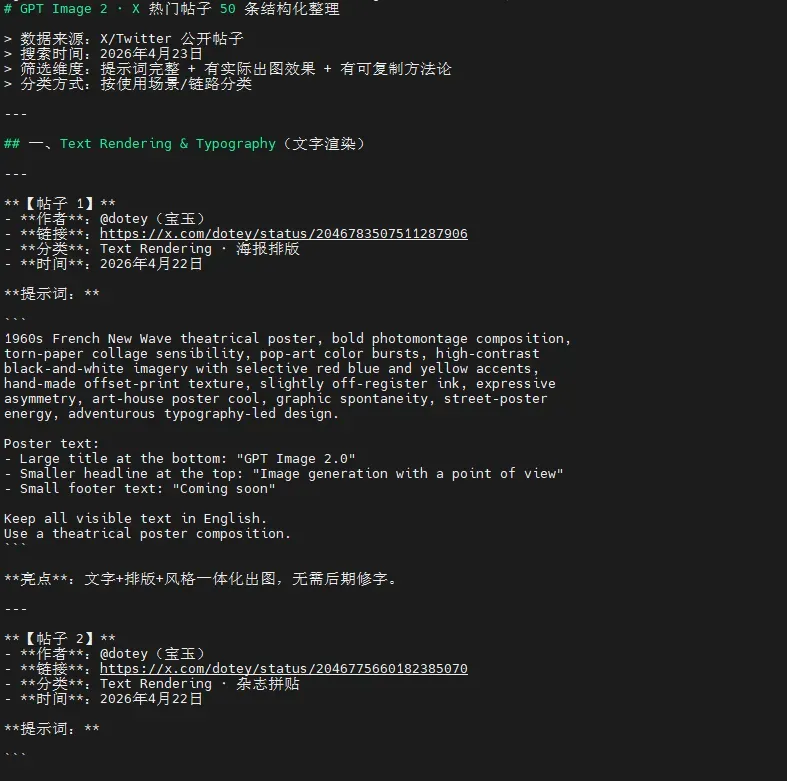

GPT Image 2终极提示词宝典:50个实战案例详解与创意应用指南

文字渲染专题

来源: @dotey(宝玉)

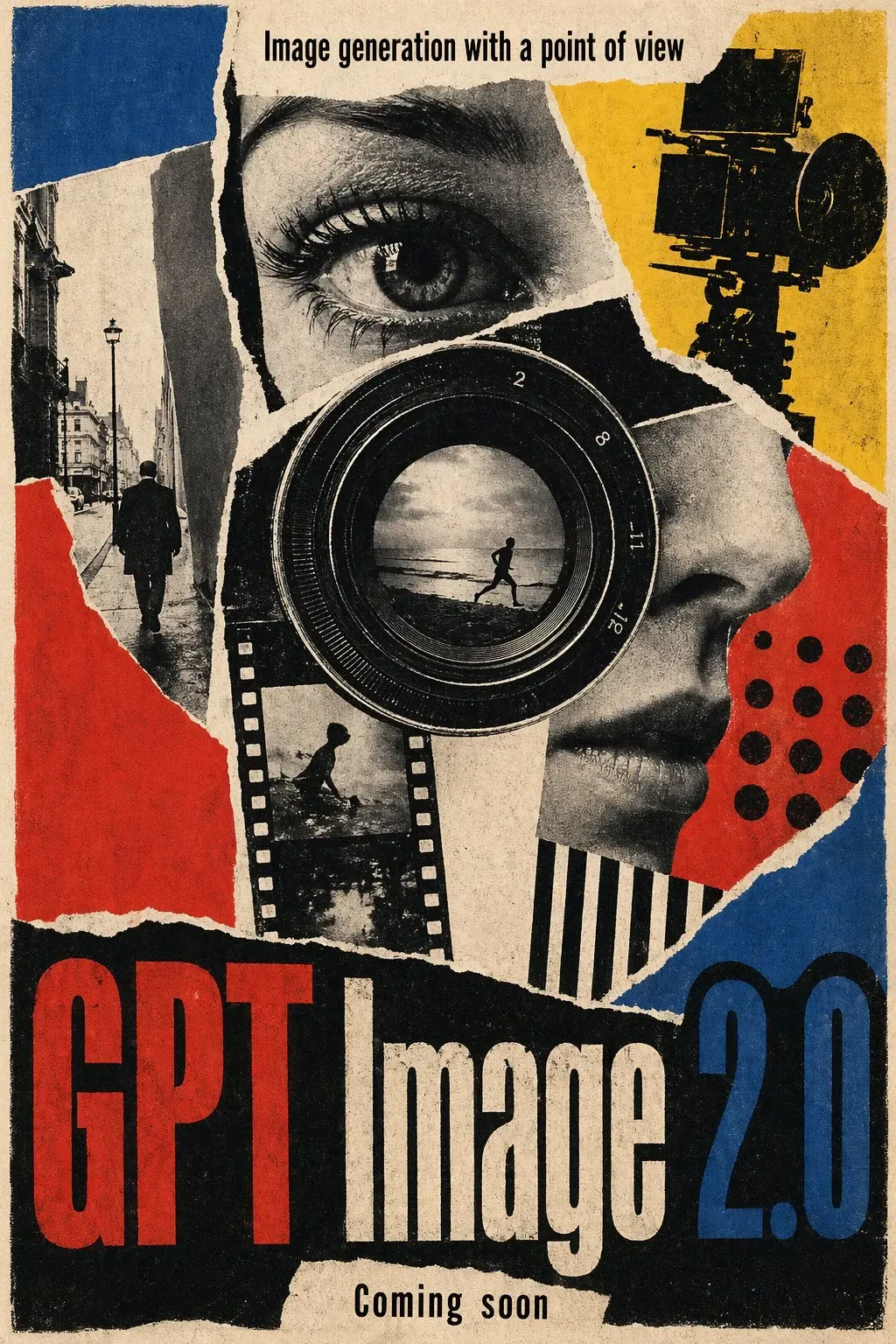

以下提示词可生成1960年代法国新浪潮风格戏剧海报,采用大胆的照片拼贴构图手法,融合撕纸拼贴质感与波普艺术色彩爆发效果:

1960s French New Wave theatrical poster, bold photomontage composition,

torn-paper collage sensibility, pop-art color bursts, high-contrast

black-and-white imagery with selective red blue and yellow accents,

hand-made offset-print texture, slightly off-register ink, expressive

asymmetry, art-house poster cool, graphic spontaneity, street-poster

energy, adventurous typography-led design.

Poster text:

- Large title at the bottom: "GPT Image 2.0"

- Smaller headline at the top: "Image generation with a point of view"

- Small footer text: "Coming soon"

Keep all visible text in English.

Use a theatrical poster composition.

GPT-Image2 PSD生成器完全指南:免费用户也能一键制作Photoshop分层文件

近期有用户反馈在短视频平台看到关于ChatGPT直接生成PSD文件的内容,但实际按照视频教程操作时却频繁遇到障碍。短视频平台在流量获取方面确实高效,然而在技术细节传达上往往存在欠缺。本文将针对这一问题,提供一套经过验证的完整解决方案,详细介绍如何利用GPT-Image2生成可直接在Photoshop中编辑的PSD分层文件。

图像生成阶段的操作要点

整个流程的第一步是获取基础图像。您可以选择自行上传图片,也可以直接通过AI生成。以生成一张夏日主题海报为例,初始需求可能不够明确,此时可以采用迭代优化策略。

首先向GPT-Image2提出基础需求,生成初始版本。如果效果未达到预期,例如缺少海报应有的视觉层次,可继续输入具体修改意见。当遇到人物元素显得刻意、画面协调性不足等问题时,持续通过对话方式微调,通常经过3-4轮优化即可获得理想效果。这种交互式创作方式特别适合提示词编写经验不足的用户,借助GPT强大的理解能力逐步完善视觉呈现。

图层拆分的技术实现

获得满意的基础图像后,关键步骤是将画面元素拆解为独立图层。此环节必须启用"Thinking"模式以确保最佳处理效果。以下是经过优化的提示词模板:

请将这张已生成的图片拆分成多个独立图层元素,并分别输出为多张图片。

具体要求如下:

每一张输出图片只保留一个独立元素,例如人物、文字、装饰物、背景主体、道具等。

所有输出图片的画布尺寸必须和原图完全一致。

每个元素在画布中的大小、位置和比例都要保持和原图一致,不能缩放、移动或重新排版。

每张图片的背景统一使用纯白色,不要使用伪透明效果。

最终输出的所有图片需要能够直接导入Photoshop叠加使用,导入后各元素可以自动对齐到原图位置,不需要手动移动或重新调整。

执行上述指令后,系统将自动完成精准抠图,分离出人物、文字、装饰元素等独立图层,各元素边缘处理效果较为理想。

PSD文件合成高级配置

完成图层拆分后,下一步是生成可编辑的PSD文件。标准提示词方案如下:

请将所有已经拆分好的图层图片重新合成为一个Photoshop可打开的PSD文件。

要求每一张输入图片都作为PSD中的一个独立图层,图层名称使用原始文件名或清单中的名称。所有图层必须保持和原始图片完全一致的画布尺寸,不能裁切透明区域,不能自动居中,不能缩放,不能移动。每个元素在PSD中的位置、大小、比例都必须与原图一致,导入Photoshop后应能自动叠回原图效果。

请自动去除每张图层图片中的纯白背景。去白底时只删除与画布边缘连通的白色背景区域,不要删除元素内部真实存在的白色细节,例如白色文字、白色衣服、白色高光、白色装饰。边缘需要适当柔化,避免出现明显白边或锯齿。

图层上下顺序必须严格按照文件编号或图层清单中的z_index排列。编号小的图层放在底部,编号大的图层放在上方。如果存在背景层,背景层应放在最底部。如果存在前景文字或装饰层,应放在上方。

最终输出PSD文件,必须能在Photoshop中打开和继续编辑。每个图层都应是独立可编辑的位图图层,可以单独隐藏、移动、缩放、调整透明度和修改效果。不要合并图层,不要输出扁平化图片,不要使用伪透明效果。

生成完成后,请检查PSD的合成预览是否尽量还原原图,确保没有图层偏移、尺寸变化、顺序错误、白底残留或元素被误删的问题。

根据实际测试,采用JSON格式结构化提示词可获得更稳定的输出质量,推荐方案如下:

{

"task": "merge_split_layers_into_psd",

"input": {

"type": "split_layer_images",

"source_reference": "original_image",

"layer_images": "all_split_layers",

"layer_order_source": {

"mode": "filename_or_manifest",

"required": true,

"rule": "layers must be ordered from bottom to top by filename index or manifest z_index"

}

},

"output": {

"type": "psd",

"color_mode": "RGB",

"canvas_size": {

"mode": "same_as_original",

"width": "same_as_original",

"height": "same_as_original"

},

"layers": {

"type": "independent_rgba_raster_layers",

"one_input_image_per_layer": true,

"keep_full_canvas_per_layer": true,

"do_not_trim_layer_bounds": true,

"do_not_resize": true,

"do_not_reposition": true,

"do_not_flatten": true,

"layer_names": "use_input_filename_or_manifest_name"

},

"background_removal": {

"enabled": true,

"source_background": "solid_white",

"method": "remove_only_white_pixels_connected_to_canvas_edges",

"white_threshold": 248,

"edge_softening": true,

"preserve_internal_white_details": true,

"preserve_highlights_and_white_text": true

},

"z_order": {

"preserve": true,

"stacking_direction": "bottom_to_top",

"fallback_rule": "use_numeric_filename_order"

},

"photoshop_compatibility": {

"openable_in_photoshop": true,

"layers_individually_editable": true,

"each_layer_can_be_moved_hidden_scaled_and_adjusted": true

},

"validation": {

"composite_preview_must_match_original": true,

"no_layer_offset": true,

"no_unwanted_white_background": true,

"no_fake_transparency": true

}

},

"requirements": {

"preserve_original_canvas_size": true,

"preserve_relative_position": true,

"preserve_element_size": true,

"preserve_z_order": true,

"preserve_layer_alignment": true,

"photoshop_editable": true

}

}

关键工具配置与文件获取

为确保最佳兼容性,强烈建议在ChatGPT应用中心添加"Adobe Photoshop"官方应用。配置路径为:界面左侧菜单栏选择"更多(More)"→“应用(Apps)",搜索并连接该应用。此配置能显著提升PSD文件的生成质量和Photoshop打开时的兼容性。

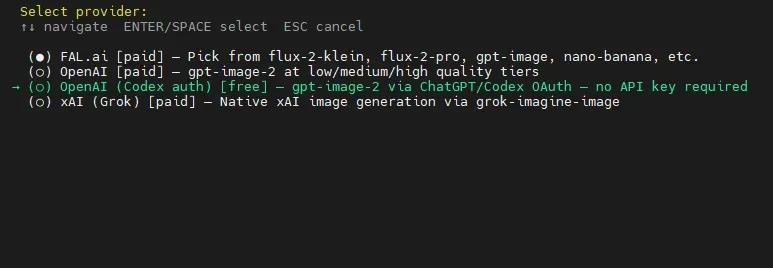

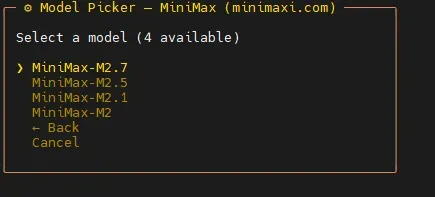

Hermes配置GPT-image-2生图功能完整指南:ChatGPT Plus用户免费接入OpenAI Codex教程

前言:GPT-image-2与Hermes框架的整合价值

GPT-image-2大模型的图像生成能力令人印象深刻,其应用场景日益丰富。目前OpenAI已将该功能深度集成,除网页端和标准API接口外,Codex环境也原生支持图像生成。对于已订阅ChatGPT Plus或Pro服务的用户,可通过Hermes框架直接调用这一强大能力,实现自动化生图流程。

前置条件说明

重要提醒:以下配置流程基于已完成OpenAI Codex的OAuth认证。若尚未执行此操作,请先参考相关部署文档完成鉴权步骤。此外,必须确保拥有有效的ChatGPT Plus或Pro会员资格,这是免费使用gpt-image-2服务的必要前提。

分步配置详解

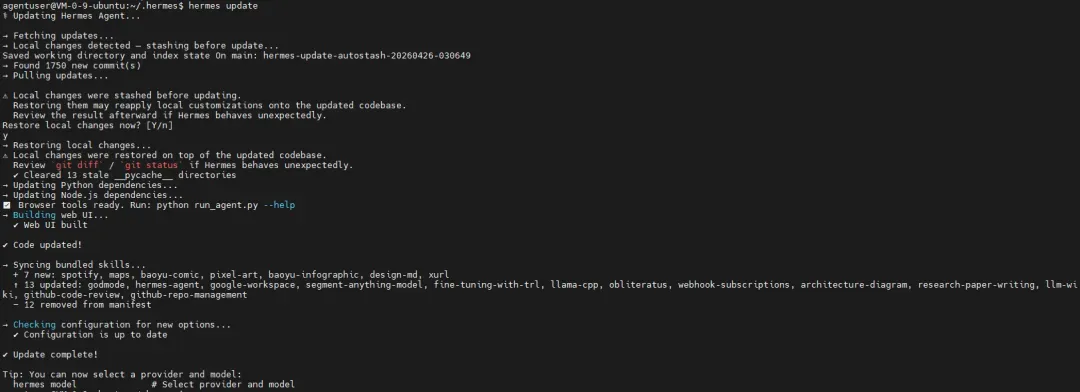

步骤一:更新Hermes核心组件

首先执行升级命令以获取最新功能支持:

hermes update

步骤二:进入工具配置界面

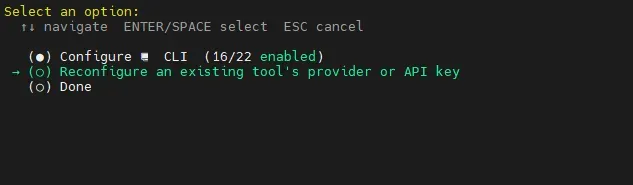

使用以下命令访问工具管理系统:

hermes tools

选择"Reconfigure an existing tool’s provider or API key"选项以修改现有工具配置。

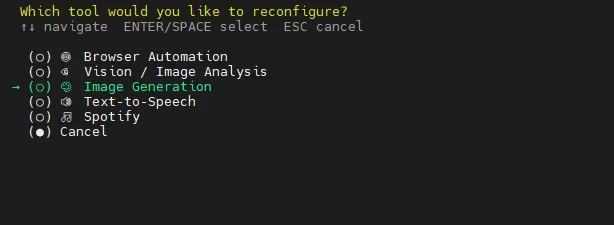

步骤三:定位图像生成模块

在工具列表中找到并选择"Image Generation"功能项。

步骤四:配置OpenAI Codex认证通道

选择"OpenAI (Codex auth) [free] — gpt-image-2 via ChatGPT/Codex OAuth — no API key required"这一选项。该配置允许直接利用已有的Codex登录凭证,无需额外申请API密钥即可调用生图服务。

步骤五:设定模型参数选项

接下来呈现的三个参数选项可根据实际需求灵活选择,分别对应不同的生成质量与速度配置。

步骤六:重启网关服务

完成上述配置后,必须重启网关以使变更生效:

hermes gateway restart

至此,所有核心配置工作已完毕,系统已具备通过Codex调用GPT-image-2的能力。

功能验证与实际效果演示

配置生效后,可通过对话测试验证生图功能。当系统中未安装专用图像生成技能时,Hermes将自动调用内置的image_generate工具,通过已配置的Codex后端执行生成任务。

进阶方案:智能提示词优化技能

为进一步提升生成质量,建议部署专门的提示词优化组件。gpt-image-2-prompting技能可自动将简洁构思转化为专业级提示词,并直接触发图像生成流程,形成"优化-生成"一体化体验。

该技能可显著提升生成结果与创作意图的匹配度,尤其适合需要批量生产高质量图像的场景。

总结与后续建议

通过上述六个步骤,即可成功将Hermes与GPT-image-2生图能力无缝对接。整个过程无需额外API密钥,充分利用了ChatGPT会员权益。建议在实际使用中结合提示词优化技能,以发挥该生图系统的最大潜力。

Hermes知识库实战:4层架构+6个步骤打造自动化复利系统

摘要:构建具备自我进化能力的知识生态系统

借鉴CyrilXBT的先进知识管理框架,深度融合Hermes代理的强大自动化能力,构建一个具备自我进化特性的智能知识生态系统。该系统采用四层技术架构设计,全程无需人工干预,真正实现知识的指数级增长与自动复利效应。

核心引擎:四层架构设计原理

本方案提出革命性的四层架构模型:智能捕获层、自动化管道、语义化存储与深度智能层。Hermes用户可将该架构无缝集成至现有工作流,重点强化智能层的认知分析能力与决策水平。系统设计的终极目标是实现100%零手动操作,让知识资产在睡眠中自动增值。

实战应用:Hermes四大核心功能模块

智能捕获层:自动化信息采集引擎

Hermes可完全替代传统自动化工具如N8N,实现端到端的内容捕获:

# 执行网络内容智能提取

content = execute_code(f"web_extract('{url}')")

# 自动存储至Obsidian收件箱

write_file(f"/vault/inbox/{date}.md", content)

深度分析层:多模型协同处理中枢

通过Hermes的代码执行能力实现跨文档模式识别:

# 每日智能简报生成器

def generate_daily_brief():

recent_files = search_files(path="/vault/inbox", pattern="*.md", limit=50)

analysis = execute_code(f"""

# 深度挖掘知识关联性与潜在模式

...

""")

write_file(f"/vault/inbox/brief-{date}.md", analysis)

智能存储层:语义化知识网络构建

利用NLP算法自动建立知识图谱:

# 自动化知识连接发现

def create_knowledge_connections():

files = search_files(pattern="*.md", limit=100)

connections = execute_code(f"""

# 运用TF-IDF向量化技术进行语义相似度计算

from sklearn.feature_extraction.text import TfidfVectorizer

...

""")

write_file("/vault/connections.md", connections)

自动化工作流:定时任务与智能调度

结合cronjob与delegate_task实现复杂任务编排:

# 周度深度综合分析

def weekly_synthesis():

result = delegate_task(

goal="对过去七天的知识捕获进行系统性复盘",

context="基于以下文档集合展开深度分析...",

toolsets=["execute_code", "search_files"]

)

synthesis = execute_code(f"""

# 执行多维度数据挖掘与洞察提取

...

""")

write_file(f"/vault/synthesis/weekly-{date}.md", synthesis)

快速启动:5步构建你的智能知识库

第一步:搭建五维文件夹架构

创建核心目录体系:Inbox(收件箱)、Notes(笔记)、Ideas(灵感)、Projects(项目)、CLAUDE.md(系统日志)。此结构为后续自动化流程提供标准化输入输出接口。

iPhone变身移动开发终端:Termius+Tailscale+tmux远程管理MacBook完整指南

重要提醒:实测发现Termius在部分场景下中文显示异常,使用前请谨慎评估!

核心要点:通过Termius、Tailscale和tmux三款工具的组合,可将iPhone转化为MacBook的远程终端控制器,实现随时随地的命令行开发。本文提供经过验证的完整部署方案。

配置概览:

- 工具数量:3款核心软件

- 验证状态:✅ 实测可用

- 部署耗时:约10分钟

适用人群定位

这套方案专为依赖终端工具的开发者设计,适合日常频繁使用git、ssh、npm及各种CLI工具的工程师,且需拥有一台长期开机的MacBook作为开发主机。

不适用场景:若您期望在iPhone上独立运行开发环境、进行图形界面操作或需要完整IDE功能,本方案无法满足这些需求。

技术实现原理

本方案并非在iOS上重建开发环境,而是将iPhone作为MacBook的远程访问入口。代码编译和任务执行仍在MacBook上完成,手机仅承担终端显示与指令输入功能。

三款工具协同工作机制:

- Termius — 作为iOS端的SSH客户端,负责建立与MacBook的安全连接

- Tailscale — 构建私有虚拟网络隧道,解决外网访问内网设备的难题

- tmux — 终端会话管理器,确保网络中断后工作环境依然保持

实测环境校验

✅ tmux v3.6a 已成功部署

✅ Tailscale 运行正常,MacBook内网IP:100.107.33.87

✅ iPhone端Tailscale 已接入,设备IP:100.119.105.79

✅ sshd-session 进程活跃,SSH服务已启用

方案可行性已完全验证,以下是详细配置步骤。

第一阶段:MacBook主机配置

1. tmux安装验证

# 检查是否已安装

tmux -V

# 若未安装,通过Homebrew部署

brew install tmux

2. Tailscale网络配置

# 安装Tailscale客户端

brew install --cask tailscale

# 验证运行状态

tailscale status

安装完成后启动Tailscale.app,使用与iPhone端相同的账号完成登录(关键步骤)。

3. SSH服务激活

通过系统设置:通用 → 远程登录 → 开启

或通过终端命令快速启用:

Lovart Image2实战解析:从模糊想法到完整美妆品牌,AI设计如何实现全链路闭环

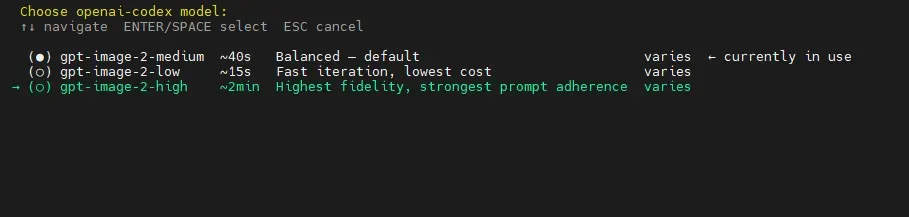

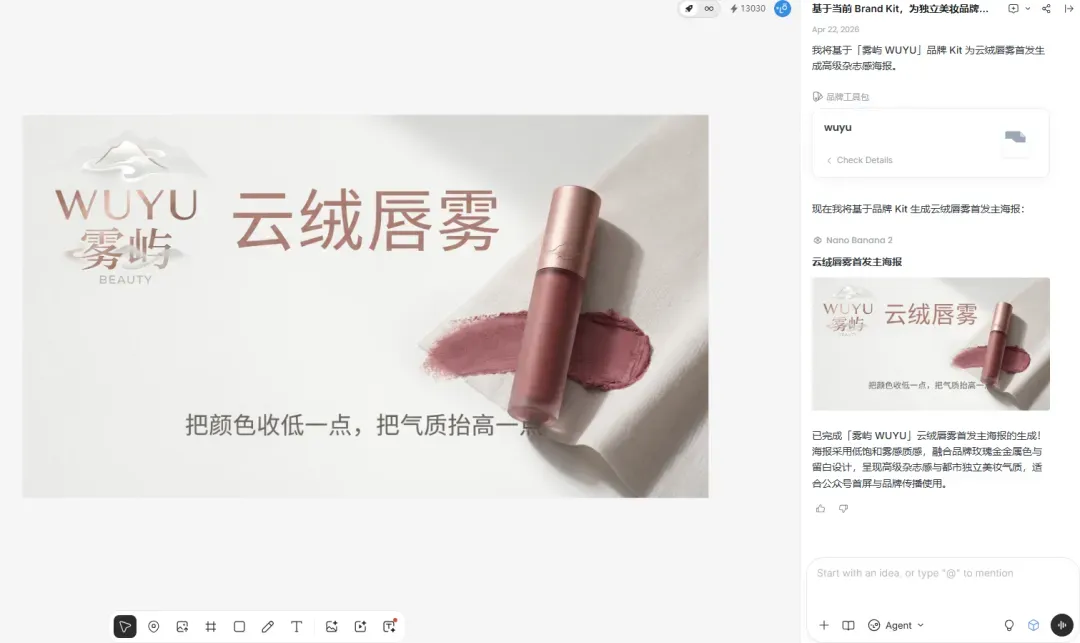

近年来,AI图像生成工具呈现爆发式增长。生成效果愈发逼真,功能持续强化,排版能力也日益精进。但当前决定工具竞争力的核心维度,早已超越单纯的图像生成能力。真正的分水岭在于:图像生成后能否支持深度编辑、批量处理、风格统一、系列化产出与最终交付。这些环节恰恰是专业设计workflow中的痛点与瓶颈。而Lovart Image2的最新升级,正是瞄准这些核心痛点提出的系统性解决方案。AI辅助设计正在向真正可落地的工程化方向演进。

本次测试未采用单一功能演示模式,而是构建了一个更接近真实商业场景的项目任务:从一句模糊的概念描述出发,在Lovart平台内使用Image2功能,完整跑通一个独立美妆品牌从0到1的首发内容体系搭建全流程。

从模糊直觉到品牌主视觉的转化

我们虚构了一个名为"雾屿WUYU"的美妆品牌,定位偏向都市极简美学、低饱和度视觉与微轻奢质感。核心验证目标在于:这个初步构想能否作为品牌种子,在AI系统中持续生长演化。

初始需求被刻意保持模糊状态,仅提供一句话描述:创建一个面向年轻族群、具有雾面质感、视觉干净、略带轻奢属性的独立美妆品牌,首发产品为唇雾系列。这种模糊性高度还原了真实商业项目中常见的初始状态——缺乏完整视觉规范、未建立明确设计系统、包装方向尚未定型。

首先使用Lovart Image2生成品牌首张主视觉图。输出结果显著超出预期,不仅完成了产品呈现,更同步构建了色彩氛围、标题排版、包装质感与整体品牌气质。

当第二张迭代图出现时,我意识到AI的真正价值不在于提供标准答案,而是将脑中的模糊感知转化为可讨论、可优化的视觉原型。图像成为最具象化的沟通媒介,让抽象概念获得实体化表达的可能。

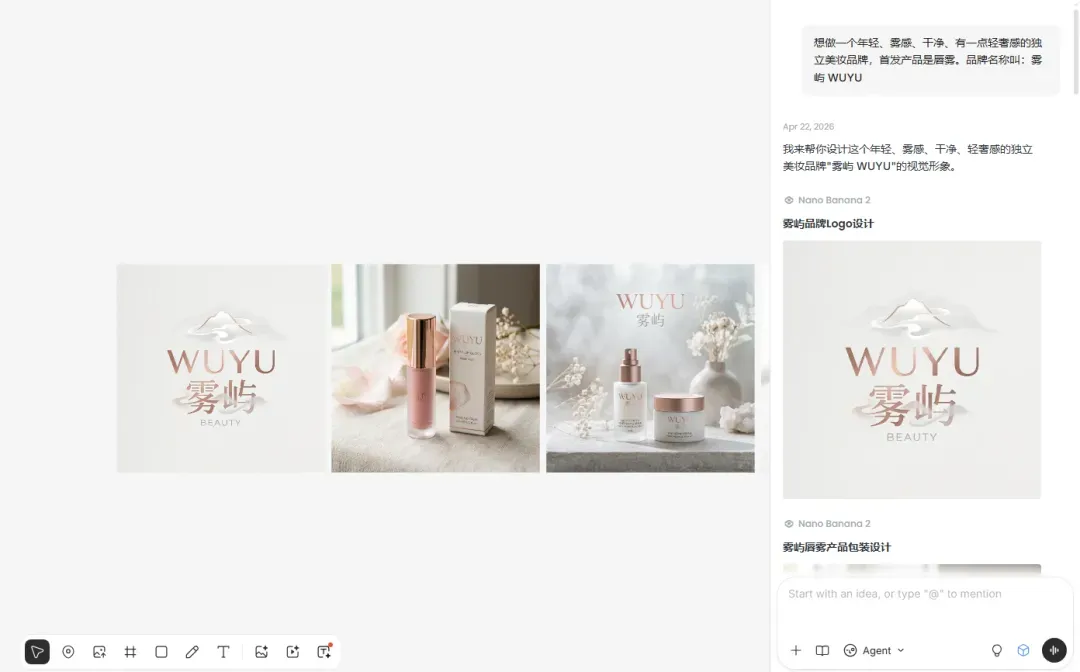

沉淀规则,构建Brand Kit系统

首张主视觉的完成仅仅是起点。品牌设计最大的风险在于后续延展过程中的失控与碎片化——今日创作的海报极具高级感,明日社交媒体配图却风格迥异,后日包装设计甚至与竞品雷同。因此第二步并未急于继续生成,而是将最满意的主视觉反向输入Brand Kit系统。

这一操作的本质是商业设计规则的数字化沉淀。实现过程极其简约:仅需上传品牌视觉基准图,系统即自动完成解析与提炼。

Lovart会智能提取图中已呈现的品牌语言要素,转化为可复用的标准化参数:

- 主色与辅助色色谱系统

- 字体风格与排版气质倾向

- 版式结构偏向杂志感或商业感

- 品牌核心关键词库

- 产品材质表现规范与氛围营造准则

至此,首张主视觉终于突破"单点作品"的局限,升华为可反复调用的品牌数字资产库。这也是Lovart区别于多数工具的核心价值所在——多数产品将惊喜停留在生成瞬间,而Lovart致力于解决更现实的工程问题:生成之后如何持续深化、高效延展。

在约束中高效创作,首发物料矩阵

Brand Kit的建立让后续工作进入快车道。所有素材均在既定规范体系内生长,彻底规避风格跑偏风险。

基于系统规范,我们批量输出了核心传播物料矩阵:

- 首发主海报

- 产品卖点海报

- 公众号头图

- 社媒封面图

首发主海报

产品卖点海报

公众号头图

社媒封面拼图

在传统workflow中,不同尺寸、信息密度、应用场景的物料极易产生视觉断裂。而本次产出无论产品标题调性、色彩搭配,还是版式布局,均呈现出高度统一的Campaign质感。Brand Kit的价值在此得到验证——前期构建系统,方能在执行阶段实现更稳、更快的冲刺。

仅有平面海报不足以支撑品牌完整性。让品牌"生长"并鲜活存在的,是触手可及的应用层物料。因此我们继续沿规范延展,一气呵成完成产品包装盒、手提袋、贴纸、礼盒小卡及快闪展示台效果图。全程零翻车,一次性成型。

产品盒/手提袋/贴纸

礼盒小卡

快闪展示台效果图

配合Lovart的Mockup与多角度预览功能,所有视觉素材均可无缝嵌入真实场景,甚至支持360度旋转查看,体验极为流畅。

闭环最终章,代言人传播内容

最终需要补充的是具备传播势能的内容。品牌上线不可能仅依赖静态海报,更需要"可发布、可传播"的社交化素材。代言人形象的构建成为必要环节。

代言人种草图

视频首帧/分镜图

动态预览

至此,整条链路实现真正闭环。回头看,成果已远超"产出几张优质图片"的范畴。我们已获得:

- 品牌首张主视觉

- 完整的Brand Kit系统

- 首发物料矩阵

- 包装与周边体系

- 人物传播图

- 视频内容框架

这意味着从一句模糊想法到一整套可投放的首发内容包,全链路已通过验证。

玩法拓展,创意平权的普惠价值

MacOS下Codex Chrome插件卡死无响应?两行pkill命令强制重置browser session急救指南

核心要点速览

Codex Chrome插件出现卡死现象,绝大多数情况下并非网络代理配置故障,而是底层browser session陷入僵死状态。通过执行两条精准的pkill强制终止命令,可直接重置整个浏览器控制链路,其修复效率远超传统的插件重装方案。

- 仅需命令数:2条终端指令

- 标准操作耗时:约10秒

- 实测问题解决率:高达90%

典型适用症状清单

- Codex界面可正常加载,但无法在新网页中激活功能

- 新建标签页后插件无法接管控制权限

- Chrome扩展图标点击无反馈或显示异常状态

- 已卸载重装插件但问题依旧存在

- 系统提示browser control卡死、extension disconnected或attach failed错误

- 单个浏览器窗口功能正常,多窗口场景下部分窗口失效

核心结论:browser session卡死是主因

许多用户第一时间将Codex插件失效归因于代理服务器异常,但深入分析表明,这仅仅是表象误判。真实的技术根源在于Codex后台维护的browser session状态机出现死锁,导致浏览器控制通道完全阻塞。而pkill -f Codex配合pkill -f Chrome的强制终止策略,能够彻底切断并重建整个会话生命周期,是当前最可靠的快速恢复手段。

卸载重装无效?揭秘Codex三层架构

普通用户尝试删除插件后重装却屡试不爽,根本原因在于Codex并非传统意义上的纯前端扩展。其技术栈包含三个紧密耦合的层级架构:

- Chrome插件层(用户可见的UI入口)

- 本地Codex后台服务(Native Host进程)

- 云端session/thread状态管理(远程会话存储)

单纯移除第一层插件外壳,对底层卡死的Native Host进程、滞留的WebSocket长连接以及僵死的browser control状态毫无影响。这种"隔靴搔痒"的操作方式无法触及问题本质,等同于未真正执行系统重置。

终极解决方案:两行pkill命令强制重置

第一步:完全退出Chrome浏览器

关键操作:必须使用Command + Q快捷键执行彻底退出,而非仅关闭窗口。此步骤确保所有Chrome衍生进程接收到终止信号。

第二步:启动macOS终端工具

通过Launchpad或Spotlight搜索"终端"(Terminal)应用并打开,准备执行底层进程管理命令。

第三步:依次输入并执行以下指令

pkill -f Codex

pkill -f Chrome

每行命令输入后均按回车键确认,系统将立即强制执行进程终止操作。

技术解析:pkill命令如何重置browser session

这两条指令本质上是对Codex浏览器控制系统执行硬重启,其技术作用域覆盖:

pkill -f Codex:精确匹配并终结所有包含"Codex"标识符的后台守护进程,包括Native Host服务与状态维持线程pkill -f Chrome:强制关闭Chrome主进程及其全部子进程,彻底清除内存中残留的DOM状态与插件沙箱- 综合效果:完整重建browser session上下文,释放被占用的端口资源,初始化全新的WebSocket通信通道

操作后续:重启Chrome与Codex恢复流程

命令执行完毕后,无需额外配置或重启macOS系统。直接重新启动Chrome浏览器并激活Codex插件,超过90%的场景下功能会立即恢复正常。建议首次操作时观察插件初始化日志,确认无异常报错信息。

根源剖析:Browser Agent架构的固有缺陷

此类频繁卡死现象源于Codex的产品本质——它并非传统插件,而是一个完整的Browser Agent系统。其技术复杂度远超常规扩展:

| 产品类型 | 核心形态 | 代理模式 | 技术复杂度 |

|---|---|---|---|

| Cursor | Agent IDE | 集成开发环境代理 | 高 |

| Claude Code | CLI Agent | 命令行界面代理 | 中 |

| Codex Browser | Browser Agent | 浏览器终端代理 | 极高 |

该架构需要实时控制网页、管理多标签生命周期、跟踪DOM树变化、持久化浏览器状态并维持双向WebSocket连接。作为早期Browser Agent技术方案,其状态管理模块与异常恢复机制尚未成熟,导致稳定性表现欠佳。

Mac本地部署DeepSeek V4 Flash完整指南:antirez的ds4.c引擎实战教程

开源项目

核心速览

ds4.c 是 Redis 创始人 antirez 专为 DeepSeek V4 Flash 打造的 macOS 原生推理引擎。该项目并非简单封装或二次开发,而是从 Metal 计算内核到 HTTP 服务接口实现了完整技术栈的自主研发。采用 2-bit 量化技术后,仅需 128GB 内存的 MacBook 即可运行,在 M3 Ultra 平台上实测文本生成速度达到每秒 36 个 token。

36

生成 t/s

1M

上下文

128

最低 GB

入门指引:ds4.c适用人群与使用场景

推荐使用人群

配备 128GB 以上统一内存的 Mac 设备用户(M3 Max 或 M3 Ultra 机型),希望在本地环境部署高性能推理模型,避免依赖云端 API 并确保数据隐私安全。适合具备基础命令行操作能力的开发者或 AI 工具深度使用者,预计花费 10 分钟即可完成部署配置。

不建议使用人群

设备内存仅为 16GB 或 32GB 的 MacBook 用户——该项目设定了 128GB 的硬性内存门槛。同时,仅希望通过网页界面与 AI 交互、不愿接触终端操作的用户也不适合选择此方案。

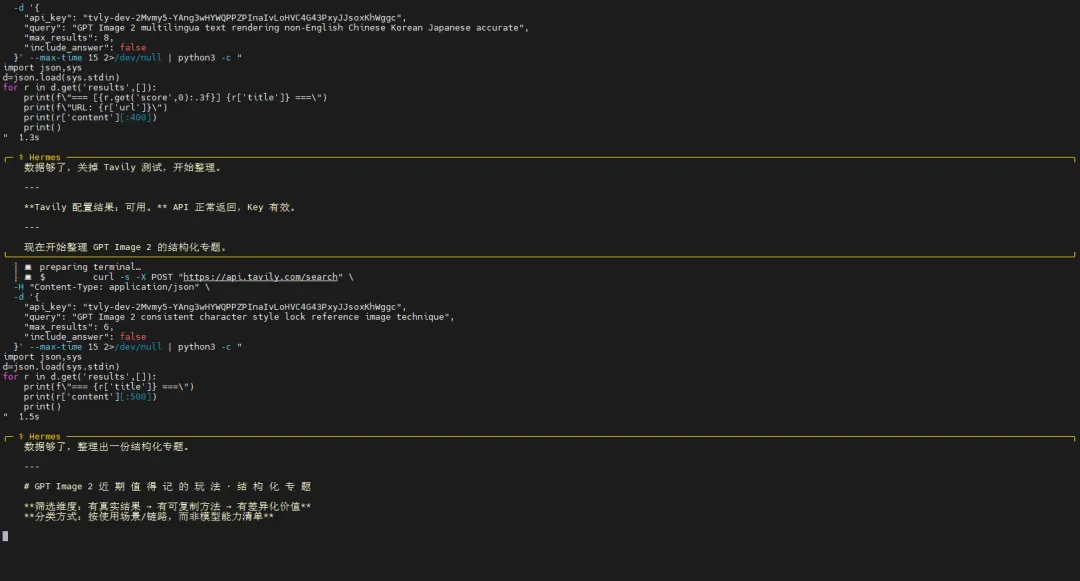

MiniMax M2.7驱动的自学习写作系统:Hermes Agent实现热点追踪到内容生产的自动化闭环

当GPT-Image-2大模型以碾压之势颠覆行业认知时,AI内容创作领域正经历一场静默的生态重构。这场技术浪潮不仅改写了模型能力的疆界,更催生出一种全新的内容生产范式——从人工追热点到智能体自动进化的系统性跃迁。

传统模式下,创作者需在各大平台高频检索、手动筛选、深度模仿,这种依赖人工的追踪机制在短期内尚可维系。但随着热点迭代周期从周级压缩至小时级,信息洪流带来的认知负荷已远超人类处理阈值。今日刚完成玩法提炼,明日便可能涌现数十个新兴案例。这种持续性的认知消耗,倒逼我们必须重新思考:当Agent架构与大模型能力已臻成熟,能否构建一套自主进化的系统,将热点追踪与内容创作全链路自动化?

这一设想促使我们启动了专项工程。初始目标仅为追踪GPT-Image-2单一热点,但在Hermes Agent与MiniMax M2.7模型的协同驱动下,系统意外展现出强大的泛化能力,自动演进为通用型工作流架构。该架构通过四级流水线实现闭环:X平台热点捕获→GitHub方法论解析→Skill沉淀→文章自动生成。

技术架构的底层逻辑

该任务场景呈现出典型的非单点特征——需持续检索、智能分类、动态去重、上下文保留,最终完成流程固化。Hermes Agent在此展现出独特优势:其原生工作流引擎可自主判断任务委派时机,动态拆解子任务,并自动归集执行结果。开发者仅需定义顶层目标,系统即自行决策多Agent协同策略与Skill沉淀节点。

模型层选用MiniMax M2.7,核心考量在于三重稳定性保障:长程任务不漂移、多轮信息整理保真、复杂内容聚合输出可控。在长流程推理、信息密集处理与稿件生成关键环节,该模型展现出卓越的语义理解、筛选归并与结构化重组能力,为系统可靠性提供底层支撑。

四级流水线实现路径

第一阶段:X平台热点智能捕获

部署Hermes Agent执行GPT-Image-2热点专题构建任务,通过以下指令集实现:

你现在要为我完成一个AI热点内容项目的第一步:在X平台上追踪GPT Image 2的热点玩法,并整理出一份结构化的热点专题。

目标:

1. 搜索最近高质量的GPT Image 2相关帖子、案例、讨论和玩法

2. 自动完成分类、去重、筛选和归纳

3. 判断哪些玩法值得持续追踪,哪些更适合短期围观

4. 输出一份适合后续写作使用的热点专题资料

请你自己根据任务复杂度决定是否调用子代理,并行处理不同方向。你不需要等我拆任务。

筛选标准:

- 优先保留可复用、可进入内容工作流、可总结成方法的玩法

- 过滤低信息密度内容、重复转发、纯炫技案例

- 每个保留案例都要说明:为什么值得记、适合什么内容场景、后续是否值得继续追

输出要求:

第一部分:热点总览

- GPT Image 2这波热点主要分成哪几类

- 哪几类热度最高

- 哪几类最值得内容创作者关注

第二部分:玩法分类

- 请你自行分类,并给每个分类命名

- 每个分类下列出代表案例

- 每个案例包含:链接、作者、时间、玩法说明、价值判断、适合写什么内容、风险提示

第三部分:写作建议

- 如果后续要写成公众号文章,优先应该追哪3类

- 每一类最适合的写作角度是什么

请直接开始执行,并在最后给我一份完整的Markdown结果。

为增强数据获取能力,系统集成Tavily搜索引擎与SocialData平台的双通道数据源,该配置在保证数据质量的同时具备成本效益优势。

首批输出结果呈现高度结构化特征,包含溯源信息、价值标注与完整提示词方案,为后续内容生产提供优质原料。

基于该专题资料快速产出的公众号文章验证了流程效率:我用爱马仕扒了X平台上50个GPT-Image-2爆款Prompt,全部带效果图,直接抄!

第二阶段:方法论深度学习

获取热点数据后,系统并未直接进入写作环节,而是执行知识萃取任务:深度解析GitHub仓库baoyu-skills中的Skill设计范式。此阶段的核心目标并非复用现成Skill,而是解构优秀Skill的演进逻辑——任务边界设定、输入输出约束、提示词工程、工作流拆解等元设计思想的提取。

提示词设计如下:

基于你刚才完成的"GPT Image 2热点专题",现在请继续执行第二步任务:

深度学习GitHub仓库JimLiu/baoyu-skills,总结这个仓库里优秀skill的共同特点,并在此基础上为我设计一个新的"一键式写作skill"。

你的目标有两层:

第一层:学习和总结

1. 深度理解baoyu-skills的整体结构

2. 观察这个仓库里skill的写法、任务边界、输入输出约束、提示词组织方式、工作流拆解方式

3. 总结:哪些设计经验最值得迁移到内容写作场景

第二层:沉淀新的skill

请基于前面总结出的经验,设计一个新的Hermes skill:

一键式写作skill

这个skill的用途是:

输入一组AI热点信息或热点专题资料,自动完成:

- 选题判断

- 写作角度拆解

- 标题方案生成

- 文章框架设计

- 段落逻辑安排

- 正文初稿生成

你需要完成的内容包括:

1. baoyu-skills仓库的结构总结

2. 优秀skill的共同特点总结

3. 哪些方法适合迁移到公众号写作场景

4. 一键式写作skill的设计思路

5. 一份接近可直接写入SKILL.md的完整草案

6. 一个测试示例:如何把刚才整理出的GPT Image 2热点专题,输入这个新skill,生成文章方案和文章初稿

输出格式:

A. baoyu-skills结构总结

B. 优秀skill的方法提炼

C. 一键式写作skill设计说明

D. SKILL.md草案

E. 测试示例:基于GPT Image 2热点专题生成文章

Hermes Agent在此阶段展现出自省能力,主动分析仓库架构、任务拆解逻辑、约束条件设计,并提炼出可迁移至内容创作场景的设计模式与组织方法论。