MinIO 开源续命成功:3 天修复 4 个高危 CVE,AI 协作维护实战记录

距离立下那个 flag 已经过去两个月。当时我在《MinIO 已死,MinIO 复生》中宣布接盘上游跑路后留下的烂摊子,专职负责 CVE 漏洞修复工作。那篇文章曾一度登上 Hacker News 首页头条数小时,收获了不少鼓励,也招来不少质疑:单凭个人力量,真的能维护好这种规模的基础设施项目吗?

这个问题确实值得探讨。因为真正的考验从不是点击 fork 按钮那一刻,也不是修改 README 文档的时候,而是当安全漏洞真的找上门来之时。现在,我可以交出答卷了。

4 月 15 日至 17 日,短短三天内,pgsty/minio 发布了 RELEASE.2026-04-17 版本,连续修复并关闭了 4 条 CVE 及数条同期披露的安全漏洞,涵盖 OIDC JWT 算法混淆(CVSS 9.8)、LDAP 登录用户名枚举与暴力破解、复制头元数据注入导致对象不可读、S3 Select 超大记录打穿内存,以及两条 unsigned-trailer 写入路径上的签名绕过。

A promise made, a promise kept.

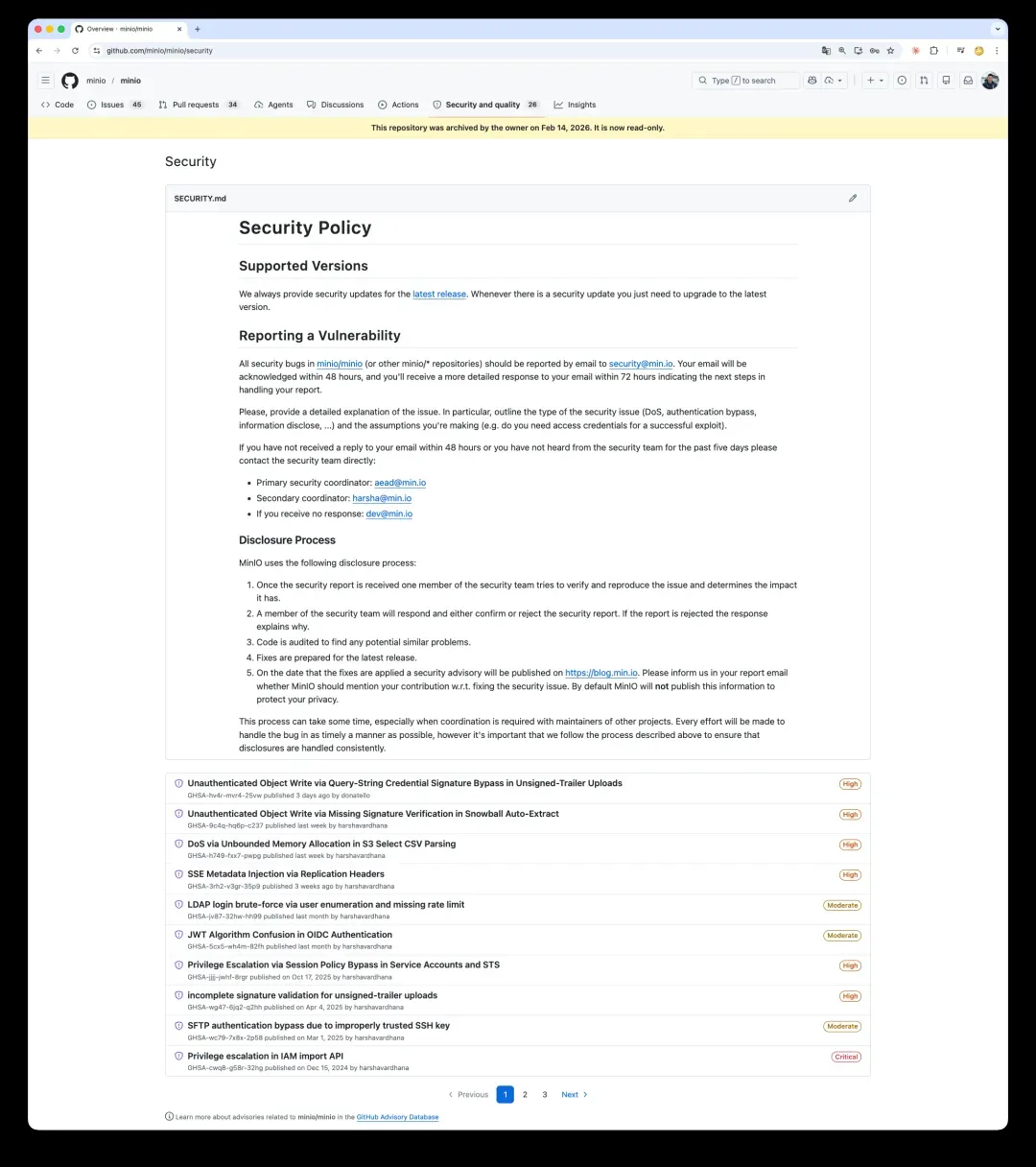

上游究竟发生了什么

2025 年 12 月,MinIO 将开源仓库切换至维护模式。README 文档中声称 “安全修复会逐例评估”。到了 2026 年 2 月,仓库直接被归档,首页显示 “当前仓库已经不再维护”。但同一仓库的 SECURITY.md 文件仍保留着:“我们总会为最新版本提供安全更新” 的承诺。

就在最近一个月,MinIO 接连爆出四个高危漏洞和两个中危漏洞,波及最后的开源版本。官方公告中明确表示:商业版本 AIStor 已修复这些问题,给开源用户的唯一建议是"升级到 AIStor"。

顺便提醒,MinIO AIStor 的入门起步价约为每年 10 万美元,包含 400 TiB 容量,单价基本与 AWS S3 持平——这实在离谱,毕竟这仅仅是纯软件。这是一种精巧的商业策略:仓库归档,道义责任撇清;但 CVE 通告照发,既能刷一波"我们很负责任"的存在感,又恰好能将用户驱赶到商业版的羊圈中。

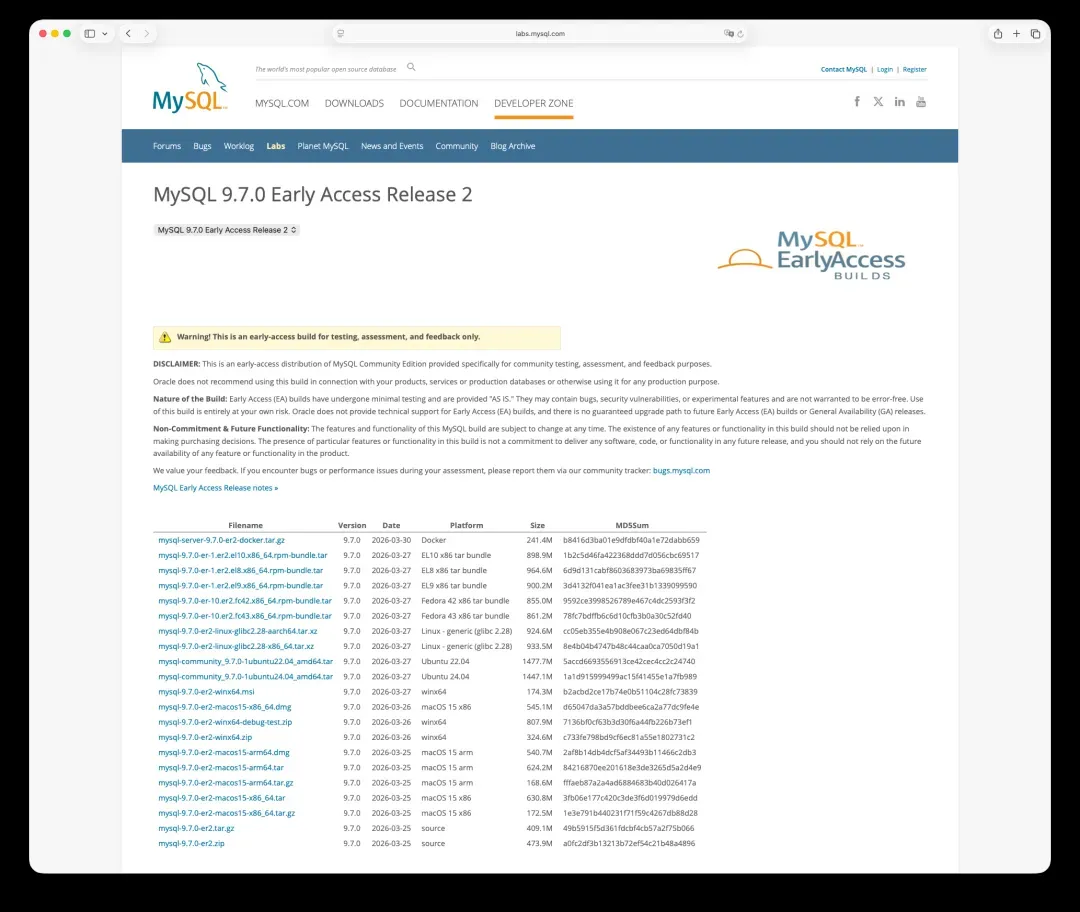

MySQL 9.7 LTS正式发布深度解析:八年支持难掩创新乏力,Oracle治理困局与PostgreSQL完胜之路

两年前 MySQL 9.0 发布之际,我曾在《MySQL 安魂九霄,PostgreSQL 驶向云外》一文中剖析过,Oracle当时大张旗鼓地推出所谓的创新版本,仅仅添加了个VECTOR数据类型就敢宣称"AI时代的数据库"。我一眼看穿:这玩意儿本质就是BLOB套了个马甲。没有距离函数,没有向量索引,除了能往列里塞一堆浮点数之外什么也干不了。之后的两年间,从9.0到9.6共推出了七个创新版本,每季度准时发布。然而Percona对这些版本连眼皮都懒得抬一下。PMM遥测数据显示,Innovation Release的市场采用率始终在1%附近挣扎,连被统计的资格都没有。这家全球最大的MySQL第三方生态公司,用无声的沉默投下了反对票。

为何现在要聚焦9.7?因为这是MySQL 9.x系列首个LTS长期支持版本:5年标准支持+3年扩展支持。此前七个Innovation Release不过季抛型过渡品,Percona不跟进,用户不敢碰,所有人都在苦等这个LTS落地。更何况MySQL 8.0将在2026年4月停止维护,存量用户必须迁移,9.7几乎成了唯一的出路。

某些公众号作者已然开始惊呼——“MySQL 9.7震撼发布!性能飙升!““让MySQL迈入AI时代!"——尽管截至2026年4月,这玩意儿连正式版都还没发布,仅是3月底放出了个早期测试二进制包。我反正下载下来体验了一番——

端上来的还是那碗隔夜饭。

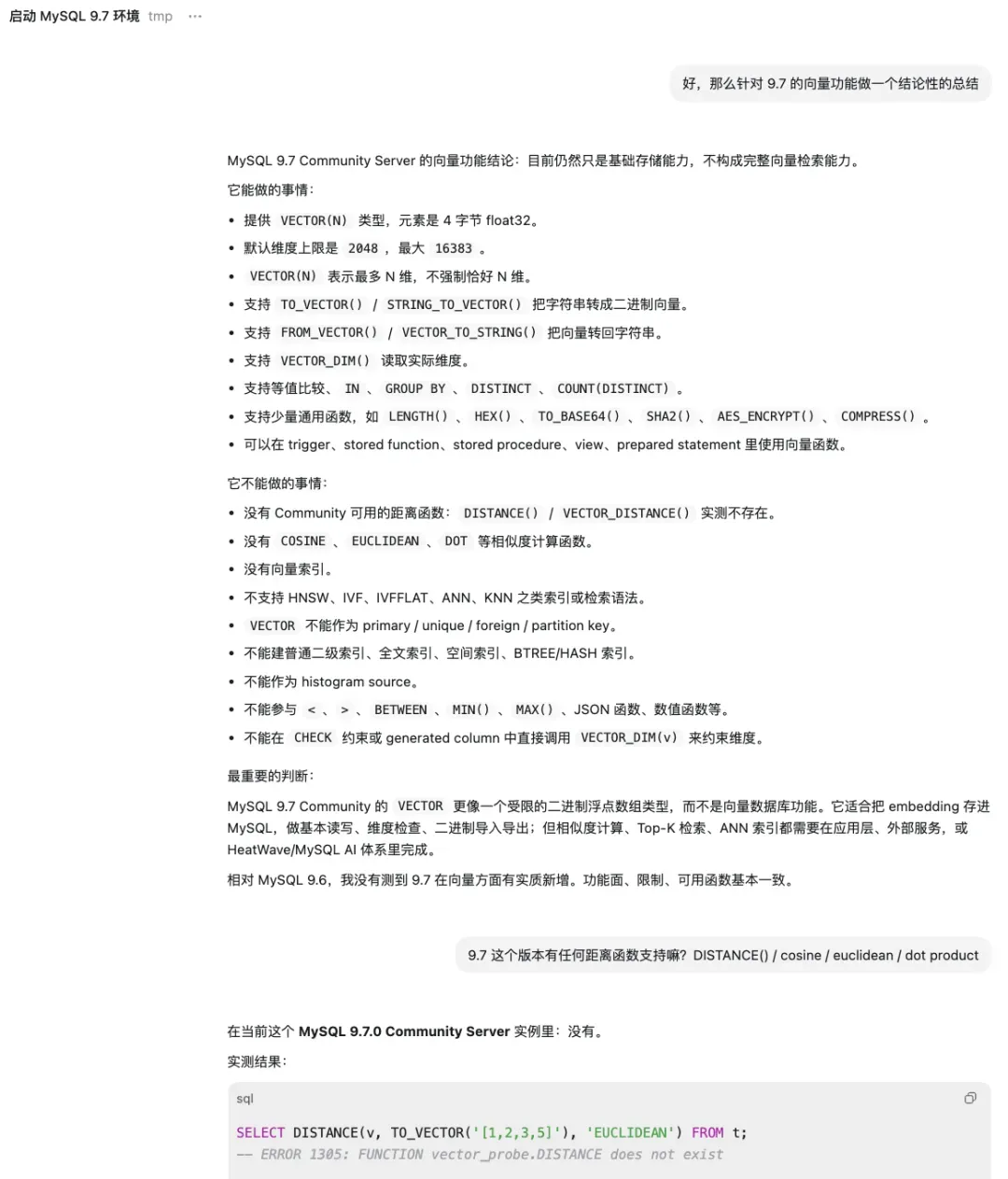

中看不中用的向量功能

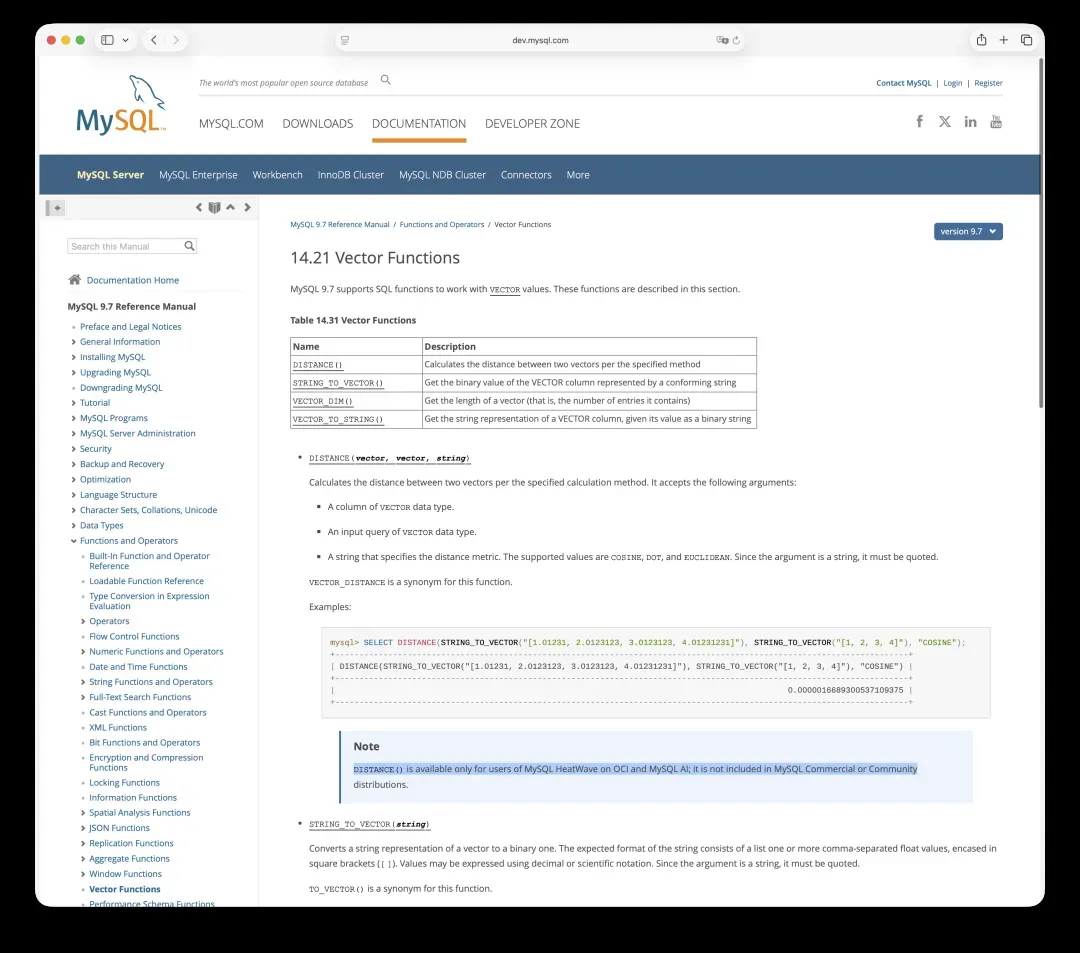

翻开MySQL 9.7参考手册第14.21章《向量函数》,整个向量模块既无向量索引,也无最近邻搜索能力,向量列不能作为主键、外键或唯一键,更不支持聚合函数。唯一算得上实用的Distance函数,居然还是付费专享功能。

老冯满腹疑惑,就这么个鸡肋功能,也值得Oracle藏着掖着,刻意放在商业版里膈应用户?MySQL何至于沦落至此?连自家人都看不下去。MariaDB 11.7去年底已原生支持VECTOR INDEX+HNSW算法;TiDB推出了向量索引Beta版;PlanetScale用SPANN算法自研了一套;Google Cloud SQL for MySQL基于ScaNN实现了向量索引;VillageSQL直接fork了MySQL 8.4专攻向量场景;甚至个人开发者都写出了第三方向量插件。Oracle自己不做,别人想做还得另起炉灶。

HeatWave的宣传语怎么说的来着?“唯一具备向量能力的MySQL”。翻译成人话就是:想玩向量?请去OCI买我们的云服务。

姗姗来迟的查询优化器

9.7总算拿出了一项实质性更新:Hypergraph优化器总算向社区版开放了(WL #17265)。MySQL传统优化器只能生成左深树JOIN执行计划,表一多就依赖贪心启发式剪枝,极易选出劣质方案。新的Hypergraph优化器基于DPhyp算法支持浓密树,通过动态规划寻找最优JOIN顺序,理论上能挖掘更优执行计划。

听着挺美。然鹅——这玩意儿2021年就有了,在Enterprise和HeatWave里捂了整整五年才肯放出来;放出来后默认还是关闭状态,必须手动执行SET optimizer_switch='hypergraph_optimizer=on';开启后不支持除STRAIGHT_JOIN外的任何hint,也不兼容TRADITIONAL和JSON格式的EXPLAIN。 一旦优化器抽风,你连干预手段都没有,直接在生产环境裸奔。

PostgreSQL的标准规划器早就能通过动态规划枚举+浓密树计划处理复杂JOIN,表多了自动切换GEQO遗传算法,经过二十多年的生产环境锤炼稳如泰山。恭喜MySQL,直到2026年才让社区用户摸到这扇门的门槛——功能有了,但默认给你关着。

其余更新细数看

外键实现终于重构了。 MySQL的外键逻辑一直内嵌在InnoDB引擎中,导致级联操作无法正确写入binlog,主从复制在外键级联场景下数据一致性毫无保障。这个存在了二十多年的缺陷,直到9.6才将外键上移至SQL层修复(WL #11249)。当年阿里开发规约严禁使用外键,追根究底或许正是因为MySQL的外键本身就是个笑话。

JSON Duality Views的DML操作向社区版开放(WL #17246)。这项功能9.4才引入,此前增删改操作必须购买Enterprise版——左手开发功能,右手收门票,Oracle的传统艺能,颇具讽刺意味。类似功能PostgreSQL十几年前就已具备。

PBKDF2认证增强(WL #17160)。PostgreSQL早在2017年就将SCRAM-SHA-256作为默认认证方式,MySQL晚了整整九年。五个Enterprise组件下放社区——复制监控、流控统计这类运维工具,本就不该锁在付费版里。日期函数行为修正(WL #16895)——都2026年了还在修TIMEDIFF、DAYNAME的边界问题。Clone Plugin跨LTS克隆——8.0即将EOL,升级路径必须8.0→8.4→9.7三级跳,不允许跨版本。

OpenSSL升级至3.5.0,zlib升级至1.3.2——连依赖库版本更新都值得写进Release Note里。

这就是三年七个创新版本攒出来的LTS答卷。

反观PostgreSQL的蓬勃生态

吐槽完MySQL 9.7,不妨换个视角看看正一路高歌猛进的PostgreSQL。

去年发布的PG 18几乎把牙膏挤爆,今年PG 19已冻结特性,新功能令人目不暇接。但比内核更震撼的是扩展生态。还是向量搜索——MySQL那边连DISTANCE()函数都捂在HeatWave里三年不动。PG这边呢?不仅有pgvector这个业界标准:HNSW+IVFFlat、六种距离度量、多种向量类型、AVX-512硬件加速;连扩展的扩展都出现了——pgvectorscale基于DiskANN做流式优化,还有VectorChord(vchord)用RaBitQ量化压缩把成本打到谷底。同一个向量搜索,PG生态卷到极致,在精度、性能、成本、规模各维度做到了极致。MySQL那边?Oracle还把DISTANCE()当宝贝疙瘩攥在手里。

这类扩展在PG生态里有多少?仅我收录的Pigsty和PGEXT.CLOUD[1]上能直接使用的扩展就超过500个:PostGIS搞定地理空间、TimescaleDB啃下时序数据、Citus撑起分布式、pg_duckdb扛起分析型查询、pg_search做全文检索……这正是PG连续吃到三代技术浪潮红利的底层密码:极致的可扩展性。传统软件时代PostGIS吃下企业GIS市场,移动互联网时代JSONB完成对MySQL的反超,AI时代pgvector干翻一众专用向量数据库。三轮浪潮,PG次次接住,MySQL次次错过。一次是偶然,两次是巧合,三次就是必然。

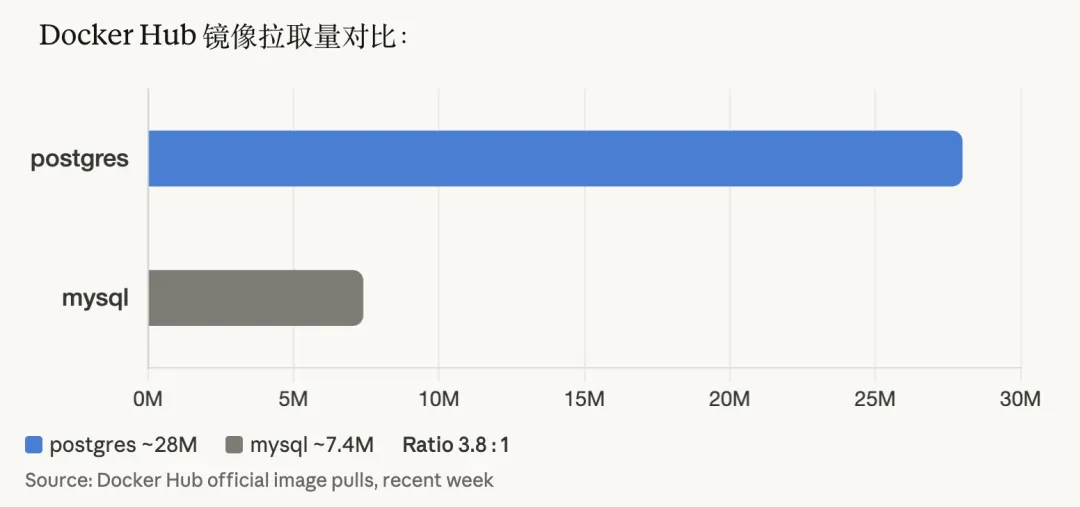

Docker Hub上的数据已然说明一切:PostgreSQL官方镜像的周下载量近乎MySQL的四倍。开发者正在用脚投票做出选择。

MySQL衰落根源探析:Oracle治理之痛

MySQL为何会沦落到这般田地?昔日的当红炸子鸡、互联网时代的宠儿,怎么就一步步走向衰落?除了架构本身的落后,我认为根源在于:MySQL并非真正意义上的开源项目。

代码以GPL协议公开没错。但"开源"有两层含义:代码公开是一回事,社区治理才是关键。PG的核心开发者来自几十家公司和独立贡献者,没有任何一家能独断专行。你在生态中的投入不会被某个"主人"一纸公告就收回。

MySQL呢?方向全由Oracle拍板。什么功能放社区版,什么锁在Enterprise,什么只在HeatWave独占——全是Oracle说了算。

去年的"GitHub停更"事件就很能说明问题。2025年下半年,mysql/mysql-server仓库提交数断崖式下跌,连续几个月几近"归零”。并非MySQL停止开发——而是Oracle转向封闭开发,外界只能看到黑箱。你想参与贡献?抱歉,Pull Request提进去石沉大海,公开的Bug Tracker都不是内部真正用的那个。与此同时,2025年9月传出Oracle大规模裁员MySQL工程团队的消息,Percona创始人Peter Zaitsev估计六七成工程师已离职。500多名开发者联名呼吁Oracle建立厂商中立的MySQL基金会——被拒绝了。后来Oracle声称"有了新的工程领导层,2026年会有新气象”。9.7大概就是这份"新气象"的首份答卷。大家也看到了——就这?

白嫖导致敝帚自珍,敝帚自珍加剧白嫖——Percona CEO在《Oracle最终还是杀死了MySQL!》一文中剖析得很透彻。AWS做了Aurora,阿里做了PolarDB-MySQL/X,腾讯做了TDSQL-M,各家基于MySQL内核竞争却无人回馈上游。Oracle被白嫖就把好东西锁起来。锁起来,社区更不愿贡献。MariaDB早早fork出走,Percona跳过所有Innovation Release,VillageSQL fork做向量,国内的TiDB/OceanBase也只是协议兼容来分蛋糕。一个本该百花齐放的生态,被它的主人抽干了活力,封死了可能性。

NAS进阶指南:Docker部署HandBrake打造24小时专业视频转码站(附核显加速优化)

HandBrake作为业界知名的开源视频转码解决方案,完全免费且功能专业全面。它兼容主流视频文件格式,能够将现有视频资源智能转换为适配各类终端设备的格式,包括智能手机、平板电脑、智能电视、游戏主机、桌面计算机以及网页端播放需求。

部署安装流程

通过Docker Compose实现快速容器化部署,配置如下:

services:

handbrake:

image: jlesage/handbrake:latest

container_name: handbrake

ports:

- 5800:5800

environment:

- TZ=Asia/Shanghai

- LANG=zh_CN.UTF-8

volumes:

- ./config:/config

- ./storage:/storage

- ./watch:/watch

- ./output:/output

- ./fonts:/usr/share/fonts

devices:

- /dev/dri:/dev/dri

restart: always

以下是核心参数配置详解(如需完整参数列表请参考官方文档):

:::

TZ(环境变量,可选):用于设置容器内部时区,建议与本地时间同步。

LANG(环境变量,可选):指定界面显示语言,设置为简体中文。

/config(路径映射):用于持久化存储应用配置文件。

/storage(路径映射):原始视频文件的输入目录。

/watch(路径映射):自动监控并触发转码的文件夹。

/output(路径映射):完成转码后的视频输出位置。

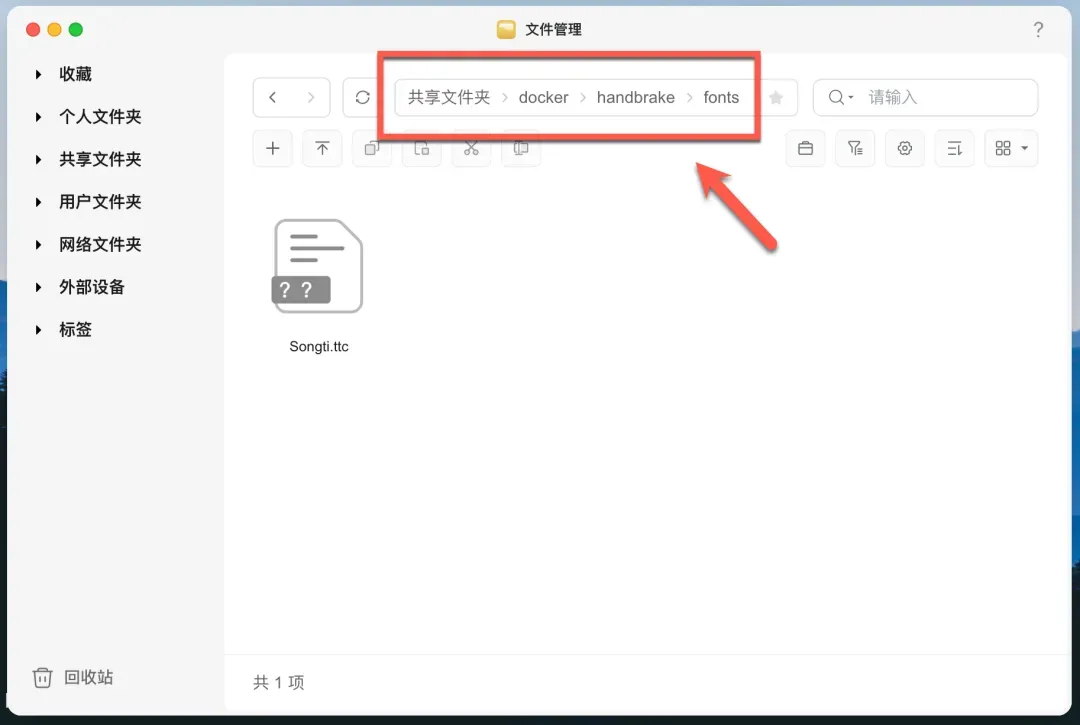

/usr/share/fonts(路径映射,可选):自定义字体存放路径,解决字幕乱码问题。

/dev/dri(设备映射,可选):开启Intel核显硬件加速功能。

:::

为确保字幕正常显示,需预先下载中文字体文件Songti.ttc。获取链接:https://pan.baidu.com/s/1bWBofZm-f-2ecDwX5QOS2g?pwd=cd2p,下载完成后请将字体文件放置于预先创建的/fonts映射目录中。

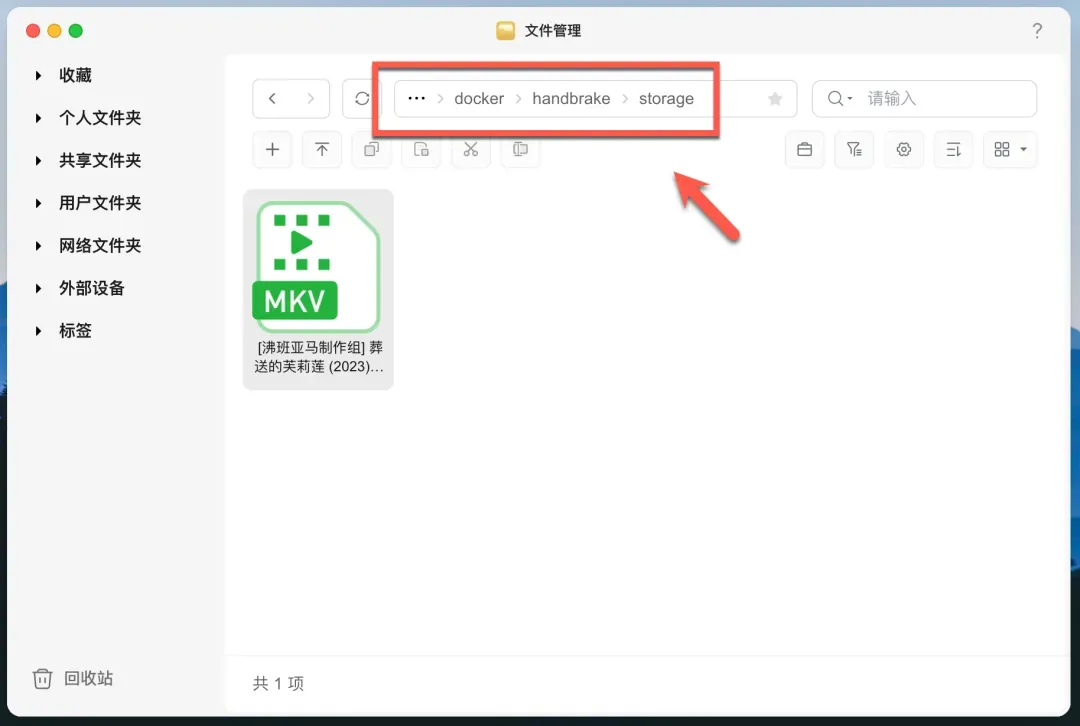

把待转码的原始视频文件上传至/storage挂载目录即可。

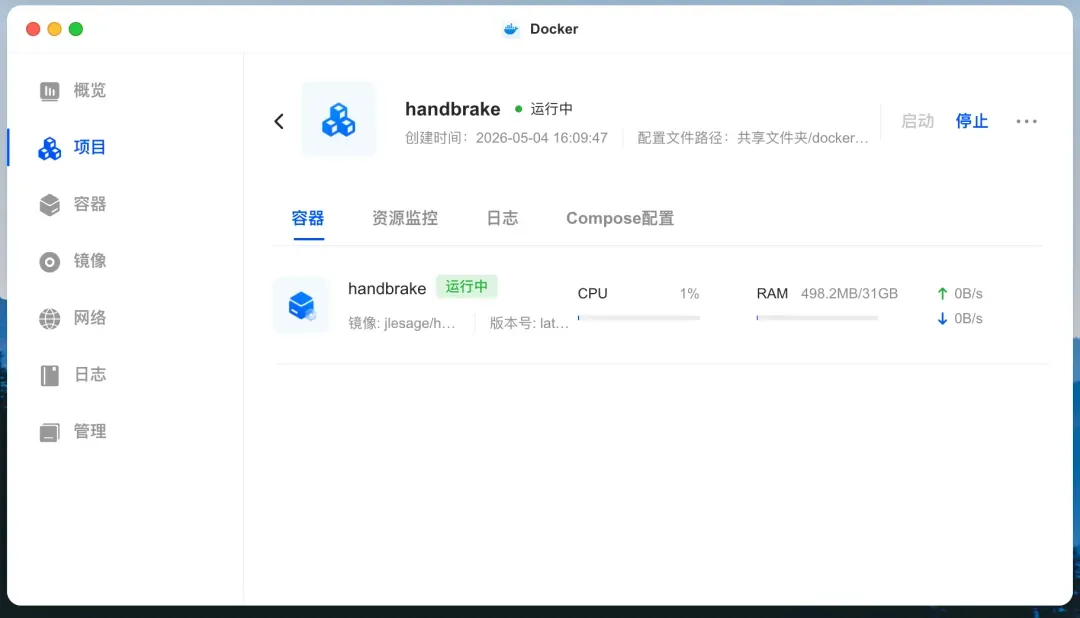

系统在空闲状态下资源占用极低,几乎不影响NAS正常运行。

操作使用详解

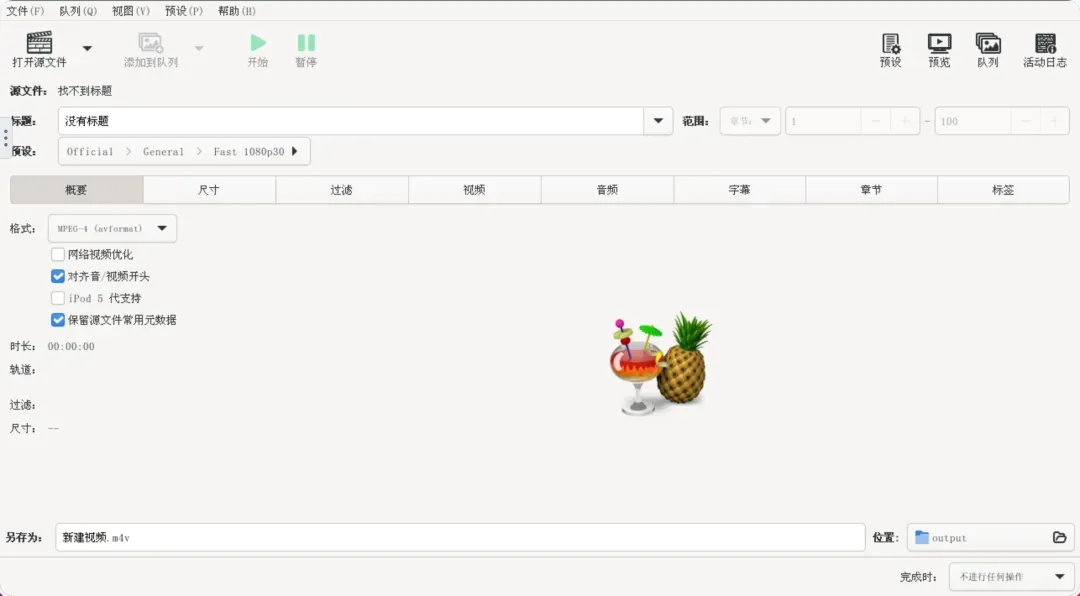

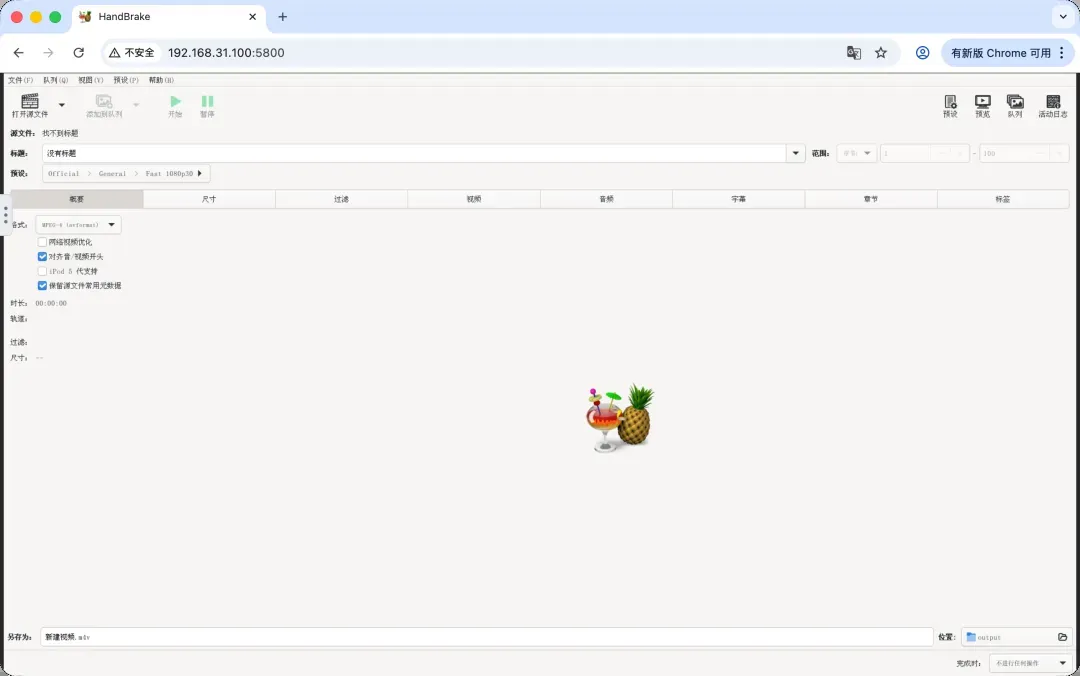

通过浏览器访问http://您的NAS_IP:5800即可进入HandBrake图形化管理界面。

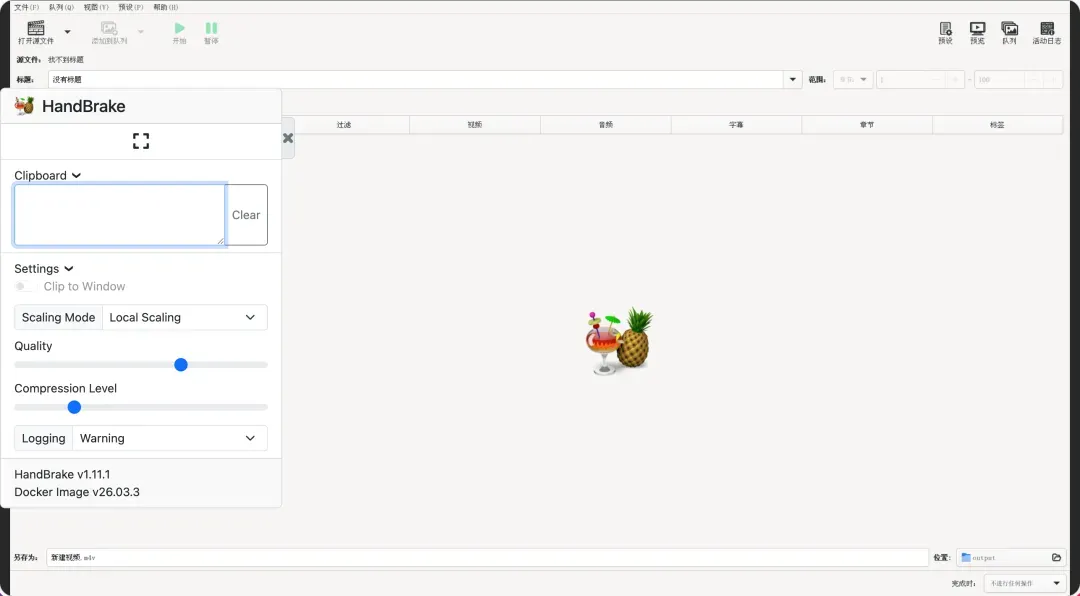

技术提示:此应用采用VNC技术封装在Linux容器中,通过远程桌面方式交互操作。

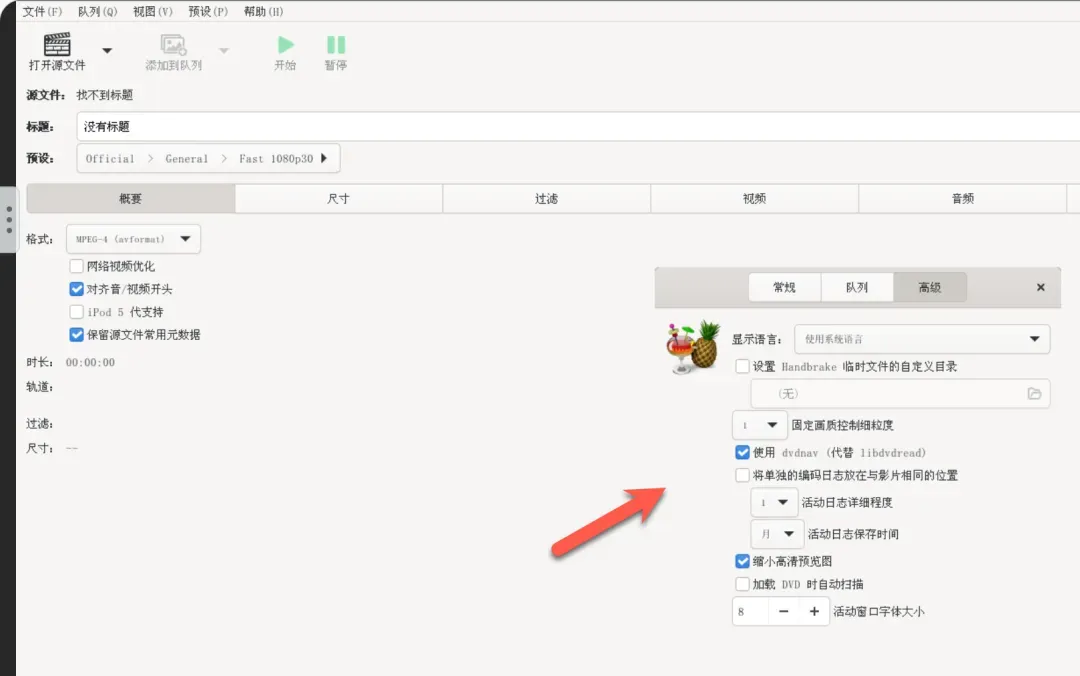

进入"文件"菜单下的"首选项"可查看详细配置项,接下来演示核心转码流程。

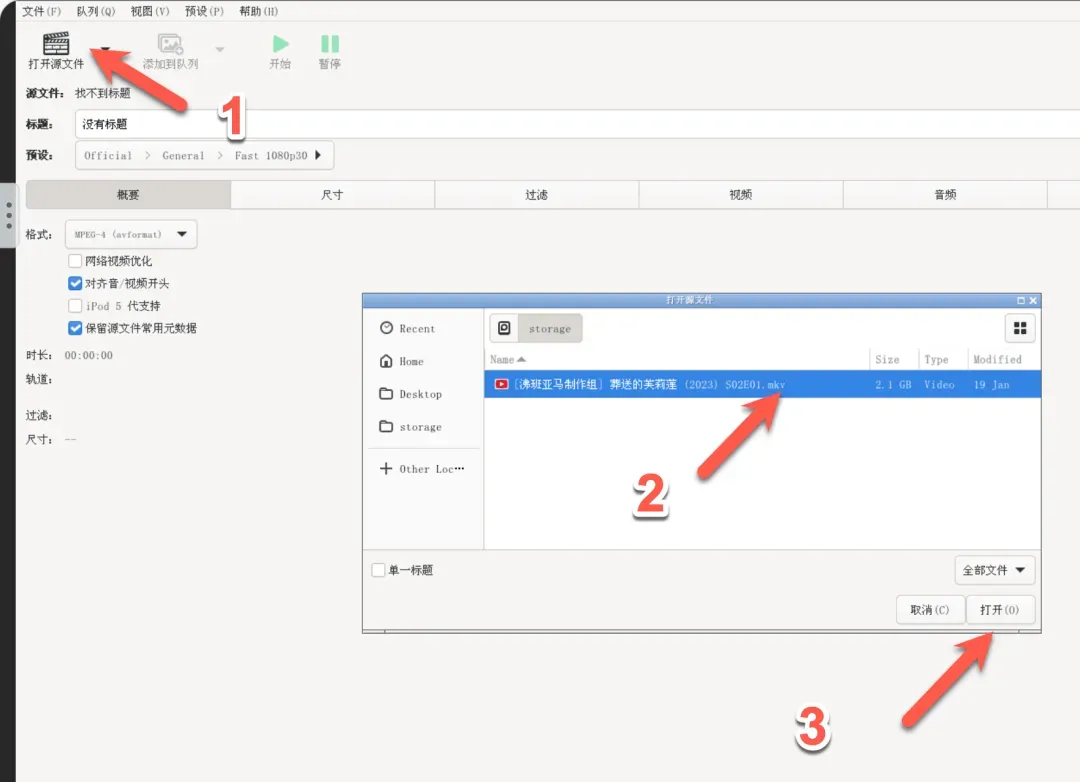

点击界面左上角"打开源文件"按钮,即可浏览并选择此前上传的视频素材。

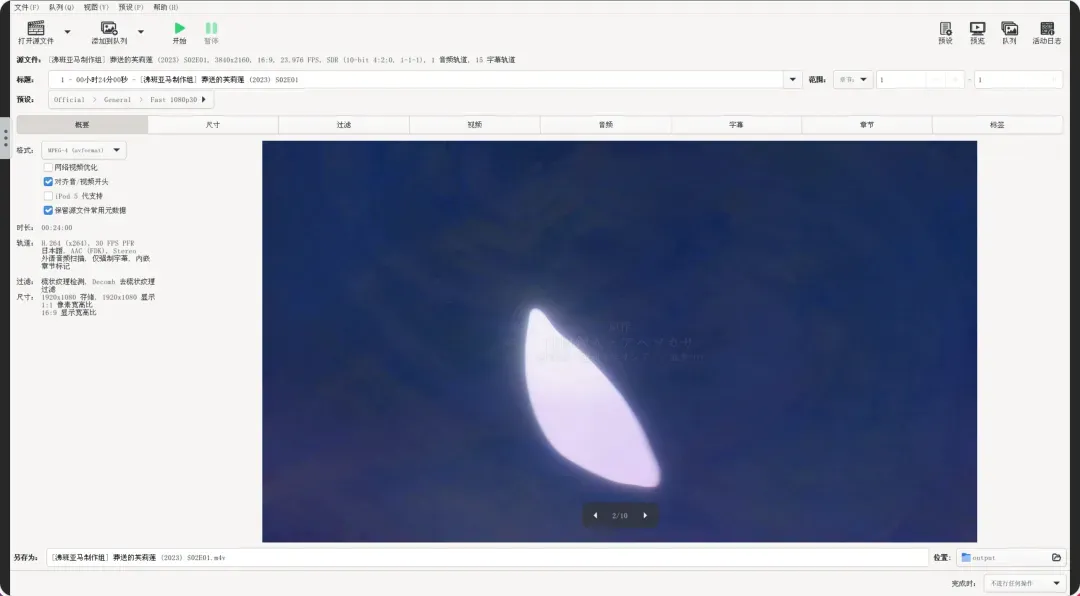

视频加载完成后,即可在右侧参数面板进行详细设置调整。

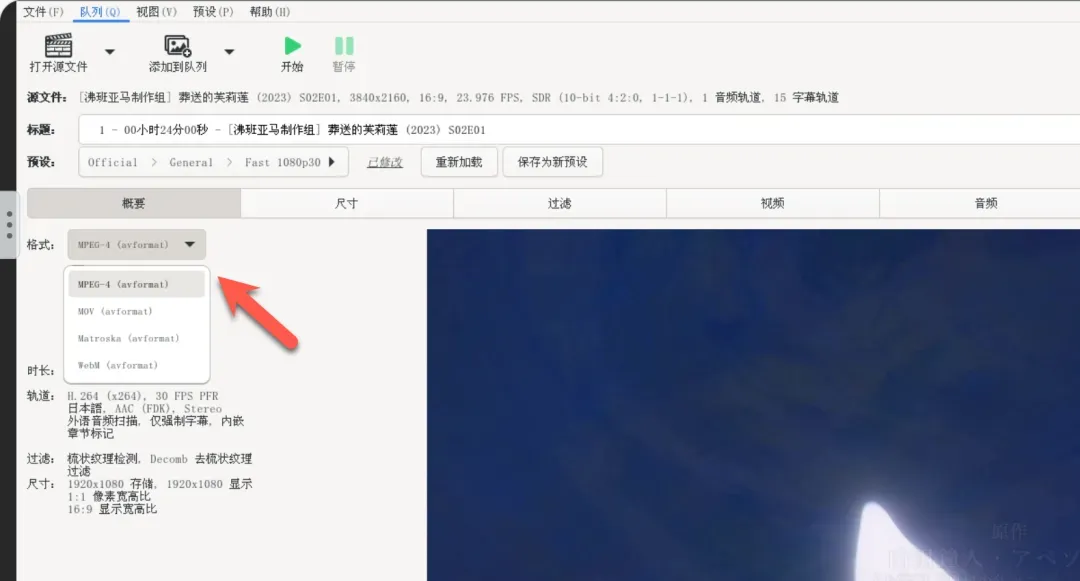

输出格式支持四种主流容器格式:MPEG-4、MOV、Matroska(MKV)和WebM,可根据播放设备兼容性灵活选择。

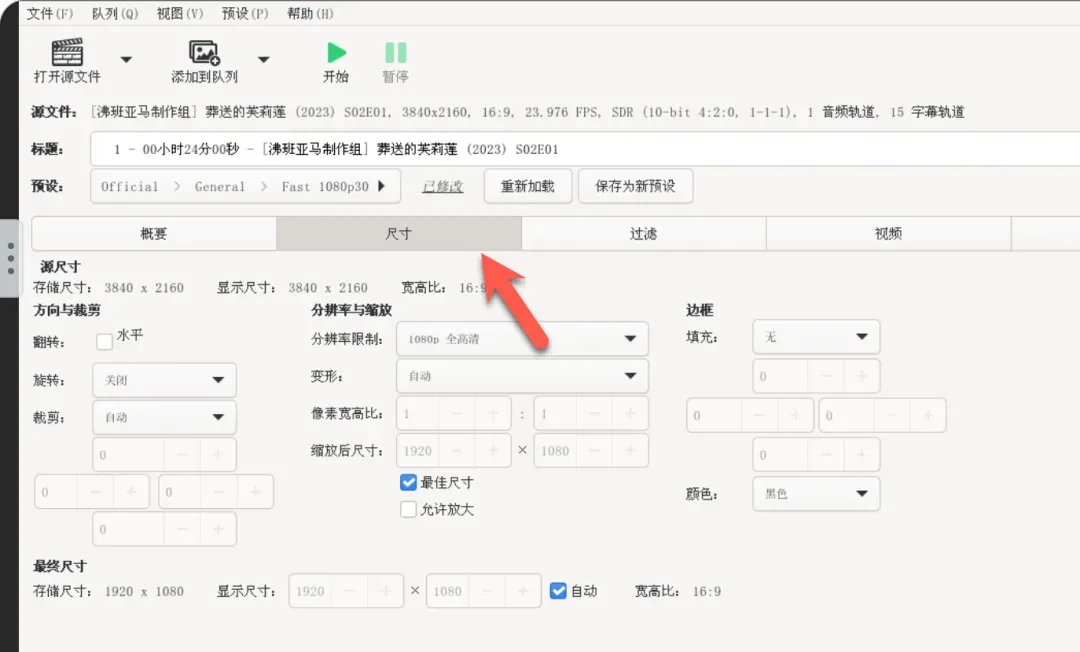

分辨率与尺寸参数支持自定义修改,本次演示采用默认原始尺寸。

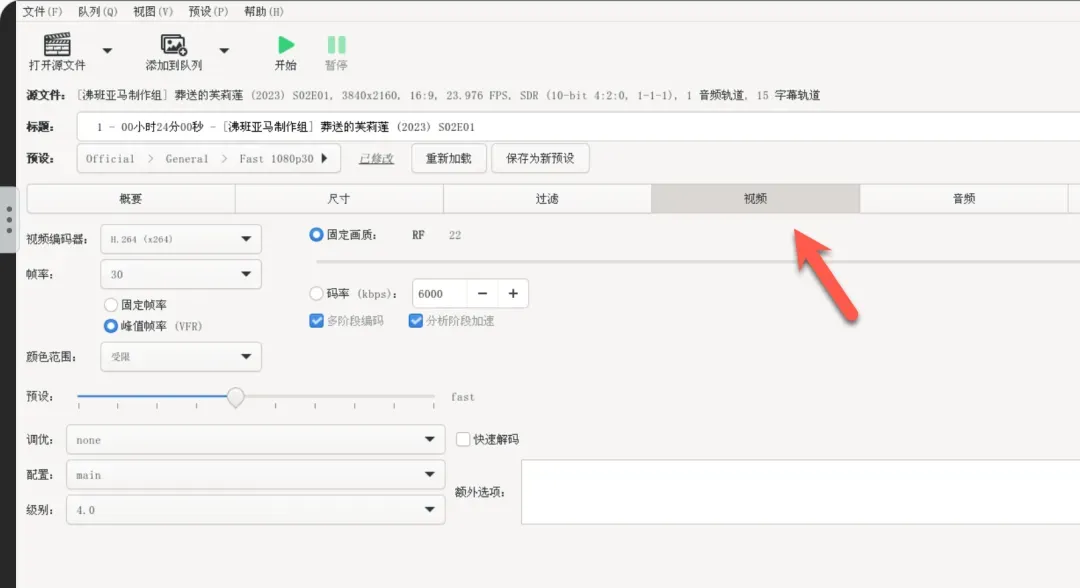

核心参数配置页面,可在此调整视频编码器与帧率设置,直接影响转码效率与画质。

编码器选项丰富,默认采用H.264 (x264)软件编码。本次测试将分别对比纯CPU与QSV硬件加速性能差异。

NAS快速部署PaintBoard开源画板:12种创意画笔功能详解与Docker教程

PaintBoard 作为一款颠覆传统的开源Web端创意绘画平台,凭借其丰富多样的画笔引擎与现代化的交互设计,为数字艺术创作注入了全新活力。这款工具不仅打破了常规绘画软件的局限,更通过十二种特色鲜明的绘画工具组合,为用户带来前所未有的创作自由度。

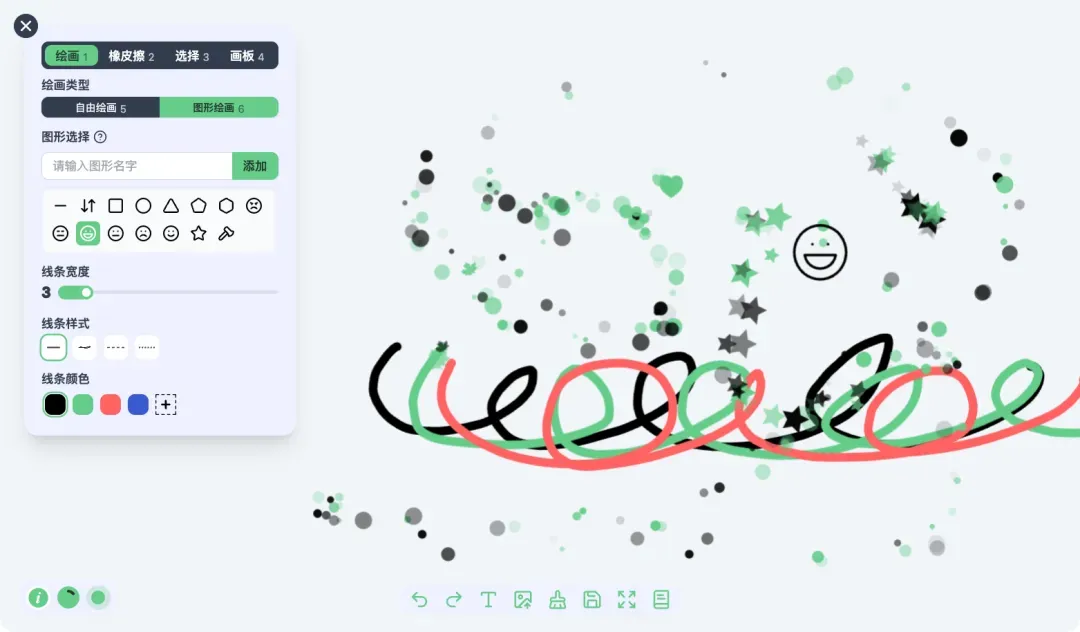

核心功能全面解析

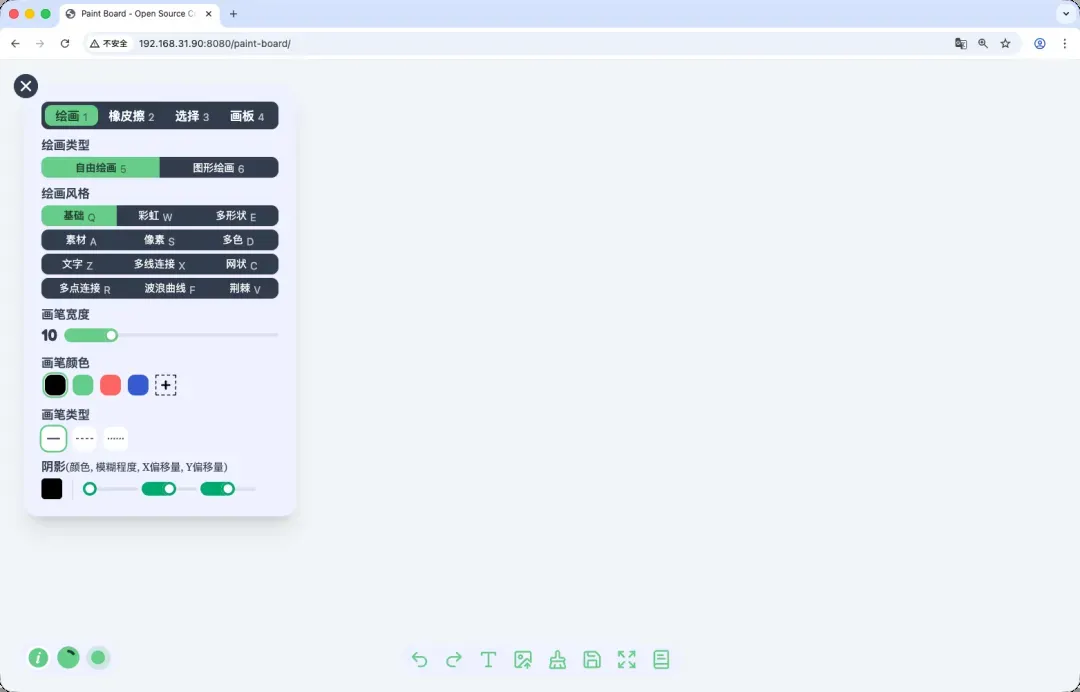

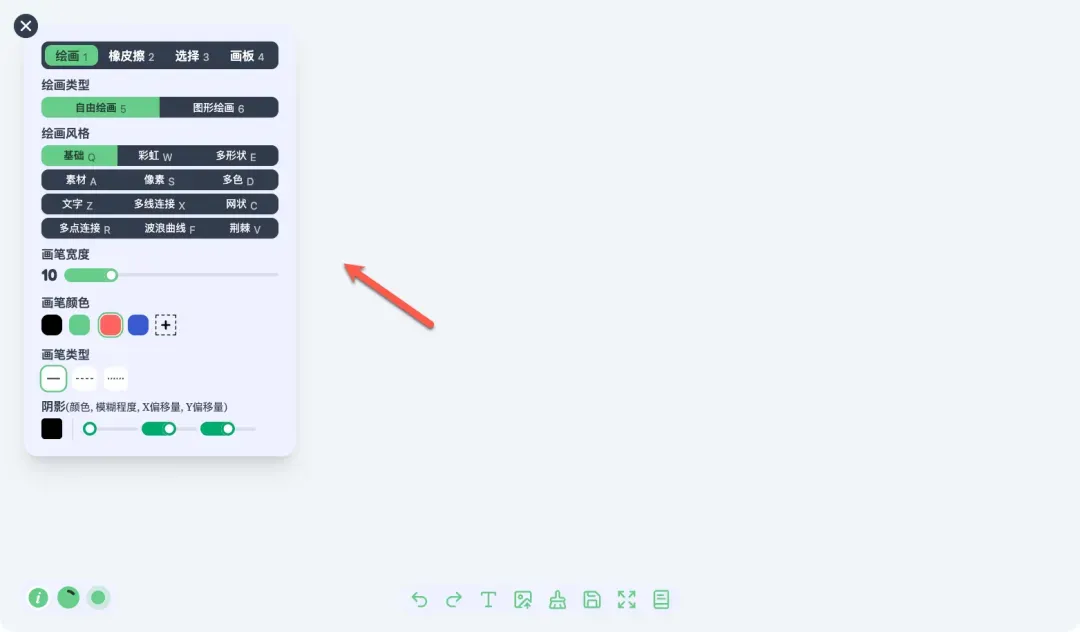

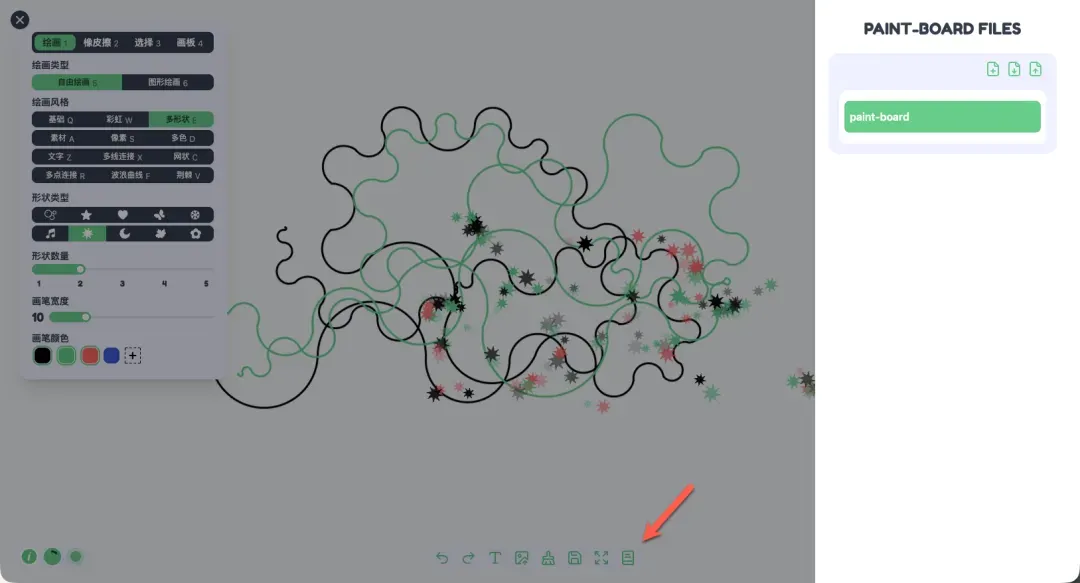

自由创作模式:系统内置十二种风格迥异的笔刷体系,涵盖基础画笔、彩虹渐变笔、多形状生成器、复合材质笔、像素艺术笔、多色混合笔、文本艺术笔、线性连接笔、网状结构笔、多点连线笔、波浪曲线笔以及荆棘纹理笔,全面覆盖从业余涂鸦到专业设计的各类创作场景。

智能图形绘制:内置几何图形库与Lucide图标集,支持一键插入矢量图形,并提供线宽调节、描边样式、填充色彩及填充模式等完整参数配置,让图形创作更加高效精准。

全能擦除系统:线性橡皮擦支持压力感应与宽度动态调整,可彻底清除任意图层内容,还原干净画布。

灵活选择工具:支持点选与框选两种选取方式,选中元素后可通过可视化控制手柄实现拖拽移动、缩放变形、旋转定位等操作,同时提供丰富的属性自定义选项。

画板管理系统:可自定义画布背景样式、精确调整尺寸参数,并支持全局绘画设置统一管理。

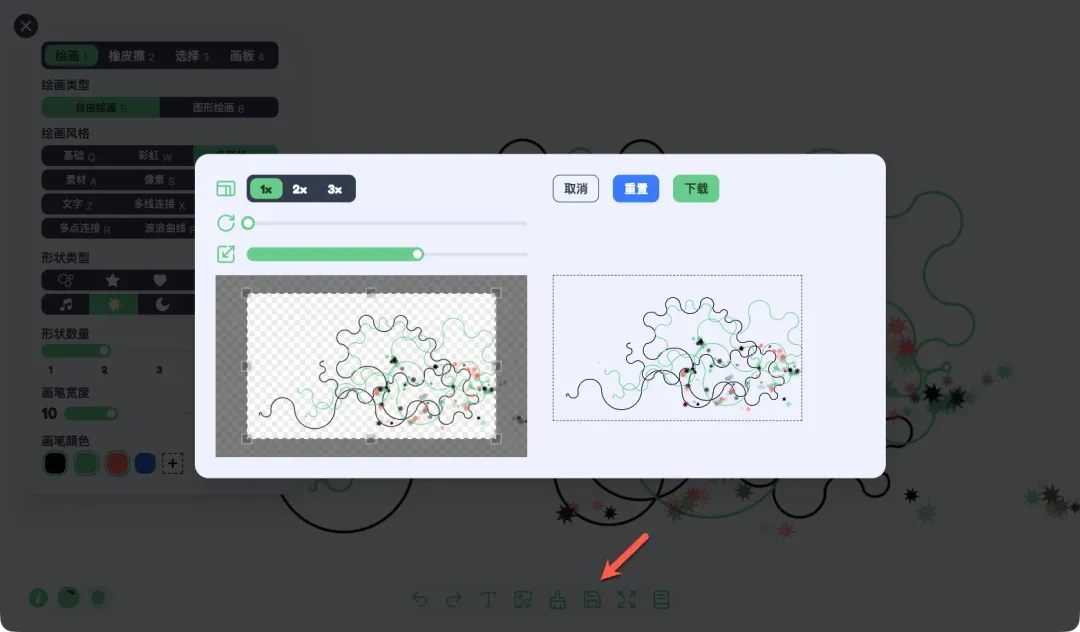

快捷操作面板:集成撤销、重做、复制选中、删除元素、文字输入、图片上传、清空画布、导出图像、文件管理等十大核心功能,从左至右布局符合人体工学设计。

多文档工作流:支持创建多个独立画布,每个画布可设置专属名称,提供增删、排序、数据导入导出等完整文件管理功能。

全球化语言支持:原生支持简体中文、繁体中文、英语、日语、韩语五种语言界面,满足不同地区用户需求。

在线体验地址:https://songlh.top/paint-board

一步式Docker部署方案

services:

paint-board:

image: heizicao/paint-board:latest

container_name: paint-board

ports:

- 8080:80

restart: always

快速上手指南

部署完成后,在浏览器地址栏输入 http://您的NAS_IP:8080 即可访问主界面,无需额外配置即可开始创作。

界面左侧陈列着十二种特色笔刷,每种工具都经过精心调校,从传统绘画到数字特效,从几何构图到自由表达,各类艺术风格均可轻松驾驭。

通过左下角设置入口,可切换界面语言并查阅完整的键盘快捷键映射与功能操作手册。

画板交互逻辑遵循直觉化设计理念,新用户无需学习成本即可快速掌握基础操作。

重要提示:所有绘画数据默认存储在本地浏览器缓存中,不会自动同步至服务器端,请务必及时使用导出功能保存重要作品。

平台支持创建多个独立画布,并提供绘画数据的批量导入导出功能,便于项目管理和版本控制。

深度评测与适用场景分析

PaintBoard采用前端Web技术与Fabric.js图形引擎构建,具备轻量化架构与开箱即用的特性。虽然功能不及专业级软件深入,但在个人艺术实验、在线教学演示、快速原型草图等轻量级场景中表现出色,填补了简易工具与复杂软件之间的市场空白。

综合推荐:⭐⭐(特别适合个人创作者与教育工作者)

交互体验:⭐⭐(界面简洁,响应迅速,功能聚焦)

部署难度:⭐(Docker方案一键部署,运维成本极低)

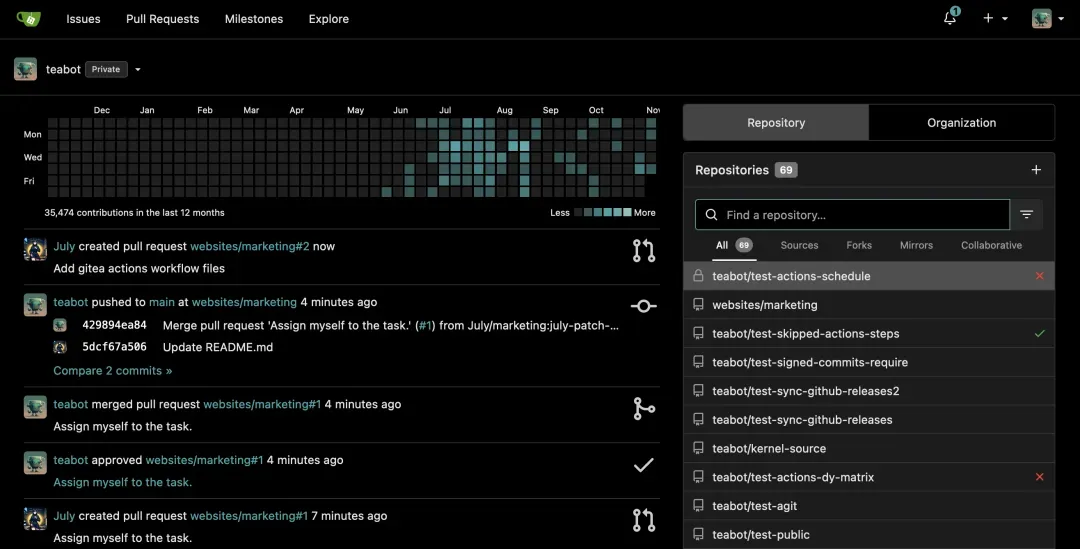

NAS私有Git代码托管方案:Gitea轻量级部署完整指南

Gitea作为轻量级自托管Git服务平台,不仅提供代码托管功能,还集成了DevOps协作能力。其核心设计理念在于实现极简部署与超低资源占用,为寻求私有化GitHub替代方案的个人开发者与小型团队,提供覆盖软件开发生命周期全过程的高效协同解决方案。

Docker Compose部署方案

采用容器化部署方式可最大限度简化安装流程,以下为经过验证的Docker Compose配置示例:

services:

gitea:

image: gitea/gitea:latest

container_name: gitea

ports:

- 3000:3000

- 2221:22

environment:

- USER_UID=1000

- USER_GID=1000

volumes:

- ./data:/data

- /etc/timezone:/etc/timezone:ro

- /etc/localtime:/etc/localtime:ro

restart: always

配置参数技术解读(更多高级参数建议参考官方文档):

:::

3000端口:Web服务访问端口,默认HTTP协议

2221端口:Git SSH服务端口,需与容器内22端口映射

USER_UID:指定运行用户ID,确保数据卷权限匹配宿主机

USER_GID:指定运行用户组ID,实现精细权限控制

/data路径:核心数据持久化存储目录

/etc/timezone:时区配置文件只读挂载,保证容器时间同步

/etc/localtime:本地时间文件只读挂载,确保日志时间准确

:::

平台使用指南

完成部署后,通过浏览器访问http://NAS设备IP地址:3000即可进入初始化界面。

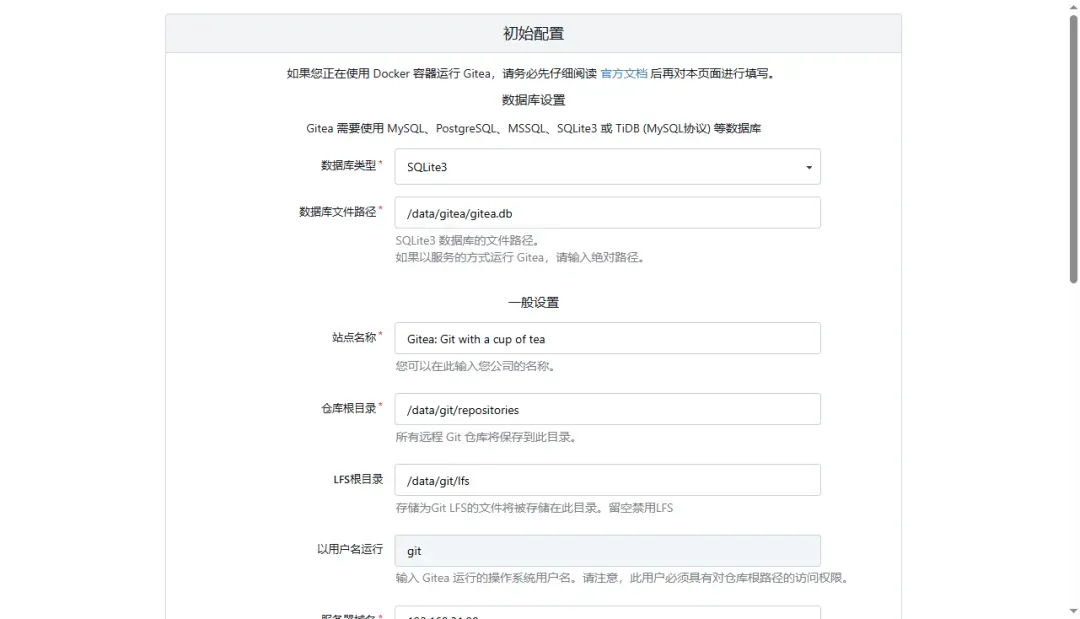

初始化配置详解

首次访问需完成基础配置,各项参数设置建议如下(配置项虽多,但多数采用默认值即可满足需求):

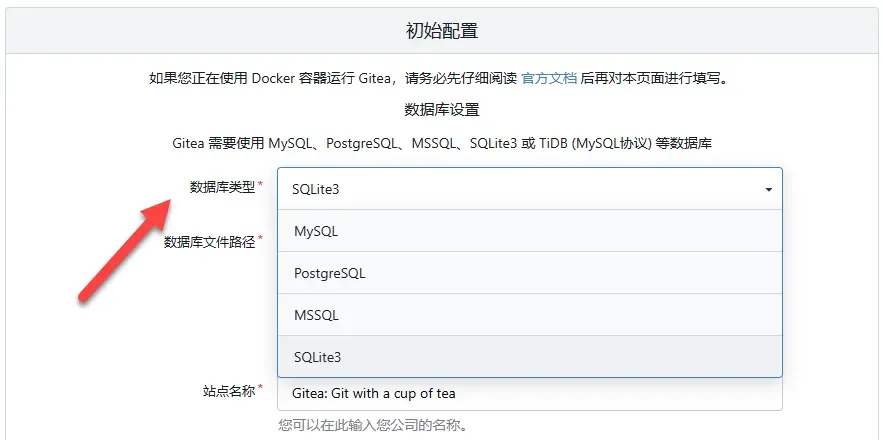

数据库类型选择:Gitea支持多种数据库后端,个人用户推荐选用SQLite3轻量级数据库方案,可快速完成部署验证,后续如需扩展可迁移至MySQL或PostgreSQL。

站点基础信息配置可根据实际需求调整站点名称,增强品牌识别度。

应用端口配置必须与Docker映射端口保持一致,如SSH服务端口应设定为2221,HTTP端口保持3000无需变更。

可选服务配置中,邮件服务如非必需可留空跳过。

服务器安全策略建议:私有化部署场景下应禁用用户自主注册功能,同时关闭OpenID第三方认证,确保平台访问可控。

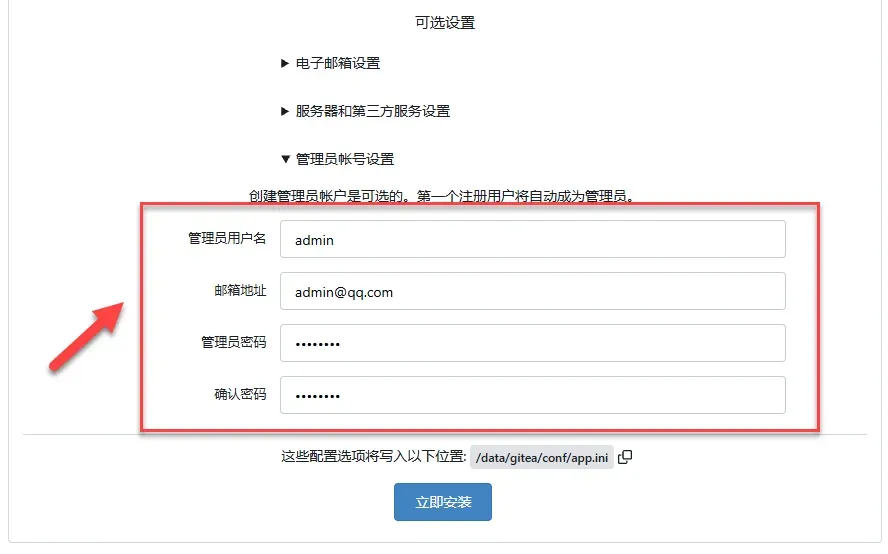

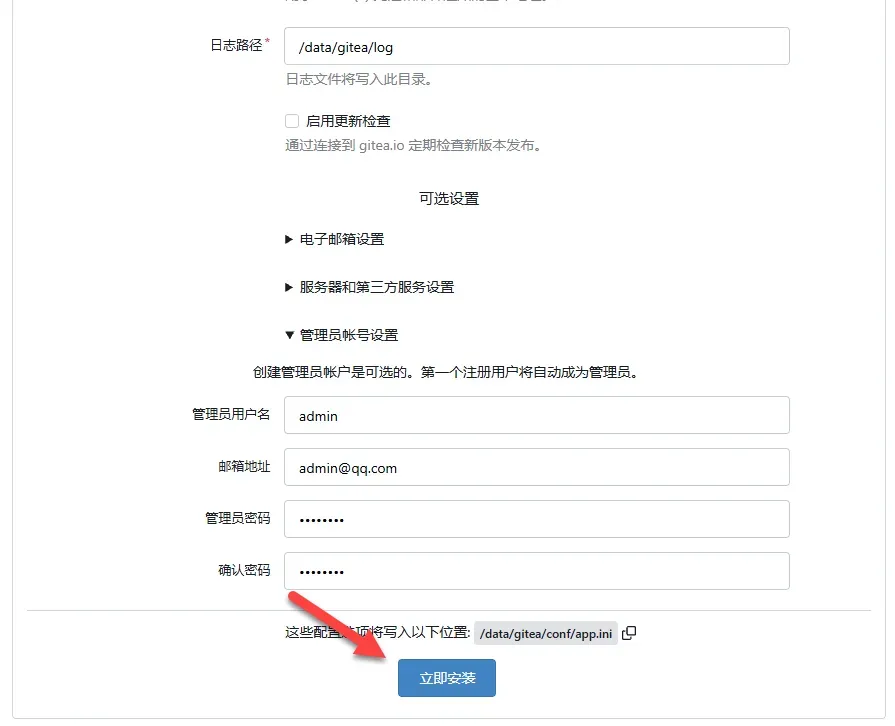

管理员账号建议在初始化阶段直接创建,避免后续重复注册的繁琐流程。

确认所有配置项无误后,点击"立即安装"按钮启动部署流程。

基础设置与个性化

安装完成后将自动跳转至用户仪表板界面。

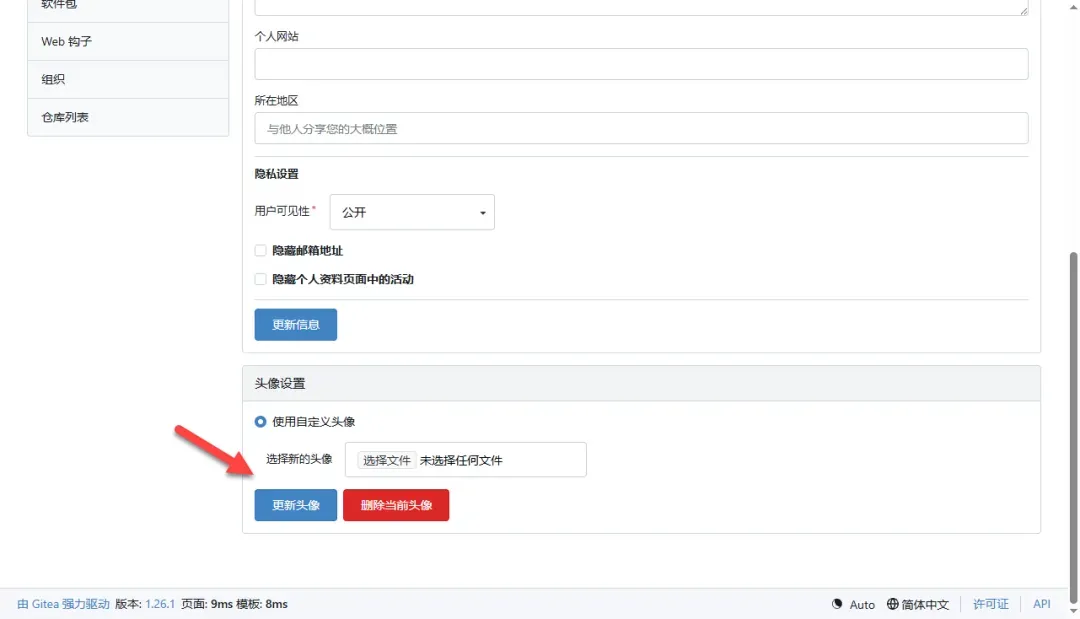

建议首先完善个人资料信息,点击右上角用户头像进入设置中心。

在用户设置页面可根据需要修改个人详细信息。

页面下方提供头像上传功能,支持个性化头像设置。

NAS算法入门零基础教程:Docker部署Hello-Algo开源项目,轻松搭建家庭算法学习环境

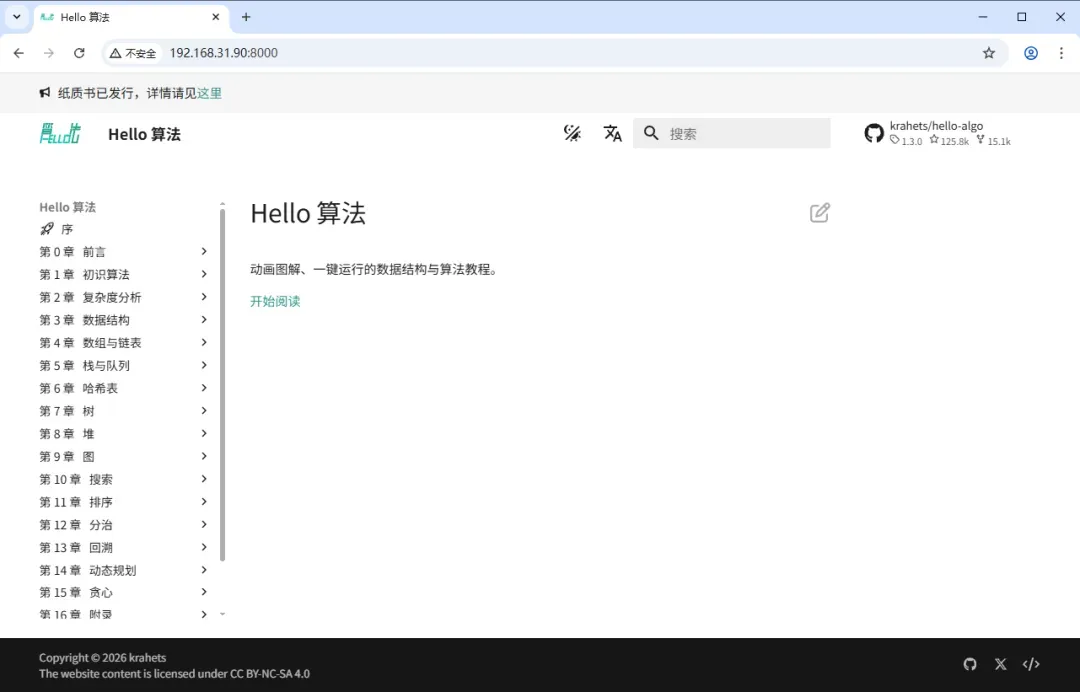

对于希望在私有云环境中系统化学习算法的用户而言,将优质开源教程部署至NAS设备是理想选择。Hello-Algo作为一款备受推崇的数据结构与算法入门教程,凭借其直观生动的动画图解与循序渐进的课程设计,成功降低了算法学习的门槛。该项目完全开源且免费提供,特别适合编程初学者构建扎实的算法基础。

该教程官网提供在线访问服务: https://www.hello-algo.com

Docker Compose部署方案

通过容器化技术,用户可在数分钟内完成Hello-Algo的本地化部署。以下是标准化的Docker Compose配置:

services:

hello-algo:

image: heizicao/hello-algo:latest

container_name: hello-algo

ports:

- 8000:8000

restart: always

访问与使用指引

部署成功后,在任意现代浏览器的地址栏输入 http://您的NAS内网IP地址:8000 即可访问图形化学习界面。

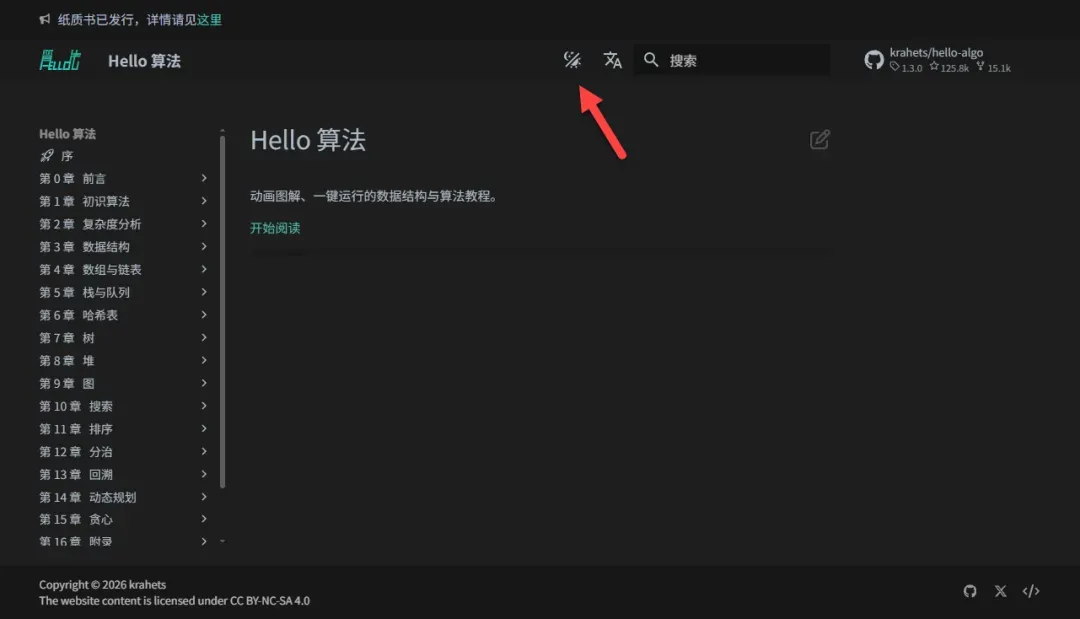

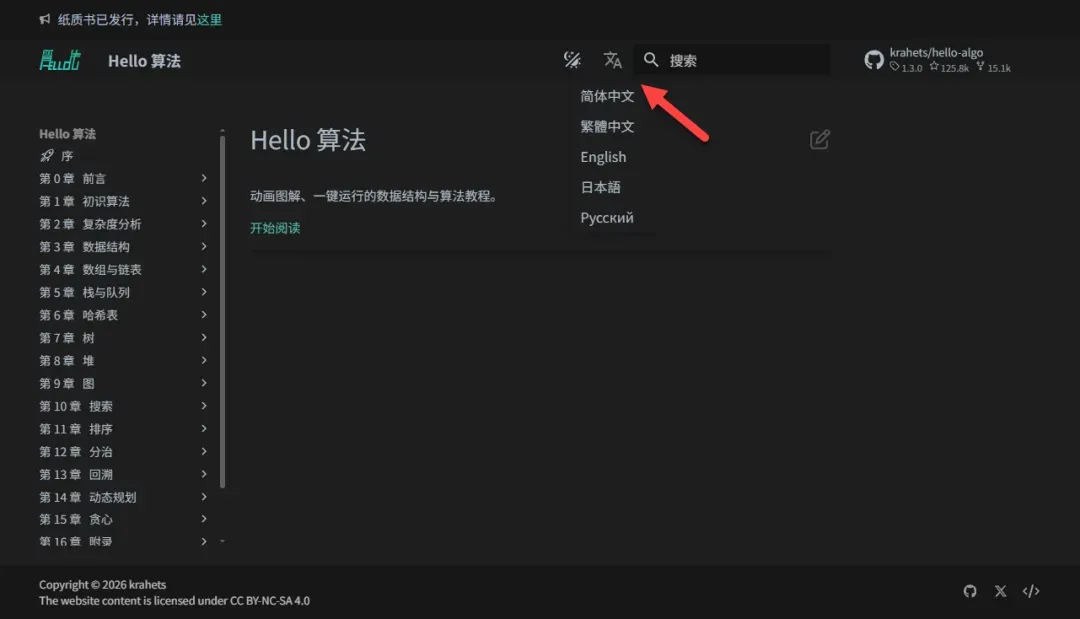

系统默认采用浅色主题,用户可根据个人偏好在设置中切换至深色模式以获得更佳的视觉体验。

Hello-Algo项目内置完整的国际化支持,涵盖简体中文、繁体中文、英语及日语等多种语言选项,满足不同地区用户的学习需求。

对于算法基础薄弱或零基础的学习者,该教程提供了明确的学习路径与导读指引。

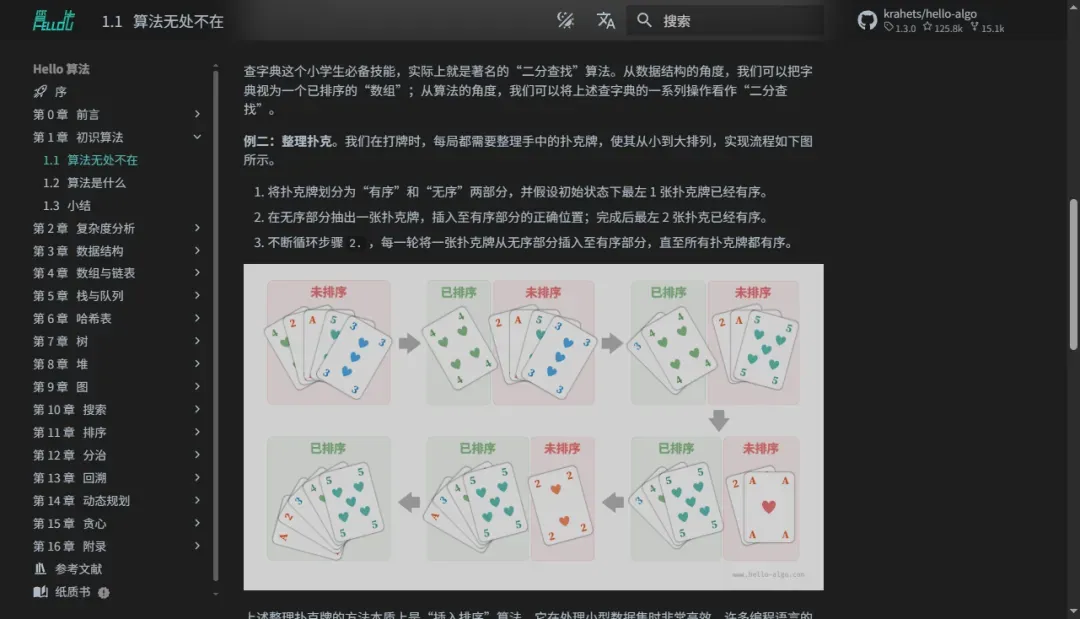

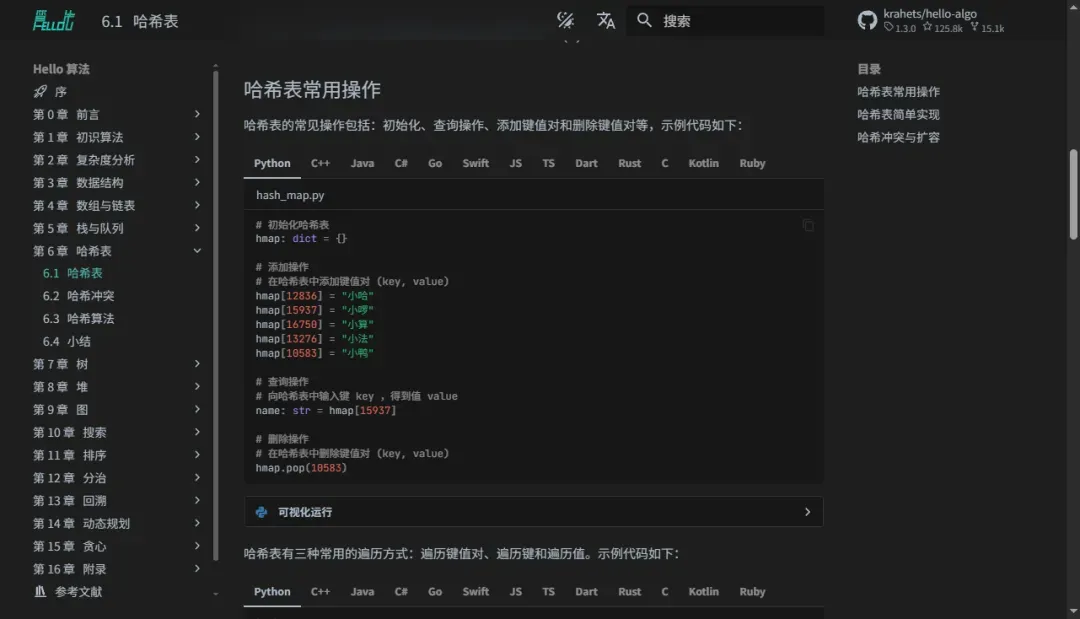

教程核心特色在于将复杂算法原理转化为高清动画图解,每个知识点均配有分步骤的可视化演示,显著提升抽象概念的理解效率。

除理论讲解外,项目还维护着完善的代码实现库,支持Python、Java、C++、C、C#、JavaScript、Go、Swift、Rust、Ruby、Kotlin、TypeScript、Dart等十余种主流编程语言,所有示例代码均可直接运行调试。

项目综合评估

初次接触Hello-Algo这一GitHub上斩获12.6万星标的开源项目时,原本预期会是传统意义上的艰深技术文档。然而实际体验远超预期——相较于常规教材的枯燥理论堆砌,本教程创新性地融合图文动画与互动式学习,将晦涩的算法逻辑转化为易于消化的知识体系。无论您是计划系统学习数据结构的编程新人,还是需要巩固算法基础的开发者,该项目都具备极高的参考价值。

综合推荐:⭐⭐⭐☆☆(三星级)

受众定位:特别适合编程零基础及算法入门阶段学习者

使用体验:⭐⭐⭐☆☆(三星级)

内容特色:图解动画丰富,知识讲解由浅入深

部署难易:⭐☆☆☆☆(一星级)

部署评价:Docker方案极简,私有部署无障碍

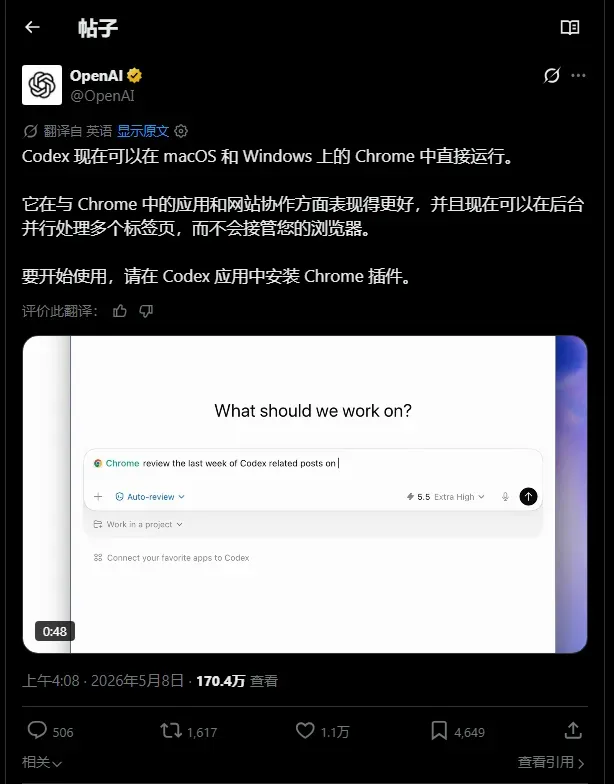

OpenAI Codex Chrome扩展正式发布:AI编程代理入驻浏览器,400万周活用户背后的三大核心功能详解

核心要点

2026年5月7日,OpenAI正式推出Codex Chrome浏览器扩展,标志着编程代理可直接在浏览器环境中操控网站与应用程序。当前Codex周活跃用户量已突破400万大关,实现年初至今高达8倍的惊人增长。

400万+

周活跃用户规模

8倍

年度增长率

2026.05.07

正式发布时间

颠覆性创新:这不是普通插件,而是真正的浏览器原生AI代理

5月7日,OpenAI通过官方X账号发布Codex for Chrome扩展程序,演示视频上线不到24小时播放量即突破百万次。与此前市场猜测截然不同,此次发布并非简单的"网页嵌入桌面应用"功能,而是将Codex作为独立代理接入浏览器生态系统——该代理能够自主创建标签页、执行点击操作、填写表单、调用开发者工具,所有任务均在后台并行处理,完全不会干扰用户当前浏览界面。

这一产品决策源于精准的用户洞察。OpenAI团队在推出Computer Use(桌面应用操控)功能后发现,开发者的日常工作流90%以上集中在浏览器内完成。与其让Codex通过屏幕监控间接理解用户行为,不如直接赋予其浏览器内核访问权限。同样是辅助编程,这种原生嵌入方式的效率与准确性实现了指数级提升。

三大核心功能深度解析

▸ 多标签并行处理架构 — Codex在独立标签组中运行,与用户的活动窗口实现物理隔离。您可以在前台查阅文档,同步让Codex在后台执行自动化测试,双方操作互不影响。

▸ 原生DevTools集成 — 可直接调用Chrome开发者工具审查DOM结构、监控网络请求、分析Console日志,前端调试无需反复切换窗口即可完成闭环验证。

▸ 跨标签上下文融合 — 能够同时抓取并整合多个标签页的数据进行综合分析,彻底告别手动复制粘贴整合信息的低效模式。

关键细节在于:上述三大功能可同步激活。传统自动化工具局限于单窗口操作,而Chrome插件架构赋予Codex真正的多任务管理能力——每个任务拥有独立标签组,实现完全隔离的并行计算。

极简部署流程:三步完成永久授权

安装流程极为简洁:启动Codex桌面客户端 → 进入插件中心 → 一键安装Chrome扩展。配置完成后,通过在对话中输入@Browser指令或直接以自然语言描述需求(如"请帮我打开XX官网并提取数据"),Codex即刻接管专属标签组执行任务。

快速上手指南

将Codex桌面客户端升级至最新版本(免费层级即可使用基础功能)

在插件市场选择安装Chrome浏览器扩展

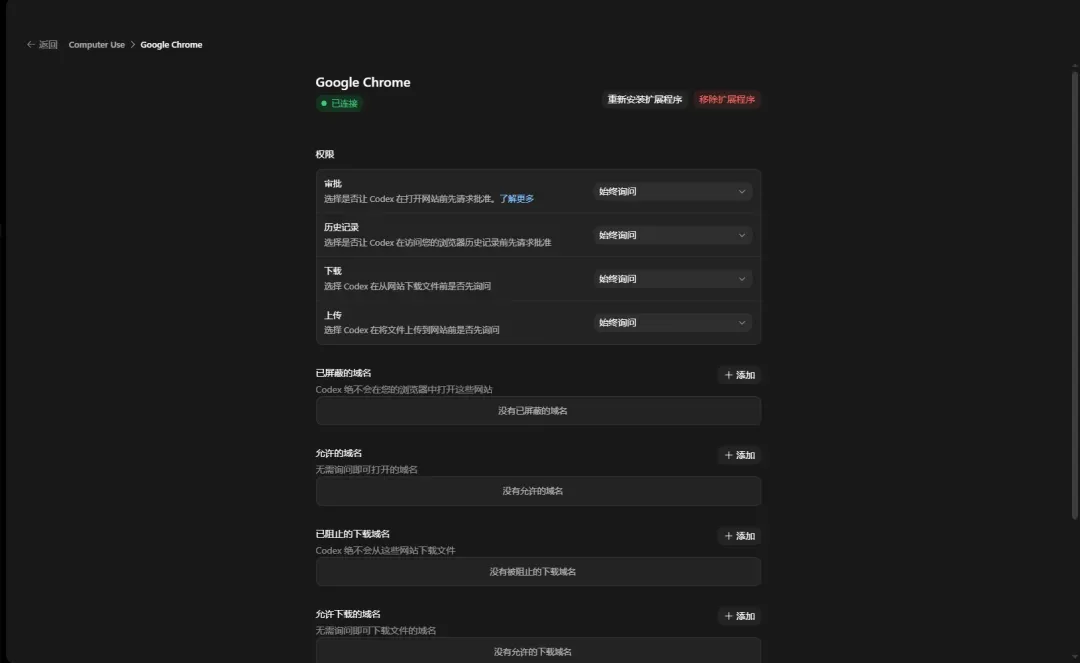

在设置面板配置可访问网站的域名白名单

对话中调用

@Browser或直接用语义化指令激活功能

重要权限说明

Codex遵循严格访问控制 — 插件安装后需在Codex设置中心手动授权允许访问的域名列表,未在白名单内的网站将无法被操作。

订阅制服务 — 桌面应用本体免费,但需订阅ChatGPT Plus(20美元/月)或更高级方案。后台并行处理等进阶功能根据订阅等级差异化提供。

精准定位:Codex浏览器助手适用于哪些专业场景

● Web全栈开发者 — 编写完前端代码后,委托Codex自动在浏览器中验证渲染效果、截图对比、回归测试,彻底解放人工刷新操作

● 深度信息研究员 — 竞品对标分析、多源资料汇总、跨平台信息交叉验证等需要聚合多标签数据的复杂场景

● QA自动化工程师 — 模拟真实用户操作路径,自动完成从注册到核心功能的端到端测试链路

反之,若您仅偶尔浏览网页,该功能则显得功能过剩。Codex明确面向专业开发者群体,ChatGPT Plus订阅起价为每月20美元,当前未提供免费试用方案。

OpenAI Codex浏览器控制完全指南:AI Agent自动操作Chrome实战解析

近期,Codex 的发展势头异常强劲。伴随 GPT-5.5 的发布,众多开发者明显感受到 Codex 在代码编写、项目修改及各类开发任务中的稳定性显著提升,用户体验日趋流畅。

更令人瞩目的是,Codex 的周活跃用户已突破 400 万大关。

这一增长速度远超预期。

而 OpenAI 的创新步伐并未停歇。

最新曝光的功能显示,Codex 现已具备直接操控 Chrome 浏览器的能力。

这一突破意义重大。

以往谈及 AI Agent,其能力多局限于思考、规划与内容生成。若无法真正介入网页操作、读取实时信息并执行任务,总觉得欠些火候。

如今 Codex 正补齐这一关键拼图。

通俗理解,Codex 不再局限于对话框内的建议提供,而是能够自主启动浏览器并实际操作完成任务。

对于正在使用 Codex 的开发者而言,这项功能值得立即体验。

经过深度测试,现将具体使用方法与实际能力边界整理如下。

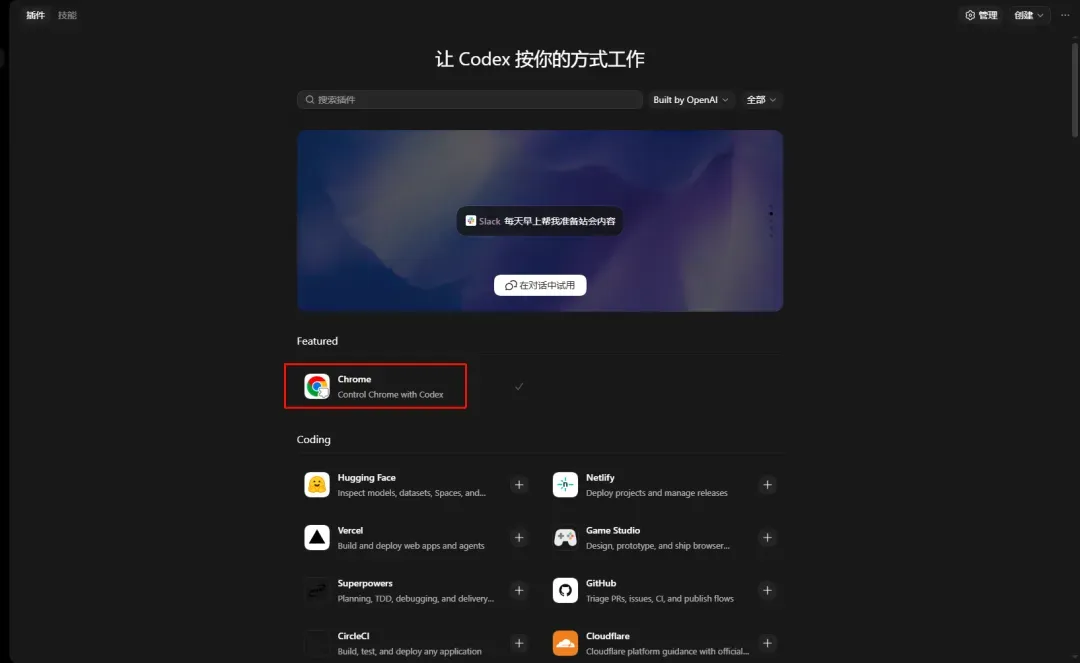

插件配置全流程

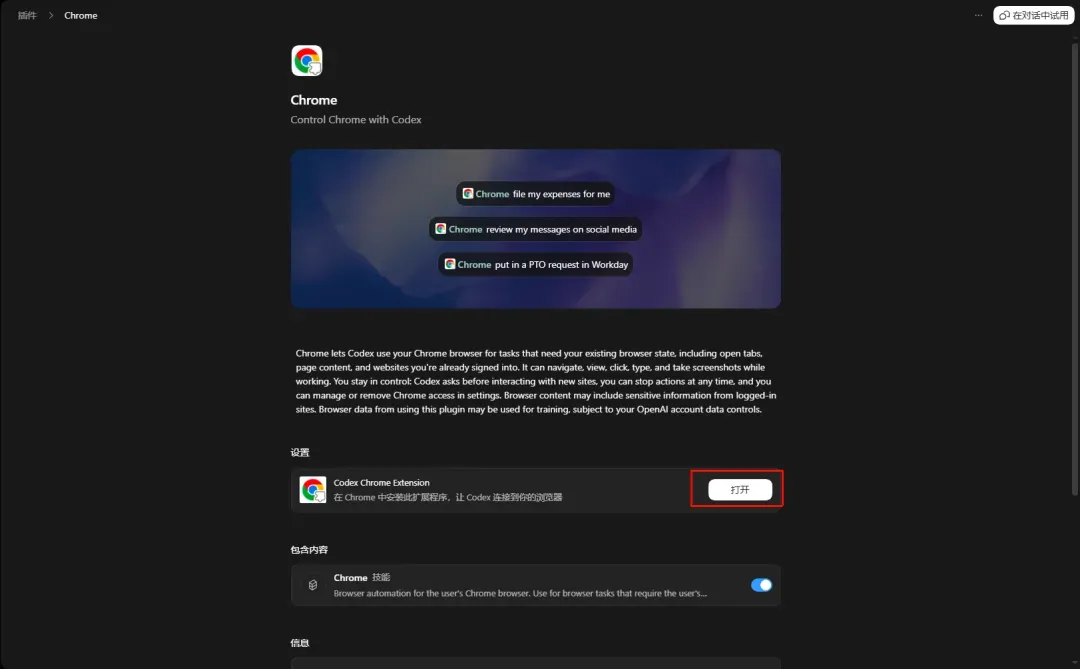

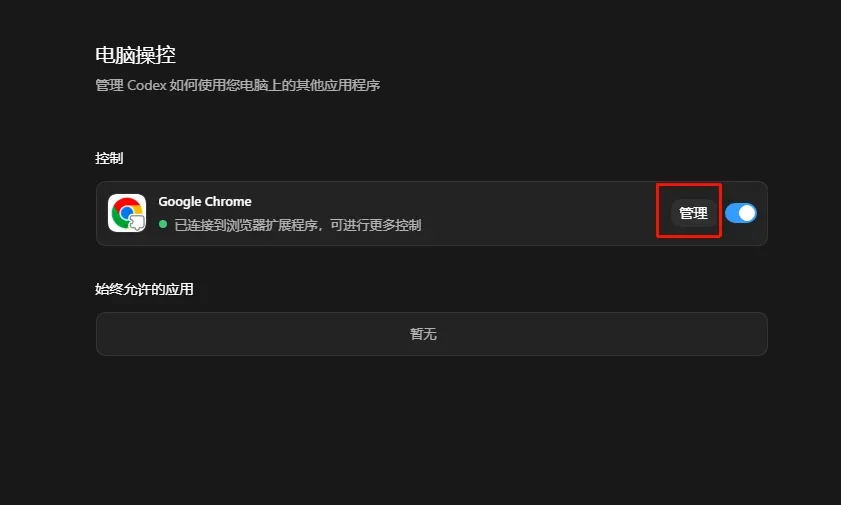

首先在插件管理页面定位 Chrome 插件并完成安装。

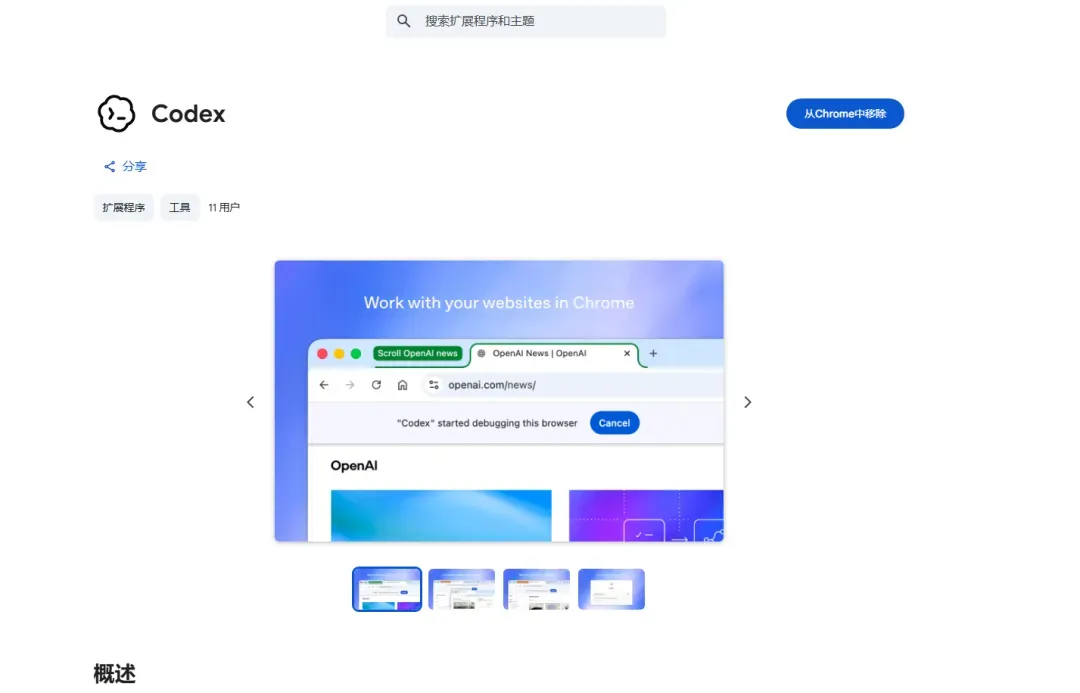

安装成功后,系统将引导下载对应的 Chrome 浏览器扩展程序。

按照提示完成浏览器插件的安装配置。

当插件图标显示绿色 Connected 状态时,表明连接已成功建立。

在计算机控制面板中,可对该插件的各项权限进行精细化管理。

权限设置可根据个人安全偏好灵活调整。

Codex 的 Chrome 插件支持多标签页后台并行处理,不会干扰用户的正常操作。这意味着在执行自动化任务的同时,用户可继续其他工作,两者并行不悖。这与传统 AI 浏览器插件存在本质区别——旧版插件运行时通常会占用鼠标键盘,导致用户只能被动等待,效率低下。

由此不得不赞叹 OpenAI 的产品洞察力,总能精准解决用户核心痛点。

实战能力验证

理论介绍不如实际测试。以下通过真实案例验证功能表现。

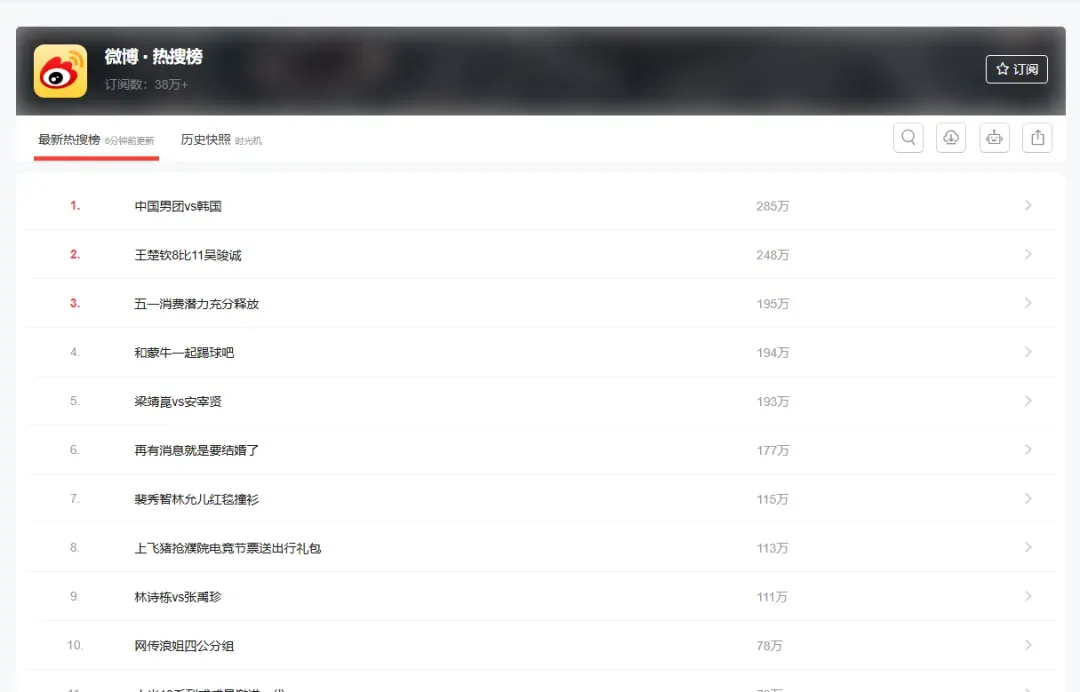

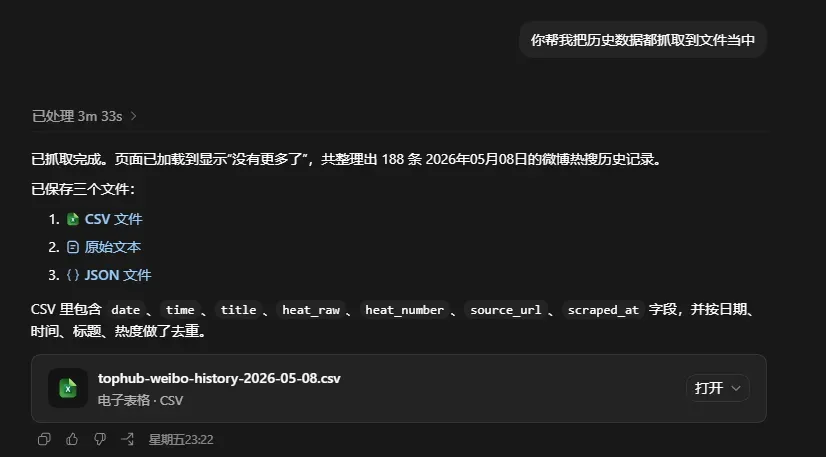

测试任务:批量下载某热搜网站的数据。

先尝试获取单日数据以验证基础功能。

结果显示数据抓取正常且准确无误。

随后指令其提取历史数据并生成文件。

数据抓取精准度与执行速度均表现优异。

OpenAI官方CLI工具openai-cli深度解析:命令行调用API、监控用量,开发者效率提升新选择

开源命令行工具

核心要点速览

OpenAI官方推出的命令行界面工具,让开发者无需编写Python代码即可在终端直接调用API接口。这款工具专为技术人员的日常调试、快速功能验证以及API使用量管理而设计,极大简化了开发流程。

项目数据概览

- GitHub星标数:266个

- 项目创建时间:7天前

- 最新发布版本:v1.1.2

一、openai-cli是什么?零基础读懂这款官方命令行工具

简单来说,openai-cli就是OpenAI官方为你打造的一款终端遥控器。在过去,调用OpenAI API要么需要编写Python或Node.js代码,要么就得手动拼接curl命令构造HTTP请求。如今只需安装这个命令行工具,通过简单的指令就能实现全部操作——发起对话、管理文件、查询用量、查看账单,所有功能均在终端内一站式完成。

这款工具的定位非常明确:面向开发者与技术运维人员,而非普通的ChatGPT网页端用户。如果你的日常工作涉及频繁与API交互——例如测试提示词、批量运行补全任务、监控组织级资源消耗——那么这款工具将帮你省去大量编写样板代码的时间成本,让工作流程更加流畅高效。

二、目标用户画像:谁最需要这款工具,谁可以跳过

强烈推荐使用的人群:

- AI应用开发者:需要频繁调用API进行功能测试和调试,快速验证不同提示词和模型行为表现的工程师

- 运维与平台管理员:负责监控组织级API用量、管理月度账单、维护多个项目和密钥的技术管理人员

- 脚本自动化使用者:希望在Bash或Shell脚本中集成AI能力,实现批量内容生成、自动化处理的开发者

- 技术评测与学习人员:想要快速体验对比不同模型输出效果,但不愿意花费时间编写样板代码的研究者

不适合使用的人群:

- 仅通过chatgpt.com网页界面使用AI服务的普通用户,且完全没有API调用需求的人

三、核心功能全面拆解:这款CLI工具能做什么

▸ 资源化的命令结构:采用openai [资源类型] [具体操作] [参数标志]的层级化设计,符合开发者直觉,命令组织逻辑清晰易懂

▸ 多格式输出支持:内置json、yaml、pretty等多种输出格式选项,并集成GJSON转换语法,方便数据解析和管道处理

▸ 智能文件处理机制:独创的@file.ext语法糖,可自动识别并正确传输文件内容,智能判断文本或二进制编码格式

▸ 完整的管理端点覆盖:提供查询组织用量、管理项目配置、验证Webhook签名等全面的后台管理功能

▸ 灵活的API地址定制:通过--base-url参数支持自定义API后端地址,轻松适配代理环境或自托管部署场景

四、三大实战场景:开发者如何真正用上openai-cli

场景一:快速测试新发布模型

每当OpenAI发布新模型时,无需再编写测试脚本,只需执行一行命令即可发送请求并查看效果:openai responses create --model <新模型名称>,验证工作瞬间完成

场景二:批量调试提示词参数

在Shell脚本中使用循环结构多次调用openai responses create命令,通过改变参数组合对比不同配置下的输出质量,大幅提升调试效率

场景三:组织级用量监控 平台管理员可通过单条命令拉取整个组织的API调用数据,按日期或项目维度进行聚合统计,实现账单监控和资源规划的自动化

五、全面对比:openai-cli vs curl vs Python SDK,哪个更适合你

| 工具类型 | CURL/原始API | openai-cli | Python SDK |

|---|---|---|---|

| 使用方式 | 手动拼接HTTP请求和JSON请求体 | 结构化命令自动生成请求 | 需编写完整Python脚本 |

| 输出格式 | 仅返回原始JSON字符串 | 支持多格式+数据转换筛选 | 返回Python对象,需自行处理 |

| 命令组织 | 无结构化设计,频繁查阅文档 | 内置结构化命令体系 | 方法调用,IDE支持好 |

| 管理功能 | 需自行实现管理端点调用 | 内置完整管理命令集 | 需额外编码实现 |

| 文件处理 | 手动编码处理文件上传 | 智能识别并自动处理 | 支持文件但需编写代码 |

| 适用场景 | 简单单次测试 | 快速验证与脚本集成 | 复杂业务逻辑开发 |

| 学习成本 | 中(需熟悉HTTP协议) | 低(装完即用) | 高(需Python环境) |

六、项目成熟度评估:openai-cli现状与未来发展

客观评估:openai-cli项目创建于2026年5月1日,截至本文撰写时上线不足10天。仓库已有42次代码提交,来自4位贡献者,获得266个GitHub星标。项目已发布4个版本(最新为v1.1.2),核心的responses create命令及管理功能已可用,但API资源覆盖范围尚未全面。

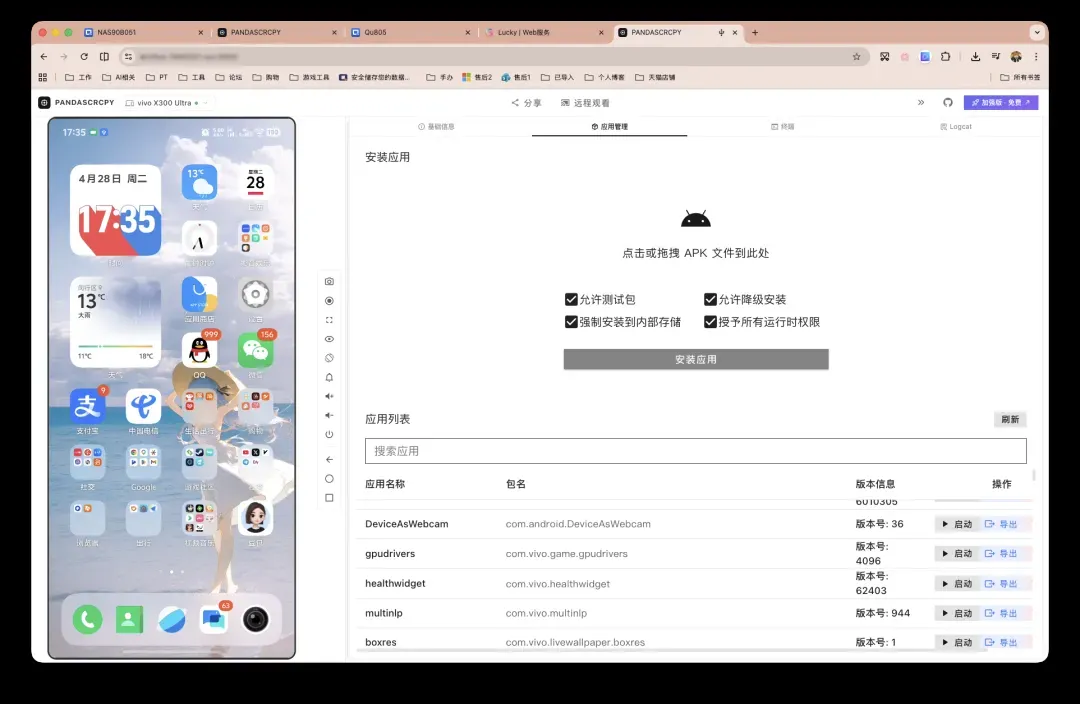

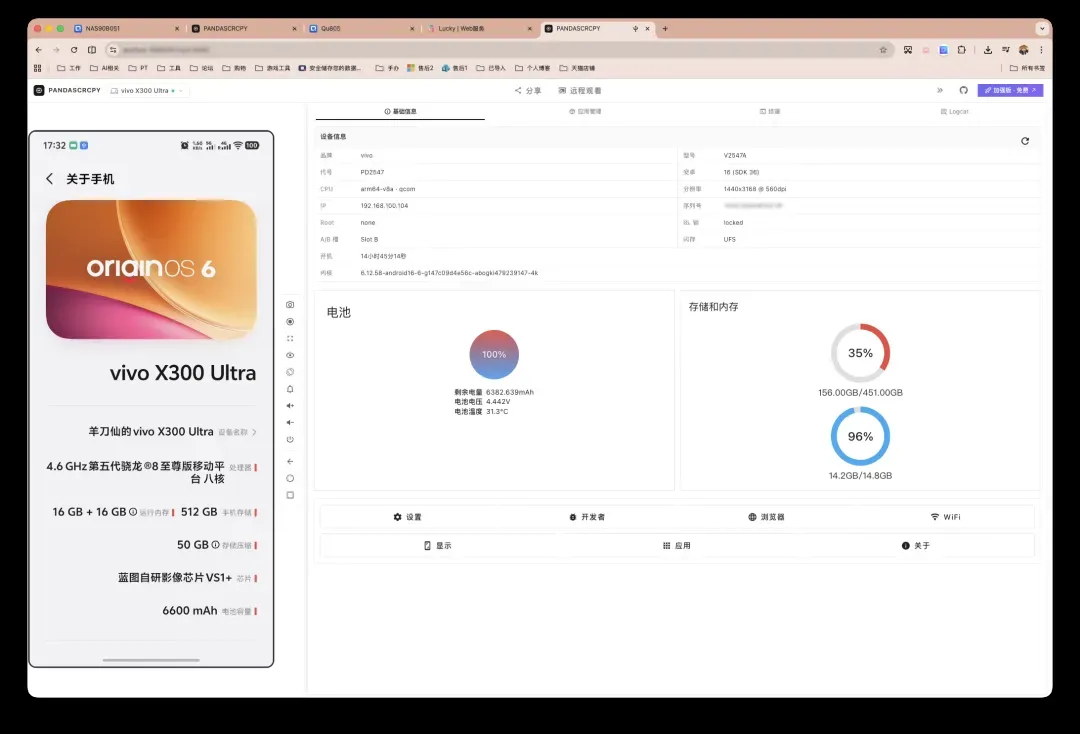

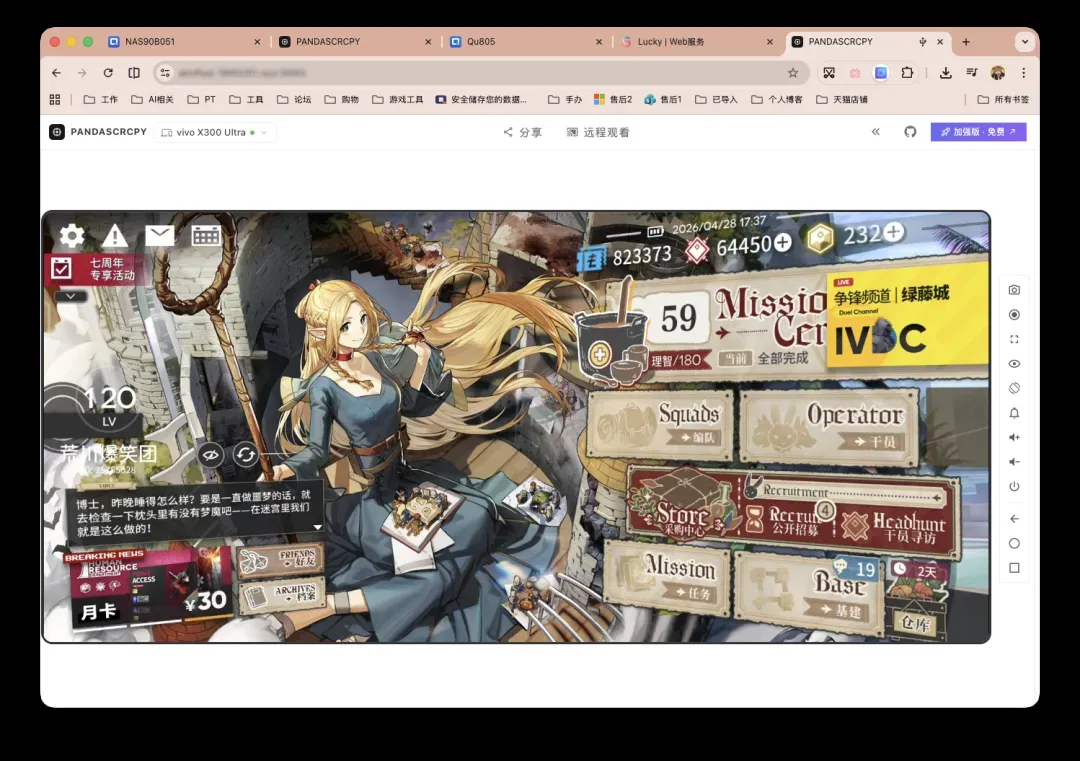

PandaScrcpy远程控制手机方案:NAS Docker部署详解与使用指南

今天给大家介绍一个极具实用价值的开源工具PandaScrcpy,它能让手机远程控制变得异常简单。完成部署后,您无需在本地计算机配置复杂的ADB环境,仅需使用Chrome或Edge浏览器,通过USB连接Android设备,即可实现投屏显示、远程操控、屏幕录制、快照截取、日志查看以及ADB Shell命令执行等全方位功能。

若从放松娱乐的角度看,这甚至可以成为一个高效的休闲助手 。

。

无论是需要将安卓手机屏幕投射到电脑上进行简单操作、查看日志或截图录屏的普通用户,还是从事安卓应用测试、设备调试以及批量测试的专业开发者,这款工具都能提供显著的价值提升。

核心应用场景

安卓设备画面投射至电脑端

当您需要在电脑大屏幕上展示手机界面、录制操作教程、进行直播演示或提供远程技术支持时,该功能尤为实用。相比传统方式,浏览器端操作更加便捷灵活。

键鼠控制手机操作

连接成功后,您可以直接在浏览器窗口内操控手机,体验与scrcpy高度相似。根据项目文档说明,系统已针对触控操作、键盘鼠标控制进行了焦点管理和指针轨迹优化,确保操作精准流畅。

开发与测试调试专用

内置多项设备端实用工具,包括应用管理器、Logcat日志系统和ADB Shell终端界面,极大简化了开发与测试人员查看系统日志、调试应用程序的工作流程。

屏幕录制与画面截图

支持本地录制手机屏幕动态画面,同时可快速截取静态快照,非常适合制作测试记录、产品演示素材或技术文档配图。

远程画面共享功能

基于PeerJS技术,可将当前手机画面实时分享给其他浏览器端用户,实现远程协作或技术支持场景下的屏幕共享需求。

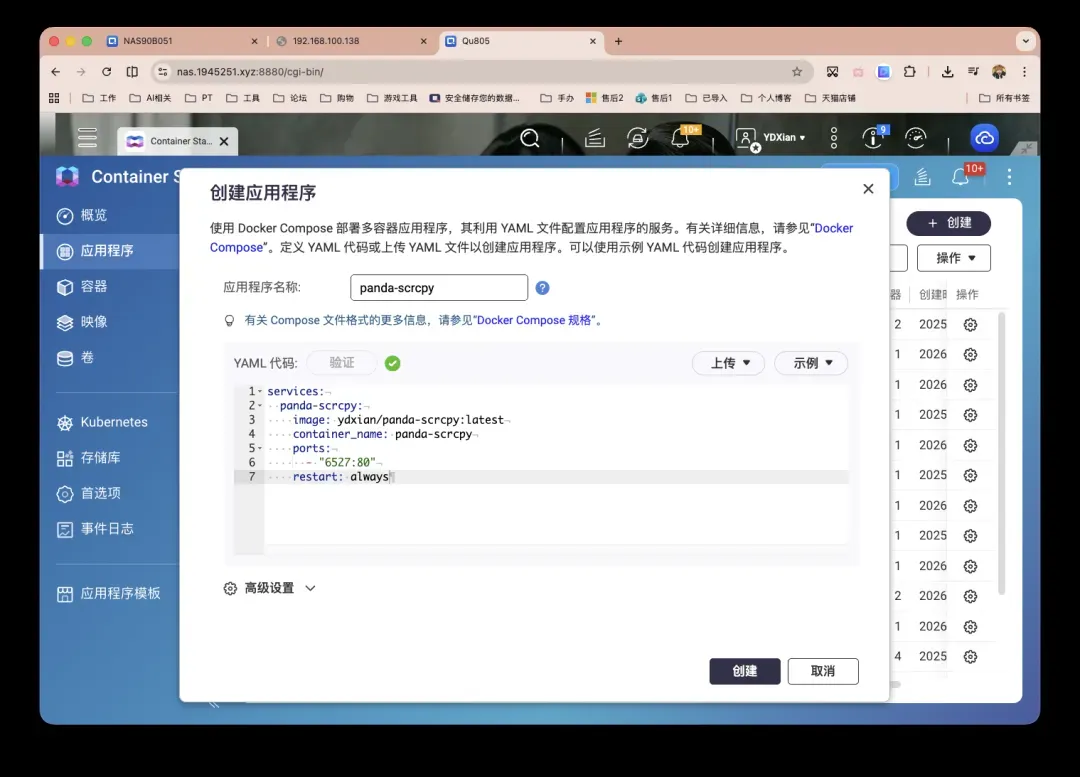

NAS部署完整流程

本文将以威联通NAS设备为例,详细介绍通过Docker Compose方式部署的完整流程。鉴于原项目未提供官方镜像,我已自行构建并上传至仓库,部署配置如下:

services:

panda-scrcpy:

image: ydxian/panda-scrcpy:latest

container_name: panda-scrcpy

ports:

- "6527:80"

restart: always

在威联通系统的Container Station中创建新的应用程序,将上述配置粘贴即可快速启动。

Web端使用详解

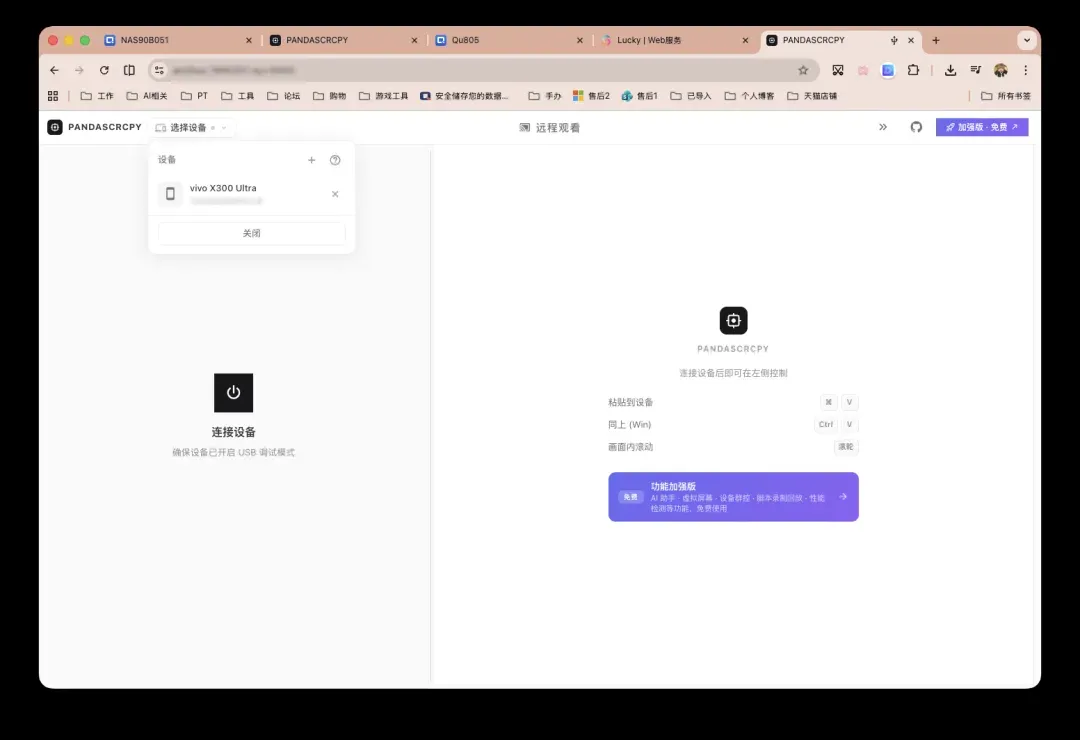

服务启动后,在浏览器地址栏输入NAS_IP:6527即可访问主界面。

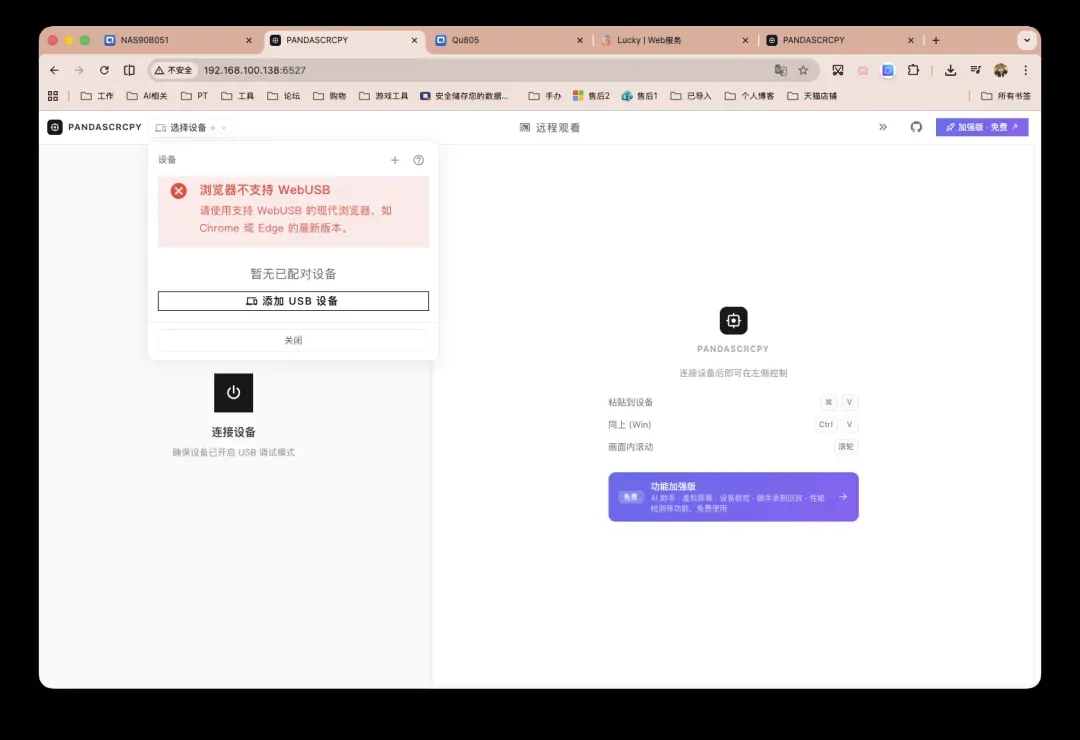

若在设备选择区域出现"浏览器不支持WebUSB"的提示,这是因为WebUSB API仅在安全上下文环境中生效。解决方案有两种:配置HTTPS反向代理,或直接通过localhost访问。考虑到远程使用的便利性,强烈建议配置反向代理。

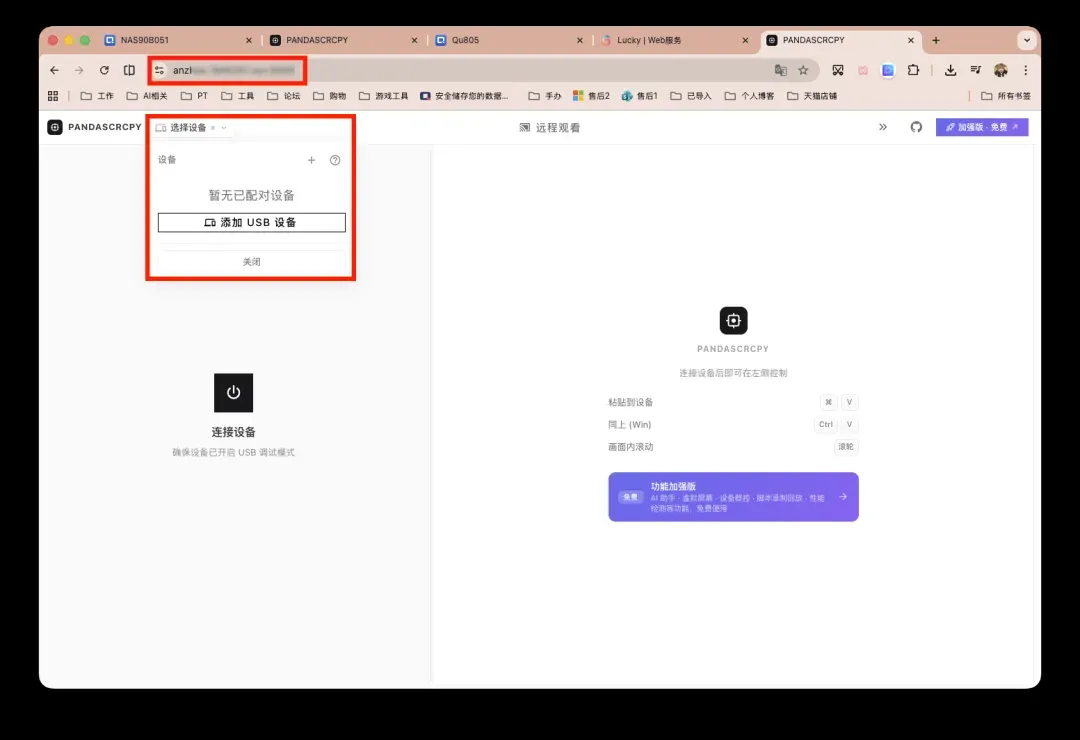

完成反向代理配置后,提示信息将消失,页面功能恢复正常。

但此时点击"添加USB设备"仍无法发现手机,原因是尚未完成手机的开发者模式配置。请使用数据线将手机连接至电脑(Mac或Windows均可),进入手机"设置"应用,滑动至"关于手机"选项,连续点击"软件版本号"七次以激活开发者模式,随后在开发者选项菜单中启用USB调试功能。

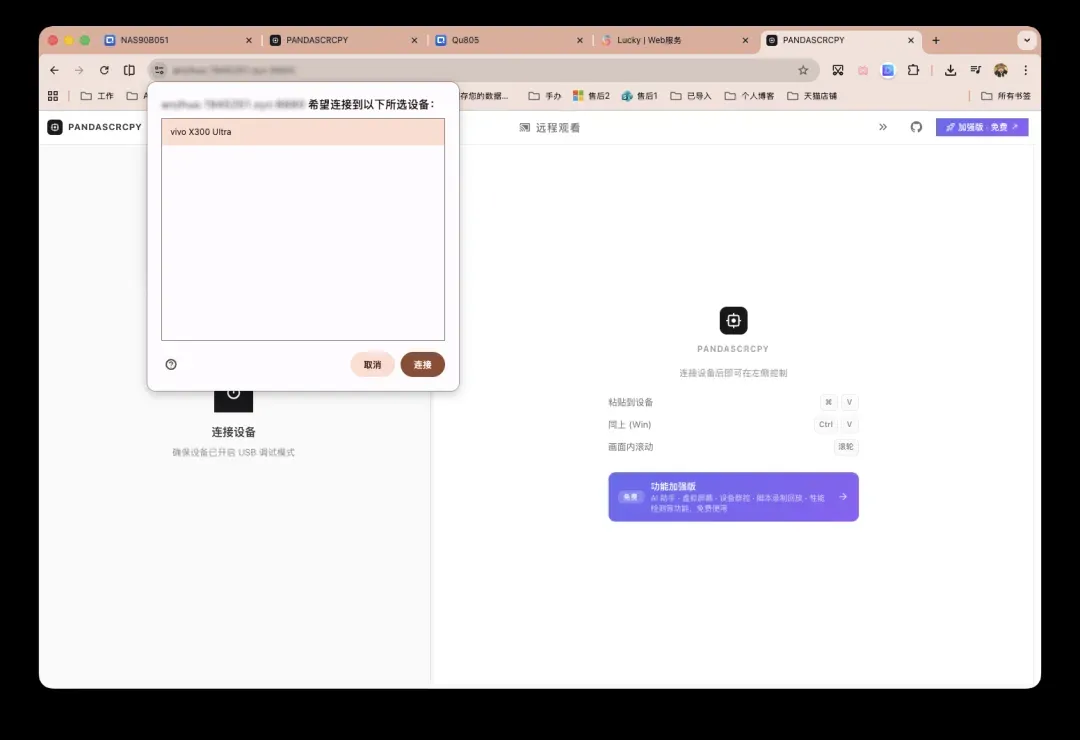

完成上述设置后,再次点击"添加USB设备",此时手机将出现在设备列表中。选中目标设备并点击"连接"按钮。

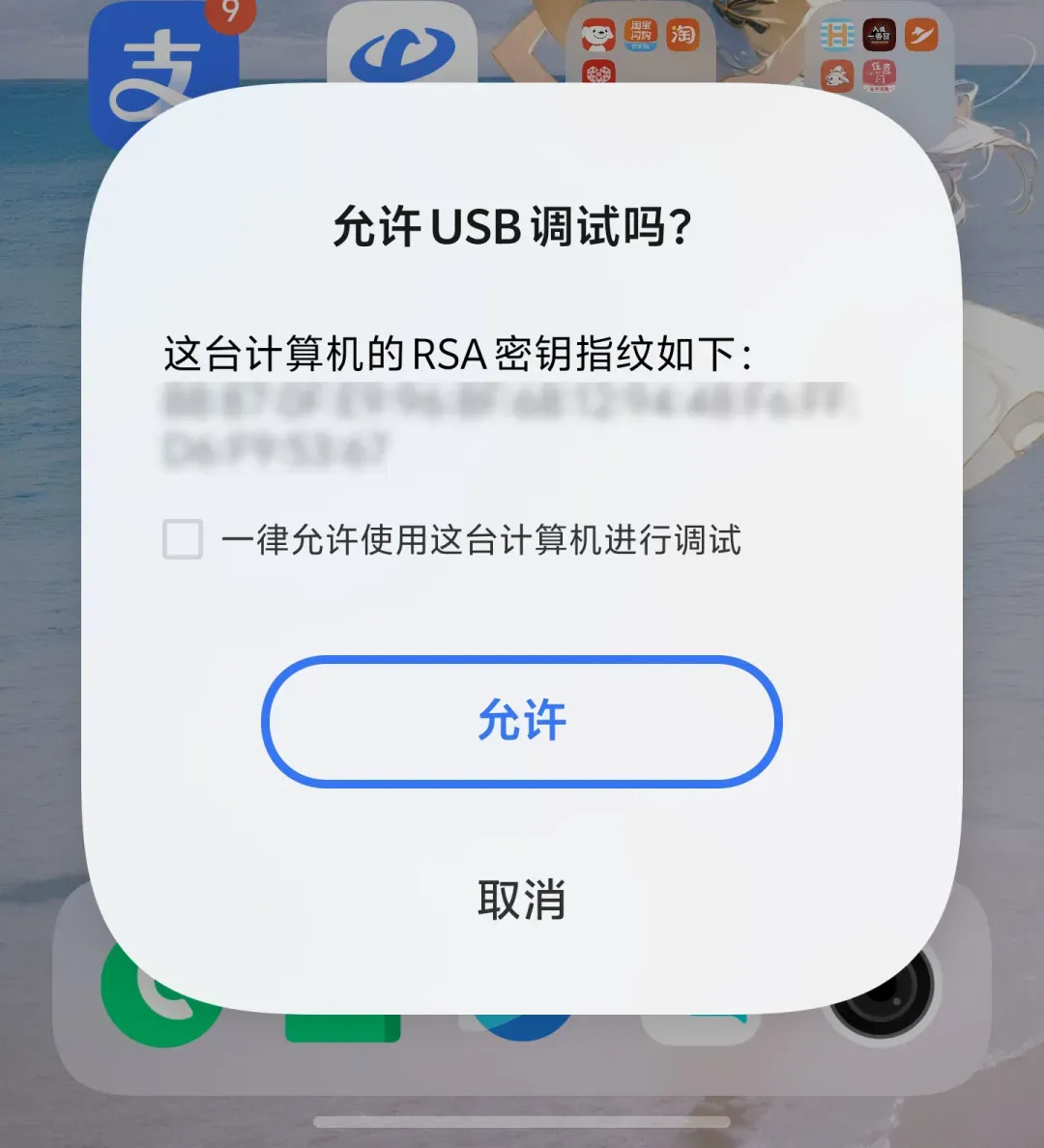

设备配对成功后,点击"连接设备"按钮建立通信。

此时手机端会弹出授权窗口,如经常使用建议勾选"一律允许"以简化后续操作。

注:部分小米手机如遇控制问题,需在开发者选项中额外开启USB调试(安全设置)权限

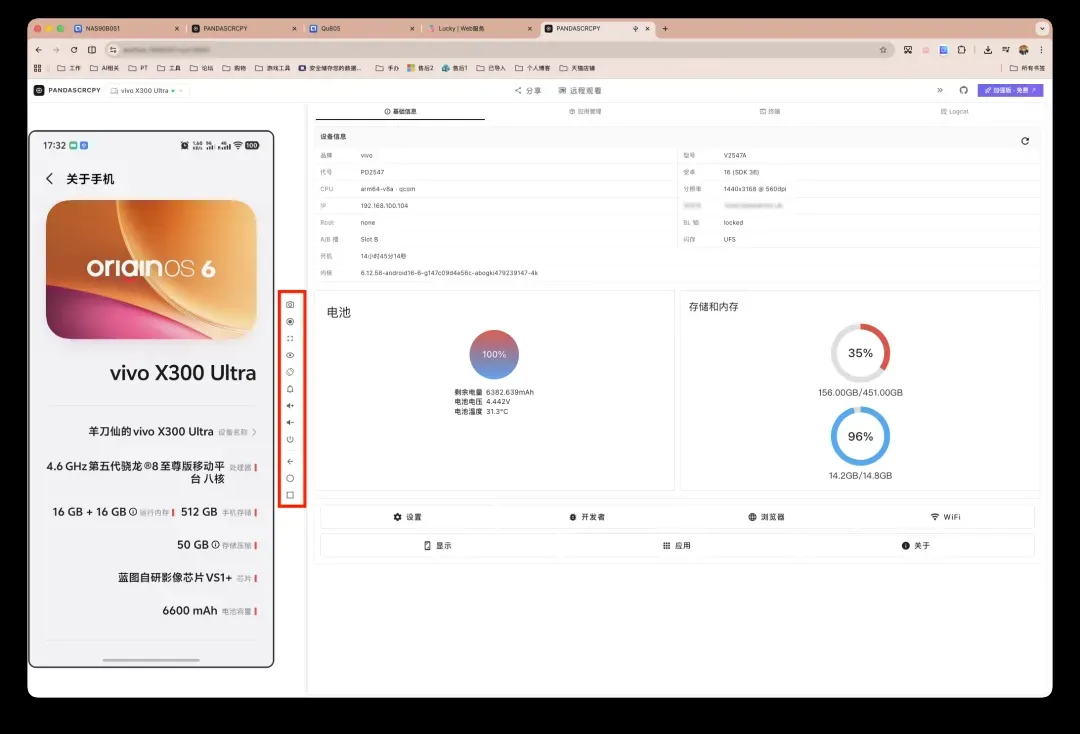

连接成功后,界面流畅度表现优秀。默认视图显示设备基础信息,中部功能区提供录屏、截图、音量调节等快捷操作。

应用管理模块可读取已安装应用列表,支持对连接设备执行应用的安装、启动和导出操作。