VibeCoding跨专业开发真相:5个真实案例揭示从入门到专业的转型路径

核心洞察

在Andrej Karpathy于2025年初提出Vibe Coding概念后的一年间,众多非专业开发者借助AI工具成功交付了可用产品。究竟哪些人真正突破了专业开发的壁垒?本文深入追踪五个可验证的真实案例,从中提炼出一条从"被动接收AI输出"到"主动掌控开发结果"的完整转型路径。

关键数据

- 24天:从零基础到应用商店上线

- 120天:单人完成企业级平台构建

- 3.5倍:AI工具带来的开发加速效应

一个被忽视的关键问题

过去一年间,围绕Vibe Coding的争议呈现出典型的技术炒作周期轨迹。早期被视为不入流的"玩具",随后又被捧上神坛号称"编程民主化",如今舆论终于回归理性。人们开始承认它在代码生成速度上的优势,但仍质疑其能否真正培养出专业的开发能力。

这一议题需要更细致的拆解。与其纠结于"Vibe Coding本身是否可取",不如聚焦于一个更具实践价值的问题:那些借助AI工具入门的开发者,在何种条件下能够实现向专业水平的跃迁? 这一问题的答案不仅关乎非科班出身者的职业发展轨迹,更为企业在招聘"AI原生开发者"时提供了评判标准。

我追踪了五个时间跨度从2025年中到2026年初的真实案例,这些案例的共同特征是:参与者均从"依赖AI编写代码"起步,最终成功交付了被真实用户使用的完整产品。 更重要的是,他们的成长历程展现出高度一致的模式。

案例一:24天,从C#零基础到Windows应用商店

2026年1月,开发者xiaocang开启了一项大胆实验:采用纯Vibe Coding方式,在一个完全陌生的技术栈上构建可发布的桌面应用。他对C#、WinUI 3和XAML均无任何经验,目标是将现有的macOS应用Easydict移植到Windows平台。

24天后,应用成功登陆Windows Store。最终统计数据显示:422次代码提交、19,554行源代码、17,474行测试代码、715个测试用例,源码与测试代码比例达到1.12:1。他在博客中总结道:“90%的代码由AI生成,但剩余10%的人工干预才是关键,包括Git工作流设计、CI/CD流水线搭建、测试策略制定、发布节奏把控以及架构决策。”

该案例的转折点出现在第7天。在此之前,他任由AI自由发挥,代码虽能运行但维护成本急剧攀升。第7天起,他开始建立Git分支规范、引入xUnit单元测试框架、配置自动化构建。工程化基础设施的搭建,标志着Vibe Coding向专业开发演进的第一道分水岭。

案例二:当"一键接受"遭遇7500名真实用户

Ciara Wearen曾是一名产品经理。2025年年中,她决定使用Cursor独立开发Next.js应用。初期"一键接受"阶段的效率令人瞩目:AI一次性生成跨越6个文件的400行代码,她仅需扫一眼确认"看起来是代码的样子"便直接采纳。功能快速堆砌,直到社交媒体分享功能"干掉"了导航菜单。

根源在于依赖冲突。分享功能引入的某个库与路由库在状态管理上产生冲突,连锁反应导致认证流程崩溃,最终导航菜单彻底消失。这是Vibe Coding的典型陷阱:单个功能看似正常,却无人评估它们之间的交互影响。

转折点源于一次深夜调试。她做出决定:不再接受任何自己无法理解的代码。此后每次AI生成代码,她都逐行审阅,对不清楚的部分要求AI解释,完全理解后才合并确认。项目上线时已服务7500名真实用户。她的回顾总结发人深省:“你不必成为专家也能发布产品,但必须理解自己的应用,才能在故障发生时修复它——因为故障注定会发生。”

模式识别:从"无脑接受"到"逐行理解"的转变,是Vibe Coder成长为专业开发者的核心拐点。CI/CD、依赖管理、状态一致性,这些在"玩具项目"中可有可无的概念,在"服务真实用户"的场景下成为生存底线。

案例三:单人企业平台:从原型到生产的五次"灾后重建"

2025年5月,一位独立开发者开始用AI工具构建企业级AI平台。120天后平台上线,集成300多个AI工具、服务5000多名用户、覆盖多个行业。按传统估算,这项工作需要6-8人团队耗时12-16周。实际情况是:单人,120天。

但过程远非一帆风顺。平台在最初9个月内经历了5次生产事故。根据SmartMaya的案例分析,每次事故都暴露出一类系统性漏洞,并催生出一条架构防御规则,涵盖SQL注入、租户隔离失效、配置错误、性能退化等多种类型。核心方法论是"将故障转化为架构模式":每次事故不仅修复bug,更增加自动化防护规则以防止同类问题再次发生。

该案例回应了一个关键质疑:Vibe Coding产出的代码是否必然质量低下? 答案是否定的。平台的质量并非来自避免故障,而是源于将每次故障转化为系统级防御机制。AI加速了故障发生与修复的循环,使平台在9个月内走完了传统团队2-3年的架构演进历程。

核心数据:3-4倍上市速度、5-8倍成本降低、团队效率提升6-8倍。但真正的护城河并非速度优势,而是持续迭代中积累的用户上下文理解与个性化深度——这是竞争对手无法复制的核心资产。

案例四:8小时完成生产级部署挑战

DataField发布的案例研究中,自由开发者Priya Sharma曾用Vibe Coding在两周内为客户搭建项目管理工具。但真正的考验在后头:客户要求私有部署,且需保证安全可靠与持续在线。

Priya此前从未部署过生产环境应用。她仅有8小时时间和每月50美元预算。结果:她在8小时内完成了全容器化部署(4个服务)、CI/CD流水线、自动数据库备份、Sentry错误追踪、健康检查监控及自动SSL证书续期。上线首月:零宕机、3次功能更新(每次部署<5分钟)、1个bug在用户报告前被Sentry捕获。

Priya坦言自己从未亲手写过Dockerfile和GitHub Actions配置。“关键技能不是记住语法,而是知道该问什么问题。“她强调,尽管不懂具体语法,但她清楚生产部署所需的所有组件:容器化、CI/CD、监控、备份等。这种"知道需要什么"的能力,恰恰是工程设计思维的核心体现。

案例五:3人团队,6周MVP,AI实现3.5倍加速

DataField记录的Insightful初创公司案例提供了最完整的团队级数据。CTO Mira Chen带领3人开发团队,需在6周内构建客户反馈平台MVP,交付给3家已签意向书的试点客户。所有成员均使用AI工具(Claude Code、Cursor、GitHub Copilot)。

项目实际实现3.5倍加速,但代价是:代码审查耗时远超预期:计划40小时,实际消耗62小时。AI生成的代码量过于庞大,人工审查成为瓶颈。安全审计还发现AI生成的3个漏洞:SQL注入(字符串拼接而非参数化查询)、租户隔离缺失(管理员API未检查权限)、错误响应暴露堆栈信息。

Mira的应对策略颇具借鉴价值:她在Sprint 0(项目第一天)就编写完CLAUDE.md架构文档,确保AI生成代码遵循统一规范;为代码审查预留缓冲时间;在最终冲刺阶段保留充足的安全审计余量。项目在第42天如期上线。规划的价值在于让你提前识别风险点所在。

五案例揭示的四阶段转型路径

尽管五个案例在技术栈、项目规模和背景上差异显著,但"从Vibe Coding到专业开发"的演进路径呈现出高度一致的四阶段模式:

阶段一:全盘接受 — 不读代码,不建测试,功能能跑即可。此阶段价值在于快速验证"可行性”。所有案例均经历过该阶段,差异仅在于停留时长。

阶段二:被迫理解 — 被"全盘接受"埋下的地雷触发(导航菜单消失、生产事故、部署失败),开始逐行审阅AI代码,建立测试体系,搭建CI/CD。案例二与案例四的转折最为典型。

阶段三:建立护栏 — 自动化测试、代码审查流程、架构文档、安全审计。案例一在第7天搭建工程化设施,案例三通过5次事故建立5条防护规则,案例五在Sprint 0完成架构文档。此阶段划清了"业余爱好者"与"专业人士"的界限。

阶段四:工程主导 — AI成为加速器而非代码生产者。开发者掌握架构决策权,AI负责执行实现。Simon Willison称之为"agentic engineering”。与Vibe Coding的本质区别在于:你审查代码、编写测试、做出架构决策、对上线结果负责。

半球智能:Transformer与Diffusion的张力法则

最近读到朋友的一篇《视觉,本就是世界的基础,而不是语言的插件》,由此引发了我与Claude的多轮深度思辨。现将对话整理成苏格拉底式问答,探究AI架构的底层逻辑。

语言地基论?视觉外挂说的认知陷阱

问:当下业界正激烈争论:多模态AI的未来,究竟该以语言为根基,还是视觉为核心?你的立场是什么?

答:回答前,我想反诘:为何我们必须设定一个"主导地位"?

问:任何系统都需要基础架构,就像建造房屋离不开地基。

答:这个比喻本身值得推敲。“地基"作为隐喻,或许正在扭曲我们的认知框架。

问:如何理解?

答:观察人类自身,语言与视觉如何共存?语言是否叠加在视觉之上?抑或视觉只是语言的附属?

问:两者更像是平行关系。

答:再深入一层。当你闭眼想象一幅画面,思维如何运作?

问:先有整体氛围、色调、意韵,细节才渐次浮现。

答:很好。现在回想一段逻辑推演呢?

问:那完全不同,必须步步为营,前提与结论环环相扣。顺序错乱,论证即刻瓦解。

答:你刚刚触发了两种根本不同的认知模式:连续的、并行的、整体先于局部的思维方式,与离散的、序列的、局部构成整体的思维方式。

问:的确如此。

答:这两类机制,或许本质就不是同一回事。

双架构之谜:Transformer与Diffusion的认知分野

问:这与AI架构有何关联?

答:这里存在耐人寻味的巧合。近年AI领域最成功的两大架构是什么?

问:Transformer与Diffusion。

答:正是。现在思考,Transformer的本质是什么?

问:预测下一个token。

答:逐步预测?

问:自回归机制。

答:Diffusion呢?

问:从噪声中整体演化、协同优化整幅图像。

答:察觉到了吗?

问:这不就是我刚才描述的两种思维方式吗?

答:完全正确。Transformer是离散、序列、符号化的;Diffusion是连续、并行、场态的。这不是偶然,而是两种在数学层面就不兼容的生成范式,恰好对应认知科学中无法通约的两种心智模型。

问:所以Transformer擅语言、Diffusion擅视觉,根源在此?

答:比这更深。不是模态差异,而是计算本体论的分野。 语言恰好是符号载体,图像恰好是场态载体,但真正的鸿沟在于计算范式本身。

拒绝融合:为何智能需要保持架构张力

问:这是否意味着下一代AI必须融合两种架构?

答:类比一个物理问题:物理学家曾将波与粒子强行统一了吗?

问:没有。

答:他们如何处理波粒二象性?

问:两套数学框架并立。描述同一现象,必须同时保留两种模型,无法归约。

答:精髓就在这里。因为真相就是两套体系各自成立,且彼此不可化约。

问:智能也遵循此理?

答:我认为是的。纯符号系统描述智能,会遗漏场态维度;纯场态系统描述智能,又会遗漏符号维度。两套体系必须共存,且需维系动态张力。

MoE的误区:百个左脑不等于左右脑

问:那么MoE是否正在实现这一点?毕竟它让多个专家并存。

答:关键问题:当下MoE中,各专家的架构是同质的还是异质的?

问:同质。Mixtral、DeepSeek等所有专家都采用相同FFN结构,仅参数不同。

答:这对应大脑中的什么结构?左右半球,还是其他?

问:显然不是左右脑,左右脑在结构层面就不同。

答:正确。MoE的专家"专业化”,是同构结构在训练中分化出的功能差异。这不是左右脑,这是一百个左脑在协同作业。

问:它对应什么生物学结构?

答:皮层柱。哺乳动物大脑皮层的重复单元:结构高度相似,功能通过经验分化。大脑真实组织方式是半球级异质+皮层柱级同质。今天的MoE只实现了后一半。

通信限制:异质分化的隐藏条件

问:将MoE改造为异质结构即可?比如一半Transformer专家,一半Diffusion专家?

答:方向正确。但先思考更根本的问题:为何大脑左右半球能保持分化?

问:因为功能差异。

答:功能差异是结果,不是成因。分化并非与生俱来,是什么让这种分化稳定存在,没有坍缩为同质系统?

问:胼胝体?

答:再想想。胼胝体的作用是什么?

问:连接两半球。

答:连接得充分吗?

问:似乎不充分。胼胝体带宽有限,且多数连接具有抑制性。

答:这揭示了什么?

问:大脑在主动限制两半球间的通信?

答:Nature Communications 2019年的全脑侧化图谱显示明确规律:脑区间功能分化越强,胼胝体连接反而越弱。 这支持"半球间独立假说"。

问:这违反直觉。

答:正是。分化依赖于通信受限。 若两半球完全连通,它们将坍缩为同质系统,丧失分化的优势。

过度连接的陷阱:为何融合会扼杀智能分化

不融资年入270万,捐掉30亿公司:5个创业者用自主权重写财富规则

有一种折磨,比穷困更残酷——你赚到了钱,却不是以自己想要的方式。

上班、打工、接外包、追风口……赚钱的途径从不匮乏。真正稀缺的,是按照个人意志获取财富:由你定义产品形态,由你掌控发展节奏,由你选择合作伙伴,由你决定何时收手。

这不是励志鸡汤。以下五个创业者与企业,各自用截然不同的轨迹验证了这一命题。

Mailchimp:零融资做到120亿美元,硅谷最叛逆的收购案

2001年,当 Ben Chestnut 与 Dan Kurzius 创办 Mailchimp 时,这不过是他们网页设计业务的附属品。没人会将"邮件营销工具"与"颠覆行业"挂钩,连他们自己也没这样想过。

他们做出一个让硅谷精英困惑不解的决定:拒绝融资。2001年不融,2005年不融,2010年不融,直到2021年被收购前始终未融一分钱。当整个行业都在高喊"增长!增长!增长!“时,他们埋头打磨产品、服务客户、囤积利润。

结局如何?年营收突破8亿美元。2021年9月,Intuit 以120亿美元完成收购——创下科技创业史上规模最大的纯自筹资金退出纪录。

“我们只是群首次创业就失败的家伙,一直坚持做自己认为对的事。“Ben Chestnut 这样总结。

Mailchimp 的案例揭示了关键真相:不依赖外部资本,不等于无法做大。一旦拿了别人的钱,你就必须按别人的规则出牌。他们选择了更慢的道路,但这条路始终掌握在自己脚下。

颇具讽刺意味的是,收购消息传出后,Mailchimp 员工被迫自付医疗费用的新闻在 Hacker News 上引爆381个点赞与346条评论。社区对创始人失去控制权后文化崩坏的担忧,恰恰印证了:当主导权易手,许多东西便一去不返。

Gumroad:800万融资的"失败”,反而找回创业初心

Sahil Lavingia 的经历更为刺痛人心。

2011年,19岁的他从 Pinterest 离职(当时是二号员工,期权尚未到手),创立 Gumroad——一个让创作者直接售卖数字产品的平台。他成功融资800万美元,投资方包括 Accel、KPCB 乃至 Naval Ravikant 等顶级机构。团队扩张至20人,一切看似顺风顺水。

随后增长陷入停滞。2015年,他不得不裁掉75%的员工。

2019年,他发表那篇广为流传的《反思我未能打造十亿美元公司的失败》。其中一句写道:

“现在我运营着一家盈利、持续增长、维护成本低廉的软件公司,服务着忠实用户。但在很多年时间里,我一直认为自己是个失败者。”

这正是融资模式最残酷之处——一旦接受风险投资,你就进入"赢家通吃"的游戏:要么成为十亿美元独角兽,要么沦为败寇。中间状态?盈利但规模有限?在 VC 的字典里,这叫"僵尸公司”。

然而现实是,多数真正让人幸福的企业,恰恰存在于这个"中间地带”。Sahil 后来回购了投资人股份,Gumroad 至今仍在运转、盈利、服务创作者,只是不再追逐独角兽光环。

Indie Hackers 社区对此类故事的反应高度一致。平台上最受欢迎的案例研究——自筹资金做到3700万美元年收入的邮件平台、16岁编程做到1500万年收入的 AV 租赁 SaaS——收获50-90+的点赞数,远超众多 VC 背景故事。社区用投票表明立场:赚钱方式比数字本身更具分量。

Patagonia:73岁创始人捐出30亿,地球成为唯一股东

如果说 Mailchimp 与 Gumroad 讲述的是"如何按自己方式赚钱",那么 Yvon Chouinard 则诠释了"钱赚够之后怎么办"。

Chouinard 自认攀岩者而非商人,1973年创立 Patagonia,用50年时间将其打造成价值30亿美元的户外品牌。

2022年9月,他捐出了整个公司所有权——转入信托基金与非营利组织,全部用于应对气候变化。

“地球现在是我们唯一的股东。"——Yvon Chouinard

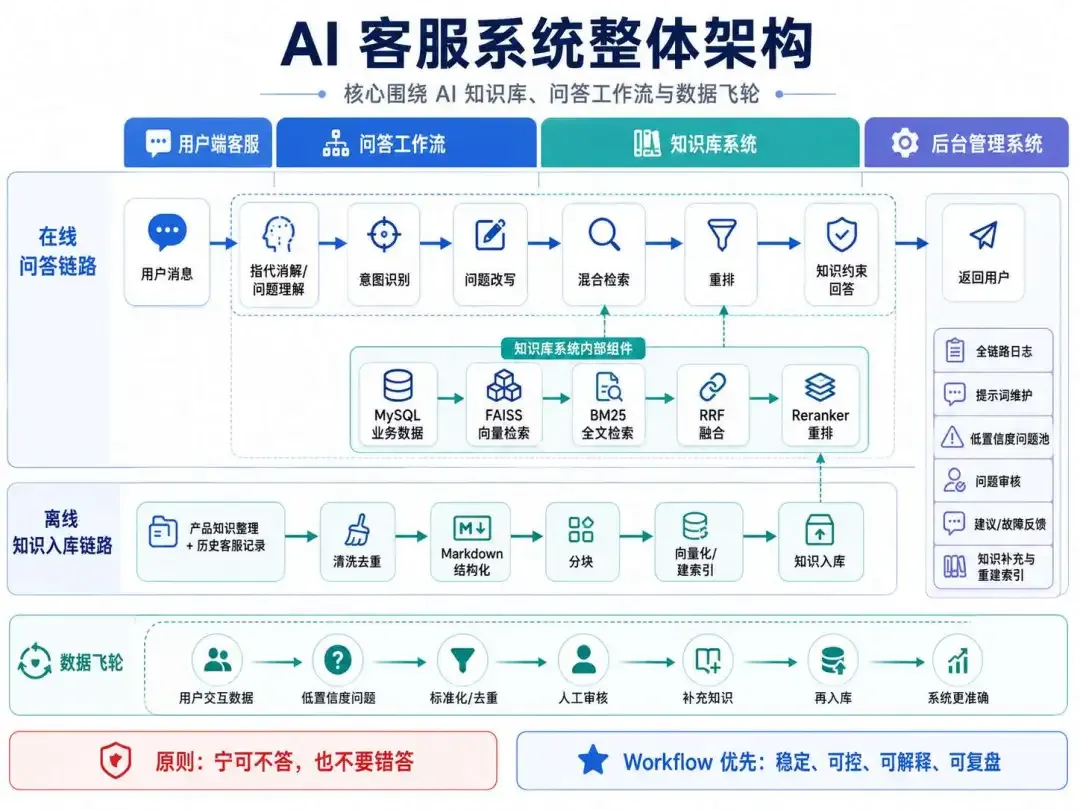

从0到1构建AI客服系统:意图识别、RAG检索与数据飞轮实战指南

续篇:AI客服实战方法论深度解析

前文《实践:AI客服实战方法论》已奠定基础,本文将以"空气小猪AI客服"为真实案例,完整拆解企业级智能客服系统的落地路径。

核心议题涵盖八大维度:项目价值评估、目标边界界定、技术路线选型、知识工程构建、意图识别实现、检索策略优化、全链路监控体系搭建,以及数据飞轮机制设计。

企业为何需要部署AI客服?

对于初创团队而言,客服始终是刚性成本。“空气小猪"上线后,客服工作长期由创始人亲自承担。

初期阶段,创始人直接接待用户确有必要——这能帮助团队精准捕捉产品痛点、理解用户使用瓶颈、收集一线反馈以驱动迭代。然而这种模式持续半年以上,日均消耗2-3小时,严重挤占了核心决策者在战略方向、产品规划、增长策略上的投入。

为何不早期引入AI客服? 关键在于语料积累。这半年的真人对话沉淀了高价值、真实场景的训练数据,成为后续智能服务的数据基石。缺乏足量优质语料,AI客服极易陷入"臆造答案"的陷阱。

并非所有业务场景都适合立即启用AI客服。若问题依赖深度人工判断、涉及复杂售后或用户权益处理,AI介入风险极高。“空气小猪"场景具备四大适配特征:

第一,高频问题高度重复。新用户咨询虽表述各异,但核心聚焦于产品定位、功能操作、学习成效、账号登录、消息推送、翻译功能、社交机制等十余个固定维度。知识库覆盖完善后,80%以上的咨询可自动化处理。

第二,历史对话质量极高。创始人过往的回复不仅包含标准答案,更蕴含对用户认知差异的解释逻辑、情绪安抚的话术策略,其价值远超从零编写的FAQ文档。

第三,产品理念需持续阐释。空气小猪的学习理念具有前瞻性,用户常带着传统工具的预期来询,客服工作中30%的精力用于解释"为何如此设计”,这类解释性内容可被结构化为标准知识。

第四,用户反馈即产品迭代信号。客服对话中埋藏着故障报告、功能建议、体验困惑等金矿。人工处理模式下,这些信息散落流失;AI客服可自动提取、归类、入库,形成结构化的需求池。

核心启示:初创产品必须由核心决策者主理客服,此举既是用户洞察的捷径,也为后续智能化积累不可替代的数据资产。

精准定义系统能力边界

启动前必须划定清晰的能力半径:哪些场景必须覆盖,哪些红线不可触碰。

核心职责包括:

- 基于知识库准确回答产品咨询

- 完整收集故障信息并自动建档

- 评估用户建议与产品战略的契合度,无效建议婉拒,有效建议入库

- 闲聊场景保持人格化、有温度的互动

- 识别知识盲区,将未知问题转入待补充队列

明确禁止行为:

- 执行任何数据库写操作或高风险指令

- 向用户作出确定性承诺(如"某功能必上线"“使用必见效”)

- 知识不足时强行编造答案

AI客服最危险的失效模式是"权威式胡诌”,这将直接摧毁用户信任。底线原则是:宁缺毋滥,不确定则沉默。

可控性优先的技术决策

曾面临两条路径:采用Dify/Coze/FastGPT等智能体平台,或自建工程化架构。

两类方案均可行。Dify功能均衡,工作流、知识库、模型管理、企业级特性相对完善,尤其适合快速MVP验证。

然而团队最终选择代码级实现,基于五重考量:

其一,过程可审计性。客服质量不仅看最终结果,更需追溯每个环节:问题改写逻辑、意图判定依据、召回内容清单、排序权重分配、上下文拼接策略、低置信判断规则、知识补充机制。黑盒平台难以实现如此细粒度的过程控制。

其二,检索深度定制需求。对召回策略、排序算法、上下文压缩等环节有精细化调优诉求,这恰恰是智能客服的核心竞争力,必须完全掌控。

其三,成本结构优化。私有化部署将产生额外服务器与运维开销,当前阶段非必要支出。

其四,响应速度要求。实测中Dify的链路易出现延迟,尤其在检索节点,难以满足"秒级响应"的用户体验基准。

其五,业务系统集成复杂度。即便使用平台,打通业务数据库、管理后台、反馈系统仍需大量定制开发。

在AI Coding工具加持下,代码实现的门槛显著降低,远低于传统预期。自建架构的显性收益在于:检索、排序、日志、飞轮等核心模块完全可控。

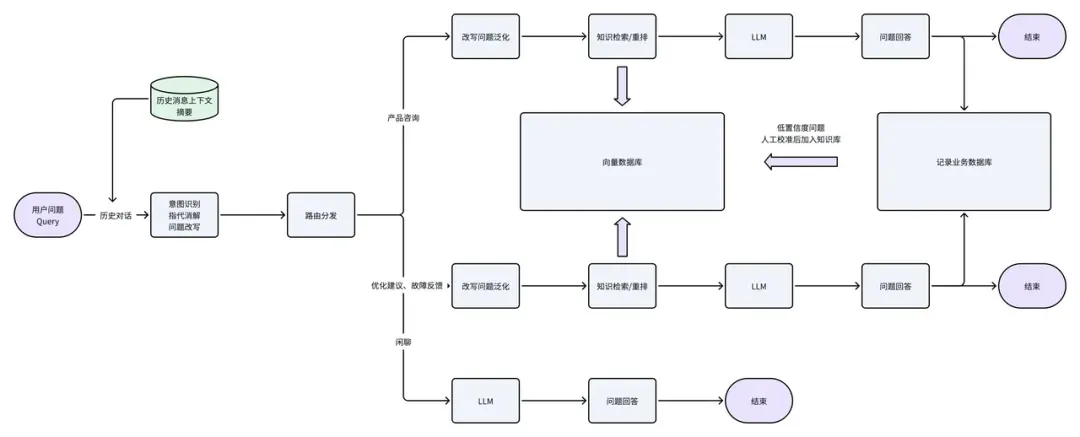

另一个架构抉择:Workflow还是Agent?

Agent具备自主规划、工具调用、动态决策能力,但客服场景要求确定性、可解释、可追溯,过度自主反而增加不确定性风险。

因此V1.0采用确定性工作流:每一步的输入、输出、异常处理均由系统显式编排。此设计牺牲了部分自主性,换取了极致的可控性与最低生产风险。事后复盘证明,先求稳定再谋智能的迭代策略极为正确。

系统流程与功能架构

将AI客服抽象为一句话:接收用户Query → 语义理解 → 意图分类 → 知识检索 → 约束生成 → 全链路日志记录。

工程实现时,该链路拆解为可观测的功能节点:

知识生产侧则独立为离线链路:

功能模块划分为四大部分:

- 用户端接口:消息收发与响应渲染

- 知识库引擎:知识采集、向量化、分层检索

- 问答编排层:模型调用与业务逻辑编排

- 管理后台:链路追踪、提示词运维、问题审核、数据看板

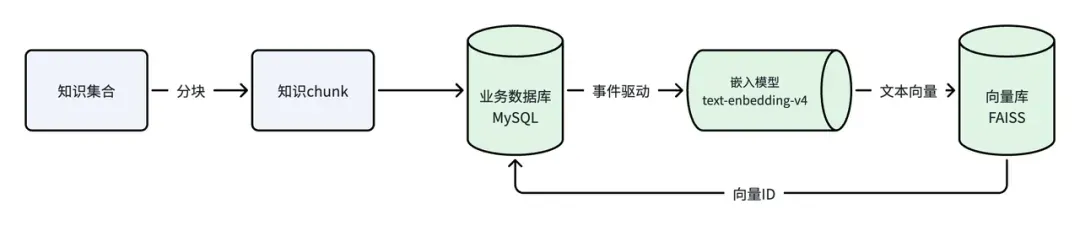

核心技术栈选型

| 模块 | 选型方案 |

|---|---|

| 服务框架 | Python + FastAPI |

| 向量检索 | FAISS |

| 业务数据 | MySQL |

| 嵌入模型 | Qwen text-embedding-v4 |

| 关键词检索 | BM25 |

| 多路融合 | RRF(倒数排序融合) |

| 精排模型 | Reranker |

| 意图识别与生成 | Qwen-plus(主力),GPT-4.1/Qwen3-max(效果基准) |

FAISS的选型逻辑在于轻量化、成熟度与低运维成本,足以支撑百万级知识规模。业务数据存于MySQL,确保知识原文、分类标签、审核状态、向量ID等元数据可结构化管控。该架构保持松耦合,未来可平滑迁移至Milvus、Weaviate或pgvector,无需重构业务层。

从6000亿蒸发到2.7%差距:中美AI生死竞速18个月纪实

如果你只能用一句话穿透这场竞赛的本质,那应该是:两边都认定自己已退无可退——而这两种判断,都能找到扎实的依据。

这不是一篇预测胜负的爽文。这是一份跨度18个月的实况切片,把双方经得起验证的底牌摊在桌面上,然后请你代入其中任意一方的视角:面对此情此景,你会不会后背发凉?

01 · 杭州震波:那个改写游戏规则的夜晚

2025年1月,特朗普重返白宫的那一周。全球AI界的注意力惯例性地聚焦华盛顿,然而真正击穿金融市场的声波,却从杭州传来。

DeepSeek揭晓了R1模型。这个源自中国团队的开源作品,性能直追OpenAI的o1——后者曾被山姆·奥特曼誉为“推理能力的史诗级跃迁”——而训练成本据称仅为o1的十分之一,甚至二十分之一。

资本市场用最诚实的方式回应:英伟达单日市值蒸发近6000亿美元,创下人类商业史上单日最大规模财富湮灭纪录。逻辑简单粗暴——如果顶级AI能用如此低廉的算力炼成,那么这个星球上最贵芯片公司的估值地基就出现了裂痕。

这是美国第一次在技术冲击之外,从财务报表上真切感受到中国AI的份量。不再是论文引用量的抽象对比,而是资产负债表上的真实震颤。

“DeepSeek-R1的发布,不是技术里程碑,是地缘政治的板块漂移。自那以后,整场游戏的音调都变了。”

02 · 数据战场:当数字本身开始站队

先来看看华盛顿最硬的底牌。

2025年,美国私营领域的AI投资达2859亿美元,中国为124亿美元。落差23倍。微软、谷歌、亚马逊、Meta四巨头的AI资本开支合计突破数千亿美元。仅美国企业的AI投入,就占全球5817亿美元总量的半壁江山。

数据中心:美国拥有5427个,中国仅有449个。12倍的数量鸿沟。

但翻页之后,剧情反转。

公共AI超算:中国部署85台——超过北美总和的两倍。

政府引导基金从2000年至2023年累计注入约1840亿美元。这不是商业决策,是国家意志的硬化。

论文发表量、引用量、AI专利注册数、工业机器人装机量——中国全盘登顶。2025年,中国工业机器人年度装机29.5万台,占全球54%。

2026年2月,斯坦福HAI研究院发布年度AI指数的核心结论:中美顶尖模型性能差距已收窄至2.7%。DeepSeek-R1曾在2025年2月短暂追平美国顶级水平,此后双方进入交替领先的绞杀状态。

2000亿美元投入,5427个数据中心,最终换得2.7个百分点的微弱优势。这份成绩单,在国会山很难被包装成胜利宣言。

关键时间轴:

- 2025.01 DeepSeek R1引爆市场,英伟达单日缩水6000亿。中国AI正式敲响战鼓。

- 2025.05 DeepSeek V2开源发布,开源与闭源模型的性能鸿沟持续收窄。

- 2026.04.13 斯坦福HAI报告定格2.7%差距。

- 2026.04.15 《纽约时报》调查结论:芯片出口管制濒临失效。中国通过算力租赁、芯片堆叠、模型蒸馏实现曲线突破。

- 2026.04.24 美国国务院向全球使领馆发出加密电报,点名DeepSeek、Moonshot AI、MiniMax三家公司。

- 2026.04.25 DeepSeek V4预览版发布,完美适配华为昇腾芯片,成本压至美国同类产品的七分之一。

03 · 外交电报、机场盘查与从未踏足的硅谷

2026年4月24日,美国国务院向全球驻外机构发送加密电报。指令清晰:警告盟友,中国AI企业——具体点名DeepSeek、Moonshot AI、MiniMax——涉嫌利用“提取与蒸馏”技术窃取美国专有模型的知识产权。

这早已超越技术纠纷,被直接升级为外交武器。通过国家级施压渠道,将商业摩擦转化为安全威胁。在此之前,OpenAI已向国会提交备忘录,指控DeepSeek对其模型实施系统性蒸馏。

同月,约20名持合法签证的中国学者在西雅图-塔科马国际机场入境时遭海关长时间羁押,最终全员遣返。他们的行程本是参加学术会议。

十年前,相似的剧本曾上演。2015年,天津大学教授张浩在洛杉矶机场被捕,当场被控经济间谍与窃取商业秘密罪,最终获刑入狱。此案在中国学术界留下永久性阴影,被视为“学术交流陷阱”的极端案例。

再看DeepSeek创始人梁文峰——一位拒绝IPO、拒绝多数投资、执着于开源路线的异类。他的名字在中国社交媒体上与“23次美国邀请悉数拒绝”的传闻绑定。该数据虽无法核实,也经不起第三方考证,但事实核心成立:他确实从未踏足美国本土。

一位从未访美的人,打造出让美国国务院动用全球外交网络预警的模型。

04 · 人才暗流:静默迁徙的方向逆转

2017年至今,选择移居美国的AI研究者骤减89%。仅2025年一年就下滑80%。

美国依然吸附着全球顶尖AI人才的绝对多数——硅谷的薪酬与算力暂时无可匹敌——但流入的势头已呈断崖式下跌。与此同时,华人AI创业者掀起归乡潮:Moonshot AI创始人杨植麟是典型样本——卡内基梅隆大学博士,归国创立Kimi,估值突破15亿美元。魔搭社区、MiniMax、零一万物,其核心创始层均流淌着美国名校与科技巨头的华人血液。

吊诡的是,美国22至25岁年轻开发者的就业率从2024年起下滑20%。当大厂为资深AI人才开出天价时,应届毕业生正被挤出市场。一个荒诞格局:美国拥有最深的人才储备池,却正在填平最浅的入水口。

05 · 算力博弈:封锁与突围的悖论

全球AI算力三年暴涨30倍。英伟达占据60%市场份额。台积电代工全球90%以上的先进AI芯片。

美国试图用芯片封锁将中国按在起跑线。逻辑直白:没有算力,就炼不出大模型。

2022年起,出口管制持续收紧:A100、H100、H200,层层加码。2026年3月,美国司法部起诉多起芯片走私大案——Super Micro牵涉25亿美元走私网络,另一宗案件将价值1700万美元的服务器经泰国中转偷运中国。

但《纽约时报》2026年4月15日的深度调查给出刺破性结论:出口管制正在失效。中国通过三重路径绕行——境外算力租赁、芯片堆叠工艺、以及华盛顿最忌惮的:蒸馏。

蒸馏的本质,是用顶级模型(如Claude、GPT-4)的输出训练轻量小模型。它游走于法律灰色地带,技术效果如此显著,以至于Anthropic公开声称“DeepSeek等动用2.4万个欺诈账户提取Claude回复”。该数字同样未获完全独立验证,但它揭示了一个业界共识:蒸馏真实存在,规模或许远超想象。

这让管制困境极度尴尬:封锁越严,对方成本优化越极致。DeepSeek V4预览版于2026年4月25日发布,在华为昇腾芯片上流畅运行,成本仅为美国同类模型的七分之一——这正是层层封锁下的最新答卷。

06 · 黑箱时代:当AI竞赛失去透明性

2025年,95个被广泛引用的AI基准模型中,80个未公开训练代码。FMTI透明度指数从58暴跌至40——这意味着模型能力越强,外界越难验证其真实实现路径。

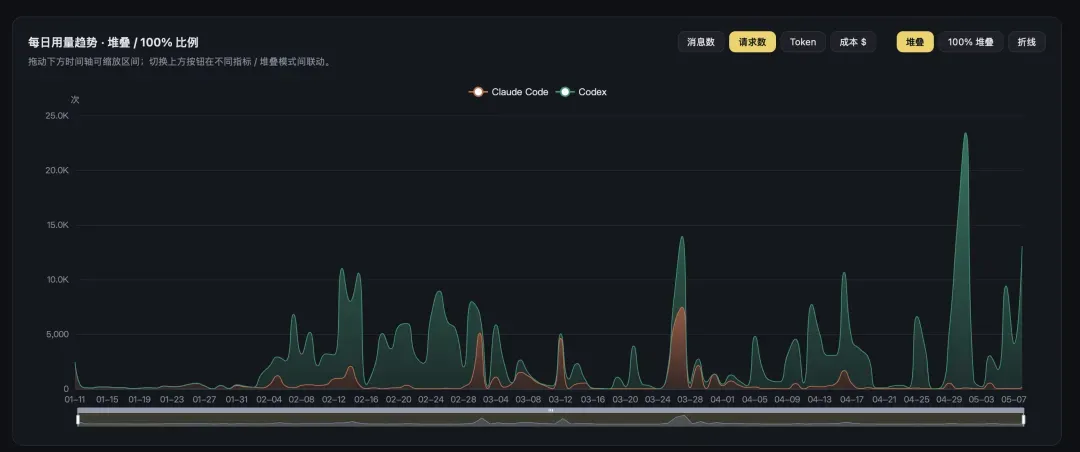

从Claude Code转向Codex:为什么GPT-5.5成为我的主力AI编程助手

此前我曾多次撰文推荐 Claude Code 这款编程助手。然而近几个月来,它的使用频率在我这里持续走低,取而代之的是 OpenAI 的 Codex。恰逢每月 200 美元的 Claude Code Max 订阅到期,我顺势取消了续费,仅保留一个 20 美元的基础账号用于观察。目前我的工具组合是:200 美元的 Codex 作为主要生产力,搭配 20 美元的 Claude 和 20 美元的 Google Gemini 作为辅助。

AI 编程工具这个市场,按月订阅才是明智之选。技术标杆的位置永远在轮换,今日王者明日可能就被超越。就在两三个月前还风光无限的 Claude,如今面对 GPT-5.5 的强势崛起,已经明显处于下风。

实战检验:模型能力的真实差距

OpenAI 的 Codex 应用生态与命令行工具日臻完善,模型性能更是实现了对 Claude 的全面超越。在处理复杂工程和硬核任务时,GPT-5.4 与 5.5 展现出令人信服的稳定性。反观 Claude 阵营,其 Opus 4.7 版本相较于 4.6 非但没有进步,反而出现明显倒退,日常对话体验更是大不如前。以至于我现在经常需要切换回 4.6 的 extended thinking 模式,才能获得流畅的交流体验。

正因如此,Claude Code 逐渐退出了我的核心工作流程,现在只被偶尔指派一些边缘性的小任务。

不仅在模型层面,工程实践也在发生同样的转变。我在开发 DBA Agent 时,最初默认用户会选择 Claude,因此相关文档都采用了 CLAUDE.md 格式。而在下个版本中,我计划将默认配置全面切换为 AGENTS.md 配合 Codex,使其成为 AI 工具链的标准接入方案。

大疆Pocket4素材备份全攻略:直连NAS释放存储,20TB空间+AI相册高效管理

传了很久的大疆 Pocket 4 这次真的来了,大家都买到了吗?

虽然不少人觉得 Pocket 4 相较于 Pocket 3 升级并不算大,但首发价便宜了 500 元,再加上一些细节优化,整体性价比其实相当出色。而且这次 Pocket 4 内置了 107GB 存储,无需插卡,开机就能直接录制。

另外在像素方面也有提升,并支持最高 4K/240FPS 的视频录制。不过 107GB 能存放的视频和照片其实相当有限,我试拍了一下,采用 4K/60FPS 画质时,录制 1 分钟大约会占用 1GB 存储空间。

而 4K/240FPS 慢动作视频,录制 1 分钟占用的存储则接近 2GB。

所以还是有必要使用存储卡。现在存储卡价格不便宜,但我手头这块闲置的佰维 MS210 高速 TF 卡是 512GB,用来拍 4K/240FPS 视频在容量和速度上都够用,也就没必要再额外购买了。

存储问题算是解决了,但如果你以前经常用 Pocket 3 拍摄,一定会发现,这玩意儿拍起来虽然方便,可在素材管理、使用上还是有一些不便之处。我之前在用 Pocket 3 时这种感觉就特别强烈,所以一直搭配 NAS 来进行素材备份和管理。

需要说明的是,并不是说买了 Pocket 4 就一定要再买一台 NAS,这只是提供一种可行的思路。我是先有了 NAS 才入手的 Pocket 3,对我来说,用 NAS 管理素材只是它众多功能里的一种。

我目前主要使用的是极空间 NAS,对它的系统功能比较熟悉。如果你已经有 NAS,而且有素材备份管理的需求,完全可以把这些功能充分利用起来。

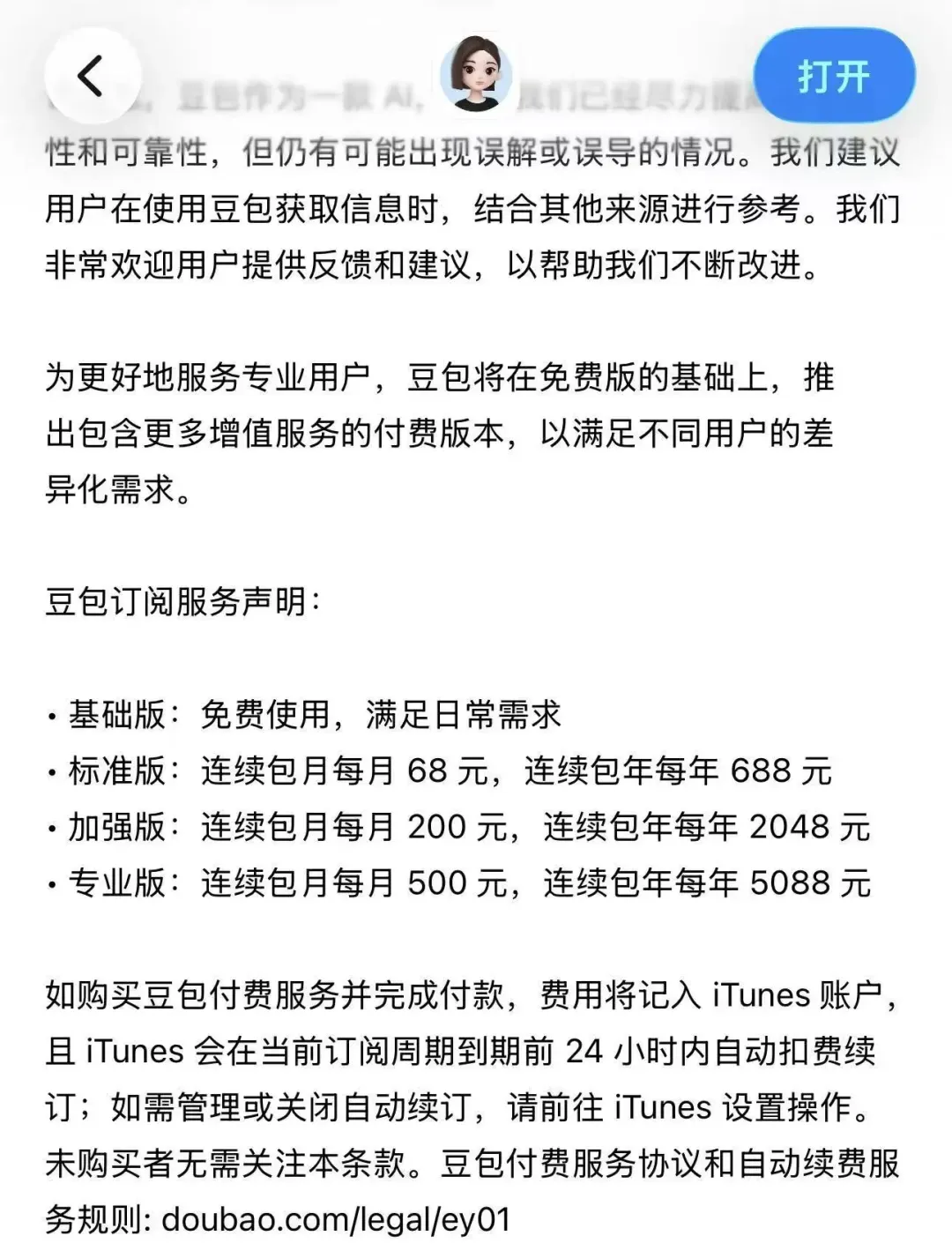

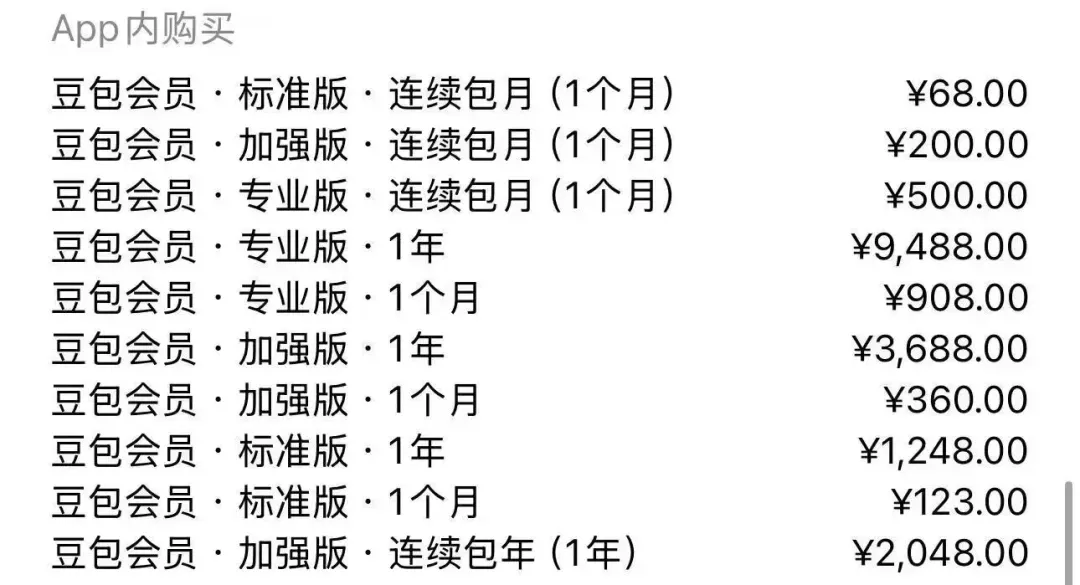

豆包AI助手即将开启付费订阅:会员体系对标ChatGPT,免费时代终结?

豆包商业化进程提速,苹果商店悄然更新订阅服务条款

近日,有细心的网友发现,字节跳动旗下AI助手豆包在苹果App Store的应用页面中,已悄然新增了订阅服务的相关条款说明。尽管当前版本尚未立即启动收费,但这一更新明确释放了即将实施会员制的信号,标志着国内AI助手市场免费模式或将迎来转折点。

根据更新的条款内容显示,豆包未来可能推行分级会员体系,这一策略与当前国际主流AI产品的商业化路径高度相似。行业观察者认为,此举预示着AI助手服务的免费红利期正在逐渐收窄,向可持续的商业模式转型已成为行业共识。

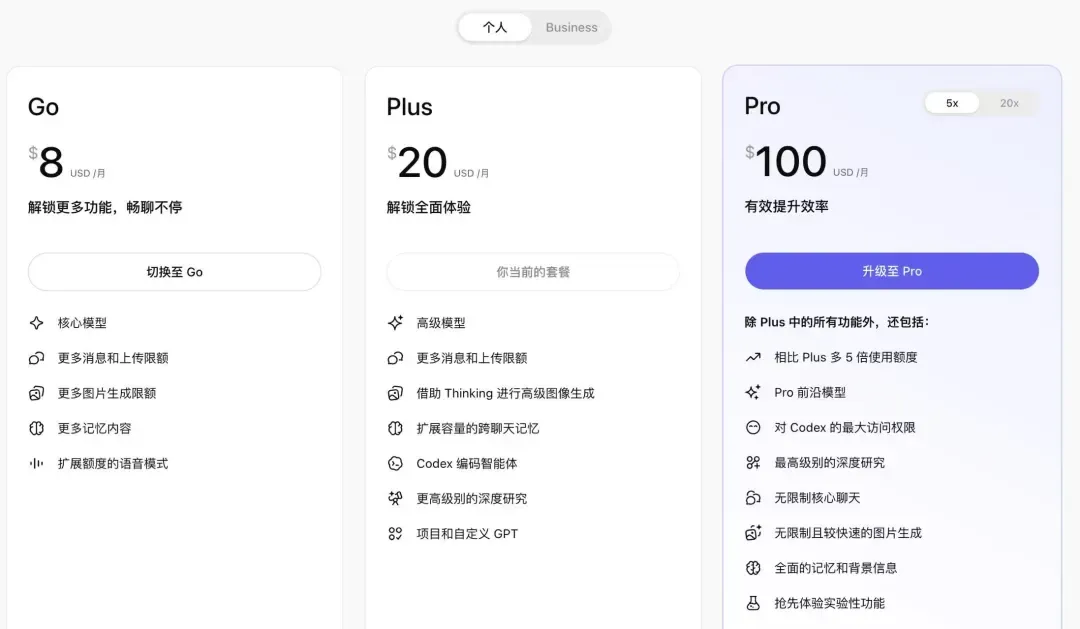

三级会员架构全面对标ChatGPT定价策略

从曝光的订阅方案来看,豆包规划的会员等级设置与OpenAI的ChatGPT形成了直接对标,分别为Go、Plus和Pro三个层级。

作为参照,ChatGPT目前在全球市场实施的订阅价格体系如下:

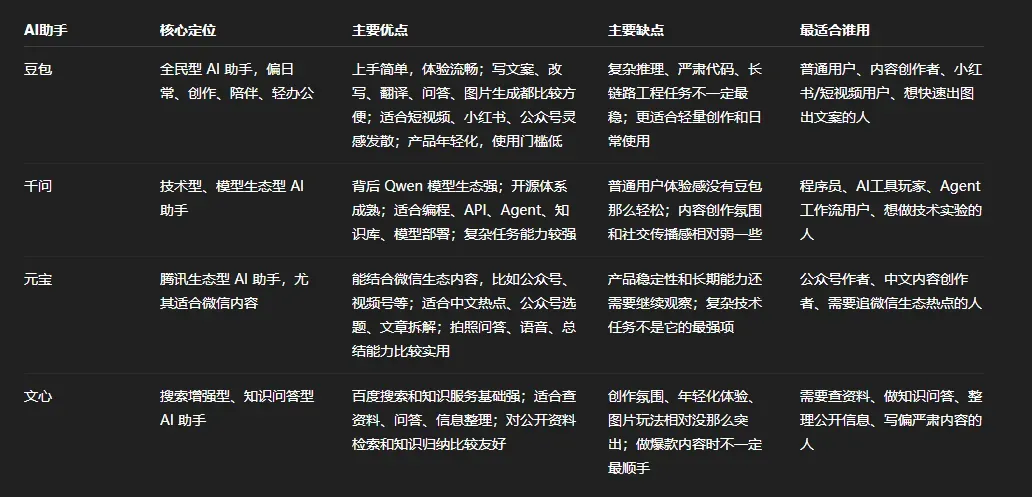

值得注意的是,具体的权益差异与功能限制细则尚未公布,市场关注的焦点集中在两个层面:其一,免费用户在收费政策实施后能够保留多少核心功能;其二,不同付费梯度之间的服务能力究竟如何区隔。考虑到当前国产大语言模型在综合性能上与GPT、Claude、Gemini等国际顶尖产品仍存在明显技术代差,豆包此次商业化的市场接受度仍有待观察。

收费模式重构用户体验与行业竞争格局

商业化转型对重度用户群体而言并非全然负面。在现有服务体系下,用户每日视频生成限额为5条,而付费机制的建立将大概率解锁更高使用额度。此外,诸如PPT智能制作、深度搜索增强等进阶功能,很可能在会员权益包中获得显著性能提升与配额扩充。

与此同时,价格门槛必然催生用户分流效应。部分对成本敏感的用户转向替代产品的趋势不可避免。针对这一潜在市场变化,我们系统梳理了当前主流AI助手的核心优势与功能短板,多数竞品目前仍维持免费策略,为用户提供多样化选择方案。

阿里通义千问或成最大受益者,用户迁移概率显著提升

基于现有市场竞争格局研判,若豆包正式推行收费策略,阿里巴巴旗下的通义千问极有可能加大资源投入承接外溢用户。对于普通用户而言,领军企业的价格策略调整反而可能激活更充分的市场竞争,最终形成服务质量与价格平衡的新生态。这种头部平台间的博弈,客观上为终端用户创造了更多选择空间与议价可能。

行业观察小结

AI助手从免费探索期迈向价值兑现期是产业发展的必然阶段。豆包的收费决策既是对自身技术投入的商业化回报尝试,也将成为国内AI应用市场成熟度的重要试金石。用户是否愿意为基础服务付费、竞品能否抓住窗口期实现反超,这些问题将在未来几个季度内得到市场验证。

独家:pgBackRest 作者宣布项目终止,PostgreSQL 备份生态迎来重大变数

GitHub 仓库已正式归档,开源备份工具时代落幕

项目作者在告别信中坦言,持续维护这一广受欢迎的 PostgreSQL 备份解决方案已变得越来越艰难。字里行间透露出的不仅是技术维护的疲惫,更折射出当下就业市场对个人开发者的不友好——当生存压力成为首要考量,曾经满怀热情的开源贡献也不得不向现实低头。

目前,pgBackRest 的 GitHub 官方仓库已完成归档操作,页面清晰地标注着"只读"状态。这意味着该项目已完全停止接受新的代码贡献、功能请求和问题修复,一个曾服务于全球数千家企业级用户的备份利器,就此画上了句号。社区用户亟需评估替代方案,以应对未来可能出现的技术支持缺口和安全更新停滞。

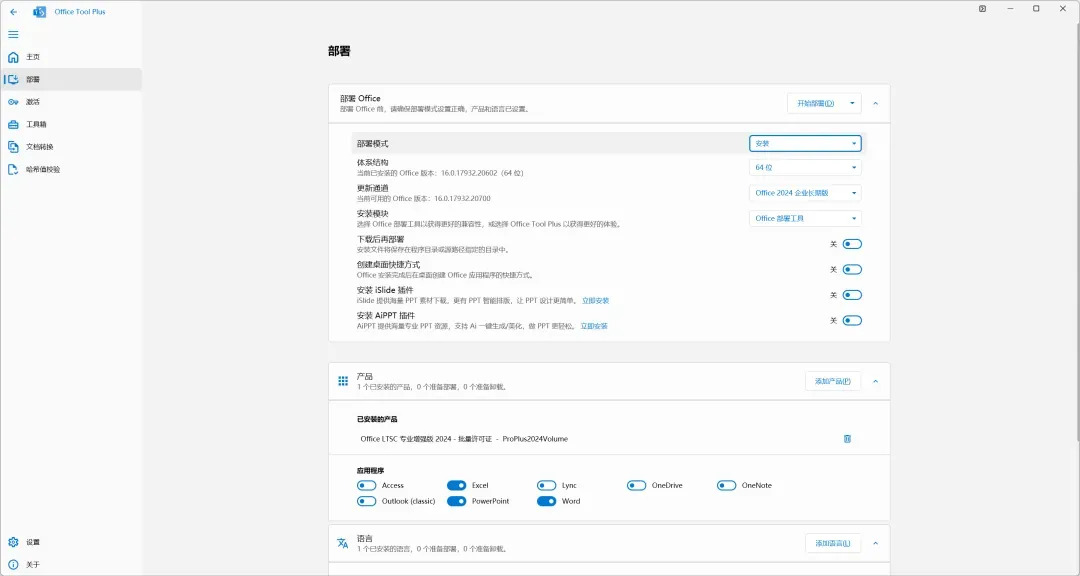

告别付费激活!手把手教你用Office Tool Plus一键永久激活Office365

经常与 Windows 打交道的朋友,难免会遇到重装系统的情况。系统装好后,习惯使用 Microsoft Office 办公却又得重新安装、激活,实在令人头疼。

有没有办法免费安装 Office 全家桶或 Office 365,并且顺利激活?当然有,只是临时去寻找往往耗时费力,还不一定立刻找到可用方案,不如提前收藏好工具,需要时信手拈来。

这里介绍一款实用软件——Office Tool Plus。它本质上是一个基于微软 Office 部署工具打造的全能办公辅助平台,功能简洁而不简单。

它免费无广告、绿色免安装,覆盖从安装到彻底卸载的完整生命周期,兼顾个人、团队乃至企业用户,堪称解决各类 Office 使用痛点的效率利器。

其核心能力之一,是高效部署与下载 Office。工具内置高速下载引擎,直接连通微软官方服务器获取安装文件,支持 Microsoft 365 及 Office、Visio、Project 2016 至 2024 全版本,囊括所有更新通道和语言包。

安装过程可以高度定制,按需勾选 Word、Excel、PowerPoint 等常用组件,剔除冗余模块以节省磁盘空间。此外,还能创建 ISO 镜像、导出或导入安装配置,方便在多设备上批量部署。

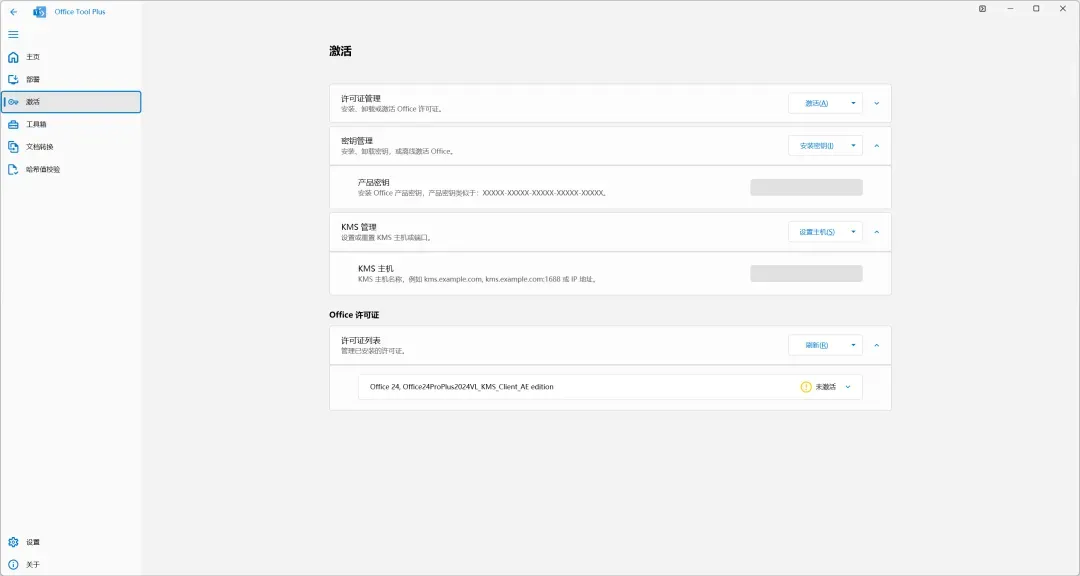

激活与授权管理同样简便。它支持在线激活、KMS 激活等多种方式,适配各类授权类型,可轻松激活全系列 Office 及相关产品。同时提供许可证、密钥及 KMS 服务器管理功能,能快速修复激活异常,毫无基础的用户也能立即上手。

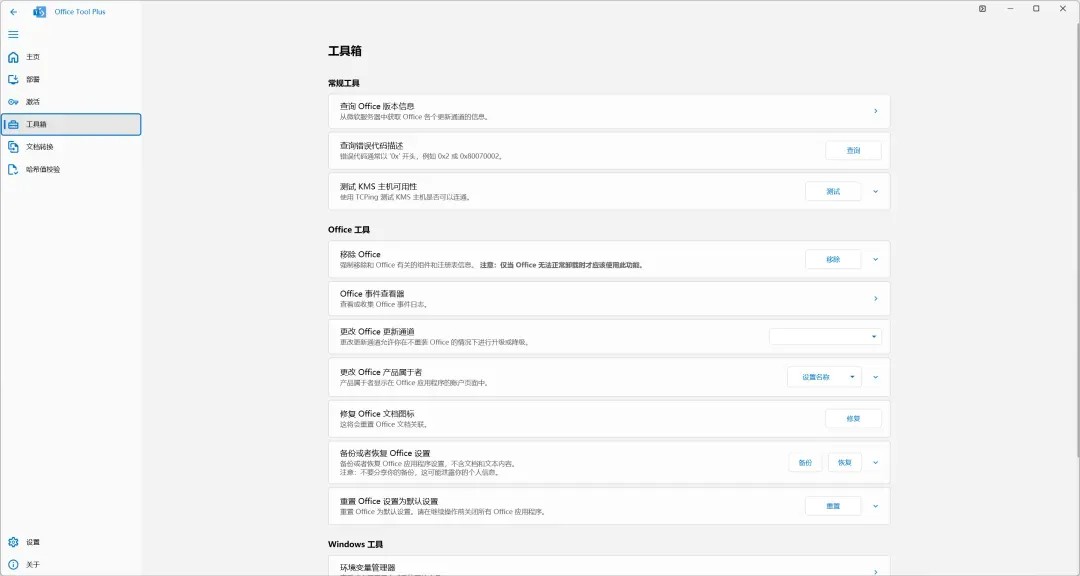

当 Office 无法正常卸载时,它还能强制清除残留文件和注册表,兼容从 2003 到最新版本的各类 Office。内置工具箱支持一键重置 Office 设置、修复安装和激活问题,无需重装软件就能解决闪退、功能失效等常见故障。

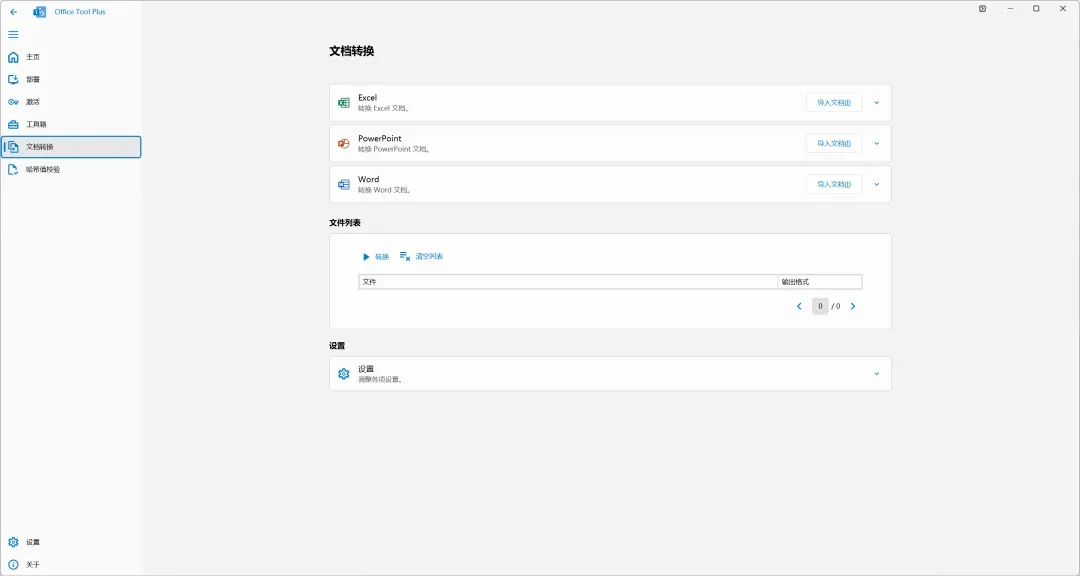

除此之外,它还具备批量转换 Word、Excel、PowerPoint 文档格式等附加功能。不过,最核心的仍是安装、激活、卸载这三板斧,用起来极其顺手。

下载链接也一并附上,强烈建议先收藏备用:

https://otp.landian.vip/zh-cn/download.html

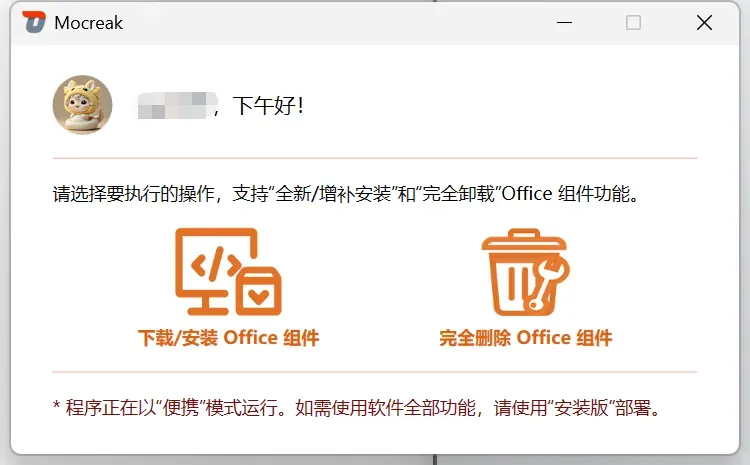

另外,还有一款同类工具 Mocreak 也非常好用(这两款我都亲身体验过)。相比 Office Tool Plus,Mocreak 的界面更加精简直观,便捷版打开后直接呈现两个核心功能:下载安装与完全卸载。

它同样提供安装版、控制台版等其他版本,用户可根据自己的使用习惯和需求自由选择,下载即用。

Mocreak 能自适应 x86、x64 架构,支持高度定制化配置,默认仅安装 Word、PPT、Excel 三大核心组件,其他全家桶功能可随意增删,同时支持 43 种语言作为首选安装语言。