AI Token省钱全攻略:零成本实现Token自由的4大绝技

想拥有永远消耗不尽的AI Token?理论上只有一条路:具备雄厚的财力,每月砸下几千甚至上万美元。但像笔者这样囊中羞涩的开发者该怎么办?答案在于精打细算。我并不追求毫无顾忌地挥霍token,我的目标是在执行任何任务时都能随时调用AI能力,无需等待配额恢复——我将这种状态称为"Token自由"。

实现这种自由主要依靠三大策略:第一,慧眼识平台,避免在黑心服务商处浪费金钱;第二,深入理解AI Agent运作原理,掌握工具使用的核心技术来节省token;第三,巧妙游走于各大厂商之间,充分挖掘免费资源。

平台甄别指南:避开Token消费陷阱

上周我曾撰文推荐过某平台,真心希望你们尚未购买其会员,即便买了,最好也只花了20美元。下个月我确定不会续费。诚然,该平台确实解决了支付和网络访问的痛点,但它隐藏着更严重的问题——而且即便在这些优点上,市场上也存在更优选择。

我曾在二手平台以几元钱的价格购买过所谓的CC服务。官方会员费20美元,为何他们能卖如此低价?购买后我便追悔莫及。这类个人运营平台主要埋藏着两类陷阱:

**陷阱一:模型偷梁换柱。**宣称提供Claude或GPT模型,却不标明具体版本号,仅模糊标注为"平台内部版本"。实则利用显卡自行部署免费开源LLM模型,冒充顶级商业模型糊弄用户。结果用户体验后感叹:“AI就这水平?媒体纯属夸大,百年内都无法超越人类。”

**陷阱二:计费单位暗箱操作。**以几元或几十元出售所谓"世界级大语言模型100个额度",用户欣喜若狂以为捡到便宜。然而实际只发送三条提示词就触达上限。查询记录发现首条提示竟消耗30个额度。用户疑惑:难道不是每次交互只计1个额度?平台回应:一个请求对应一个额度是您的误解。在我们的系统中,思考、规划、分析、代码生成、执行、验证、修改、总结等每个环节都算作一次或多次交互,每个动作都消耗数个额度,因此单条提示消耗30个额度难道不合理吗?

除了上述两大陷阱,这类平台还存在诸多猫腻。正是这些问题导致部分用户对AI望而却步,形成了"AI又贵又笨"的错误认知。

个人小平台不可靠,那转向大平台总该安全了吧?国内头部厂商确实规范,但受国际法规限制,无法直接提供国外大语言模型服务。因此你会发现国内大厂的AI IDE都分为两个版本:例如字节的Trae分CN版和国际版,腾讯的CodeBuddy同样如此。

CN版仅限国内模型,国际版才能调用Claude 4.7 Opus、GPT 5.5 Pro、Google Gemini 3.1 Pro等顶级模型——因为海外厂商明确规定不允许中国大陆IP使用其服务。即便使用国内大厂开发的国际版,网络限制依然存在。有传言称CodeBuddy国际版默认集成了昂贵的Claude 4.7 Opus,我对此持怀疑态度,毕竟Opus成本极高,企业不太可能免费提供。某些IDE默认模型表现优异,实则源于其在Agent层面的深度优化,而非单纯依赖模型能力。

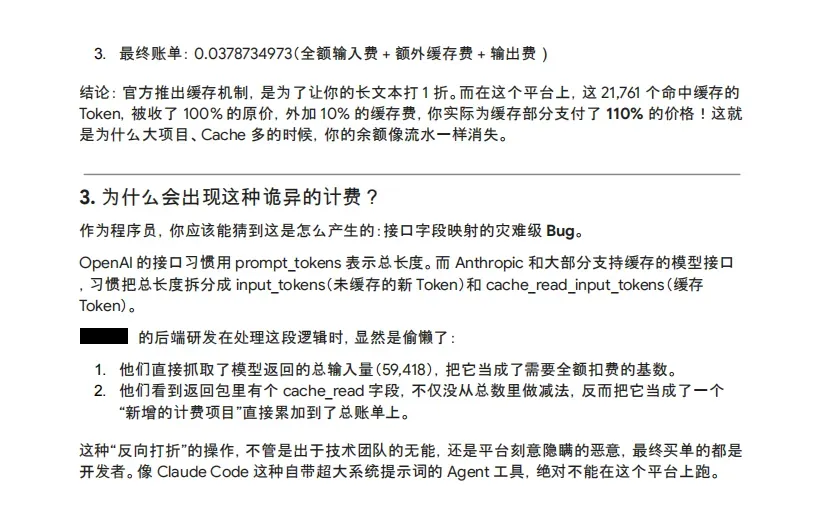

主流token供应平台分为两类:一类是字节、腾讯、阿里、DeepSeek、MiniMax等拥有自研模型的大厂,它们在自家平台主推自有模型,通常不提供竞品尤其是国外模型(尽管其内部员工广泛使用国外模型以提升技术);另一类是聚合平台,如我早前误推的某平台,以及OpenRouter(https://openrouter.ai)、DeepInfra(https://deepinfra.com)、Together(https://www.together.ai)等。聚合平台质量参差不齐,自ChatGPT 4.0发布以来,多少此类平台昙花一现便销声匿迹,其中必有蹊跷。

分享我的真实遭遇:订阅某平台20美元会员后,每天仅用几条提示就耗尽额度。为何消耗如此迅速?查看价格体系便知端倪:大语言模型通常设有输入价、输出价和缓存价三个档位,核心逻辑在于——命中缓存的调用成本极低。

MiniMax模型定价

DeepSeek V4定价

然而能否命中缓存完全由大模型厂商决定,缓存数据也存储在厂商服务器上,与中间商无关。良心厂商如Anthropic会如实向中间商返回缓存命中数据,此时是否按缓存价计费,就看中间商的商业道德了。

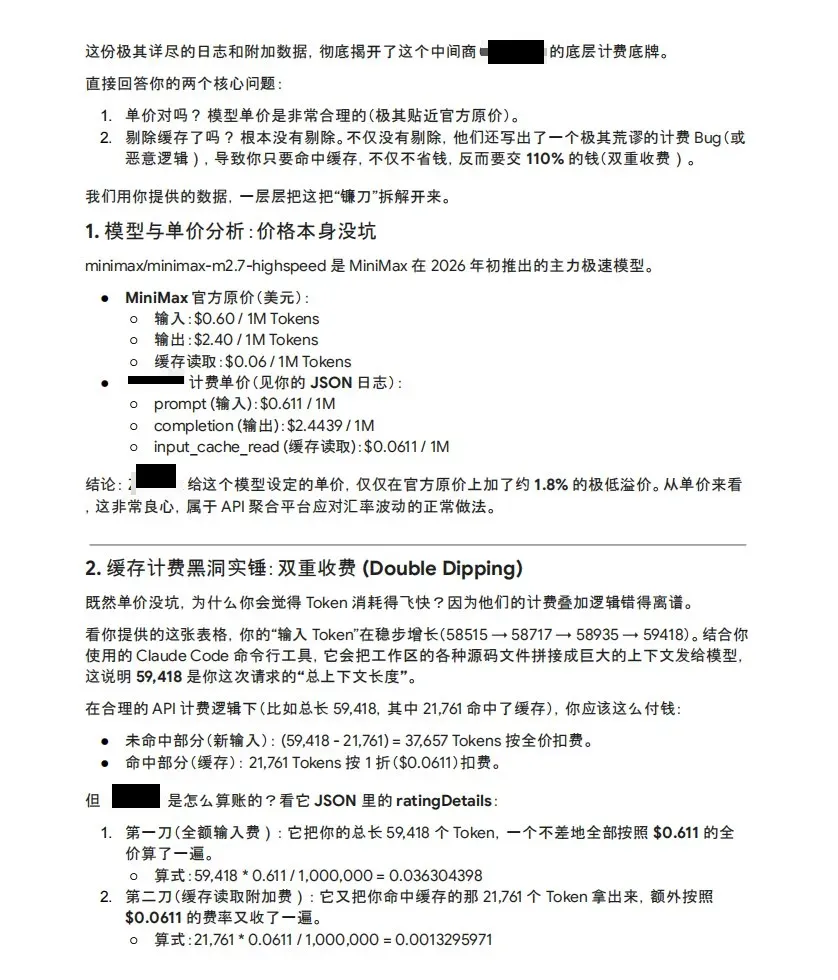

近期使用某平台时,提交两三条提示就触及限额,令我倍感挫败。于是调取后台日志分析——日志文件竟达十几万字。懒得手动查阅,我将其投喂给Gemini 3.1 Pro分析。不确定谷歌是否对该平台存有偏见,Gemini的回复令我震惊,原文截图如下:

Gemini指出该平台可能存在计费逻辑缺陷——不仅未扣除已缓存的token,反而重复计费每次加收110%费用。为确保准确性,我重新下载日志再次验证,结论完全一致。好家伙!难怪token眨眼间耗尽!官方API(无论是OpenAI还是Claude)都会自动减免缓存部分,到中间商这里非但不少,反而多收。更过分的是,这一切竟光明正大记录在日志中,是赌定用户不会查看吗?但愿是Gemini误判,否则此事着实恶劣。我下个月绝不再续费该平台。

至此真相大白:闲鱼个人平台不可信,连是否使用真模型都无法保证;部分聚合商掌控计费算法,缓存token是否减免全凭良心,差价高达数倍。这类平台适合未体验过Claude Code或GPT的用户短期尝鲜,长期订阅甚至购买百元套餐毫无意义。近两年倒闭的聚合平台不在少数,个中缘由值得深思。

除上述两类,还有优质聚合平台如OpenRouter、DeepInfra、Together等。可靠平台不仅记录缓存命中数,更会在总额度中扣除,这类良心服务才值得信赖。我个人推荐OpenRouter,它模型齐全且提供Agent SDK,是程序员研究AI Agent开发的理想阵地。

Token节流术:CLI工具高效使用法则

目前阶段,CLI工具在token优化方面普遍优于IDE。尽管IDE在鼠标和光标交互上有独特优化,但整体而言CLI的优化更为先进。我已完全转向CLI开发,并总结出一段使用口诀:

完成阶段性任务可执行/compact压缩对话

遇到子任务分支可用/agents调度

走偏方向立即用/rewind回退

新阶段准备提交代码前执行/clear

代码改动较大不放心,预先运行/diff检查

其中/compact最为关键,它能将冗长对话精简为核心信息点,清除冗余历史文本,节省70%以上的活跃token。

这些指令虽针对Claude Code设计,但多数CLI已实现功能互通。AiDer和OpenCode作为开源先驱贡献了众多创新,Repo Map机制便疑似由AiDer首创。

若常忘记手动压缩,可安装claude-mem插件实现自动优化。该插件自动压缩上下文并在新会话中注入精简内容,确保持续节省token。

安装步骤简洁:

/plugin marketplace add thedotmack/claude-mem

/plugin install claude-mem

不同CLI插件安装方式类似,但需注意区分当前环境——在Gemini CLI中尝试安装Claude插件必然失败,切勿误怪网络问题。

另一项必做优化是配置ignore文件,主动排除无关文件以避免token浪费。此招尤其对Node.js项目效果显著,node_modules目录的体积堪称恐怖。

通用过滤规则建议:

- 构建产物:dist/、build/、out/、bin/、obj/

- 依赖包:node_modules/、vendor/、.venv/、env/

- 日志与临时文件:*.log、tmp/、.cache/、.DS_Store

- 隐藏目录:.git/、.idea/、.vscode/、.gemini/(非必要不包含)

- 多媒体与二进制:.png、.jpg/、.pdf/、.exe/、*.zip

各CLI对应ignore文件名:

AI时代普通人创业避坑指南:OPC模式与Token销售实战心得

AI创业误区:持续学习并非核心突破口

近期因处理多平台账号事务暂停更新,表面是时间紧张,实则因项目推进节奏加快。投身AI领域月余,却似历经一年,期间见证大模型代理政策迭代、新产品涌现、OPC模式构建等行业变局。现将实践心得梳理分享,为AI赛道参与者提供参考。

常见认知陷阱在于:AI创业需持续学习新技术。这个观点成立,但非关键。AI技术迭代迅猛,旧知识尚未内化,新框架已取而代之。因此,入局时机从来不是问题,所有参与者都处于同步学习状态。笔者历经两个月追逐风口无果后,转而聚焦垂直切入点,一个月内即获实质进展。核心在于:深度参与实践远比观望学习重要。

破局关键:从技术应用转向生态布局

当前AI领域的制胜点并非单纯的应用能力。精通工具运用虽能提升效率,但本质上仍是优化版的"高级打工人"模式。真正的机遇在于顶层布局、市场推广与生态普及——即帮助更多从业者接入AI工具链。

面对"自媒体人为何转向Token渠道"的疑问,答案源于经验沉淀与AI能力放大效应。此前因精力限制搁置创业计划,而AI完美解决了这一瓶颈:从战略规划到宣传执行,均可交由智能工具完成。十余年科技行业积累的人脉资源——涵盖项目方、投资人、技术专家及社区KOL——在Token分销业务中转化为核心资产。个人信用背书则确保优质代理权限的获取与用户信任的建立。这也是OPC模式的亲身实践样本。

OPC模式争议:生产力革命而非旧瓶装新酒

针对OPC模式等同于传统大众创业的观点,以及部分项目失败引发的质疑,基于实战经验作出回应:

OPC与早期创业潮的本质区别在于生产力基础的根本性变革。大众往往只看到单人公司"低成本、低门槛"的表象,却忽视其依托AI生产力跃迁的实质。传统创业要求团队无短板,OPC模式则依赖创始人的绝对长板。这种模式极大降低了管理成本与团队内耗,规避了股权分配等利益纠葛,使创业者能专注于核心能力释放,其余环节交付AI处理。低成本、高利润、零内耗、轻资产构成OPC的核心竞争力,但项目选择需匹配这些特性。

笔者将社群运营引入Token销售,通过圈层扩散实现行业传播,成效显著。需特别强调的是:AI创业的前端开发门槛极低,且运行依赖大模型输出,行业经验者能快速构建可用产品。基于该逻辑,已在视频创作、自媒体运营及电商领域落地多个AI提效工具。另一大优势在于商业模式:Token预付机制消除了账期、垫资与库存压力,这是传统创业无法比拟的特征。

残酷真相:OPC并非适合所有人

必须直面现实:AI会放大而非缩小能力差距。有积累者如虎添翼,零基础者难以借力。针对资源薄弱人群的建议如下:

- 先沉淀再出发:在目标领域深耕3-5年,构建专业能力与人脉网络

- 从微创新切入:避免直接启动大型项目,捕捉细分场景的小机会

- 保持动态学习:AI领域变速快,阶段性落后无需焦虑,新技术会快速覆盖旧周期

- 创业是能力溢出而非逃避:当现有岗位无法承载个人价值时,才是创业窗口期

- OPC更适合中年转型者,年轻人应深度理解模式,为未来时机储备认知

未来布局:构建社群驱动的AI产品生态

下一步规划已明确四个方向:

第一,固化OPC社区运营与Token社群代理模式,作为核心推广范式。

第二,推进与360等大厂的技术合作协议,依托其底层能力实现AI项目在各类OPC社区及企业端的规模化落地。

第三,拓展软硬件AI产品代理与自研体系,围绕Token消耗构建产品矩阵,服务个人与中小企业增效需求,打造社群化AI产品分发新范式并下沉至OPC网络。

第四,同步启动B端与C端业务,以"人"为核心构建AI逆袭社群,力求在五六七三个月跑通模型并形成迭代节奏。

五一期间将开展社群内部直播,深度拆解上述经验与未来规划,欢迎真正想参与Token浪潮的从业者关注。

Claude Code 模型封锁终极绕过指南:手写 MITM 代理完整方案与代码实战

直击痛点:为什么以往的好用方法一夜之间全部失效

Anthropic 在最新的 Claude Code(v2.1.126) 中悄然上线了一套极度严格的内生封闭机制,目的非常清楚:阻止用户通过代理工具(如 CC Switch 等)把底层模型替换为 DeepSeek V4 这类既聪明又便宜的第三方大模型。 如果你是一个重度依赖 AI 编程的开发者,某个早上打开终端敲入 claude,大概率会被满屏的 404 Model Not Found、400 Invalid Request,甚至流中断搞得措手不及。为了把这道封锁彻底拆掉,我经历了一整夜的排错,最终手搓了一个“终极中间人代理(MITM Proxy)”,直接让 Anthropic 的防线形同虚设。下面把整个破解过程和可以直接照搬使用的完整代码分享出来。

三重防线:从本地到流式,Anthropic 狠在何处

这次 Anthropic 一共设下了三道防线,一环扣一环,稍有不慎就会触发报错。

第一道防线:本地模型名称白名单校验

过去在代理中直接指名 --model deepseek-v4-flash,Claude Code 就会老老实实把请求外发。升级后,其默认模型被悄悄变更为 claude-sonnet-4-6,并且加上了本地强校验:所有非白名单模型名都会被本地拦截,网络请求根本不会发出去。

绕过思路很简单:顺着它的预期走,客户端依旧发送官方模型名 claude-sonnet-4-6,然后在代理层悄悄替换为真正的目标模型名,客户端完全感知不到底层变化,自然不再报错。

第二道防线:DeepSeek 端的 Catch-22 死循环

突破名称限制后,请求终于到达 DeepSeek,但紧接着就收到了 400 错误。这是因为 Claude Code 默认会携带 output_config: { effort: 'max' },而这个参数会强制触发 DeepSeek 的思考模式(Reasoner)。问题在于,DeepSeek 的 Reasoner 有一个致命缺陷——不支持工具调用(Tool Choice)。

这就形成了一个死锁:

- Claude Code 发出

effort: max→ 触发 Reasoner; - Reasoner 要求历史消息中包含

thinking块; - Reasoner 又不允许工具调用,一旦消息中带有 WebSearch 或 MCP 工具定义就会直接崩溃。

破解方式只能“断臂求生”:在代理层强制删除 output_config 参数,同时遍历所有历史消息,把所有 thinking 块剔除,让 DeepSeek 保持在支持工具调用的 V4 Flash 模式。代价是关闭了思考模式,但完整保留了工具调用的能力。

Codex 进阶实战完全指南:云端 IDE 集成与深度应用技巧

许多开发者初次接触 Codex 时,往往从本地部署开始。

实际上,Codex 的云端版本提供了更为强大的协作能力。

可以这样理解两者的差异:

- 本地 Codex:在你的个人计算机上独立运行

- 云端 Codex:直接对接 GitHub 仓库,在云端环境中处理任务

对于已经托管在 GitHub 上的项目,云端版本无疑是更优选择。它能够直接读取仓库代码、深度理解项目结构,并在后台静默执行开发任务。

1. 初始化 GitHub 代码仓库

假设本地存在一个项目目录,例如:

cd d:\test1\

首先将该目录初始化为 Git 仓库:

git init

完成初始化后,建议立即提交初始版本,形成第一个历史快照。提交信息务必描述清晰,避免所有提交都使用"update"这类模糊描述。

2. 配置远程仓库并推送代码

登录 GitHub 平台创建新的远程仓库,命名为 test1。

仓库创建完毕后,在终端依次执行以下命令(注意替换为你的实际仓库地址):

git remote add origin https://github.com/你的用户名/test.git git branch -M main git push -u origin main

执行 git push 时通常会触发 GitHub 授权流程。

根据提示选择浏览器授权即可完成身份验证。

推送成功后,你将在 GitHub 页面看到完整的项目文件列表。

3. 授权 Codex 访问 GitHub 资源

访问 Codex 云端入口:https://chatgpt.com/codex

点击页面中的"连接到 GitHub"按钮,按流程完成授权操作。

授权成功后,选择目标仓库并授予访问权限。

CodexCLI 安装避坑全攻略:从 PowerShell 报错到环境变量全面修复

问题一:安装命令被 PowerShell 阻止

刚开始满怀期待地运行官方安装命令,却直接撞上了一个错误:

npm install -g @openai/codex

遇到这种现象,多半是因为 Windows 自带的 PowerShell 出于安全考虑,默认禁止执行 .ps1 脚本,而 npm 在 PowerShell 中的操作恰好属于这类脚本。

要解决它,我们只需调整策略,为当前用户开放本地脚本的运行权限。

第一步,以管理员身份打开 PowerShell:右键单击开始菜单(或按 Win+X),选择“Windows PowerShell (管理员)”或“终端 (管理员)”。

第二步,查看当前的执行策略。在窗口中输入以下命令并回车:

Get-ExecutionPolicy

如果返回的是 Restricted,就说明正是默认的“禁止”状态导致了刚才的报错。

第三步,调整策略。下面这条命令只会更改当前用户的执行策略,也就是只对你这个账户生效。这样既解决了问题,又不会降低太多安全性——它允许本地脚本运行,但对来自网络的脚本要求具备可信的数字签名。

Set-ExecutionPolicy -Scope CurrentUser RemoteSigned

问题二:重试安装,确认成功

策略修改后,重新运行官方的安装命令,几秒钟内就会出现类似下图的界面,这说明 @openai/codex 工具包已经成功安装。

至于 npm notice ... 之后的内容,只是在提示官方 npm 版本已经更新到了 11.13.0,不更新对 codex 的使用也不会有影响。如果想更新,直接复制图中倒数第二行 run 后面的命令,粘贴并回车运行即可。

问题三:命令无法识别,环境变量还没配好

输入 codex 命令后,如果出现了“无法将‘codex’项识别为 cmdlet…”之类的错误,通常说明 codex 本身已经装上了,但系统还找不到它。

核心原因就是 PATH 环境变量没有配置好。 这就像你走进一家商场却找不到某家店铺——店铺确实存在,但缺少登记信息,所以寻址失败。我们需要做的,就是把 codex 的“住址”登记到系统的 PATH 中。

问题四:给终端一张“地图”,让 PowerShell 认识 codex

因为咱们一直用的是 PowerShell,但 PowerShell 压根不知道 codex 这个家伙在哪里。为了让它们互相认识,就得制作一张地图——也就是配置 PATH。

Codex登录验证码卡住?低成本虚拟号码排障实录:解决AI工具最后一厘米难题

很多AI工具真正的门槛不在模型或提示词,而在于登录、验证、支付、地区这类“最后一厘米”。这次使用Codex时,恰好卡在了手机验证码这一环,我把整个排障过程记录下来,供有同样困扰的朋友参考。

登录Codex本不该单独写成一篇文章——按常理,只要输入账号,收到验证码,就能进入工具直接使用。但现实往往偏离理想路线。

很多时候,AI工具最大的阻碍并非模型、提示词或是功能本身,而是最后一步那个小小的验证码。这次,我正好被卡在这个位置。

Codex登录要求手机验证,而我遇到的难题是:必须使用国外号码才能接收验证码。

这个问题早有耳闻,许多人都有类似遭遇。但多数讨论停留在“我也卡住了”“可能需要海外号码”“听说有接码服务”的层面,真正把流程走通、把坑位讲透彻的经验分享,却难得一见。

因此,我把它当作一次小型排障来处理。搜索后,发现有人推荐接码平台hero-sms.com。

需要提前声明:这不是官方方案,也不建议将其作为长期账号的基础设施。它只是一次应急排障记录。如果你已经被验证码卡住,只想快速确认工具能否继续使用,那不妨把它看作一次低成本的尝试。

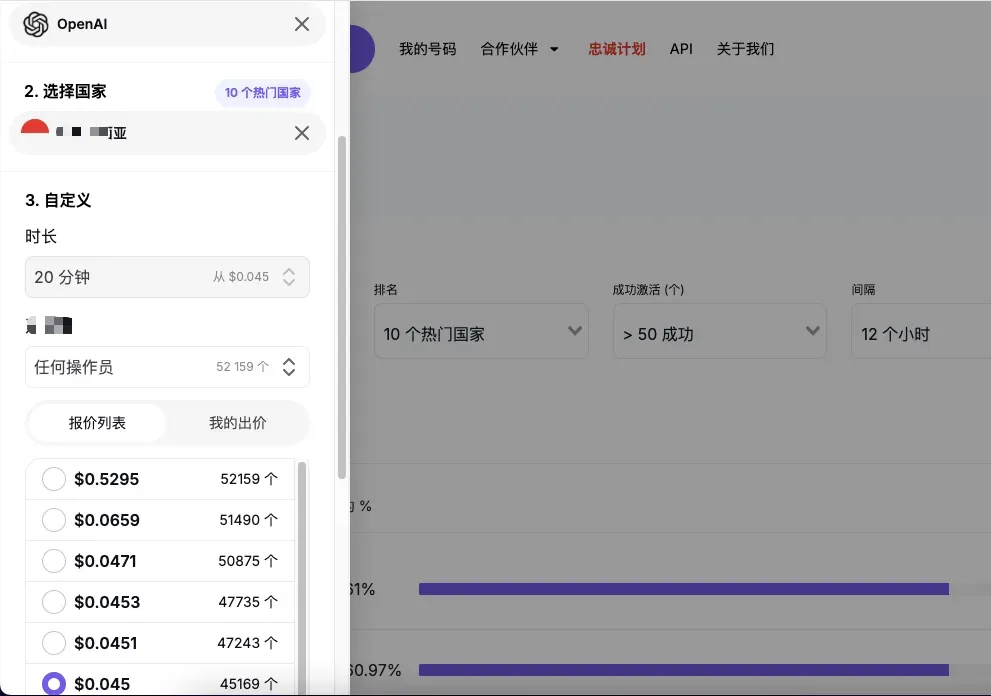

注册平台的过程本身很简单,关键在充值和选号。该平台最低需预充2美元,随后按服务类型选择GPT或OpenAI相关选项,并挑选国家。

第一个坑是价格。页面以美元计价,数值看着不大,可换算成人民币后差距明显。我先尝试新加坡的号码,一个验证码大约要5元人民币。并不是花不起这5块钱,而是这本质只是一次性验证尝试,并非长期服务,也无法保证百分百成功。既然是试错,就要把单次成本压到最低。于是我继续搜寻。

随后我又试了越南和香港的号码,都没能收到验证码。好在平台有个关键设计:收不到时可撤销号码,费用会退回账户。这一机制大幅降低了试错成本。最终我选择了泰国,并非事先笃定它能成功,而是平台的热门国家排行里泰国名列其中,且价格低廉。当时泰国号码仅需约0.1美元,折合人民币七八毛钱——这个试错成本完全可以接受。

选好号码后,回到Codex登录页填入,等待片刻,验证码便收到了。输入后登录成功,这个卡点终于解决。

只盯着结果看,这事似乎微不足道——七八毛钱,一个虚拟号码,一条验证码,登录成功。但它值得被记录下来,是因为它恰好暴露了AI工具落地过程中非常普遍的一类障碍。

不少人以为自己是不会用AI,其实不然。他们很可能是卡在账号、支付、地区、网络、验证码,或者某个英文页面里一个语焉不详的选项上。这些环节看似不高级,却直接决定了工具能否进入你的工作流。

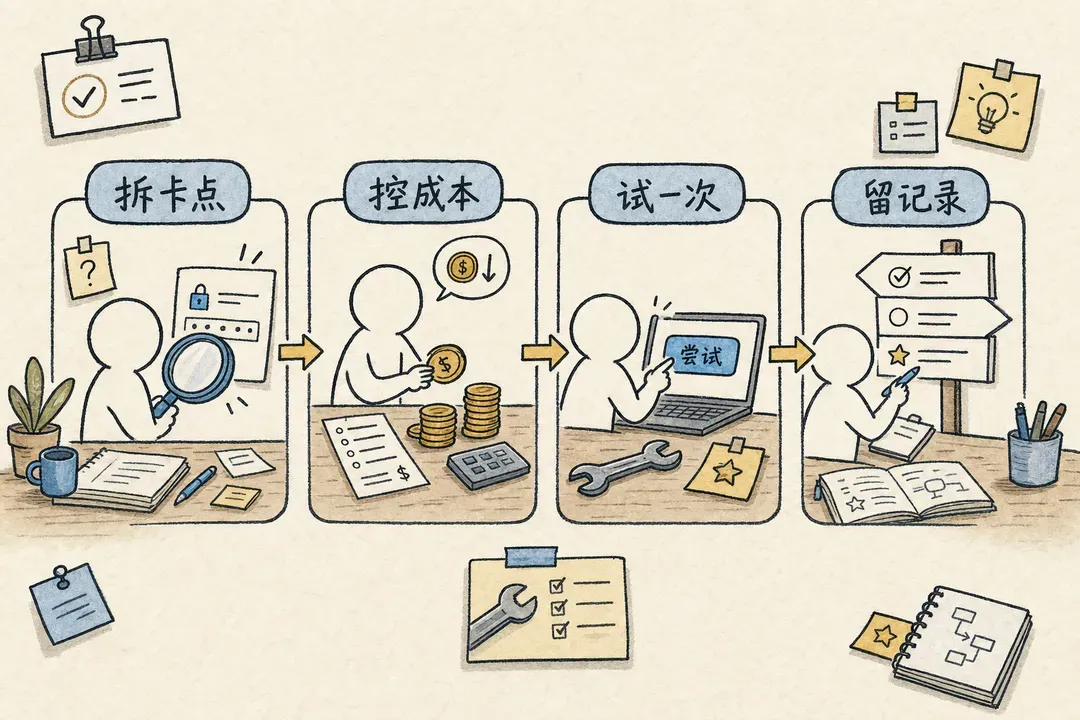

只要这些卡点没被解决,再强大的工具也只能停留在“听说很好用”的层面。这次我的处理思路很简单:碰到这类问题,千万别一上来就追问“有没有完美方案”。先拆解问题:卡点究竟出在哪一步?是无法登录,收不到验证码,还是账号本身存在限制?

接下来思考:有没有低成本的试错路径?不同国家的号码价格差异如何?能否撤销号码、费用是否会退回?还有,这个方案是否只适合临时排障?如果你无法收回该号码的使用权,就别把它当作核心账号的长期安全依赖。最后,一定要把排障过程和结果记录下来。

许多问题之所以反复折磨人,并非因为它真的复杂,而是因为每个人都只在自己的终端上解决了一次,没有留下过程。这篇文章本质上只是一条小记录:我试过新加坡,太贵;试过越南和香港,收不到码;好在可以撤销退款;最后泰国成功,花费仅七八毛。下次再有人卡在相似环节,至少不必从一团迷雾里重新摸索。

当然,不能把这种方法神化。接码平台的可用性、价格和国家线路随时可能变动,今天能收到验证码,不意味着明天依然好使。这也不等同于官方推荐,更无法保障长期安全。优先使用官方途径;如果自己拥有长期可控的号码,就尽量不要依赖一次性号码。只有当你明确这纯粹是一次临时验证、一次应急排障时,才适合动用这种低成本尝试。

一个验证码看似微不足道,可一旦卡住,整条工作流就会停滞。这次最值得留下的,并不是那串数字,而是解决此类问题的顺序:先拆解卡点,再控制成本,接着大胆试错,最后把路标留在原地。

Codex突发电话验证登录异常:基于官方issue的故障诊断与应对方案

核心结论:根据近期公开信息,确有一定数量的 Codex 用户在登录过程中被重定向至“添加手机号 / 验证手机号”页面。 但更准确的描述并非“OpenAI 已正式宣布 Codex 全面采用电话验证”,真实情况是:OpenAI 官方仓库 openai/codex 中,近期集中出现了多条与手机号验证相关的登录异常与验证码问题,影响范围已从个别用户的单点报错演进为一波较为集中的认证故障。

此事之所以值得重视,并非仅仅因为“多了一步验证操作”,而是它已切实干扰到开发者能否顺利完成登录、能否正常收到短信验证码,甚至在部分情形下影响到依赖 ChatGPT 登录会话的持续使用。

若您近期同样遇到了 Codex 突然要求补充手机号码、验证码无法接收,或在切换设备后登录过程与以往不同的状况,本文旨在帮助您厘清以下四个核心问题:

- 当前究竟发生了哪些情况?

- 截至目前可以确认的情报有哪些?

- 哪些结论尚不宜过早下定?

- 身为开发者,现阶段最稳妥的应对方法是什么?

近期事件回顾

根据 OpenAI 官方 openai/codex 仓库最近公开的多个议题,近几日暴露的问题主要可归纳为三类,均与“电话验证”直接相关。

情况一:Codex 登录时被要求添加手机号

4 月 29 日,一条直言不讳的 issue——“Codex need phone number”——出现在官方仓库中。提交者描述的情况十分清晰:

- 此前一直在使用 Codex

- 换用另一台设备重新登录

- 通过 Google/Apple SSO 登录后

- Codex 突然要求提供手机号码

- 而该账号原本并未绑定任何手机号

该 issue 并非一般的抱怨,官方仓库为其添加了以下标签:

bugauth

截至本文编撰时,这条 issue 已累计 24 条评论和 19 个 👍 反应,显示不少用户遭遇了类似情形,已非孤立事件。

情况二:进入验证流程后根本收不到验证码

4 月 30 日,仓库中又出现了一个更具体的问题:

“ChatGPT asking phone number verify but didn’t send any code yet”

Codex远程服务器频繁重连?终极排查与清理app-server进程指南

最近在使用 VS Code 远程开发时,Codex 扩展表现出明显的不稳定性。典型症状包括:对话过程中突然弹出“reconnected”提示、刚一打开就长时间转圈加载、Codex 面板完全卡死连退出登录都点不动,而通过浏览器直接访问 ChatGPT 官网却一切正常,服务器代理层面也未发现明显问题。

起初很容易归咎于账号、API 密钥、模型或某个配置项出错,但逐一排查后才发现,这次故障的根源并非 Claude 配置缺陷,也不是简单的“能不能打开 ChatGPT 官网”。

先说结论:问题主要出在 Codex VS Code 扩展自身的后台进程与长连接机制。Codex 在 VS Code Remote 环境中并不是直接依赖浏览器工作,它会在远程服务器上启动一个后台进程:

codex app-server

整体通信链路大致如下:

VS Code Codex Panel → Codex App Server → ChatGPT/Codex Backend

因此,浏览器能顺利打开 ChatGPT 官网只能说明浏览器那条链路畅通,并不能代表 VS Code 扩展内部的 Codex 长连接也同样稳定。

在实际排查中,我观察到了两类关键异常。

第一类是 Codex 与后端的通信长连接被直接断开,日志中会出现类似:

stream disconnected before completion https://chatgpt.com/backend-api/codex/responses

这说明 Codex 与 OpenAI 后端之间的 WebSocket 或长连接被异常中断。

第二类是本地扩展进程反复报错:

worker_rpc_response_error method=stable-metadata workerId=git

这个错误并非来自 OpenAI 后端,而是 Codex 扩展在尝试读取当前工作区的 Git 元数据时持续失败(比如检测是否为 Git 仓库、分支、commit 信息、文件变更等)。这类问题通常不会直接切断模型回复,但会不断消耗扩展宿主资源,导致面板卡顿、持续转圈、CPU 占用升高等现象。

OpenAI Codex新手完全指南:2026最新版安装、配置与实战教程

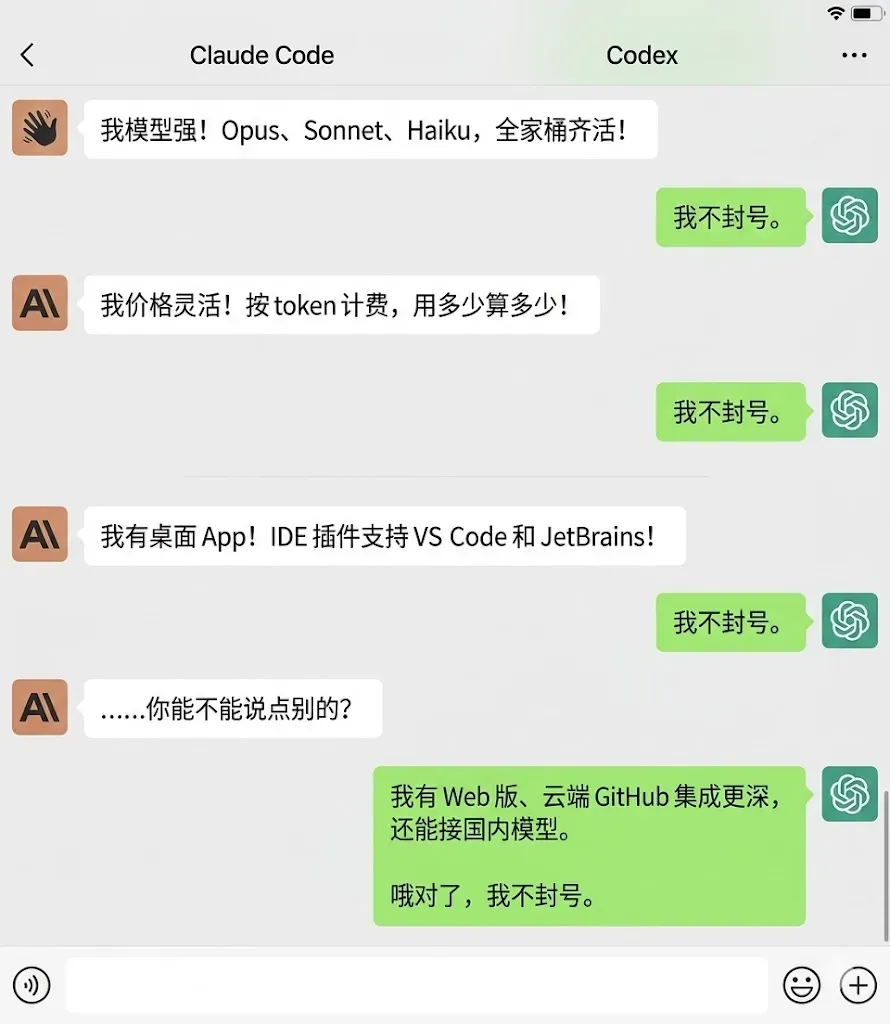

当前AI编程工具领域呈现百花齐放态势,Cursor、Trae、Claude Code、Codex等国内外产品竞相角逐。继前期发布的Claude Code入门指南获得积极反馈后,应读者广泛需求,本文将系统解析OpenAI官方出品的Codex编程助手,深入探讨其核心竞争力、部署方案、上手路径及避坑技巧。

Codex脱颖而出的核心优势

Claude Code虽功能强大,但存在两大显著短板:免费额度限制严格且定价高昂,同时Anthropic官方账号管控政策导致封号风险持续高企。针对此类痛点,开发者社群频繁咨询OpenAI是否有对标方案。答案明确肯定——Codex不仅具备同等编码能力,更在系统稳定性与GitHub集成方面表现优异,成为值得信赖的替代选择。

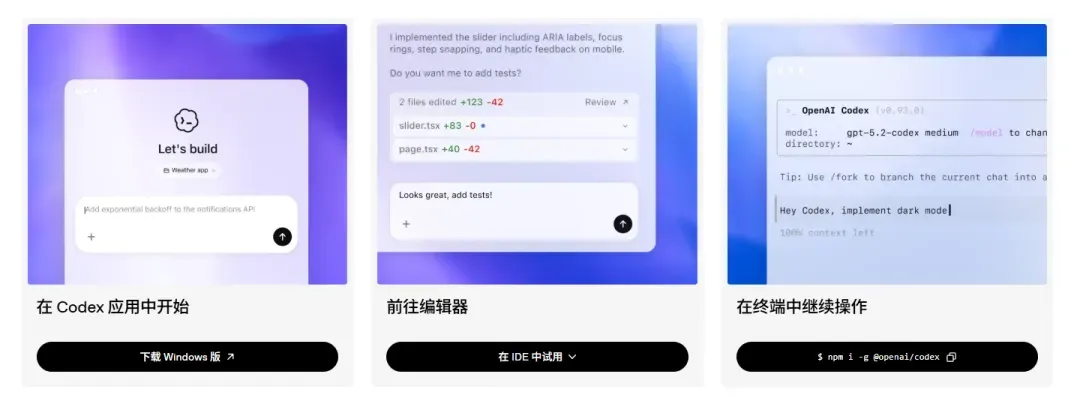

Codex全景解读:不只是代码生成器

Codex是OpenAI官方推出的智能编码解决方案,具备需求理解、代码生成、命令执行与缺陷调试等核心能力。其设计架构支持四种运行模式,全面覆盖差异化使用场景:

- CLI命令行模式:在终端环境中运行,满足纯键盘操作偏好,实现黑框式全局控制

- App桌面应用:提供图形化界面,兼容macOS与Windows系统,规避终端交互复杂性

- Web网页版本:浏览器直接访问,免安装部署,适配临时设备或应急代码调整需求

- IDE插件形态:深度整合VS Code、Cursor及Windsurf,实现编辑器内无缝调用,自动携带代码上下文

四种模式无绝对优劣,建议根据个人操作习惯与具体场景灵活选用。终端爱好者优选CLI,可视化需求选择App,轻量场景使用Web,日常开发则推荐IDE插件。

2026年Codex重大更新解读

将Codex简单定义为"OpenAI版Claude Code"已无法涵盖其完整价值。自2026年起,Codex完成从对话式编码助手向"AI工作流系统"的战略转型。

根据官方更新日志,2026年4月核心迭代包含三项关键升级:

Codex App 26.415(2026-04-16发布):桌面端升级为全功能AI工作台,新增内置浏览器、任务侧边栏、GitHub PR处理、制品查看器、记忆系统、多终端支持、多窗口管理及Windows托盘适配等特性

GPT-5.5模型集成(2026-04-23上线):GPT-5.5正式接入Codex,显著增强复杂实现、代码重构、深度调试、测试验证等重型任务处理能力,使其从脚本生成工具升级为可承接生产级项目的工程平台

Codex CLI 0.128.0(2026-04-30发布):命令行引入持久化

/goal工作流,支持长期目标的创建、暂停、恢复与清理;同步新增codex update指令,并在权限控制、沙箱隔离与插件扩展方面实现精细化提升

上述演进揭示了一个本质转变:评估Codex的标准不应仅停留在"能否编写代码",而应聚焦于"能否承接工作流中重复性、复杂性、跨文件、需验证的工程任务"。本教程聚焦入门实践,高级功能将在后续专题中深度展开。

Codex最佳应用场景分析

以下五类开发者最适合立即投入Codex生态:

- 已订阅ChatGPT Plus/Pro用户:建议优先体验Codex,每月20美元以上的订阅价值将得到充分释放,超越常规文本生成场景

- 偏好图形化界面:厌恶终端交互,期望通过鼠标点击完成核心操作

- 重视账号稳定性:需要官方工具构建可靠备用工作流,规避封号风险

- 寻求低成本试错:Codex包含在现有订阅内,以官方客户端显示为准,建议先验证可用性再决策

- 认可GPT模型代码能力:对GPT系列在代码编写、解释与修改方面的表现持有信心

未订阅ChatGPT服务的用户同样可通过配置国内大模型API实现低成本接入,后续章节将提供完整方案。

Codex安装全攻略:四种方式任选

Codex部署流程简洁高效,主流配置环境均可顺利完成。以下分模式详解操作步骤:

环境准备

系统需预装Node.js与git,在终端执行以下命令验证:

node --version

npm --version

git --version

若环境缺失,请先行安装。此环节为前置依赖,任何遗漏均可能导致后续报错。

Node.js获取地址:https://nodejs.org/zh-cn/download Git获取地址:https://git-scm.com/install/windows

特别提示:Windows用户如遭遇环境配置障碍,建议优先选用App模式。CLI模式虽可用,但如遇疑难可考虑WSL方案或直接切换至App。

CLI模式安装

命令行模式面向终端重度用户,提供两种安装途径:

# npm全局安装

npm install -g @openai/codex

# Homebrew安装(限macOS)

brew install --cask codex

安装验证命令:

codex --version

返回版本号即表示成功。若执行失败,请优先核查Node.js、npm全局路径配置及网络连通性。

App模式安装

Windows用户可通过微软商店获取: https://get.microsoft.com/installer/download/9PLM9XGG6VKS?cid=website_cta_psi

VSCode远程SSH下Codex插件403错误终极解决:代理、回调与IPC权限三重排查

先前我一直使用Cursor进行“氛围编程”(vibe coding),却频频被token快速消耗的问题困扰。恰好我订有ChatGPT Plus,于是决定转投Codex体系。

然而,受众所周知的环境限制,即使开启了网络代理,当我在VSCode中通过Remote-SSH连接远程服务器后,依然遇到了登录异常,见下图:

本以为这只是个小网络故障,结果从下午排查到深夜。最终定位到三个层面的问题交织在一起:代理出口、OAuth回调以及插件IPC权限。过程踩了不少坑,整理出来希望能帮到有同样遭遇的朋友。

首先,我在远程服务器上确认当前代理链路走向:

echo $http_proxy $https_proxy $all_proxy

curl -x http://127.0.0.1:7890 https://api.ipify.org; echo

curl -x http://127.0.0.1:12789 https://api.ipify.org; echo

发现本机7890端口已被占用。我便将远程入口端口改为12789,并让它转发至本机实际代理端口(本机为7897)。

本机SSH config最终配置如下:

Host <你的服务器名称>

HostName <你的服务器IP>

User <你的用户名>

RemoteForward 12789 127.0.0.1:7897

LocalForward 1455 127.0.0.1:1455

两条转发缺一不可。RemoteForward负责让远程服务器借助本机代理出网,LocalForward则用于浏览器OAuth回调回流至远程服务器的1455端口。

之后回到远程,将Shell环境中的代理统一指向12789(即SSH反向转发入口):

export http_proxy=http://127.0.0.1:12789

export https_proxy=http://127.0.0.1:12789

export all_proxy=socks5h://127.0.0.1:12789

export NO_PROXY=localhost,127.0.0.1,::1

export no_proxy=$NO_PROXY

验证出网是否成功:

curl --max-time 10 -x http://127.0.0.1:12789 https://api.ipify.org; echo

此时返回了一个新的出口IP,表明远程已确实走通了本机代理链路。

接着,我在远程的Cursor设置里配置HTTP代理:

{

"http.proxy": "http://127.0.0.1:12789",

"http.proxySupport": "on",

"http.noProxy": ["localhost", "127.0.0.1", "::1"]

}

至此,网络连接和OAuth回调环节基本没问题,已经能够通过Codex CLI成功登录。然而,Codex插件却在这时卡死不动。

这一步最为坑人,起初我一度以为是网络问题再次发作。后来仔细查看日志,才发现是IPC权限错误。排查使用了下面几条命令:

grep -R "codex-ipc\|EACCES" ~/.cursor-server/data/logs -n

ls -la /tmp/codex-ipcid

结果发现机器上/tmp/codex-ipc的属主是另一个用户,权限为drwxrwxr-x,我并无写入权限,因此插件无法在其中创建ipc-1007.sock。解决办法并非重装插件,而是给自己设立一个私有的TMPDIR,让IPC不再落入共享的/tmp/codex-ipc中。