Qwen3-0.6b Docker浏览器部署全攻略:本地运行大语言模型完整指南

Qwen-Web 是一款设计用于在本地浏览器环境中直接运行 Qwen3-0.6b 大型语言模型的开源项目,其核心优势在于实现零安装流程、不进行任何日志记录,并且完全保障用户数据的本地私密性。

您可以通过在线演示地址提前体验该项目的基本功能与交互界面。

在线演示地址

部署与安装步骤

本项目推荐使用 Docker Compose 进行快速部署,以下为完整的服务配置代码块。

services:

qwen-web:

image: heizicao/qwen-web:latest

container_name: qwen-web

ports:

- 8443:443

restart: always

操作使用指南

完成容器部署后,在浏览器地址栏中输入 https://您的NAS_IP地址:8443 即可访问应用主界面,请务必注意该服务强制使用 HTTPS 安全协议进行连接。

温馨提示:若浏览器提示“您的连接不是私密连接”,属于自签名证书的正常现象,请手动选择“继续前往”或类似选项即可正常访问。

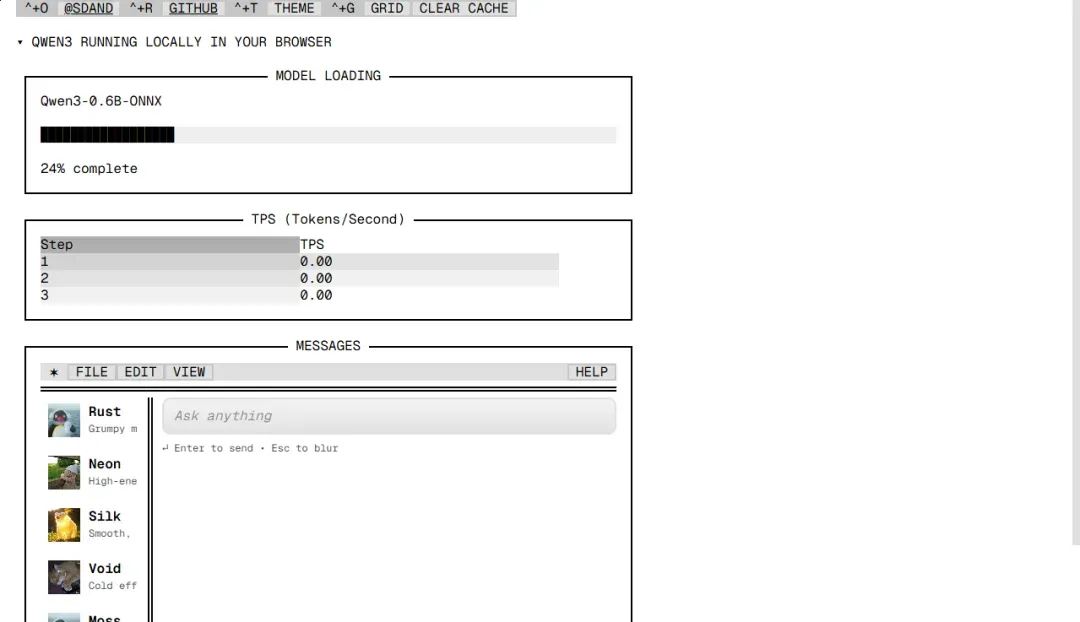

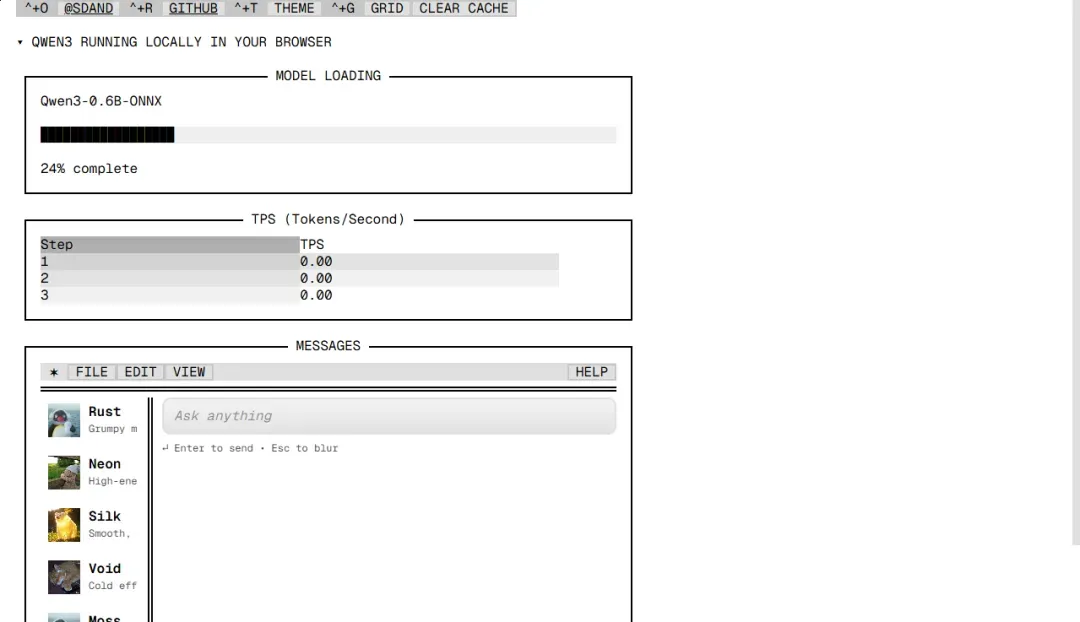

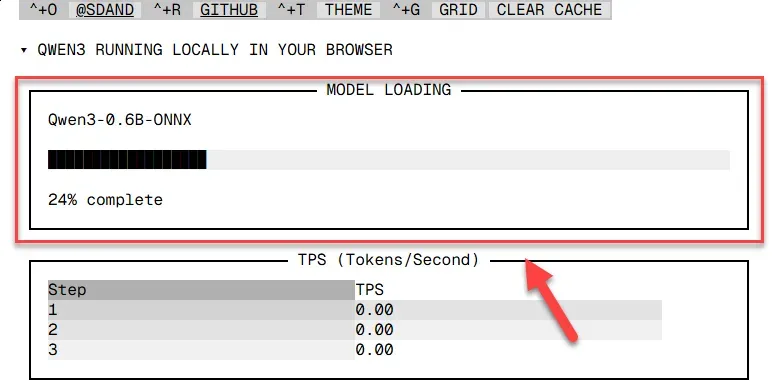

每次通过网页首次访问时,系统都需要从本地加载 Qwen3-0.6b 的模型文件到内存中,此过程可能需要短暂等待。

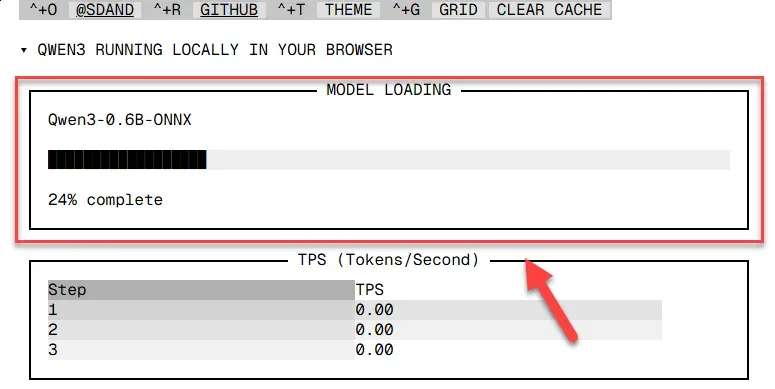

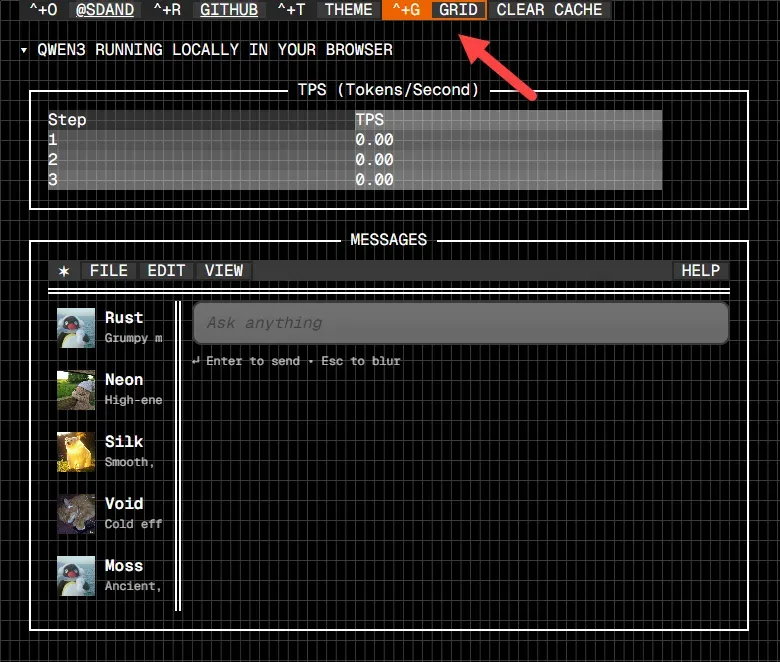

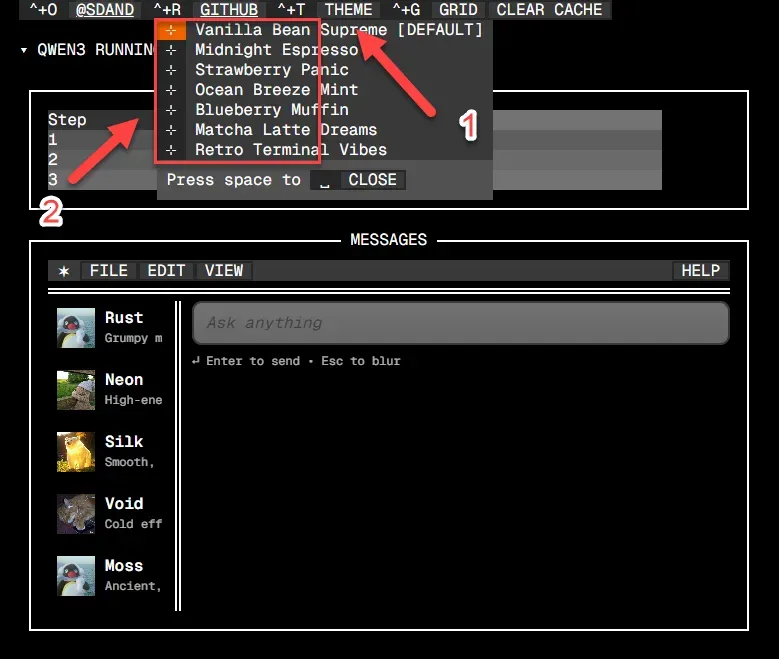

界面顶部的导航栏提供了颜色主题切换功能,用户可以根据个人偏好选择浅色或深色显示模式。

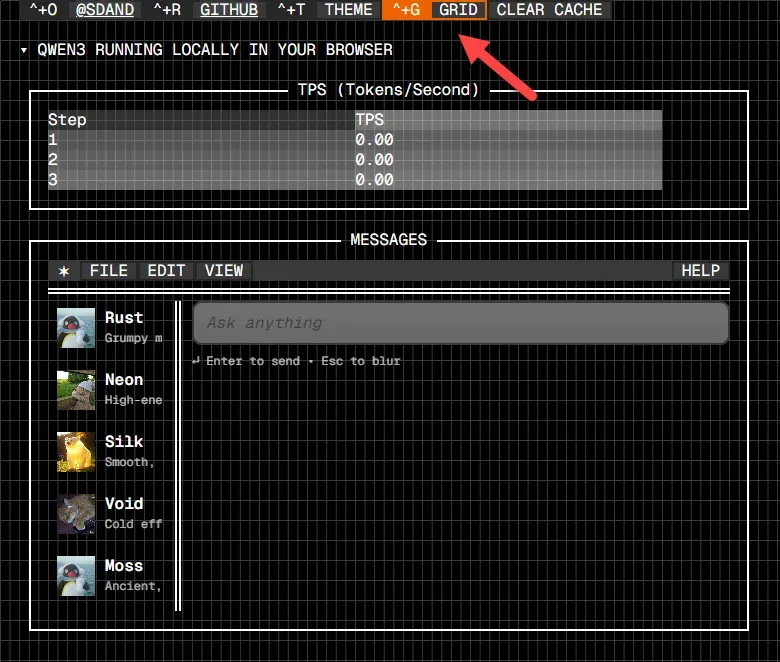

应用背景支持添加网格化视觉效果,这一设计元素能够增强界面的科技感与层次感。

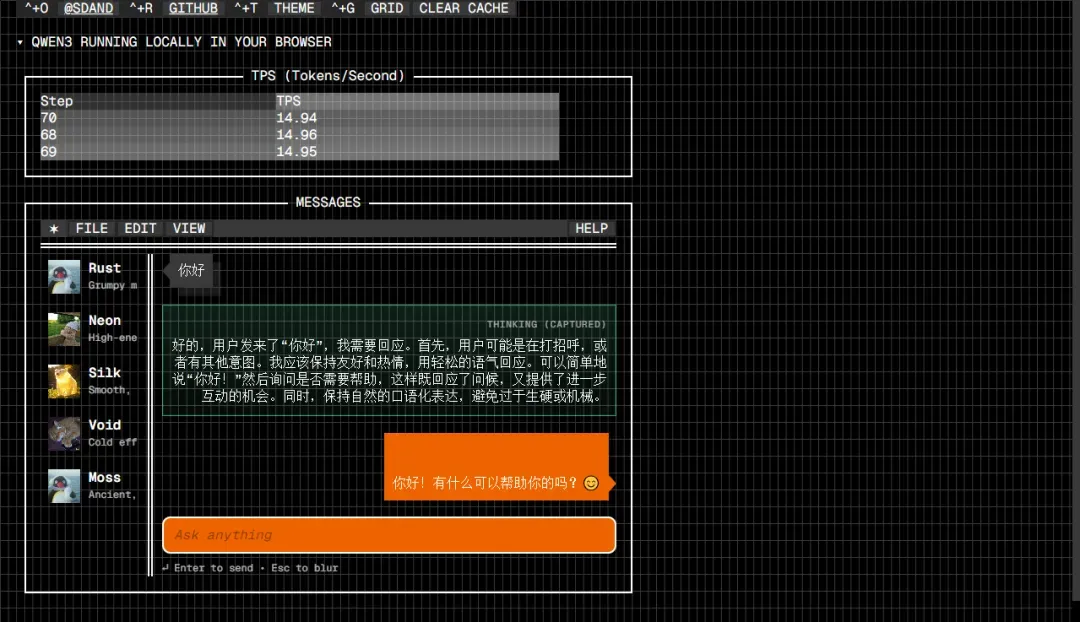

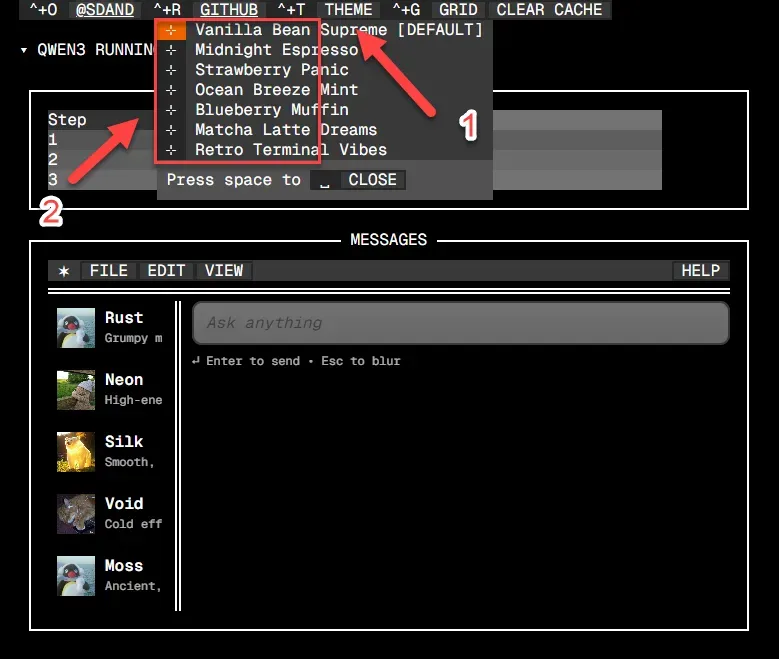

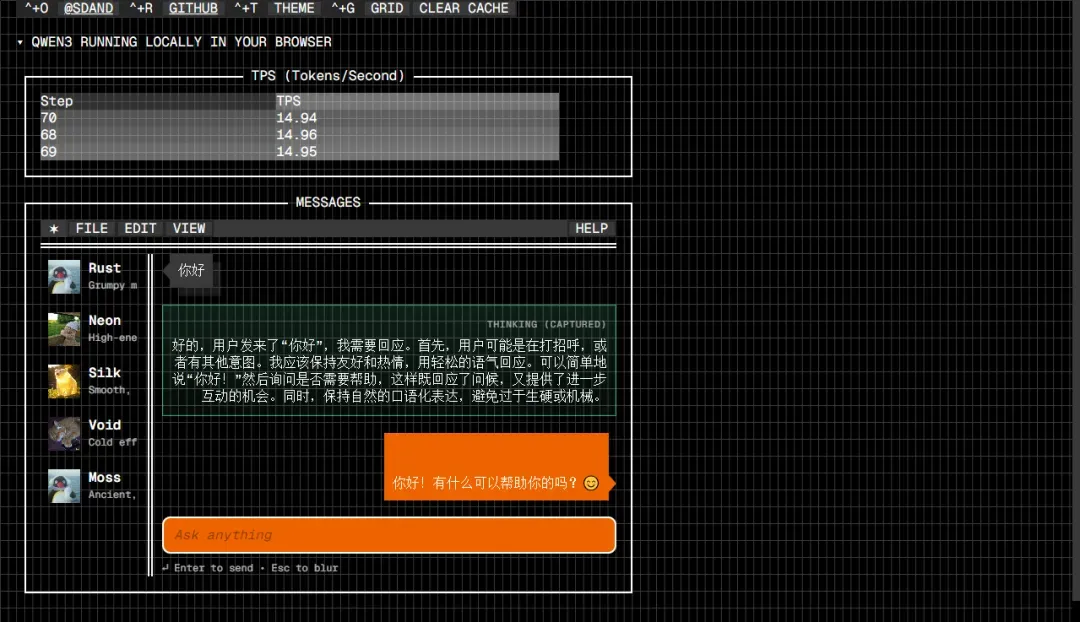

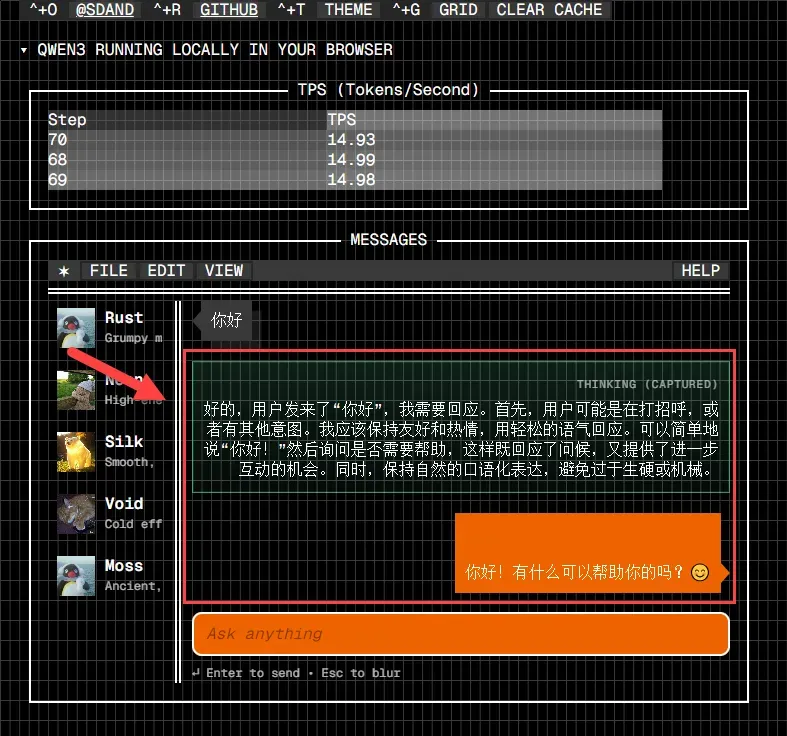

在输入框键入问题并按下回车键后,模型将开始生成思考过程并输出回答内容。

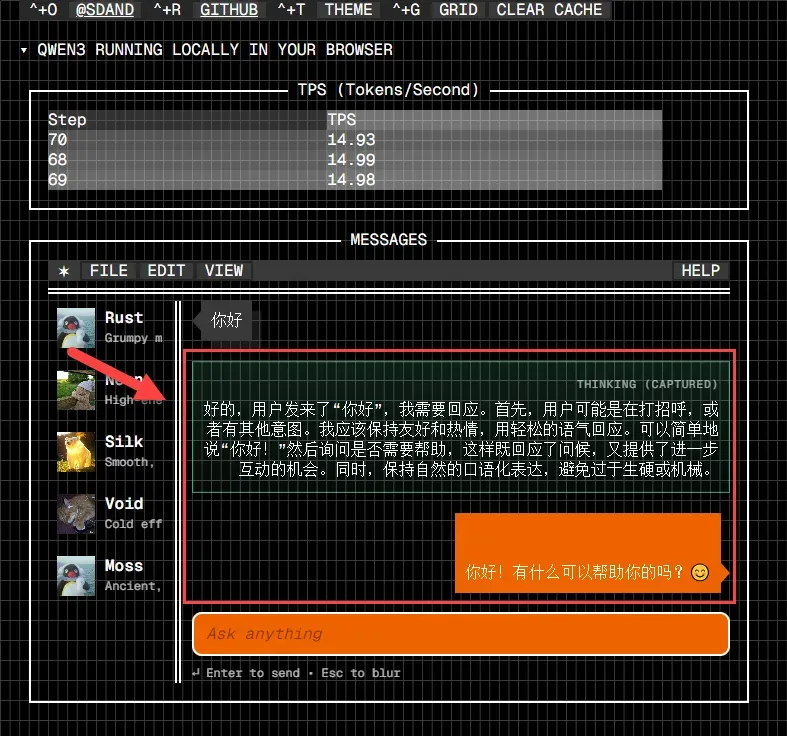

界面会实时显示模型的回复速度,例如示例中的 14.93 TPS(每秒生成标记数)。由于答案生成过程伴有完整的“思考链”展示,实际交互体验中的响应速度感知尚在可接受范围内。

左侧边栏预设了多个对话角色模板,用户可以直接选择特定角色以开启具有不同风格和背景的聊天会话。

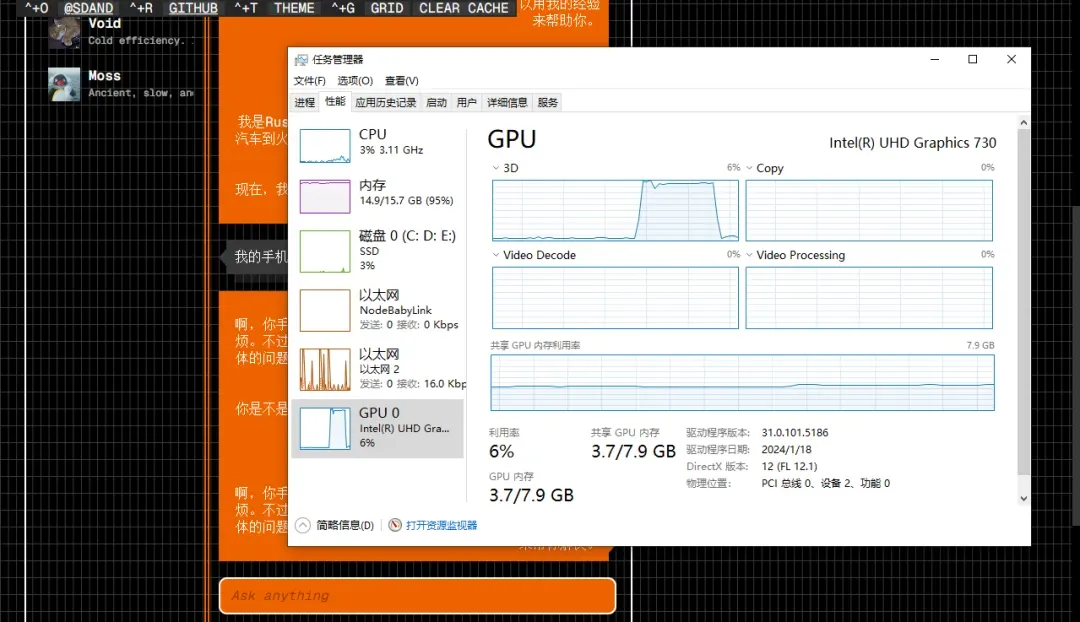

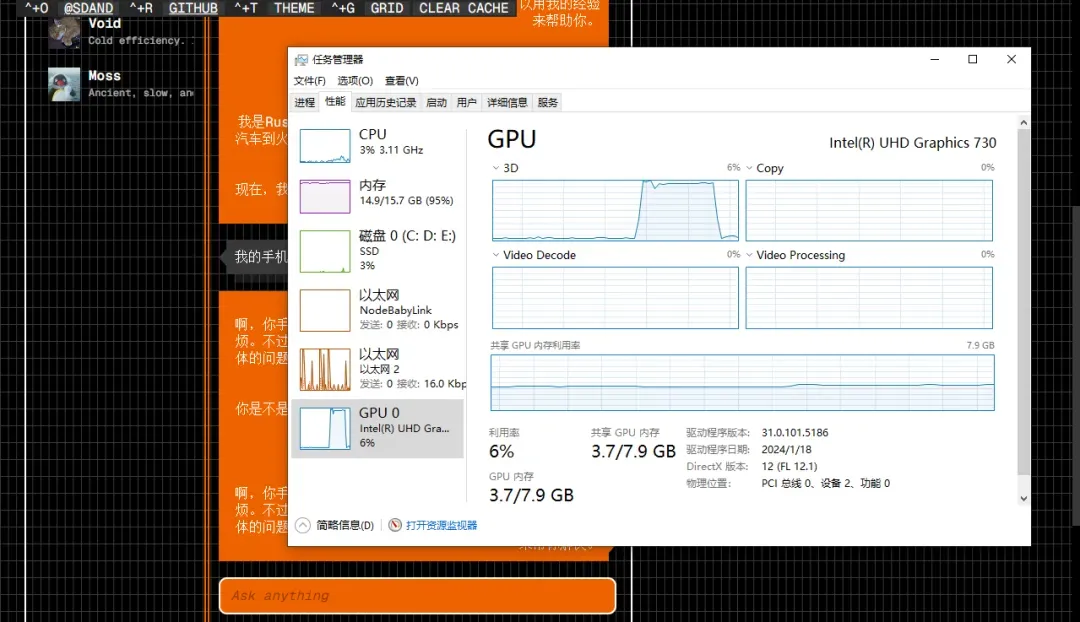

整个网页聊天过程中的模型推理计算,均通过 WebGPU 技术调用您设备本地的 GPU 硬件资源来完成,无需依赖远程服务器。

项目总结与综合评估

该项目在概念和实践层面都颇具新意,成功实现了在标准浏览器环境中本地化运行 Qwen3 系列大型语言模型。其技术核心在于利用现代 WebGPU 接口,使得网页应用能够直接调度终端设备的 GPU 进行高性能计算与图形渲染。不过,当前版本仍存在一些可优化的空间,例如对个人电脑界面的适配尚不完善,且模型在运行过程中偶现响应停滞或意外输出英文回复的缺陷。尽管如此,从技术探索和娱乐体验的角度出发,它依然是一个富有乐趣的工具,既能满足运行前沿语言模型的好奇心,也可作为测试本地 GPU 计算性能的一个轻量级基准场景。

综合推荐指数:⭐⭐⭐(创意新颖,值得尝试)

实际使用体验:⭐⭐(界面相对简单,偶发性问题影响流畅度)

部署流程难度:⭐(配置极其简单,近乎一键完成)

TrWebOCR免费中文离线OCR工具:高效识别与简易部署全攻略

TrWebOCR 是一款开源且易于使用的中文离线OCR项目,其识别准确率能够与大型商业解决方案相媲美。该项目提供了直观的Web操作页面以及灵活的API接口,方便用户进行文字提取和集成。

部署与安装指南

以下是使用 Docker Compose 快速部署 TrWebOCR 的配置文件示例,只需简单几步即可完成环境搭建。

services:

trwebocr:

image: mmmz/trwebocr:latest

container_name: trwebocr

ports:

- 8089:8089

restart: always

操作步骤与使用演示

完成部署后,在浏览器地址栏中输入 http://NAS的IP:8089 即可访问 TrWebOCR 的Web操作界面。

在Web界面中上传或选择需要识别的图片文件,随后点击识别按钮即可启动OCR处理流程。

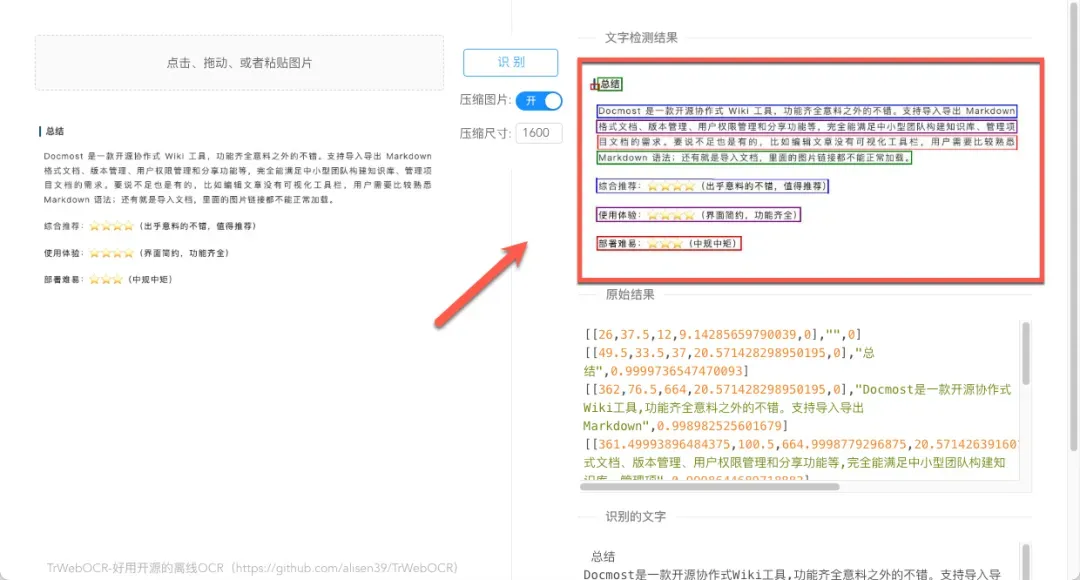

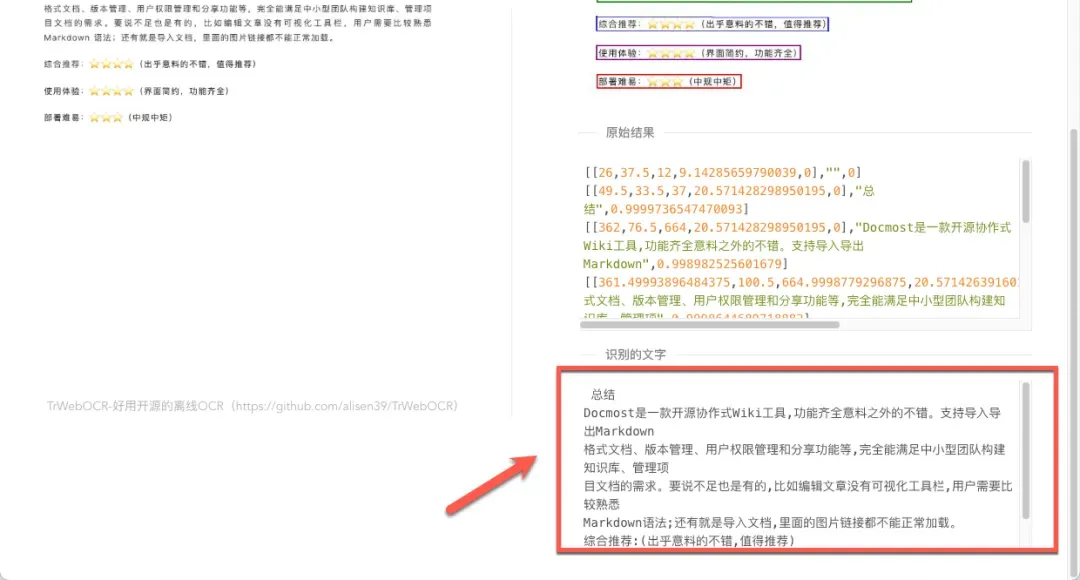

识别过程通常非常迅速,例如本次演示在不到两秒的时间内就完成了处理,界面上会清晰地用选框标出识别出的文字区域。

在大多数情况下,文字识别结果都相当准确(需要注意的是,当字体间距过于紧密或使用特殊字体时,识别精度可能会受到一定影响)。

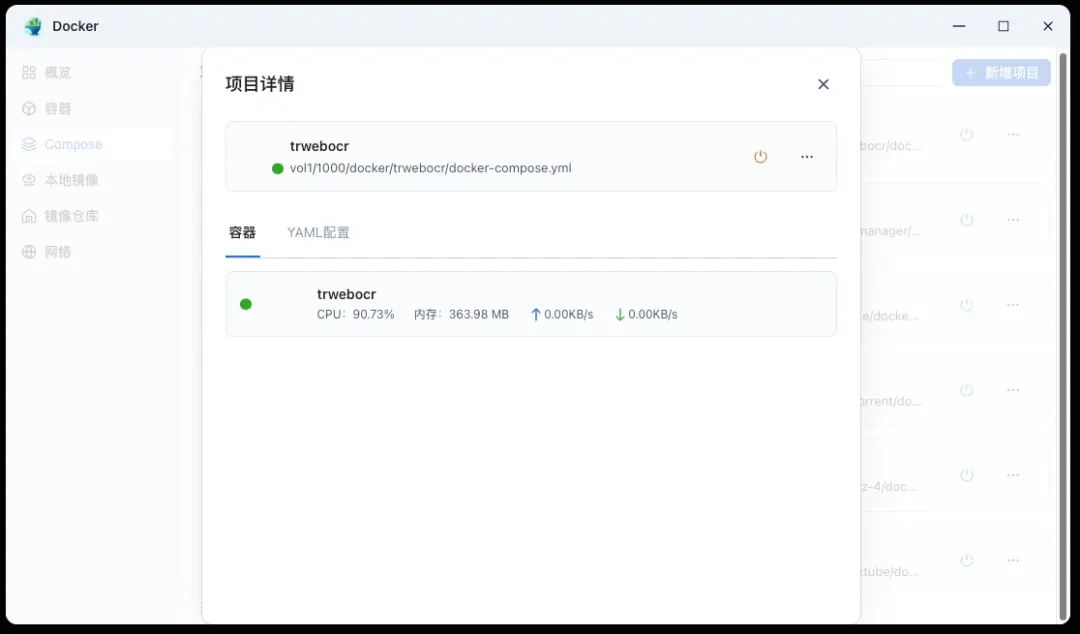

在进行OCR识别任务时,该工具会占用较高的CPU计算资源,相比之下其对内存的消耗则保持在较低水平。

综合评价与总结

TrWebOCR 作为一款轻量级、开源且支持完全离线运行的中文OCR工具,其部署过程极为简便。该工具识别速度出色,在图片质量清晰且字体常规的条件下,能够保持较高的识别准确率。尽管其用户操作界面设计较为简洁,但功能完备且实用,同时提供了API接口供程序化调用。对于具有本地OCR需求,希望处理日常文档、屏幕截图等文字提取任务的用户,都可以尝试部署并使用这款工具。

综合推荐指数:⭐⭐⭐(即开即用,提供API接口)

实际使用体验:⭐⭐⭐(识别速度快,操作直观)

部署难度评级:⭐(非常简单)

从零开始搭建传奇三私服:Zircon Mir3 Server 完整部署图文教程

Zircon Mir3 Server 是一个基于皓石传奇三的开源服务器端项目。该项目起源于吉米在2019年发布的Zircon版本,经过后续发展,致力于提供一个能够跨平台运行并支持Docker容器化部署的传奇三游戏服务器环境。需要特别强调的是,该项目仅供技术研究与学习使用,任何商业用途或非法行为均被严格禁止。

该项目实现了相当完整的游戏内容体系:

- 游戏中包含了战士、法师、道士以及刺客四大经典职业。

- 每个职业平均设计了多达38个不同的技能供玩家学习与使用。

- 拥有丰富多样的地图场景和道具系统,支持玩家角色等级提升至100级。

- 技能系统支持修炼至第6级,装备系统则包含了精炼等深度玩法。

- 法师与道士职业所召唤的宠物,具备成长系统,最高可升级至暗金等级。

在部署支持方面,该服务器端展现出良好的灵活性:

- 支持在Linux、Windows以及Docker容器等多种平台环境中进行部署。

- 项目提供了便于使用的Docker Compose配置文件示例,简化了容器化部署流程。

此外,服务器还集成了一些便捷的游戏内功能:

- 游戏内的传送石道具,允许玩家方便地传送到任意已开放的地图。

- 支持游戏客户端进行自动更新(此功能需要v1.0.0及以上版本的客户端配合)。

准备工作提示:为了便于用户快速部署,相关的资源文件已打包整理。你也可以按照后续的详细步骤自行操作,或通过加入开发者社群获取必要的文件。

第一步:获取与准备资源文件

首先,访问该开源项目的代码仓库地址:https://gitee.com/raphaelcheung/zircon-legend-server

在项目页面向下浏览,可以找到通过百度网盘下载资源的链接(同样,也可以通过加入社群获取这些文件)。

请将列出的三个文件全部下载下来,后续的每个步骤都需要用到它们。

接下来,解压名为“服务器运行”的压缩包文件。请注意,由于文件编码或格式问题,建议在Windows系统上进行解压操作,在NAS或Mac系统上解压时即使输入正确密码也可能报错。解压密码为:“QQ群 915941142”。

在你的NAS设备或服务器上,创建一个名为zircon的文件夹,将上一步解压得到的所有文件放入此文件夹内。

第二步:部署游戏服务端

使用Docker Compose是部署服务端最便捷的方式。你可以创建一个docker-compose.yml文件,并写入以下配置内容:

services:

zircon:

image: raphzhang/zirconlegend:latest

container_name: zircon

ports:

- 7000:7000

volumes:

- ./datas:/zircon/datas

- /etc/localtime:/etc/localtime:ro

- /etc/timezone:/etc/timezone:ro

restart: unless-stopped

关键参数说明(更多高级配置建议参考项目官方文档):

/zircon/datas:此卷映射路径用于持久化存放服务器的各类配置和游戏数据。/etc/localtime与/etc/timezone:这两个可选卷映射用于同步容器与宿主机的时区设置,确保游戏内时间显示准确。

启动容器后,通过查看容器日志来验证服务是否运行正常。当在日志中看到服务器成功启动并监听端口的消息时,即表示服务端部署成功。

第三步:配置与运行游戏客户端

首先,解压之前下载的“客户端运行文件”压缩包,其中包含了游戏运行所必需的海量地图、角色模型、音效等资源文件。

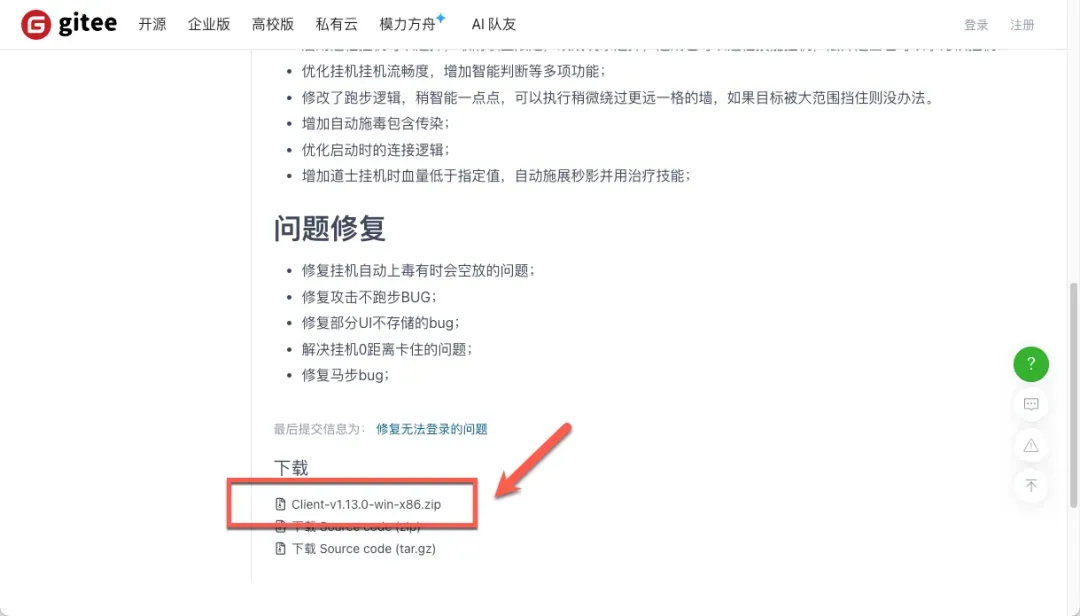

仅靠资源文件还无法启动游戏,你还需要下载客户端的主程序。请访问客户端项目地址:https://gitee.com/raphaelcheung/zircon-legend-client

在项目页面右侧,找到并点击“发行版”或“Releases”标签页,跳转到版本发布页面。

在发布页面中,找到最新的客户端主程序压缩包并点击下载。

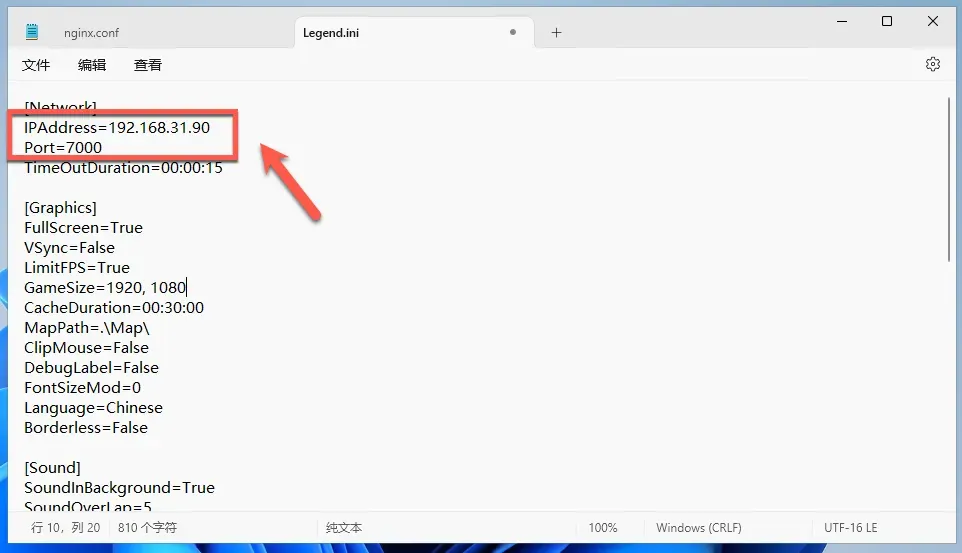

将下载的客户端主程序解压,你应该能看到类似Legend.exe等文件。使用文本编辑器打开其中的Legend.ini配置文件。

在配置文件中,找到服务器地址(IP)和端口号(Port)的设置项,将其修改为你实际部署的服务端的IP地址和端口(默认为7000),其余配置可暂时保持默认。

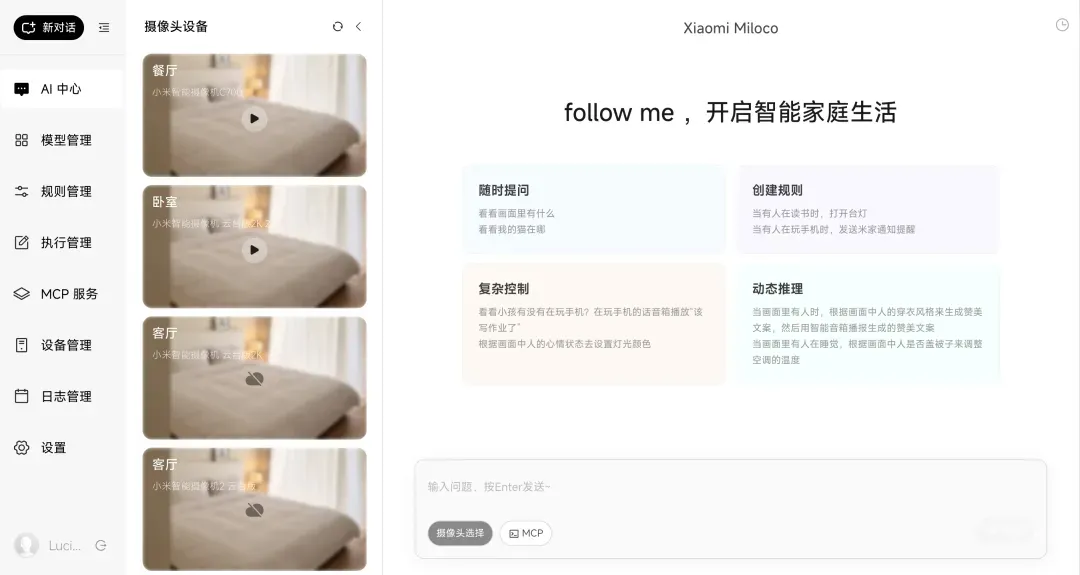

小米开源AI全屋控制方案Xiaomi Miloco:本地部署与智能家居未来探索

Xiaomi Miloco是小米公司推出的智能家居前沿探索方案。它以米家智能摄像机作为核心的视觉信息输入源,并依托小米自研的大语言模型,实现了对全屋IoT设备的深度整合与智能控制。这一方案采用基于大模型的开发范式,允许用户直接使用自然语言来定义复杂的家庭场景需求与自动化规则,从而解锁了更广泛、更具创新性的智能设备联动可能性。

方案核心特性解析

- 自然语言交互新范式:基于大模型技术框架,用户可通过简单的对话完成复杂的规则设置与设备指令控制,大幅降低了智能家居的配置门槛。

- 视觉数据的智能化应用:将摄像头的实时视频流作为环境感知信息源,利用大模型解析其中包含的家庭场景事件(如人员活动、物体状态变化),并据此响应用户的查询与指令。

- 端侧计算保障隐私:通过将任务拆分为场景规划与视觉理解两个阶段,并部署小米自研的端侧模型,实现了端侧视频理解,所有数据处理在本地完成,有效保护了家庭隐私安全。

- 深度融入米家生态:无缝对接米家生态体系,支持获取与控制米家设备、执行米家自动化场景,并能发送自定义内容到米家通知。

重要提示: 初次接触时,请不要被其部分硬件要求吓退。之所以列出独立显卡,是针对希望在本地完全运行AI模型的“完全体”部署方案。实际上,方案也支持直接调用云端模型的API,对本地硬件要求会低很多。

环境配置要求指南

硬件基础配置:

CPU: x64 架构

显卡: NVIDIA 30系及以上显卡,显存 8GB 及以上(最低要求),建议 12GB 及以上

存储: 建议预留 16GB 及以上的可用空间(用于存放本地模型文件)

软件依赖环境:

操作系统:

- Linux: x64 架构,建议使用 Ubuntu 22.04 及以上 LTS 版本

- Windows: x64 架构,建议 Windows 10 及以上版本,并确保支持 WSL2

- macOS: 暂未提供官方支持

Docker: 需要 20.10 及以上版本,并支持 docker compose 功能

NVIDIA 驱动: 需安装支持 CUDA 的 NVIDIA 显卡驱动

NVIDIA Container Toolkit: 用于在Docker容器中启用GPU支持

详细的运行与开发环境配置步骤,请参考官方文档: https://github.com/XiaoMi/xiaomi-miloco/blob/main/docs/environment-setup_zh-Hans.md

部署安装实战教程

Xiaomi Miloco 由后端服务和AI引擎两部分组成。完整的本地部署需要同时安装两者,这就要求计算机配备高性能独立显卡。对于大多数普通设备,可以选择仅部署后端服务,而将AI处理任务交由云端API完成。

方案一:一键式快速部署

对于刚入门的新手用户,最简便的方法是使用官方提供的一键安装脚本。

手把手教你部署Homebox:打造专属家庭资产管理系统

Homebox是一款专为家庭用户设计的开源、自托管库存与组织系统。它通过直观的分组、位置定位与标签体系,帮助用户高效地追踪和管理家中的各类物品。无论是家庭日常用品的归档,还是小型仓库的资产盘点,它都能提供一个结构清晰、易于维护的数字化解决方案。

安装步骤:使用Docker Compose快速搭建

部署Homebox最便捷的方式是使用Docker Compose。你只需在服务器或NAS上创建一个docker-compose.yml文件,并写入以下配置内容。

services:

homebox:

image: ghcr.io/hay-kot/homebox:latest

container_name: homebox

ports:

- 7745:7745

environment:

- TZ=Asia/Shanghai

volumes:

- ./data:/data

restart: unless-stopped

保存文件后,在相同目录下执行 docker-compose up -d 命令,即可启动Homebox服务。容器将自动创建并运行在后台。

使用指南与功能详解

初始化设置与登录

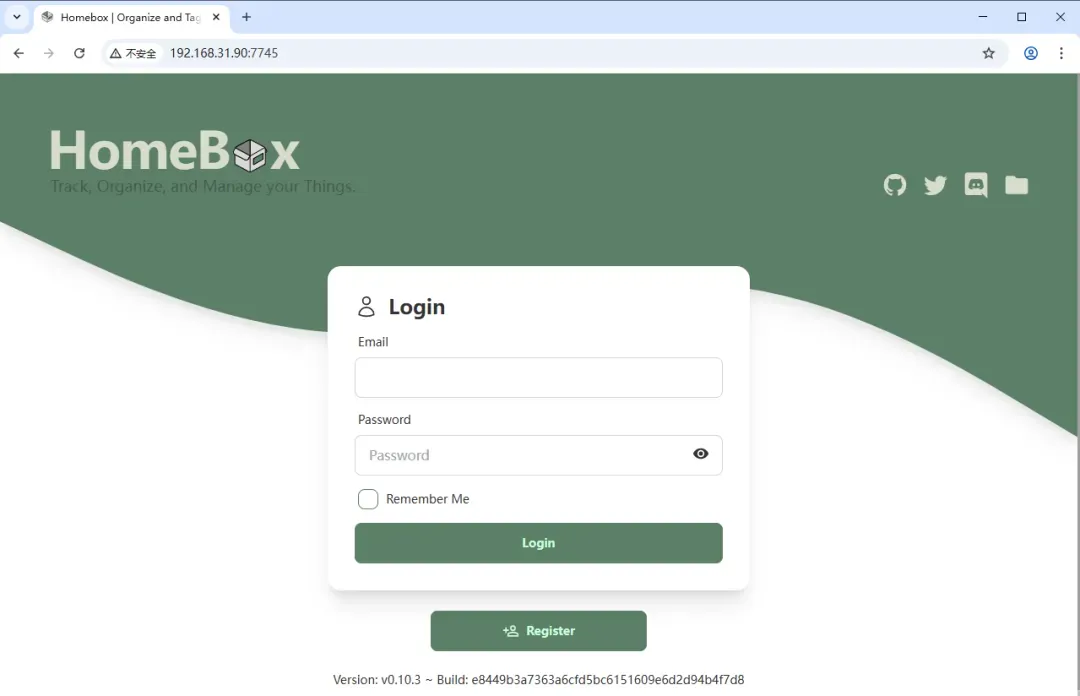

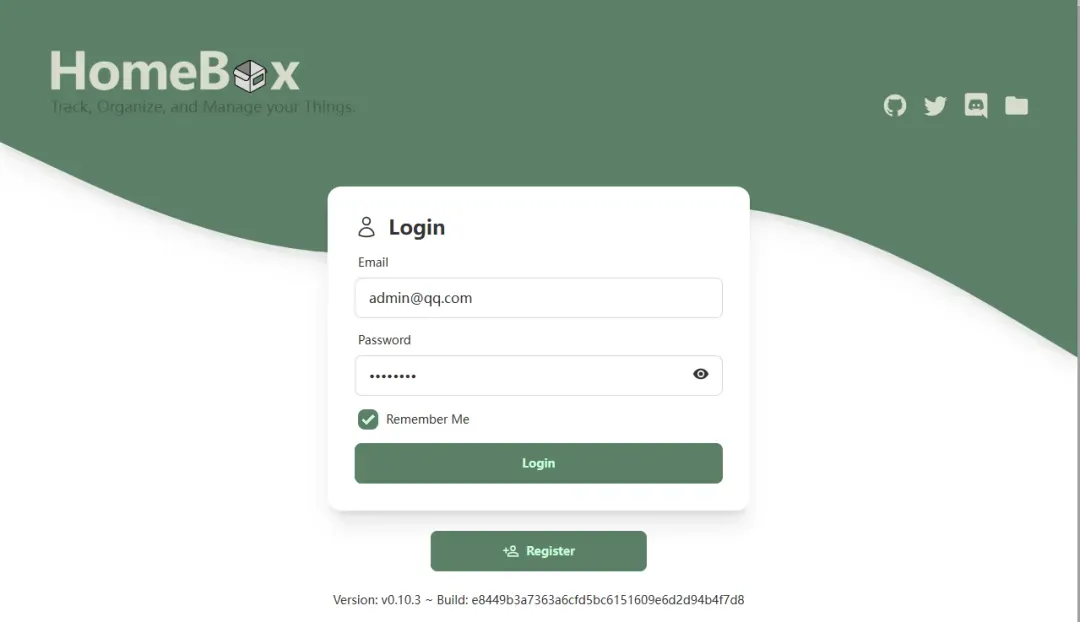

服务启动后,在浏览器地址栏输入 http://你的服务器IP:7745 即可访问Homebox的Web界面。

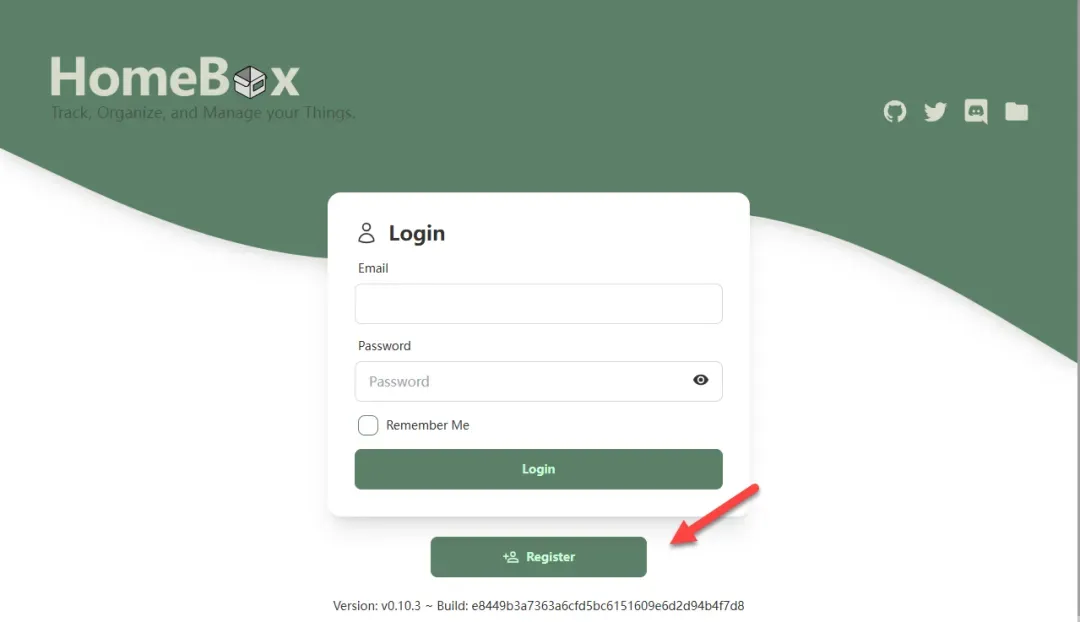

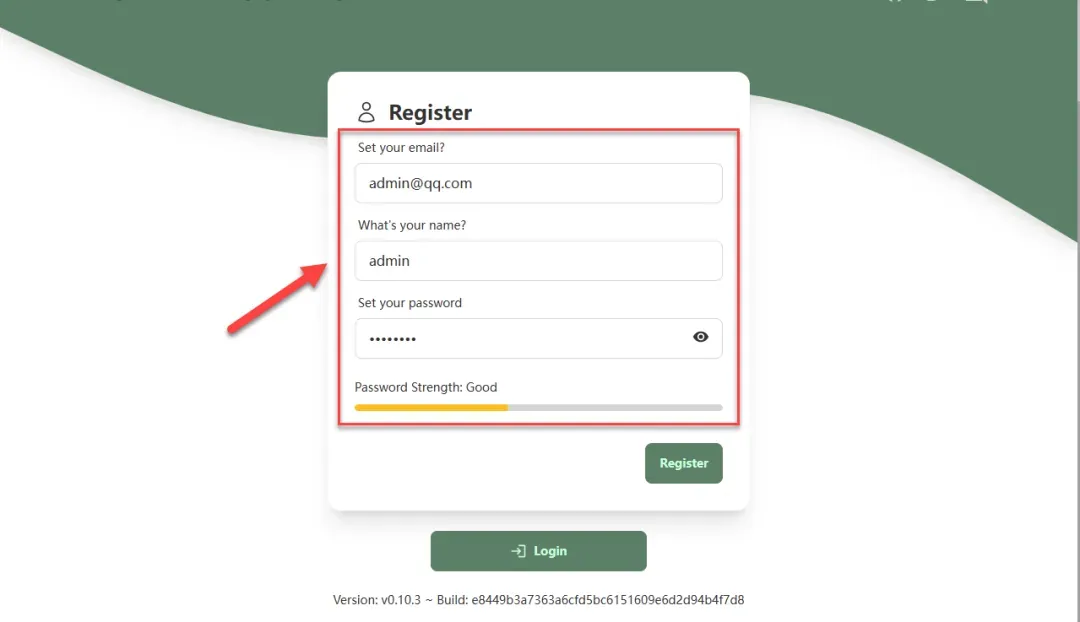

首次使用需要创建管理员账户。在登录界面下方找到并点击“Register”(注册)按钮。

按照提示填写用户名、邮箱和密码等信息,完成账户注册。

注册成功后,使用刚才设置的邮箱和密码进行登录,即可进入系统主面板。

界面与基础配置

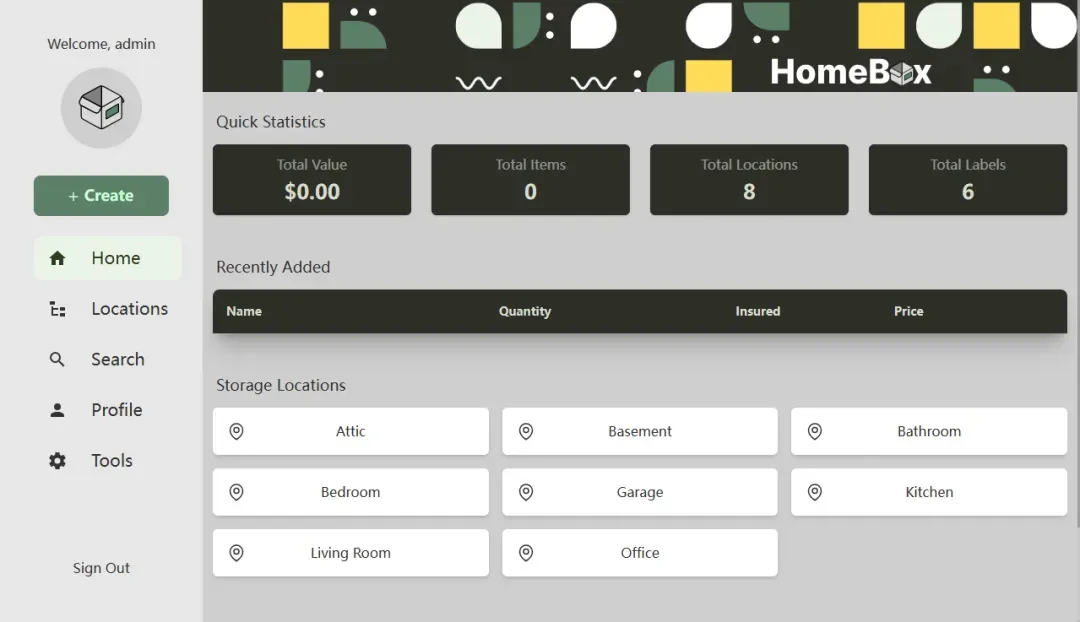

Homebox的主界面设计十分清爽,布局直观,各项功能一目了然。

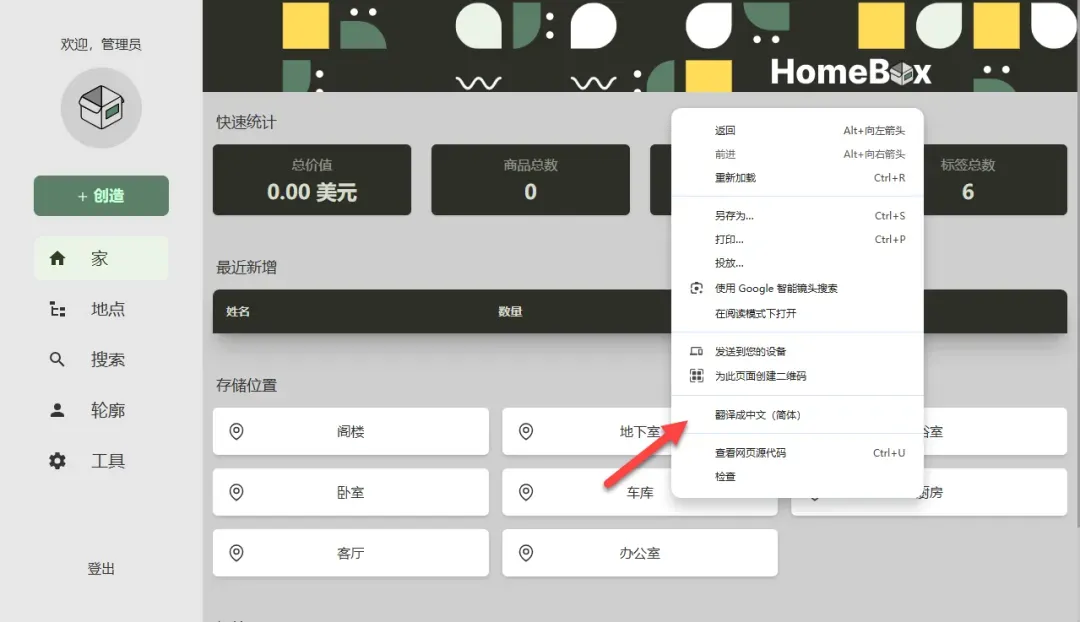

需要注意的是,当前版本应用本身并未内置中文支持。不过,你可以借助浏览器的网页翻译功能(如Chrome的右键“翻译成中文”选项)来获得更好的浏览体验。

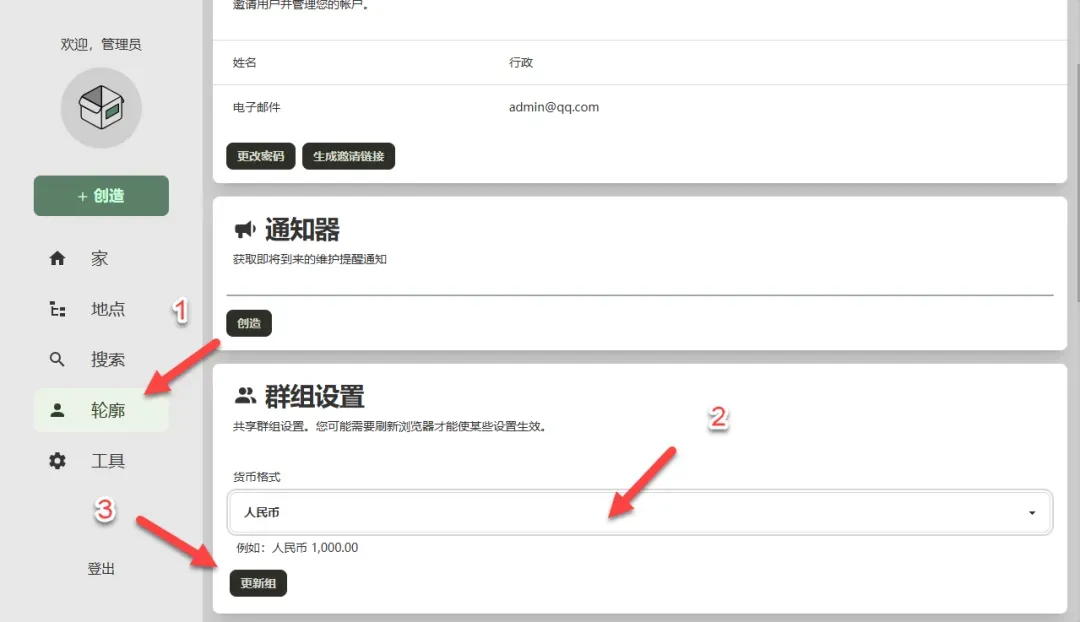

为了让资产价值显示更符合本地习惯,建议先进行货币设置。点击右上角头像,进入“Profile”(个人资料)页面,在“Currency”(货币)下拉菜单中选择“CNY - Chinese Yuan”,将货币格式切换为人民币。

设置完成后返回首页,可以看到金额的单位已经成功更新为“¥”。

核心功能:位置与标签管理

一个高效的管理系统始于清晰的组织结构。Homebox的核心逻辑围绕“位置”和“标签”展开。

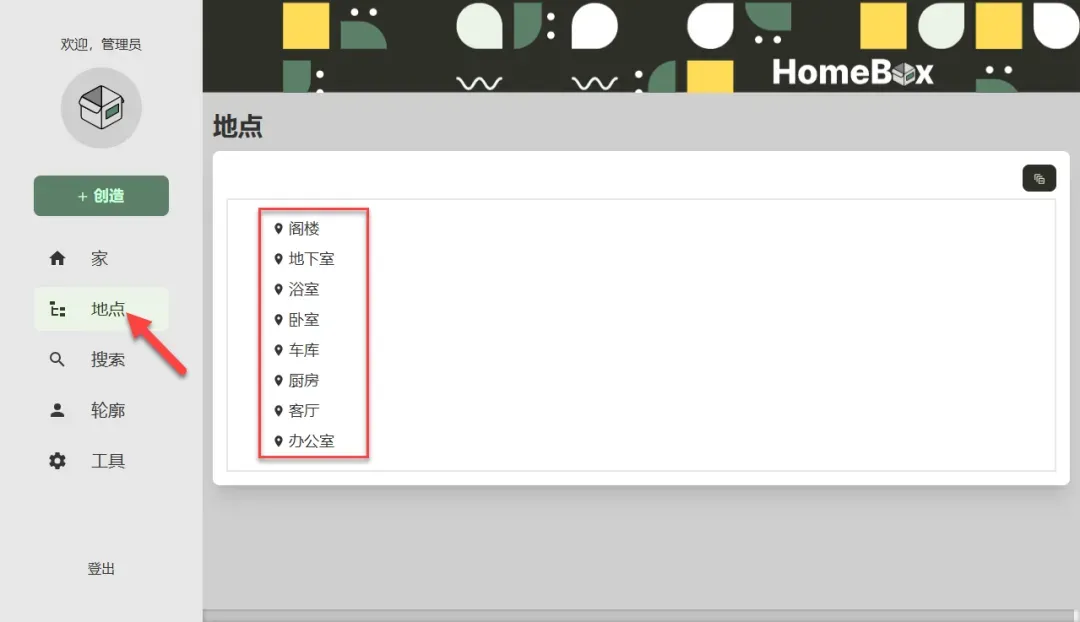

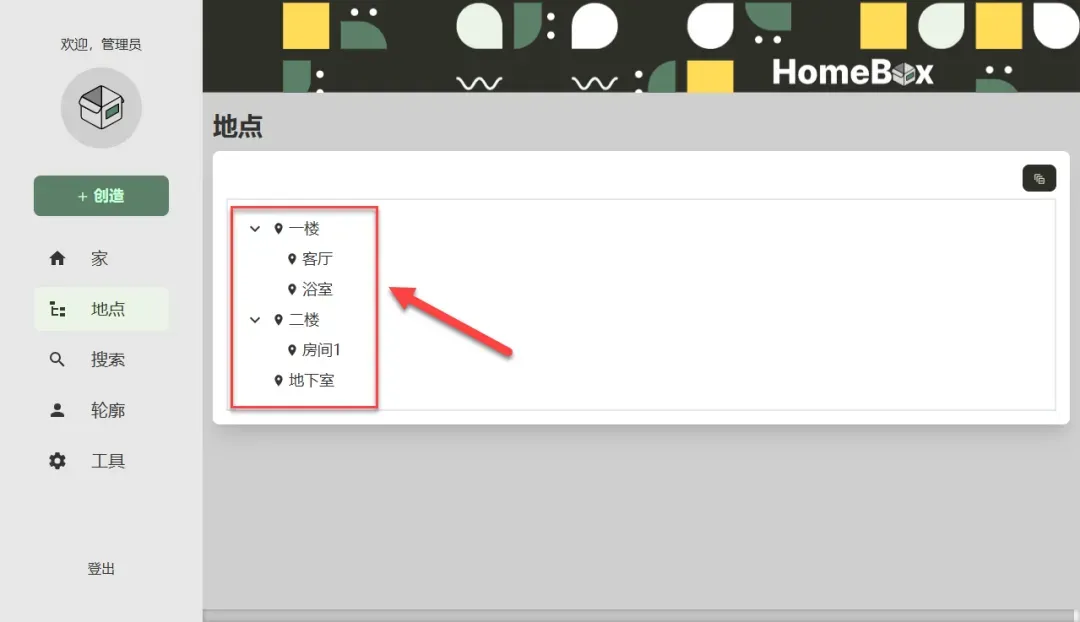

点击侧边栏的“Locations”(位置),系统已预设了几个示例地点。你可以根据实际情况保留、修改或删除它们。

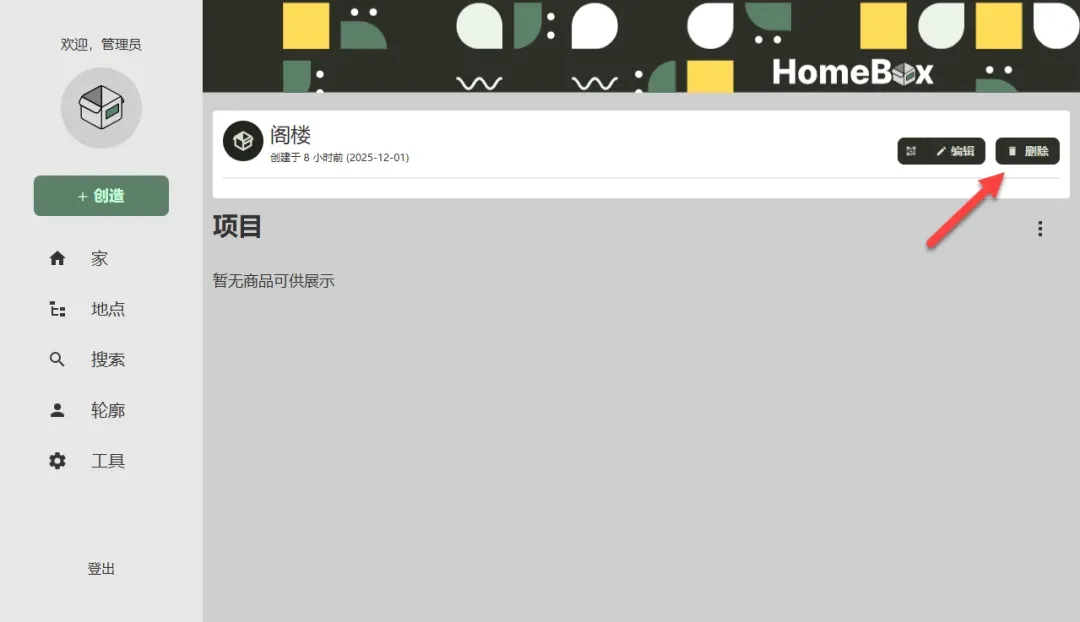

点击任意位置可进入详情页,若不需要可点击删除。

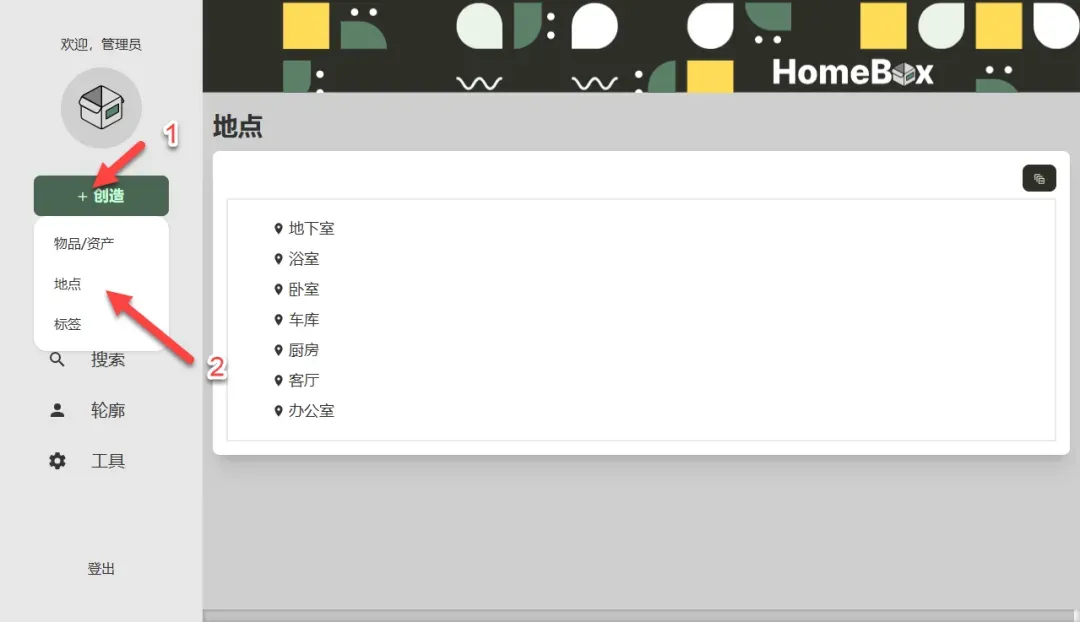

点击“Create”(创建)按钮,开始新建你自己的物品存放位置。

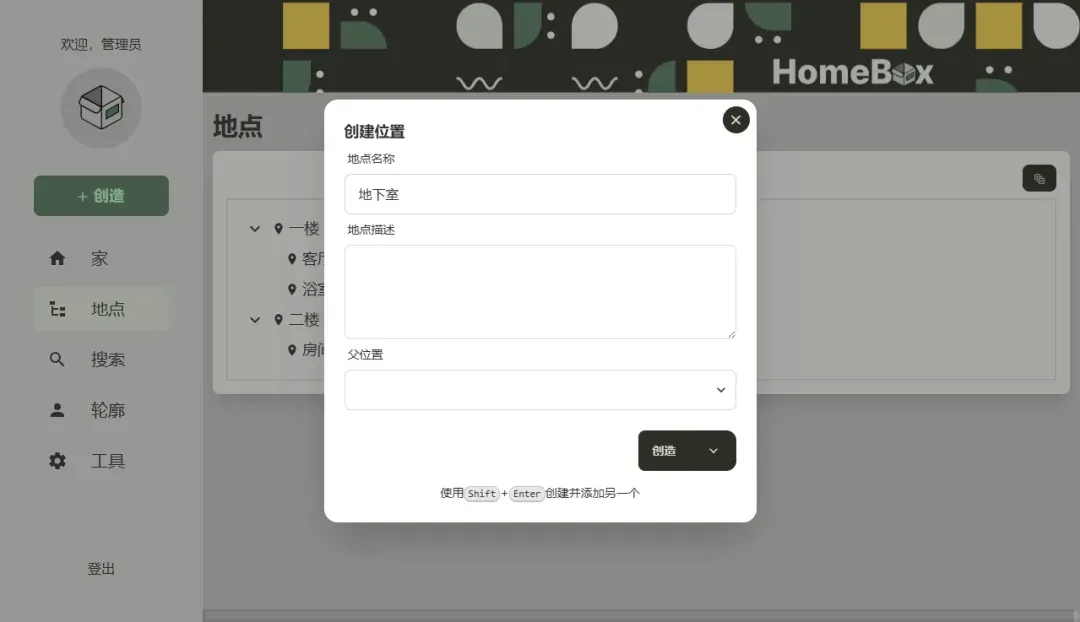

填写位置的名称与描述,例如“客厅储物柜”或“书房书架第三层”。

更强大的是,你可以为位置指定一个“Parent”(父位置),从而实现多层级的结构管理,例如“家 -> 书房 -> 书桌抽屉”。如果下拉框未显示选项,尝试刷新页面或直接输入已存在位置的名称即可。

除了位置,标签是另一种灵活的归类方式。在“Tags”(标签)页面,你可以创建诸如“电子产品”、“重要文件”、“季节性物品”等标签,方便从不同维度筛选物品。

添加与管理物品资产

当位置和标签都准备就绪后,就可以开始添加具体的物品了。点击导航栏的“Items”(物品),然后选择“New Item”(新建物品)。

手把手教程:MuMuAINovel AI小说创作助手本地部署与深度体验

MuMuAINovel 是一款基于人工智能技术的智能小说创作辅助工具,旨在帮助用户轻松构建和撰写精彩的虚构故事。

核心特性

- 🤖 多模型支持:可灵活对接 OpenAI、Gemini、Claude 等多种主流AI模型。

- 📝 智能创作向导:提供AI驱动的自动化流程,辅助生成故事大纲、角色设定及世界观框架。

- 👥 可视化角色管理:具备专门的人物关系图与组织架构图管理功能,清晰展现故事脉络。

- 📖 全面的章节编辑:支持对小说章节进行创建、编辑、重新生成以及文风润色等操作。

- 🌐 详尽的世界观设定:提供专门模块用于构建和整合故事发生的背景与环境。

- 🔐 灵活的登录方式:支持通过 LinuxDO OAuth 或创建本地账户进行登录。

- 💾 生产级数据管理:采用 PostgreSQL 数据库,确保多用户环境下的数据安全与隔离。

- 🐳 便捷的容器化部署:提供 Docker Compose 配置,可实现一键式启动,快速投入使用。

安装与配置步骤

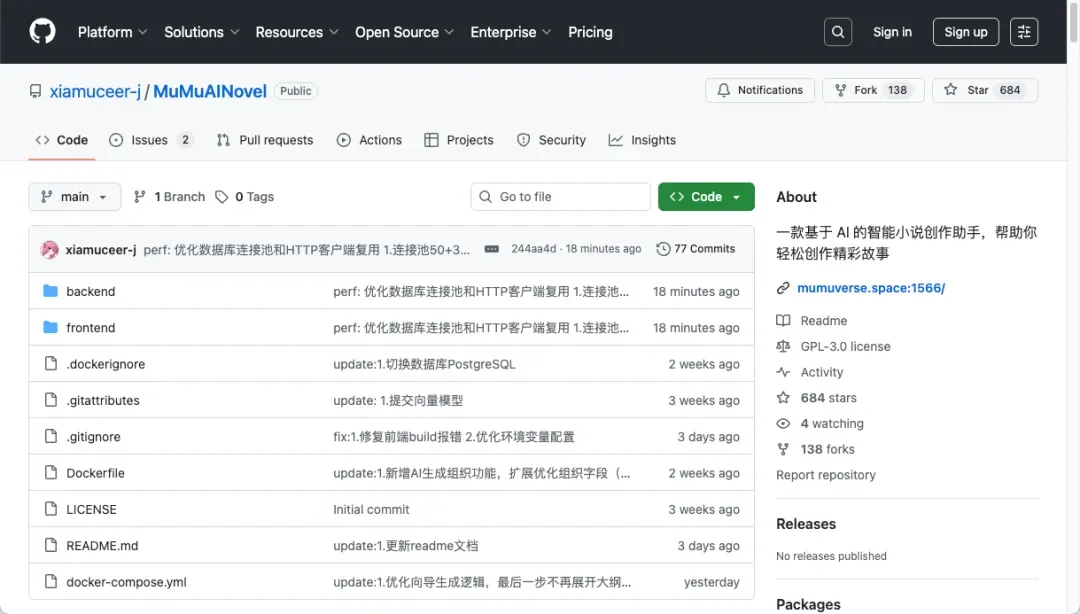

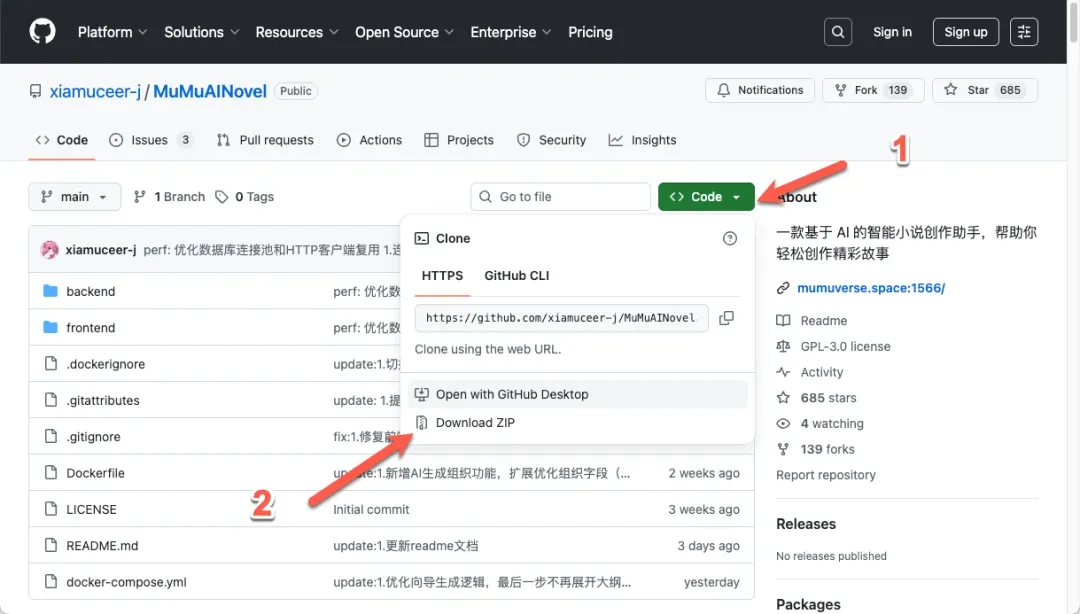

首先,访问该项目的 GitHub 仓库地址:https://github.com/xiamuceer-j/MuMuAINovel

将整个项目代码库下载到本地。

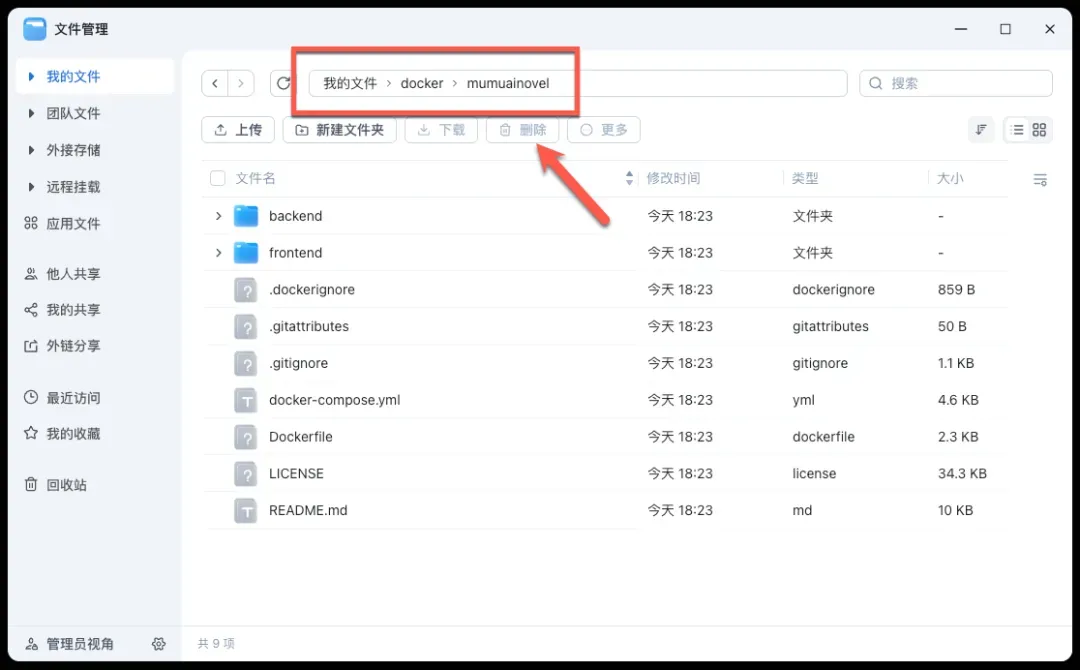

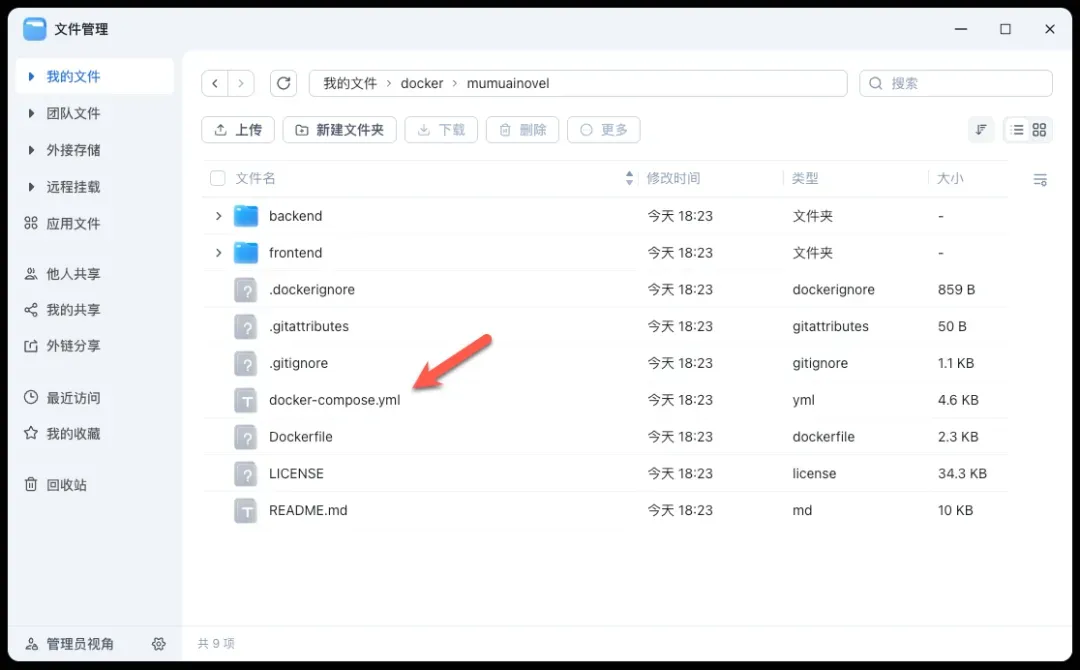

在本地创建一个名为 mumuainovel 的文件夹,并将下载的压缩包解压后放入其中。

找到项目根目录下的 docker-compose.yml 模板配置文件。

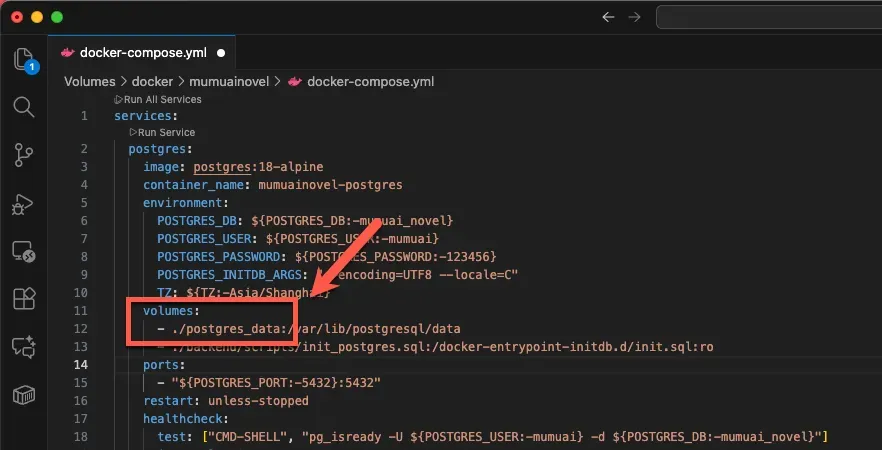

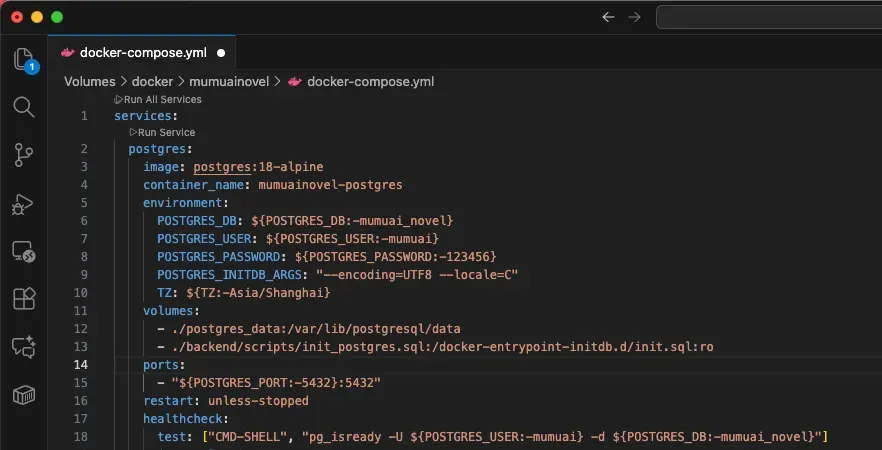

修改文件中 postgres_data 的挂载路径,建议改为相对路径 “./postgres_data”(使用绝对路径亦可)。

其余配置通常可保持默认,除非有特殊需求。

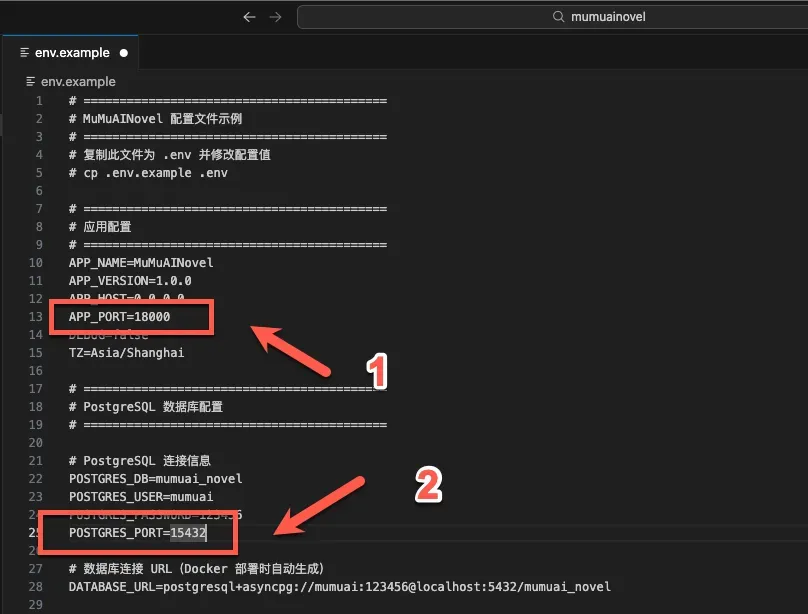

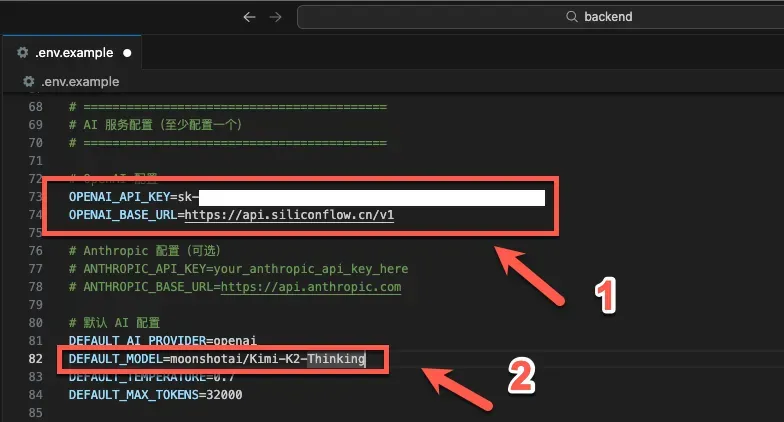

接下来,进入 backend 目录,找到名为 .env.example 的环境变量示例文件。

打开 .env.example 文件进行编辑。如果本地系统的 8000 或 5432 端口已被占用,可在此处修改为其他可用端口。

提示:配置AI模型API是关键一步。例如,若使用硅基流动平台的API,需相应修改接口地址和模型名称。以下是一个配置示例(模型可根据需要调整,例如尝试 DeepSeek):

https://api.siliconflow.cn/v1

deepseek-ai/DeepSeek-R1

如有必要,可在此文件中修改默认的管理员账户用户名和密码。

浏览器中直接运行Qwen3大语言模型:Docker零安装部署完整指南

Qwen-Web 是一个创新的开源项目,它使用户能够在本地浏览器中直接运行 Qwen3-0.6b 大语言模型。该项目实现了零安装需求,同时不记录日志或存储任何用户数据,确保了隐私和安全。

您可以通过访问在线演示来体验该项目的功能:https://qwen-web.sdan.io。

部署步骤

使用 Docker Compose 可以快速部署该项目,具体配置如下:

services:

qwen-web:

image: heizicao/qwen-web:latest

container_name: qwen-web

ports:

- 8443:443

restart: always

操作指南

在浏览器地址栏中输入 https://NAS的IP:8443 即可访问界面,请注意必须使用 HTTPS 协议。

提示:如果浏览器显示有关私密连接的警告,请选择继续访问以进入界面。

每次打开网页访问时,系统都需要先加载 Qwen3-0.6b 的模型文件,这可能需要一些时间初始化。

界面顶部栏提供了颜色主题切换功能,用户可以根据喜好调整外观。

背景支持添加网格效果,这增强了视觉体验并可能辅助界面布局。

在输入框中键入文字并按回车确认后,系统会生成回复并显示在对话区域内。

界面上方会显示回复速度,例如 14.93TPS,由于模型会展示思考过程,因此整体响应速度在可接受范围内。

左侧边栏内置了多个预设角色,用户可以选择这些角色进行针对性的聊天交互。

网页聊天功能通过 WebGPU 技术调用设备 GPU 进行计算,这提升了模型运行的效率和性能。

评价与总结

这个项目展现了在浏览器环境中直接运行 Qwen3 大语言模型的有趣潜力。它利用 WebGPU 技术实现网页对设备 GPU 的调用,从而进行计算和渲染。目前,该项目在 PC 界面适配方面尚有改进空间,且运行模型时偶尔会出现 BUG,例如卡顿或回复英文内容。尽管如此,个人认为它仍然具有较高的娱乐性和探索价值,用户可以在运行模型的同时测试设备 GPU 的性能表现。

综合推荐:⭐⭐⭐(项目概念新颖,具有一定趣味性)

使用体验:⭐⭐(界面设计较为简单,且存在偶发的功能性问题)

部署难易:⭐(部署过程极为简便,适合快速上手)

铭凡N5-255 NAS深度体验:强悍硬件与极致扩展,是否物超所值?

铭凡 N5-255 是一款在硬件配置上表现强劲、扩展能力极为出色且散热效能优秀的 NAS 设备,能够充分满足家庭环境以及小型创作团队对于海量数据存储与高速文件传输的各类需求。其核心搭载了 AMD Ryzen 7 H255 处理器,并配备了 16GB 的 DDR5 内存,提供了 5个机械硬盘位与 3个 NVMe 固态硬盘位组成的混合存储方案,拥有双 USB4 高速接口,同时支持用户自行添加半高规格的 PCIe 扩展设备。

开箱与外观解析

本次开箱体验的对象是铭凡 N5-255 设备,其产品包装箱的尺寸相当可观,拿在手中能感受到明显的分量。笔者在京东平台以 3480 元的价格购入,接下来将带领大家一同开箱,并分享这段时间的真实使用感受。

包装箱的侧面清晰标注了该设备的核心配置:采用了 AMD Ryzen 7 H255 处理器,支持 DDR5 内存,最多可扩展安装 5 块 HDD 机械硬盘与 3 块 NVMe 固态硬盘。在接口方面,则提供了 USB4(40Gbps)、10G 以太网口以及一个半高 PCIe 扩展插槽。

拆开最外层的纸质包装箱,移开顶部的固定泡沫板后,便能看到被白色防尘膜妥善包裹着的 NAS 主机。在旁边,还放置了一个黑色的配件盒。

包装内附有产品说明书、保修卡以及使用指南(务必记得扫描二维码,其中提供了驱动程序和手机应用程序的下载链接,笔者也是后期折腾许久后才发现的)。

配件中包含一根 HDMI 连接线。

同时,也配备了一根标准网线。

电源适配器的规格为 19V/14.7A,最大输出功率达 279.3W。这个功率应对 5 块机械硬盘加上 3 块 M.2 固态硬盘的供电需求可谓绰绰有余,即便额外加装一块高性能的半高独立显卡也完全没有问题。

PlaylistDL NAS部署全攻略:轻松下载Spotify与YouTube音乐资源

您是否正在使用Spotify(声破天)和YouTube(油管)来享受海量音频与视频内容?作为全球范围内极具影响力的流媒体平台,它们分别占据了音频和视频领域的领先地位。为了提升日常使用体验,许多用户会选择与朋友共同订阅家庭套餐会员。

然而,平台上的内容浩如烟海,我们常常面临听不完、看不尽的困扰。当您希望将心仪的音乐曲目离线保存至本地时,可能会发现这个过程远比预想的要复杂。特别是在YouTube上,面对长长的播放列表,逐一手动保存不仅耗时费力,还可能遭遇访问限制或地区封锁。若还想同步提取音频轨道、视频封面或字幕文件,更是让人倍感疲惫。

正是为了解决这些痛点,我发现了一个名为PlaylistDL的宝藏工具项目。它能够帮助您轻松地将来自这两个平台的音乐内容保存到您的网络附加存储设备中。实际上,它的能力并不仅限于音乐,像有声书、相声段子或其他音频类文件都可以顺利处理。

请注意,该工具专注于提取音频内容。这意味着,即使您输入的是YouTube视频链接,最终获得的也只会是高质量的音频文件。

项目简介与核心特性

PlaylistDL 是一款支持自托管的Web应用程序,专门用于从Spotify和YouTube获取歌曲、专辑或整个播放列表,并将其转换为MP3格式的文件。该程序提供了一个简洁的Web界面,用户只需输入资源链接,它便会调用 spotdl(针对Spotify)或 yt-dlp(针对YouTube)引擎,在后台完成音频的抓取与保存工作。

双平台支持:能够自动识别并处理来自Spotify和YouTube的URL链接。 会话隔离管理:为每位用户创建独立的下载目录,确保文件管理清晰有序。 管理员控制模式:允许具备管理员权限的用户直接将文件下载到服务器上的指定文件夹。 实时进度与日志:通过网页界面可以直观查看下载进度条和详细的操作日志。 智能清理机制:可设置在特定时间后自动删除临时下载文件,释放存储空间。 结构化存储:下载完成的音频文件会自动按照艺术家和专辑名称进行分类归档,提升管理效率。

部署步骤详解

本文将以为联通NAS为例,详细介绍通过Docker Compose部署PlaylistDL的完整流程。

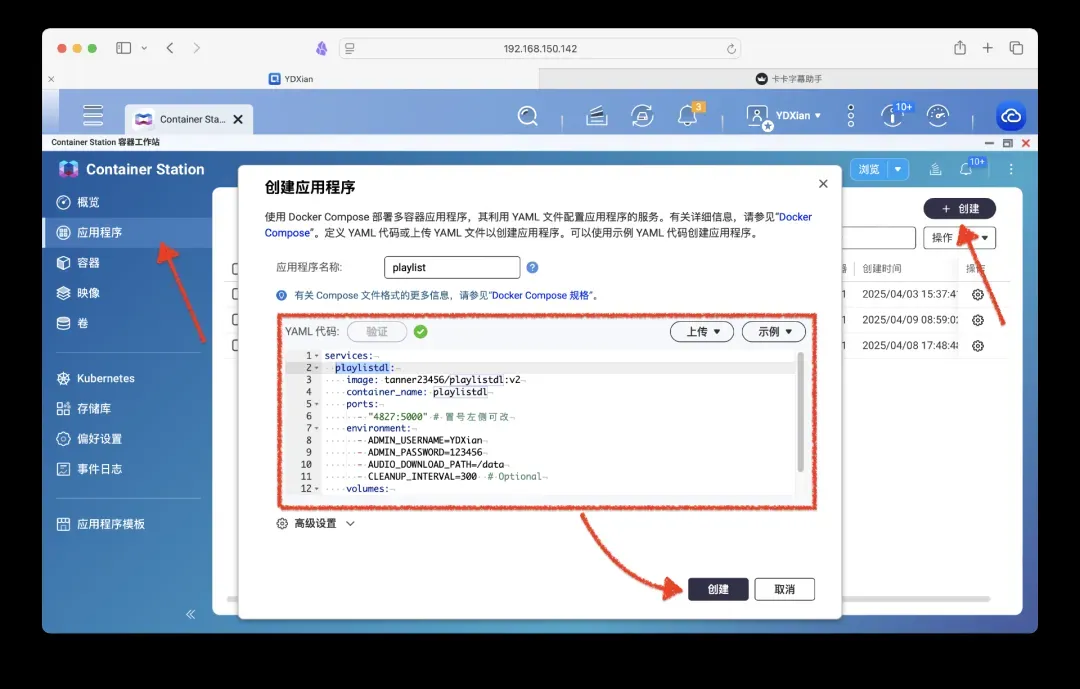

以下是部署所需的Docker Compose配置代码:

version: '3' # 若使用最新版Docker Compose,此行可省略

services:

playlistdl:

image: tanner23456/playlistdl:v2

container_name: playlistdl

ports:

- "4827:5000" # 冒号左侧的端口号可根据需要修改

environment:

- ADMIN_USERNAME=YDXian

- ADMIN_PASSWORD=123456

- AUDIO_DOWNLOAD_PATH=/app/data

- CLEANUP_INTERVAL=300

volumes:

- /share/Container/playlistdl/data:/app/data

restart: unless-stopped

关键参数说明:

tanner23456/playlistdl:v2:请注意指定镜像版本为v2,这是由项目作者维护的稳定版本。/share/Container/playlistdl/data:/app/data:此为宿主机与容器内的路径映射。冒号左侧的宿主机路径建议您根据自身NAS的存储结构进行修改。这里有一个需要注意的地方:最初尝试时,曾误将容器内路径设置为/data,导致下载完成后无法在NAS目录中找到文件。通过查看容器日志并进入容器内部检查,才确认正确的路径应为/app/data。

使用指南与操作演示

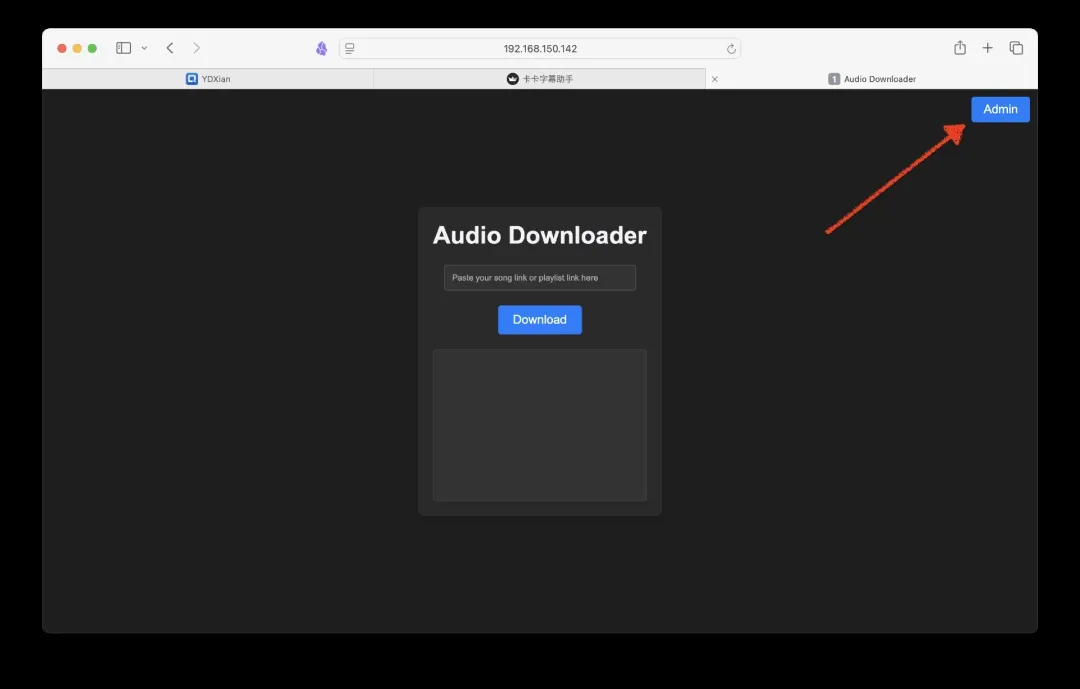

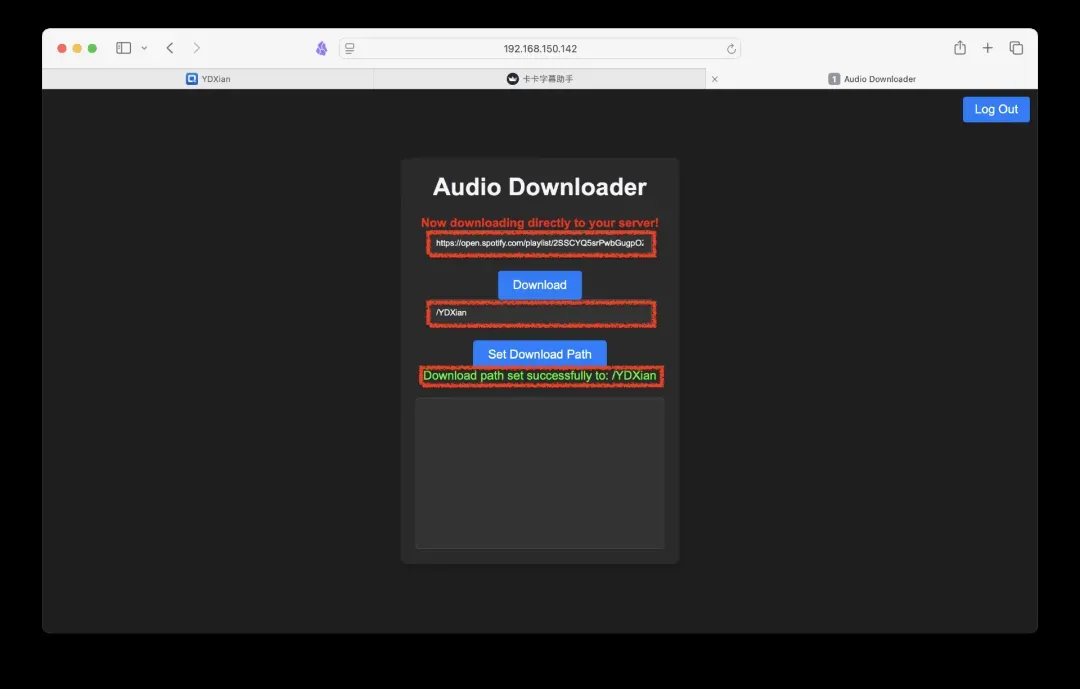

完成上述部署后,在浏览器地址栏中输入 您的NAS_IP地址:4827 即可访问PlaylistDL的Web服务界面。

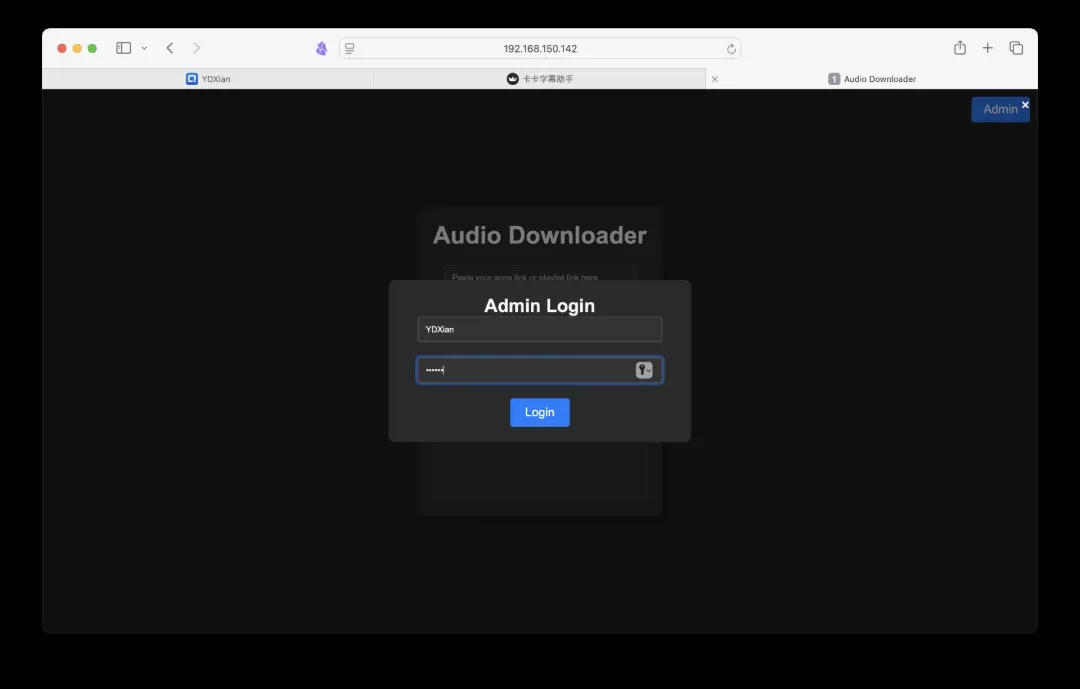

界面右上角设有“Admin”入口,点击后将跳转至登录页面。需要说明的是,若想将文件直接下载到您的NAS或服务器上,必须完成管理员登录。登录所用的用户名和密码,即部署代码中环境变量 ADMIN_USERNAME 和 ADMIN_PASSWORD 所设定的值。

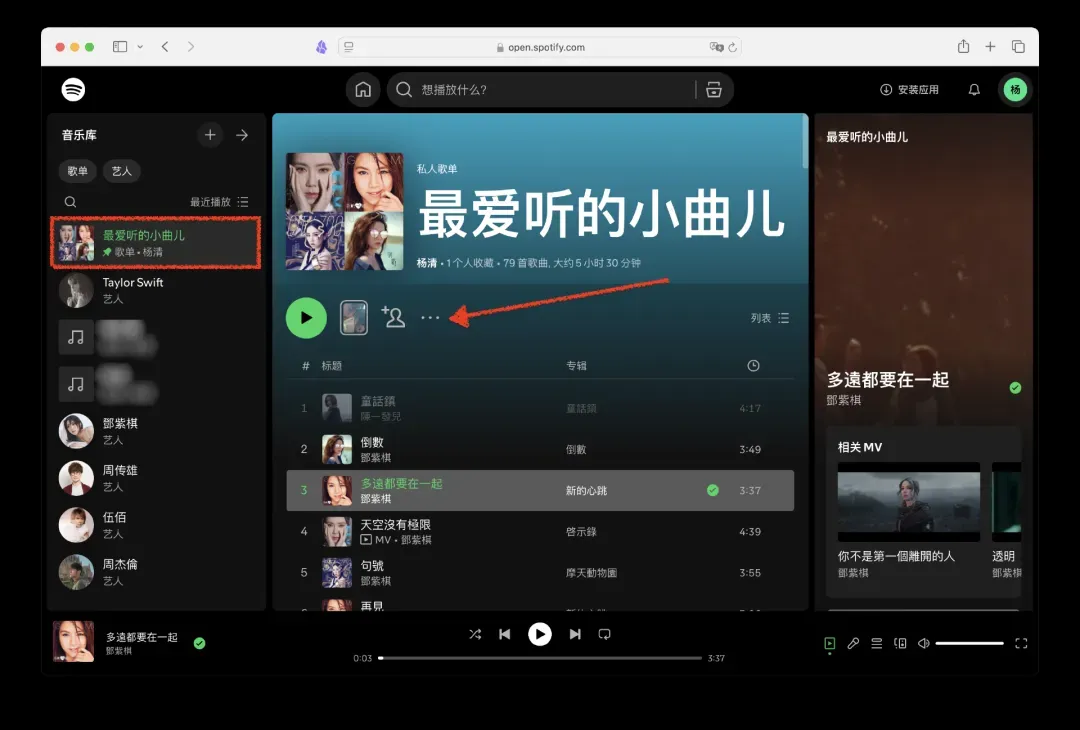

让我们首先以Spotify进行测试。打开Spotify应用,分别选择个人歌单和单曲。

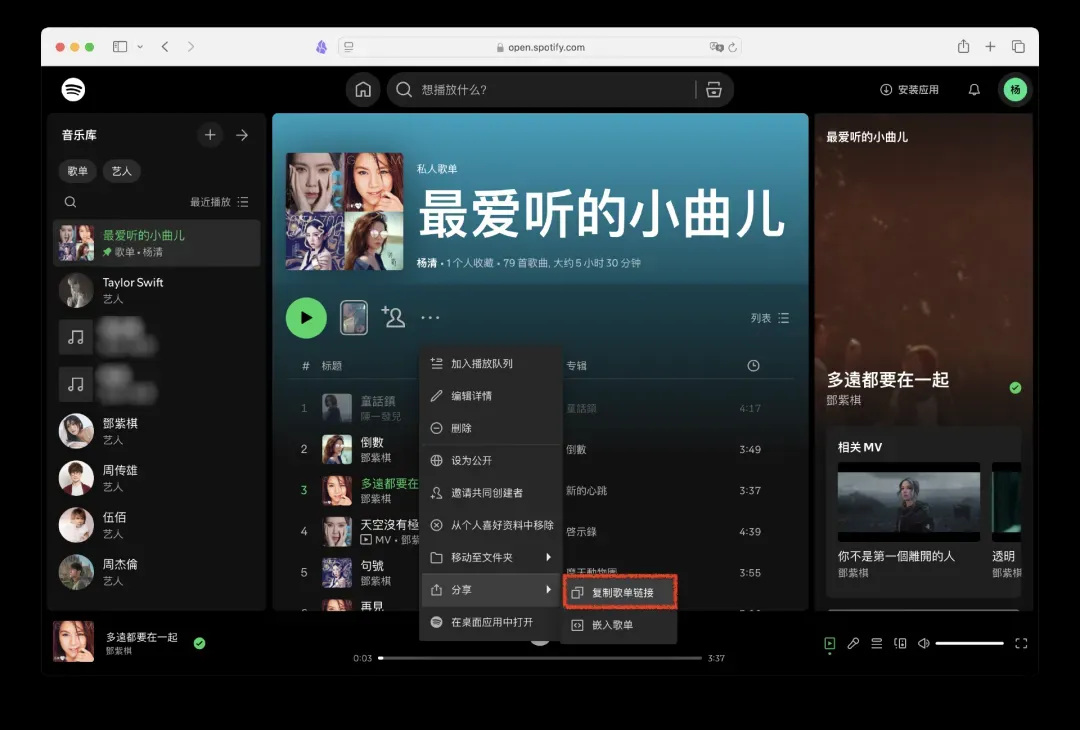

点击“分享”功能,获取该歌单或歌曲的分享链接,并将其复制到剪贴板。

将复制好的链接粘贴到PlaylistDL网页的URL输入框中,点击“Download”按钮即可开始任务。您也可以在此处自定义文件下载的存储目录。

在威联通NAS上部署LibreTranslate:打造私有化离线翻译平台

是否遇到过这样的困扰:当急需翻译一段内容时,网络却突然中断,导致在线翻译页面无法打开?或者经常需要处理大量翻译任务,却受限于字数限制、请求频率,甚至被各种广告干扰?此外,是否担忧使用在线翻译工具时,内部资料会被上传至Google、百度等服务器,导致数据隐私泄露?对于开发者而言,调用翻译API时是否也常面临需要绑定信用卡或付费的障碍,使得调试过程困难重重?

如果以上问题正是您的痛点,那么LibreTranslate值得深入了解。这是一款开源、免费且无需联网即可使用的翻译工具,支持本地部署、多语言互译,并确保数据完全不上传至外部服务器。通过Docker容器技术,它可以一键启动,为您提供一个安全、私有的翻译环境。

本文作者在日常工作中经常需要校订总部文稿,曾混合使用腾讯翻译君和Google翻译。在体验过LibreTranslate后,认为其表现优异,因此特此推荐。

核心特性 LibreTranslate是一个完全开源的项目,它不依赖任何第三方专有服务提供商(如Google或Azure)来执行翻译任务。其核心基于神经网络的翻译引擎,由开源的Argos Translate库提供支持,能够在离线环境下运行,并支持自建部署,实现完全的自托管。

🌍 无需依赖任何第三方云平台,可完全在本地离线部署。 🔐 支持API密钥管理和访问请求控制,有效防止滥用。 🧠 支持多种语言之间的互译,包括中文、英文、法语、西班牙语等主流语种。 🐳 提供官方Docker镜像,极大降低了部署和维护的复杂性。 ⚡️ 启动速度快,系统资源占用低,特别适合在内网或资源受限的环境中运行。

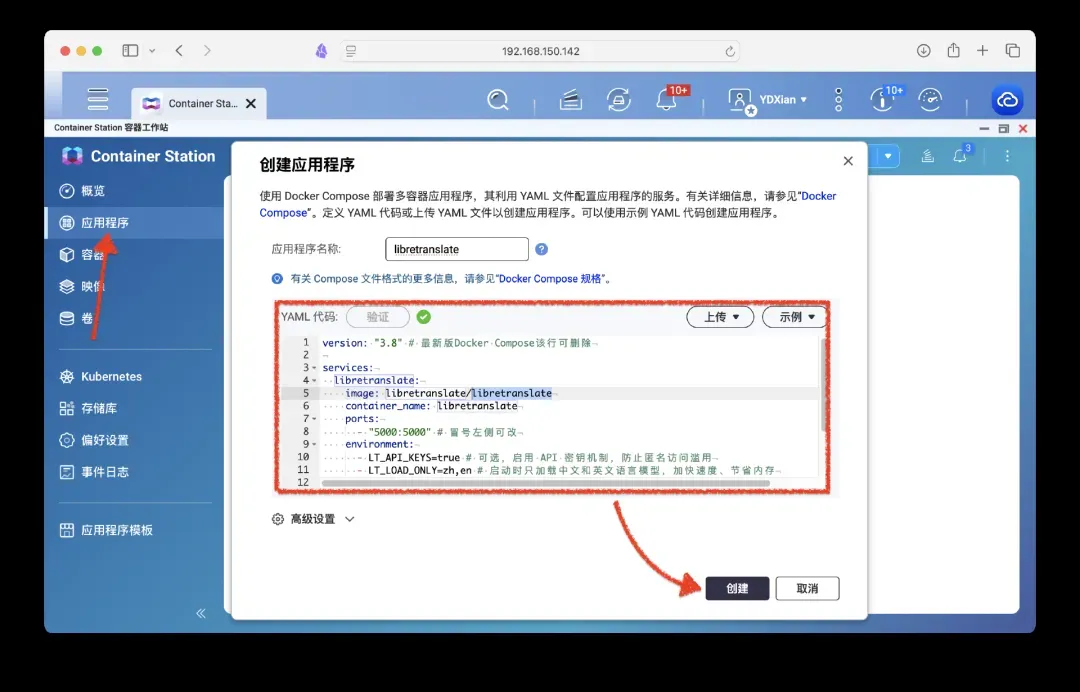

详细部署步骤 本文将演示如何在威联通NAS平台上,使用Docker Compose方式部署LibreTranslate。

以下是经过考量的部署配置代码:

version: "3.8" # 如果使用最新版Docker Compose,此行可删除

services:

libretranslate:

image: libretranslate/libretranslate

container_name: libretranslate

ports:

- "8899:5000" # 冒号左侧的端口可根据需要修改

environment:

- LT_API_KEYS=true # 可选配置,启用API密钥机制,防止匿名访问滥用

- LT_LOAD_ONLY=zh,en # 启动时仅加载中文和英文语言模型,以加快启动速度并节省内存

- LT_UPDATE_MODELS=true # 启动时自动检查并更新语言模型文件

volumes:

- /share/Container/libretranslate/api_keys:/app/db # 持久化存储API密钥数据库,容器重启后数据不丢失

- /share/Container/libretranslate/models:/home/libretranslate/.local # 缓存语言模型数据,避免每次启动重复下载

restart: unless-stopped

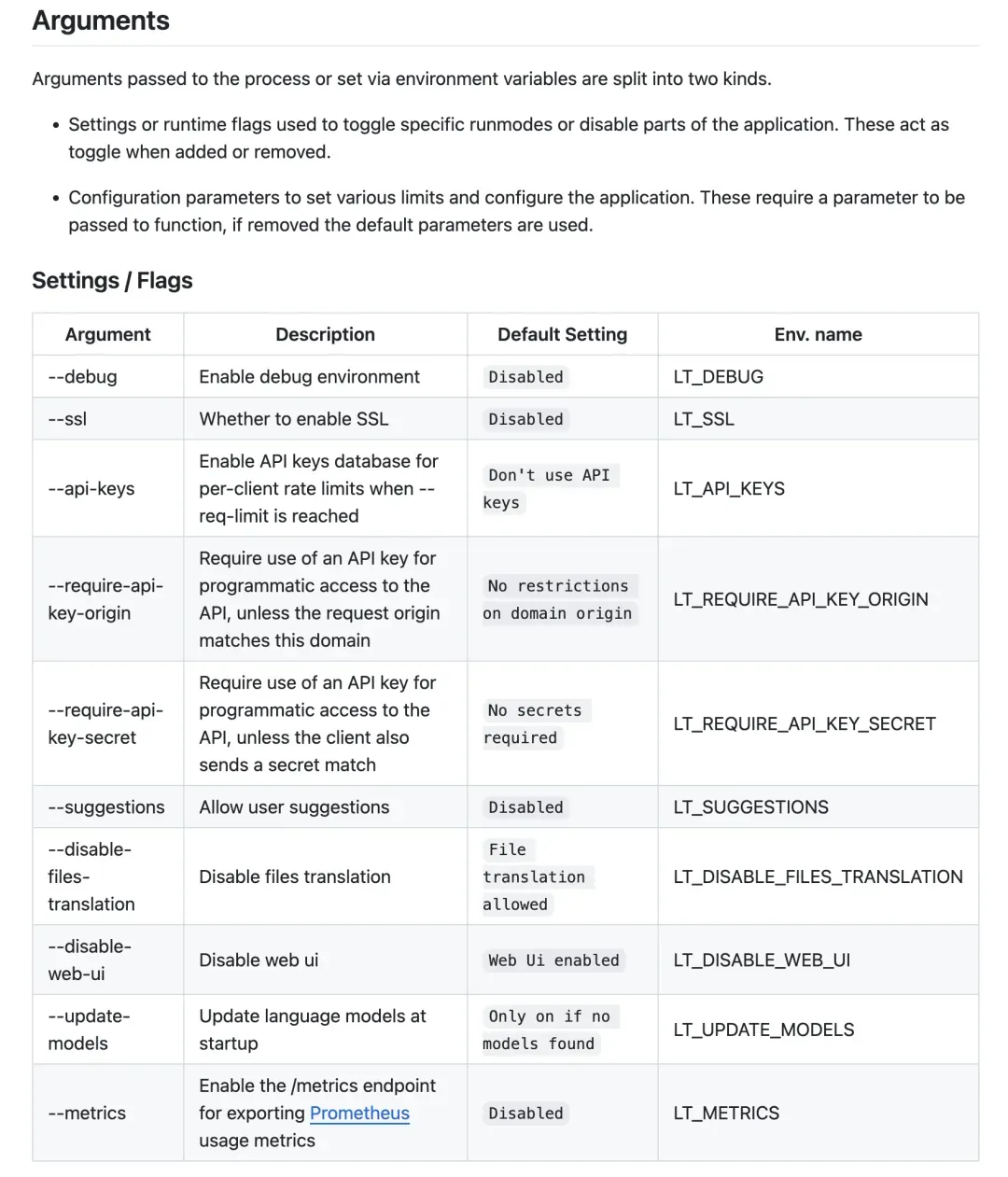

上述配置代码包含了基本的部署参数。若您需要进行更深入的配置,例如调整文件翻译功能或设置最大文本处理量,建议访问GitHub搜索项目 libretranslate/libretranslate,进入其官方主页查阅完整文档。下图展示了项目文档的部分内容。

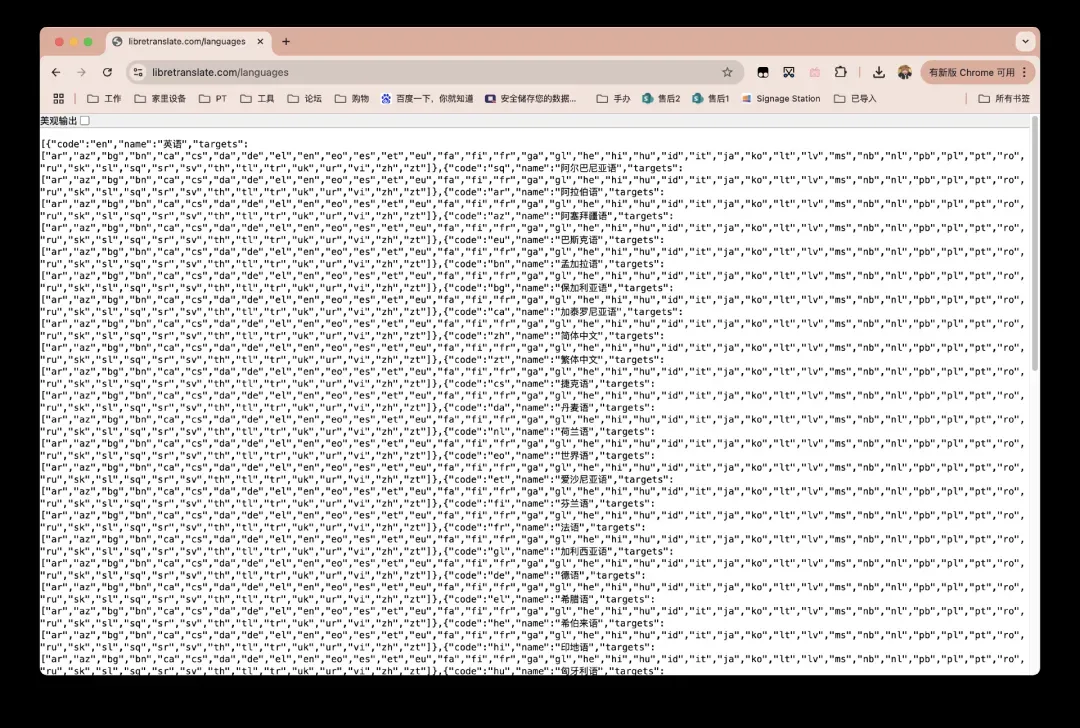

关于LibreTranslate支持的语言列表,可以参考以下图示。

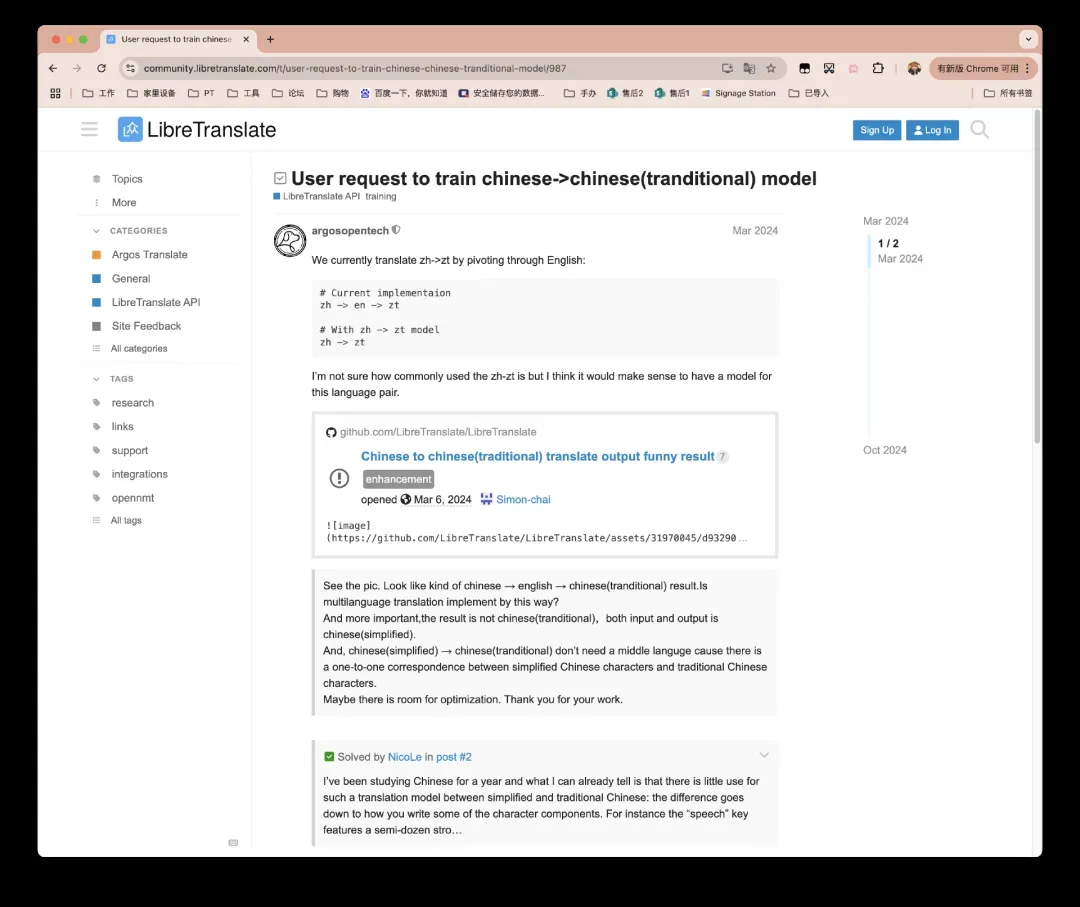

该项目的可配置项相当丰富。在其社区论坛中,也有一些有趣的讨论,例如关于简体中文与繁体中文互译的议题。可以看出,部分海外开发者对这两种中文变体之间的微妙差异了解不深。正如有开发者指出,专门构建一个从简体到繁体的直译模型,其需求可能相对有限,且在不同文化背景下,简单的字符转换本身就是一个复杂课题。值得欣慰的是,一些熟悉中文的贡献者正积极参与,共同推动语言支持方面的进步。

话题回到部署本身。首次部署时需要下载语言模型文件,这个过程可能会花费一些时间。您可以利用这段时间进行其他准备工作,例如提前配置好反向代理等。如果在部署过程中遇到问题,请参考文末的“常见问题与解决方案”部分,大多数问题都与文件权限设置有关。

使用指南与功能演示

根据上述部署,在浏览器中输入 NAS_IP:8899 即可访问LibreTranslate的Web界面。界面右上角可以输入API密钥、切换用户界面语言以及选择明暗主题。