HotPush:一站式热点聚合利器,打造你的专属信息流,效率倍增!

在碎片化信息时代,每日浏览热点已成为许多人的固定习惯。然而,平台繁多导致信息极度分散,常常让人陷入“越刷越乱”的困境:微博热搜、知乎热榜、B站热门、外加技术圈必看的V2EX和掘金……真正的挑战并非缺乏内容,而是缺少一个能将各平台热点有效聚合,并依据个人偏好进行主动推送的整合方案。

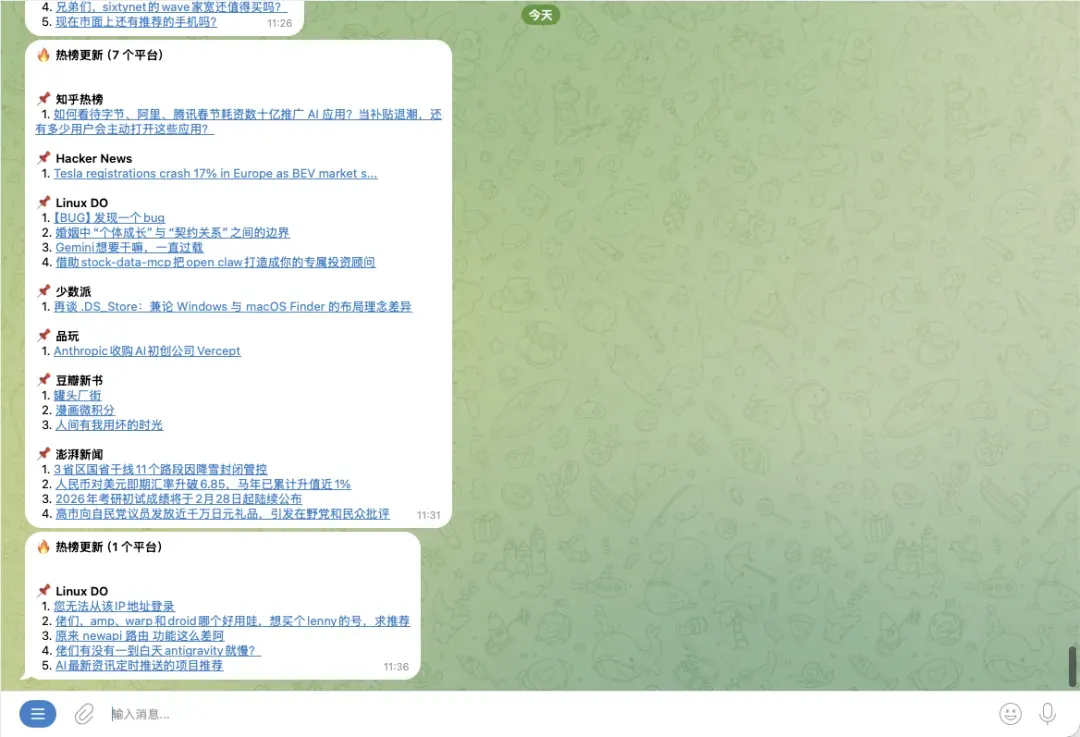

近期,一个名为HotPush的开源项目进入了我的视野,它精准定位于“热点聚合与主动推送”。该项目将微博、知乎、B站、V2EX等13个主流平台的热榜内容统一汇聚于一个清晰的面板之中。更出色的是,它支持将你关心的热点信息,实时推送到Telegram、Discord、企业微信、飞书、钉钉乃至个人邮箱等多个渠道。同时,它还具备关键词过滤、推送时段限制、来源平台筛选等智能规则,能有效过滤无关信息,减少干扰。

核心特性一览

项目的完整名称是JackyST0/hotpush,你可以在GitHub上轻松搜索到。其核心功能围绕“推送”展开,数据源基于某公开站点的RSS(latest.rss),无需登录即可获取公开的热点信息。

- 🌐 打破信息孤岛 - 聚合微博、知乎、B站、V2EX等13个平台的热门榜单,实现一站式浏览。

- 📨 连接你的工作流 - 支持将信息推送至Telegram、Discord、企业微信、飞书、钉钉、电子邮件等常用渠道。

- ⚡ 捕捉瞬息热点 - 实现分钟级别的监控频率,确保新出现的热点能够第一时间送达。

- 🎯 精准信息筛选 - 通过关键词黑白名单、自定义推送时间段、特定来源平台过滤等规则,打造纯净信息流。

- 🎨 优雅交互体验 - 前端采用Vue 3与Tailwind CSS构建,提供现代化、响应式的用户界面。

- 👥 灵活的权限管理 - 支持多用户体系与细粒度的权限控制,适合团队协作使用。

- 🐳 简化部署流程 - 提供完整的Docker镜像与编排文件,支持一键快速启动,真正做到开箱即用。

- 🆓 开源精神永驻 - 遵循宽松的MIT开源协议,可自由使用、修改与分发。

此外,根据项目动态,开发者正在规划集成AI摘要生成功能,值得后续关注。

详细部署指南

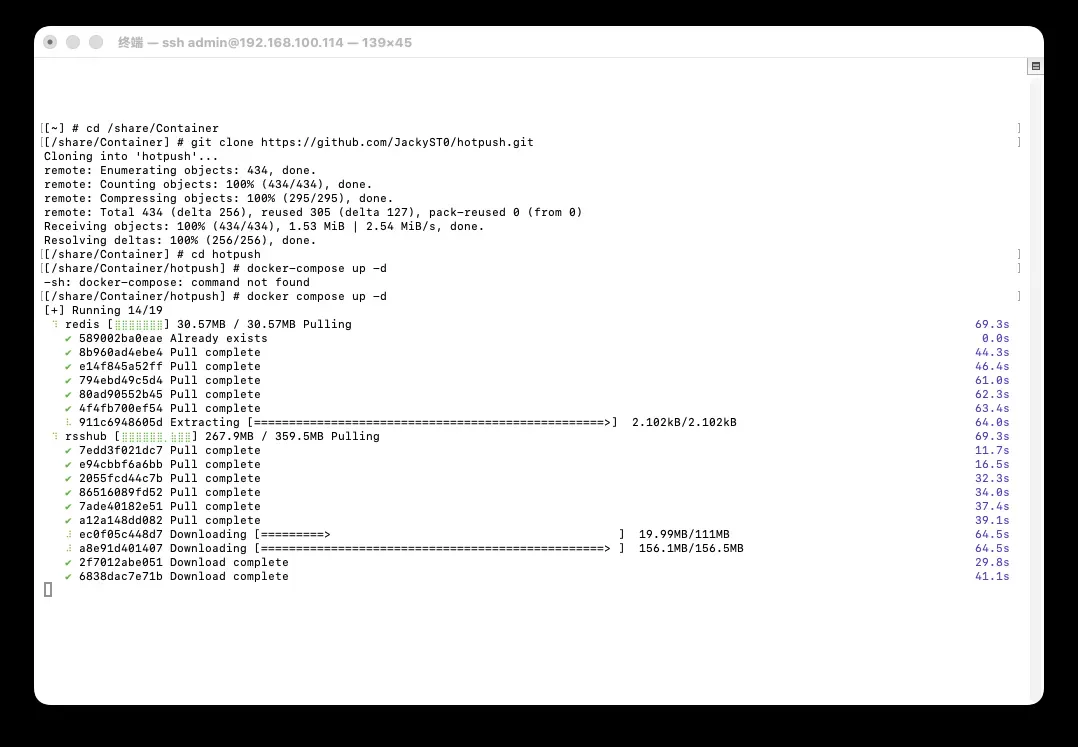

下面我们以在威联通(QNAP)NAS上部署为例,整个过程并不复杂。

首先,通过电脑上的终端工具(如PuTTY或Terminal)使用SSH连接到你的NAS,并依次执行以下命令进行操作。

# 第一步,进入常用的Docker工作目录

cd /share/Container

# 第二步,从GitHub克隆项目仓库

git clone https://github.com/JackyST0/hotpush.git

# 第三步,进入项目文件夹

cd hotpush

# 第四步,使用Docker Compose创建并启动所有服务(在后台运行)

docker compose up -d

# 如果上述命令执行失败,可以尝试使用传统的docker-compose命令

docker-compose up -d

项目启动时需要进行首次构建,请耐心等待片刻,直到控制台输出显示所有服务均已正常运行。

如果在运行过程中遇到错误,例如下图所示的情况。你可以先通过 docker-compose down 命令停止服务,然后重新执行上述第四或第五条启动命令。

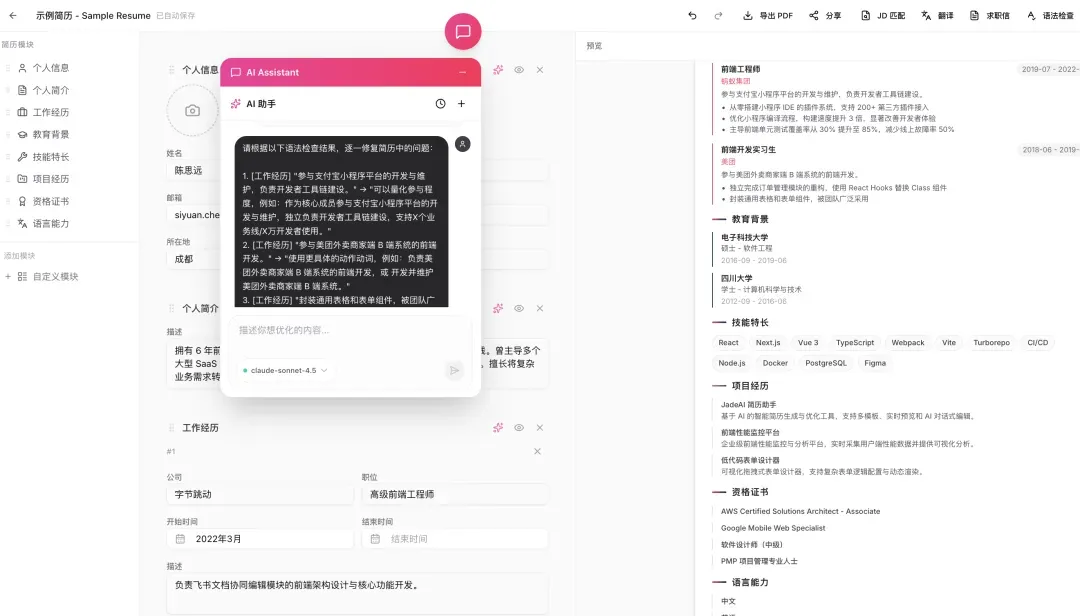

JadeAI开源AI简历助手全攻略:智能生成、优化润色与一键部署指南

开工首日,一位从事企业招聘兼职的朋友向我诉苦:今年本地人才市场拥挤到难以挪步,每年春季都是求职高峰期,机会固然增多,但筛选过程也更为严苛——人力资源专员通常仅用几十秒就能决定是否继续浏览一份简历。

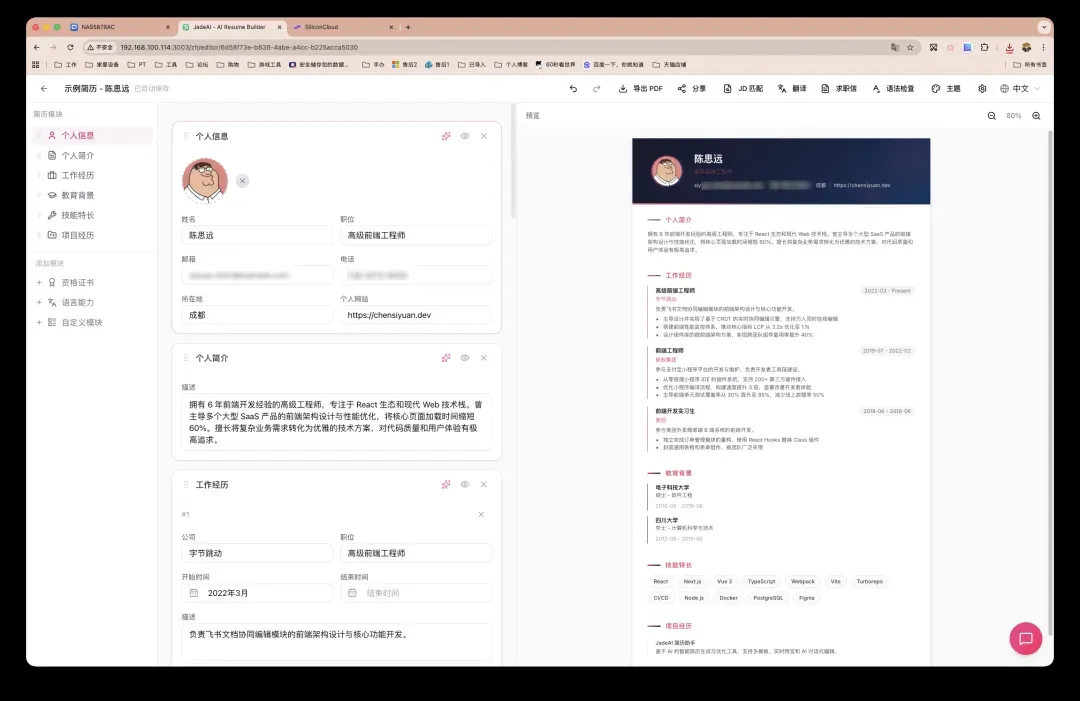

本期将分享一款我近期发现的AI简历辅助工具:JadeAI。它允许用户直接上传现有的简历PDF或图片文件进行解析,并基于人工智能的解读结果对简历结构与表达进行优化。该工具还具备职位描述匹配分析、求职信生成、语法与措辞检查等功能,并支持导出PDF、DOCX等多种格式,非常适合用于快速打磨简历至可投递状态。

项目概览

该项目为开源项目,完整名称可在GitHub上搜索:twwch/JadeAI。

以下是该工具的功能特性介绍,其设计既灵活又丰富。尽管功能众多,但部署过程却出乎意料地简单。

一、在线设计功能

- 拖拽排版:各模块支持自由移动与重新排列。

- 画布直改:点击即可编辑,上手速度极快。

- 50+ 模板:包含ATS友好型、时间线式、简约及商务等多种风格。

- 主题自定义:实时预览配色、字体、间距与页边距调整效果。

- 撤销/重做:最多支持50步操作历史记录。

- 自动保存:可设置自动保存频率,也支持手动即时保存。

二、AI智能功能

- AI 聊天助手:在编辑器内直接对话,支持多轮历史追溯。

- 一键生成简历:基于目标岗位、个人经历与技能生成完整简历内容。

- 简历解析:上传PDF或图片简历,自动提取并转换为可编辑结构。

- JD 匹配分析:提供关键词匹配度、ATS系统评分及具体改进建议。

- 生成求职信:结合简历与职位描述生成求职信,可选正式、友好或自信等语气。

- 写作质量检查:识别弱动词、模糊表达与语法问题,并给出综合评分。

- 多语言翻译:保留技术术语准确性,支持约10种语言互译。

- 模型接口灵活:兼容OpenAI、Anthropic或自定义API,用户可自行配置密钥。

三、导出与分享选项

- 多格式导出:支持PDF、DOCX、HTML、TXT及JSON格式导出。

- 链接分享:生成可分享的令牌链接,可选密码保护增强隐私。

- 浏览统计:查看简历被打开或访问的次数统计。

四、管理与用户体验

- 多简历看板:提供网格或列表视图,支持搜索与排序功能。

- 复制与重命名:快速创建简历不同版本并进行管理。

- 新手引导:首次使用时提供交互式操作指引。

- 双语界面:支持中英文语言切换;具备深色模式选项。

- 登录灵活:支持Google OAuth授权或浏览器指纹识别(无需配置)。

- 数据库可选:默认使用SQLite,也可适配PostgreSQL数据库。

部署步骤详解

以威联通NAS为例,通过Docker Compose方式部署JadeAI。

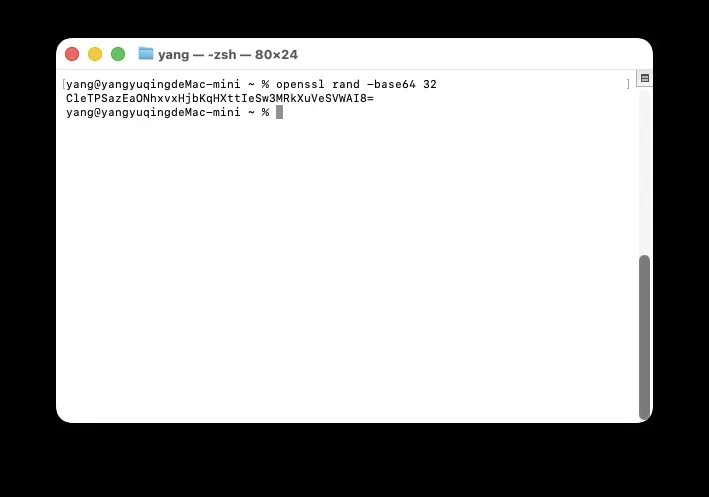

首先打开任意终端,输入以下命令生成一个Secret Key。

openssl rand -base64 32

# 以下示例密钥可供参考,实际使用中自定义更佳:CleTPSazEaONhxvxHjbKqHXttIeSw3MRkXuVeSVWAI8=

随后打开威联通的Container Station应用,创建新的应用程序。

部署代码如下所示:

services:

jadeai:

image: twwch/jadeai:latest

container_name: jadeai

ports:

- "3003:3000" # 左侧端口可根据需要自行修改

environment:

- AUTH_SECRET=CleTPSazEaONhxvxHjbKqHXttIeSw3MRkXuVeSVWAI8=

volumes:

- /share/Container/jadeai:/app/data

restart: always

实战使用指南

部署完成后,在浏览器中输入NAS_IP:3003即可访问JadeAI服务界面。其设计风格现代且美观。

JadeAI智能简历生成器完整部署与使用教程:AI驱动优化求职简历

JadeAI是一款基于人工智能技术的智能简历构建工具,旨在协助用户高效地创建和优化个人简历,从而提升求职成功率。它整合了先进的AI功能与直观的可视化编辑界面,让简历制作过程变得更加简单和个性化。

核心功能特性详解

JadeAI提供了全面而强大的功能集,覆盖简历编辑、AI增强、导出分享和管理等多个方面,具体包括:

1. 简历编辑功能

- 拖拽编辑器:通过可视化拖放操作,自由排列简历的各个模块和条目,布局调整直观便捷。

- 行内编辑:点击简历画布上的任意字段,即可直接进行编辑,实现所见即所得的修改体验。

- 50套专业模板:提供丰富多样的简历模板选择,涵盖经典、现代、极简、创意、ATS友好、时间线、北欧风、瑞士风等多种设计风格。

- 主题定制:实时调整简历的颜色方案、字体样式、间距和页边距,并即时预览效果,满足个性化审美需求。

- 撤销/重做:支持完整的编辑历史记录,最多可回溯50步操作,确保编辑过程安全无忧。

- 自动保存:可配置自动保存的时间间隔(范围从0.3秒到5秒),同时也支持用户手动触发保存,防止数据丢失。

2. AI智能能力

- AI聊天助手:编辑器内集成对话式AI助手,支持多个独立会话并保存聊天历史,可随时咨询简历优化建议。

- AI一键生成简历:只需输入目标职位、个人经验和技能关键词,AI便能自动生成结构完整、内容专业的简历草稿。

- 简历解析:上传现有的PDF或图片格式简历,AI能够自动识别并提取其中的全部文字内容,方便快速导入和编辑。

- JD匹配分析:将您的简历与招聘职位描述进行智能对比,分析关键词匹配度、提供ATS系统评分并给出具体的改进建议。

- 求职信生成:基于您的简历内容和职位描述,AI自动生成定制化的求职信,并允许用户选择正式、友好或自信等不同语气。

- 语法与写作检查:自动检测简历文本中的弱动词、模糊描述和语法错误,并提供整体写作质量评分。

- 多语言翻译:支持在10种常用语言之间进行互译,同时能保留专业术语的原意,助力国际化求职。

- 灵活AI供应商:支持接入OpenAI、Anthropic等主流AI服务,也允许配置自定义API端点;用户可在应用内自行管理API密钥。

3. 导出与分享选项

- 多格式导出:支持导出为PDF(采用Puppeteer和Chromium引擎渲染)、智能单页PDF(自动优化内容以适应一页)、DOCX、HTML、TXT及JSON格式。

- JSON导入:可以导入先前导出的JSON文件,用以还原简历或创建新简历;在编辑器中导入会覆盖当前内容,在仪表盘导入则会创建新简历。

- 链接分享:生成基于Token的安全分享链接,并可选择添加密码保护,方便安全地向他人展示简历。

- 浏览统计:自动追踪并统计通过分享链接查看您简历的次数,了解简历的关注度。

4. 简历管理工具

- 多简历仪表盘:提供网格和列表两种视图模式,支持按名称搜索以及按创建日期或名称进行排序,方便管理多个简历版本。

- JSON导入创建:直接在仪表盘界面通过上传JSON文件来快速创建新的简历项目。

- 复制与重命名:提供快捷操作来复制现有简历或对其进行重命名,简化简历版本管理流程。

- 新手引导:内置交互式分步引导教程,帮助新用户快速熟悉核心功能和操作流程。

5. 其他实用特性

- 双语界面:提供完整的中文(zh)和英文(en)用户界面,满足不同语言用户的使用习惯。

- 暗色模式:支持浅色、深色以及跟随系统设置三种主题模式,保护视力并提升阅读舒适度。

- 灵活认证:支持通过Google OAuth进行账户登录,也提供基于浏览器指纹的零配置匿名使用方式。

- 双数据库支持:默认使用无需配置的SQLite数据库,也支持切换至更强大的PostgreSQL数据库以满足进阶需求。

详细安装步骤:Docker Compose部署JadeAI

使用Docker Compose是部署JadeAI最便捷的方式。只需创建一个docker-compose.yml文件,并填入以下配置内容:

services:

jadeai:

image: twwch/jadeai:latest

container_name: jadeai

ports:

- 3000:3000

environment:

- AUTH_SECRET=9xiV4uOJyvtYGj4i

volumes:

- ./data:/app/data

restart: always

关键参数说明:

AUTH_SECRET(环境变量):此密钥用于会话加密,建议使用命令openssl rand -base64 32生成一个更安全的随机字符串进行替换。/app/data(卷挂载路径):此目录用于持久化存储JadeAI的配置文件和应用数据,确保容器重启后数据不丢失。

保存文件后,在终端中运行 docker-compose up -d 命令即可启动服务。更多高级配置参数建议查阅官方文档。

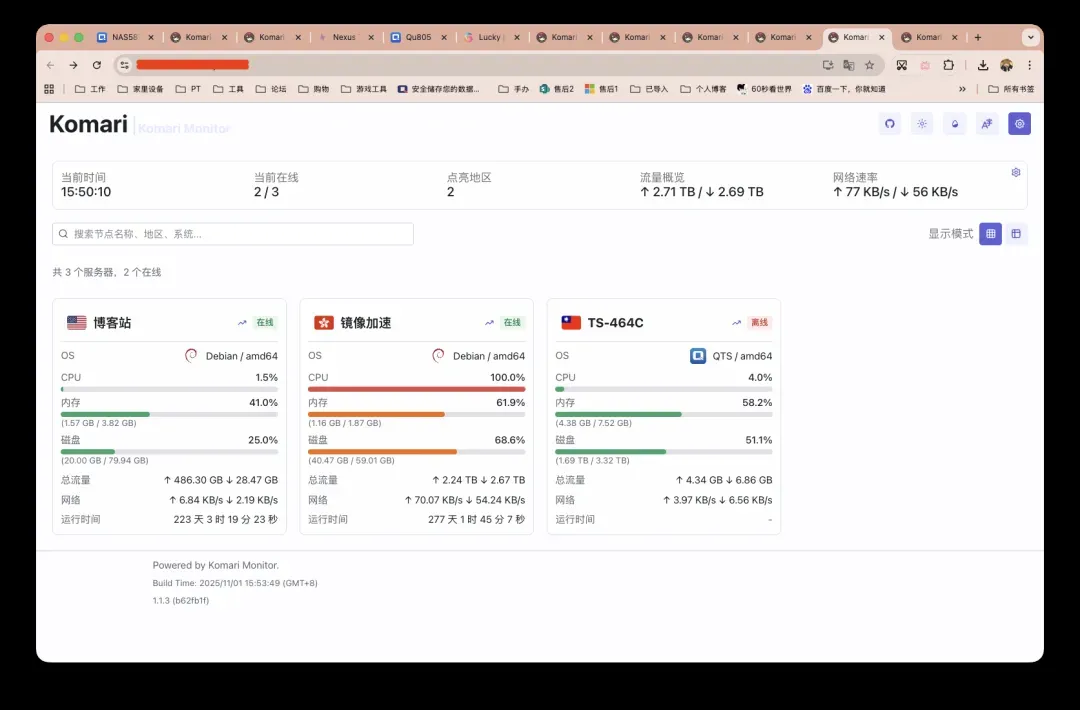

Komari Docker一键部署:集中监控多台服务器的自托管方案

Komari 是一款设计轻巧的自托管服务器监控工具,其核心目标是提供一套简洁且高效的服务器性能监控方案。它允许用户通过 Web 界面直观地查看服务器运行状态,并借助轻量级的代理程序(Agent)来收集各项性能数据。

本文不会深入探讨每一个功能细节,而是直接给出核心结论:

对于个人用户而言,Komari 大约 95% 的实际价值,在于它能够“将分散在不同地点的服务器统一收纳到一个管理面板中进行管理”。这尤其体现在集中查看状态、快速定位目标机器以及便捷地进行 SSH 登录这些日常操作上。

本文将逐步演示如何通过 Docker 快速部署 Komari。您可以使用一台 NAS(网络附加存储)设备作为管理中枢,将所有服务器的监控信息整合到一个统一的仪表盘中,从而将其打造为日常运维和访问服务器的便捷入口。

Komari的核心特性

轻量高效:运行时资源占用极低,能够适应各种规模和服务器的资源条件。 自托管:所有监控数据完全由您自己掌控,保障了隐私安全,且部署过程简单明了。 Web 界面:提供了直观易懂的监控仪表盘,用户无需复杂学习即可上手使用。

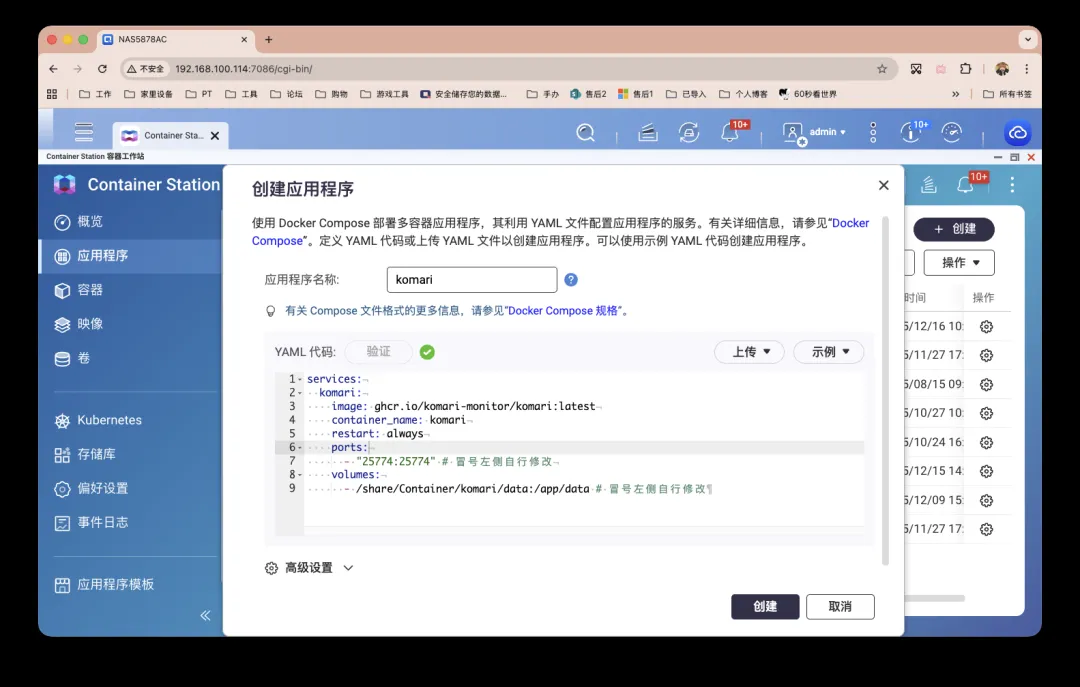

部署流程

以下以威联通(QNAP)NAS为例,介绍通过 Docker Compose 方式进行部署的具体步骤。

首先,您需要准备一份 Docker Compose 配置文件,其内容如下:

services:

komari:

image: ghcr.io/komari-monitor/komari:latest

container_name: komari

restart: always

ports:

- "25774:25774" # 冒号左侧的端口号可根据需要自行修改

volumes:

- /share/Container/komari/data:/app/data # 冒号左侧的路径请根据您的NAS实际情况修改

接下来,打开威联通 NAS 系统中的 Container Station 应用。点击创建新的应用程序,并将上述配置代码粘贴到相应的编辑区域中。

此外,项目作者也为使用 systemd 初始化系统的 Linux 发行版(如 Ubuntu、Debian 等)提供了一键安装脚本,方便在这些系统上直接安装 Komari Agent。

curl -fsSL https://raw.githubusercontent.com/komari-monitor/komari/main/install-komari.sh -o install-komari.sh

chmod +x install-komari.sh

sudo ./install-komari.sh

使用展示

按照上述步骤成功部署 Komari 服务端后,在浏览器地址栏输入 您的NAS_IP地址:25774 即可访问 Komari 的 Web 管理界面。初次访问时,浏览器可能会提示连接非 HTTPS(不安全),在内网环境中这通常可以忽略。但如果您计划通过外网访问,强烈建议设置反向代理并配置 SSL 证书以确保安全。

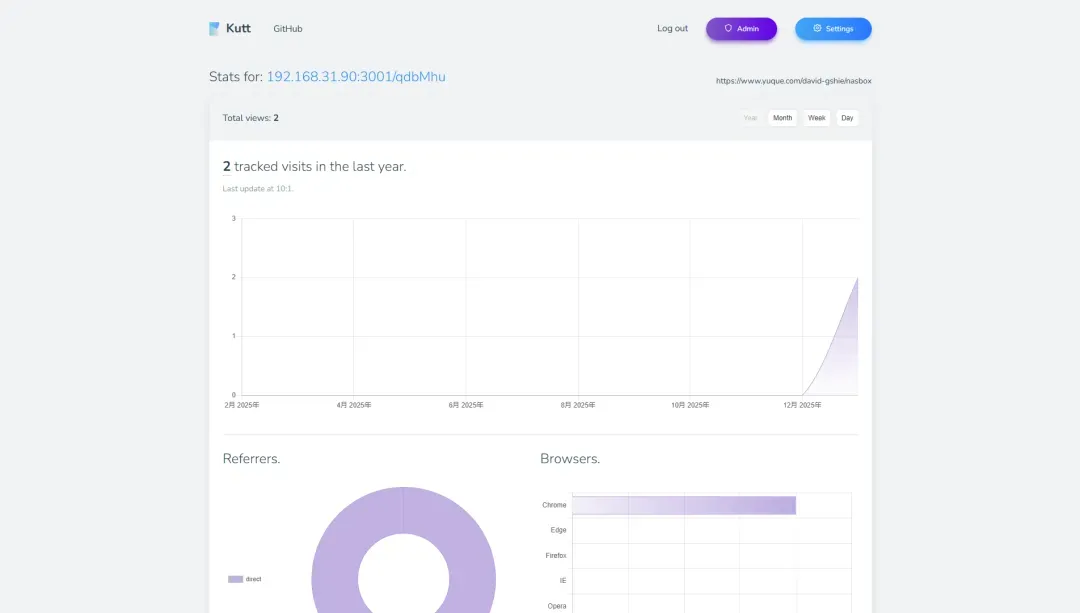

Kutt短链接部署全攻略:2分钟快速上手与详细教程

Kutt 是一款功能强大的现代开源URL缩短器。它不仅支持自定义域名,还提供了链接创建与编辑、访问统计查看以及用户管理等一系列实用功能。

主要特点:

-

自托管适配性强

- 零配置快速启动,无需额外构建步骤。

- 数据库支持:默认使用SQLite(无需安装),也可选择Postgres或MySQL/MariaDB。

- 缓存支持:可选Redis以提升性能。

- 权限管控:可禁用用户注册、关闭匿名链接生成,并支持OpenID Connect (OIDC)登录。

-

丰富的自定义能力

- 自定义域名:支持绑定自有域名生成短链接。

- 链接精细化配置:可为短链接设置自定义URL、访问密码、描述和过期时间。

- 链接管理:支持查看、编辑和删除已生成的链接。

-

统计与管理

- 私有统计:短链接的访问数据仅对创建者或管理员可见。

- 管理员面板:支持后台管理用户,并审核或操作所有链接。

-

其他能力

- 主题定制:支持界面主题自定义。

- RESTful API:提供完整的接口,便于集成到其他系统。

安装步骤

通过 Docker Compose 可以快速部署 Kutt。以下是一个基本的配置示例:

services:

kutt:

image: kutt/kutt:latest

container_name: kutt

ports:

- 3000:3000

volumes:

- ./db_data_sqlite:/var/lib/kutt

- ./custom:/kutt/custom

environment:

- DB_FILENAME=/var/lib/kutt/data.sqlite

- JWT_SECRET=sk-xxxxx

- DEFAULT_DOMAIN=192.168.31.90:3000

restart: always

关键环境变量说明:

DB_FILENAME:指定SQLite数据库文件的存储路径。JWT_SECRET:用于签署身份验证令牌,建议使用长且随机的字符串。DEFAULT_DOMAIN:设置您的域名或IP地址及端口。

更多高级参数配置建议参考官方文档以获得最佳实践。

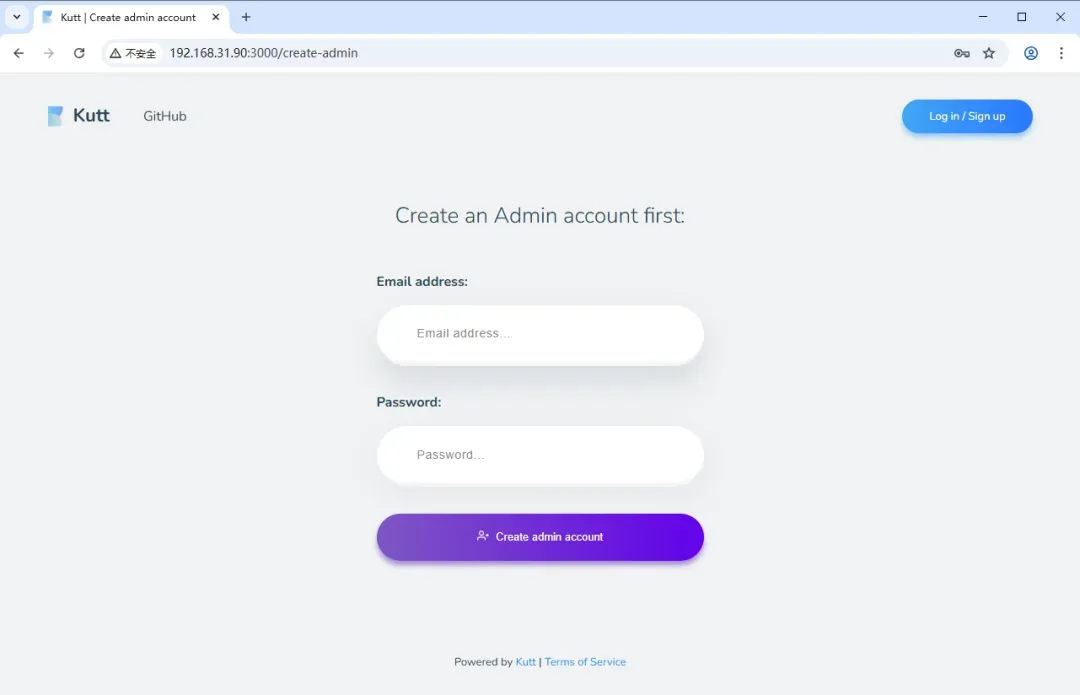

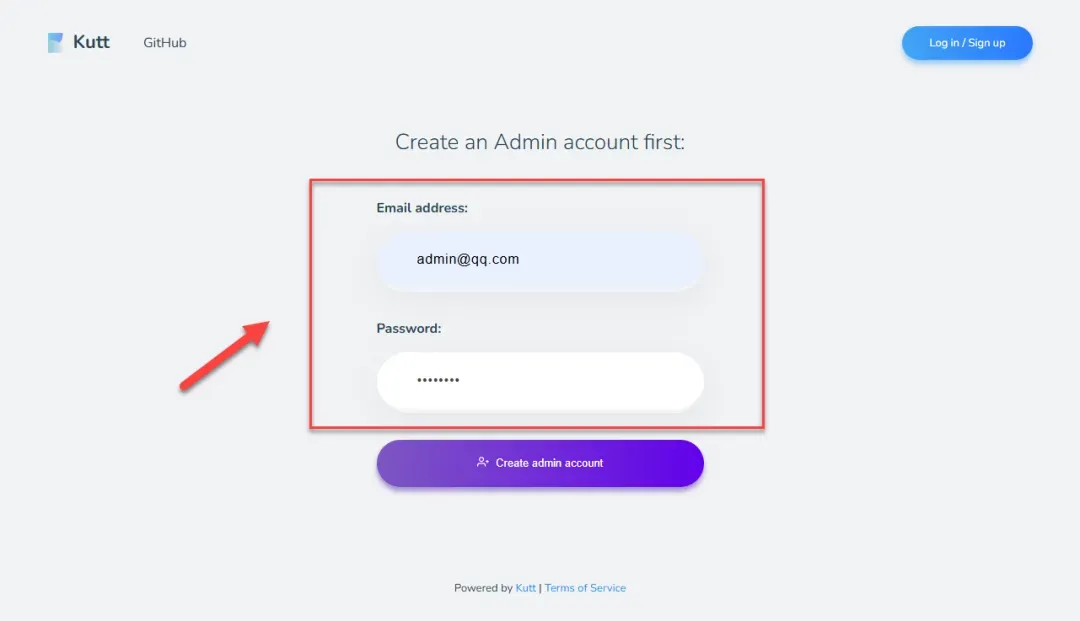

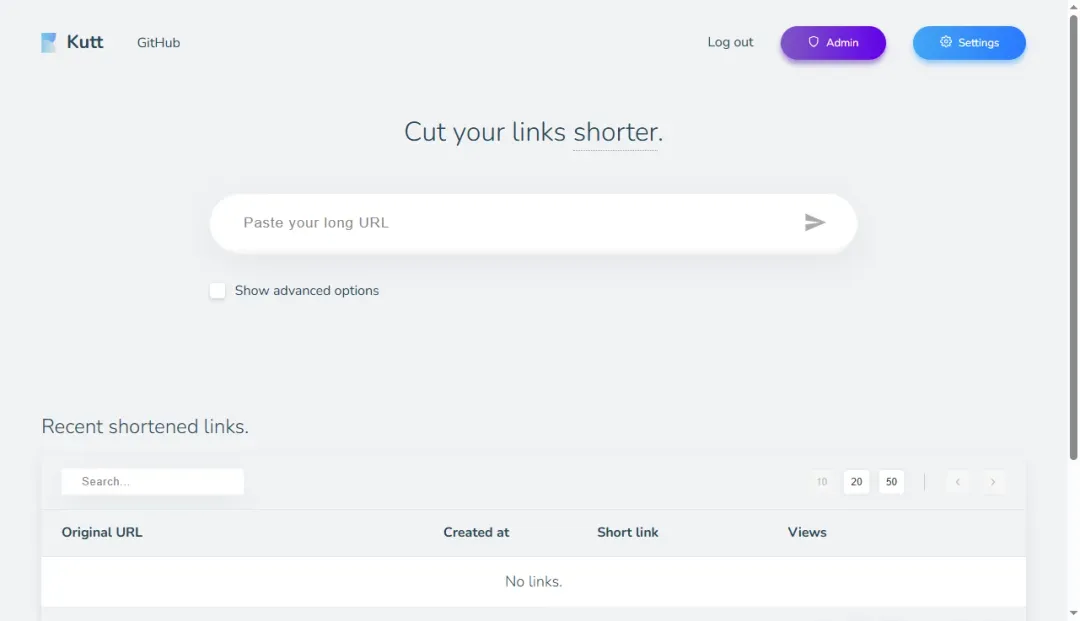

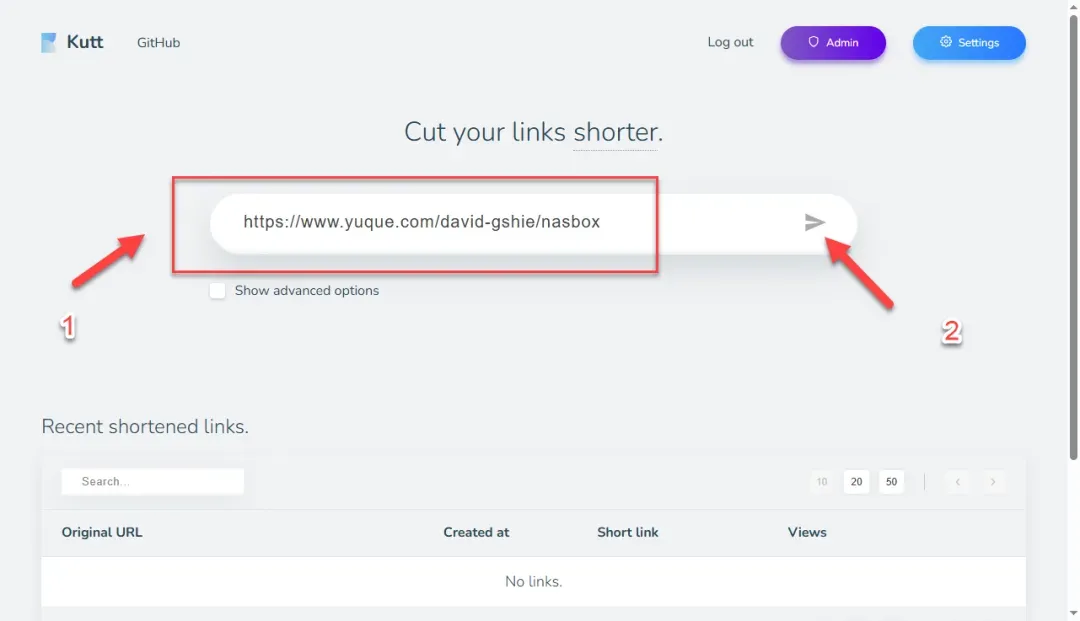

使用指南

部署完成后,在浏览器中访问 http://您的服务器IP:3000 即可看到Kutt的初始界面。

首先,根据页面提示创建一个管理员账号。

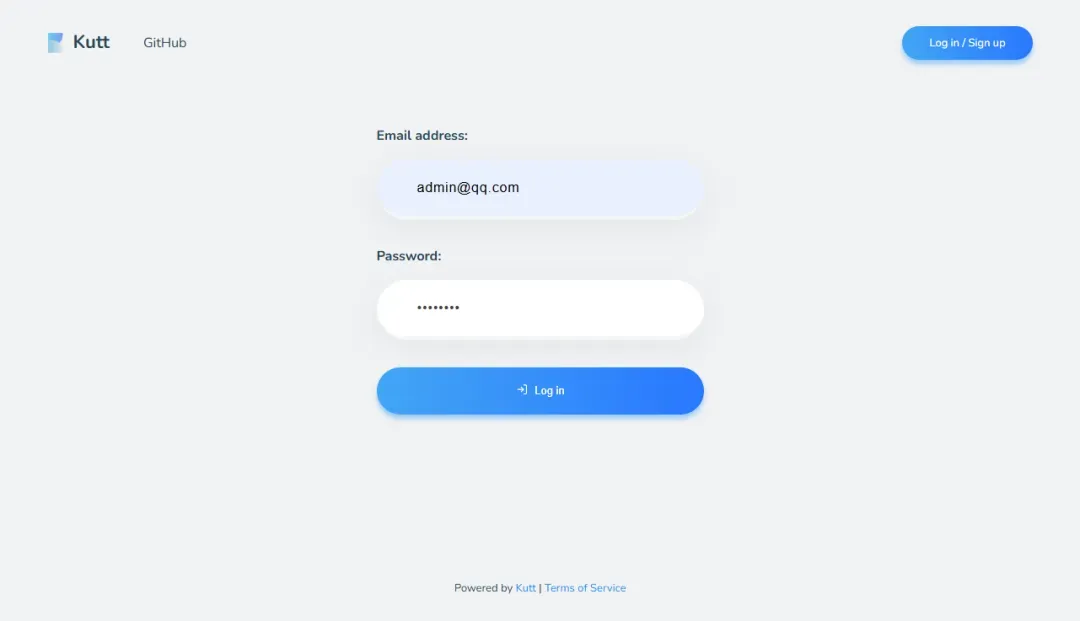

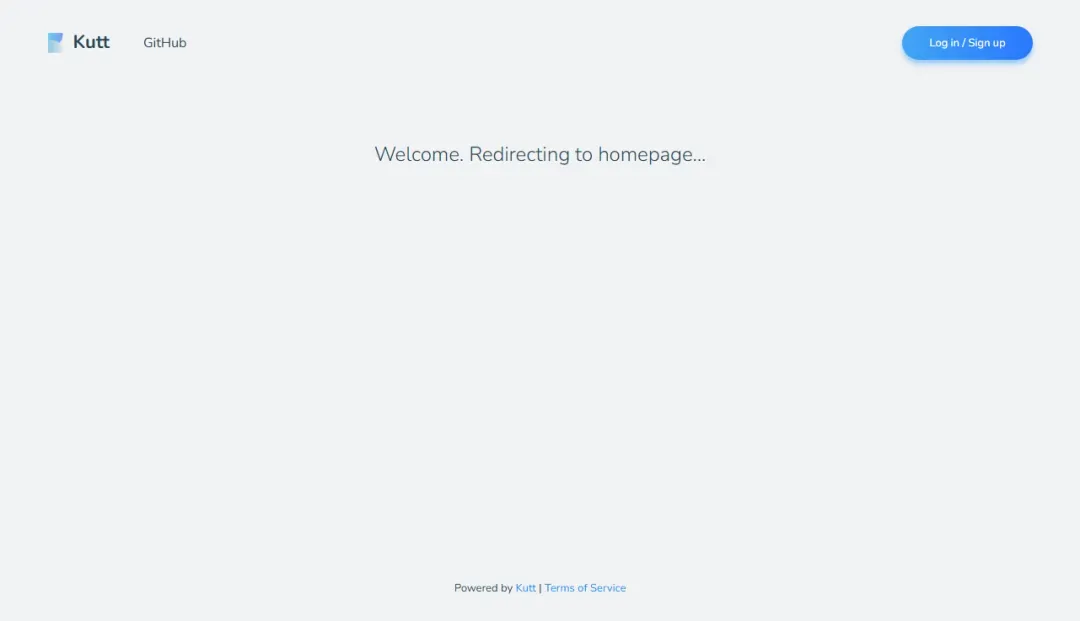

账号创建成功后,使用该账号登录系统。

注意: 为了确保所有功能正常工作,建议通过HTTPS访问管理界面。例如,可以通过反向代理将3000端口映射到3001等HTTPS端口,避免跳转问题。

登录后的管理面板设计简洁,下面简要介绍基本使用方法。

在输入框中粘贴一条长URL,然后点击提交按钮。

KVideo一键部署完整指南:替代LibreTV的现代视频聚合平台

近年来,类似MoonTV和LibreTV的视频播放聚合平台项目层出不穷,数量显著增多。

这些早期项目通常内置视频源,部署完成后即可直接观看。而后续涌现的OmniBox、冬瓜TV、MoonTVPlus等平台,虽然功能更加强大、界面更为美观、使用也更加便捷,但多数属于空壳应用,需要用户自行导入视频源才能正常使用。

至于这些平台不内置视频源的原因,大家应该都心知肚明。

本期内容将介绍一个新项目:KVideo,它可以作为LibreTV的替代品。这个平台不仅能观看常规内容,还提供了高阶用法。关于订阅信息和高阶用法的详细内容,可通过文末提示获取。

项目概述

完整项目名称是KuekHaoYang/KVideo。该项目兼容ARM和X86这两种主流处理器架构。

KVideo是一款高性能、现代化的视频聚合与播放应用,致力于提供卓越的用户体验和视觉设计。项目采用Next.js 16的最新特性,结合React 19和Tailwind CSS v4,构建了一个既美观又功能强大的视频浏览平台。

主要特性与功能

以下内容根据项目主页进行了精简和总结。

🎥 智能视频播放器

支持HLS流媒体播放,具备缓存和后台下载功能,提供断点续播、倍速播放、全屏模式等完整的播放控制选项,并针对移动设备进行了深度优化。

🔍 多源并行搜索系统

能够同时搜索多个视频源,支持自定义源管理和统一解析,提供搜索历史记录以及多维度的结果排序功能。

🎬 豆瓣信息集成模块

自动获取豆瓣评分、演员信息、剧情简介和相关推荐,让用户在观看前对内容有全面了解。

💾 本地观看历史管理

在本地记录观看进度和历史记录,支持断点续播和一键清理功能,所有数据均不上传服务器,充分保障用户隐私。

📱 全端响应式界面设计

适配桌面和移动设备,触控操作友好,并优先优化移动端的使用体验。

🌙 主题与无障碍辅助功能

支持深色和浅色模式切换,符合WCAG无障碍标准,提供完整的键盘操作支持和高对比度显示选项。

详细部署步骤

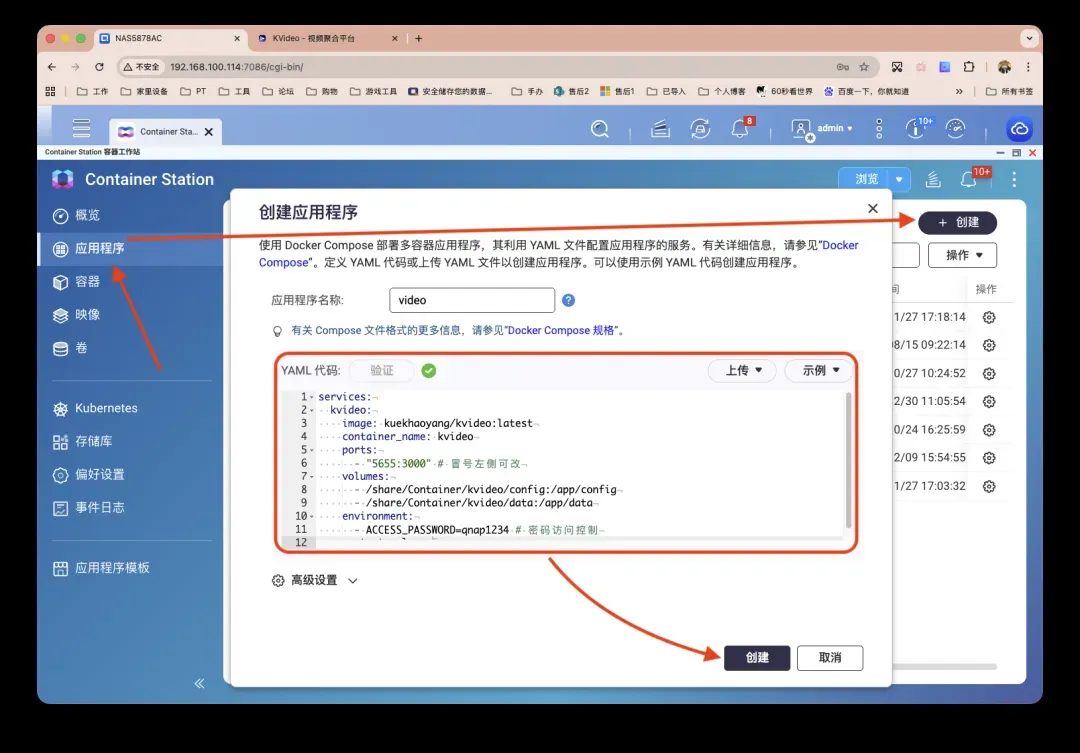

以威联通NAS为例,通过Docker Compose方式部署KVideo。

部署代码如下所示:

services: kvideo: image: kuekhaoyang/kvideo:latest container_name: kvideo ports: - "5655:3000" # 冒号左侧可改 environment: - ACCESS_PASSWORD=qnap1234 # 密码访问控制 restart: always

将上述代码根据个人需求修改后,打开威联通的Container Station应用,创建新的应用程序。

实际操作与界面展示

视频源的相关信息,请参考文末提示。

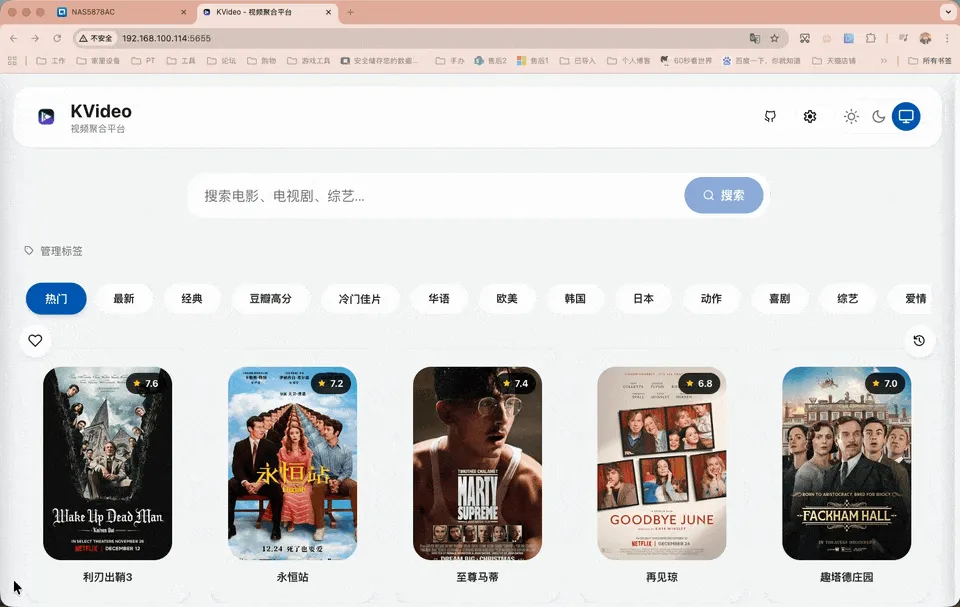

按照上述代码部署完成后,在浏览器中输入NAS_IP:5655即可访问服务。由于设置了访问控制,首次访问需要输入预设密码。

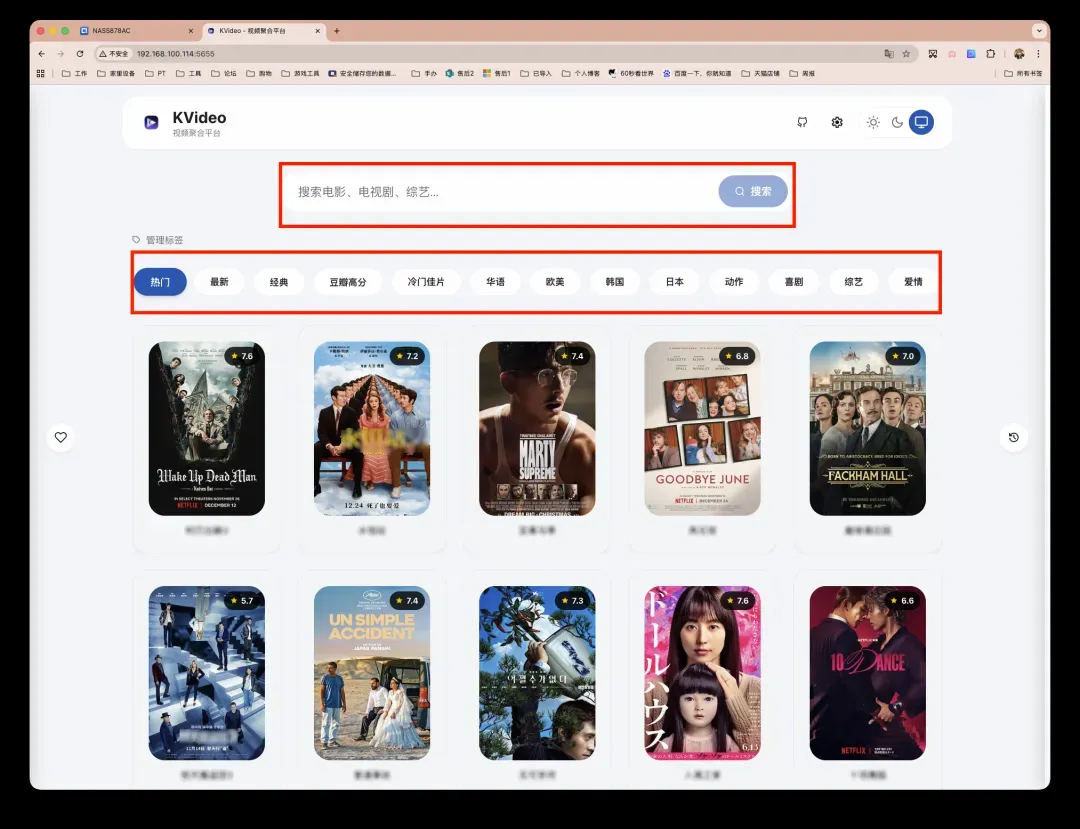

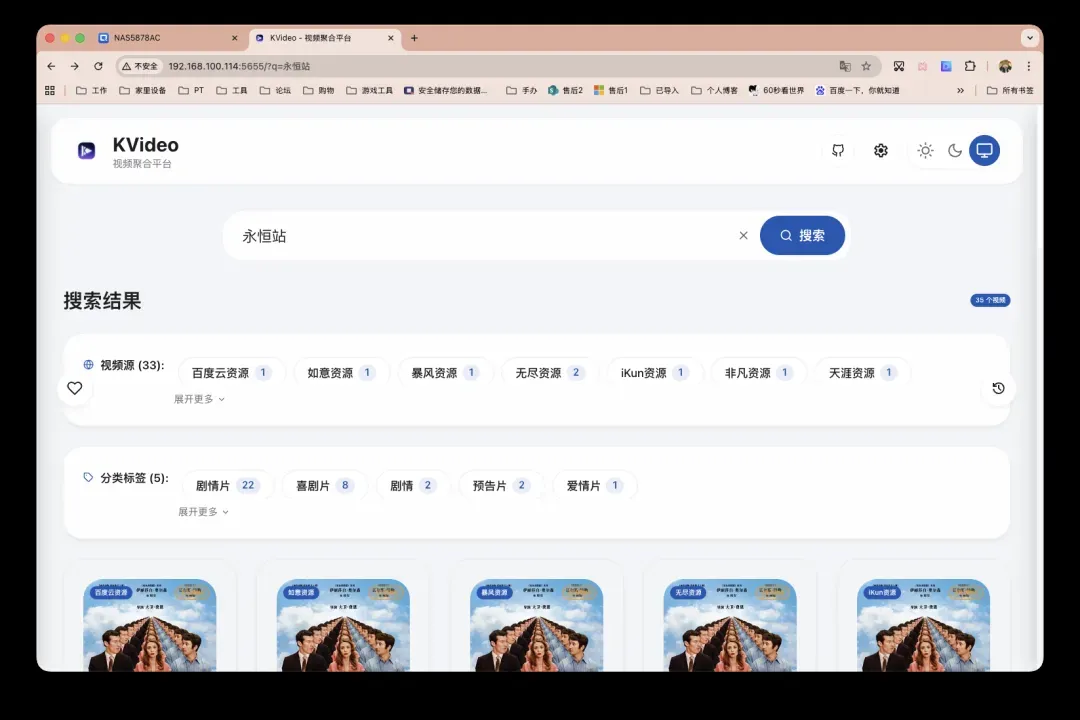

登录后界面如下图所示。平台支持搜索功能、热门分类浏览,右侧还设有观看历史按钮。

随意点击一个分类或视频,但由于尚未配置视频源,页面不会显示任何内容。

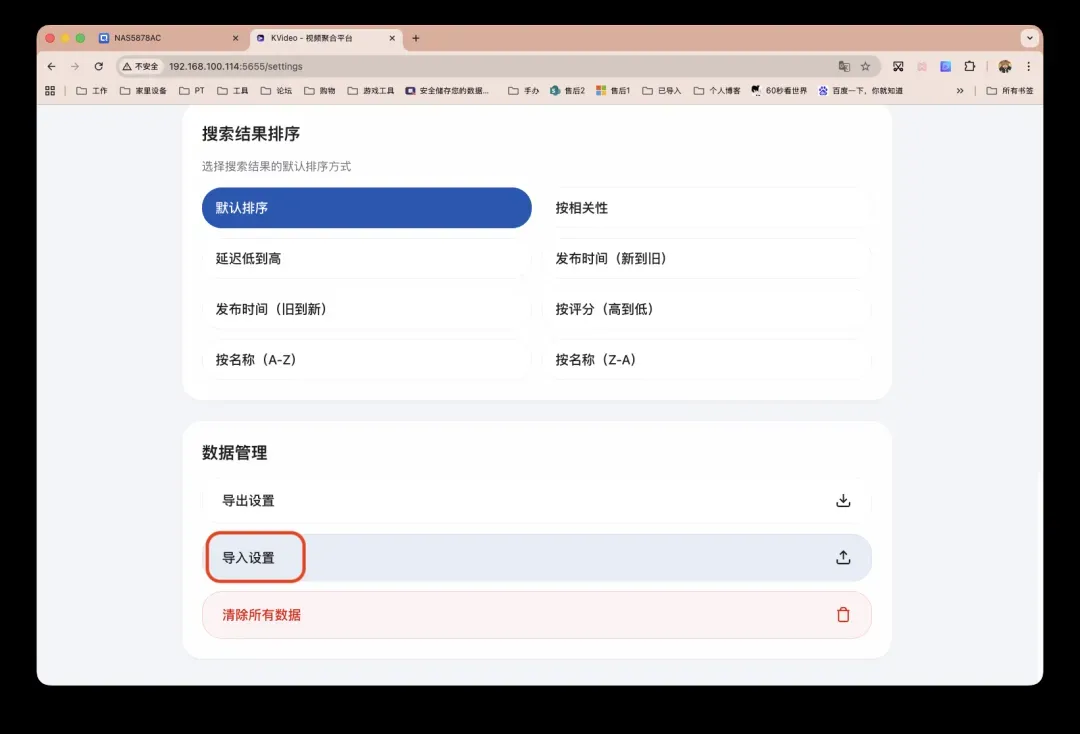

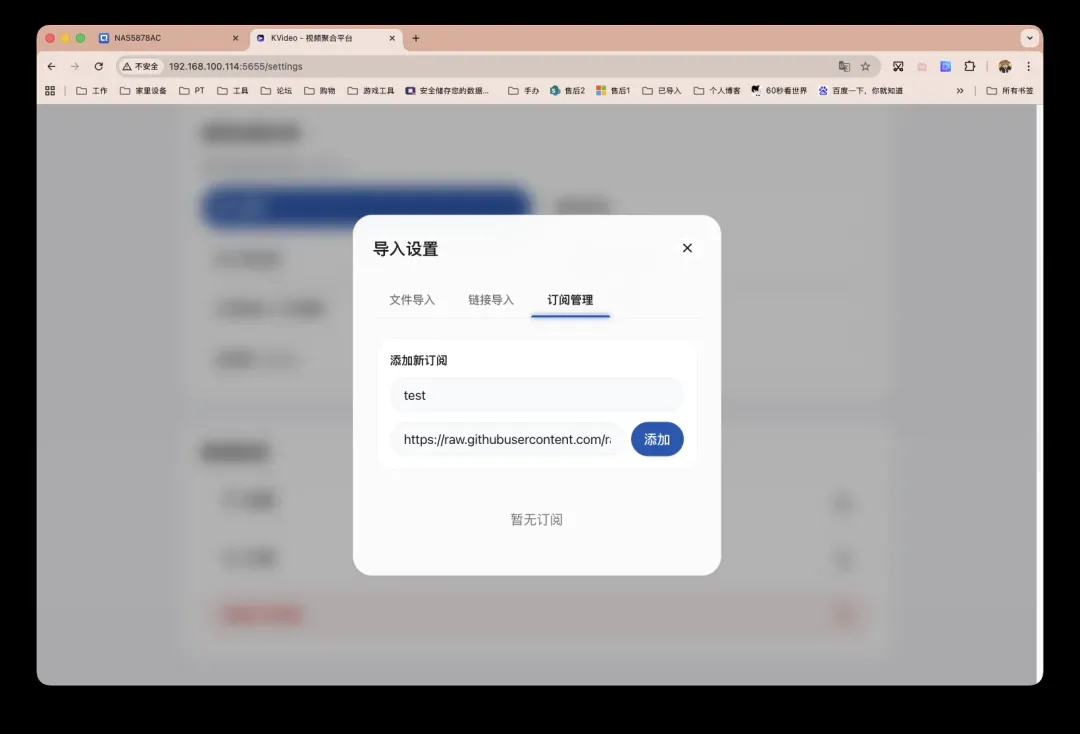

接下来点击右上角的齿轮图标进入配置界面。滚动到底部,点击“导入设置”选项。

在“订阅管理”部分,填写订阅名称,在订阅链接栏输入通过提示获取的内容,然后点击“添加”按钮即可完成配置。

返回首页后,再次点击相同内容,视频列表就会正常显示,延迟较低的源会自动排列在前。浏览常规内容时,可以发现其视频源与之前介绍的其他平台相差不大。

LamaCleaner AI图像修复工具:一键去除水印的完整部署与使用教程

Lama Cleaner 作为一款免费开源的图像修复工具,其核心基于当前最为先进的人工智能模型构建而成,能够高效处理多种图像修改任务。

部署安装指南

通过 Docker Compose 可以便捷地部署 Lama Cleaner 服务。以下是一个基础的配置示例:

services:

lama-cleaner:

image: cwq1913/lama-cleaner:cpu-1.2.5

container_name: lama-cleaner

command: lama-cleaner --device=cpu --port=8080 --host=0.0.0.0

ports:

- 8080:8080

volumes:

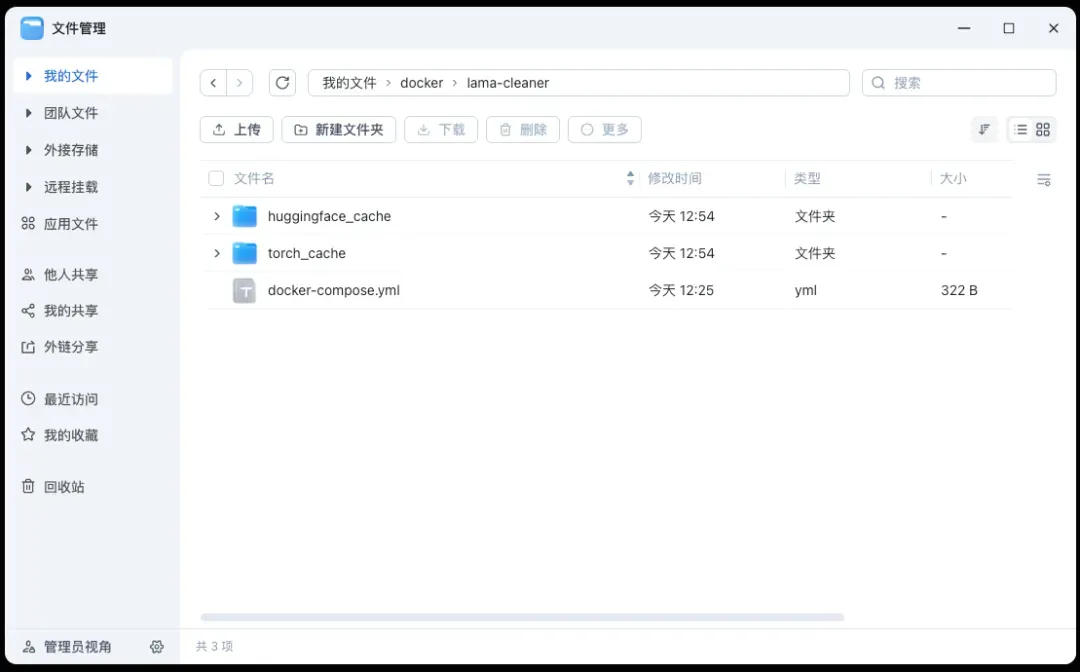

- ./torch_cache:/root/.cache/torch

- ./huggingface_cache:/root/.cache/huggingface

restart: always

针对配置中的关键参数进行简要说明(如需了解更多细节,建议查阅官方文档):

:::

device(命令参数):用于指定工具的运行环境,例如 CPU 或 GPU。

port(命令参数):用于设定服务访问的端口号。

/root/.cache/torch(卷映射路径):此目录用于存放 Lama、LDM、Zits、MAT、FCF 等核心模型文件。

/root/.cache/huggingface(卷映射路径):此目录则用于存放 Stable Diffusion 1.5 等相关模型。

:::

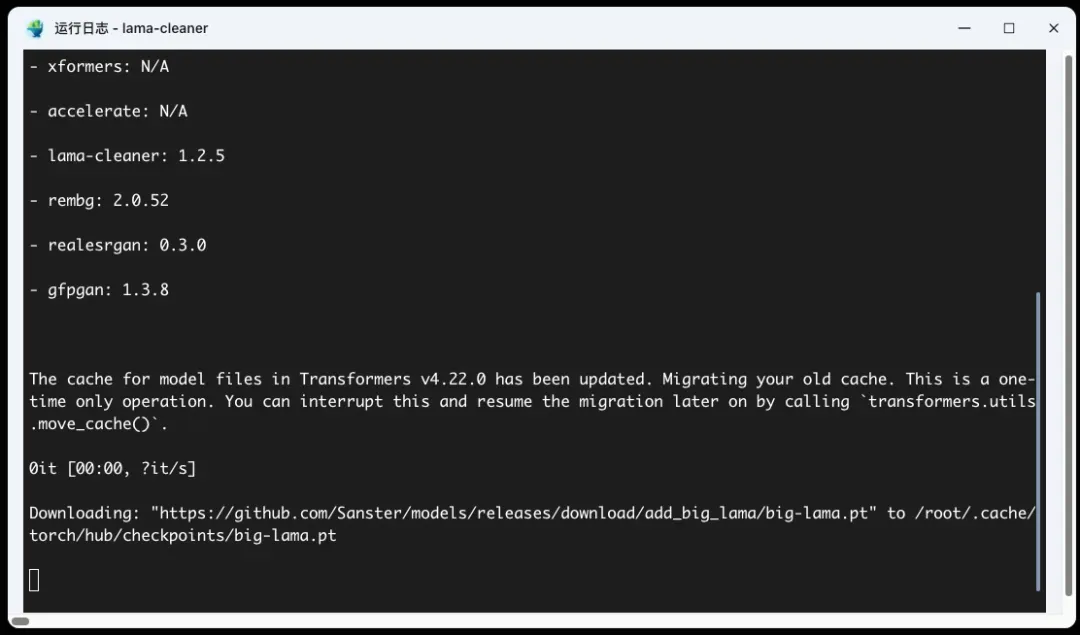

容器首次运行启动后,系统会自动尝试下载所需的模型文件。如果您的网络环境导致下载不畅,可以参考后续步骤进行手动下载。

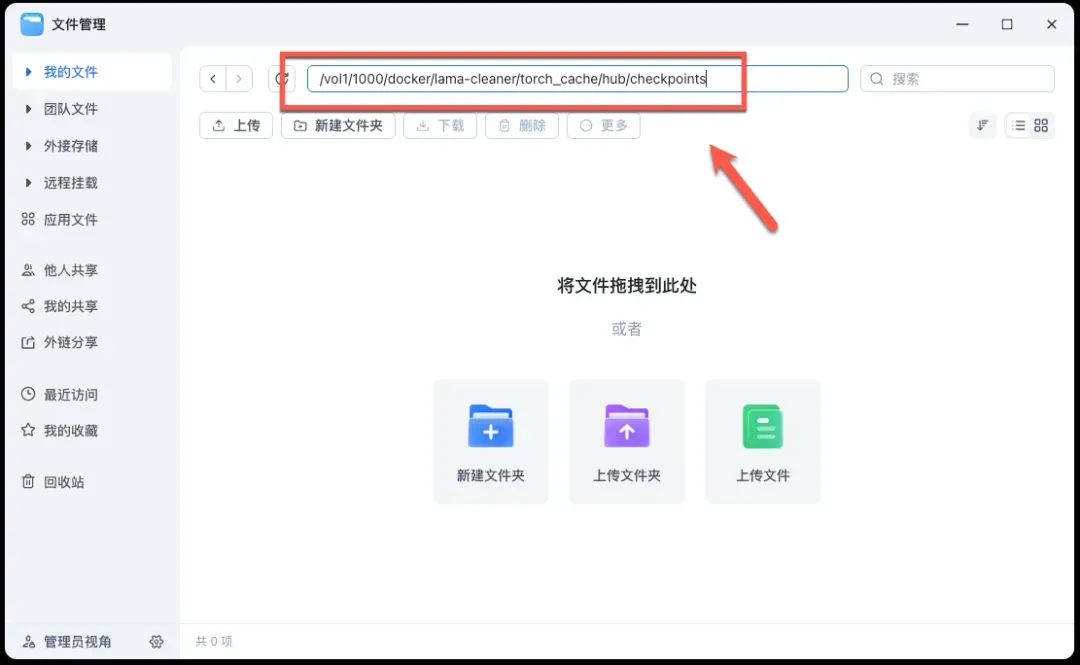

首先需要暂停并关闭正在运行的容器实例,然后进入在宿主机上对应的数据卷映射目录。

在目录结构中定位到 /torch_cache/hub/checkpoints 这个子目录(如果该目录内已存在文件,可以将其清空以便后续操作)。

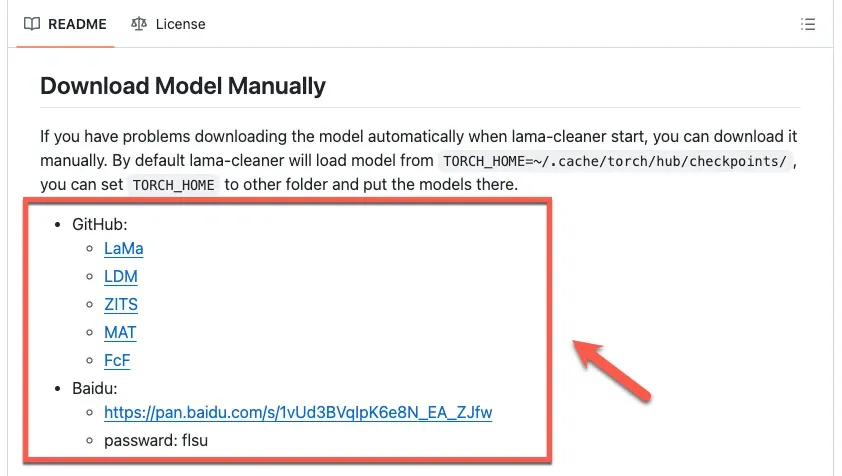

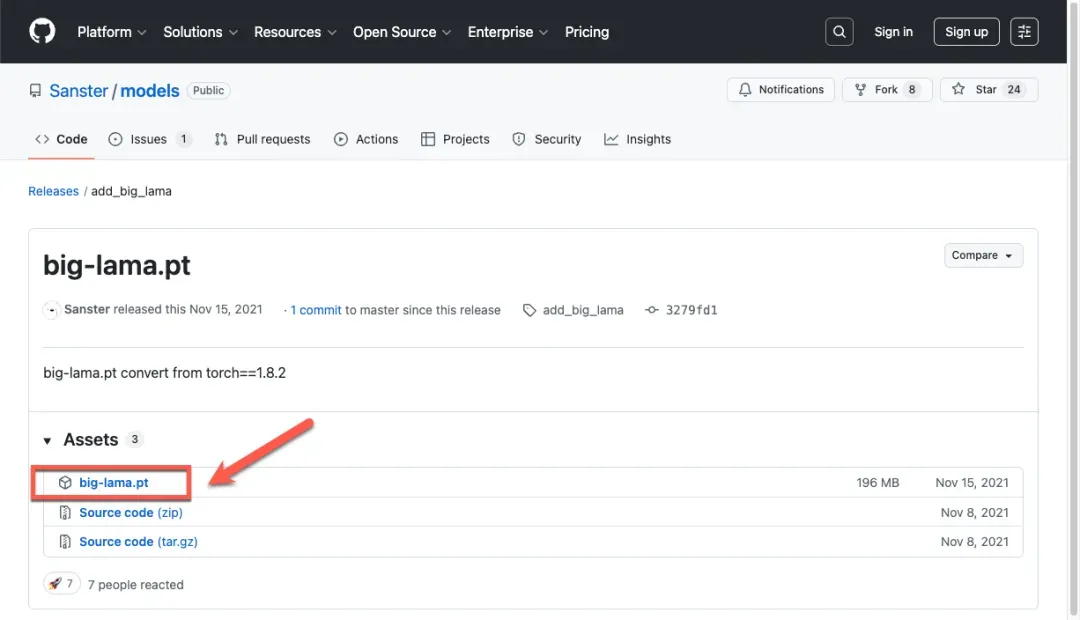

接下来访问项目的 GitHub 仓库页面(网址为:https://github.com/guocuixia/lama-cleaner-)以下载模型文件。

对于基础的水印去除功能,通常只需要下载 LaMa 模型文件即可(其他模型可根据个人实际需求选择下载)。

将下载得到的 .pt 格式模型文件,放置到之前定位的 checkpoints 文件夹内。

Log-Lottery抽奖系统:5分钟部署年会3D球体抽奖全攻略

Log-Lottery是一款高度可配置和定制化的抽奖应用程序,以其炫酷的3D球体抽奖效果而著称,尤其适用于年会抽奖等庆典活动。它支持奖品管理、人员名单配置、界面自定义、图片和音乐设置等多项功能,提供完整的解决方案。

该系统具备以下核心功能特点:

- 🕍 炫酷3D球体效果,专为年会抽奖设计,开箱即用,无需复杂设置。

- 💾 支持本地持久化存储,确保数据安全可靠,避免丢失。

- 🎁 灵活配置奖品和奖项,可根据活动需求自定义。

- 👱 管理抽奖人员名单,支持批量导入和编辑。

- 🎼 内置背景音乐播放功能,增强活动氛围。

- 🖼️ 通过Excel表格导入人员名单,抽奖结果也可用Excel格式导出,便于后续处理。

- 🎈 允许临时增加抽奖环节,适应突发需求。

- 🧨 支持国际化多语言界面,满足不同地区使用。

- 🍃 可更换背景图片,提升视觉定制化。

- 🚅 提供Docker容器化构建,简化部署流程。

- 😘 弹幕功能目前处于开发阶段,未来将增强互动性。

- 🧵 卡片可组合成多种形状,增加抽奖显示的多样性。

快速安装指南

通过Docker Compose可以轻松部署该系统。以下是一个示例配置文件,用于快速启动服务:

services:

log-lottery:

image: log1997/log-lottery:latest

container_name: log-lottery

ports:

- 9279:80

restart: always

运行此配置后,服务将在端口9279上启动,实现一键部署。

系统配置与使用详解

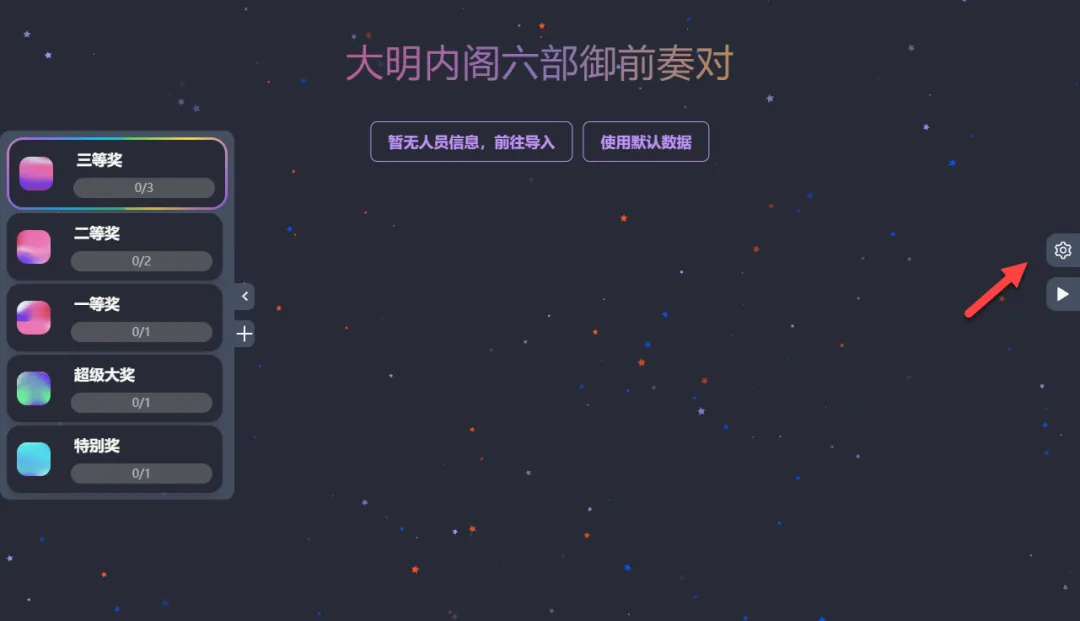

在浏览器中输入 http://NAS的IP:9279/log-lottery/ 访问系统界面。请注意,确保访问链接正确无误,以进入主页面。

首先,点击界面右侧的设置按钮,开始配置系统参数。

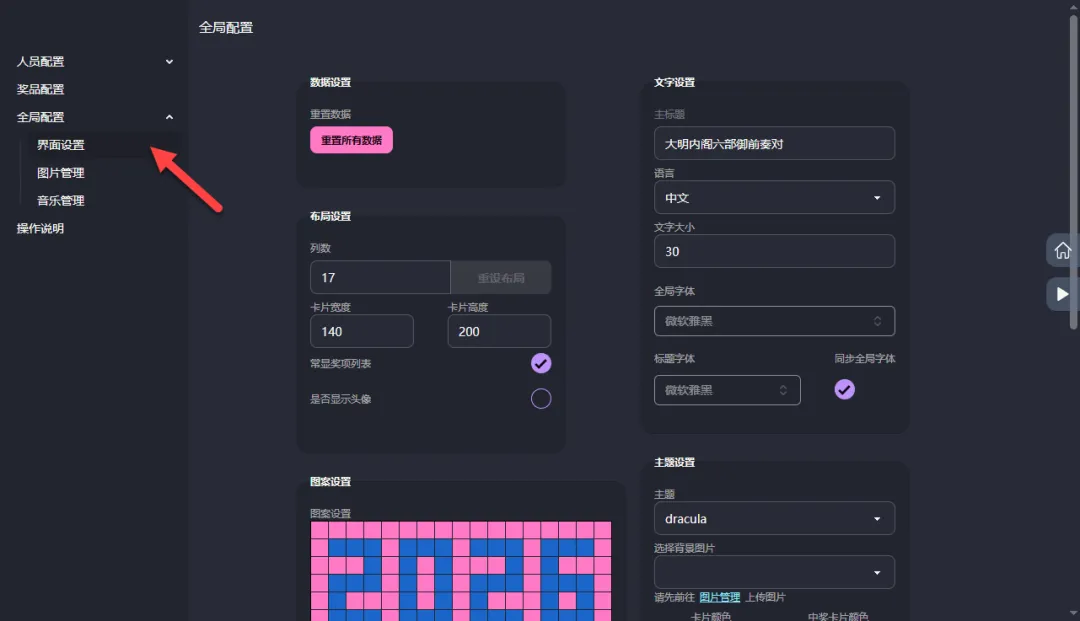

进入全局配置菜单后,选择界面设置选项。

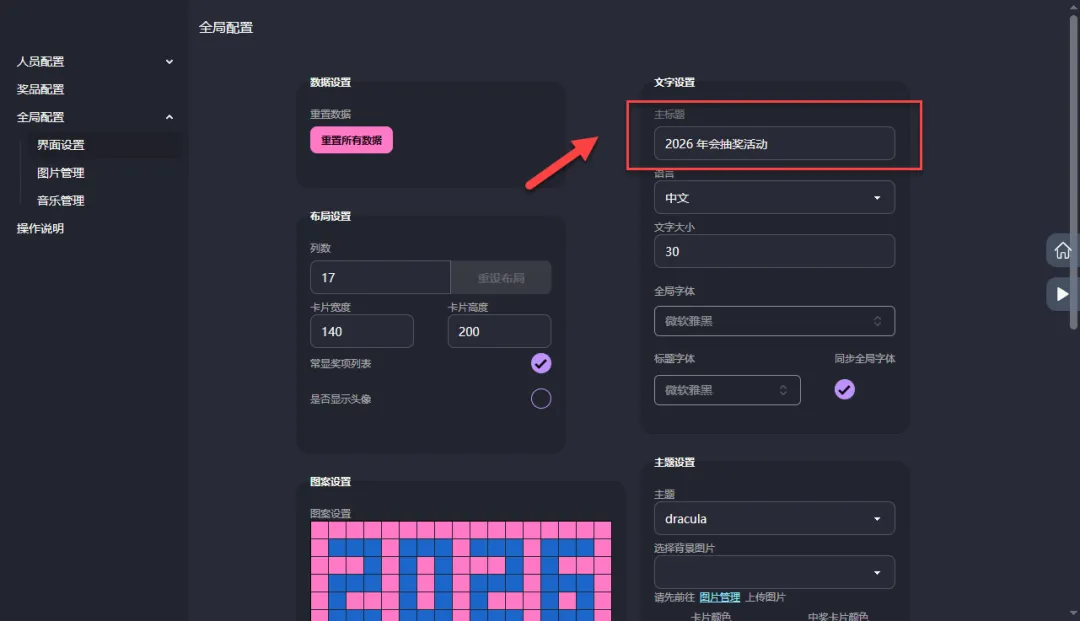

在此处,您可以修改活动名称和主题,使其更贴合您的活动主题。

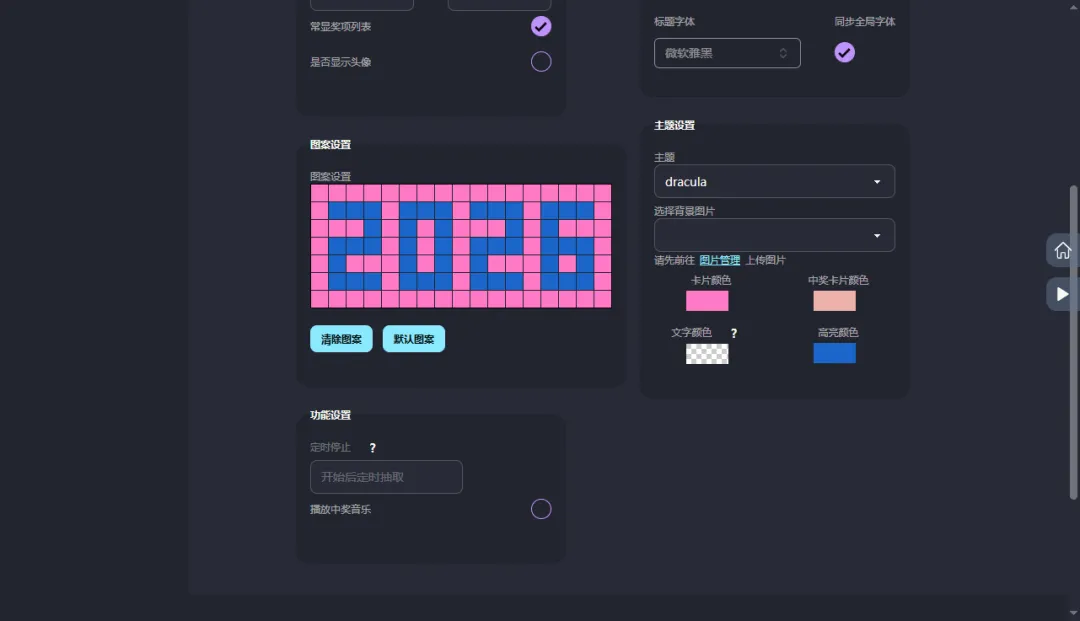

此外,根据品牌LOGO,您可以调整主题颜色,提升视觉定制化效果,让系统外观更具个性。

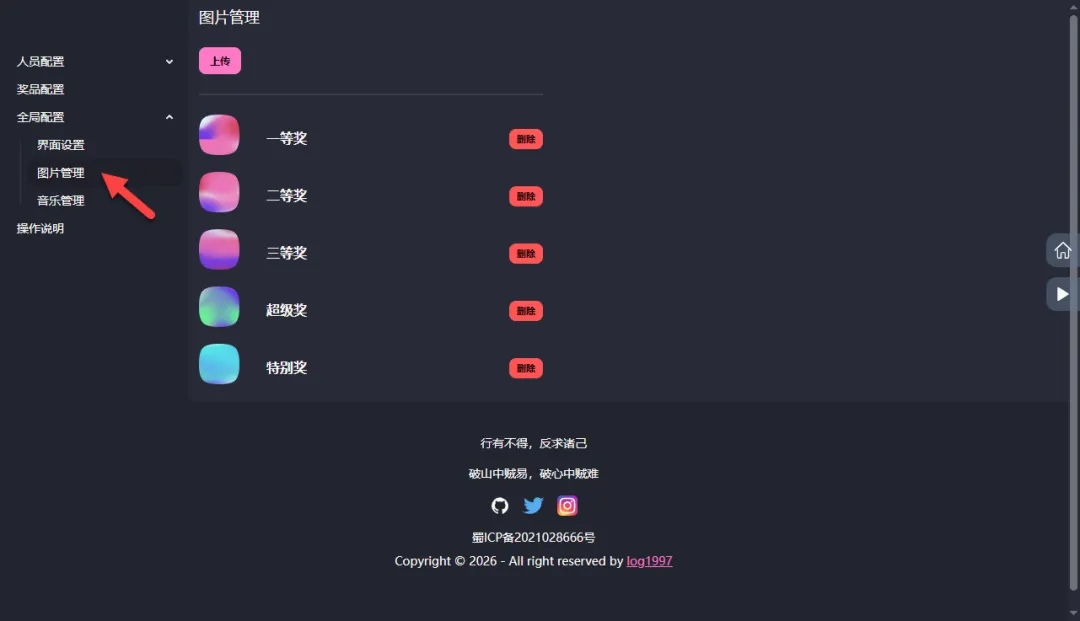

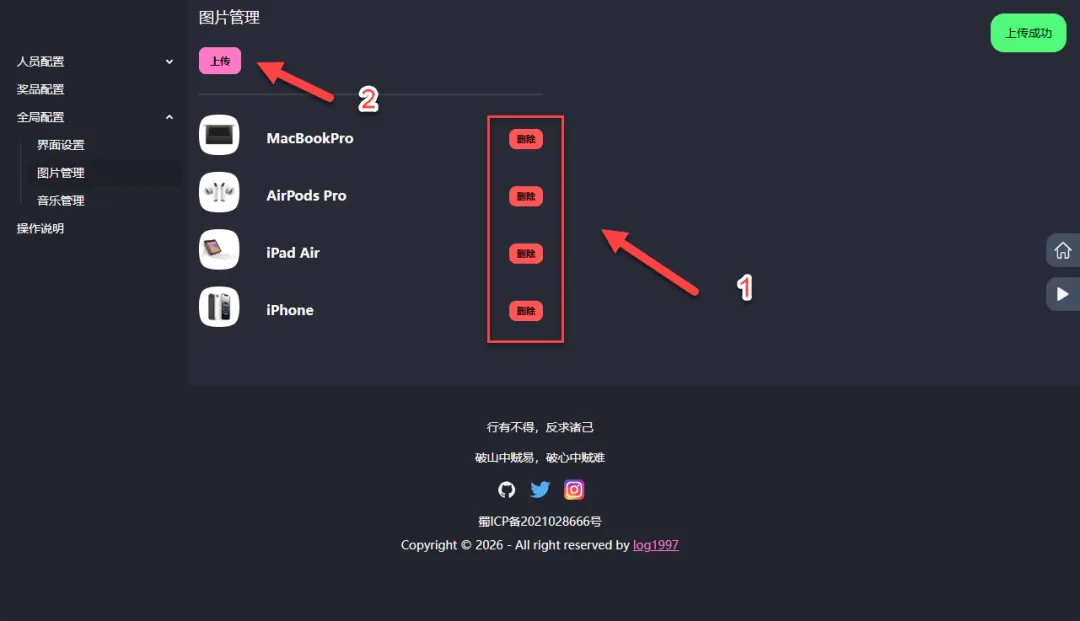

在全局配置中,选择图片管理选项。

建议先删除默认奖项,然后上传自定义的活动奖项图片,以匹配实际奖品。

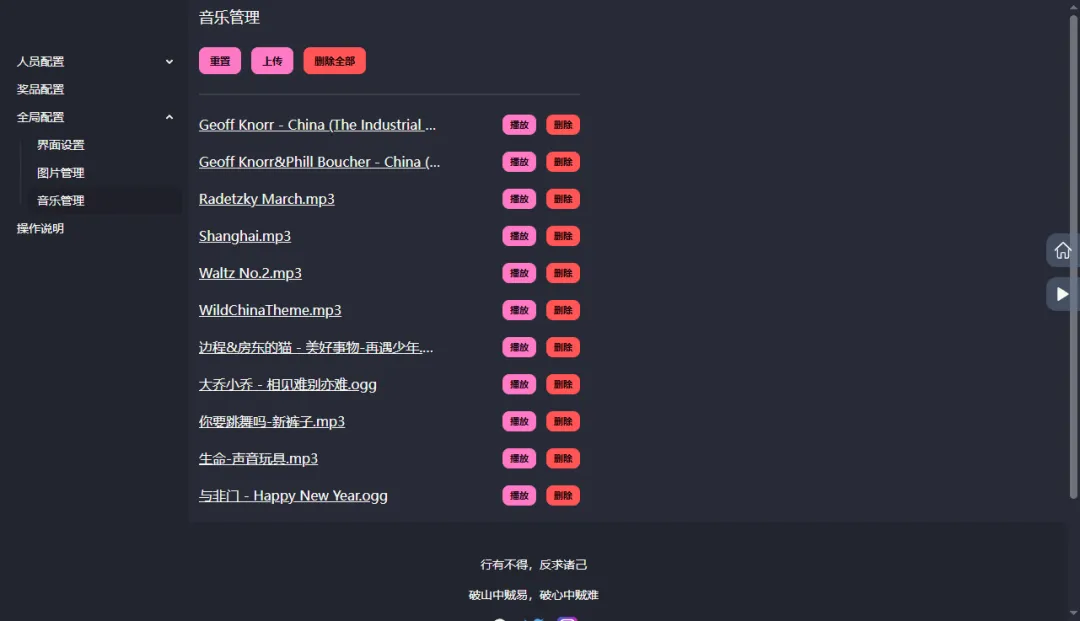

进入全局配置的音乐管理部分,根据需要设置背景音乐,增强活动氛围。

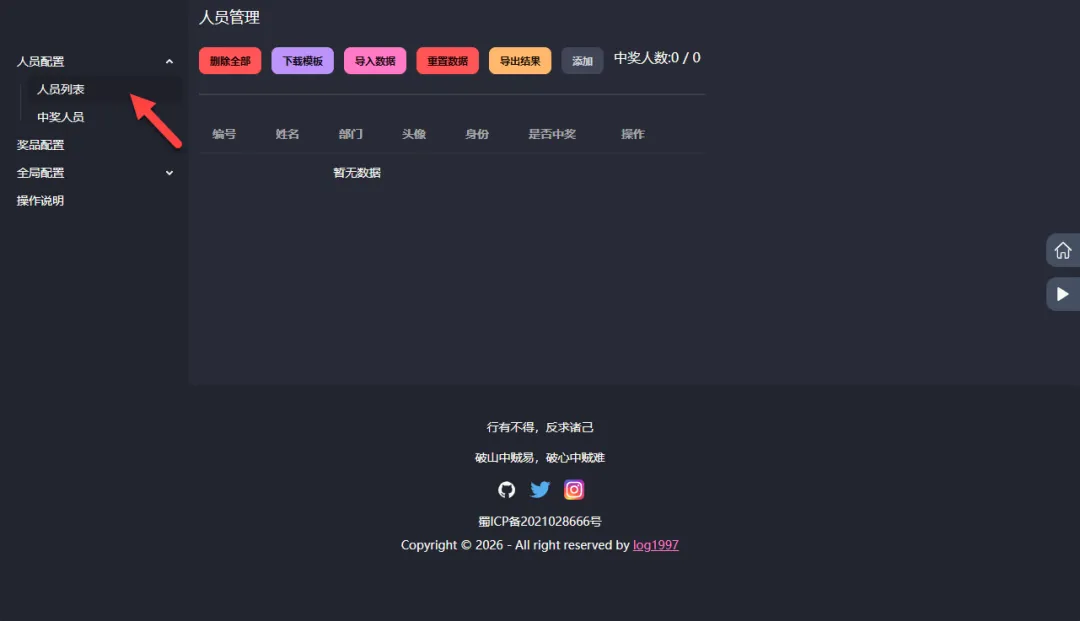

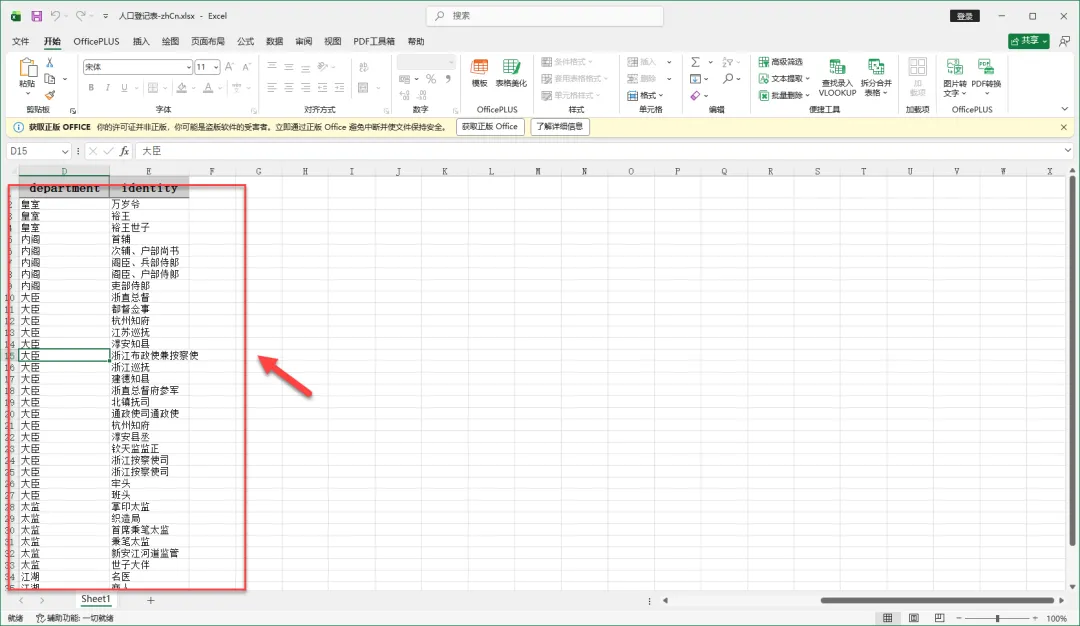

接下来,进入人员配置菜单,选择人员列表选项。

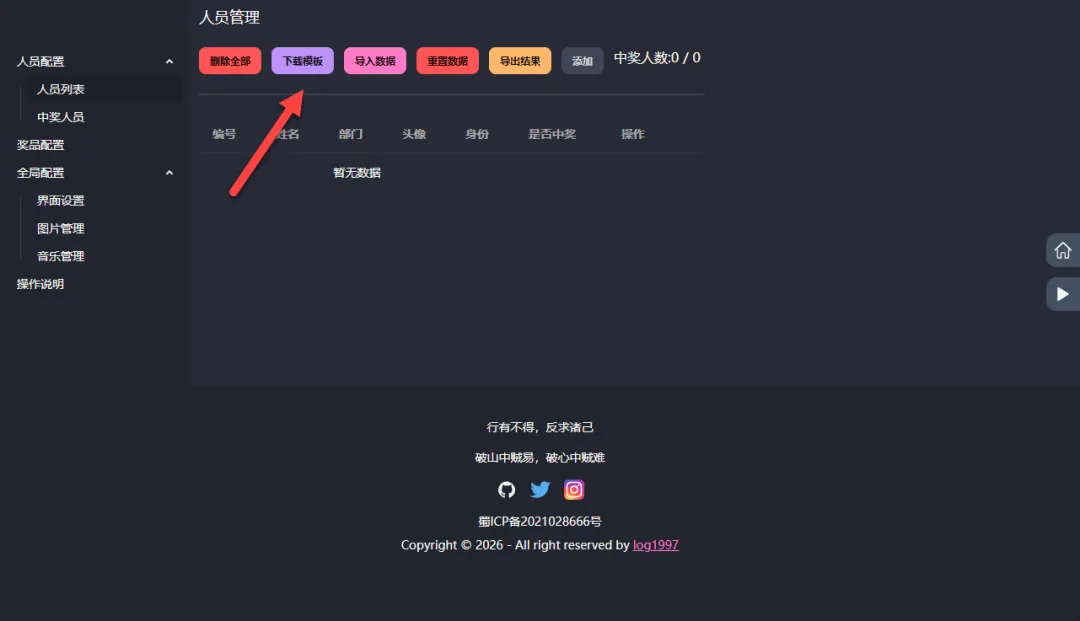

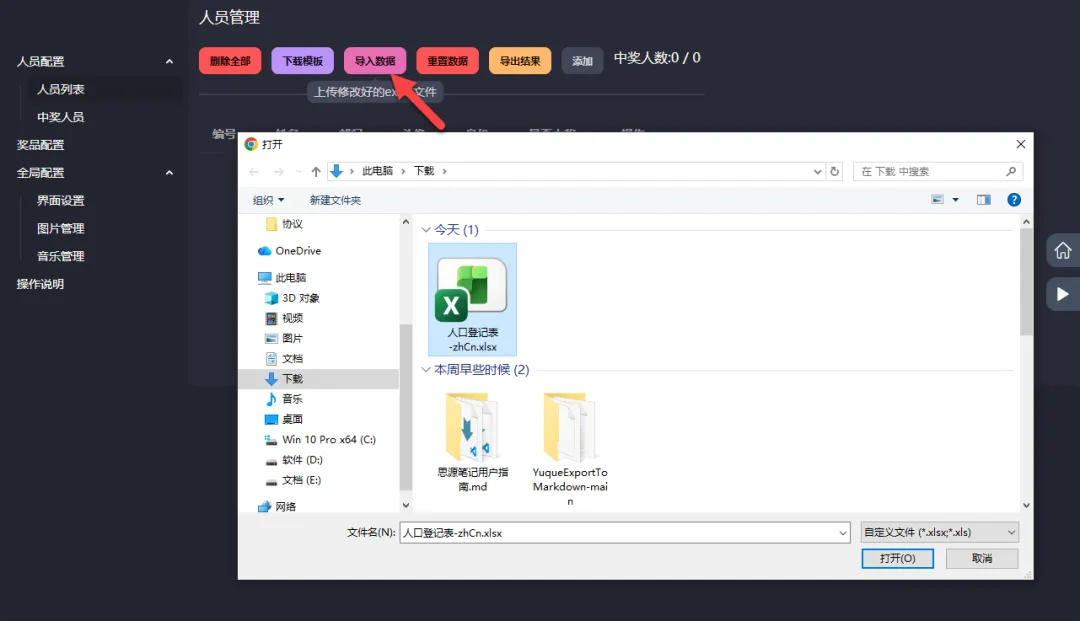

点击“下载模板”按钮,获取Excel格式的模板文件。

根据实际需求,在模板中修改部门和人员姓名,确保名单准确。

完成修改后,点击“导入数据”按钮,将名单上传至系统。

导入成功后,系统会显示确认信息。如有需要,您也可以手动添加人员数据,作为临时补充。

完成人员设置后,接下来配置奖品信息。

根据活动安排,设置奖品名称、数量和顺序等参数。

Logseq本地部署完整指南:轻松搭建个人知识库系统

Logseq是一款注重隐私保护的开源知识管理平台,它支持多种文件格式,例如Markdown和Org-mode,并集成了笔记管理、PDF标注、任务跟踪和白板绘制等多种功能。该平台拥有丰富的插件和主题生态系统,同时提供桌面端和移动端应用程序,方便用户随时随地进行知识整理与协作。

访问在线演示版本可以直接体验其基本功能:https://demo.logseq.com

Docker Compose快速部署

通过Docker Compose配置可以简化部署流程,以下是一个示例配置文件:

services:

logseq:

image: ghcr.io/logseq/logseq-webapp:latest

container_name: logseq

ports:

- 8080:80

restart: always

Logseq核心功能与界面操作

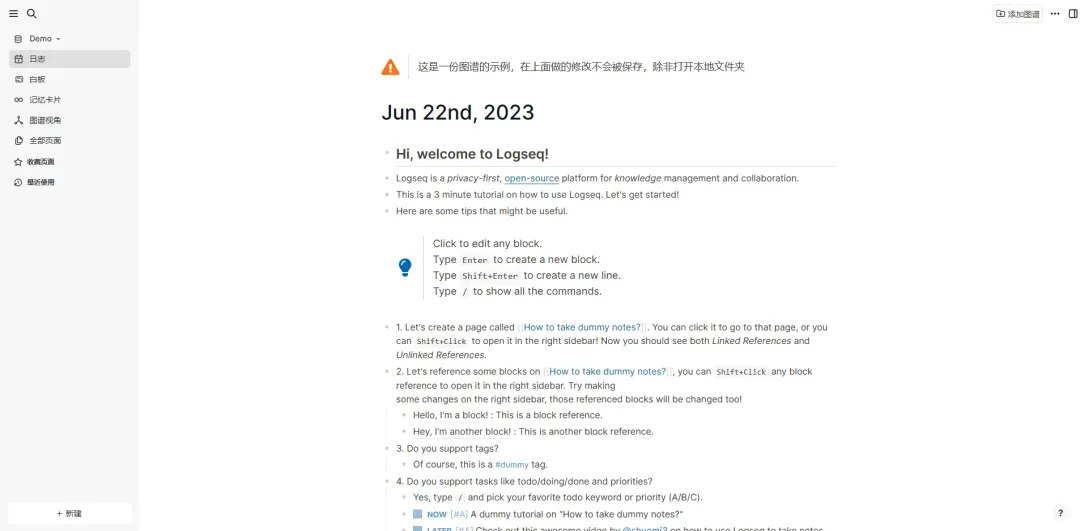

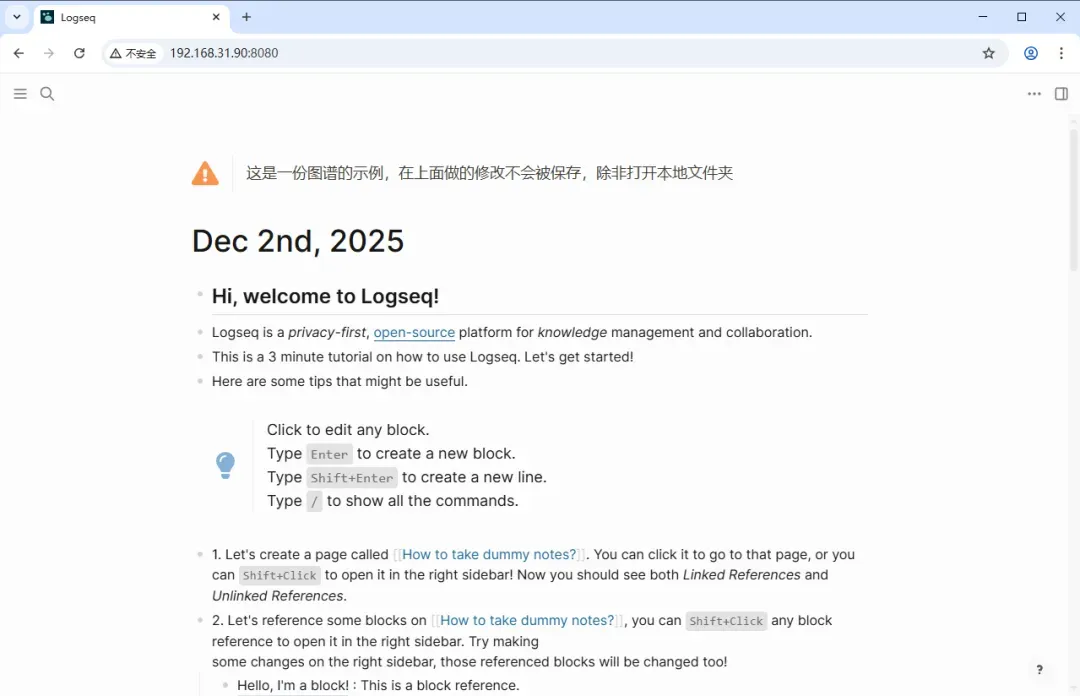

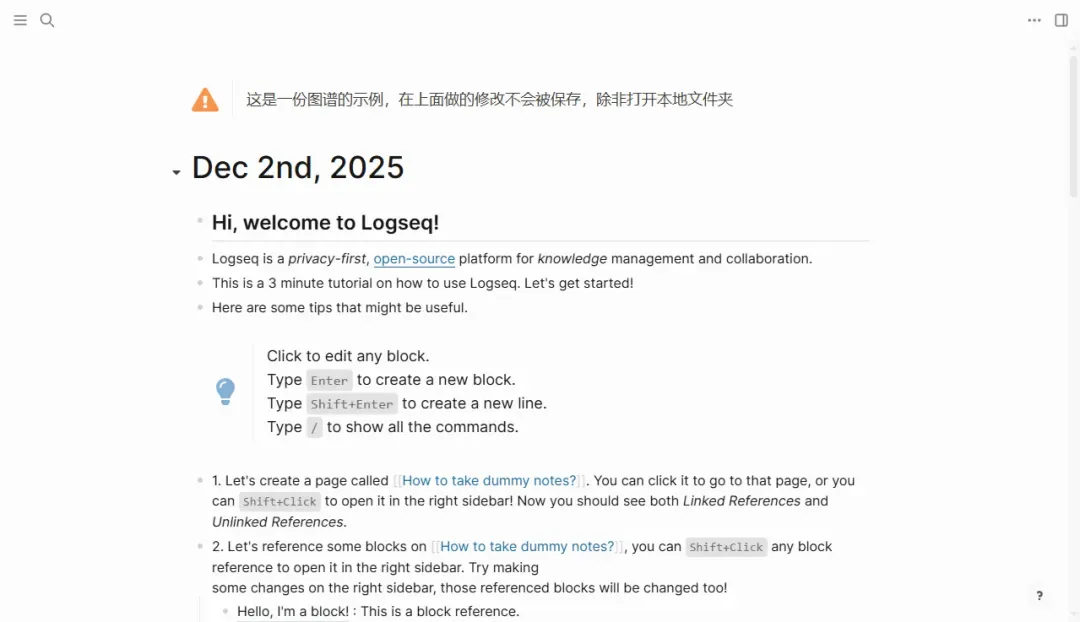

在浏览器地址栏输入http://NAS的IP:8080即可访问Logseq的Web界面。

初始界面会显示示例页面,系统对中文的良好支持使得本地化使用体验更为友好。

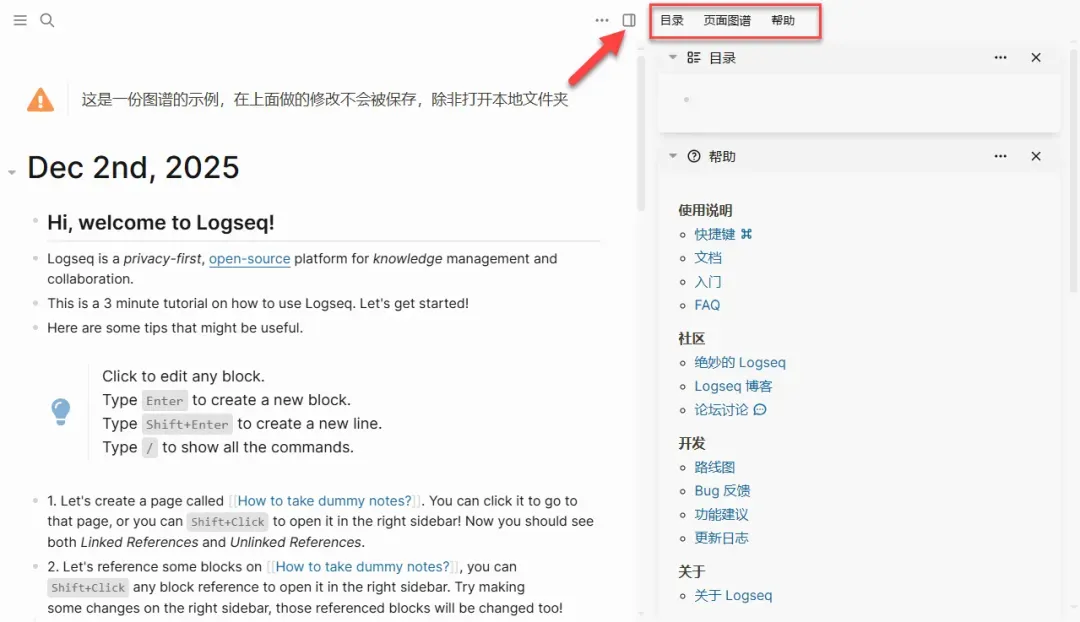

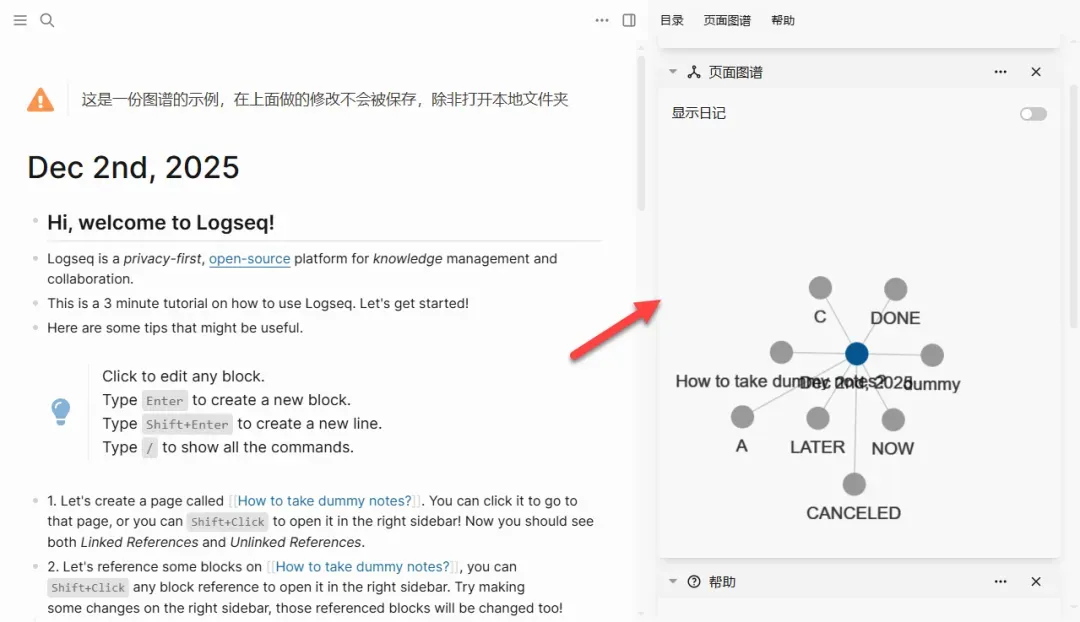

展开右侧边栏后,可以看到三个主要模块:目录列表、页面图谱和帮助文档。

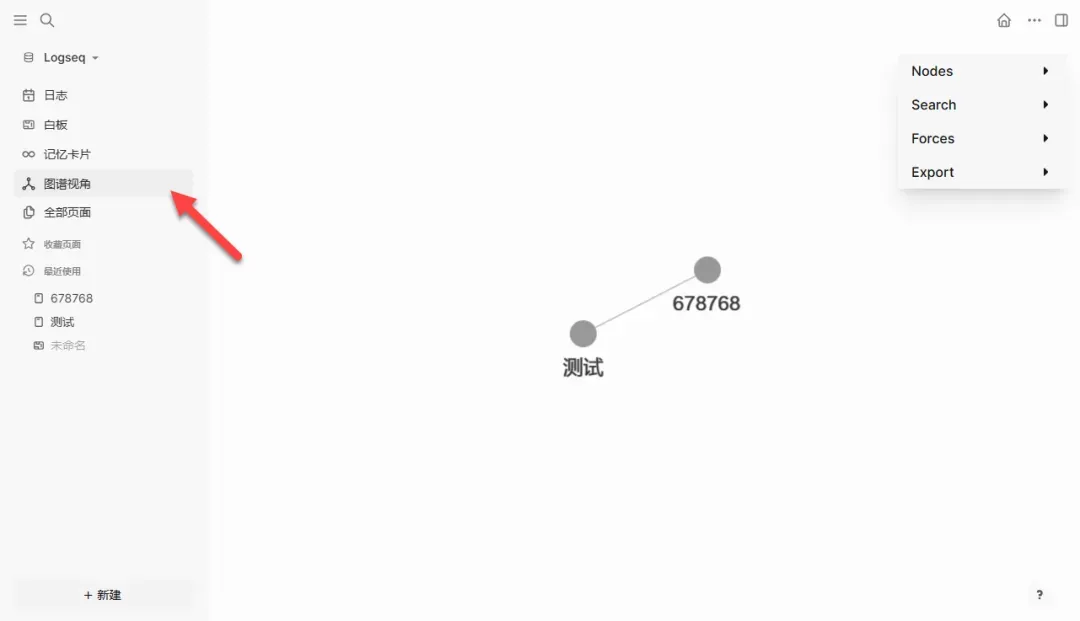

目录和帮助模块的功能较为直观,页面图谱则用于可视化展示双链笔记之间的关联关系。

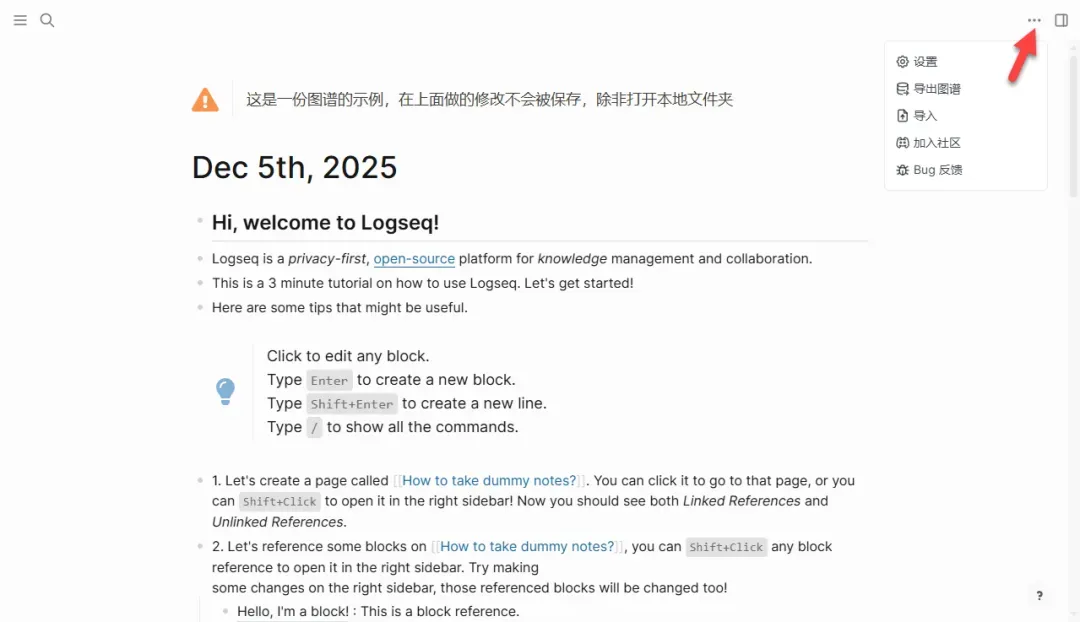

点击界面右上角的“更多”按钮,可以进入设置菜单,其中包含配置选项、数据导入和导出等功能。

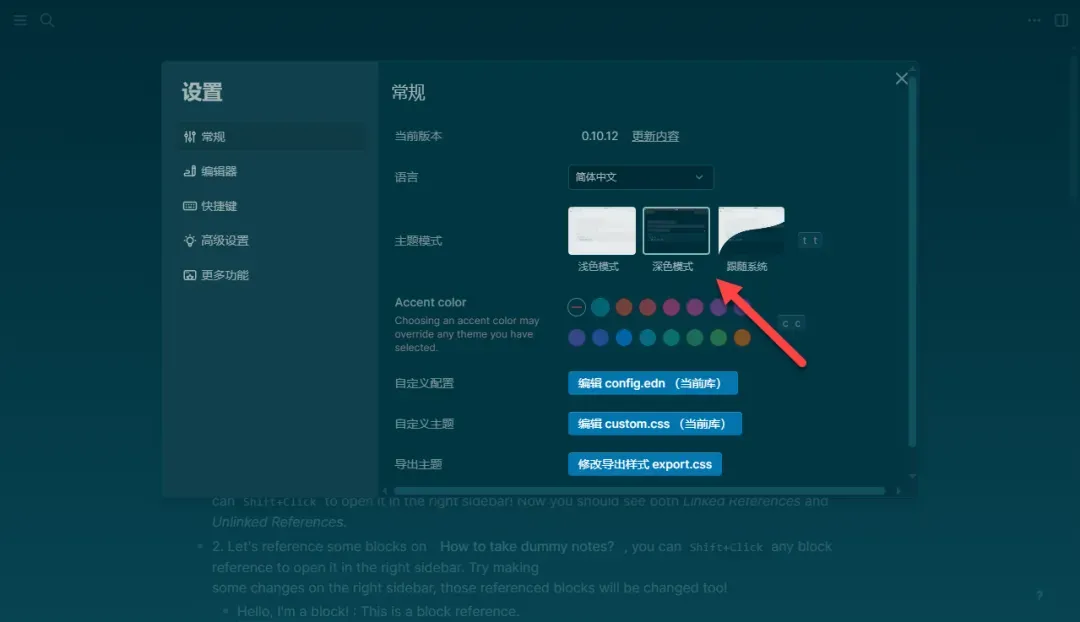

在设置中用户可以轻松切换深色主题模式,以适应不同光照环境下的使用需求。

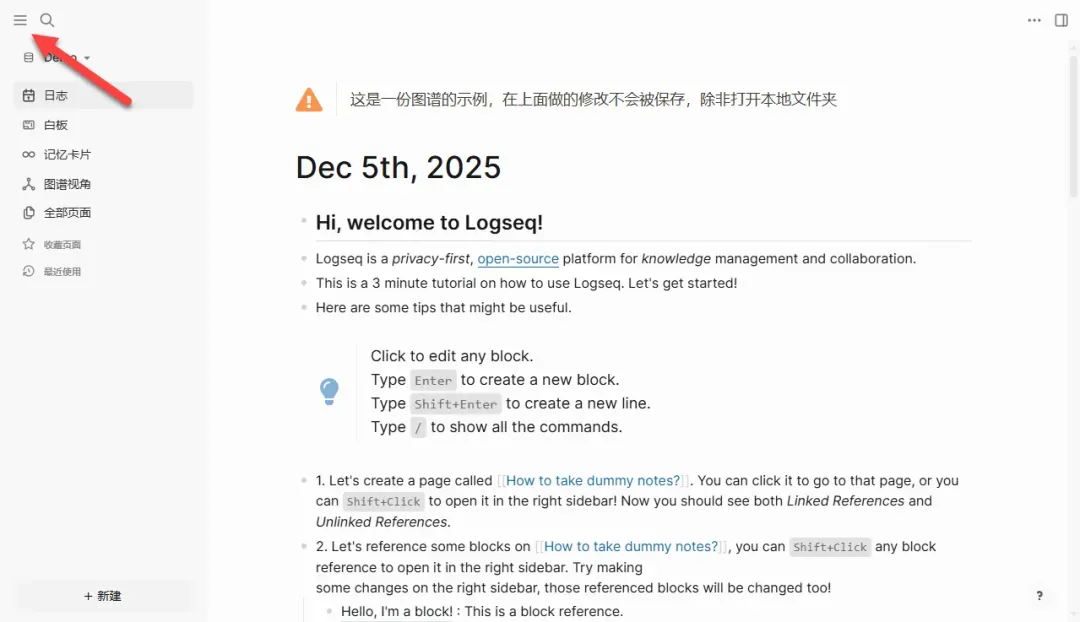

点击左侧导航栏可以进一步展开功能面板。

首次查看所有图谱时,系统通常会提示用户添加内容,因为初始状态下没有关联数据。

注意:如果未通过HTTPS协议访问,浏览器可能会提示不支持调用本地文件API接口。

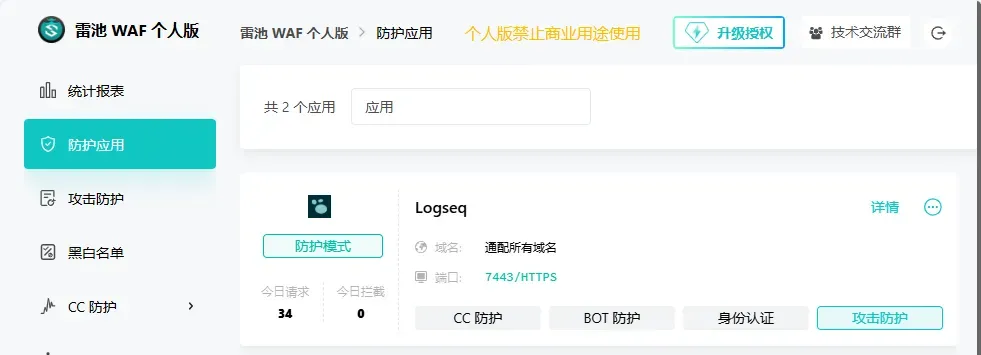

例如,可以通过雷池等工具实现HTTPS重定向来解决此问题,具体配置方法需根据实际环境进行调整。

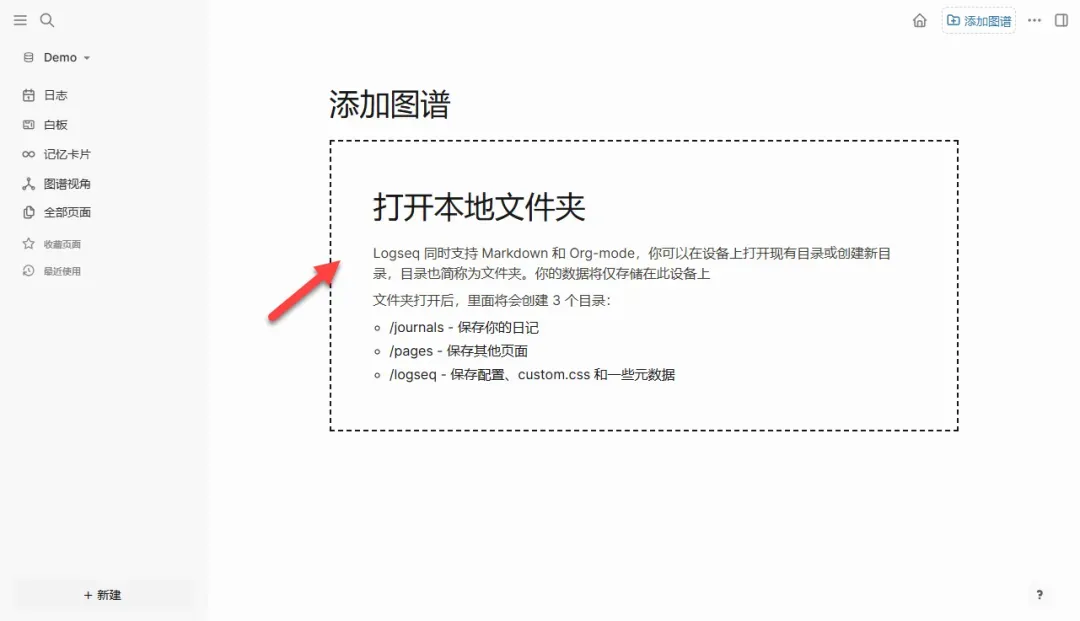

开始使用前,需要在本地创建一个空文件夹作为知识库的存储目录。

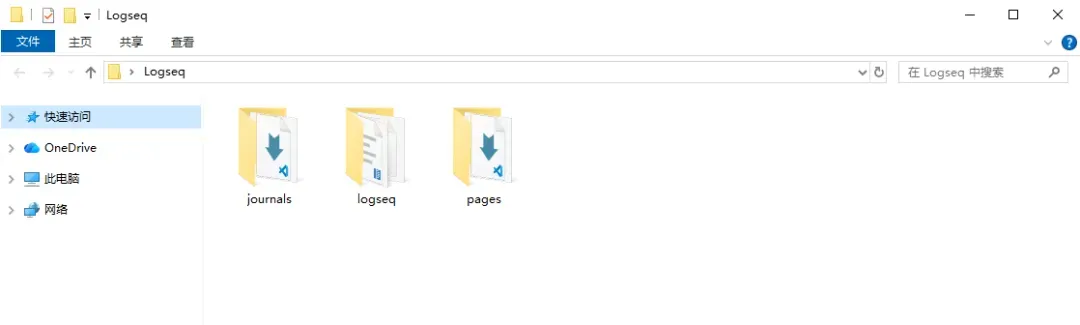

在页面中选择刚才创建的文件夹,系统会自动生成三个子文件夹,用于分类存放不同类型的文件。

日志页面会根据日期自动创建,并完整支持Markdown语法进行内容编辑。

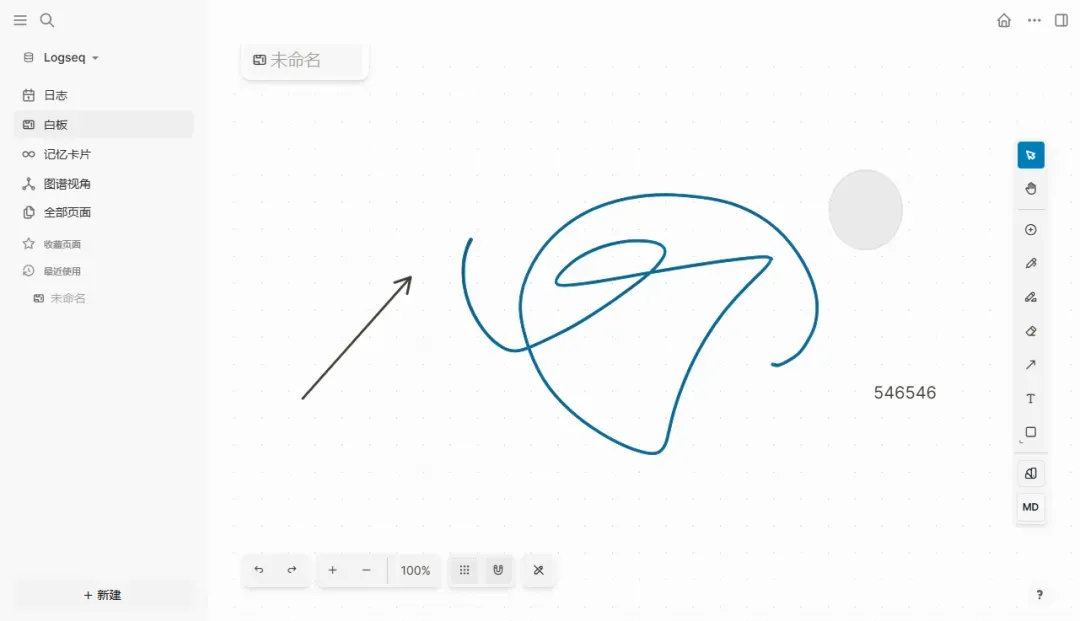

白板功能允许用户进行简单的绘图和标注,基本工具齐全,适合快速构思和可视化表达。

创建新页面操作顺畅,系统支持双向链接功能,便于建立知识节点之间的关联。

从图谱视角可以直观地查看所有双链关系,帮助用户梳理知识网络结构。

点击全部页面选项,可以浏览和管理已创建的所有页面内容。

整体评价与建议

Logseq作为一款以隐私为首要考虑的开源知识管理工具,提供了强大的Markdown编辑能力、知识图谱展示和白板协作功能,界面设计简洁且支持深色模式切换。通过Docker部署流程非常简单,只需映射端口即可运行,但需要注意的是,直接编辑NAS目录中的文件可能不够便捷,因为Web界面可能受限于文件API调用权限。

综合推荐指数:⭐⭐⭐(支持Markdown语法,适合本地离线使用)

实际使用体验:⭐⭐⭐(界面简洁,双链和Markdown功能完善)

部署难度等级:⭐(操作步骤极为简单)

Manga-Translator 一键部署指南:轻松实现漫画AI翻译与本地化

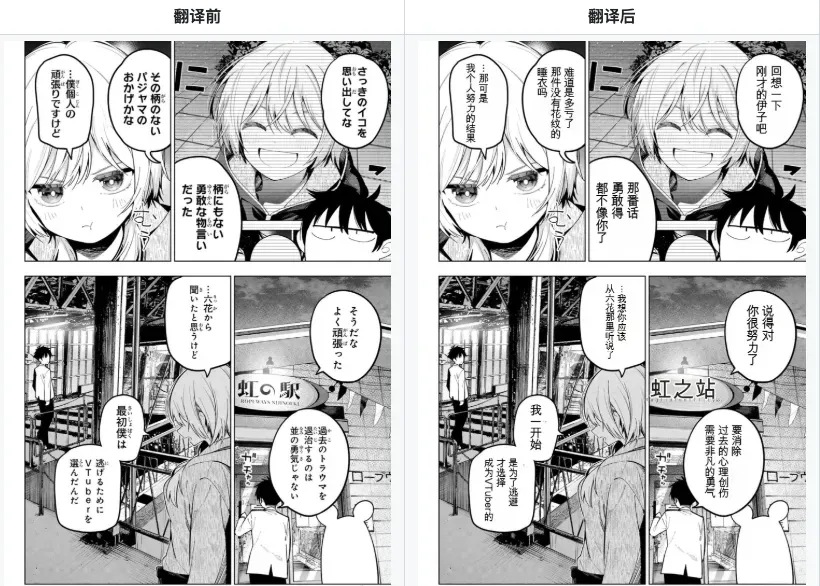

对于许多漫画爱好者而言,追更连载中的海外作品(生肉)是一大痛点。制作组往往有固定的发布计划,无法即时翻译最新内容。虽然英文漫画尚可阅读,但面对日文或韩文漫画时,理解剧情就变得异常困难。

本文将介绍一个能够解决此问题的AI工具项目:Manga-Translator。该项目支持通过 Docker 一键部署,能够自动识别、翻译并替换漫画图片中的文字,让您轻松享受“熟肉”。

Manga-Translator 项目概述

项目的完整名称为 hgmzhn/manga-translator-ui,您可以在 GitHub 上进行搜索以获取更详细的信息。项目主页提供了多平台部署指南及详细的配置使用说明。

该工具能够一键翻译漫画图片中的对话与文本,全面支持日漫、韩漫、美漫,无论是黑白漫画还是彩色漫画均可准确识别。其工作流程包括自动检测文字区域、识别(OCR)、翻译以及最后的文字嵌入(嵌字)。它支持日语、中文、英语等多种语言的互译。项目基于强大的 manga-image-translator 核心引擎开发,集成了以下主要特性:

✅ 核心功能一览

🔍 智能文本检测:自动精准定位漫画图像中的所有文字区域。

📝 多语言OCR引擎:支持对日语、中文、英语等多种语言的文字进行识别。

🌐 多种翻译引擎:提供 OPAI、Gemini(含普通与高质量模式)、Sakura 等多种翻译引擎,并兼容其他符合规范的AI翻译接口。

🎯 高质量上下文翻译:可利用支持多模态的AI模型(如 GPT-4o、Gemini),结合图像视觉上下文进行翻译,显著提升准确率与语境贴合度。

📚 自动术语管理与一致性维护:AI能够自动识别并积累漫画中的专有名词(如人名、地名、组织名),确保在长篇连载翻译中术语前后统一。

🎨 智能图像修复:自动擦除原始文字,并基于周围背景进行智能填充,使画面看起来自然无痕。

✍️ 自动化智能嵌字:自动为译文进行排版,支持多种字体、颜色、描边等样式自定义,让翻译结果如同原生作品。

🤖 AI辅助断句:在使用 OPAI、Gemini 等翻译器时,支持智能断句功能,使对话更符合阅读习惯。

📦 高效批量处理:支持一次性处理整个文件夹内的所有漫画图片,极大提升效率。

准备工作:获取AI能力密钥

由于翻译功能依赖于外部AI服务,因此您需要准备相应平台的 API Key。为了达到最佳翻译效果,强烈建议选择支持多模态(Multimodal)的模型。这类模型能够“看到”图片内容,结合视觉信息进行翻译,效果远胜于纯文本翻译。

项目支持 OPAI 及其兼容接口(如 DeepSeek、硅基流动等),这意味着您可以使用这些平台的API。本文后续演示将使用硅基流动的免费额度进行。

使用高质量多模态翻译引擎的优势在于:

📸 深度上下文理解:AI模型能分析图像场景,理解角色情绪和动作,从而给出更贴切的翻译。

🎯 翻译准确度飞跃:结合画面信息,可有效避免纯文本翻译产生的歧义。

📝 整体剧情把握:支持批量发送多张图片,有助于AI理解连贯的剧情发展。

🔧 高度自定义:支持通过提示词(Prompt)自定义翻译风格和术语表。

详细部署指南(以威联通NAS为例)

请注意:翻译效果的优劣很大程度上取决于您所使用的AI模型。 建议导入完整章节甚至整部漫画,以便AI更好地理解剧情脉络,获得更连贯的翻译结果。

以下将以威联通(QNAP)NAS为平台,使用 Docker Compose 方式进行部署演示。作者虽注明Docker部署为“试验性”功能,但实际体验稳定。

项目提供的原始部署命令如下:

# Windows CMD / PowerShell

docker run -d --name manga-translator -p 8000:8000 hgmzhn/manga-translator:latest-cpu

# Linux / macOS

docker run -d --name manga-translator -p 8000:8000 hgmzhn/manga-translator:latest-cpu

# CPU 版本:hgmzhn/manga-translator:latest-cpu

# GPU 版本:hgmzhn/manga-translator:latest-gpu

# 性能越强,体验越好

为了便于管理和持久化数据,我整理了以下 Docker Compose 配置: